일반 소개

Ostris의 AI 툴킷은 훈련 및 이미지 생성 작업을 위한 안정적인 확산 및 FLUX.1 모델을 지원하는 데 중점을 둔 오픈 소스 AI 툴셋입니다. 개발자 Ostris가 만들고 유지 관리하며 GitHub에서 호스팅하는 이 툴킷은 연구자와 개발자가 모델을 미세 조정하고 실험할 수 있는 유연한 플랫폼을 제공하는 것을 목표로 합니다. 여기에는 LoRA 추출, 일괄 이미지 생성, 레이어별 학습 등의 기능을 지원하는 다양한 AI 스크립트가 포함되어 있습니다. 이 프로젝트는 현재 개발 단계에 있으며 일부 기능은 충분히 안정적이지 않을 수 있지만, 사용자 지정 기능이 뛰어나 딥 러닝 분야의 고급 사용자에게 적합합니다. 이 툴셋은 Linux 및 Windows 시스템을 지원하며, FLUX.1 모델 트레이닝을 실행하려면 최소 24GB의 비디오 메모리를 갖춘 Nvidia GPU가 필요합니다.

기능 목록

- 모델 교육:: LoRA 및 LoKr 모델 학습을 위한 안정적인 확산 및 FLUX.1 모델 미세 조정을 지원합니다.

- 이미지 생성프로필 또는 텍스트 프롬프트를 기반으로 배치 이미지를 생성합니다.

- LoRA 추출 및 최적화모델 특징 추출을 최적화하기 위한 LoRA 및 LoCON 추출 도구를 제공합니다.

- 계층별 교육학습을 위해 특정 신경망 레이어를 선택하고 가중치를 유연하게 조정할 수 있습니다.

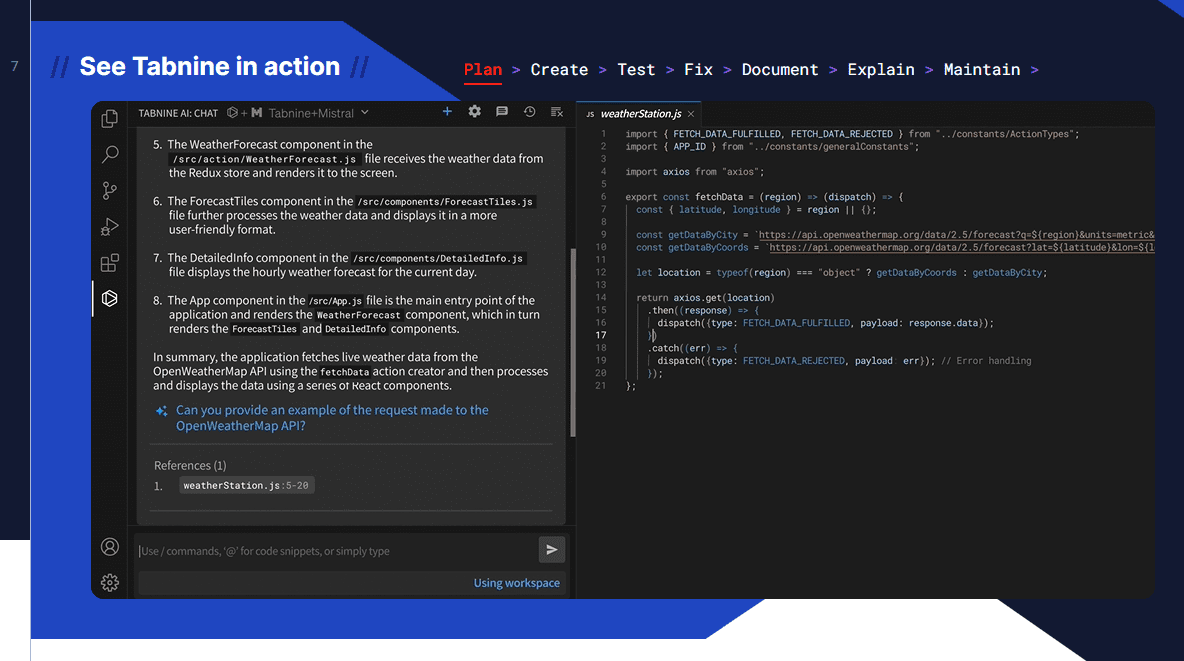

- 사용자 인터페이스 지원작업 관리 및 모델 학습 작업을 간소화할 수 있도록 AI 툴킷 UI와 Gradio UI를 제공합니다.

- 데이터 집합 처리이미지 해상도를 자동으로 조정하고 버킷별로 이미지를 그룹화하여 다양한 이미지 형식을 지원합니다.

- 클라우드 교육런팟 및 모달 플랫폼에서 트레이닝 작업 실행 지원.

도움말 사용

설치 프로세스

Linux 시스템 설치

- 클론 창고터미널에서 다음 명령을 실행하여 코드를 다운로드합니다:

git clone https://github.com/ostris/ai-toolkit.git

cd ai-toolkit

- 하위 모듈 업데이트모든 종속 라이브러리가 완료되었는지 확인합니다:

git submodule update --init --recursive

- 가상 환경 만들기파이썬 3.10 이상 사용:

python3 -m venv venv

source venv/bin/activate

- 종속성 설치파이토치를 먼저 설치한 다음 다른 종속 요소를 설치하세요:

pip3 install torch

pip3 install -r requirements.txt

Windows 시스템 설치

- 클론 창고명령 프롬프트에서 실행합니다:

git clone https://github.com/ostris/ai-toolkit.git

cd ai-toolkit

- 하위 모듈 업데이트:

git submodule update --init --recursive

- 가상 환경 만들기:

python -m venv venv

.\venv\Scripts\activate

- 종속성 설치CUDA 12.4를 지원하는 PyTorch 버전을 설치한 다음 다른 종속 요소를 설치합니다:

pip install torch==2.5.1 torchvision==0.20.1 --index-url https://download.pytorch.org/whl/cu124

pip install -r requirements.txt

UI 인터페이스 설치

- Node.js 설치시스템에 Node.js 18 이상이 설치되어 있는지 확인합니다.

- UI 구축: UI 디렉터리에 들어가 종속 요소를 설치합니다:

cd ui

npm install

npm run build

npm run update_db

- UI 실행시작 화면:

npm run start

- UI 액세스브라우저에 입력

http://localhost:8675.

주요 기능

FLUX.1 모델 교육

- 환경 준비하기디스플레이 출력에 사용되는 경우 구성 파일에서 설정한 24GB 이상의 비디오 메모리가 GPU에 있는지 확인합니다.

low_vram: true를 사용하여 CPU에서 모델을 정량화합니다. - FLUX.1-dev 구성:

- 허깅 페이스에 로그인하여 다음을 방문하세요.black-forest-labs/FLUX.1-dev를 클릭하고 라이선스를 수락합니다.

- 프로젝트 루트 디렉터리에서

.env파일에HF_TOKEN=你的读取密钥.

- FLUX.1-schnell 구성하기:

- 구성 파일을 편집합니다(예

train_lora_flux_schnell_24gb.yaml), 추가합니다:model: name_or_path: "black-forest-labs/FLUX.1-schnell" assistant_lora_path: "ostris/FLUX.1-schnell-training-adapter" is_flux: true quantize: true sample: guidance_scale: 1 sample_steps: 4

- 데이터 집합 준비하기루트 디렉터리에 생성

dataset폴더에.jpg및.jpeg어쩌면.png이미지와 해당.txt파일을 설명합니다. - 구성 파일 편집: 복제

config/examples/train_lora_flux_24gb.yaml(시간)까지config디렉토리의 이름을my_config.yml수정 사항folder_path는 데이터 세트 경로입니다. - 러닝 트레이닝:: 구현:

python run.py config/my_config.yml

교육 결과는 지정된 출력 폴더에 저장되며 Ctrl+C로 일시 중지하고 가장 최근 체크포인트부터 다시 시작할 수 있습니다.

Gradio UI를 사용한 교육

- 허깅 페이스에 로그인: 달리기

huggingface-cli login입력은 다음과 같습니다.write권한의 열쇠입니다. - 시작 UI:: 구현:

python flux_train_ui.py

- 작동 UI인터페이스에서 이미지를 업로드하고, 설명을 입력하고, 매개변수를 설정한 후 트레이닝을 클릭하면 완료 후 LoRA 모델을 게시할 수 있습니다.

클라우드에서의 교육(RunPod)

- 런팟 인스턴스 만들기템플릿 사용

runpod/pytorch:2.2.0-py3.10-cuda12.1.1-devel-ubuntu22.04에서 A40(48GB 비디오 메모리)을 선택합니다. - 설치 도구 세트주피터 노트북에 연결하고 터미널에서 Linux 설치 명령을 실행합니다.

- 데이터 집합 업로드루트 디렉터리에 생성

dataset폴더에서 이미지와 설명 파일을 끌어다 놓습니다. - 구성 및 실행의 구성 파일을 수정합니다.

folder_path구현python run.py config/my_config.yml.

데이터 집합 준비

- 서식 지정 요구 사항: 지원

.jpg및.jpeg및.png형식의 설명 파일은.txt파일 이름은 일관성이 있어야 합니다(예image1.jpg카운터파트image1.txt). - 설명:

.txt에 설명을 작성합니다.[trigger]플레이스홀더에 정의된 대로 구성 파일의trigger_word교체. - 자동 조정: 이 도구는 구성된 해상도에 따라 이미지를 자동으로 축소하고 그룹화하며, 확대는 지원되지 않습니다.

계층별 교육

- 구성 파일 편집: In

network부분적으로 추가되었습니다:

network:

type: "lora"

linear: 128

linear_alpha: 128

network_kwargs:

only_if_contains:

- "transformer.single_transformer_blocks.7.proj_out"

- "transformer.single_transformer_blocks.20.proj_out"

- 러닝 트레이닝: 수정된 구성 파일로 시작하여 지정된 레이어만 학습시킵니다.

주의

- 교육 중단파일이 손상되지 않도록 체크포인트를 저장하는 동안 Ctrl+C를 누르지 마세요.

- UI 보안UI는 현재 보안이 취약하고 공용 네트워크에 노출되는 것을 권장하지 않는 Linux에서만 테스트되었습니다.

- 도움 받기오스트리스 디스코드 커뮤니티에 가입하여 개발자에게 직접 비공개 메시지를 보내지 않고 질문할 수 있습니다.

© 저작권 정책

기사 저작권 AI 공유 서클 모두 무단 복제하지 마세요.

관련 문서

댓글 없음...