DuckDuckGoの検索APIを使い、ビッグモデルにネットワーク機能への無料アクセスを提供し、New Bingのような効果を狙う。

プロジェクト概要

統合によって DuckDuckGo 一般的な大規模言語モデルに似たものを与える検索API New Bing リアルタイムのウェブアクセスとインテリジェントなQ&A機能。既存の 関数呼び出し関数は、効率的で柔軟なクエリ処理と回答生成プロセスを実現します。

コアの実現

システムは Function calling クエリ処理と回答生成をシームレスに統合するためのメカニズム:

- クエリ分析と検索:クエリの使用

claude-3-haikuもしかしたらgpt-3.5-turboより単純なモデルは、最適化された検索語を生成し、関数呼び出しによって検索APIを呼び出す。 - ウェブ検索: DuckDuckGo APIを呼び出して、リアルタイムで情報検索を行う。

- インテリジェントな回答生成

claude-3-5-sonnnetもしかしたらgpt-4oこのような、より複雑なモデルは、検索結果とオリジナルの質問を組み合わせて、正確で包括的な回答を生成する。

コードの実装

1.環境設定と機能定義

import os

import json

from openai import OpenAI

from duckduckgo_search import DDGS

API_KEY = os.getenv("OPENAI_API_KEY")

BASE_URL = os.getenv("OPENAI_BASE_URL")

client = OpenAI(api_key=API_KEY, base_url=BASE_URL)

FUNCTIONS = [

{

"name": "search_duckduckgo",

"description": "使用DuckDuckGo搜索引擎查询信息。可以搜索最新新闻、文章、博客等内容。",

"parameters": {

"type": "object",

"properties": {

"keywords": {

"type": "array",

"items": {"type": "string"},

"description": "搜索的关键词列表。例如:['Python', '机器学习', '最新进展']。"

}

},

"required": ["keywords"]

}

}

]

2.関連補助機能

def search_duckduckgo(keywords):

search_term = " ".join(keywords)

with DDGS() as ddgs:

return list(ddgs.text(keywords=search_term, region="cn-zh", safesearch="on", max_results=5))

def print_search_results(results):

for result in results:

print(

f"标题: {result['title']}\n链接: {result['href']}\n摘要: {result['body']}\n---")

def get_openai_response(messages, model="gpt-3.5-turbo", functions=None, function_call=None):

try:

response = client.chat.completions.create(

model=model,

messages=messages,

functions=functions,

function_call=function_call

)

return response.choices[0].message

except Exception as e:

print(f"调用OpenAI API时出错: {str(e)}")

return None

def process_function_call(response_message):

function_name = response_message.function_call.name

function_args = json.loads(response_message.function_call.arguments)

print(f"\n模型选择调用函数: {function_name}")

if function_name == "search_duckduckgo":

keywords = function_args.get('keywords', [])

if not keywords:

print("错误:模型没有提供搜索关键词")

return None

print(f"关键词: {', '.join(keywords)}")

function_response = search_duckduckgo(keywords)

print("\nDuckDuckGo搜索返回结果:")

print_search_results(function_response)

return function_response

else:

print(f"未知的函数名称: {function_name}")

return None

3.主な加工機能

def main(question):

print(f"问题:{question}")

messages = [{"role": "user", "content": question}]

response_message = get_openai_response(

messages, functions=FUNCTIONS, function_call="auto")

if not response_message:

return

if response_message.function_call:

function_response = process_function_call(response_message)

if function_response:

messages.extend([

response_message.model_dump(),

{

"role": "function",

"name": response_message.function_call.name,

"content": json.dumps(function_response, ensure_ascii=False)

}

])

final_response = get_openai_response(messages, model="gpt-4o")

if final_response:

print("\n最终回答:")

print(final_response.content)

else:

print("\n模型直接回答:")

print(response_message.content)

実現

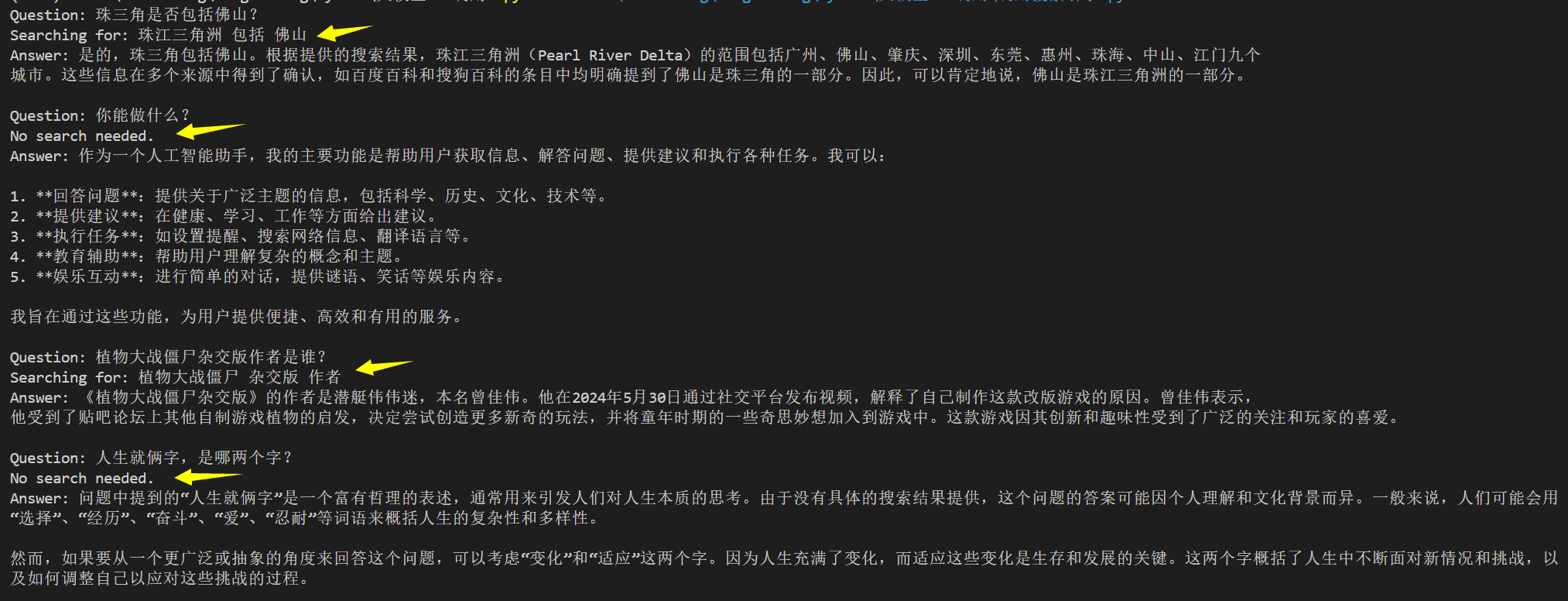

このようにして、例えば様々な質問に答えることができる大規模なモデルを作ることができる:

- 地理情報:"PRDは仏山を含むのか?"

- AI自身の能力に関する質問、"何ができるのか?"

- ドメイン固有の質問、"Plants vs. Zombies Hybridの作者は誰ですか?"

- 哲学的雑感:"人生には2つの言葉がある。

- "ジャンピング不平等とは何か "に関連する時事問題

- 時間に関する質問:「現在の北京時間は?

フルコード

import os

import json

from openai import OpenAI

from duckduckgo_search import DDGS

API_KEY = os.getenv("OPENAI_API_KEY")

BASE_URL = os.getenv("OPENAI_BASE_URL")

client = OpenAI(api_key=API_KEY, base_url=BASE_URL)

FUNCTIONS = [

{

"name": "search_duckduckgo",

"description": "使用DuckDuckGo搜索引擎查询信息。可以搜索最新新闻、文章、博客等内容。",

"parameters": {

"type": "object",

"properties": {

"keywords": {

"type": "array",

"items": {"type": "string"},

"description": "搜索的关键词列表。例如:['Python', '机器学习', '最新进展']。"

}

},

"required": ["keywords"]

}

}

]

def search_duckduckgo(keywords):

search_term = " ".join(keywords)

with DDGS() as ddgs:

return list(ddgs.text(keywords=search_term, region="cn-zh", safesearch="on", max_results=5))

def print_search_results(results):

for result in results:

print(

f"标题: {result['title']}\n链接: {result['href']}\n摘要: {result['body']}\n---")

def get_openai_response(messages, model="gpt-3.5-turbo", functions=None, function_call=None):

try:

response = client.chat.completions.create(

model=model,

messages=messages,

functions=functions,

function_call=function_call

)

return response.choices[0].message

except Exception as e:

print(f"调用OpenAI API时出错: {str(e)}")

return None

def process_function_call(response_message):

function_name = response_message.function_call.name

function_args = json.loads(response_message.function_call.arguments)

print(f"\n模型选择调用函数: {function_name}")

if function_name == "search_duckduckgo":

keywords = function_args.get('keywords', [])

if not keywords:

print("错误:模型没有提供搜索关键词")

return None

print(f"关键词: {', '.join(keywords)}")

function_response = search_duckduckgo(keywords)

print("\nDuckDuckGo搜索返回结果:")

print_search_results(function_response)

return function_response

else:

print(f"未知的函数名称: {function_name}")

return None

def main(question):

print(f"问题:{question}")

messages = [{"role": "user", "content": question}]

response_message = get_openai_response(

messages, functions=FUNCTIONS, function_call="auto")

if not response_message:

return

if response_message.function_call:

if not response_message.content:

response_message.content = ""

function_response = process_function_call(response_message)

if function_response:

messages.extend([

response_message.model_dump(),

{

"role": "function",

"name": response_message.function_call.name,

"content": json.dumps(function_response, ensure_ascii=False)

}

])

final_response = get_openai_response(messages, model="gpt-4o")

if final_response:

print("\n最终回答:")

print(final_response.content)

else:

print("\n模型直接回答:")

print(response_message.content)

if __name__ == "__main__":

main("植物大战僵尸杂交版的作者是谁?他是怎么想到做出来这个游戏的?")

© 著作権表示

記事の著作権 AIシェアリングサークル 無断転載はご遠慮ください。

関連記事

コメントはありません