Qwen2.5-Max basado en la arquitectura MoE supera completamente a DeepSeek V3

Resumen de modelos

En los últimos años, el entrenamiento de grandes modelos basado en la arquitectura de Mezcla de Expertos (MoE) se ha convertido en una importante línea de investigación en el campo de la inteligencia artificial. El equipo de Qwen ha lanzado recientemente el modelo Qwen2.5-Max, que emplea más de 20 billones de tokens de datos de pre-entrenamiento y un esquema de post-entrenamiento refinado, y ha hecho grandes avances en la aplicación a escala de la arquitectura MoE. avances. El modelo ya está disponible enInterfaz APItal vezChat de Qwenplataforma para la experiencia.

Características técnicas

1. Innovaciones en la arquitectura de los modelos

- Optimización de sistemas expertos híbridos: Asignación eficiente de recursos informáticos mediante mecanismos dinámicos de encaminamiento

- Escalabilidad multimodalAdmite múltiples tipos de entradas y salidas, como texto, datos estructurados, etc.

- mejora de la contextualizaciónEntrada máxima: 30.720 tokens, puede generar texto continuo de hasta 8.192 tokens.

2. Matriz funcional básica

| dimensión funcional | Indicadores técnicos |

|---|---|

| Soporte multilingüe | Cobertura de 29 idiomas (incluido chino/inglés/francés/español, etc.) |

| capacidad de cálculo | Operaciones matemáticas complejas y generación de código |

| Tratamiento estructurado | Generación y análisis sintáctico de datos JSON/tabla |

| comprensión contextual | Generación de concatenación de texto largo de 8K tokens |

| idoneidad de la aplicación | Sistemas de diálogo/análisis de datos/razonamiento basado en el conocimiento |

Evaluación del rendimiento

Comparación de modelos de mando

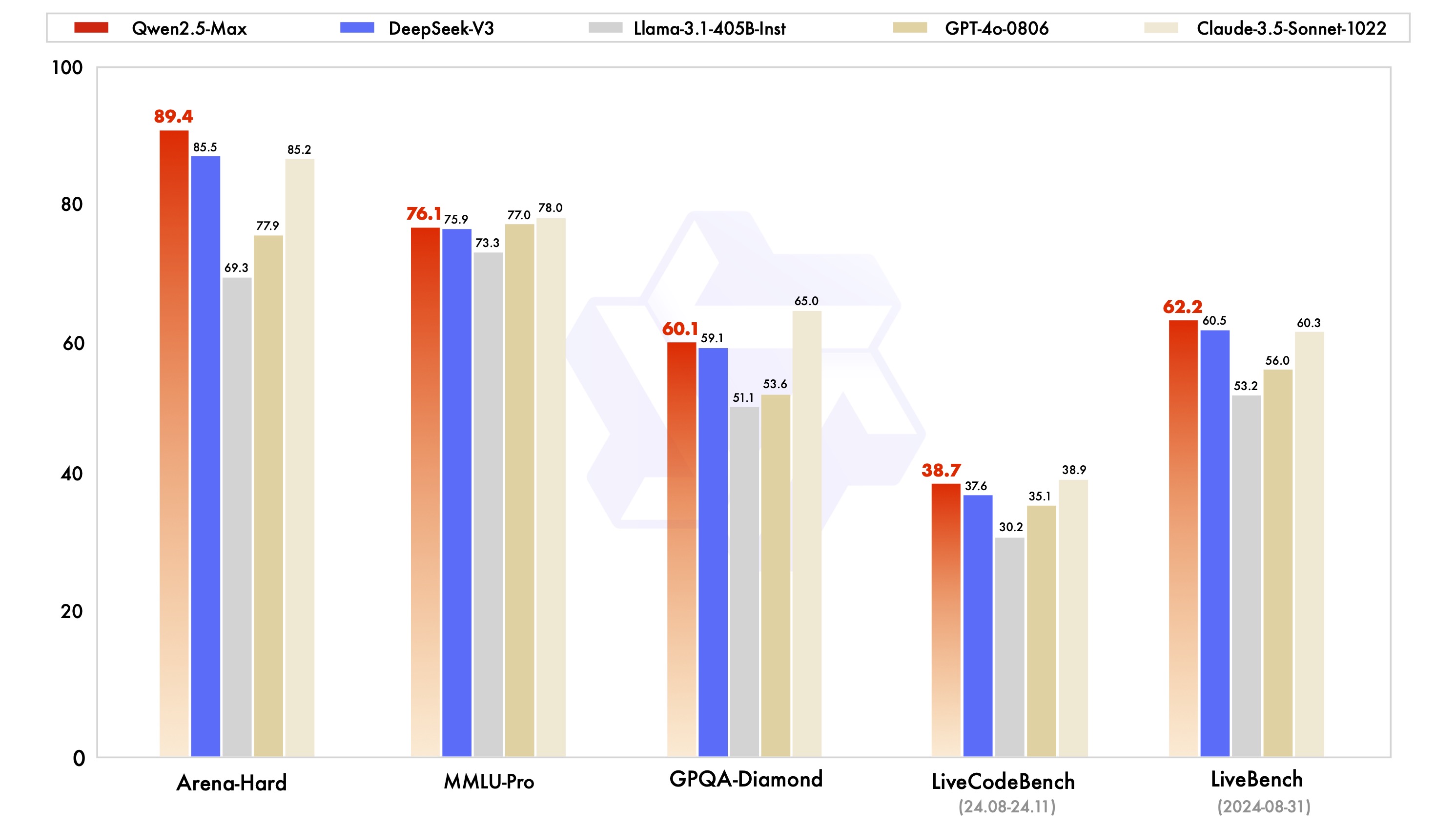

Qwen2.5-Max muestra una competitividad significativa en pruebas de referencia como MMLU-Pro (prueba de conocimientos universitarios), LiveCodeBench (evaluación de la capacidad de programación) y Arena-Hard (simulación de preferencias humanas):

Los datos de las pruebas muestran que el modelo supera a DeepSeek V3 en las dimensiones de capacidad de programación (LiveCodeBench) y razonamiento integrado (LiveBench), y alcanza el máximo nivel en la prueba de razonamiento de alto orden GPQA-Diamond.

Comparación del modelo base

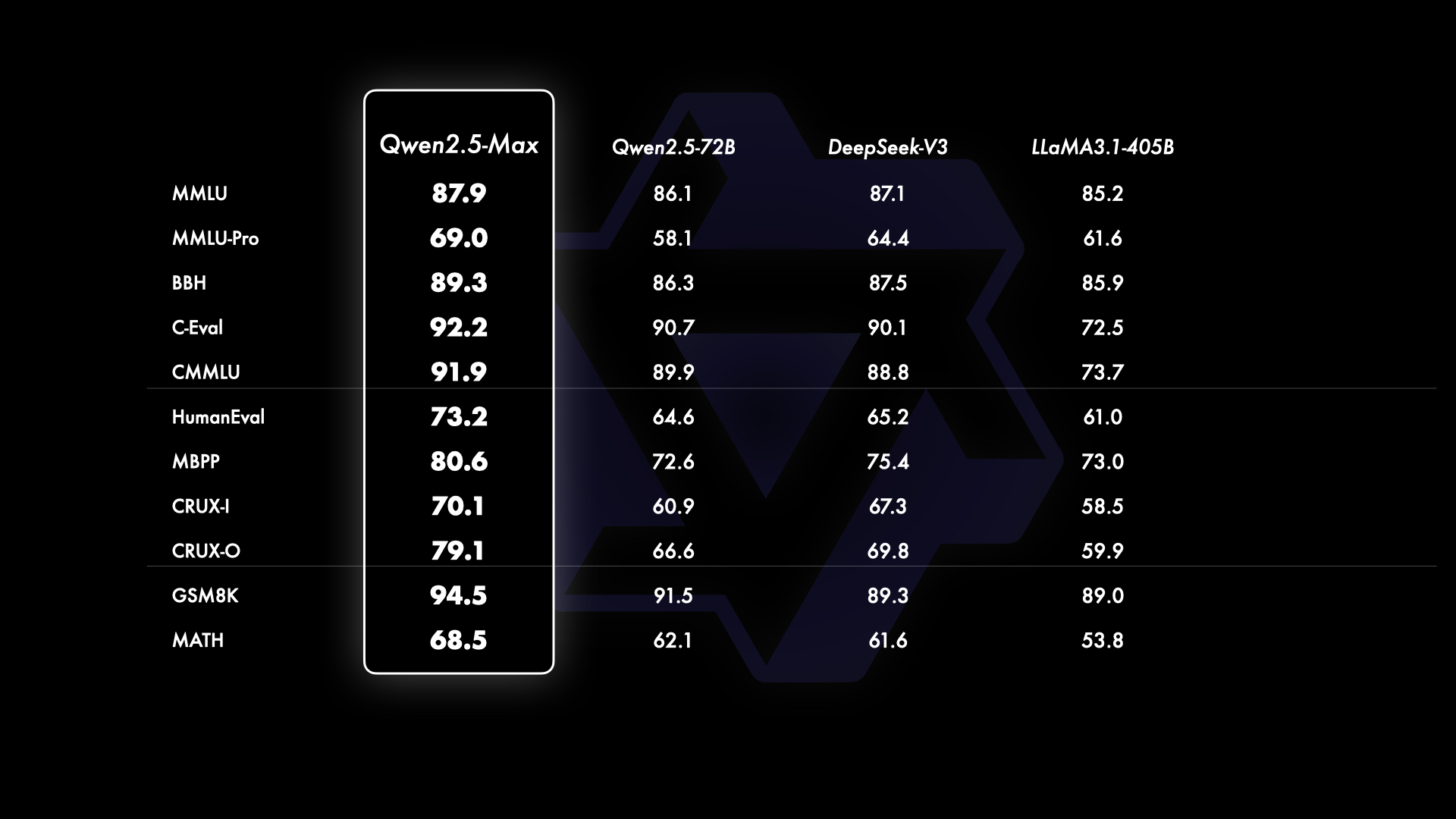

En comparación con los principales modelos de código abierto, Qwen2.5-Max demuestra ventajas técnicas a nivel de capacidades básicas:

Comparando Llama-3.1 con una escala de parámetros de 405B y Qwen2.5-72B con parámetros de 720B, Qwen2.5-Max mantiene la ventaja en la mayoría de los ítems de la prueba, validando la eficacia de la arquitectura MoE en el escalado de modelos.

Acceso y uso

1. Acceso a la API de la nube

from openai import OpenAI

import os

client = OpenAI(

api_key=os.getenv("API_KEY"),

base_url="https://dashscale.aliyuncs.com/compatible-mode/v1",

)

response = client.chat.completions.create(

model="qwen-max-2025-01-25",

messages=[

{'role':'system', 'content':'设定AI助手角色'},

{'role':'user', 'content':'输入查询内容'}

]

)

2. Experiencia interactiva

- entrevistasEspacio de demostración Hugging Face

- Botón Ejecutar para cargar el modelo

- Interacción en tiempo real mediante un cuadro de texto

3. Despliegue en la empresa

- inscripciónCuenta Aliyun

- Lanzamiento de una gran plataforma de servicios modelo

- Crear claves API para la integración de sistemas

Dirección de la evolución tecnológica

La versión actual se optimiza continuamente en los siguientes ámbitos:

- Estrategias de mejora de la calidad de los datos tras la formación

- Colaboración multidisciplinar para optimizar la eficiencia

- Aceleración del razonamiento con bajo consumo de recursos

- Desarrollo de interfaces multimodales ampliadas

perspectivas de futuro

La mejora continua de la escala de datos y de la escala de parámetros del modelo puede mejorar eficazmente el nivel de inteligencia del modelo. A continuación, seguiremos explorando, además del escalado del preentrenamiento, invertiremos enérgicamente en el escalado del aprendizaje por refuerzo, con la esperanza de lograr una inteligencia superior a la de los seres humanos e impulsar la IA para explorar el reino desconocido.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...