OpenAI comenzó a ofrecer Prompt Caching para modelos de gran tamaño (modelos de la serie GPT): el precio de las entradas de los modelos de la serie GPT-4o se redujo a la mitad y la velocidad de acceso aumentó en 801 TP3T.

En las aplicaciones de grandes modelos, el procesamiento de peticiones complejas suele ir acompañado de una latencia y un coste elevados, especialmente cuando hay mucha repetición en el contenido de la petición. Este problema de "solicitud lenta" es especialmente importante en escenarios con solicitudes largas e interacciones de alta frecuencia. Para hacer frente a este problema, OpenAI ha introducido recientemente la solución Caché de avisos Función. Esta nueva tecnología evita el doble cómputo al almacenar en caché la misma porción de prefijo procesada por el modelo, lo que reduce significativamente el tiempo de respuesta y los costes asociados a la solicitud. Especialmente en el caso de solicitudes de sugerencias largas con contenido estático, el almacenamiento en caché de sugerencias puede mejorar significativamente la eficiencia y reducir la sobrecarga operativa. En este artículo, presentaremos en detalle cómo funciona esta función, los modelos compatibles y cómo optimizar la tasa de aciertos de la caché mediante una estructura de sugerencias razonable para ayudar a los desarrolladores a mejorar la experiencia de uso de modelos de gran tamaño.

¿Qué es el caché de petición de modelo grande (Prompt Caching)?

El caché de avisos es un mecanismo utilizado para reducir la latencia y el coste computacional del procesamiento de avisos largos con contenido repetido. En este contexto, una "sugerencia" se refiere a la entrada que envías al modelo. En lugar de recalcular los N primeros tokens de entrada de una sugerencia cada vez durante el proceso de solicitud, el sistema almacena en caché los resultados de los cálculos anteriores. En lugar de recalcular los primeros N tokens de entrada de una pista cada vez durante el proceso de solicitud, el sistema almacena en caché los resultados de los cálculos anteriores para poder reutilizar los datos almacenados en caché en solicitudes posteriores con el mismo prefijo de pista, lo que acelera el procesamiento, reduce la latencia y ahorra costes.

En términos sencillos, la caché de sugerencias funciona de la siguiente manera:

- Almacenar en caché los primeros 1024 tokens El sistema comprueba si los primeros 1024 tokens del contenido de la petición son los mismos que los de la petición anterior, y si lo son, almacena en caché el cálculo de esos tokens.

- acierto de caché Cuando una nueva solicitud coincide con un indicio almacenado en caché, lo denominamos "acierto de caché". En ese momento, la respuesta contendrá información detallada sobre el token de caché, lo que ayudará a reducir el tiempo y el coste de cálculo.

- reducir costes : en Tipo de despliegue estándar en el que los tokens almacenados en caché se facturarán a un precio con descuento; mientras que en el Tipos de despliegue preconfigurados en el que las etiquetas de caché pueden incluso obtener un descuento 100%.

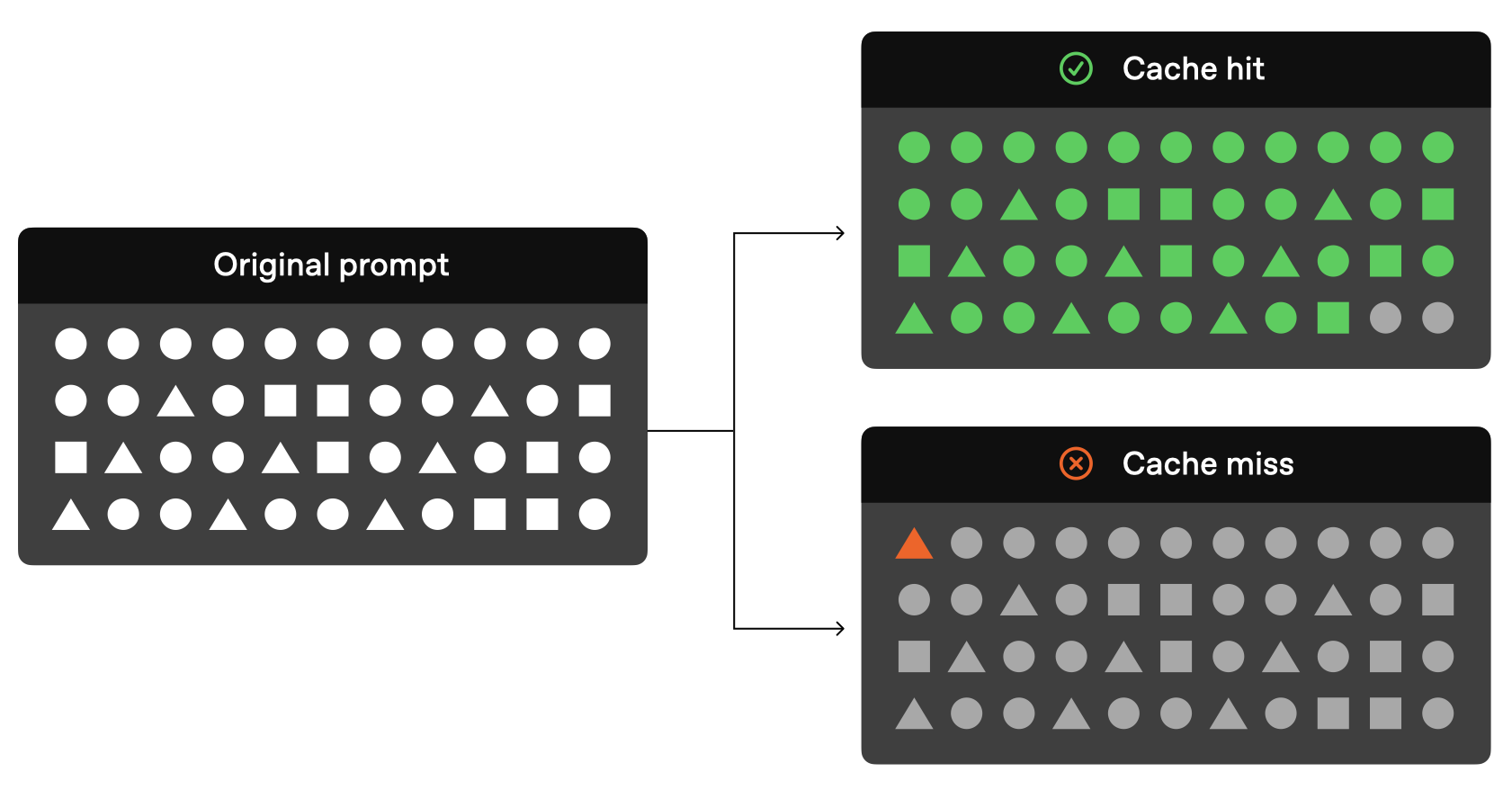

Se ofrece oficialmente un esquema muy gráfico del almacenamiento en caché de los tacos:

Como se puede ver en la figura anterior, si los tokens anteriores en su solicitud original son los mismos que la solicitud anterior, esa parte de la solicitud se puede resolver no a través del modelo, sino simplemente leer directamente a través de los resultados almacenados en caché.

Actualmente, OpenAI proporciona oficialmente los siguientes modelos almacenables en caché:

| modelización | Costes de entrada de texto | Costes de entrada de audio |

|---|---|---|

| gpt-4o (excepto gpt-4o-2024-05-13 y chatgpt-4o-latest) | 50% baratos | inaplicable |

| gpt-4o-mini | 50% baratos | inaplicable |

| gpt-4o-realtime-preview | 50% baratos | Barato 80% |

| o1-vista previa | 50% baratos | inaplicable |

| o1-mini | 50% baratos | inaplicable |

Los modelos actuales que admiten cue caching (p. ej., gpt-4o, gpt-4o-mini, gpt-4o-realtime-preview, etc.) son todos eficaces para reducir el coste de la entrada de texto, especialmente con el descuento de coste de 50%, y el modelo gpt-4o-realtime-preview disfruta incluso del descuento de coste de 80% al procesar la entrada de audio. El soporte de estos modelos no sólo mejora la eficacia de respuesta del modelo, sino que también proporciona a los desarrolladores una solución de bajo coste y alto rendimiento, especialmente para escenarios que requieren repeticiones frecuentes de peticiones o contienen grandes cantidades de contenido estático.

Cómo funciona la caché de sugerencias

De acuerdo con la documentación oficial actual de OpenAI, deben cumplirse las siguientes condiciones para que tu solicitud pueda utilizar la caché:

- La longitud de la pregunta debe ser como mínimo 1024 etiquetas .

- incitado Primeras 1024 etiquetas Debe estar en una solicitud posterior idéntico .

Además, hay que tener en cuenta que, oficialmente, los 1024 tokens iniciales son la longitud mínima de la caché, pero los 128 tokens incrementales de los aciertos posteriores, es decir, la longitud de la caché son 1024, 1152, 1280, 1408 como para1024 fichas es el mínimo, incrementos de 128 fichasLa forma en que se guarda.

Cuando se produce una "coincidencia de caché", la respuesta de la API contendrá cached_tokensque indica cuántos tokens proceden de la caché. Por ejemplo, el número de tokens enviados a o1-preview-2024-09-12 La solicitud de un modelo puede devolver la siguiente respuesta:

{"created":1729227448,"model":"o1-preview-2024-09-12","object":"chat.completion","usage":{"completion_tokens":1518,"prompt_tokens":1566,"total_tokens":3084,"completion_tokens_details":{"reasoning_tokens":576},"prompt_tokens_details":{"cached_tokens":1408}}}

En este ejemplo, el1408 marcadoresse obtiene de la caché, lo que reduce significativamente el tiempo y el coste de procesamiento.

Ahorro de tiempo tras el acceso a la caché

OpenAI dice oficialmente que los modelos no guardan información en caché todo el tiempo. El mecanismo actual relacionado con el cue caching para la serie de modelos GPT es el siguiente:

- Duración de la caché El caché estará en el 5-10 minutosse borra tras el estado inactivo de la caché. Si no se ha accedido al último uso de la caché durante más de una hora, se elimina por completo.

- Fallos de caché Si uno de los primeros 1024 tokens del prompt es diferente, el Fallos de caché en este momento

cached_tokenstendrá un valor de 0. - La caché no se comparte : Indica que la caché no estará en unsuscribirse acompartida entre ellas. Cada suscripción tiene su propia caché.

Tipos de contenido en caché admitidos

La funcionalidad de la caché de sugerencias varía en función del modelo utilizado. Por ejemplo.Modelos de la serie o1Sólo admite texto, no mensajes de sistema, imágenes, llamadas a herramientas o salida estructurada, por lo que su función de caché es aplicable principalmente a la parte de mensajes de usuario. El sitio gpt-4o y gpt-4o-mini El modelo admite el almacenamiento en caché de más tipos de contenido, incluidos:

- mensajes : Una serie completa de mensajes, incluyendo mensajes de sistema, mensajes de usuario y mensajes de ayuda.

- imágenes Imágenes (ya sean enlaces o datos codificados en base64) contenidas en los mensajes de usuario, siempre que el archivo

detailLos parámetros son coherentes. - Llamada a la herramienta : Incluye matrices de mensajes y cachés definidos por herramientas.

- Salida estructurada : Modo de salida estructurado adjunto a un mensaje del sistema.

Para aumentar la probabilidad de aciertos en la caché, se recomienda colocar los duplicados al principio de la matriz de mensajes.

Indicación de la versión de la API de OpenAI que admite la caché

La función de caché de pistas se introdujo por primera vez en el API versión 2024-10-01-preview en la prestación de ayuda. Para o1 Serie de modelos La respuesta de la API se ha añadido ahora al cached_tokens para mostrar el número de tokens alcanzados por la caché.

Pasos para activar el almacenamiento en caché:

- longitud mínima Asegúrate de que el mensaje tiene al menos 1024 tokens.

- prefijo coherente (matem.) Asegúrese de que los primeros 1024 tokens del prompt son consistentes en todas las peticiones.

- Respuesta API Cuando se produce una coincidencia en la caché, la respuesta de la API muestra el icono

cached_tokensque indica cuántos tokens se almacenan en caché.

¿Es posible desactivar la caché de sugerencias?

Las sugerencias se almacenan en caché en todos los modelos compatibles Activado por defecto y actualmente Sin opción de desactivación . Esto significa que si está utilizando un modelo compatible, el almacenamiento en caché se activa automáticamente, siempre que la solicitud sea admisible.

¿Por qué es tan importante la memoria caché?

El almacenamiento en caché aporta dos ventajas principales:

- Reducción del retraso : El almacenamiento en caché acelera significativamente los tiempos de respuesta al evitar el procesamiento duplicado del mismo contenido.

- ahorrar costes El almacenamiento en caché reduce el número de tokens que hay que procesar y, por tanto, reduce el coste computacional total, especialmente en el caso de solicitudes largas con mucho contenido duplicado.

El almacenamiento en caché de sugerencias es especialmente ventajoso para aplicaciones en las que es necesario procesar a menudo los mismos datos o sugerencias, como los sistemas de IA conversacional, la extracción de datos y las consultas repetitivas.

Buenas prácticas para la caché de sugerencias de OpenAI

Para mejorar la probabilidad de aciertos en la caché, OpenAI también da algunos consejos oficiales:

- Avisos estructurados: coloque el contenido estático o repetitivo delante del aviso y el contenido dinámico detrás del aviso.

- Supervise las métricas de caché: optimice las políticas de caché y de sugerencias supervisando los porcentajes de aciertos, latencia y marcas de caché.

- Utilice sugerencias largas y horas valle: utilice sugerencias más largas e inicie solicitudes durante las horas valle para aumentar las posibilidades de aciertos en la caché, ya que ésta se borrará con más frecuencia durante las horas punta.

- Mantener la coherencia: Reduzca la probabilidad de que se vacíe la caché utilizando periódicamente peticiones puntuales con el mismo prefijo.

Preguntas y respuestas frecuentes sobre la técnica de caché de sugerencias de OpenAI

- ¿Cómo garantiza la caché la privacidad de los datos?

Las memorias caché no se comparten entre diferentes organizaciones. Solo los miembros de una misma organización pueden acceder a la misma caché de pistas. - ¿La caché de sugerencias afecta al marcado de salida o a la respuesta final?

Cue Cacheno afectará aLa salida del modelo. La salida generada es siempre la misma tanto si se utiliza la caché como si no. Dado que sólo se almacenan en caché las preguntas, la respuesta real se recalcula cada vez en función de las preguntas almacenadas en caché.

- ¿Es posible borrar la caché manualmente?

Actualmente no es posible borrar manualmente la memoria caché. Los avisos que no se han utilizado durante mucho tiempo se eliminan automáticamente de la caché. Normalmente, la caché se borra en la pantalla 5-10 minutos se borra tras un periodo de inactividad, pero durante periodos de poco tráfico, la caché puede durar como máximo una hora . - ¿Tengo que pagar más para utilizar la caché de sugerencias?

No es necesario. El almacenamiento en caché se activa automáticamente, sin ninguna acción o coste adicional para el usuario. - ¿Las sugerencias en caché cuentan para los límites del TPM?

Sí, el almacenamiento en caché no afecta a la limitación de velocidad, los accesos a la caché siguen contando para el número total de peticiones. - ¿Puedo utilizar los descuentos de la caché de sugerencias en la API a gran escala y a granel?

Consejo Los descuentos de caché no se aplican a la API masiva, pero sí en el nivel de escala. Con Scale Tier, los tokens de desbordamiento también están sujetos a descuentos de caché. - ¿Se aplica la caché de sugerencias a las solicitudes de retención de datos cero?

Sí, el almacenamiento rápido en caché cumple con la política actual de retención cero de datos.

resúmenes

La función de almacenamiento en caché de pistas de Azure OpenAI ofrece una valiosa solución de optimización para gestionar pistas largas y solicitudes repetitivas. Mejora significativamente la eficiencia del modelo al reducir la latencia computacional y el coste.

A medida que se admitan más modelos y se siga optimizando la función de caché de sugerencias, se espera que los usuarios de Azure OpenAI puedan disfrutar de una experiencia de servicio más eficiente y rentable.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...