GLM-4.6V - Serie de modelos multilingües multimodales de código abierto Wisdom Spectrum AI

Últimos recursos sobre IAPublicado hace 4 meses Círculo de intercambio de inteligencia artificial 25.1K 01

¿Qué es GLM-4.6V?

GLM-4.6V es una serie de modelos lingüísticos multimodales de código abierto de Smart Spectrum AI, la serie contiene dos versiones:GLM-4,6V (106B-A12B), la versión base para escenarios de nube y clúster de alto rendimiento, con una arquitectura Mixed Expert (MoE), tiene unos 106.000 millones de parámetros totales y 12.000 millones de parámetros activos, y es adecuada para manejar tareas multimodales a gran escala.GLM-4.6V-Flash (9B).La versión ligera para implantación local y aplicaciones de baja latencia, con 9.000 millones de parámetros, puede ejecutarse en hardware de consumo y admite inferencia rápida e interacción en tiempo real. El modelo obtiene buenos resultados en más de 30 puntos de referencia de evaluación multimodal convencionales, como MMBench y MathVista, y su rendimiento en la misma escala de parámetros alcanza el nivel SOTA, lo que supone un logro puntero en el campo de los grandes modelos multimodales actuales.

Características funcionales de GLM-4.6V

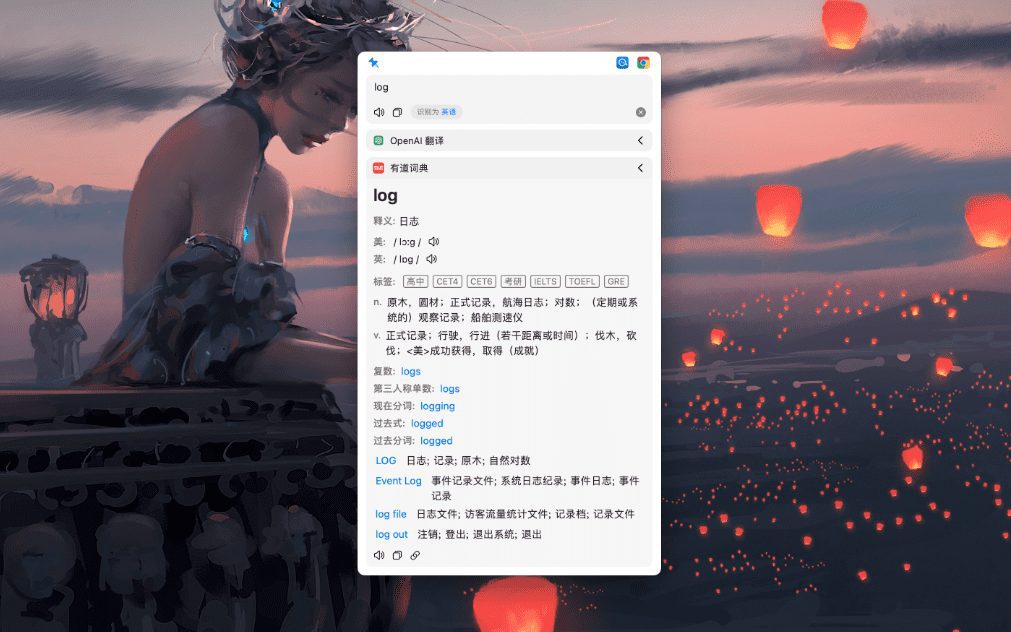

- Funciones nativas de invocación multimodal de herramientasLas imágenes, capturas de pantalla, etc. se pueden utilizar directamente como parámetros de la herramienta sin convertirlos en texto, y los resultados visuales devueltos por la herramienta también pueden participar directamente en el razonamiento posterior, formando un bucle cerrado completo de percepción-comprensión-ejecución.

- Ventana contextual extralargaLa ventana de contexto se amplía a 128.000 tokens durante el entrenamiento y es capaz de manejar contenidos multimodales como documentos largos, vídeos y diagramas complejos, conservando la memoria de entradas anteriores y el razonamiento intermodal.

- Alto rendimiento y bajo costeEl precio de la llamada API se ha reducido en 50% en comparación con la generación anterior GLM-4.5V, con una entrada de 1 $/millón de tokens y una salida de 3 $/millón de tokens, lo que equilibra el rendimiento y el coste.

- Escenarios muy utilizados: Al dar soporte a tareas como la creación de gráficos de disposición mixta, guías de compra guiadas visualmente, desarrollo de réplicas e interacciones frontales y comprensión de documentos largos y vídeos, proporciona un pedestal tecnológico para aplicaciones de agentes multimodales.

Principales ventajas del GLM-4.6V

- Capacidades nativas de invocación de herramientasPor primera vez, la capacidad de invocación de herramientas está integrada de forma nativa en el modelo visual, lo que permite utilizar datos multimodales, como imágenes y capturas de pantalla, directamente como parámetros de entrada para la herramienta sin necesidad de convertirlos antes en descripciones de texto. Los resultados visuales devueltos por la herramienta (por ejemplo, gráficos, capturas de pantalla de páginas web) pueden ser analizados directamente por el modelo e integrados en la cadena de inferencia, formando un bucle cerrado completo de "percepción-comprensión-ejecución", que mejora significativamente la eficacia y precisión del procesamiento de las tareas multimodales.

- Capacidad de procesamiento contextual extralargaLa ventana contextual se extiende hasta 128.000 tokens y puede manejar documentos complejos de hasta 150 páginas, 200 páginas de PPT o 1 hora de vídeo, manteniendo la memoria de las primeras entradas y realizando razonamientos entre imágenes y documentos para escenarios como el análisis de documentos largos y la comprensión de vídeo.

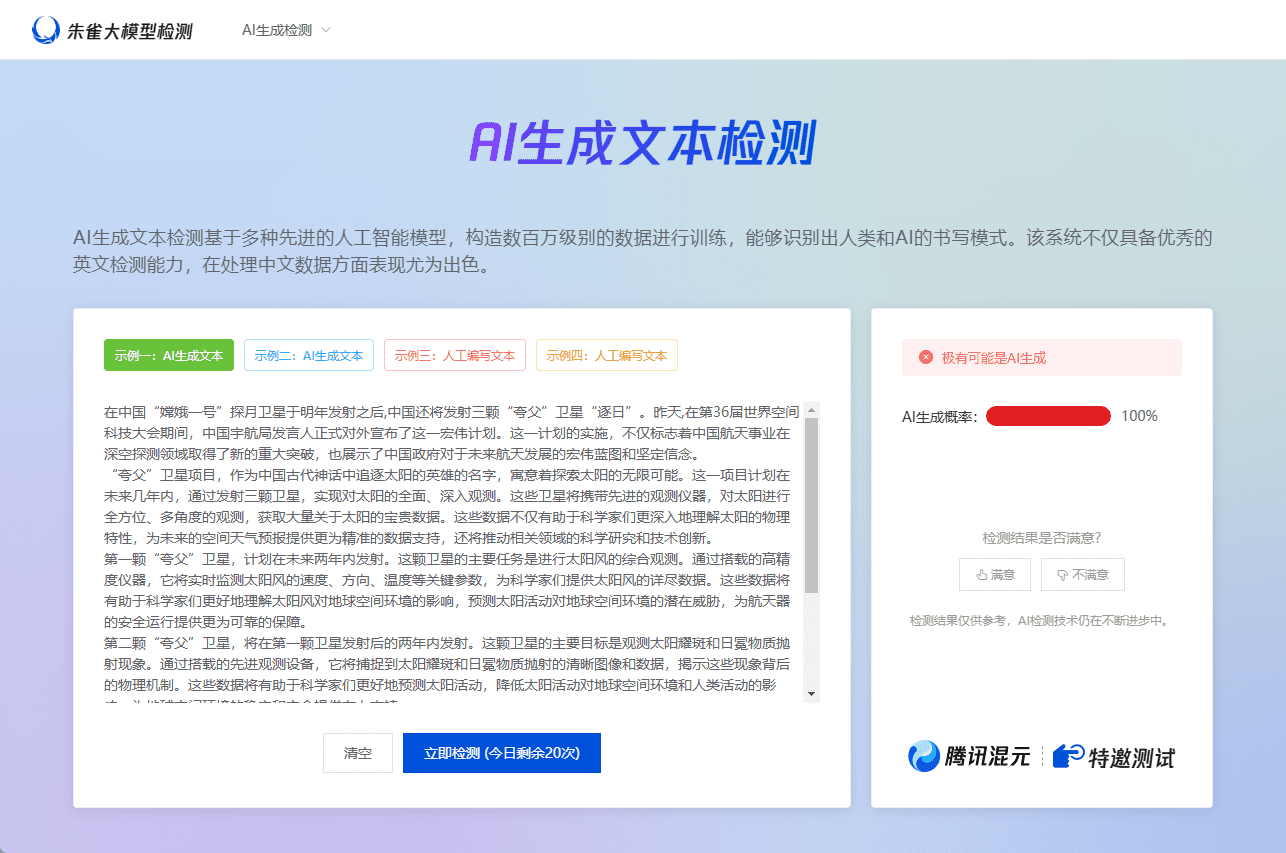

- Comprensión visual de gran precisiónExcelente rendimiento en tareas visuales como el reconocimiento de gráficos, el reconocimiento de texto manuscrito, el reconocimiento de caracteres, la evaluación del material de los objetos, etc., con una reducción significativa de las ilusiones. Admite la entrada de imágenes de relación de aspecto arbitraria y resolución 4K, y tiene una gran capacidad de procesamiento de imágenes de tamaño no estándar (por ejemplo, capturas de pantalla de IU, documentos escaneados).

- Capacidad de salida multimodalLa salida ya no se limita al texto, sino que puede generar contenido de texto mixto, incluidas imágenes, tablas, capturas de pantalla de páginas web, etc., y puede filtrar, integrar y controlar la calidad de estos resultados, lo que resulta adecuado para la creación de contenidos, la generación de informes gráficos y otros escenarios.

- Apoyo en programación y desarrollo front-endOptimizado para escenarios front-end, puede cargar capturas de pantalla o diseños de páginas web para generar código HTML/CSS con precisión de píxeles, admite varias rondas de depuración de interacciones visuales basadas en capturas de pantalla y puede localizar y corregir automáticamente fragmentos de código para mejorar la eficacia del desarrollo front-end.

- Ventajas de la relación coste-eficaciaLa versión ligera (parámetro 9b): En comparación con el modelo de la generación anterior, el precio de la llamada a la API se reduce en 50%, sólo 1 $ por millón de tokens para la entrada y 3 $ para la salida, lo que la hace más adecuada para escenarios de entrada de imágenes a gran escala. La versión ligera (parámetro 9b) puede ejecutarse en GPU de consumo, lo que reduce el umbral de implantación.

- Código abierto y apoyo ecológico: Es completamente de código abierto, proporciona pesos de modelos, código de inferencia y proyectos de ejemplo, es compatible con los principales marcos de inferencia (por ejemplo, VLLM, SGLang, XLLM) y puede desplegarse en entornos de GPU y NPU domésticas, lo que facilita a los desarrolladores la personalización de sus desarrollos y su integración en sistemas existentes.

- rendimiento líderLa versión 9b de GLM-4.6V-Flash supera al Qwen3-VL-8B en rendimiento general, y la versión de 106b parámetros supera al Qwen3-VL-235B con el doble de parámetros.

¿Cuál es la página web oficial de GLM-4.6V?

- Repositorio GitHub:: https://github.com/zai-org/GLM-V

- Biblioteca de modelos HuggingFace:: https://huggingface.co/collections/zai-org/glm-46v

- Documentos técnicos:: https://z.ai/blog/glm-4.6v

Personas a las que va dirigido el GLM-4.6V

- desarrollador front-endEl modelo optimiza la reproducción del front-end y la capacidad de desarrollo de interacciones visuales multirronda, que puede cargar capturas de pantalla o diseños de páginas web para generar código HTML/CSS/JS de alta calidad, admitir la modificación de interacciones multirronda, acortar el enlace de "diseño a página ejecutable" y mejorar la eficiencia del desarrollo del front-end.

- Procesadores de documentos y vídeoPuede manejar documentos largos (por ejemplo, informes financieros de empresas que cotizan en bolsa) y vídeos largos, extraer indicadores básicos de manera uniforme en todos los documentos, comprender las señales ocultas en los informes y gráficos, y resumirlos automáticamente en una tabla de análisis comparativo; puede realizar un peinado global y un razonamiento de grano fino en vídeos largos, señalando los puntos clave en el tiempo, lo que resulta adecuado para comprender e investigar contenidos complejos.

- Desarrollador de servicios de atención al cliente inteligentes multimodalesLa combinación de información visual y textual para ofrecer respuestas y sugerencias precisas, y el apoyo al diálogo en varias rondas, pueden mejorar la eficacia del servicio de atención al cliente y proporcionar a los usuarios servicios más completos y precisos.

- Investigadores y analistas de datos: En el campo de la investigación científica y el análisis de datos, puede manejar datos multimodales complejos, como artículos e informes de investigación, para ayudar a extraer información clave, realizar análisis de datos y razonamientos, y ayudar en la investigación científica y la toma de decisiones.

- educadorEl programa de aprendizaje en línea: puede utilizarse para la creación y el apoyo de contenidos didácticos, como la generación de materiales didácticos ilustrados, el análisis sintáctico de documentos de aprendizaje complejos, etc., para ayudar a los estudiantes a comprender y dominar mejor sus conocimientos.

- Desarrolladores e investigadores de IALa IA multimodal: como modelo de código abierto, proporciona un potente pedestal tecnológico para que los desarrolladores e investigadores de IA lo utilicen en futuras investigaciones y desarrollos para explorar nuevas aplicaciones e innovaciones tecnológicas en IA multimodal.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Puestos relacionados

Sin comentarios...