Mando R7B: recuperación y razonamiento mejorados, soporte multilingüe, IA generativa rápida y eficiente

El modelo más pequeño de nuestra familia R ofrece velocidad, eficiencia y calidad de primer nivel para crear potentes aplicaciones de IA en GPU y dispositivos de vanguardia comunes.

Hoy nos complace publicar Comando R7B, el modelo más pequeño, más rápido y el último de nuestra serie R de grandes modelos lingüísticos (LLM) desarrollados específicamente para la empresa.Command R7B ofrece un rendimiento líder en el sector en su clase de modelos de ponderación abierta capaces de gestionar las tareas del mundo real que importan a los usuarios. El modelo está diseñado para desarrolladores y empresas que necesitan optimizar la velocidad, la rentabilidad y los recursos informáticos.

Al igual que otros modelos de la familia R, Command R7B ofrece una longitud de contexto de 128k y destaca en varios escenarios importantes de aplicación empresarial. Combina un sólido soporte multilingüe, generación aumentada de recuperación validada por referencia (RAG), razonamiento, uso de herramientas y comportamiento de agentes. Gracias a su tamaño compacto y a su eficiencia, puede ejecutarse en GPUs de gama baja, MacBooks e incluso CPUs, lo que reduce drásticamente el coste de poner en producción aplicaciones de IA.

Alto rendimiento en un paquete pequeño

Un modelo global

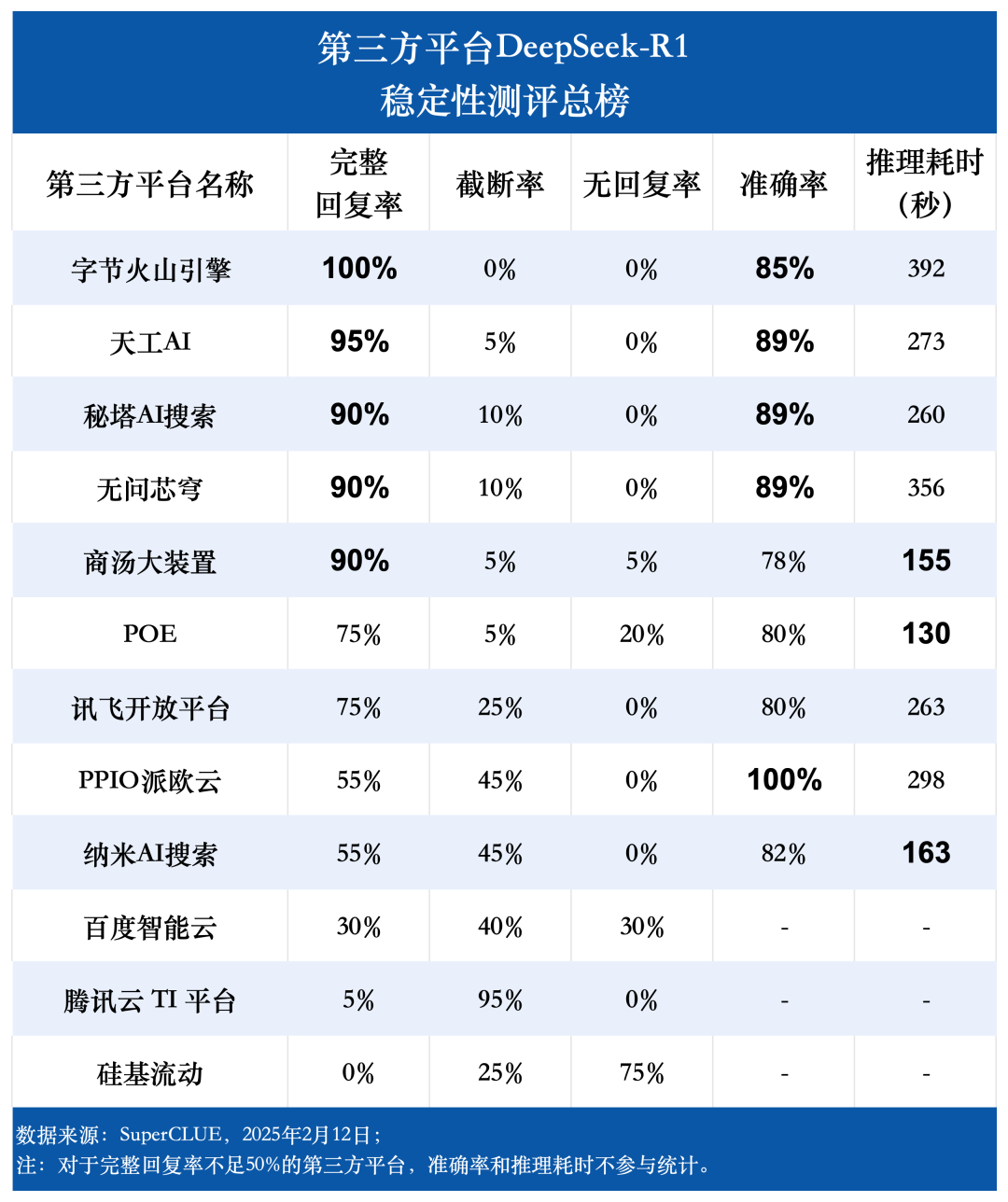

El Command R7B obtiene buenos resultados en pruebas de referencia normalizadas y verificables externamente, tales como HuggingFace Open LLM en la clasificación general. El Mando R7B ocupó el primer puesto de media en todas las tareas, con un gran rendimiento en comparación con otros modelos comparables de ponderación abierta.

Resultados de la tabla de clasificación de HuggingFace. Los resultados de Command R7B los hemos calculado nosotros, basándonos en los consejos y las valoraciones de HuggingFace.

Aumento de la eficacia en tareas matemáticas, de código y de razonamiento

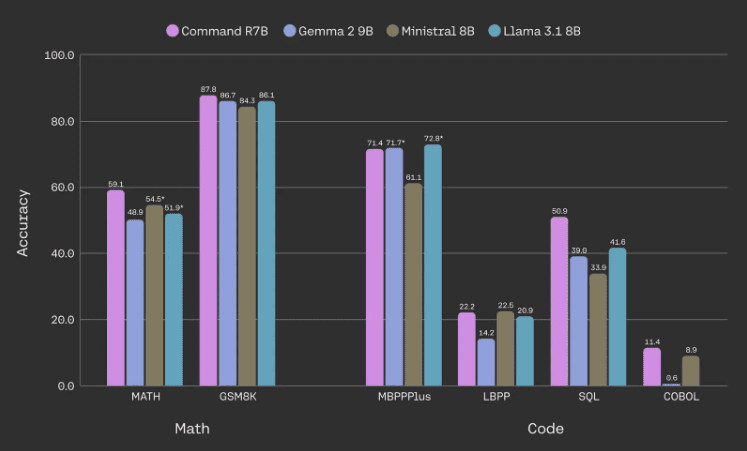

Uno de los principales objetivos del Mando R7B es mejorar el rendimiento en tareas de matemáticas y razonamiento, escritura de código y multilingüismo. En concreto, el modelo es capaz de igualar o superar el rendimiento de modelos comparables de ponderación abierta en pruebas de referencia comunes de matemáticas y código, utilizando menos parámetros.

Rendimiento del modelo en matemáticas y evaluación comparativa de códigos. Todos los datos proceden de evaluaciones internas; las cifras marcadas con un asterisco corresponden a resultados externos, que son superiores. Utilizamos la versión básica de MBPPPlus, LBPP se promedia en 6 lenguajes, SQL se promedia en 3 conjuntos de datos (secciones de dificultad alta y superalta de SpiderDev y Test only, BirdBench y un conjunto de datos interno) y COBOL es un conjunto de datos que desarrollamos internamente.

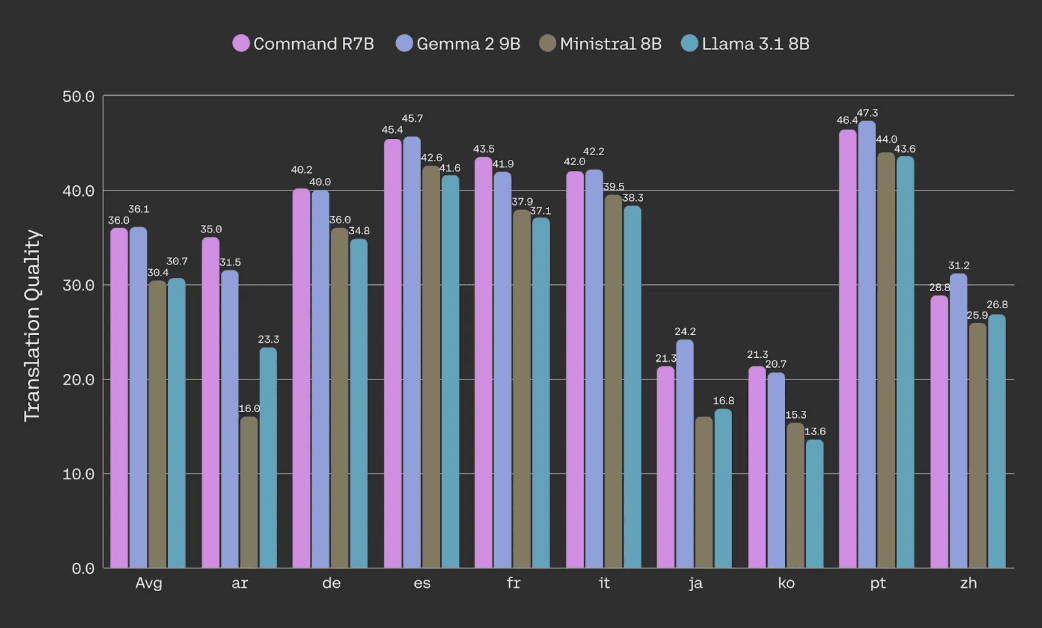

Calidad de traducción de los documentos evaluada con el conjunto de datos NTREX (mediante la métrica spBLEU del corpus).

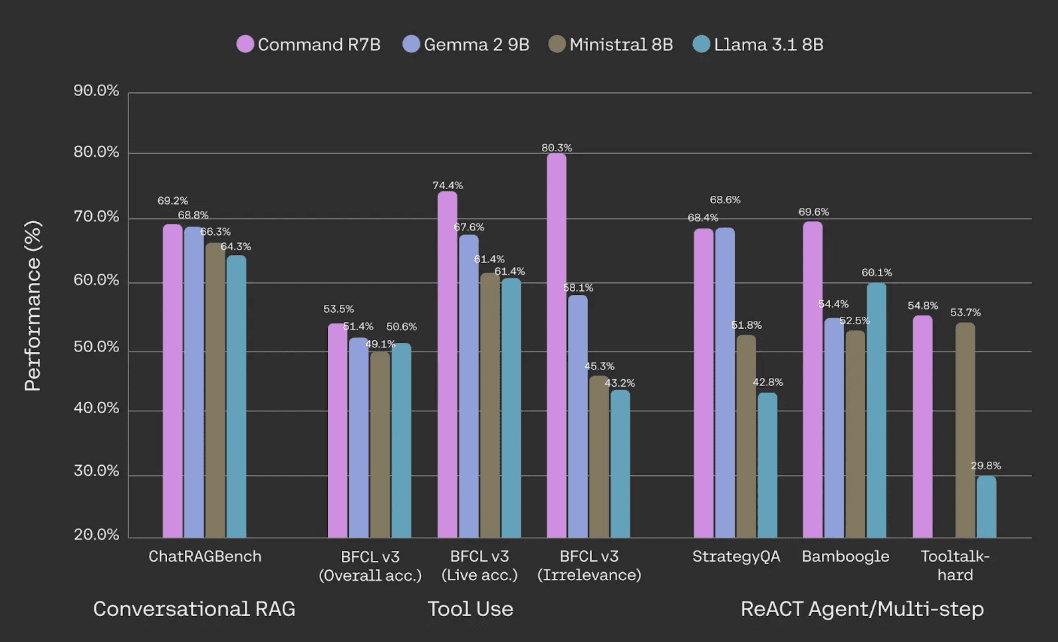

El mejor GAR de su clase, uso de herramientas e inteligencia

Command R7B supera a otros modelos de ponderación abierta de tamaño comparable en el manejo de usos empresariales básicos como RAG, uso de herramientas e inteligencias de IA. Es ideal para organizaciones que buscan un modelo rentable basado en documentos y datos internos. Al igual que nuestros otros modelos de la serie R, nuestro RAG Se proporcionan referencias locales en línea, lo que reduce en gran medida las ilusiones y facilita la comprobación de los hechos.

Evaluación del rendimiento en ChatRAGBench (media de 10 conjuntos de datos), BFCL-v3, StrategyQA, Bamboogle y Tooltalk-hard. Para más información sobre la metodología y otros detalles, véase la nota a pie de página [1].

En cuanto al uso de herramientas, vemos que, comparado con modelos a escala comparables, el Command R7B es más eficiente en términos de Tabla de clasificación de las llamadas a funciones de Berkeley Esto demuestra que el Comando R7B es particularmente hábil en el uso de herramientas en entornos diversos y dinámicos en el mundo real y es capaz de evitar llamadas innecesarias a herramientas, un aspecto importante del uso de herramientas en aplicaciones del mundo real. Esto demuestra que el Mando R7B es particularmente hábil en el uso de herramientas en entornos diversos y dinámicos del mundo real, y es capaz de evitar llamadas innecesarias a herramientas, lo cual es un aspecto importante del uso de herramientas en aplicaciones del mundo real.La capacidad del Mando R7B para utilizar herramientas de varios pasos le permite apoyar inteligencias IA rápidas y eficientes.

Optimización para casos de uso empresarial

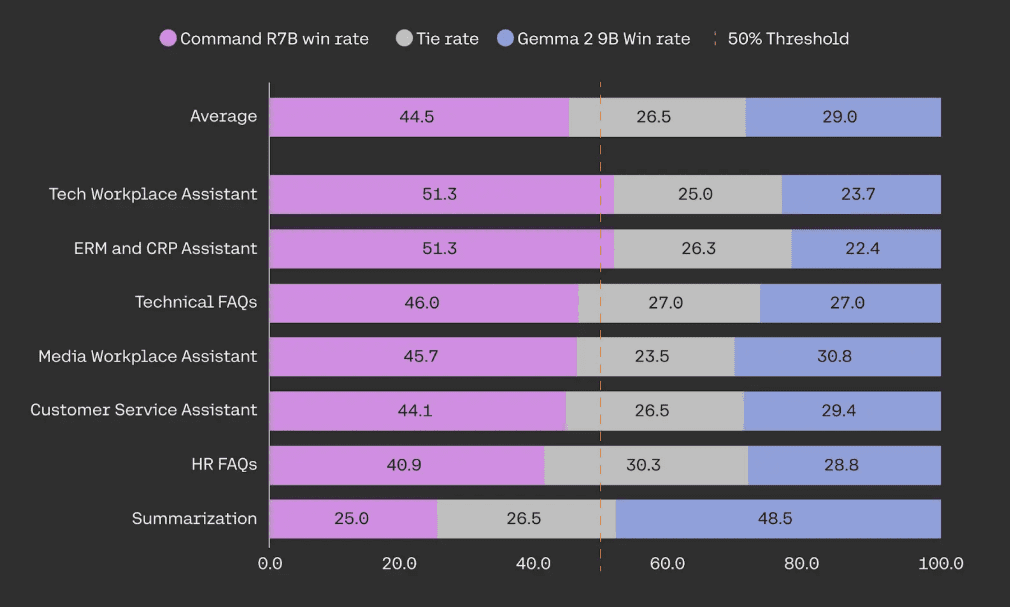

Nuestros modelos están optimizados para satisfacer las necesidades de las organizaciones a la hora de implantar sistemas de inteligencia artificial en el mundo real. Command R7B supera a los modelos de tamaño similar y ponderación abierta en pruebas ciegas cara a cara en casos de uso RAG para crear asistentes de IA que interesen a los clientes, como funciones de atención al cliente, RRHH, cumplimiento normativo y soporte informático.

En la evaluación humana, Command R7B se probó frente a Gemma 2 9B en una muestra de 949 casos de uso RAG empresariales. Todos los ejemplos fueron anotados a ciegas al menos tres veces por anotadores humanos especialmente formados para evaluar la fluidez, la fidelidad y la utilidad de las respuestas.

Eficaz y rápido

El tamaño compacto de Command R7B proporciona una pequeña huella de servicio para la creación rápida de prototipos y la iteración. Destaca en casos de uso de alto rendimiento en tiempo real, como chatbots y asistentes de código. También admite el razonamiento del lado del dispositivo al reducir drásticamente el coste de implantación de infraestructura, como GPU y CPU de consumo.

En este proceso no hemos comprometido nuestros estándares de seguridad y privacidad a nivel empresarial para garantizar la protección de los datos de nuestros clientes.

inicio rápido

Command R7B está disponible desde hoy en Plataforma Cohere También puede utilizarse en el HuggingFace Sobre el acceso. Nos complace dar a conocer los pesos del modelo para ofrecer a la comunidad investigadora de la IA un acceso más amplio a la tecnología punta.

| Cohere Precios API | importación Ficha | Ficha de salida |

|---|---|---|

| Mando R7B | $0.0375 / 1M | $0.15 / 1M |

[1] RAG conversacional: una prueba de rendimiento medio en el benchmark ChatRAGBench sobre 10 conjuntos de datos, que pone a prueba la capacidad de generar respuestas en diversos entornos, incluidas tareas conversacionales, procesamiento de entradas largas, análisis de formularios y extracción y manipulación de información de datos en un entorno financiero. Mejoramos la metodología de evaluación utilizando la integración del discriminador PoLL (Verga et al., 2024) en combinación con Haiku, GPT3.5 y Command R, lo que proporcionó una mayor coherencia (kappa de Fleiss = 0,74 frente a 0,57 en la versión original, basada en 20.000 valoraciones manuales). Uso de la herramienta: rendimiento en la prueba comparativa BFCL-v3 del 12 de diciembre de 2024. Todas las puntuaciones disponibles proceden de tablas de clasificación públicas; en caso contrario, se trata de evaluaciones internas realizadas con el código base oficial. En el caso de los competidores, indicamos la mayor de sus puntuaciones en BFCL "incitada" o "llamada a función". Informamos de la puntuación global, la puntuación del subconjunto en tiempo real (que comprueba el uso de herramientas en entornos reales, diversos y dinámicos) y la puntuación del subconjunto irrelevante (que comprueba cómo el modelo evita llamar a herramientas innecesariamente).REACT Agent/Multi-step: Evaluamos LangChain REACT La capacidad de las inteligencias conectadas a Internet para descomponer problemas complejos y desarrollar planes para la ejecución satisfactoria de la investigación se evaluó mediante Bamboogle y StrategyQA. Bamboogle se evaluó mediante la integración de PoLL, y StrategyQA se evaluó valorando si el modelo seguía las instrucciones del formato y finalmente respondía 'Sí ' o 'No' para emitir un juicio. Utilizamos los conjuntos de pruebas de Chen et al. (2023) y Press et al. (2023).ToolTalk reta al modelo a realizar razonamientos complejos y a buscar activamente información del usuario para completar tareas de usuario complejas como la gestión de cuentas, el envío de correos electrónicos y la actualización de calendarios.ToolTalk-hard se evalúa utilizando la tasa de éxito soft de la biblioteca oficial ToolTalk. ToolTalk requiere que el modelo exponga una API de llamada a funciones, que Gemma 2 9B no tiene.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...