BrowseComp: OpenAI lanza un nuevo parámetro para evaluar la capacidad de recuperación de información de las redes de IA

Recientemente, OpenAI lanzó un proyecto llamado BrowseComp una nueva prueba de referencia diseñada para evaluar la capacidad de los agentes de IA para navegar por Internet. La prueba de referencia consta de 1.266 preguntas que abarcan una amplia gama de dominios, desde el descubrimiento científico a la cultura pop, y exige que el agente navegue de forma persistente por un entorno web abierto en busca de respuestas difíciles de encontrar y entrelazadas con la información.

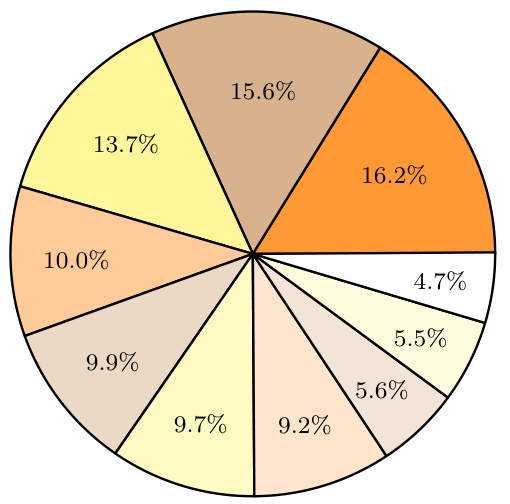

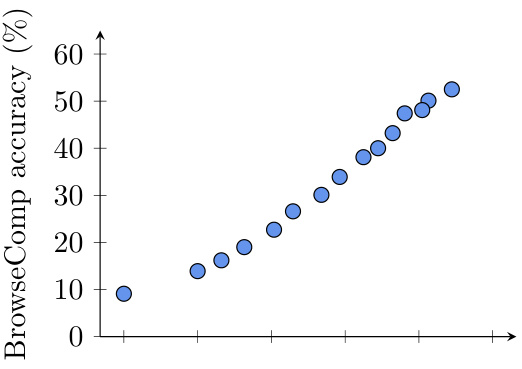

Figura 1: Rendimiento de BrowseComp de una versión anterior de OpenAI Deep Research con diferentes esfuerzos de navegación. La precisión mejora suavemente a medida que aumenta la cantidad de cálculo en el momento de la prueba.

Los puntos de referencia existentes están "saturados" y BrowseComp se ha desarrollado con este fin.

En la actualidad, algunas pruebas de referencia populares, como SimpleQA, se centran en la capacidad de un modelo para recuperar hechos aislados y sencillos. Para modelos avanzados como GPT-4o, que está equipado con herramientas de navegación, estas tareas se han vuelto demasiado sencillas y se acercan a la saturación del rendimiento. Esto significa que los puntos de referencia como SimpleQA ya no son eficaces para diferenciar las verdaderas capacidades de los modelos cuando se trata de información más compleja que requiere una exploración profunda de la red para encontrarla.

Para colmar esta laguna, OpenAI ha desarrollado BrowseComp (que significa "Competición de navegación"). La prueba consta de 1.266 preguntas difíciles y está diseñada para evaluar la capacidad de los agentes de IA para localizar preguntas difíciles de encontrar, con puntos de información entrelazados y que pueden requerir visitas a docenas o incluso cientos de sitios web para responderlas. El equipo ha publicado la prueba en el sitio web de OpenAI simple evals Repositorio GitHuby proporciona informaciónDocumentos de investigación.

Concepto de diseño de BrowseComp

BrowseComp se diseñó originalmente para llenar un vacío en las pruebas comparativas existentes. Aunque en el pasado ha habido varias pruebas comparativas para evaluar las capacidades de recuperación de información, la mayoría se han basado en preguntas relativamente sencillas que pueden resolverse fácilmente con los modelos lingüísticos existentes, y BrowseComp se centra en preguntas complejas que requieren búsquedas en profundidad y razonamientos creativos para encontrar las respuestas.

He aquí algunos ejemplos de ediciones en BrowseComp:

- Ejemplo de pregunta 1Entre 1990 y 1994, ¿qué equipos de fútbol disputaron partidos con árbitros brasileños en los que hubo cuatro tarjetas amarillas (dos para cada equipo), tres de ellas en la segunda parte, y se realizaron cuatro sustituciones durante el partido, una de ellas por lesión en los primeros 25 minutos del encuentro?

- respuesta de referenciaIrlanda - Rumanía

- Ejemplos de preguntas 2:: Por favor, identifique un personaje de ficción que ocasionalmente rompe la cuarta pared para interactuar con el público, es conocido por su humor y tiene un programa de televisión que se emitió entre los años 60 y 80 y contó con menos de 50 episodios.

- respuesta de referenciaEl hombre de plástico

- Ejemplos de preguntas 3: Por favor, identifique el título de un artículo científico presentado en una conferencia EMNLP entre 2018 y 2023 en el que el primer autor tenía un título universitario de Dartmouth College y el cuarto autor tenía un título universitario de la Universidad de Pensilvania.

- respuesta de referencia:: Fundamentos de la panificación: La ciencia del pan

Características exclusivas de BrowseComp

- desafiando aLos problemas de BrowseComp se diseñan cuidadosamente para garantizar que los modelos existentes no puedan resolverse en poco tiempo. Los formadores humanos realizan múltiples rondas de validación al crear los problemas para garantizar su dificultad. A continuación se indican algunos de los criterios utilizados para evaluar la dificultad de los problemas:

- No resuelto por los modelos existentesSe pidió a los formadores que comprobaran que GPT-4o (con y sin navegación), OpenAI o1 y las versiones anteriores del modelo de investigación en profundidad no abordaban estas cuestiones.

- No disponible en los resultados de búsquedaEl sistema de búsqueda: se pidió a los formadores que realizaran cinco búsquedas sencillas en Google y comprobaran que las respuestas no aparecían en las primeras páginas de los resultados de búsqueda.

- Los humanos no pueden resolverlo en diez minutos.El objetivo: se pide a los formadores que creen problemas lo suficientemente difíciles como para que otra persona no pueda resolverlos en diez minutos. Para algunos de los problemas, un segundo formador intenta encontrar la respuesta. A los formadores que crearon problemas que se resolvieron en más de 40% se les pidió que revisaran sus problemas.

Figura 2: Distribución de temas en BrowseComp. La distribución de temas en BrowseComp viene determinada por las sugerencias del ChatGPT El modelo clasificó a posteriori los temas de cada pregunta. - Fácil de verificar:: A pesar de la dificultad de las preguntas, las respuestas suelen ser breves y claras, y fácilmente verificables mediante respuestas de referencia. Este diseño hace que la evaluación comparativa sea un reto sin ser injusta.

- variegación:: Las preguntas de BrowseComp abarcan una amplia gama de áreas, como la televisión y el cine, la ciencia y la tecnología, el arte, la historia, los deportes, la música, los videojuegos, la geografía y la política. Esta diversidad garantiza la exhaustividad de los tests.

Evaluación del rendimiento del modelo

Las pruebas realizadas en BrowseComp han demostrado que el rendimiento de los modelos existentes es desigual:

- GPT-4o responder cantando GPT-4.5 Sin la función de navegación, la precisión es cercana a cero. Incluso con la función de navegación activada, la precisión de GPT-4o sólo mejora de 0,6% a 1,9%, lo que indica que la función de navegación por sí sola no basta para resolver problemas complejos.

- OpenAI o1 El modelo no tiene una función de navegación, pero alcanza una precisión de 9,91 TP3T gracias a su gran capacidad de razonamiento, lo que sugiere que algunas respuestas pueden obtenerse mediante razonamiento de conocimiento interno.

- Investigación a fondo de OpenAI El modelo obtuvo los mejores resultados, con una precisión de 51,51 TP3T. El modelo busca de forma autónoma en la red, evaluando y sintetizando información de múltiples fuentes y adaptando su estrategia de búsqueda para poder abordar problemas que de otro modo no podrían resolverse.

análisis en profundidad

1. Errores de calibración

Aunque el modelo de Deep Research funciona bien en términos de precisión, tiene un elevado error de calibración. Esto significa que el modelo carece de una evaluación precisa de su propia incertidumbre a la hora de dar con confianza respuestas incorrectas. Este fenómeno es especialmente evidente en los modelos con capacidades de navegación, lo que sugiere que el acceso a herramientas web puede aumentar la confianza del modelo en las respuestas incorrectas.

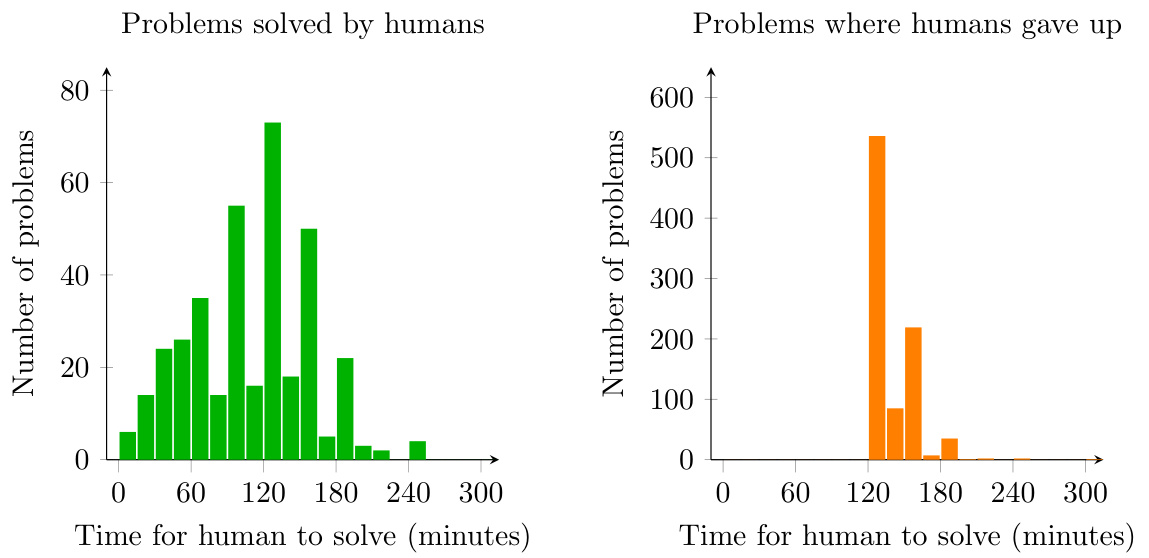

Figura 3: Histograma que muestra el tiempo que tarda un humano en resolver un problema de BrowseComp o en abandonar. Los entrenadores solo podían abandonar después de intentar resolver el problema durante al menos dos horas.

2. Impacto de los recursos informáticos

Los resultados de las pruebas muestran que el rendimiento del modelo mejora gradualmente a medida que aumentan los recursos computacionales en el momento de la prueba. Esto sugiere que los problemas de BrowseComp requieren una cantidad significativa de esfuerzo de búsqueda y razonamiento, y que más recursos computacionales pueden mejorar significativamente el rendimiento del modelo.

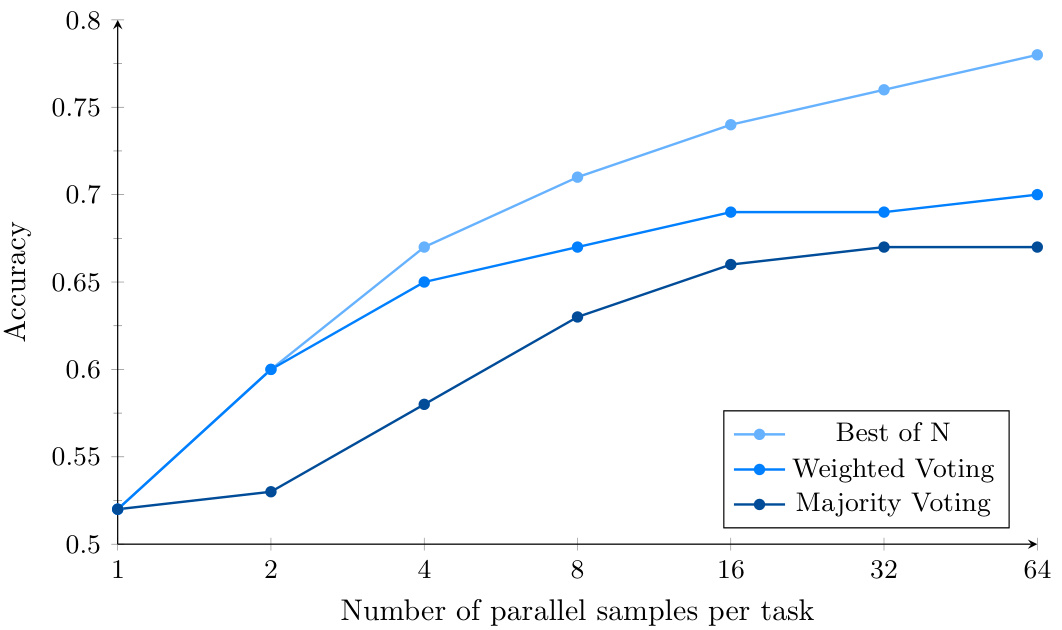

Figura 4: Rendimiento de BrowseComp para Deep Research cuando se utiliza el muestreo paralelo y la votación basada en la confianza. El esfuerzo computacional adicional mejora aún más el rendimiento del modelo con Best-of-N.

3. Estrategias de agregación

El rendimiento del modelo puede mejorarse aún más mediante múltiples intentos y utilizando diferentes estrategias de agregación (por ejemplo, votación por mayoría, votación ponderada y mejor elección) 15% a 25%. donde la estrategia de mejor elección obtiene el mejor rendimiento, lo que indica que el modelo de Deep Research tiene un alto nivel de precisión a la hora de identificar la respuesta correcta.

llegar a un veredicto

El lanzamiento de BrowseComp aporta una nueva dimensión a la evaluación de los agentes de IA. No sólo pone a prueba la capacidad de recuperación de información de un modelo, sino que también examina su persistencia y creatividad en problemas complejos. Aunque todavía hay que mejorar el rendimiento de los modelos existentes en BrowseComp, la publicación de esta prueba de referencia sin duda hará avanzar la investigación en el campo de la IA.

En el futuro, a medida que se contraten más modelos y avance la tecnología, cabe esperar que el rendimiento de los agentes de IA en BrowseComp siga mejorando, lo que en última instancia dará lugar a agentes de IA más fiables y dignos de confianza.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...