Youtu-LLM - 腾讯 Youtu 团队开源的轻量级语言模型

Youtu-LLM是什么

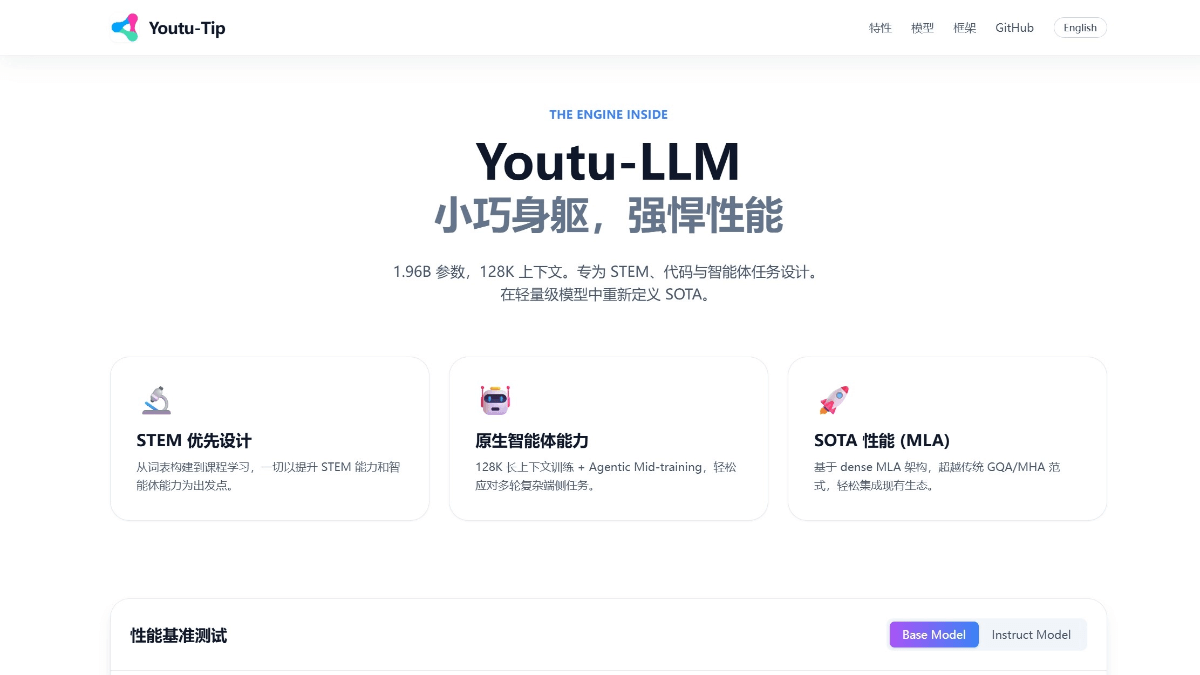

Youtu-LLM 是腾讯 Youtu 团队开源的轻量级语言模型,参数规模为 19.6 亿。专为智能体任务设计,具备强大的“原生智能体能力”,在多项任务中超越同规模甚至更大模型。模型采用紧凑架构和 128K 长上下文窗口,支持长程任务处理,针对 STEM 领域优化词表,提升推理效率。

Youtu-LLM的功能特色

- parameter scale:模型参数量约为1.96亿(2B),远小于常见的数十亿或数百亿参数的大模型,适合资源受限场景部署。

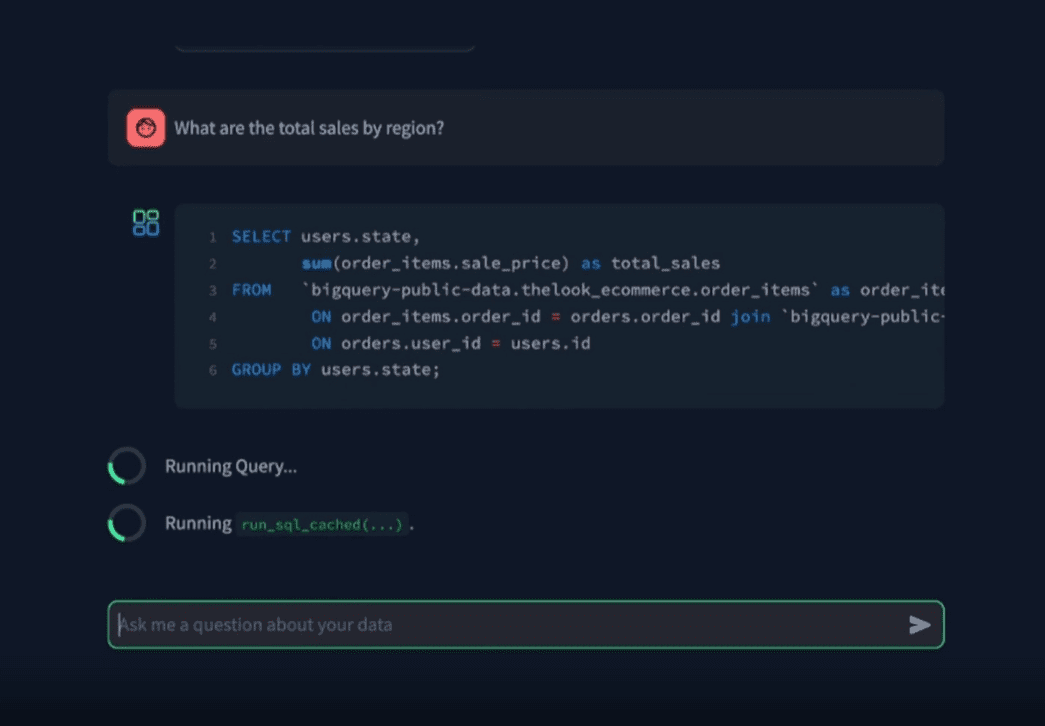

- architectural design:采用密集多潜在注意力(Dense MLA)架构,支持128k超长上下文窗口,能在极小内存占用下实现长文本推理与状态跟踪,适合处理长程智能体任务。

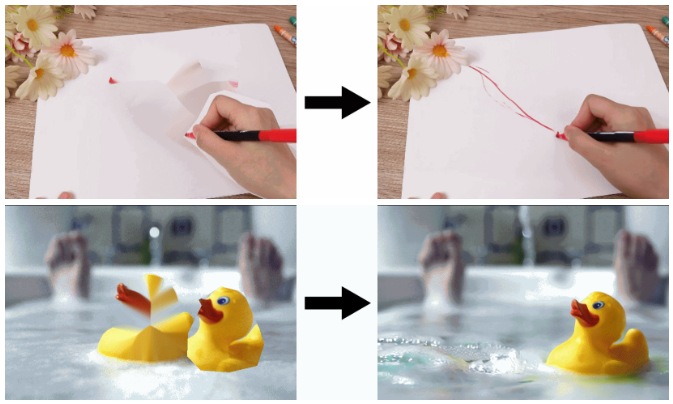

- Training Strategies:通过“常识→STEM→智能体”的多阶段预训练课程,系统性培养模型的推理、规划、工具使用等智能体能力,非依赖知识蒸馏或指令微调。

- performance:在通用任务(如常识推理、数学计算、代码生成)上与参数量更大的模型(如4B参数模型)性能相当,在智能体特定任务(如深度研究、代码修复、工具调用)中显著超越同规模模型,甚至部分任务超越参数量为其4倍的模型。

- application scenario:适用于端侧部署、隐私敏感场景,可作为代码助手、研究助手或通用智能体,支持本地化部署和低延迟推理。

Youtu-LLM的核心优势

- 轻量但高性能:参数量仅19.6亿,却在智能体任务中超越同规模甚至更大模型,兼具高效推理和低资源消耗。

- 原生智能体能力:从预训练阶段就注入智能体思维,具备自主规划、执行和反思能力,无需依赖外部框架。

- Long Context Support:支持128K上下文窗口,适合处理长文本和复杂任务,如多跳推理和长代码修复。

- 优化的分词器:专为STEM领域设计,提升数学、代码等专业领域的token压缩率和推理效率。

- 系统性预训练:通过“常识→STEM→智能体”三阶段课程式训练,逐步提升模型的综合能力。

- 高质量轨迹数据:引入200B tokens的智能体轨迹数据,覆盖多种复杂场景,强化智能体任务表现。

- Open source and flexible deployment:全面开源,支持多种版本和微调工具,方便开发者在不同场景中快速部署。

Youtu-LLM官网是什么

- Project website:https://youtu-tip.com/#llm

- Github repository:https://github.com/TencentCloudADP/youtu-tip/tree/master/youtu-llm

Youtu-LLM的适用人群

- Developers and engineers:适合需要高效代码辅助、自动化软件开发任务以及在资源受限的设备上部署模型的开发者。

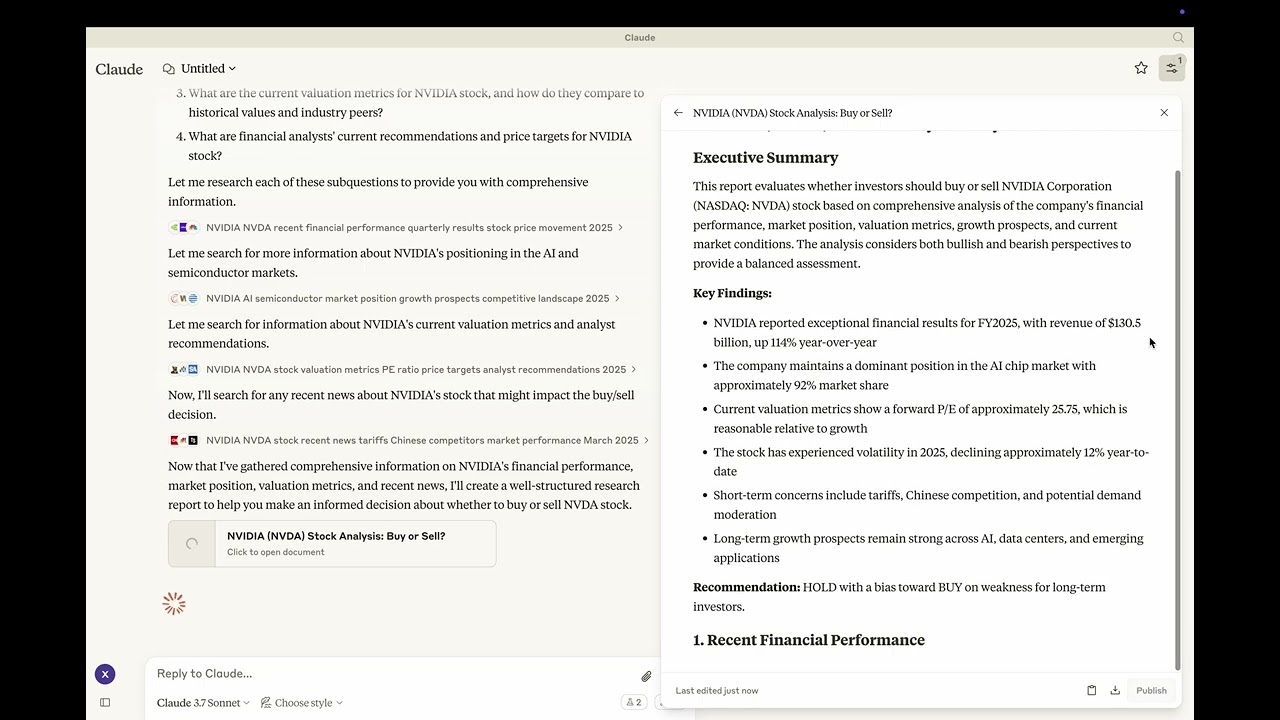

- Researchers and scholars:能帮助进行文献综述、知识整合和研究报告生成,适合学术研究和知识探索场景。

- 企业用户和技术团队:适用于需要处理企业知识库、技术文档解析以及多工具协同工作的团队。

- 个人用户和 AI 爱好者:适合希望使用轻量级但功能强大的 AI 模型作为个人助手,完成日常任务自动化和复杂问题解决。

- Educators and students:可以用于辅助教学、学习资源整理以及复杂知识的多跳推理和总结。

- 隐私敏感行业从业者:由于支持边缘部署和本地运行,适合对数据隐私有高要求的行业,如金融、医疗等。

© Copyright notes

Article copyright AI Sharing Circle All, please do not reproduce without permission.

Related posts

No comments...