未来はここにある:"製品としてのモデル "時代の徹底考察

ここ数年、AI開発の次の段階に関する議論が絶えることがない。より強力な推論能力?それとも真のマルチモーダル融合? 様々な憶測が飛び交い、AI分野に新たな変化をもたらしている。

今こそ、決定的な判断を下す時だと思う:商品としてのモデル」の時代が到来した。 これは単なるトレンドではなく、現在のAI開発の状況に対する深い洞察である。

学術研究の最先端であれ、商業市場の実際の方向性であれ、すべての兆候は明らかにこの変革の方向に向いている。

- ジェネリックモデルのスケールアップがボトルネックになっている: 一般的な大型モデルの「大きければ大きいほど良い」という開発モデルは、徐々にその限界を露呈しつつある。 これは技術的な課題だけでなく、費用対効果も考慮しなければならない。 GPT-4後の業界の議論でも明らかになったように、機種の能力アップと算術的なコストアップの関係は単純なリニアではなく、シザーギャップが広がっている。 機種パワーは直線的にしか伸びないかもしれないが、この巨大な機種のトレーニングと運用にかかるコストは指数関数的に上昇する。 他のベンダーは言うに及ばず、OpenAIほどの技術とリソースを持つ企業でさえ、巨額の投資をカバーできるビジネスモデルを見つけるのに苦労している。 このことは、AI能力を無限に向上させるためにモデルのパラメータサイズの拡張だけに頼る時代は終わったかもしれないということを示唆している。 より効率的で、費用対効果が高く、持続可能なAI開発の道を見つける必要がある。

- オリエンテーション・トレーニングは新たな勢力として台頭し、予想をはるかに上回る成果を上げている: ジェネリック・モデルの開発が停滞しているのとは対照的だ。"オピニオントレーニング" アプローチは驚くべき可能性を秘めている。 このトレーニングパラダイムは、特定のタスクやアプリケーションシナリオのためにモデルを微調整し、トレーニングすることに重点を置いている。 強化学習と推論技術の収束は、ターゲットを絞ったトレーニングを活性化させた。 単に「データを学習する」のではなく、モデルが実際に「タスクを学習する」ようになってきている。 これは質的な飛躍であり、AIに対する考え方の転換を意味する。 数学における小さなモデルの驚異的なパフォーマンスも、コードジェネレーターからコードベースの自律的な管理者へのコードモデルの進化も、あるいは クロード 情報入力がほとんどゼロで複雑なゲームをプレーするケースは、オリエンテーション・トレーニングの威力を証明している。 この「小さくても立派な」、「特化していても強い」モデル開発路線は、将来のAI応用の主流になるかもしれない。

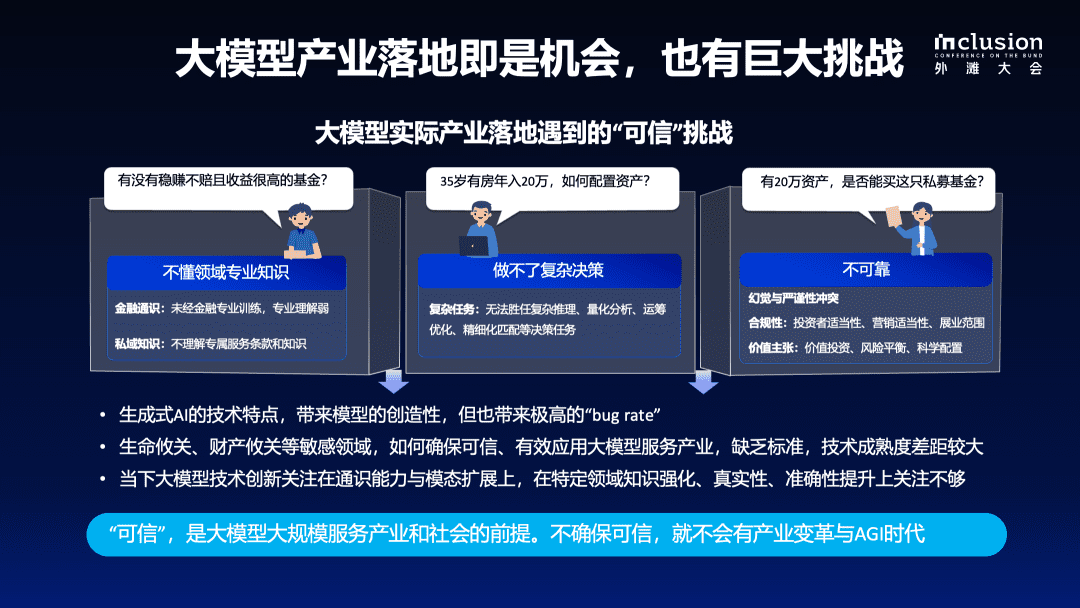

- モデル推論のコストは崖から落ちる: かつてAI導入の「障害」とされた推論コストも大幅に軽減された。 おかげで ディープシーク AIなどの企業によるモデルの最適化と推論アクセラレーションにおけるブレークスルーにより、AIモデルの展開と応用の敷居は劇的に低くなっている。 DeepSeekの最新の調査によると、既存のGPUコンピューティング・パワーは、理論上、世界中で数十億人の人々がそれぞれ最先端のモデルを使用し、1日あたり1万個のAIモデルを処理できることを示している。 トークン ニーズがある。 つまり、算数はもはやAIの普及を制限する重要な要因ではなくなっており、AIの大規模な応用の時代が加速しているのだ。 モデルプロバイダーにとって、トークンを販売するだけの「ペイ・パー・ユース」ビジネスモデルに頼ることは、AIモデルの価値を十分に引き出すには明らかに不十分である。 より垂直的で専門的なモデル・サービスやソリューションの提供など、バリュー・チェーンの上位に目を向ける必要がある。

これらの兆候はすべて、AI産業の発展の焦点が「一般的なモデル」から「製品としてのモデル」という新しいパラダイムに移行しつつあることを示している。 これは技術的な調整だけでなく、ビジネスモデルや産業形態における重大な変化でもある。 従来の "アプリが王様 "という哲学は見直す必要があるかもしれない。 長い間、投資家や起業家は、アプリケーションの革新こそがAIの商業化の鍵であると考え、AIのアプリケーション層に焦点を当ててきた。 しかし、「モデル・アズ・プロダクト」の時代には、アプリケーション層が最初に自動化され、破壊されるかもしれない。 今後のコンペティションの焦点は、モデルそのものにあり、より高度で、より効率的で、よりプロフェッショナルなモデルを持つことができる者が、AIコンペティションで優位に立つことができるだろう。

将来のモデルの形:専門化、垂直化、サービス化

ここ数週間で、"モデル・アズ・プロダクト "のパラダイムから2つの象徴的な製品が登場した。 アンソロピック クロード3.7ソネット。 いずれも新世代モデルのトレンドを反映した製品であり、将来のモデルの姿を予感させるものだ。

OpenAIのDeepResearchは、リリース以来多くの注目を集めたが、多くの誤解を伴っている。 単にGPT-4の "シェル "アプリケーション、あるいはGPT-4をベースとした検索機能拡張ツールと解釈する向きも多い。 しかし、それは真実とはかけ離れている。 OpenAIは、研究と情報検索タスクに特化した全く新しいモデルを実際にトレーニングする。 DeepResearchは、外部の検索エンジンやツールの呼び出しに依存する「ワークフロー」ではなく、正真正銘の "研究言語モデル"外部からの介入を必要としない、エンドツーエンドの自律的な検索、閲覧、情報統合、レポート作成機能を備えています。 DeepResearchは、外部からの介入なしに、エンドツーエンドの自律的な検索、閲覧、情報統合、レポート生成機能を備えています。 DeepResearchを使ったことがある人なら誰でも、従来のLLMやチャットボットとの違いをはっきりと感じることができる。 DeepResearchが生成するレポートは、明確な構造化、厳密な論証、確実な追跡が可能であり、従来の検索ツールやLLMをはるかに凌駕する専門性と深みを反映している。

対照的に、「ディープ・サーチ」を謳う市場に出回っている他の製品、例えば以下のようなものがある。 当惑 やグーグルの関連機能は、それに比べると見劣りする。 ハンチョン・リーが指摘するように、これらの製品はまだ本質的に、いくつかの簡単な微調整と機能のオーバーレイを伴う一般的なモデルに基づいており、検索タスクのための深い最適化と体系的な設計が欠けている。 DeepResearchの出現は、"製品としてのモデル "というコンセプトの初上陸を示すとともに、専門化・垂直化されたモデルの発展方向を示している。

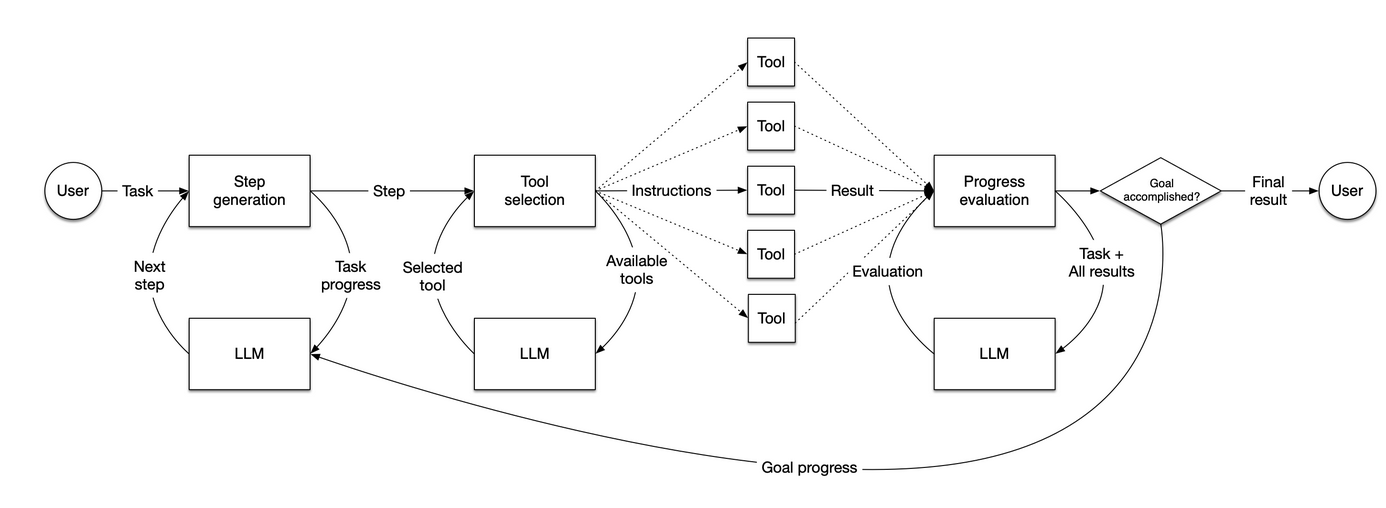

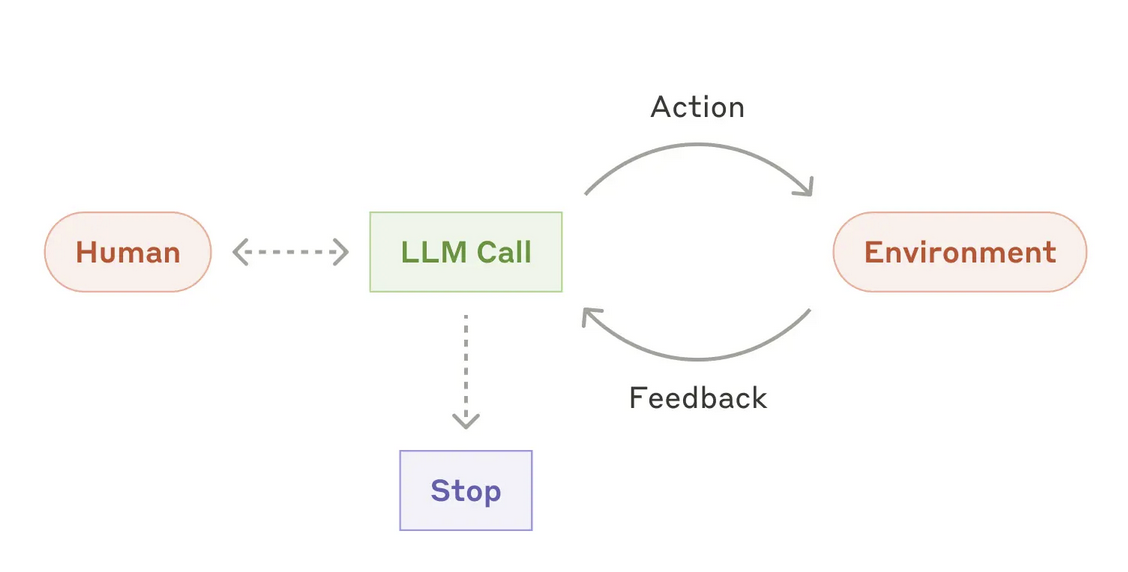

Anthropicはまた、"製品としてのモデル "戦略を積極的に推進しており、エージェント・モデルに関する洞察を提供している。 彼らは昨年12月に次のような記事を発表している。研究報告書AnthropicはAgentモデルを再定義した。 Anthropicは、真のAgentモデルは次のようなものであるべきだと主張している。 "自律"ワークフローの単なるリンクとしてではなく、ターゲットタスクを独立して完了することができる。 DeepResearchと同様に、Anthropicはエージェントモデルが次のようなものであるべきだと強調している。 "内部的に" あらかじめ定義されたコードパスや外部オーケストレーションに依存するのではなく、タスクフローの動的計画、ツールの自律的な選択と呼び出しなど、タスク実行の全プロセスを完結させる。

今日、市場には数多くのエージェント・スタートアップが出現しているが、彼らが構築する「エージェント」の大半は、まだ「エージェント」の枠から抜け出せないでいる。 「ワークフロー レベル。 これらの "エージェント "は、基本的に、LLMと様々なツールをリンクさせ、決まったステップ数でタスクを実行する一連の定義済みのコードフローである。 この "擬似エージェント "アプローチは、特定の分野では価値があるかもしれないが、AnthropicやOpenAIによって定義された "本物のエージェント "アプローチには程遠い。 真の意味で自律的なシステムは、質的な飛躍を遂げるためにモデル・レベルで再構築され、革新されなければならない。

Anthropic Claude 3.7のリリースは、"製品としてのモデル "の傾向をさらに証明するものである。 Claude 3.7は、複雑なコードシナリオのために深く最適化されたモデルである。 クロード3.7は、コード生成、コード理解、コード編集において優れた性能を発揮する。 特に注目に値するのは デヴィン クロード3.7を搭載したこのような高度に複雑でインテリジェントな「AIプログラマー」ワークフローは、SWEベンチマークでも大幅な改善を達成することができた。 このことは、優れたアプリケーションを構築するカギとなるのは、モデルそのものの力であることを示唆している。 複雑なワークフローや外部ツールの設計に多くの労力を費やす代わりに、リソースはモデル自体の開発と最適化に投資されるべきである。

のPleiasチーム。 ラグ 検索拡張生成(RAG)ドメインの探索は、「製品としてのモデル」という考え方も反映している。 従来のRAGシステムは通常、データルーティング、テキストチャンキング、結果の並べ替え、クエリ理解、クエリ拡張、コンテキストフュージョン、検索最適化など、複数の独立した結合ワークフローで構成されている。 これらのリンク間の有機的な統合の欠如は、システムの高い脆弱性と高いメンテナンス・最適化コストにつながります。 Pleiasチームは、RAGシステムの様々な側面を統合するために、最新のトレーニング技術を使おうとしている。 「モデリング一つはデータ前処理と知識ベース構築のためのモデルであり、もう一つは情報検索、コンテンツ生成、レポート出力のためのモデルである。 これら2つのモデルは互いに連携し、RAGの全プロセスタスクを完了する。 このソリューションは、新しいモデルアーキテクチャ設計、洗練された合成データパイプライン、カスタマイズされた強化学習報酬関数を必要とし、真の技術革新であり、研究のブレークスルーである。 RAGシステムを "モデル化 "することで、システム・アーキテクチャを大幅に簡素化し、システムの性能と安定性を向上させ、配備とメンテナンスのコストを削減し、RAG技術のスケール・アプリケーションを実現することができる。

一言で言えば、"製品としてのモデル "の核となるコンセプトは次のようなものだ。 "複雑さの置き換え". 本来アプリケーション層で解決しなければならない複雑な問題は、モデルのトレーニングによってモデルレベルで事前に処理され、消化される。 モデルは、トレーニング段階で様々な複雑なシナリオや極端な状況を事前に学習し適応するため、モデルの展開や適用がよりシンプルで効率的になる。 将来的には、AI製品の中核的価値は、アプリケーション層での派手な機能や複雑なワークフローよりも、モデルそのものに反映されるようになるだろう。 モデルトレーナーは、価値創造と価値獲得において支配的なプレーヤーになるだろう。 Anthropic Claudeの目標は、LlamaIndexが提供する基本的なエージェントフレームワークのような、現在のワークフローベースの「擬似エージェント」システムを破壊し、置き換えることだ。 彼らは、よりスマートで、より自律的で、より使いやすいAIアプリケーションを、より強力なモデルで実現したいと考えている。

は、以下に説明するように、より高度なモデリング・アーキテクチャに取って代わられる:

製品としてのモデル」時代の生き残り:独自のモデルを開発するか、それともそれに飲み込まれるか?

繰り返しになるが、大規模なAI研究所の戦略的配置は「秘密作戦」ではなく、明確かつオープンである。 ある意味、彼らの戦略は透明性に欠けるように見えるかもしれないが、核心的な意図は明確である: 彼らはモデルレイヤーから出発し、アプリケーションレイヤーにまで浸透してエンド・ツー・エンドのAI製品やサービスを構築し、バリューチェーンを支配しようとするだろう。 このトレンドのビジネスへの影響は広範囲に及ぶ。 Databricks社のGen AI担当副社長であるナヴィーン・ラオは、その正鵠を射ている:

今後2-3年のうちに、クローズドソースのAIモデル・プロバイダーはすべて、APIインターフェースの直接販売を徐々にやめていくだろう。 オープンソースのモデルだけがAPIを通じてサービスを提供し続けるだろう。 クローズドソースのモデルプロバイダーの目標は、独自に競争力のある、ジェネリックではないAI能力を構築することであり、これらの能力を提供するためには、究極のユーザーエクスペリエンスとアプリケーションインターフェースを作成する必要がある。 将来のAI製品は、もはやモデルそのものではなく、モデル、アプリケーション・インターフェース、特定の機能を統合した完全なアプリケーションになるだろう。

これは、モデル・プロバイダーとアプリ開発者の「役割分担」の蜜月時代が終わったことを意味する。 アプリケーション開発者、特にサードパーティのモデルAPIに依存してアプリケーションを構築する「ラッパー」企業は、生き残りをかけたかつてない難題に直面している。 今後、AI業界の競争環境は以下のような方向に発展する可能性がある:

- モデルプロバイダーは、市場シェアを獲得するために独自のアプリケーションを開発する: クロード・コード とDeepSearchは、モデルプロバイダーがその応用分野を積極的に拡大していることを示している。 DeepSearchはオープンAPIインターフェースを持たないが、サービスの価値を高めるコア機能としてOpenAIのプレミアムサブスクリプションサービスに統合されている。 Claude Codeは、開発者がコードエディタで直接Claude 3.7モデルを使用できるようにする、軽量のエンドポイント統合ツールです。 こうした動きは、モデル・プロバイダーがユーザーに直接サービスを提供し、市場シェアを獲得するために、独自のアプリケーション・エコシステムの構築を加速させていることを示している。 注目すべきは、Cursorのようないくつかのアプリケーションラッパーが、Claude 3.7モデルにプラグインされたときにパフォーマンスの低下やユーザーの離脱を経験していることである。 これは、モデルが製品であるという考えをさらに裏付けている: 真のAIエージェントは、既存のワークフローに対応したり適応したりするのではなく、モデル自身の能力を最大限に引き出すことに関心がある。

- アプリケーション・ラッパーの変換、モデルの自己研究に焦点を当てる: モデルプロバイダーの "下降線 "に直面し、一部のヘッド・アプリケーション・ラッパーは、積極的に変革を求め、独自のモデルトレーニング能力を構築しようとしている。 スタートが遅く、モデル・トレーニングにおいて相対的に弱いにもかかわらず、これらの企業は積極的に基礎固めを行っている。 例えばCursorは、小さなコード自動補完モデルの価値を強調している; ウインドサーフ Perplexityは、トラフィックのルーティングのために長い間自家製の分類器に依存しており、検索強化のためにDeepSeekの独自の変種のトレーニングを開始している。 これらの動きは、アプリケーション・ラッパーが、今後の競争の足がかりを得るためには「APIコール」モデルだけに頼ることは困難であり、競争力を維持するためには一定のモデル自己開発能力を習得しなければならないことに気づいたことを示している。

- UIイノベーションがブレイクアウトの鍵かもしれない: 多数の中小規模のアプリケーション・ラッパーにとって、生き残る余地は今後さらに狭まるだろう。 大規模なモデルラボがAPIサービスを軒並み縮小すれば、こうした小規模なラッパーは、より中立的な第三者の推論サービスプロバイダーに頼らざるを得なくなるかもしれない。 モデル機能の収束に伴い、UI(ユーザー・インターフェース)とユーザー・エクスペリエンスにおける革新が、小規模なパッケージ業者が突破口を開く鍵となるかもしれない。 UIの価値は、AIの分野では長い間ひどく過小評価されてきた。 ジェネリック・モデルがより強力になり、モデルのデプロイとアプリケーション・プロセスがますます合理化されるにつれて優れたユーザー・インターフェースは、製品の競争力を高め、ユーザーを惹きつける重要な要素である。 特にRAGのようなアプリケーション・シナリオでは、モデルの能力はもはや決定的な要因ではなく、使いやすさ、双方向性、ユーザー・エクスペリエンスがより重要になるだろう。

要するに、ほとんどのアプリケーション・ラッパーにとって、将来は「どっちつかず」のジレンマが待ち受けている: モデルのトレーナーに変身するか(Training)、モデルのオーナーに飲み込まれてしまうか(Being Trained On)。 現在、これらのアプリケーション・ラッパーが行っている作業は、ある意味、大規模なモデルラボにとって「無料の市場調査」と「無料のデータラベリング」になっている。 なぜなら、ユーザーのインタラクション・データとフィードバックはすべて、最終的にはモデル・プロバイダーに流れ、彼らがモデルを改良し、製品を最適化し、市場での地位をさらに強化するのに役立っているからである。

アプリケーション・ラッパーの今後の方向性は、投資家の姿勢や認識にも大きく左右される。 心配なことに、現在の投資環境は、モデルトレーニングの分野に対してやや「偏って」いるようだ。 多くの投資家はいまだに「アプリケーションが王様」という伝統的な概念に固執しており、モデルトレーニングの価値と可能性を認識していない。 この投資の「ミスマッチ」は、AI技術の健全な発展を妨げ、欧米のAI産業が将来の競争で遅れをとる原因にさえなりかねない。 その結果、一部のアプリケーション・ラッパーは、投資家に誤解されないよう、モデル・トレーニングへの取り組みを「隠さなければならない」可能性もある。 例えば、CursorのミニチュアやCodiumは、今のところ十分な宣伝や広報活動ができていない。 モデルではなくアプリケーションを重視する」というこの投資志向は、業界内で深い反省と警戒を呼び起こす必要がある。

過小評価される強化学習:AIの未来競争の鍵

現在のAI投資分野では、次のようなことが広く行われている。 "強化学習は価格に反映されなかった" 現象である。 この現象の背景には、投資コミュニティがAI技術の開発トレンドに認知バイアスをかけ、強化学習技術の戦略的意義を軽視していることがある。

AIに対するVCの投資判断は通常、いくつかの前提に基づいて行われる:

- アプリケーションレイヤーはバリューポケットであり、モデルレイヤーはインフラストラクチャーに過ぎない: 投資家は一般的に、AIの真の価値はアプリケーション層に反映され、アプリケーションの革新こそが既存市場を破壊する鍵だと考えている。 モデルレイヤーはAPIインターフェースを提供するインフラに過ぎず、中核的な競争力はない。

- モデルAPIの価格は下がり続け、アプリケーション・ラッパーは恩恵を受け続けるだろう: 投資家は、モデル・プロバイダが市場シェアを獲得するためにAPIコールの価格を下げ続け、それによってアプリケーション・ラッパーの収益性を高めると予想している。

- クローズドソースのモデルAPIは、すべてのアプリケーションに十分である: 投資家は、クローズド・ソースのモデルAPIで構築されたアプリケーションは、データ・セキュリティや自律性に対する要求が高いセンシティブな業界であっても、幅広いシナリオのニーズを満たすことができると考えている。

- モデルトレーニングは大きな投資であり、サイクルも長く、リスクも高い: 投資家は一般的に、モデルトレーニング機能の構築は「ありがたくない」投資だと考えている。 モデル・トレーニングには莫大な資本、長いサイクル、高い技術的敷居が必要であり、モデルAPIを直接購入してアプリケーションを迅速に開発するよりもはるかにリスクが高い。

しかし、"製品としてのモデル "の時代においては、こうした仮定はますます通用しなくなってきている。 投資界がこのような時代遅れの概念を持ち続ければ、AI開発の戦略的機会を逃し、市場資源の配分を誤ることになりかねないと懸念している。 現在のAI投資ブームは、「危険なギャンブル」、「最新の技術開発(特に強化学習)を正確に評価できない市場の失敗」に発展する可能性がある。

ベンチャー・キャピタル(VC)ファンドは、以下のようなポートフォリオへの投資を求めている。 "無相関"VCの目標はS&P500指数に勝つことではない。 VCの目標は、S&P500指数に勝つことではなく、全体的なリスクを軽減し、いくつかの投資がダウンサイクルでも利益を生むように分散されたポートフォリオを構築することである。 無相関」投資のプロフィールに合致するモデル・トレーニング。 欧米主要国の景気後退リスクを背景に、イノベーションと成長の大きな可能性を秘めたAIモデルトレーニングの分野は、マクロ経済サイクルとの相関性が弱い。 しかし、研修モデル企業は一般的に資金調達難に直面しており、これはベンチャー・キャピタルの本質的な論理に反している。 プライム・インテレクトは、最先端のAIラボに成長する可能性を秘めた、数少ない欧米のAIモデル育成スタートアップのひとつだ。 初の分散型LLMを育成するなど、技術的なブレークスルーはあるものの、資金規模は普通の「シェル」アプリ企業に匹敵する。 悪貨が良貨を駆逐する」という現象は示唆に富む。

いくつかの大規模な研究所を除いて、AIモデルをトレーニングするための現在のエコシステムは、非常に脆弱で限界にある。 世界的に見ても、モデル・トレーニングに力を入れている革新的な企業はほんの一握りだ。 Prime Intellect、Moondream、Arcee、Nous、Pleias、Jina、HuggingFace事前トレーニングチーム(非常に小規模だが)などが、オープンソースのAIモデルトレーニングスペースのほぼ全体を構成している。 アレンAI、EleutherAIなどの一握りの学術機関とともに、彼らは現在のオープンソースAIトレーニング基盤の基礎を築き、維持している。 ヨーロッパでは、Pleiasチームが開発したコモン・コーパス・コーパスと事前学習ツールに基づいてモデル学習を計画しているLLMプロジェクトが7~8あることを知った。 盛んなオープンソースコミュニティは、商業投資の不足を補うために一定の役割を果たしているが、モデルトレーニングのエコシステムが直面している課題の根本を突き止めるのに苦労しているのも事実だ。

OpenAIも「垂直RL」の重要性を痛感しているようだ。 最近、OpenAIの幹部がシリコンバレーのスタートアップ・シーンに不満を表明したという報道があった。 おそらく、このメッセージはサム・アルトマン自身から発せられたものであり、次回のYCスタートアップキャンプに反映されるかもしれない。 これは、OpenAIのコラボレーション戦略の転換の可能性を示唆している。 将来、OpenAIが選ぶパートナーは、もはやAPIの顧客だけでなく、モデルの初期トレーニング段階に関わる「共同契約者」になるかもしれない。 舞台裏から表舞台へと移るモデルトレーニングは、AI競技の核となる。

製品としてのモデル」の時代は、AIイノベーションのパラダイムシフトを意味する。 単独で戦う時代は終わり、オープンな協力と共同イノベーションが主流になるだろう。 検索領域とコード領域は、「モデル・アズ・プロダクト」を最初に達成した領域である。その理由の大部分は、この2つの領域におけるアプリケーション・シナリオが比較的成熟していること、市場の需要が明確であること、そして技術的な道筋が明確であることである。 例えば カーソル このような革新的な製品は、迅速に反復し、わずか数ヶ月でリリースすることができる。 しかし、ルールベースのシステムのインテリジェントなアップグレードなど、将来に向けてより価値の高いAIの応用シナリオはまだ模索の初期段階にあり、技術的な課題も大きく、市場の需要も不透明であるため、「短・中・急」の方法でブレークスルーを達成するのは難しい。 このような分野では、学際的なバックグラウンドを持ち、長期的かつ綿密な研究開発投資を行うための高度な集中力を備えた小規模チームが必要とされる。 このような「小さくて美しい」イノベーション・チームは、将来AI業界で重要な力を持つようになるかもしれないし、初期の技術蓄積を終えた後、その価値を実現するために大手テクノロジー企業に買収されるかもしれない。 ユーザーインターフェース(UI)の分野でも、同様のコラボレーションモデルが出現する可能性がある。 UIイノベーションに注力する企業の中には、大規模なモデルラボと戦略的パートナーシップを確立し、クローズドソースの特殊モデルへの独占的なAPIアクセスを得ることで、差別化された競争力のあるAI製品を構築することができる。

ディープシークの戦略的レイアウトは、「モデルは製品である」というトレンドの中で、より前向きで野心的であることは間違いない。 DeepSeekが目指すのは、「製品としてのモデル」ではなく、「共通インフラ層としてのモデル」である。 OpenAIやAnthropicと同様に、DeepSeekの創設者であるWenfeng Lianは、DeepSeekのビジョンを公言している:

我々は、現在の段階は 技術革新の爆発、アプリケーションの爆発ではないディープシークは、AIを活用した産業エコシステムを構築している。 AIの川上と川下の業界エコシステムが完全に構築されて初めて、ディープシークはアプリケーションそのものを行う必要はない。 もちろん必要であれば、ディープシークはアプリケーションも行うことができますが、これは優先事項ではありません。 ディープシークの中核戦略は、常に技術革新を堅持し、強力なAI共通基盤プラットフォームを構築することである。

"モデル・アズ・プロダクト "の時代において、アプリケーション・レイヤーに注意を限定することは、以下のことに等しい。 "次世代の戦争の指揮には、前世代の戦争の将兵を使え"心配なのは、西側のAI業界がいまだに「アプリケーションが王様」という古い考え方に浸っているように見えることだ。 心配なのは、西側のAI業界はいまだに「アプリケーションが王様」という古い考え方に浸っているようで、AI開発の新しいトレンドに対する十分な知識と準備が欠けていることだ。 おそらく多くの人々は、AI分野の「戦争」が静かに新たな局面を迎えていることにまだ気づいていない。 製品としてのモデル」という新しいパラダイムを最初に取り入れた者は、将来のAI競争で先手を打つことになるだろう。

© 著作権表示

記事の著作権 AIシェアリングサークル 無断転載はご遠慮ください。

関連記事

コメントはありません