RIG(Retrieval Interleaved Generation):検索しながら書き込む検索戦略で、リアルタイムデータのクエリに適している。

技術の核心:リトリーバル・インターリーブド・ジェネレーション(RIG)

- RIGとは?

RIGは、大規模言語モデルによる統計データの処理における幻覚の問題に対処するために設計された革新的な生成手法である。従来のモデルが不正確な数値や事実を無から生成するのに対し、RIGは外部データソースへのクエリーを生成プロセスに挿入することで、データの信憑性を確保する。 - 動作原理 ::

- このモデルは、統計が必要な質問を受けると、答えを生成する際にデータ・コモンズ(グーグルが提供する公開データ知識ベース)を動的に呼び出す。

- クエリの結果は、例えば自然言語で出力に埋め込まれる:[DC("フランスの人口は?")-->"6700万人"]。.

- この「検索と生成のインターリーブ」によって、検証された統計情報を提供しながら、言語的な流暢さを維持することができる。

モデル詳細

- 基本モデル Gemma 2 (27Bパラメータバージョン)は、研究と実験のために設計された効率的なオープンソースの言語モデルです。

- 目標の微調整 データコモンズへの問い合わせが必要なタイミングを認識し、そのデータを生成プロセスにシームレスに統合できるよう、特別に訓練されています。

- インプットとアウトプット ::

- 入力:任意のテキストプロンプト(質問や文など)。

- 出力:英文テキスト。データコモンズのクエリー結果が埋め込まれている場合があります。

- 多言語主義 主に英語をサポート("it "は "instruction-tuned"、つまりインストラクション・チューン版という意味かもしれないが、このページには言語範囲は明記されていない)。

アプリケーションシナリオ

- 対象ユーザー 学術研究者、データサイエンティスト。

- 使用 ある国の人口」や「ある年の世界のCO2排出量」など、正確な統計が求められるシナリオに適しています。

- 制約条件 現在のところ初期バージョンであり、信頼できるテスターのみが使用できるもので、本番環境や商用利用は推奨されていません。

モデルhttps://huggingface.co/google/datagemma-rig-27b-it

原文ママhttps://arxiv.org/abs/2409.13741

RIG実現プロセス

RIGは、検索と生成を連動させたアプローチであり、LLMに自然言語クエリを生成させてデータコモンズからデータを検索することで、生成結果の精度を向上させることを目的としている。以下にRIGの詳細な実装手順を示す:

1. モデルの微調整(モデルの微調整)

目的: LLMがデータコモンズから統計情報を取得するための自然言語クエリを生成できるようになること。

動く::

- 最初のクエリーと生成LLMは統計クエリを受け取ると、通常、数値の答えを含むテキストを生成する。この数値回答をLLM(LLM-SV)によって生成された統計値例えば、「カリフォルニア州の総人口は?例えば、"カリフォルニア州の総人口は?"というクエリに対して、LLMは "カリフォルニア州の総人口は約3,900万人です。というクエリに対して、LLMは「カリフォルニア州の総人口は約3,900万人です」と生成するかもしれません。

- 関連データの特定LLMによって生成されたテキストから、データ・コモンズのデータベースから最も関連性の高いデータを特定し、ファクトチェックのメカニズムとしてユーザーに提供する必要がある。この検索された値をデータコモンズ統計値(DC-SV).

- 自然言語クエリの生成これを実現するために、LLMを微調整し、LLM-SVとともにLLM-SVを記述する自然言語クエリを生成する。このクエリはデータコモンズからデータを取得するために使われる。

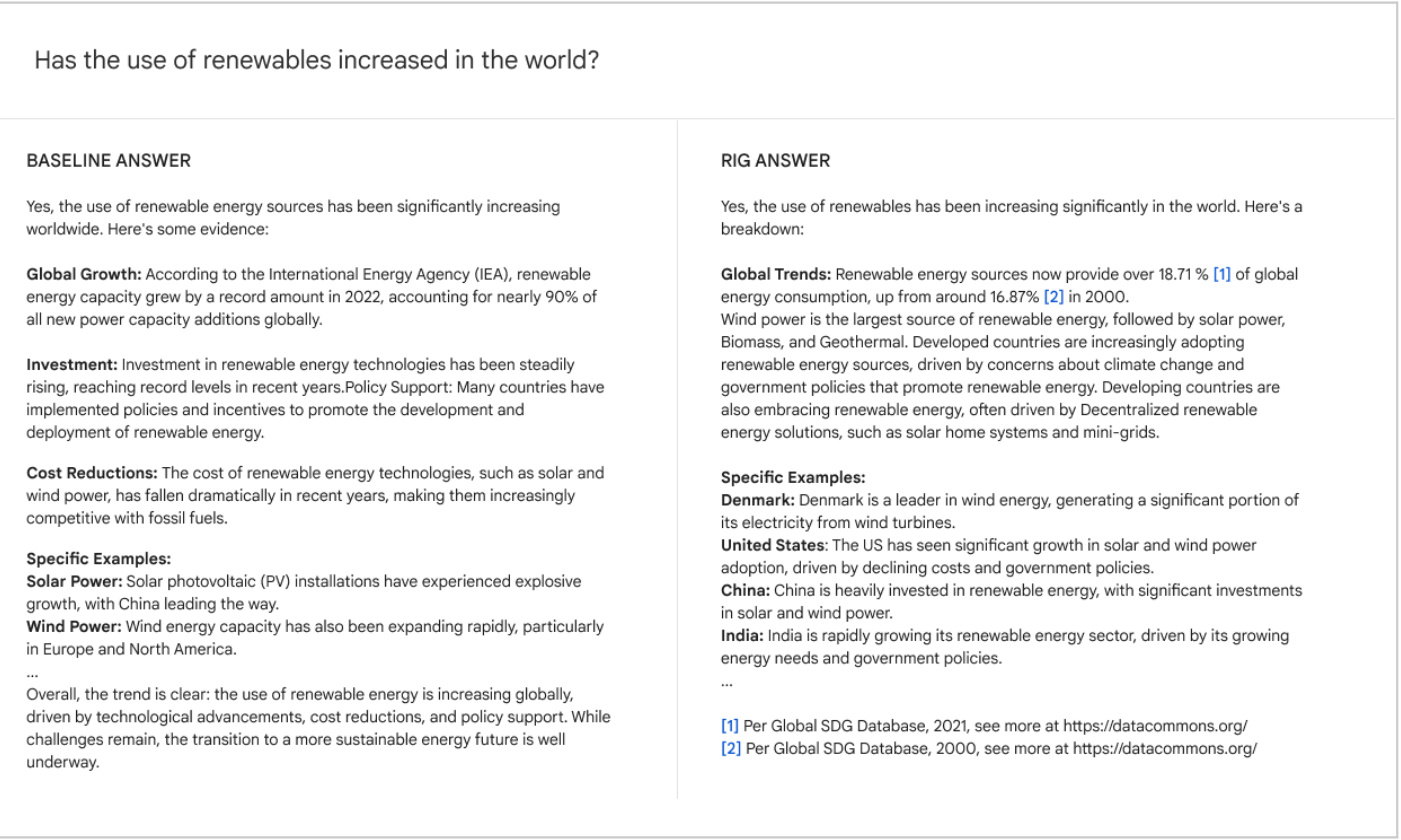

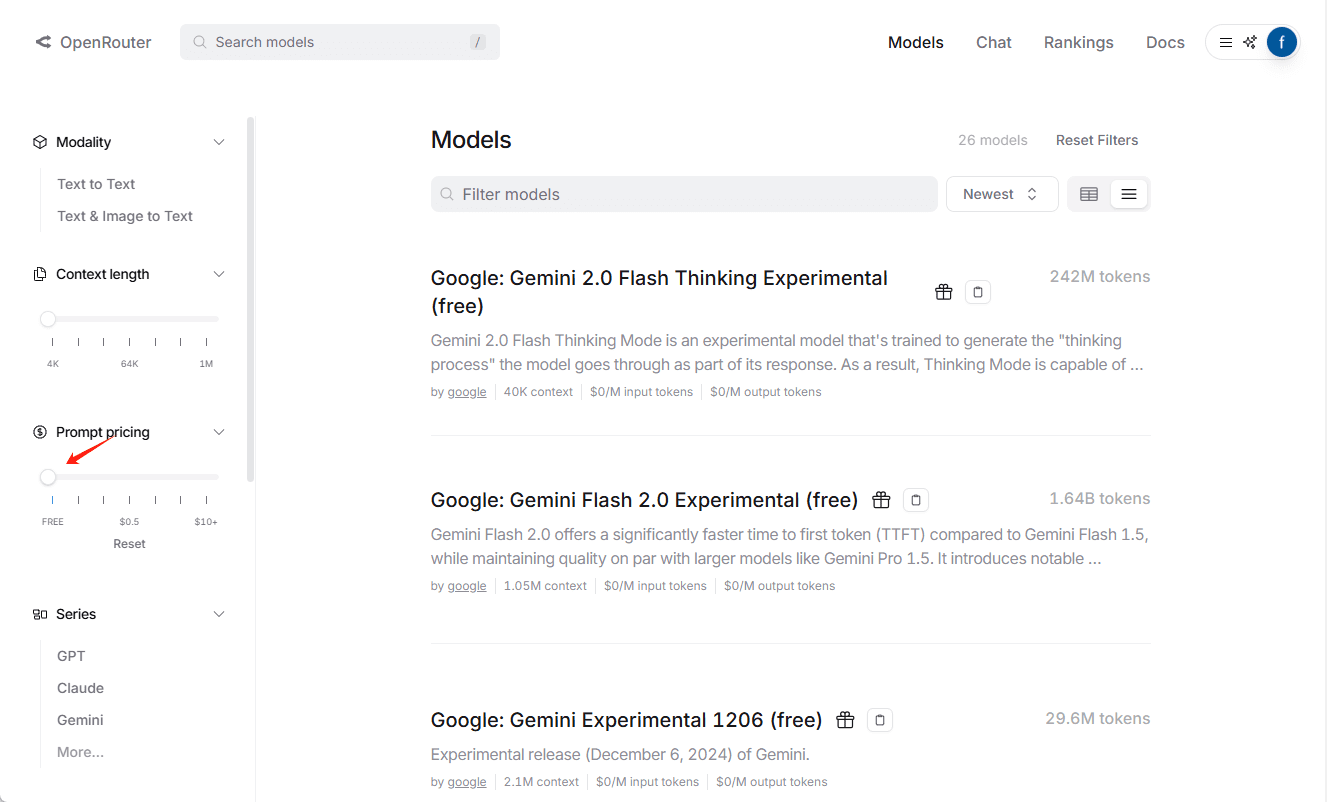

図1:ベースラインGemma(Gemma 7B IT、Gemma 2 27B IT)とRIG(Retrieve Interleaved Generation)のクエリ回答比較。図1ベースラインのGemmaモデルとRIGモデルの回答の比較を示す。RIGモデルは統計値だけでなく、検索に使用されるクエリーも生成する。

- トレーニングデータセット約700のユーザークエリを含むコマンドレスポンスデータセットを微調整に使用します。各クエリに対して、統計データ(約400例)を含むベースモデルによって生成されたレスポンスを選択し、より強力なLLM(例:Gemini 1.5 Pro)を使用して自然言語のデータコモンズコールを生成します。

典型例::

- 諮るカリフォルニア、サンフランシスコ、アラバマ、そしてアメリカに関する統計をひとつ教えてください。

- 生返事::

- カリフォルニア州は全米で最も人口の多い州として第1位であり、2020年には約3900万人になる。

- サンフランシスコの糖尿病罹患率は人口10000人当たり9.2人である。

- ...

- 微調整されたレスポンス::

- カリフォルニア州は、全米で最も人口の多い州として第1位である。DC(2020年のカリフォルニア州の人口は?

- サンフランシスコでは、糖尿病率は[ ]である。DC(サンフランシスコにおける糖尿病の有病率は?]

- ...

2. クエリー変換

目的LLMが生成した自然言語クエリを、データコモンズからデータを取得するための構造化クエリに変換します。

動く::

- クエリを分解する自然言語クエリを以下の要素に分解する:

- 統計変数またはトピック例:「失業率」、「人口統計」など。

- サイト例えば「カリフォルニア」。

- 因果性例:「ランキング」、「比較」、「変化率」など。

- マッピングと識別例えば、統計変数を特定するために埋め込みベースのセマンティック検索インデックスを使用し、場所を特定するために文字列ベースの名前付きエンティティ認識を実装する。

- カテゴリーとテンプレートのマッチング識別されたコンポーネントに基づき、クエリを一定のクエリテンプレートに分類する。例

- YY(YY有多少XX)のXXはいくつ?)

- AAにおけるZZ間のXXとYYの相関関係は何か(What is correlation between XX and YY across ZZ in AA)

- YYのXXでZZの数が最も多いのはどれか(YY中哪些XX的ZZ数量最多)

- YY(YYY中最重要显著的XX是什么35 YY中最重要显著的XX是什么35 YY中最重要显著的XX是什么35 YY中最重要显著的XX是什么34)

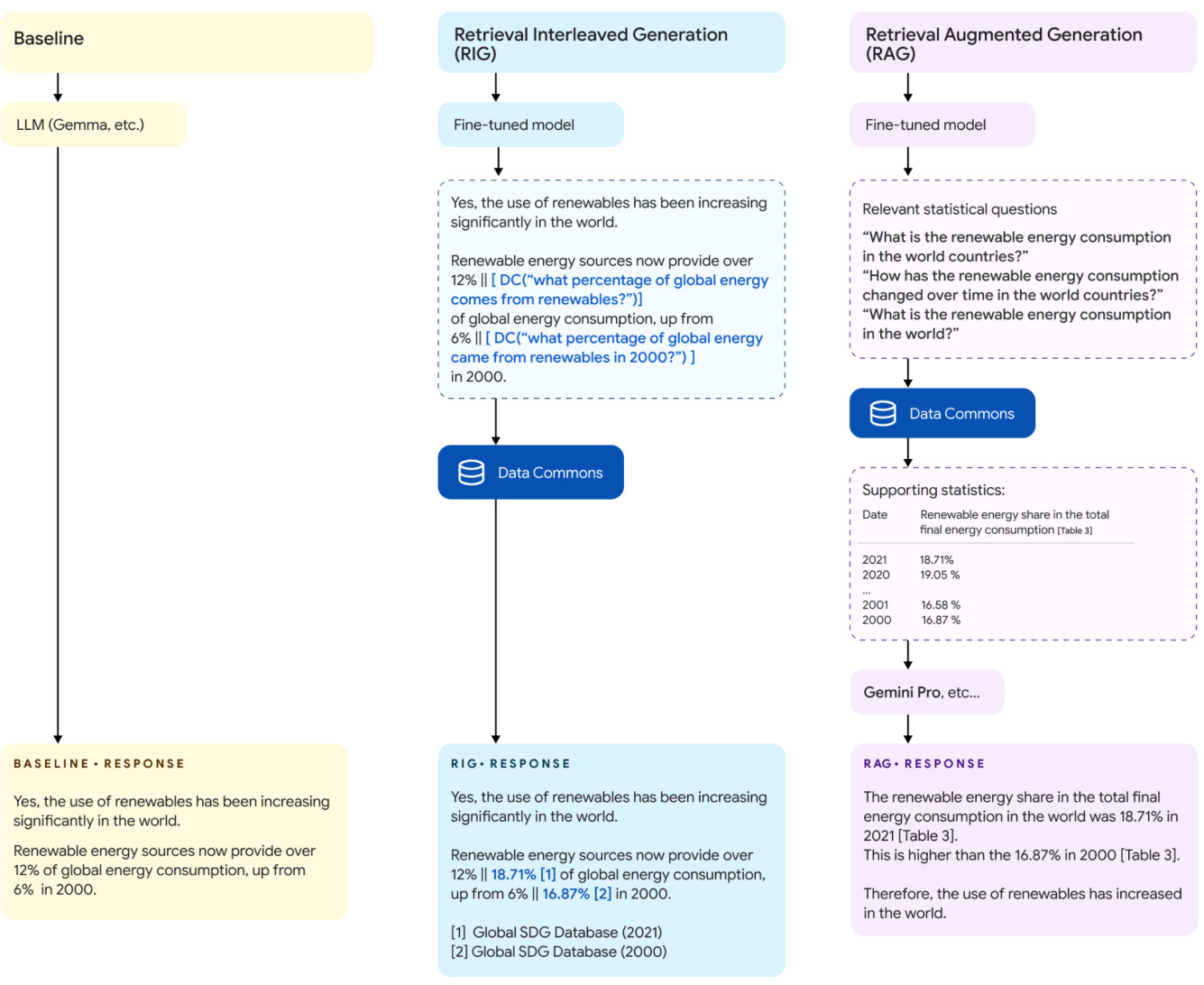

図2:ベースライン、RIG、RAGの統計による回答作成方法の比較。ベースラインアプローチは根拠を示さずに直接統計を報告するが、RIGとRAGはデータコモンズを利用して権威あるデータを提供する。図2ベースライン、RIG、RAGの各アプローチの比較を示す。RIGアプローチは、データコモンズからの検索に適した自然言語の質問と織り交ぜて統計タグを生成する。

- クエリーの実行データコモンズの構造化データAPIを呼び出し、クエリーテンプレートと変数や場所のIDに基づいてデータを取得します。

3. フルフィルメント

目的検索されたデータは、LLMによって生成された統計値とともにユーザーに提示されます。

動く::

- データ・プレゼンテーションデータコモンズから返された回答は、オリジナルのLLMが作成した統計データと共にユーザーに提示されます。これにより、ユーザーはLLMのファクトチェックを行うことができます。

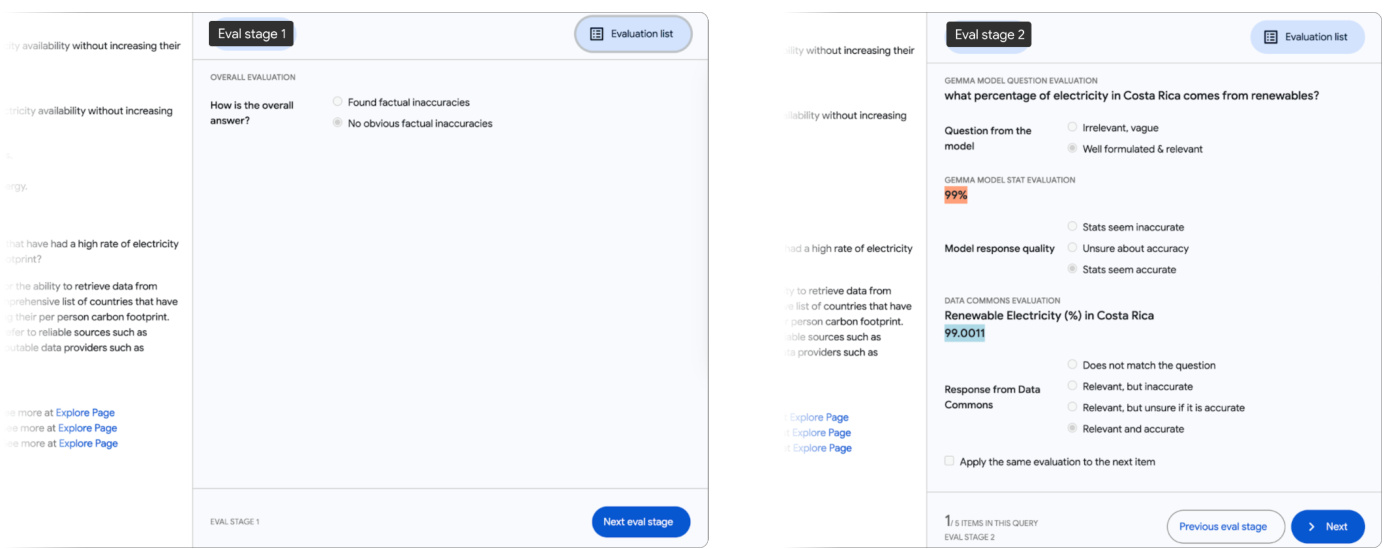

図3:RIG評価ツール。この図は、2つの評価段階のスクリーンショットを並べて表示したものです。各段階には2つのパネルがあります。左側には、評価される完全な回答が表示されます(上の画像ではスペースを節約するために除外されています)。右側は評価タスクです。ステージ1では、評価者は明らかな誤りがないか素早くチェックします。ステージ2では、評価者は回答に含まれる各統計を評価します。図3RIG評価ツールの使用プロセスを示します。評価者は、明らかな誤りがないかを素早くチェックし、回答に存在するすべての統計を評価することができます。

- ユーザーエクスペリエンスサイド・バイ・サイド、相違点の強調表示、脚注、ホバー・アクションなど、この新しい結果を提示する方法はさまざまあり、今後の課題として検討することができる。

概要

RIGの実施プロセスには、以下の重要なステップが含まれる:

- モデリングの微調整LLMが生成した統計値を記述する自然言語クエリをLLMに生成させる。

- クエリー変換自然言語クエリを構造化クエリに変換し、データコモンズからデータを取得します。

- データ検索とプレゼンテーションデータコモンズからデータを取得し、LLMが生成した統計情報とともにユーザーに提示する。

これらのステップを通じて、RIGメソッドはLLMの生成能力とデータコモンズのデータリソースを効果的に組み合わせ、統計クエリの処理におけるLLMの精度を向上させる。

© 著作権表示

記事の著作権 AIシェアリングサークル 無断転載はご遠慮ください。

関連記事

コメントはありません