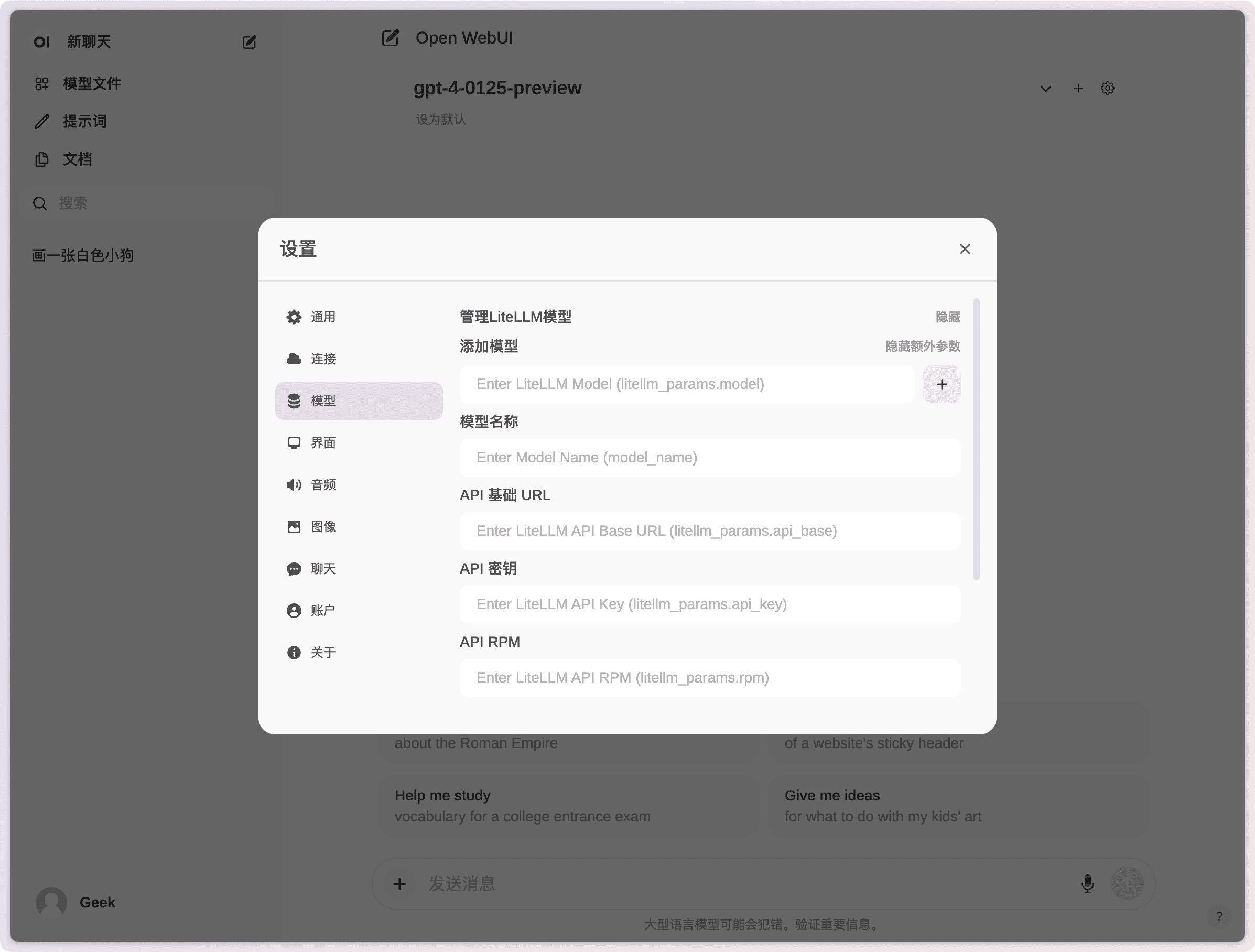

Open WebUI: ローカルでホストされるAIチャットWebUI

はじめに

Open WebUI(旧称Ollama WebUI)は、LLM(大規模言語モデル)のために設計されたフレンドリーなAI対話型ユーザー・インターフェースです。Open WebUIの優れた機能には、チャット形式のインターフェースデザイン、高い応答性、DockerやKubernetesを使った簡単なセットアップ、コードハイライト、MarkdownとLaTeXのサポート、ローカルとリモートのRAG統合、音声/ビデオ通話機能、画像生成の統合などがあります!などなど。

OpenWebUIについて:

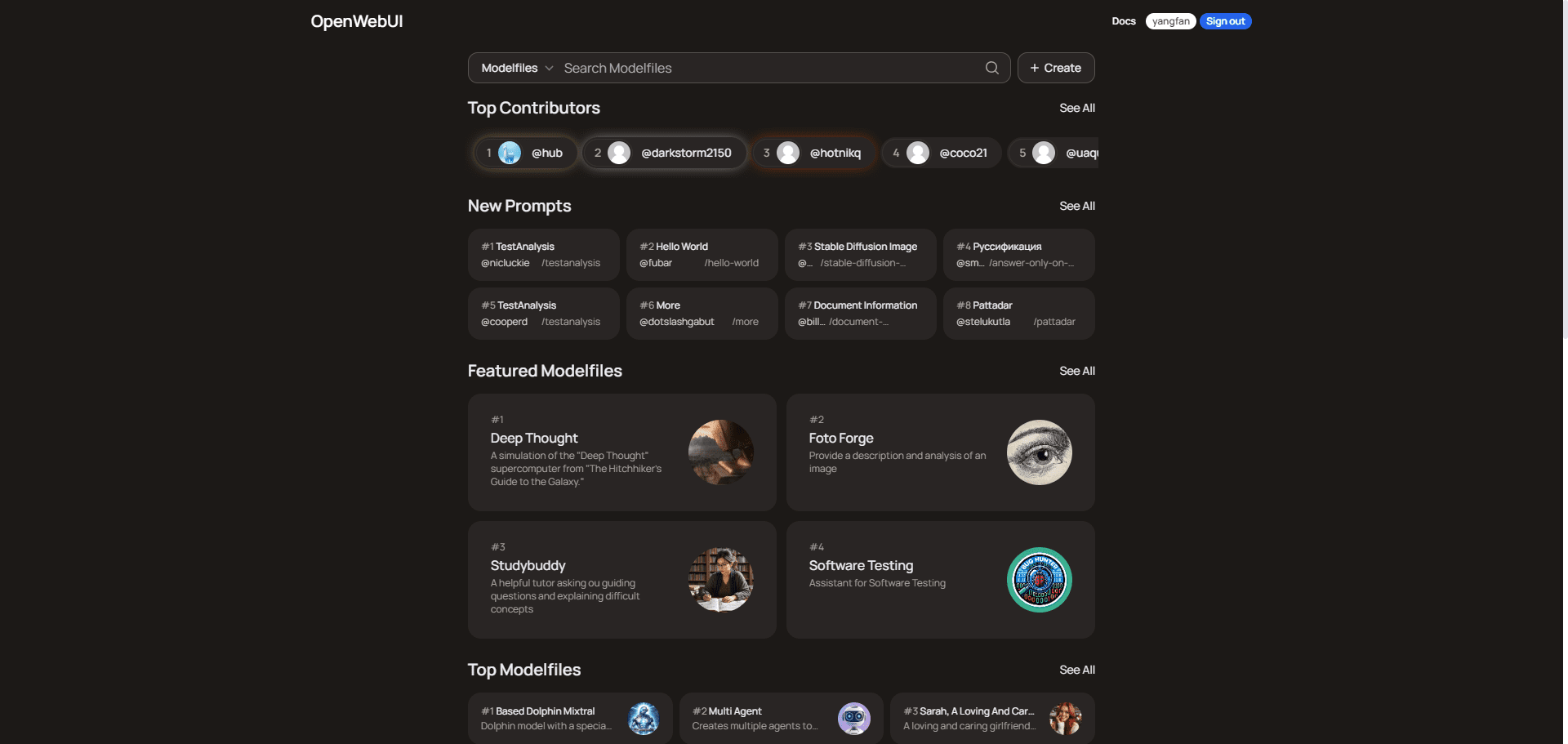

OpenWebUIは、プログラミング、ライティング、生産性向上、教育、ビジネス、データ分析などをカバーする多目的モデルファイルを提供するユーザーコミュニティプラットフォームです。ユーザーは、タスクやプロジェクトの効率を高めるために、これらのモデルファイルを探索し、ダウンロードすることができます。このプラットフォームには15,000人以上のユーザーがおり、投稿者のランキングや共有されたスマートチャットログに基づいてコミュニケーションや学習を行っています。

無料のクラウド展開方法については ミニチュア・チャット・ツールの個人用セットを薄型コンピュータに導入 以下は、KoyebによるOpen WebUIの導入についての説明である。

機能一覧

- シームレスなインストールDockerやKubernetes経由で簡単にインストールでき、OllamaやCUDAタグ付きイメージもサポートしています。

- API統合OpenAI互換のAPIと簡単に統合でき、複数の対話モデルをサポートします。

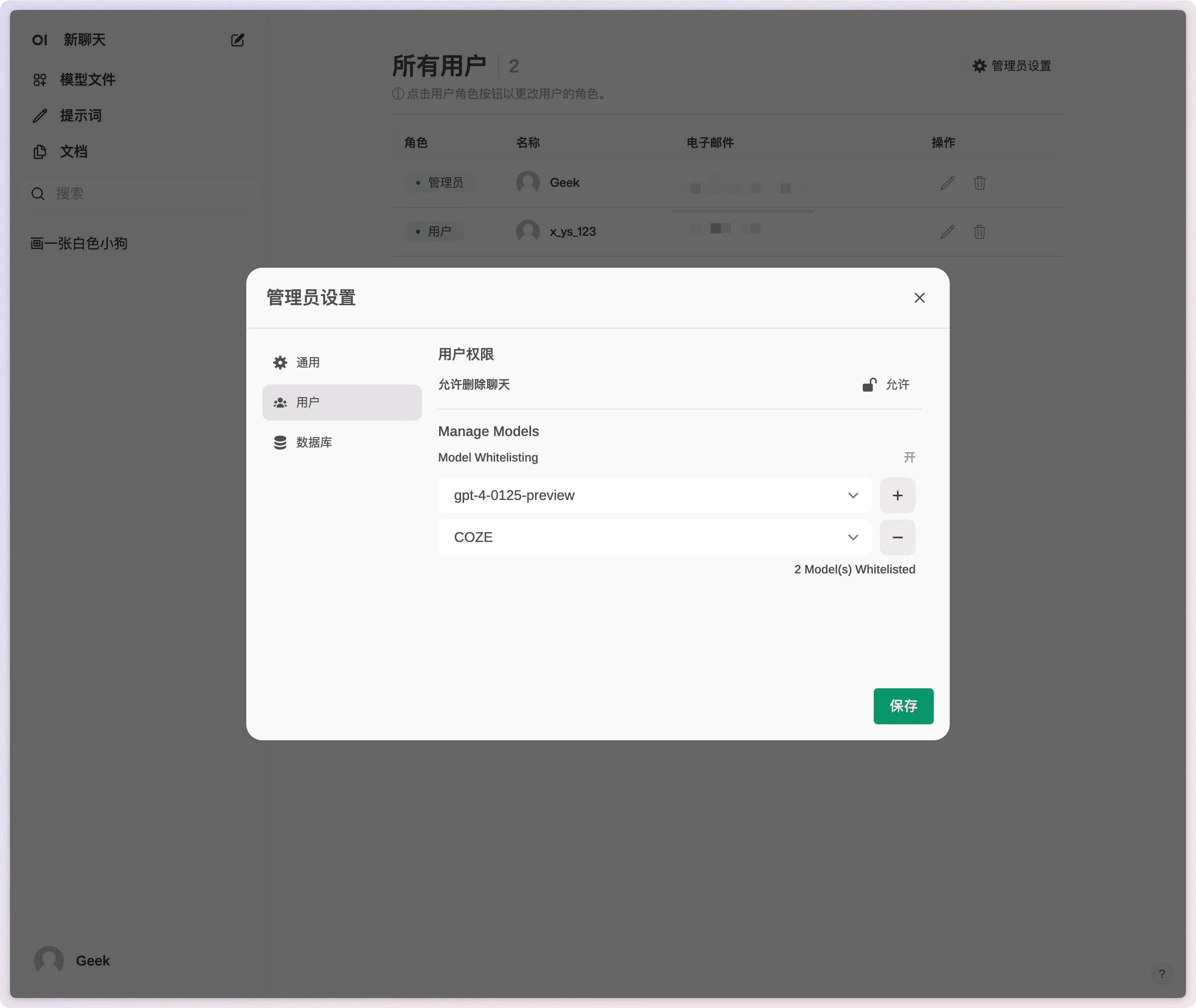

- きめ細かなパーミッションとユーザーグループ管理者は、詳細なユーザーの役割と権限を作成し、安全なユーザー環境を確保することができます。

- レスポンシブデザインデスクトップPC、ノートPC、モバイルデバイスでシームレスな体験をお楽しみください。

- プログレッシブ・ウェブ・アプリケーション(PWA)オフラインアクセスをサポートし、モバイルデバイス上でネイティブアプリのような体験を提供します。

- MarkdownとLaTeXのサポート総合的なMarkdownとLaTeXの機能を提供し、インタラクティブな体験を向上させる。

- 音声/ビデオ通話ハンズフリー音声通話とビデオ通話を統合し、よりダイナミックなチャット環境を実現。

- モデルビルダーOllama モデルを簡単に作成し、Web UI からカスタム ロール/エージェントを追加できます。

- 地域のRAG統合Retrieval Augmented Generation (RAG)をサポートし、ドキュメントとのやり取りをチャット体験にシームレスに統合。

- 画像生成の統合AUTOMATIC1111 API、ComfyUI、OpenAIのDALL-Eをサポートし、チャット体験を豊かにします。

- マルチモデル対話複数のモデルを同時に操作し、それぞれの長所を活かして最適な対応を行う。

- 役割ベースのアクセス制御(RBAC)Ollamaへのアクセスおよびモデル作成/引き上げの権限を持つのは、権限を与えられた担当者のみとし、安全なアクセスを確保する。

- 多言語サポート国際化サポートは、ユーザーが好みの言語を選択できるように提供されます。

- プラグイン対応Pipelinesプラグインフレームワークにより、カスタムロジックとPythonライブラリをシームレスに統合。

ヘルプの使用

設置プロセス

Dockerを使ったインストール

- プルミラーターミナルで以下のコマンドを実行し、GitHubコンテナ・レジストリから最新のOpen WebUI Dockerイメージを取り出します:

docker pull ghcr.io/open-webui/open-webui:main - 実行中のコンテナ永続的なデータ保存を保証するために、デフォルト設定でコンテナを実行する:

docker run -d -p 3000:8080 -v open-webui:/app/backend/data --name open-webui ghcr.io/open-webui/open-webui:main- ボリュームマッピングコンテナ再起動時のデータ消失を防ぐため、永続的なデータストレージを確保する。

- ポートマッピングローカルマシンのポート3000にWebUIを公開する。

Pythonを使ったインストール

- Open WebUIのインストール互換性の問題を避けるため、必ずPython 3.11を使用してください。ターミナルで以下のコマンドを実行してください:

pip install open-webui - オープンWebUIの実行インストールが完了したら、以下のコマンドを実行して Open WebUI を起動します:

open-webui serveこれでOpen WebUIサーバーが起動します。http://localhost:8080访问。

機能操作ガイド

音声/ビデオ通話

- 電話をかけるチャット画面で「音声通話」または「ビデオ通話」ボタンをクリックし、連絡先を選択して通話を開始します。

- 呼制御通話中、インターフェイスのコントロールボタンでミュートや電話を切ることができます。

画像生成

- 画像生成ツールを選択: チャット画面でAUTOMATIC1111 API、ComfyUI、OpenAIのDALL-Eを選択します。

- 入力内容入力ボックスに画像の説明を入力し、生成ボタンをクリックします。

- 結果を見る生成された画像はチャットに表示され、保存や共有が可能です。

地域のRAG統合

- 書類の読み込みドキュメントをロードしたり、ドキュメント・ライブラリにファイルを追加するには、チャット・インターフェースの#コマンドを使用します。

- 取り出すチャットにクエリを入力すると、システムは自動的に読み込まれたドキュメントから関連情報を取得し、応答を生成します。

一般的な問題

- 接続性の問題接続の問題が発生した場合は、DockerコンテナがOllamaサーバーにアクセスできることを確認してください。以下のコマンドで解決してください:

docker run -d --network=host -v open-webui:/app/backend/data -e OLLAMA_BASE_URL=http://127.0.0.1:11434 --name open-webui --restart always ghcr.io/open-webui/open-webui:main - Dockerインストールの更新: Watchtowerを使って、ローカルのDockerインストールを最新バージョンにアップデートしてください:

docker run --rm --volume /var/run/docker.sock:/var/run/docker.sock containrrr/watchtower --run-once open-webui

CuddlefaceでOpen WebUIをワンクリックでデプロイする

https://codeberg.org/fossandroid/Open-WebUI.git

https://linux.do/t/topic/274417

© 著作権表示

記事の著作権 AIシェアリングサークル 無断転載はご遠慮ください。

関連記事

コメントはありません