OpenVoice (MyShell):少ないサンプルで多言語の音声クローニングが可能

はじめに

OpenVoiceは、リファレンス・スピーカーの音声を複製し、スピーカーの短いオーディオ・クリップのみを使用して多言語音声を生成する、汎用性の高いオンザフライ・ボイス・クローニング手法です。OpenVoiceでは、音質の再現に加え、感情、アクセント、リズム、間、イントネーションなどのボイススタイルを細かくコントロールすることができます。

OpenVoice関連音声合成プロジェクト: https://github.com/myshell-ai/MeloTTS

このプロジェクトは、データセットを使って独自の音声を訓練することができるが、訓練インターフェースがない。Instantaneous Speech Cloningとは異なり、安定的に訓練されたモデルを使った音声合成に重点を置いている。

機能一覧

正確なトーンクローニング:OpenVoiceは、基準トーンを正確に複製し、複数の言語やアクセントの音声を生成できます。

柔軟な音声スタイルコントロール:OpenVoiceでは、感情、アクセント、リズム、間、イントネーションなど、音声スタイルを細かくコントロールできます。

ゼロショットによるクロスランゲージ音声クローニング:生成される音声は参照音声と同じ言語である必要はなく、大規模な多言語トレーニングデータセットで提示される必要もない。

注目だ:

1.正確なトーンクローニング。 OpenVoiceは、基準音を正確に複製し、複数の言語やアクセントの音声を生成することができます。

2.フレキシブルなトーンコントロール。 OpenVoiceは、ボイススタイル(感情やアクセントなど)だけでなく、リズム、ポーズ、イントネーションなどのスタイルパラメータを細かくコントロールできます。

3. サンプル数ゼロのクロスリンガル音声クローニング。 音声が生成される言語も、音声が参照される言語も、大規模な話者多言語トレーニングデータセットに存在する必要はない。

ヘルプの使用

詳細については、使用説明書を参照してください。

よくある質問についてはQAをご確認ください。質問と回答のリストは定期的に更新していきます。

MyShellで適用する:インスタント・スピーチ再生および音声合成(TTS)サービスの直接利用。

ミニマリストの例:高品質を必要としないOpenVoiceを素早く体験できます。

Linuxのインストール:研究者・開発者限定。

グーグルコラボのクイックトライアル

/content!git clone -b dev https://github.com/camenduru/OpenVoice /content/OpenVoice!apt -y install -qq aria2!aria2c --console- -log-level=error -c -x 16 -16 -k 1M https://github.com/camenduru/OpenVoice -d /content -o checkpoint_ 1226 zip!log-level=error -c -x 16 -s 16 -k 1M https://huggingface.co/camenduru/OpenVoice/resolve/main/checkpoints_1226.zip -d /content -o checkpoints_ 1226 zip!unzip1226.zip!unzip /content/checkpoints_1226.zip!pip install -q gradio==3.50.2 langid faster-whisper whisper-timestamped unidecode eng-to-ipapypinyin cn2an!python openvoice_app.py --share

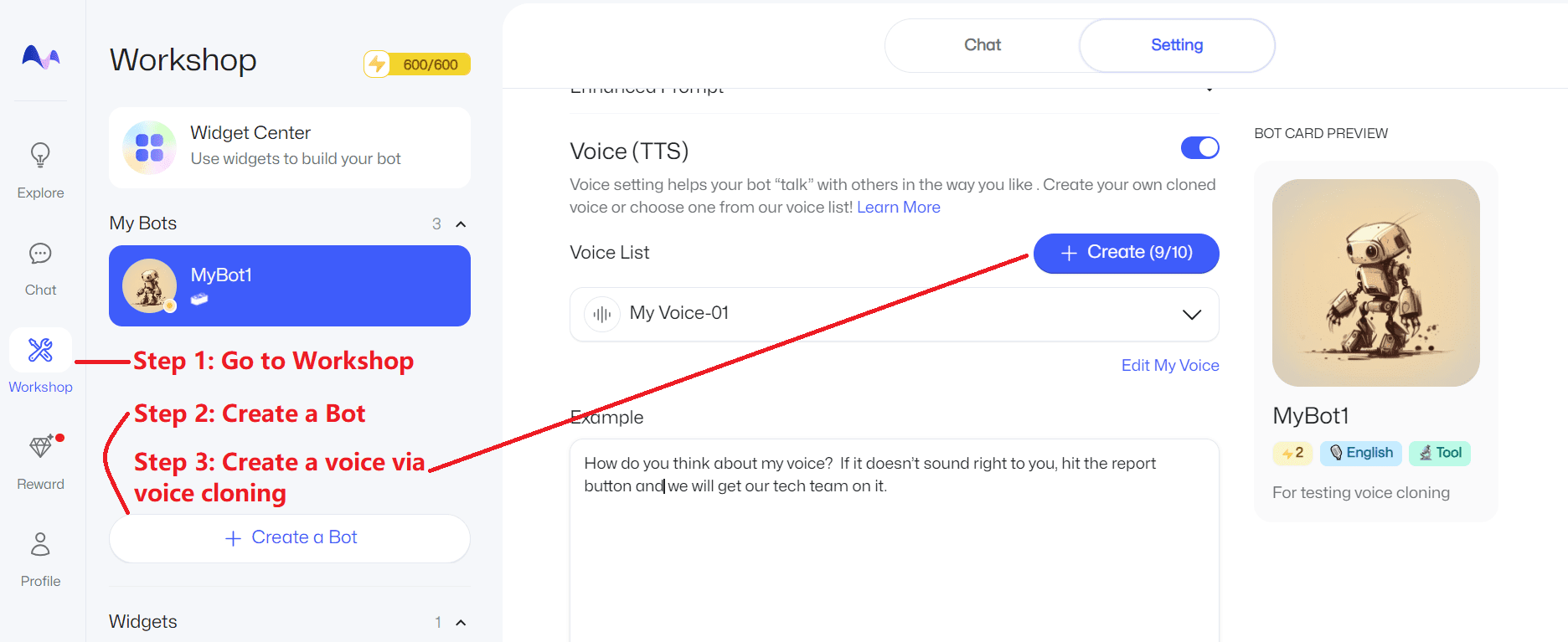

マイシェルに適用する

ほとんどのユーザーにとって、無料のTTSとライブボイスレプリケーションサービスを体験する最も便利な方法は、MyShellで直接体験することです。

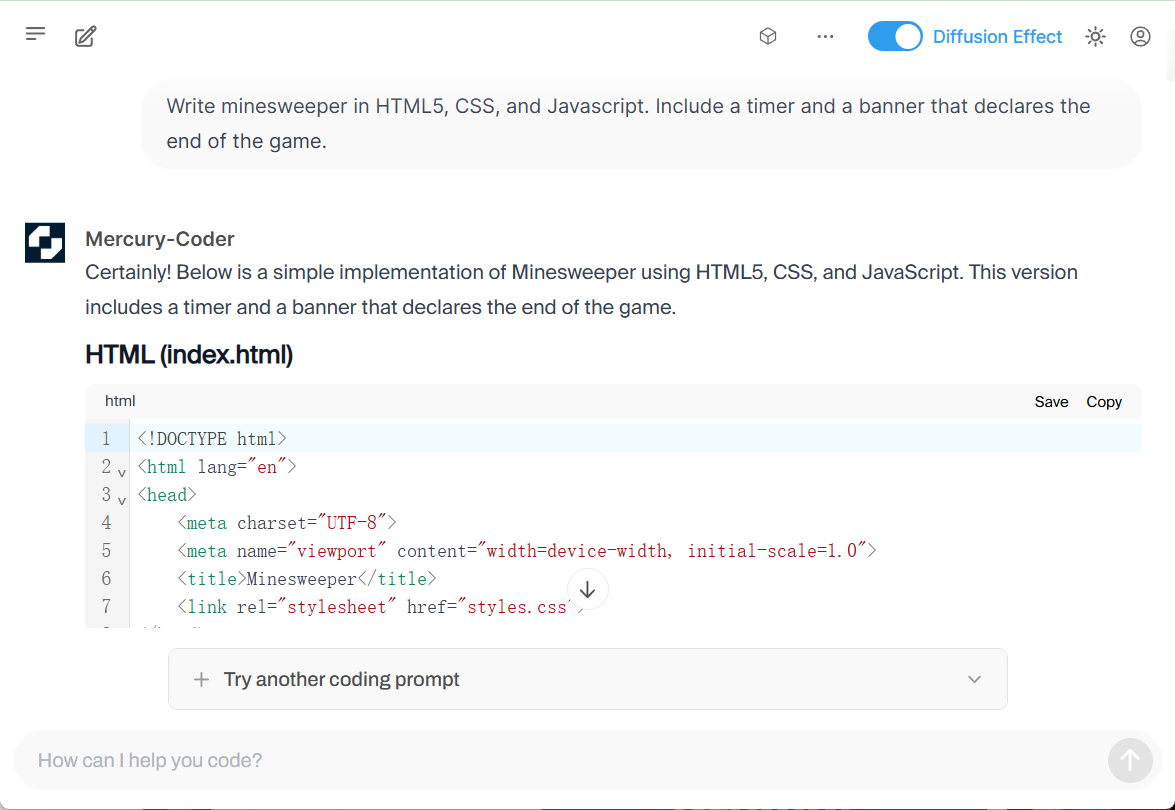

TTSサービス

ここをクリック以下の手順に従ってください:

ボイスクローニング

ここをクリック以下の手順に従ってください:

ミニマリストの例

OpenVoiceを手っ取り早く味わいたい方、あまり品質や安定性を求めない方は、以下のリンクをクリックしてください:

レプトンAI:https://www.lepton.ai/playground/openvoice

MySHell:https://app.myshell.ai/bot/z6Bvua/1702636181

ハグする顔:https://huggingface.co/spaces/myshell-ai/OpenVoice

Linuxのインストール

このセクションは主にLinux、Python、PyTorchに熟練した開発者や研究者のためのものです。このリポジトリをクローンして、以下のようにしてください:

conda create -n openvoice python=3.9

コンダはオープンボイスをアクティベートする

git clone git@github.com:myshell-ai/OpenVoice.git

cd OpenVoice

pip install -e .

From [以下はチェックポイントをダウンロードし、それを解凍して チェックポイント ファイル

1. 柔軟な音声スタイルコントロール:参照デモパート1.ipynb]OpenVoiceがクローン音声のスタイルをどのように制御しているかをご紹介します。

2. 言語横断的な音声クローニング:をご参照ください。デモパート2.ipynb]MSML学習セットで表示される言語、表示されない言語のデモについて学ぶ。

3. グラディオのデモここでは、最小限のローカル・グラディオ・シミュレーションを提供する。gradioのデモに問題がある場合は demo_part1.ipynbそしてdemo_part2.ipynb と [QnA]を使用する。 python -m openvoice_app --share ローカルのgradioデモを開始する。

3. アドバンスト・ユーザーズ・ガイドベースとなる音声モデルは、ユーザーが好む任意のモデル(任意の言語、任意のスタイル)に置き換えることができます。デモにあるように se_extractor.get_se 新しいベーススピーカーのためのトーン埋め込みを抽出する方法。

4. 自然な音声を生成するための提案:自然な音声を生成するためのTTSには、単一話者や複数話者のものが数多くあります。ベースとなる話者モデルをお好みのモデルに置き換えるだけで、音声の自然さをお好みのレベルにまで高めることができます。

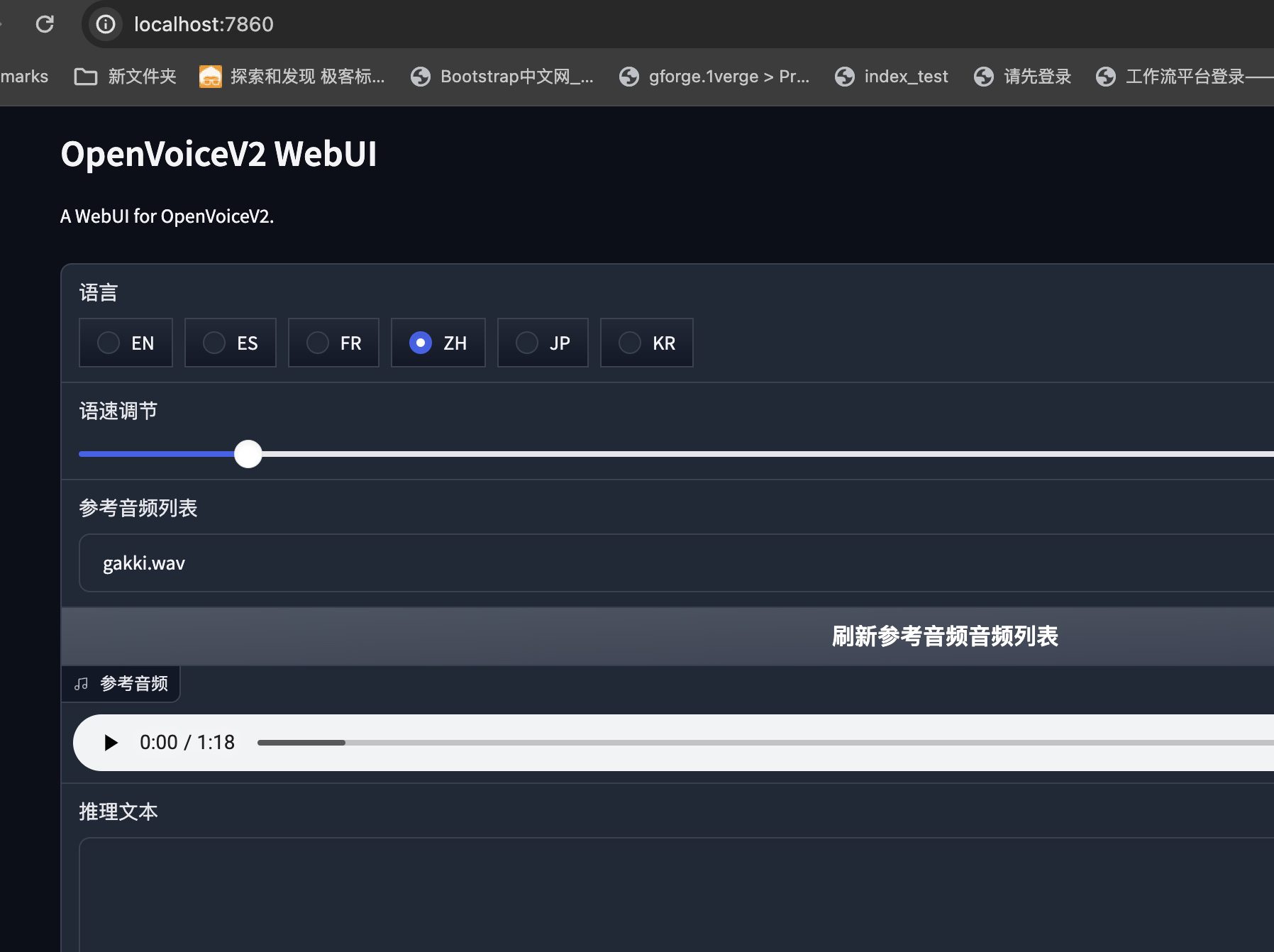

OpenVoiceV2ローカルデプロイメントチュートリアル、Apple MacOsデプロイメントプロセス

最近、OpenVoiceプロジェクトはV2バージョンを更新し、新しいモデルはより中国語の推論にやさしくなり、音色もある程度改善されました。今回は、V2バージョンのOpenVoiceをAppleのMacOsシステムにローカルにデプロイする方法を紹介します。

まずOpenVoiceV2のzipをダウンロードします:

OpenVoiceV2-for-mac代码和模型 https://pan.quark.cn/s/33dc06b46699

このバージョンはMacOs用に最適化され、中国語の声の大きさが変更されています。

解凍後、まず hub フォルダをプロジェクトディレクトリの HF_HOME からカレントシステムの以下のディレクトリにコピーします:

/Users/当前用户名/.cache/huggingface

これは、Macシステムにおけるhuggingfaceモデルのデフォルトの保存パスであり、これをコピーしないと、10G以上の事前学習モデルを一からダウンロードする必要があり、非常に面倒である。

それからプロジェクトのルート・ディレクトリーに戻り、コマンドを入力する:

conda create -n openvoice python=3.10

Pythonのバージョンは3.10であることに注意してください。

次に仮想環境をアクティブにする:

conda activate openvoice

システムは戻る:

(base) ➜ OpenVoiceV2 git:(main) ✗ conda activate openvoice

(openvoice) ➜ OpenVoiceV2 git:(main) ✗

アクティベーションが成功したことを示す。

最下層にはメカブが必要なので、インストールはブリューで行う:

brew install mecab

依存関係のインストールを開始します:

pip install -r requirements.txt

OpenVoiceは音素の抽出のみを担当するため、音声の変換にはttsのサポートも必要であり、ここではmelo-ttsモジュールに依存する。

メロのディレクトリに移動する:

(openvoice) ➜ OpenVoiceV2 git:(main) ✗ cd MeloTTS

(openvoice) ➜ MeloTTS git:(main) ✗

MeloTTSの依存関係をインストールします:

pip install -e .

成功したら、辞書ファイルを別途ダウンロードする必要があります:

python -m unidic download

その後、ルート・ディレクトリに戻ってプロジェクトを開始すればいい:

python app.py

システムは戻る:

(openvoice) ➜ OpenVoiceV2 git:(main) ✗ python app.py

Running on local URL: http://0.0.0.0:7860

IMPORTANT: You are using gradio version 3.48.0, however version 4.29.0 is available, please upgrade.

--------

To create a public link, set `share=True` in `launch()`.

これでMacOsでのOpenVoiceのデプロイは完了です。

結語

OpenVoiceの画期的な特徴の1つは、ゼロショットで言語横断的なボイスクローニングを実行できることです。これは、トレーニングデータセットに含まれていない言語に音声をクローンすることができ、それらの言語用の大量の話者トレーニングデータを提供する必要がありません。しかし、ゼロショット学習は、豊富なラベル付きデータを使用する従来の教師あり学習と比較して、未知のカテゴリ、特に複雑なカテゴリにおいて、一般的に精度が低いという事実があります。補助的な情報に頼ることは、ノイズや不正確さをもたらす可能性があるため、OpenVoiceは非常に特殊なトーンではうまく機能せず、そのような問題を解決するためには、基礎となるモダリティに合わせて微調整する必要があります。

© 著作権表示

記事の著作権 AIシェアリングサークル 無断転載はご遠慮ください。

関連記事

コメントはありません