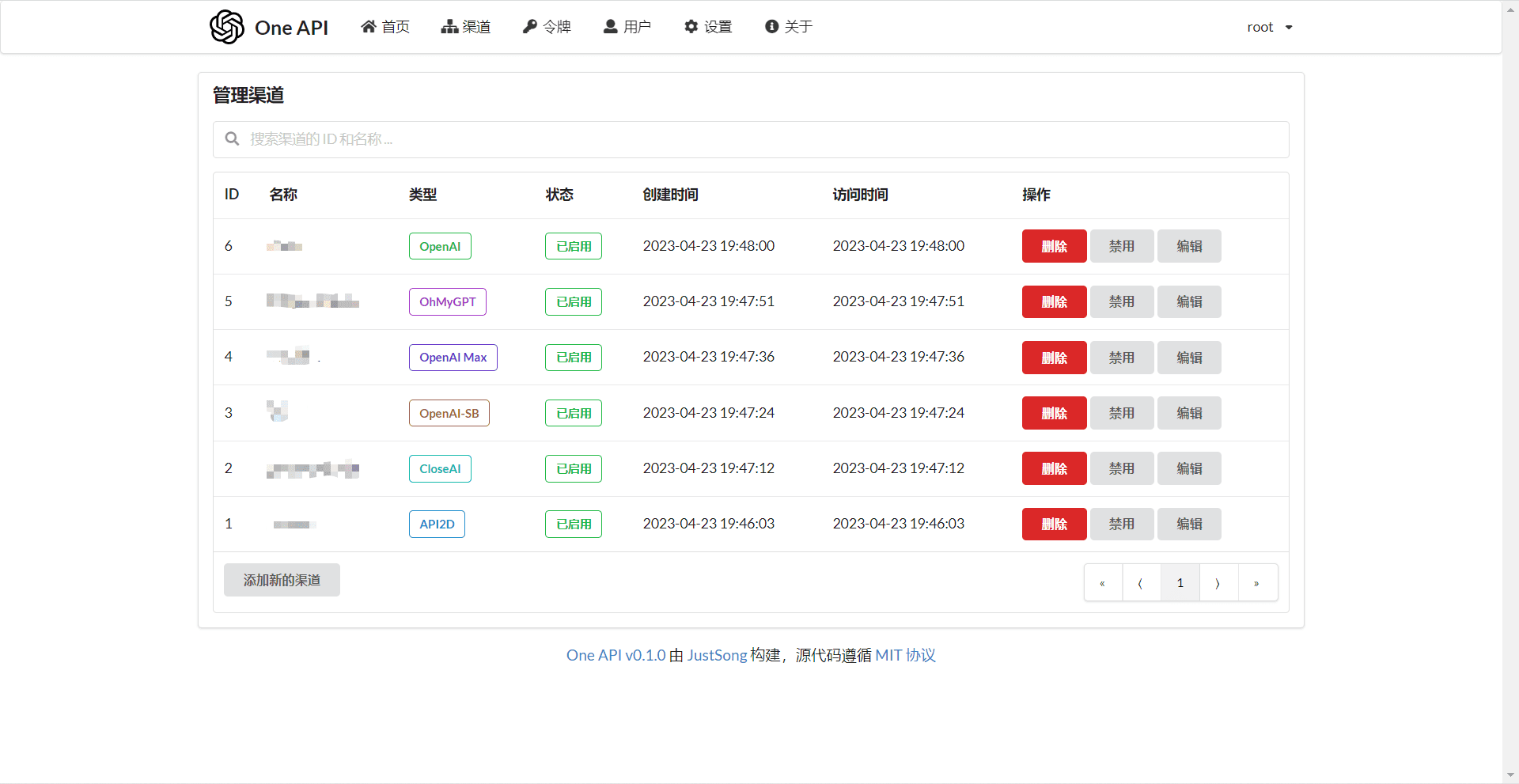

One API:マルチモデルのAPI管理と負荷分散、配信システム

はじめに

One API 是一个开源的接口管理与分发系统,支持多种大模型如 OpenAI ChatGPT、Anthropic Claude、Google PaLM 2 & ジェミニ など。システムは標準的なOpenAI APIフォーマットを通じてすべてのビッグモデルにアクセスし、ロードバランシング、トークン管理、償還コード管理、チャネル管理などの機能を提供する。ユーザーはOne APIをDocker経由ですぐにデプロイして利用することができます。

新しいAPI Midjourney をサポートする One API をベースにした二次開発バージョンです。

1つのapiブランチより多くのモデルのサポート、統計ページの追加、openai以外のモデルのための関数呼び出しの改善。

機能一覧

- 複数のビッグモデル(Azure、OpenAI ChatGPT、Anthropic Claude、Google PaLM 2 & Geminiなど)にアクセスし、管理するためのAPIインターフェース。

- 複数のアクセスチャンネルをサポートするロードバランシング機能

- 異なる言語モデル・インターフェースを統合する単一のAPI

- トークンの管理:トークンの有効期限、量、許可IP範囲、モデルのアクセス権を設定します。

- 引き換えコード管理:引き換えコードをバッチで生成し、アカウントにエクスポートします。

- チャンネル管理:チャンネルの一括作成、モデルリストの設定

- ユーザーグループとチャンネルグループの管理

- 限度額の詳細とユーザー招待特典を見る

- マッピングインターフェースとCloudflare AI Gatewayのサポート

- システム名、ロゴ、フッターのカスタマイズ

- 電子メール、Flybook、GitHub、WeChat公開番号など、複数のユーザーログイン登録方法をサポートします。

- ワンクリックでデプロイできるDockerイメージのサポート

ヘルプの使用

インストールと展開

One APIはDockerによる迅速なデプロイをサポートしています。以下のデプロイコマンドはSQLiteとMySQLを使用します:

SQLiteを使用した展開コマンド:

docker run --name one-api -d --restart always -p 3000:3000 -e TZ=Asia/Shanghai -v /home/ubuntu/data/one-api:/data justsong/one-api

MySQL deploy コマンドを使用する:

docker run --name one-api -d --restart always -p 3000:3000 -e SQL_DSN="root:123456@tcp(localhost:3306)/oneapi" -e TZ=Asia/Shanghai -v /home/ubuntu/data/one-api:/data justsong/one-api

必要に応じてデータベース接続パラメータを変更してください。

機能操作ガイド

- トークン管理管理インターフェイスでは、トークンの有効期限、使用量、許可IP範囲、モデルのアクセス権を設定できます。

- 償還コード管理ユーザーが口座に入金するために使用できる引き換えコードのバッチ生成とエクスポートをサポートします。

- チャネル管理ユーザーはチャンネルを一括で作成し、異なるチャンネルのモデルリストを設定することができます。

- ユーザー・グループ化とチャンネル・グループ化サブグループごとに異なる倍率を設定でき、管理が容易。

- 限度額の内訳を見るクレジットの詳細な使用状況を確認することができます。

- ユーザー招待特典新しいユーザーを招待することで、リワードクレジットを獲得できます。

- カスタマイズされた設定システム名、ロゴ、フッターはもちろん、ホームページやアバウトページもカスタマイズできます。

使用例

ユーザーは以下のサンプルコードでOne APIを呼び出すことができます:

import requests

url = "http://localhost:3000/v1/completions"

headers = {

"Authorization": "Bearer YOUR_API_KEY",

"Content-Type": "application/json"

}

data = {

"model": "gpt-3.5-turbo",

"prompt": "Hello, world!",

"max_tokens": 50

}

response = requests.post(url, headers=headers, json=data)

print(response.json())

© 著作権表示

記事の著作権 AIシェアリングサークル 無断転載はご遠慮ください。

関連記事

コメントはありません