OmniShow - 字节联合港大等推出的端到端多模态视频生成框架

OmniShow是什么

OmniShow是字节跳动推出的端到端多模态视频生成框架,能同时整合文本、参考图像、音频、姿态四种条件生成高质量人机交互视频。模型基于120亿参数的Waver 1.0架构,支持最长10秒连续长镜头生成,在电商展示、短视频制作、交互娱乐等场景具有重要应用价值。OmniShow创新性地提出统一通道条件注入机制和门控局部上下文注意力模块,解决了多模态控制与生成质量之间的权衡难题,建立了首个HOIVG领域综合评估基准HOIVG-Bench,在R2V、RA2V、RP2V及RAP2V四种任务设置下均达到SOTA性能。

OmniShow的功能特色

- 四种任务模式::

- R2V(参考图生成视频):单图驱动角色动作

- RA2V(参考图+音频生成视频):对口型演讲/演唱

- RP2V(参考图+姿态生成视频):姿态可控表演

- RAP2V(全模态生成):文本+图像+音频+姿态联合控制

- 物理合理性优化:针对手部接触、抓握动作进行专门优化,显著减少网格穿透现象,物体交互更符合真实物理规律。

- 姿态跟随能力:支持复杂空间交互和大幅度姿态变化,能准确生成手部接触和物体外观保持。

- 风格化支持:不仅限于真实影像,支持卡通、3D渲染等风格化角色动画生成。

OmniShow的核心优势

- 多模态统一生成:单个模型同时支持文本、参考图、音频、姿态四种条件的灵活组合,无需切换不同模型即可完成R2V/RA2V/RP2V/RAP2V全任务覆盖。

- 高效条件注入:采用Unified Channel-wise Conditioning机制,通过通道拼接策略高效注入图像和姿态信息,避免破坏基础模型预训练先验,实现可控性与生成质量的最佳平衡。

- 精准音画同步:Gated Local-Context Attention模块通过音频上下文打包和掩码注意力机制,确保视频帧与对应音频片段精准对齐,支持高保真对口型表演。

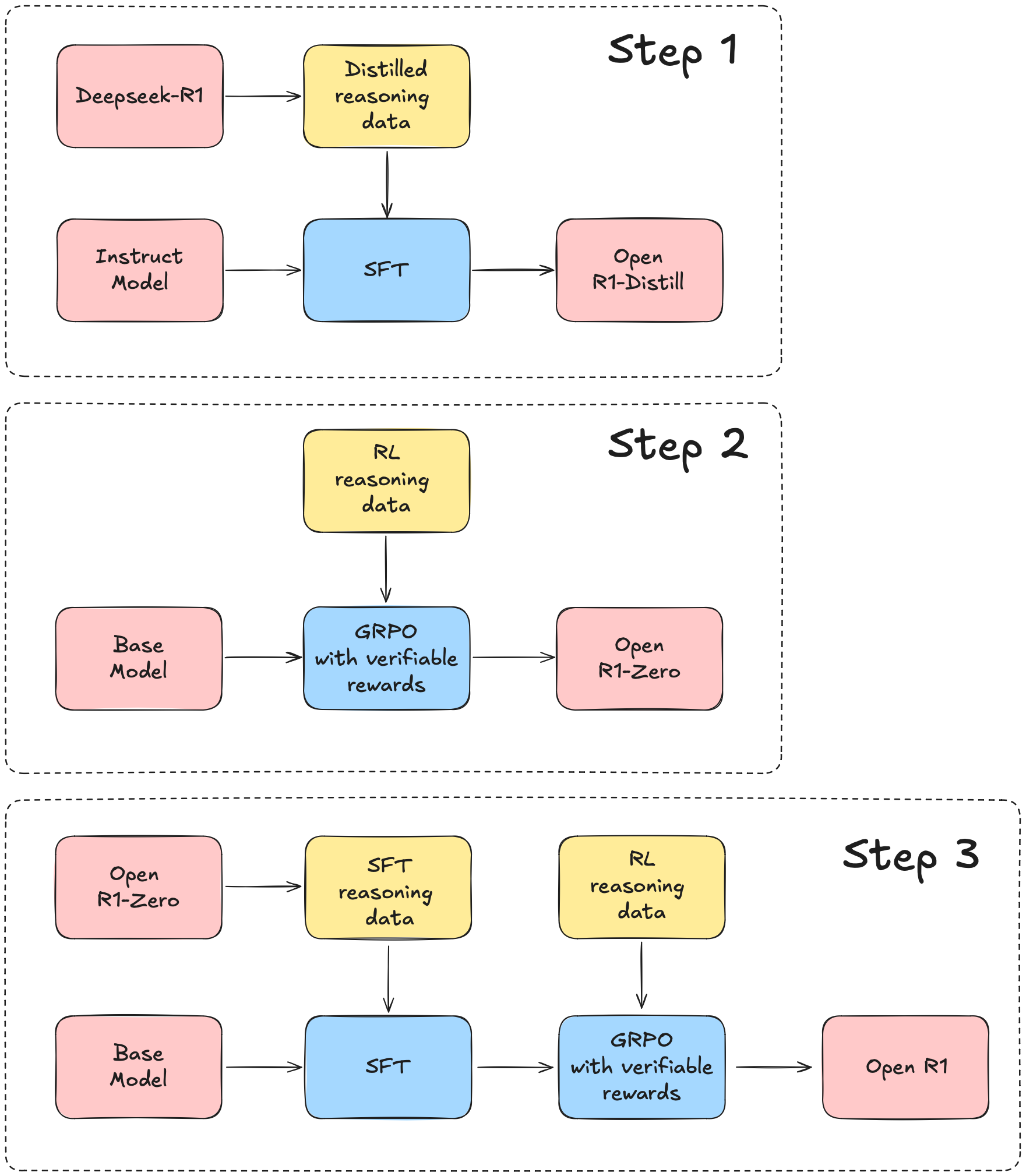

- 解耦联合训练:Decoupled-Then-Joint Training策略先分别训练R2V和A2V专用模型,再通过权重插值融合,有效解决高质量HOI数据稀缺问题。

- 原生长镜头生成:支持最长10秒连续视频生成,动作弧线完整连贯,避免剪辑拼接带来的不连续性,适合产品演示和叙事场景。

- アイデンティティの一貫性維持:强参考图像约束机制确保人物面部特征、服装、道具外观在全片段中高度一致,物体交互物理合理性强。

OmniShow官网是什么

- プロジェクトのウェブサイト:https://correr-zhou.github.io/OmniShow/

- GitHubリポジトリ:https://github.com/Correr-Zhou/OmniShow

使用OmniShow的操作步骤

- 准备输入条件:上传角色参考图像、音频片段或姿态序列(支持任意组合),并撰写描述人机交互的文本提示词。

- コンフィギュレーション生成パラメータ:选择任务模式(R2V/RA2V/RP2V/RAP2V),系统基于Waver 1.0架构自动处理多模态条件融合。

- ビデオの作成:模型通过Flow Matching监督机制生成最长10秒连续视频,支持480p/720p分辨率。

- 反復最適化:预览生成结果,调整提示词或参考条件,重新生成直至交互动作、时间节奏和视觉效果符合预期。

OmniShow的适用人群

- 电商内容创作者:需要生成产品演示视频、虚拟主播带货片段。

- 短视频制作者:需要快速生成角色互动、对口型演唱等创意内容。

- 游戏/动画开发者:需要批量生成风格化角色表演动画。

- 広告・マーケティングチーム:需要制作高可控性的品牌代言人视频。

- AI研究者:从事多模态视频生成、人机交互领域的学术研究。

OmniShow的常见问题

Q: OmniShow目前是否开放使用?

A: 截至2026年4月,代码仍处于内部审核阶段,GitHub仓库已建立但代码尚未公开,技术报告已发布。

A: 截至2026年4月,代码仍处于内部审核阶段,GitHub仓库已建立但代码尚未公开,技术报告已发布。

Q: 与其他视频生成模型相比的核心差异是什么?

A: OmniShow是唯一同时支持四种模态(文本+参考图+音频+姿态)统一控制的端到端模型,而非常规模型的级联组合方案,在RAP2V任务上显著优于VACE+LatentSync级联基线。

A: OmniShow是唯一同时支持四种模态(文本+参考图+音频+姿态)统一控制的端到端模型,而非常规模型的级联组合方案,在RAP2V任务上显著优于VACE+LatentSync级联基线。

Q: 支持的最大视频时长是多少?

A: 原生支持最长10秒连续长镜头生成,帧率24fps,最多241帧

A: 原生支持最长10秒连续长镜头生成,帧率24fps,最多241帧

Q: 对硬件有何要求?

A: 训练阶段使用8卡并行计算,推理支持Ulysses序列并行(并行度8),总参数量12.3B(基础12B+音频模块0.3B)

A: 训练阶段使用8卡并行计算,推理支持Ulysses序列并行(并行度8),总参数量12.3B(基础12B+音频模块0.3B)

Q: 是否支持商业用途?

A: 目前为学术研究项目,展示视频均标注"仅供研究目的",具体商用授权条款待代码正式发布后明确

A: 目前为学术研究项目,展示视频均标注"仅供研究目的",具体商用授权条款待代码正式发布后明确

© 著作権表示

記事の著作権 AIシェアリングサークル 無断転載はご遠慮ください。

関連記事

コメントはありません