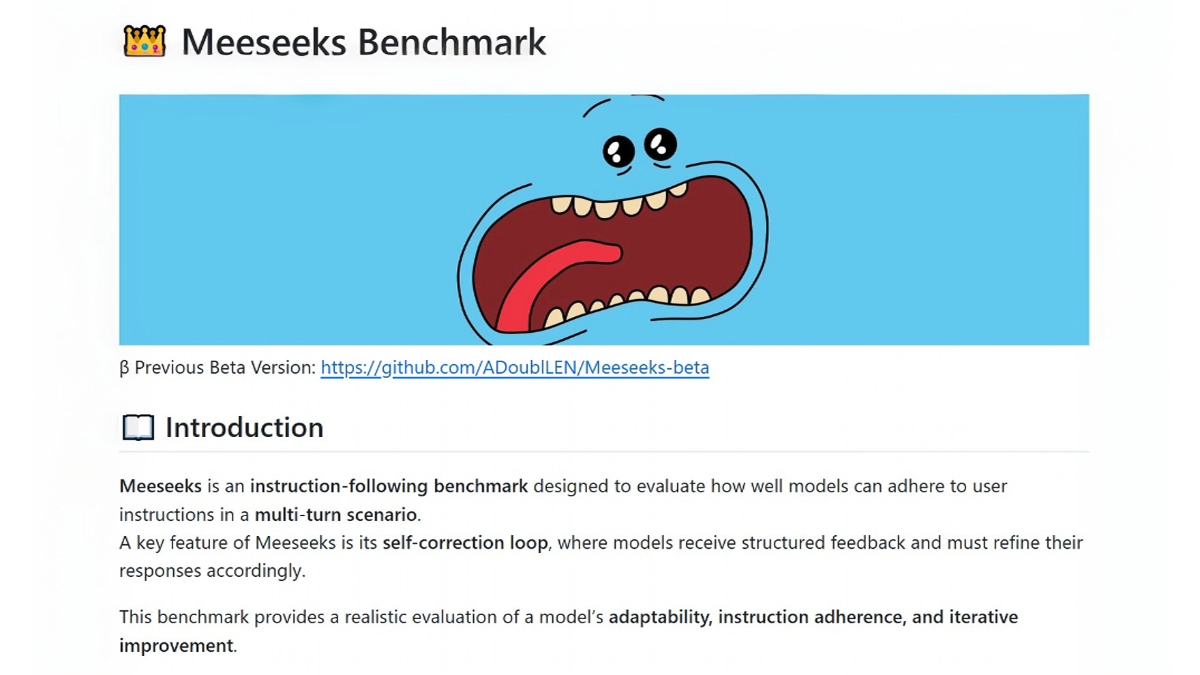

Meeseeks - 模範的な指示に従う能力を評価するためのMeeseeksオープンソース評価セット

ミーシークスとは?

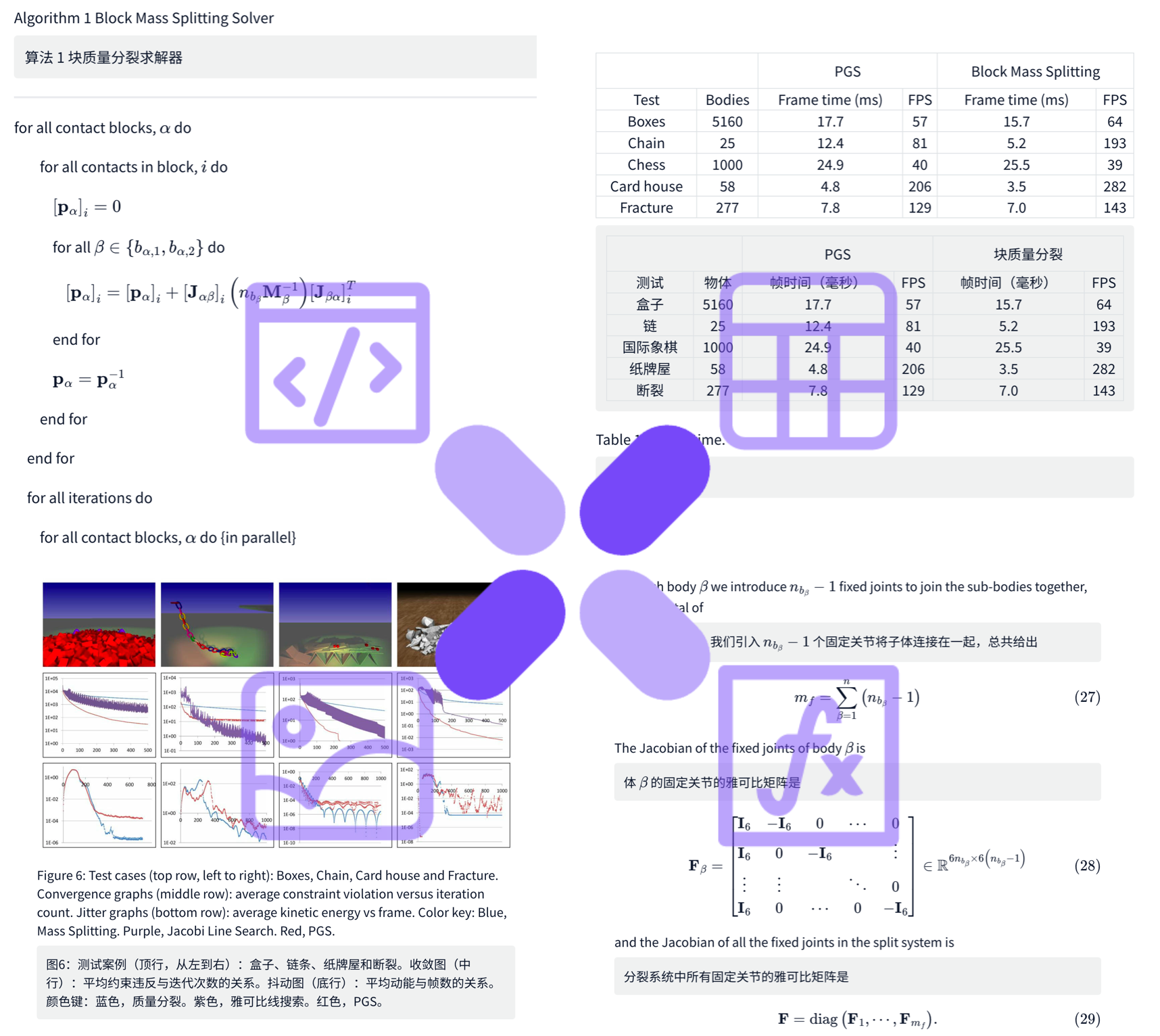

Meeseeksは、Meituan M17チームがモデルの指示に従う能力を評価するために使用しているオープンソースの大規模モデル評価セットです。Meeseeksは3段階の評価フレームワークを使用し、モデルがユーザーの指示に厳密に従うことができるかどうかを測定し、回答の知識の正しさを評価することなく、マクロレベルからミクロレベルまでの回答を生成します。Meeseeksは、モデルがフィードバックを受けた後に修正を行うことができる多ラウンド修正モードを導入し、モデルの自己修正能力を評価します。Meeseeksのデータ設計はより挑戦的で、異なるモデル間のギャップを効果的に広げることができ、モデル開発者に最適化の方向性を提供します。

ミーシークスの特徴

- 指令遵守能力評価Meeseeksは、3段階の評価フレームワークを使用して、マクロなタスクの意図からミクロな詳細ルールまで、ユーザーの指示に従うモデルの能力を総合的に測定し、モデルが生成する回答が厳密に指示に沿ったものであることを確認します。

- マルチラウンド・エラー訂正モードMeeseeksは、モデルが指示を完全に満たしていない場合、自動的にフィードバックを生成し、問題を指摘してモデルの修正を要求し、自己修正能力を評価する。

- 客観的な評価基準すべての評価項目は、結果の一貫性と正確性を保証するために、客観的に判断できる基準となっています。

- 難しいデータ設計テストケースはより挑戦的で、異なるモデル間のギャップを効果的に埋め、開発者に最適化の方向性を与えることができる。

ミーシークスの核となる強み

- 革新的なマルチラウンド・フィードバックメカニズムMeeseeks独自の多ラウンドエラー修正モードは、モデルの初期性能を評価し、複数回のフィードバック後の自己修正能力を検証し、モデルの動的最適化の基礎を提供する。

- 客観的でスケーラブルなルーブリック評価基準は客観的で明確であり、拡張やカスタマイズが容易で、さまざまなシナリオやニーズの評価要件を満たすことができる。

- 実ビジネスデータ主導実際のビジネスデータに基づいて構築されているため、評価結果が実際のアプリケーションに大きく関連し、実際のシナリオにおけるモデルのパフォーマンスについて信頼性の高い基準を提供します。

- 高い難易度と差別化複雑で困難なデータ設計を評価することで、指示に従う能力という点で、異なるモデルを効果的に区別することができ、モデルの選択と最適化を強力にサポートします。

ミーゼクスの公式サイトは?

- GitHubリポジトリ:: https://github.com/ADoublLEN/Meeseeks

- HuggingFaceモデルライブラリ:: https://huggingface.co/datasets/meituan/Meeseeks

ミーシークスの対象者

- 人工知能研究者標準化された評価ベンチマークを提供することで、研究者がさまざまなマクロモデルのコマンド順守能力を評価・比較し、モデル開発と最適化の参考とする。

- モデル開発者多ラウンドエラー修正モデルときめ細かい評価フレームワークにより、開発者はモデルの欠陥を特定し、モデルのパフォーマンスを向上させるために的を絞った最適化を行うことができます。

- コーポレート・テクニカル・チーム大規模なモデルを使用してコンテンツを生成したりサービスを提供したりする企業チームは、モデルがビジネス要件を満たしているかどうかを評価し、展開に適したモデルを選択します。

- 教育者教育分野において、教育者がモデルによって作成されたコンテンツが教育的要件を満たしているかどうかを評価し、教育技術の応用をサポートする。

- コンテンツクリエーターコピー、レビュー、ストーリーなど、質の高いコンテンツを生成するコンテンツ制作者が、大規模なモデルの助けを借りて、モデルの生成能力を評価し、コンテンツ制作の効率と質を向上させる。

© 著作権表示

記事の著作権 AIシェアリングサークル 無断転載はご遠慮ください。

関連記事

コメントはありません