ハイブリッドVincennesビデオ:高品質のビデオのリアルな映像を生成し、テンセントは、大規模なモデルのオープンソースのビデオ生成

はじめに

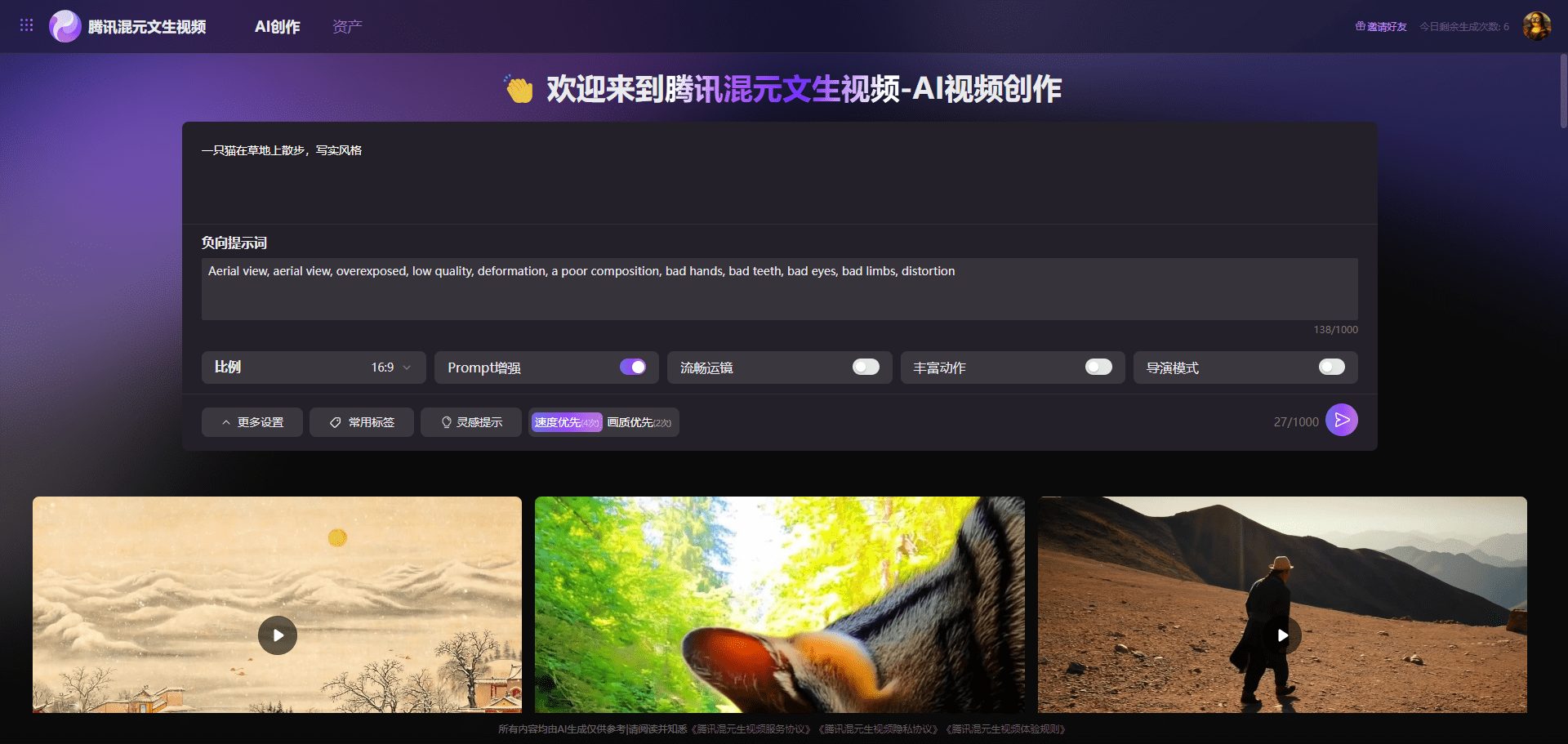

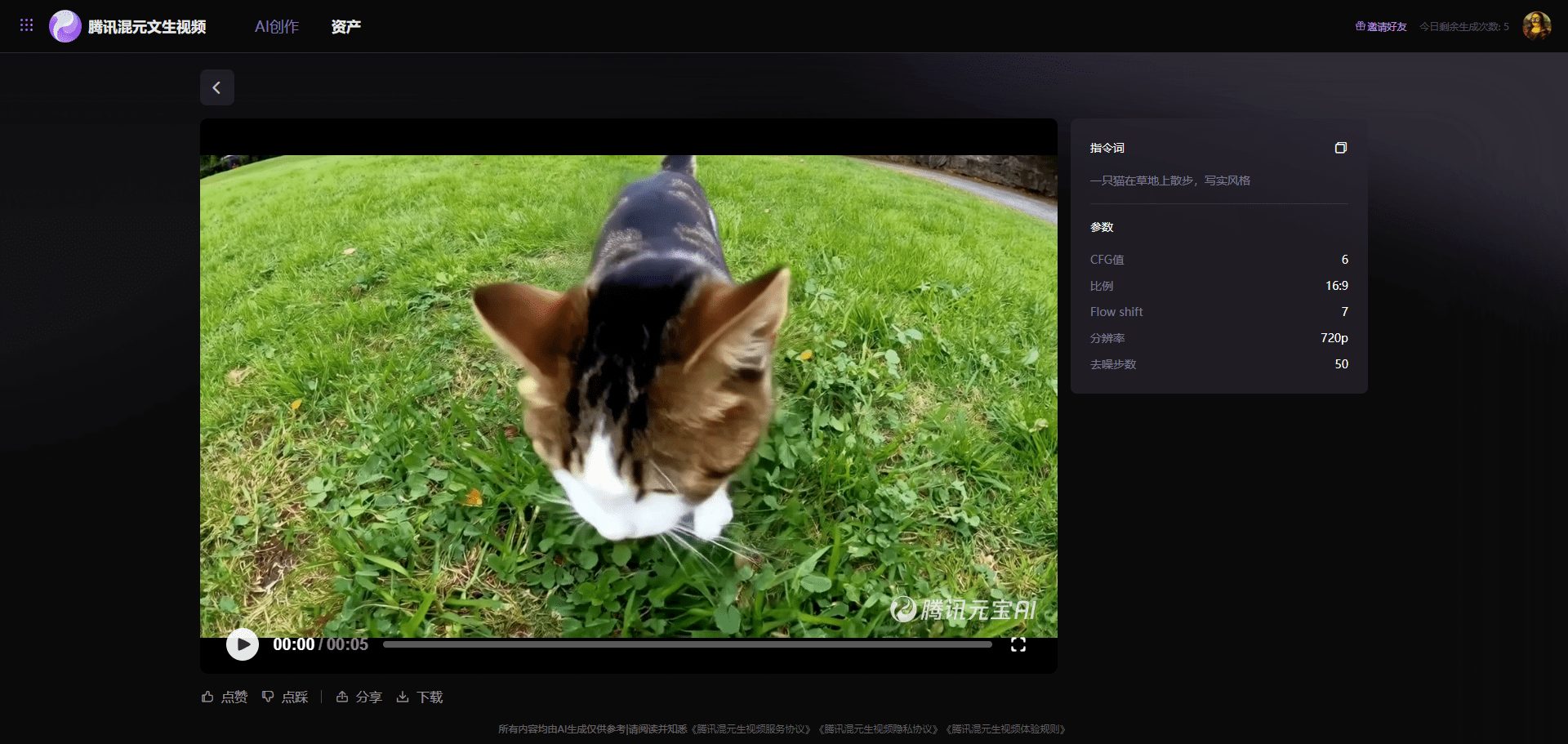

テンセント・ハイブリッド・テキスト・ジェネレーション・ビデオ(Yuanbao APPで利用可能)は、テンセントが発表したAI技術に基づくビデオ生成プラットフォームである。このプラットフォームは、強力なクロスドメイン知識と自然言語理解を備えたテンセント混元ビッグモデルを活用し、ユーザーのテキスト記述に基づいて高品質のビデオコンテンツを生成する。リアルなスタイルでもバーチャルなスタイルでも、騰訊混合元がテキストで生成した動画は簡単に実現でき、ユーザーの創造性を生き生きとした動画作品に変えることができる。このプラットフォームは、個人的な創作から商業的な用途まで、さまざまな創作表現のニーズに適しており、便利で効率的な動画生成ソリューションを提供する。

HunyuanVideoはTencentによるオープンソースの動画生成フレームワークで、高品質の動画生成機能を提供することを目的としている。このプロジェクトはPyTorchをベースにしており、事前に学習されたモデル、推論コード、サンプル動画が含まれている。HunyuanVideoは、データのキュレーション、画像と動画の共同モデル学習、大規模なモデル学習と推論をサポートする効率的なインフラストラクチャなど、多くの重要な技術を採用している。HunyuanVideoは、映像品質、動きの多様性、テキストと映像のアライメント、生成の安定性などの点で、多くの主要なクローズドソースモデルを凌駕しています。

ハイブリッドビデオ生成モデルの高速化バージョン:ファストフンユアン高品質の動画を生成するのに必要な拡散ステップはわずか6ステップで、オリジナルバージョンの50ステップに比べ8倍も速い。

機能一覧

- テキスト生成ビデオユーザーがテキストの説明を入力すると、プラットフォームが自動的に対応するビデオコンテンツを生成します。

- マルチスタイル対応さまざまなクリエイティブなニーズに応えるため、リアルとバーチャルの両方のスタイルでビデオ生成をサポート。

- 高品質出力高い物理的精度とシーンの一貫性で映像を生成し、映画品質の映像体験を提供します。

- 継続的なアクションの生成連続的なアクションシーンを生成できるため、スムーズで自然な映像が得られます。

- 芸術的レンズ: 芸術的な映像表現を提供するために、監督レベルの映像の使用をサポートする。

- 物理的コンプライアンス生成された映像は物理法則に合致し、見る者の不協和音を軽減する。

ヘルプの使用

機能操作ガイド

テキスト生成ビデオ

- 入力テキストの説明テキストボックスに生成したいビデオの説明を入力します。空は暗く、地面には雪が積もっている。

- スタイルを選ぶリアルな映像かバーチャルな映像か、お好きなスタイルをお選びください。

- ビデオの作成生成」ボタンをクリックすると、対応するビデオコンテンツが自動的に生成されます。

- プレビュー&ダウンロード生成後、ビデオ効果をプレビューし、満足したらダウンロードして保存することができます。

マルチスタイル対応

- スタイル切り替えビデオを作成する際、リアルとバーチャルのスタイルを自由に切り替えることができ、さまざまなクリエイティブなニーズに対応できます。

- スタイル・プリセットこのプラットフォームは、ユーザーが必要に応じてビデオ生成に適したスタイルを選択できるように、さまざまなスタイルのプリセットを提供している。

高品質出力

- シネマ・クオリティの体験高い物理的精度とシーンの一貫性で映像を生成し、映画品質の映像体験を提供します。

- 詳細な調整すべてのフレームが期待に沿うように、ユーザーは生成されたビデオに詳細な調整を加えることができます。

継続的なアクションの生成

- 入力連続動作の説明例えば、「トレッドミルの上を走る人」など。

- 連続アクションビデオの作成スムーズで自然な動きを実現するために、連続的な動きのビデオを自動的に生成します。

芸術的レンズ

- レンズ選択プラットフォームは幅広いレンズオプションをサポートしており、ユーザーは生成に適したビデオレンズを選択することができます。

- 芸術的表現出来上がったビデオには、アーティスティックな映像が使われ、より表現力豊かな視覚効果がもたらされる。

物理的コンプライアンス

- フィジカルルール生成された映像は物理法則に合致し、見る者の不協和音を軽減する。

- シナリオの一貫性映像のすべてのシーンに一貫性と一貫性を持たせること。

一般的な問題

- ビデオ生成の失敗入力されたテキストが要件を満たしているかどうかを確認するか、再生成を試みてください。

- ログインの問題ログインできない場合は、携帯電話番号と認証コードが正しいことを確認するか、カスタマーサービスにお問い合わせください。

インストールと展開プロセス

- 環境依存Python 3.8以上がインストールされ、必要な依存ライブラリーがインストールされていることを確認してください。

pip install -r requirements.txt - 訓練済みモデルのダウンロード学習済みモデルをプロジェクトページからダウンロードし、指定のディレクトリに配置します。

- 推論コードを実行する次のコマンドを使って推論コードを実行し、ビデオを生成します。

python sample_video.py --input_text "生成视频的描述文本"

機能 操作の流れ

テキストからビデオへ

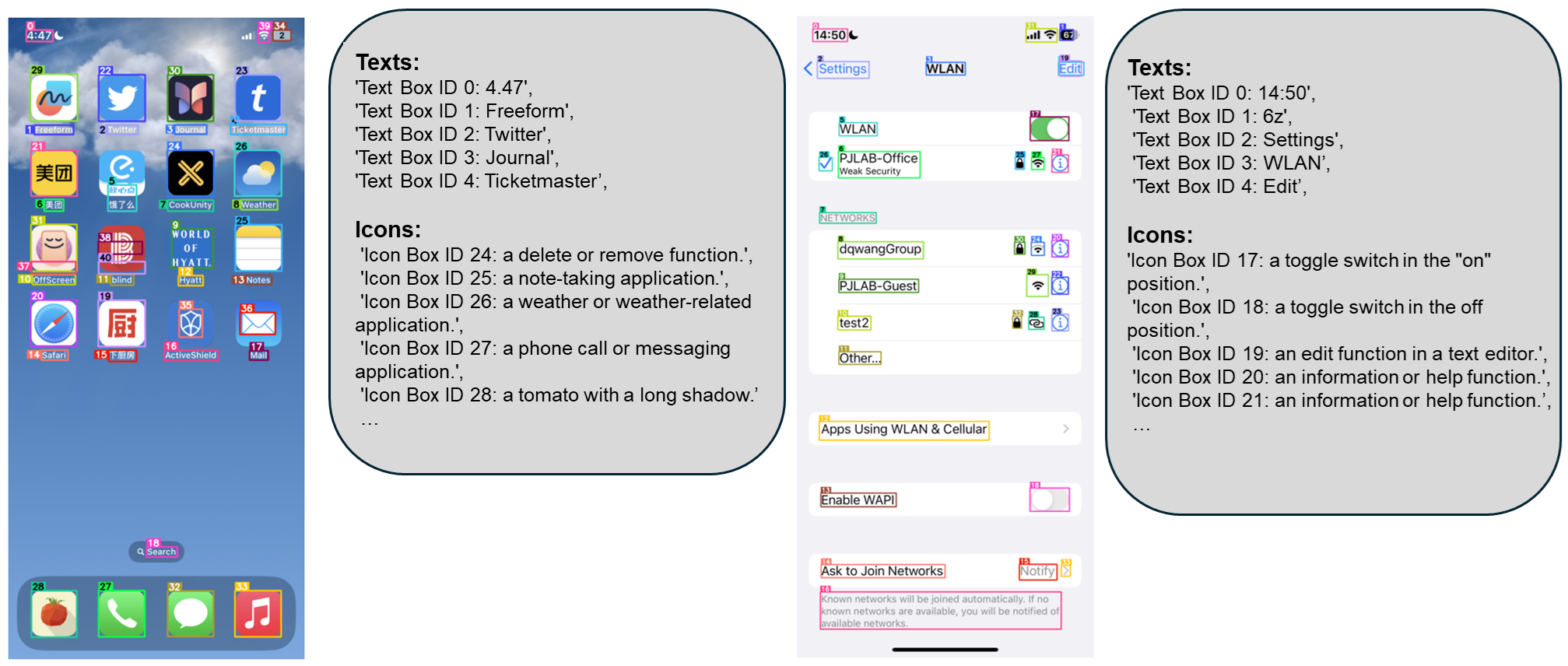

- 入力テキストの説明コマンドラインまたは Gradio Web Demo で説明テキストを入力します。

- 推論コードを実行する推論コードを実行し、対応するビデオファイルを生成する。

- 生成された結果を見る出力ディレクトリに生成されたビデオファイルを表示します。

画像からビデオへの変換

- 入力画像ファイル入力画像ファイルのパスを指定します。

- 推論コードを実行する推論コードを実行し、ダイナミックビデオを生成する。

- 生成された結果を見る出力ディレクトリに生成されたビデオファイルを表示します。

マルチGPU並列推論

- マルチGPU環境の設定複数のGPUがシステムにインストールされ、CUDA環境が設定されていることを確認してください。

- 並列推論コードの実行マルチGPU並列推論コードを以下のコマンドで実行する。

python sample_video.py --input_text "生成视频的描述文本" --gpus 4

グラディオ・ウェブ・デモ

- Gradioサーバーの起動以下のコマンドを実行して、Gradio Web Demo サーバを起動します。

python gradio_server.py - ウェブ・デモへのアクセス提供されたURLをブラウザで開き、テキストを動画に変換する機能を体験してください。

事前学習モデルのダウンロード

- プロジェクトのページを見るHunyuanVideoのGitHubプロジェクトページへ。

- 訓練済みモデルのダウンロード学習済みモデルファイルのダウンロードリンクをクリックします。

- モデルファイルの配置ダウンロードしたモデルファイルをプロジェクトの指定ディレクトリに配置します。

以上の詳細なヘルプにより、ユーザーは簡単にHunyuanVideoを使い始め、高品質のビデオ生成機能を体験することができる。

ハイブリッド・ビデオ・ワンクリック・インテグレーション・パック

クォーク:https://pan.quark.cn/s/ae28d498f451

百度:https://pan.baidu.com/s/1PgJKZiey98rKWZzPFzT6-w?pwd=pwk8

© 著作権表示

記事の著作権 AIシェアリングサークル 無断転載はご遠慮ください。

関連記事

コメントはありません