大型モデルで理解できる動画の長さは?スマートスペクトラムGLM-4V-Plus:2時間

前2世代のビデオモデル(CogVLM2-VideoとGLM-4V-PLUS)に基づき、我々はGLM-4V-Plus-0111ベータ版のリリースでビデオ理解技術をさらに最適化しました。このバージョンでは、ネイティブの可変解像度のような技術を導入し、異なるビデオの長さと解像度に適応するモデルの能力を向上させています。

- 短い映像をより詳細に把握:映像の長さが短いコンテンツの場合、このモデルはネイティブの高解像度映像をサポートし、詳細な情報を正確に捉えることができます。

- 長時間の動画もより深く理解:2時間にも及ぶ長時間の動画に対しても、モデルは自動的に小さな解像度に調整することができ、時間情報と空間情報のキャプチャのバランスを効果的にとることで、長時間の動画をより深く理解することができる。

今回のアップデートにより、GLM-4V-Plus-0111ベータバージョンは、時間的Q&Aという前2世代のモデルの利点を引き継ぐだけでなく、ビデオの長さと解像度適応性の大幅な改善を達成しました。

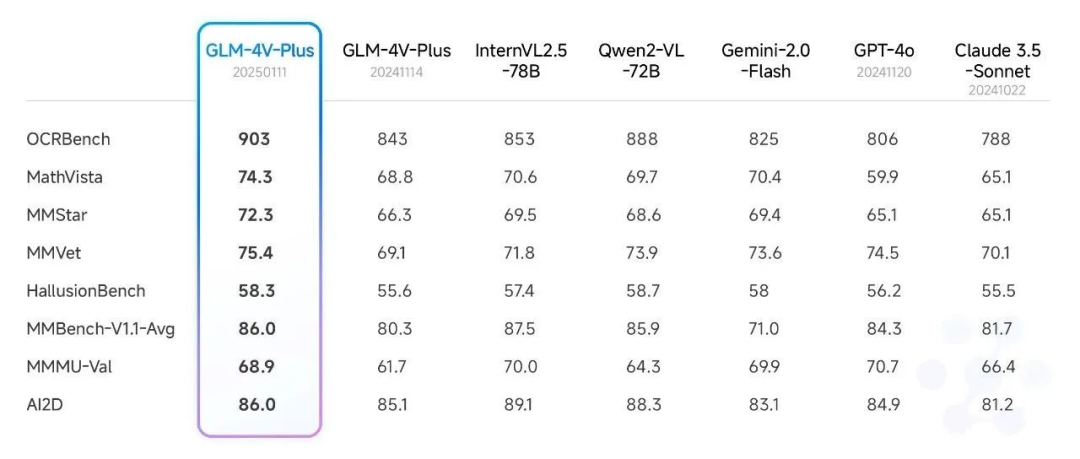

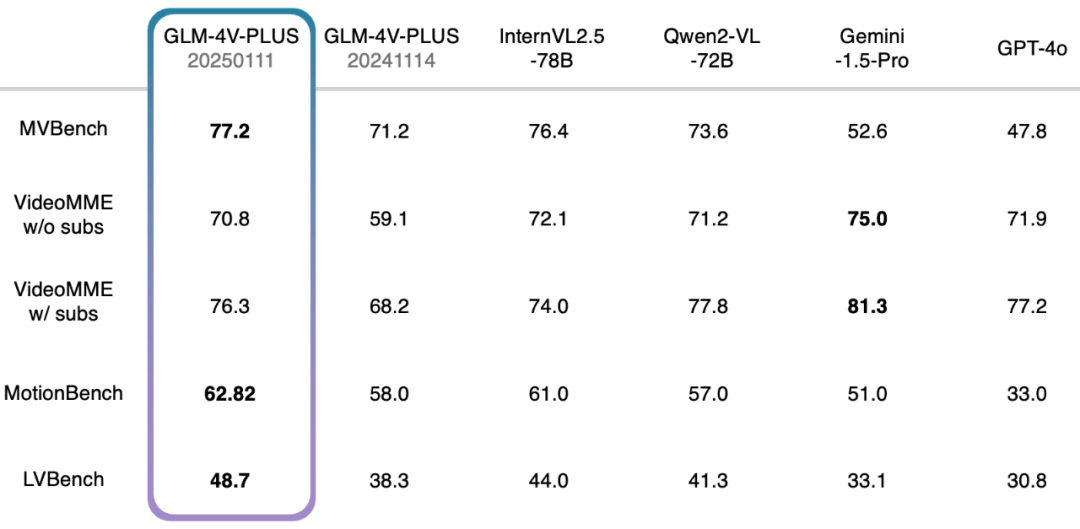

性能比較

先日リリースされたSmart Spectrum Realtime, 4V, Airの新モデルリリースと新しいAPIの記事では、画像理解領域におけるGLM-4V-Plus-0111(ベータ版)モデルのレビュー結果について詳述しました。このモデルは、いくつかの公開レビューリストでsotaレベルに達しました。

さらに、権威ある動画理解レビューセットに対する総合テストも実施し、こちらも比較的高いレベルを達成しました。特に、GLM-4V-Plus-0111ベータモデルは、動画中のきめ細かな行動理解や長時間の動画理解において、同程度の動画理解モデルを大きく上回る結果を得た。

- MVBench:このレビューセットは、映像理解におけるマルチモーダル・マクロモデルの複合能力を総合的に評価するために設計された、20の複雑な映像タスクで構成されている。

- VideoMME w/o subs: マルチモーダル評価ベンチマークとして、VideoMMEは大規模言語モデルのビデオ解析能力を評価するために使用される。この場合、w/o subsバージョンは字幕のないマルチモーダル入力を表し、ビデオ自体の解析に焦点を当てています。

- VideoMME w/ subs: 字幕なしバージョンと似ているが、マルチモーダルデータを扱う際のモデルの総合的なパフォーマンスをより包括的に評価するため、マルチモーダル入力として字幕を追加した。

- MotionBench:きめ細かな動き理解に焦点を当てたMotionBenchは、動き解析のためのビデオ理解モデルの能力を評価するための、多様なビデオデータと高品質な人間のアノテーションを含む包括的なベンチマークデータセットです。

- LVBench:長時間の動画を理解するモデルの能力を評価することを目的とし、長時間の動画タスクを扱う際のマルチモーダルモデルの性能に挑戦し、長時間の時系列分析におけるモデルの安定性と精度を検証する。

シナリオ・アプリケーション

この一年で、映像理解モデルの応用領域は拡大し、ニューメディア、広告、セキュリティレビュー、工業生産などの業界向けに、映像説明文生成、イベントセグメンテーション、分類、ラベリング、イベント分析などの多様な機能を提供してきました。今回発表したGLM-4V-Plus-0111ベータ版映像理解モデルは、これらの基本機能を継承・強化し、映像データの処理・解析能力をさらに強化しました。

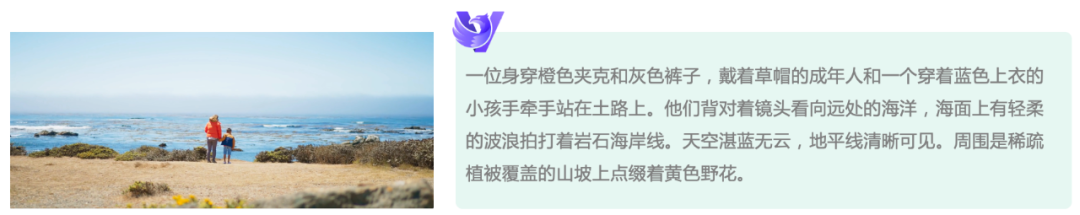

より正確な映像説明機能:ネイティブ解像度入力と継続的なデータフライホイールファントム最適化により、映像説明生成におけるファントム率を大幅に低減し、映像コンテンツのより包括的な説明を実現することで、より正確で豊富な映像情報をユーザーに提供します。

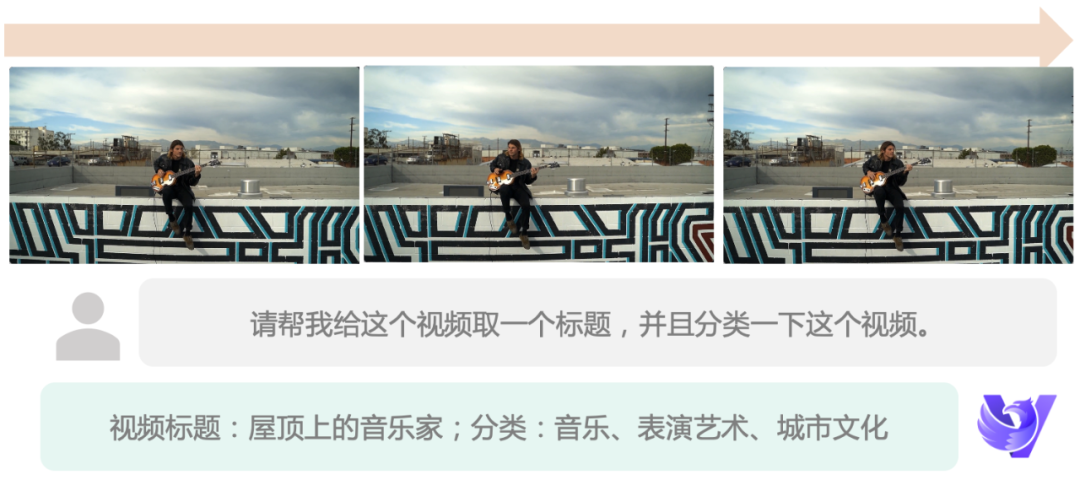

効率的な映像データ処理:新モデルは、詳細な映像説明を提供する機能だけでなく、映像の分類、タイトル生成、ラベリング作業を効率的に行うことができます。ユーザーは、プロンプトをカスタマイズすることで処理効率をさらに向上させたり、インテリジェントな管理のために自動化されたビデオデータプロセスを構築することができます。

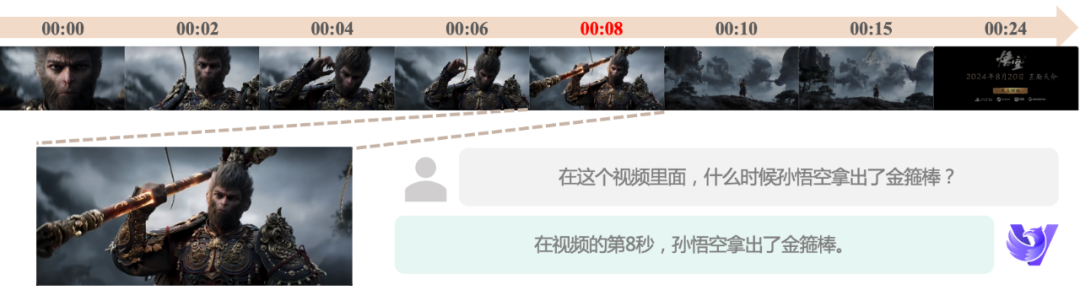

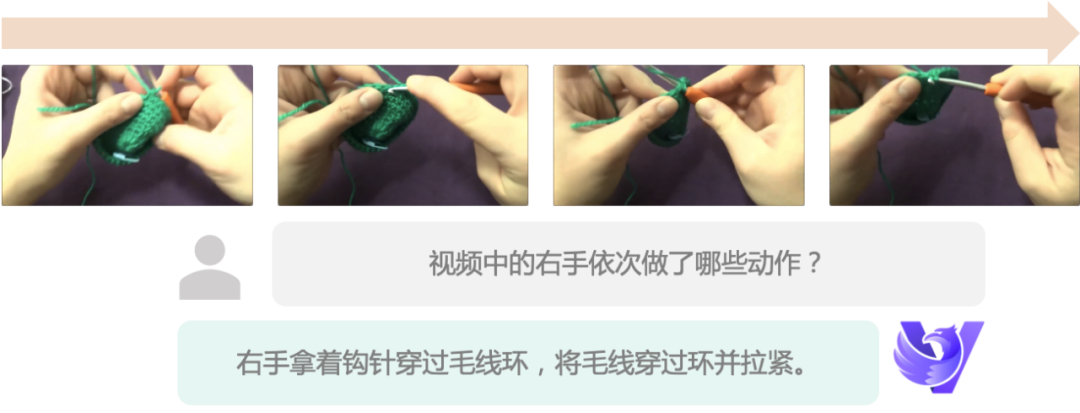

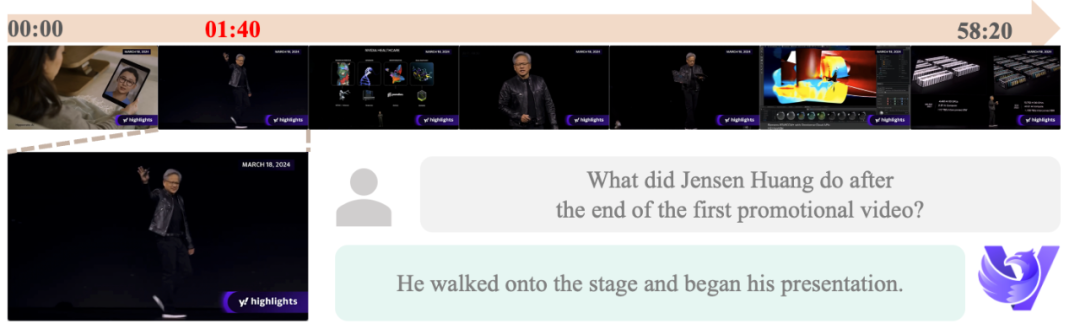

正確な時間認識:ビデオデータの時間次元的性質に対応するため、私たちのモデルは第一世代から時間質問能力の向上に専念してきました。現在、新しいモデルは、特定のイベントの時点をより正確に特定し、ビデオのセマンティック・セグメンテーションと自動編集を可能にし、ビデオの編集と分析を強力にサポートします。

高フレームレート入力に対応し、映像のフレームレートが低い場合でも、小さな動きの変化を捉え、より細かな動きの把握が可能。

超長時間映像理解:革新的な可変解像度技術により、映像処理時間の制限を突破し、最大2時間の映像理解をサポートすることで、映像理解モデルのビジネス応用シーンを大幅に拡大:

リアルタイムビデオ通話機能:強力なビデオ理解モデルをベースに、さらにリアルタイムビデオ通話モデルGLM-Realtimeを開発しました。このモデルは現在オンラインに公開されています。スマートスペクトラムAIオープンプラットフォームGLM-Realtimeは、ビデオ通話インテリジェンスの構築を支援するだけでなく、既存のネットワーク接続可能なハードウェアと組み合わせることで、スマートホーム、AI玩具、AIメガネなどの革新的な製品を簡単に作ることができる。

現在、一般ユーザーもSmart Spectrum Clear SpeechアプリでAIによるビデオ通話を体験することができる。

© 著作権表示

記事の著作権 AIシェアリングサークル 無断転載はご遠慮ください。

関連記事

コメントはありません