Coqui TTS (xTTS) : une boîte à outils d'apprentissage profond pour la génération de texte à partir de la parole avec un support multilingue et des capacités de clonage de la voix

Introduction générale

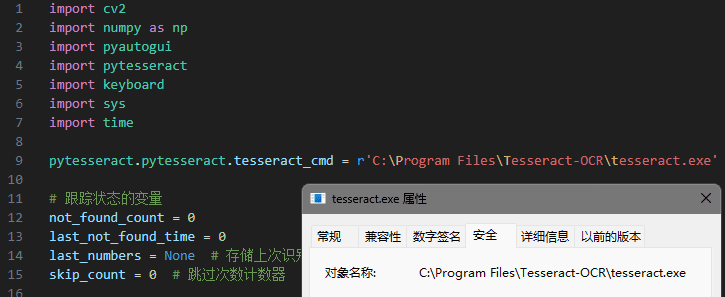

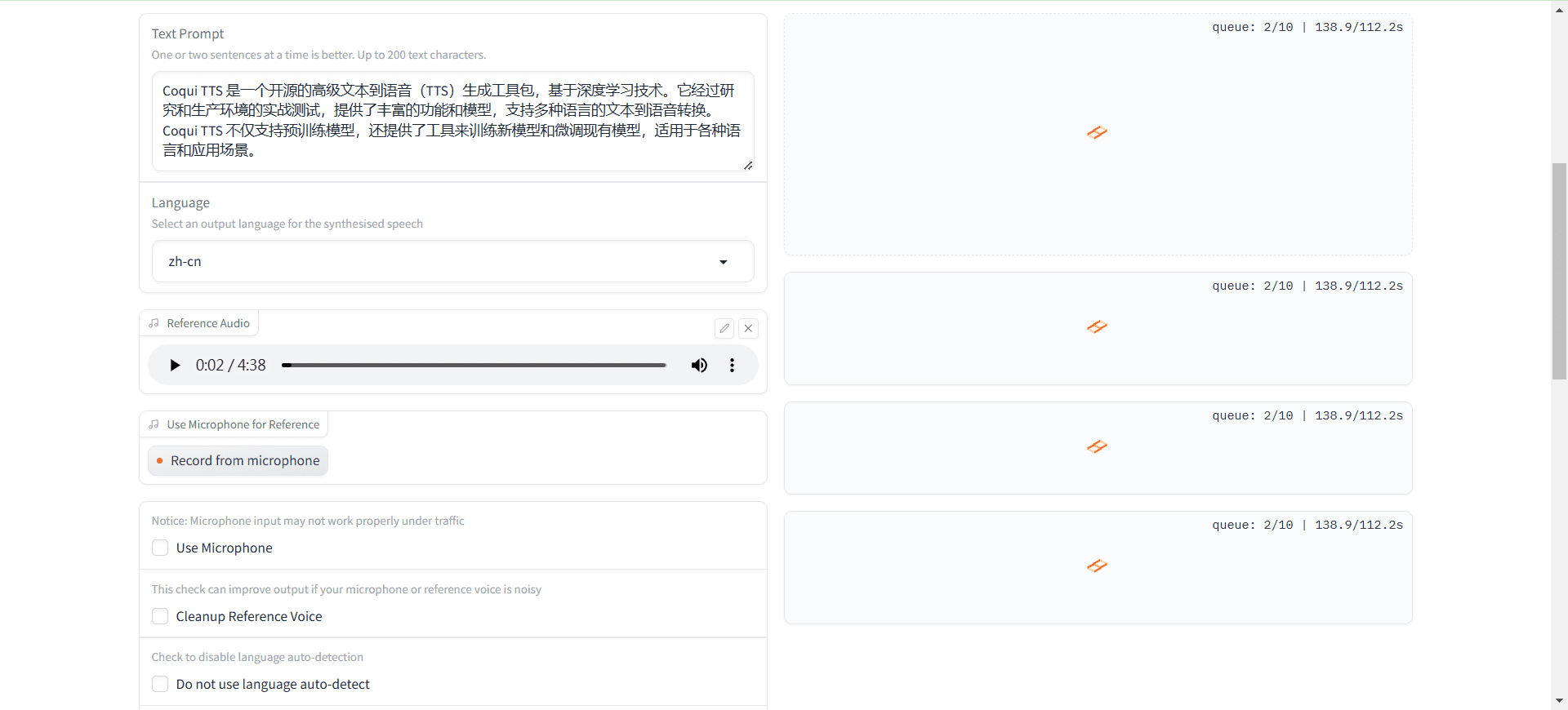

Coqui TTS est une boîte à outils de génération de texte-parole (TTS) avancée et open source, basée sur des techniques d'apprentissage profond. Coqui TTS ne prend pas seulement en charge les modèles pré-entraînés, mais fournit également des outils pour entraîner de nouveaux modèles et affiner les modèles existants pour un large éventail de langues et de scénarios d'application.

L'auteur ne met plus à jour le projet, le projet de branche est en maintenance continue : https://github.com/idiap/coqui-ai-TTS

Démonstration : https://huggingface.co/spaces/coqui/xtts

Liste des fonctions

- Prise en charge multilingueLe logiciel d'aide à la décision : Il permet de convertir le texte en parole dans plus de 1 100 langues.

- Modèle de pré-entraînementLes modèles pré-entraînés : Un large éventail de modèles pré-entraînés est fourni, qui peut être utilisé directement par l'utilisateur.

- formation au modèleLes modèles d'évaluation de l'impact sur l'environnement : aide à la formation de nouveaux modèles et à l'affinement des modèles existants.

- clonage du sonLa fonction de clonage de la voix permet de générer une voix pour un son spécifique.

- Une formation efficaceFournir des outils de formation rapide et efficace sur les modèles.

- Journal détailléLes participants sont invités à fournir des journaux de formation détaillés sur le terminal et le Tensorboard.

- Outils pratiquesFournir des outils pour l'analyse et la compilation des données.

Utiliser l'aide

Processus d'installation

- entrepôt de clonesPour cela, il faut d'abord cloner le dépôt GitHub de Coqui TTS.

git clone https://github.com/coqui-ai/TTS.git cd TTS

2. **安装依赖** :使用 pip 安装所需的依赖。

```bash

pip install -r requirements.txt

- Installation du TTS Pour installer TTS, exécutez la commande suivante.

python setup.py install

Utilisation

- Chargement de modèles pré-entraînés La conversion texte-parole peut être effectuée à l'aide de modèles pré-entraînés.

from TTS.api import TTS

tts = TTS(model_name="tts_models/en/ljspeech/tacotron2-DDC", progress_bar=True)

tts.tts_to_file(text="Hello, world!", file_path="output.wav")

- Former un nouveau modèle Vous pouvez former de nouveaux modèles à partir de votre propre ensemble de données.

python TTS/bin/train_tts.py --config_path config.json --dataset_path /path/to/dataset

- Affiner les modèles existants Les modèles existants peuvent être affinés pour répondre à des scénarios d'application spécifiques.

python TTS/bin/train_tts.py --config_path config.json --dataset_path /path/to/dataset --restore_path /path/to/pretrained/model

Procédure d'utilisation détaillée

- Préparation des données Préparer l'ensemble de données d'entraînement et s'assurer que le format des données est conforme aux exigences.

- fichier de configuration Fichier de configuration : Editer le fichier de configuration

config.json, définir les paramètres d'apprentissage. - Commencer la formation Exécuter le script d'apprentissage pour commencer l'apprentissage du modèle.

- Contrôler la formation Contrôlez le processus de formation, consultez les journaux de formation et les performances du modèle via le terminal et le Tensorboard.

- évaluation de la modélisation La formation : Une fois la formation terminée, les performances du modèle sont évaluées et les ajustements et optimisations nécessaires sont effectués.

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...