Claude 3.7 Sonnet et Claude Code : le raisonnement de pointe rencontre le codage agentique

Anthropique L'entreprise a publié aujourd'hui Claude 3.7 Sonnet ^1^ , qui est non seulement le modèle le plus intelligent d'Anthropic à ce jour, mais aussi le premier modèle de raisonnement hybride sur le marché. claude 3.7 Sonnet fournit à la fois des réponses quasi instantanées et un raisonnement plus approfondi, étape par étape, et le processus de raisonnement est accessible à l'utilisateur. l'utilisateur de l'API dispose également d'un contrôle fin sur la façon dont le modèle réfléchit à la question de l'API, ce qui lui permet d'avoir une vue d'ensemble de la situation. durée.

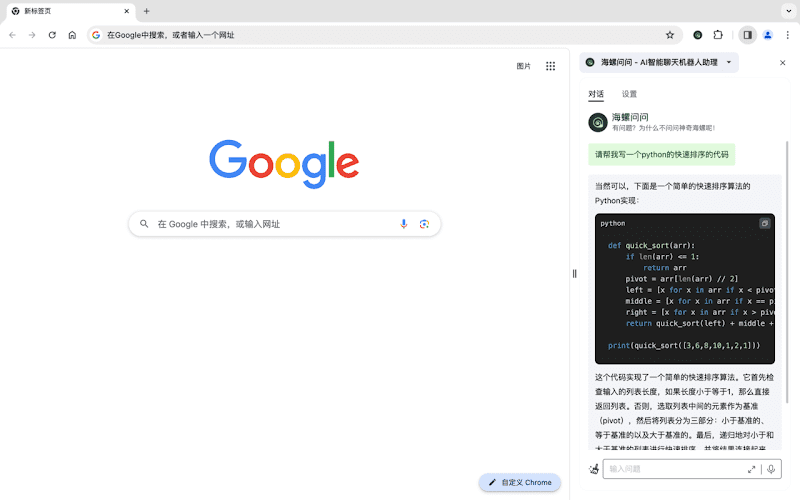

Claude 3.7 Sonnet montre des améliorations particulièrement significatives en matière de codage et de développement web frontal. Le modèle est accompagné de Claude Code, un outil de ligne de commande pour le codage agentique, actuellement disponible en avant-première de recherche limitée, qui permet aux développeurs de déléguer un large éventail de tâches d'ingénierie à Claude directement à partir du terminal.

Claude 3.7 Sonnet est maintenant supporté par toutes les versions de Claude (Free, Pro, Team et Enterprise), ainsi que par Anthropic API, Amazon Bedrock et Google Cloud Vertex AI. Le mode de réflexion étendu est disponible sur toutes les plateformes sauf la version gratuite de Claude. Le mode de réflexion étendu est disponible sur toutes les plateformes, à l'exception de la version gratuite de Claude.

Le prix de Claude 3.7 Sonnet reste le même que celui de son prédécesseur, tant en mode de réflexion standard qu'en mode de réflexion approfondie : par million d'entrées. jetons 3 par million de jetons de sortie et 15 par million de jetons de sortie - y compris les jetons de réflexion.

Claude 3.7 Sonnet : le raisonnement de pointe devient pratique

Anthropic a développé Claude 3.7 Sonnet avec une philosophie différente de celle des autres modèles de raisonnement. De même que l'homme utilise le même cerveau pour réagir rapidement et réfléchir en profondeur, Anthropic considère que le raisonnement doit être une capacité intrinsèquement intégrée à un modèle de pointe, plutôt qu'un modèle complètement séparé. Cette approche unifiée crée également une expérience plus fluide pour les utilisateurs.

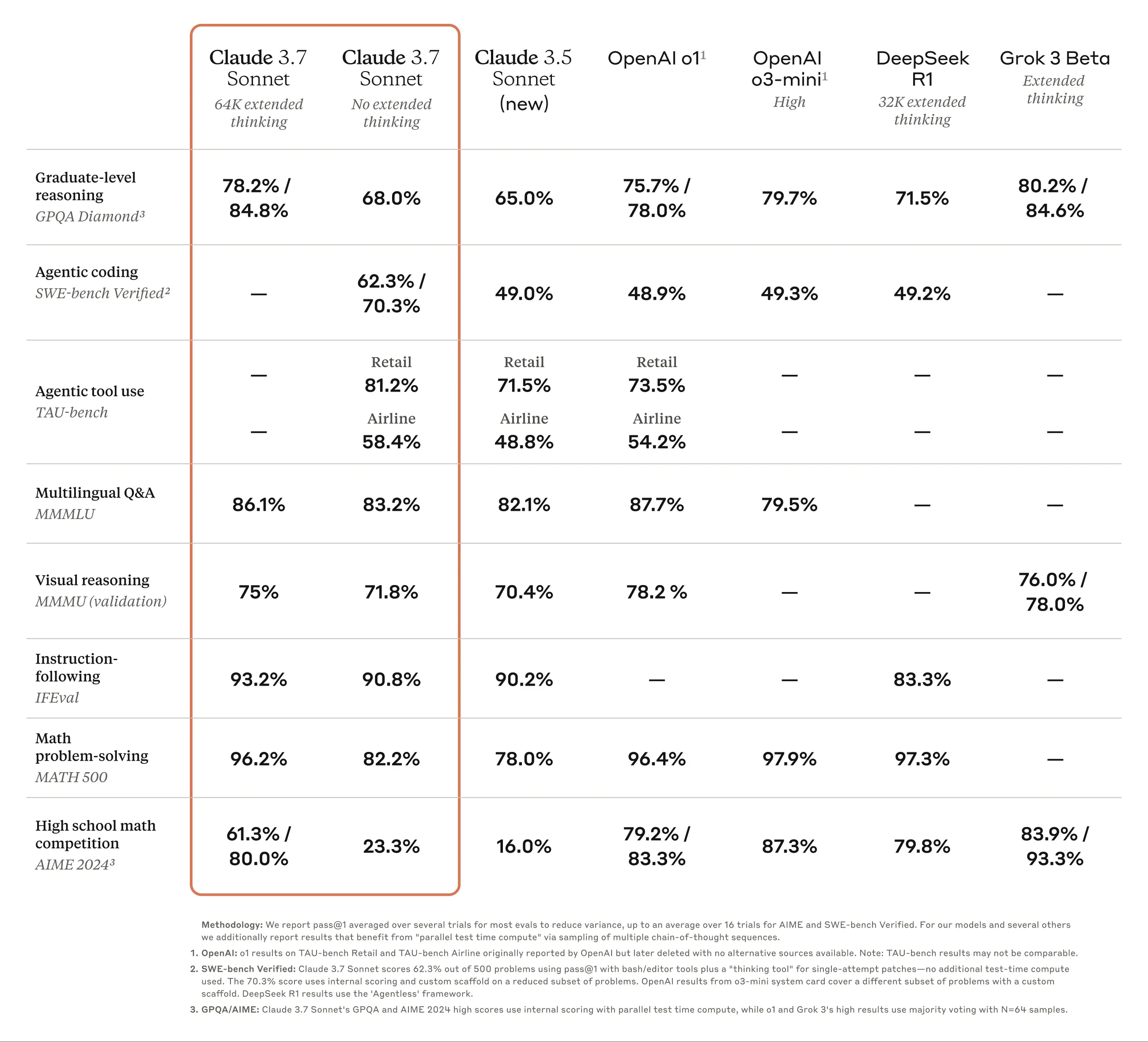

Claude 3.7 Sonnet incarne cette idée de plusieurs manières. Tout d'abord, Claude 3.7 Sonnet combine un LLM normal avec un modèle d'inférence : l'utilisateur peut choisir quand le modèle répond rapidement en mode standard et quand il réfléchit plus longtemps avant de répondre. En mode standard, Claude 3.7 Sonnet est une version améliorée de Claude 3.5 Sonnet. En mode réflexion approfondie, le modèle réfléchit sur lui-même avant de répondre, ce qui améliore ses performances en mathématiques, physique, suivi de commandes, codage et bien d'autres tâches.

Deuxièmement, lors de l'utilisation de Claude 3.7 Sonnet via l'API, l'utilisateur a également le contrôle sur le fait de penser au budgetL'utilisateur peut demander à Claude de penser à un maximum de N jetons, et la valeur de N peut être fixée à une limite de 128K jetons. Cela donne à l'utilisateur la possibilité d'arbitrer entre la vitesse (et le coût) et la qualité de la réponse, selon ses besoins.

Troisièmement, au cours du développement du modèle d'inférence, Anthropic a légèrement réduit l'accent mis sur les sujets des concours de mathématiques et d'informatique dans le sens de l'optimisation, et s'est plutôt concentré sur des scénarios d'application du monde réel afin de mieux refléter la manière dont les utilisateurs professionnels utilisent réellement le LLM.

Les premiers tests ont montré que Claude est un leader dans tous les aspects du codage : Cursor note que Claude est à nouveau un leader dans les tâches de codage du monde réel, avec des améliorations significatives dans des domaines allant du travail avec des bases de code complexes à l'outillage avancé, et Cognition trouve que Claude surpasse tout autre modèle lorsqu'il s'agit de planifier des changements de code et de gérer des mises à jour de la pile complète. Vercel souligne la précision supérieure de Claude dans les flux de travail d'agents complexes, tandis que l'équipe de la Replit Après avoir déployé Claude avec succès pour créer des applications web et des tableaux de bord complexes à partir de zéro, ce qui est difficile à réaliser avec d'autres modèles, l'évaluation de Canva a montré que Claude produit systématiquement du code prêt à la production qui est non seulement mieux conçu, mais qui réduit aussi considérablement les bogues.

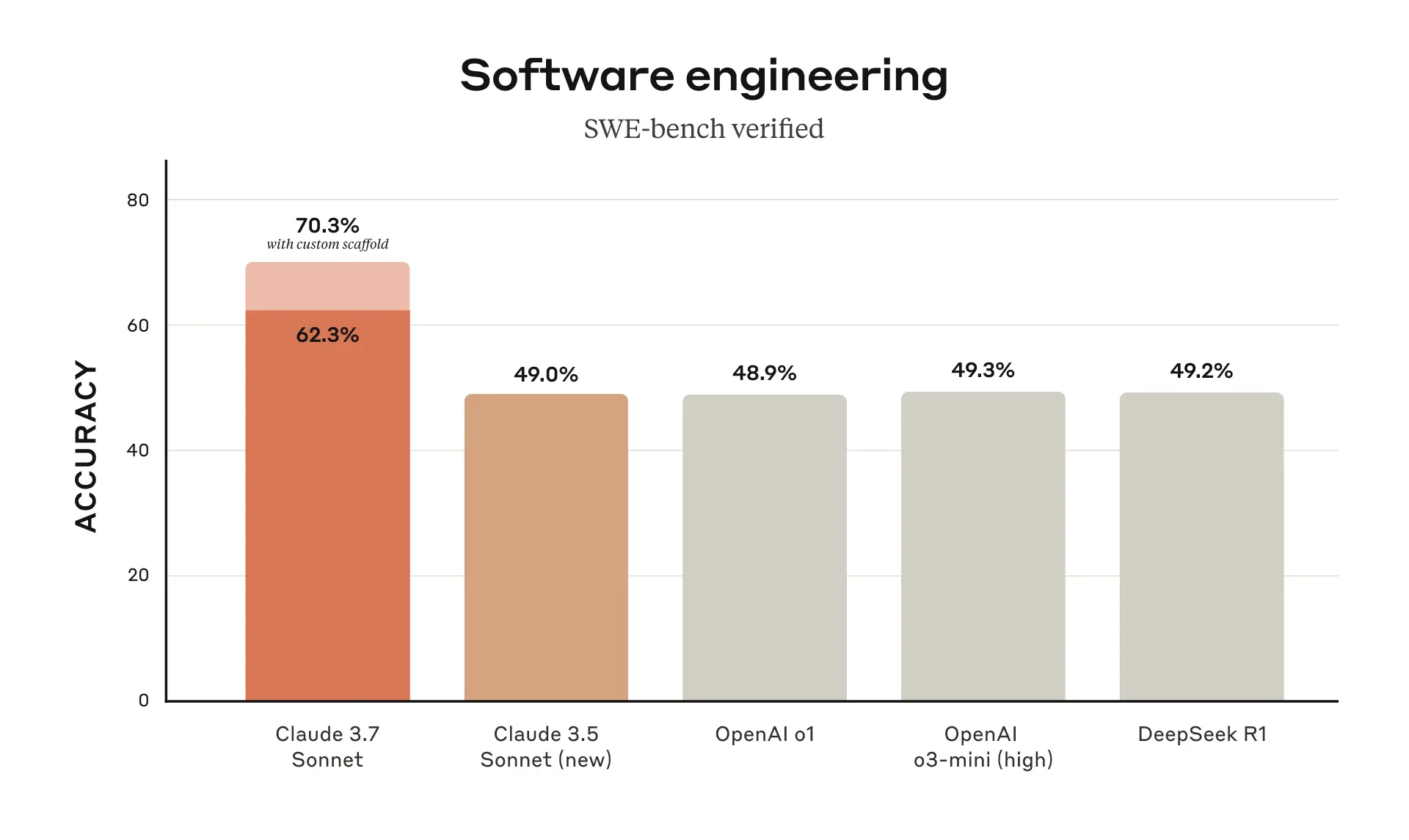

Claude 3.7 Sonnet a obtenu la meilleure performance sur SWE-bench Verified, un benchmark qui mesure la capacité des modèles d'IA à résoudre des problèmes logiciels réels. Pour plus d'informations sur l'échafaudage, voir l'annexe.

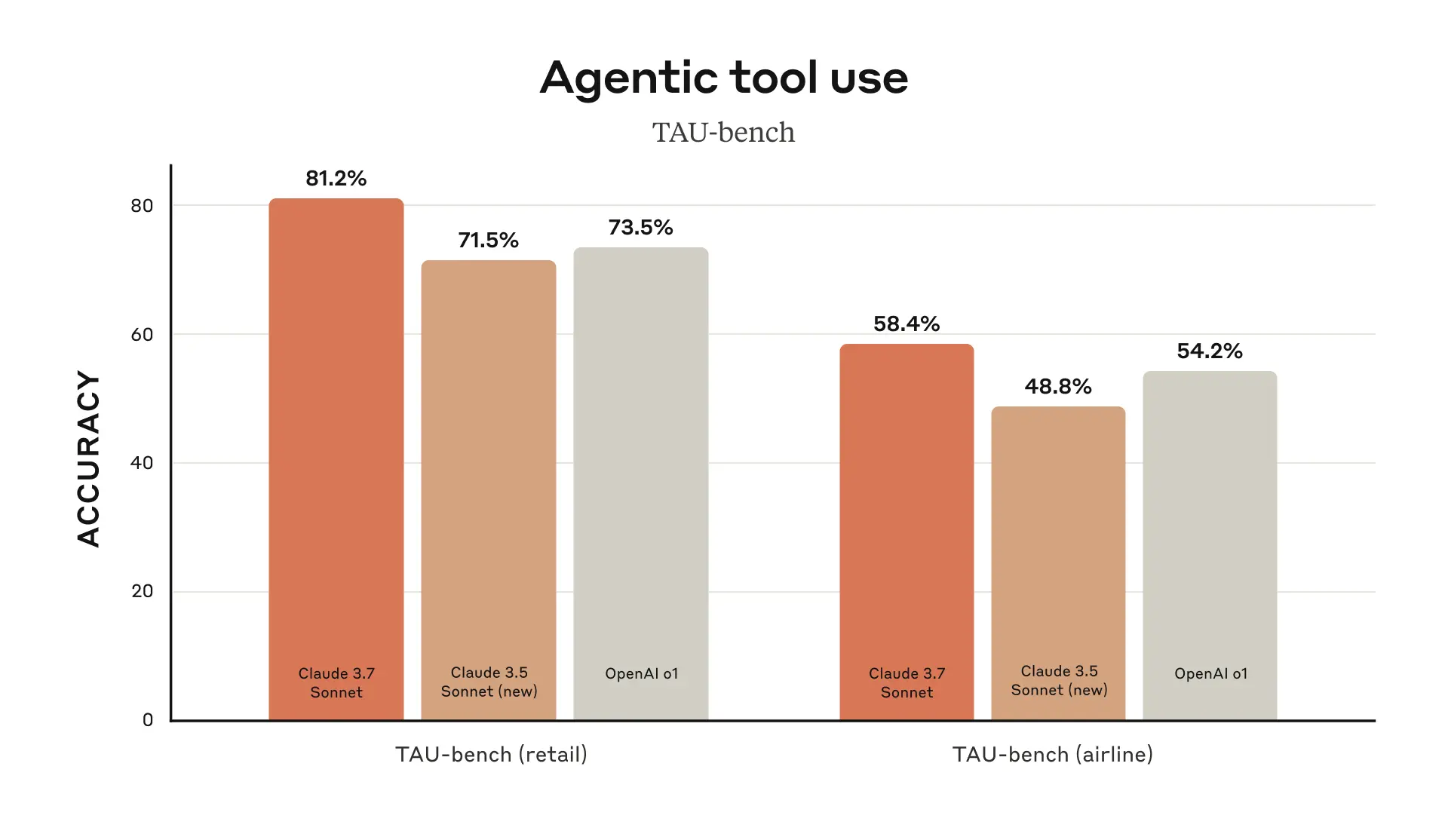

Claude 3.7 Sonnet a obtenu la meilleure performance sur TAU-bench, un cadre pour tester la performance des agents d'intelligence artificielle sur des tâches complexes du monde réel impliquant des interactions entre l'utilisateur et l'outil. Pour plus d'informations sur l'échafaudage, voir l'annexe.

Claude 3.7 Sonnet excelle dans le suivi des instructions, le raisonnement généralisé, les capacités multimodales et l'encodage agentique, et le mode de pensée étendu améliore considérablement ses performances en mathématiques et en sciences. En plus des repères traditionnels, Claude 3.7 Sonnet surpasse même tous les modèles précédents dans les tests du jeu Pokémon.

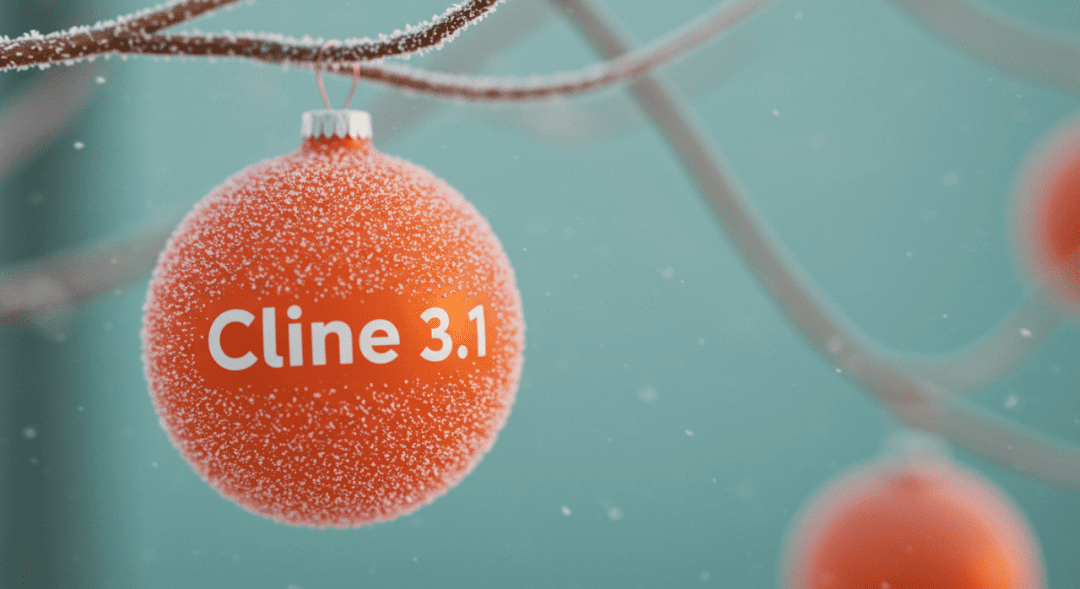

Claude Code : un nouvel assistant pour les développeurs

Depuis juin 2024, Sonnet est le modèle de choix pour les développeurs du monde entier. Anthropic est désormais disponible dans une version limitée de prévisualisation de la recherche. Code Claude -- Le premier outil de codage agentique d'Anthropic pour renforcer l'autonomie des développeurs.

Claude Code est un collaborateur actif qui recherche et lit du code, édite des fichiers, écrit et exécute des tests, transmet du code et le pousse sur GitHub, et utilise des outils de ligne de commande - en informant les utilisateurs à chaque étape.

Claude Code en est encore à ses débuts, mais il est devenu un outil indispensable pour l'équipe d'Anthropic, en particulier pour le développement piloté par les tests, le débogage de problèmes complexes et le remaniement à grande échelle. Lors des premiers tests, Claude Code a été capable d'effectuer en une seule opération des tâches qui auraient normalement pris plus de 45 minutes à réaliser manuellement, réduisant ainsi de manière significative le temps de développement et les coûts administratifs.

Dans les semaines à venir, Anthropic prévoit d'apporter des améliorations continues basées sur l'utilisation des utilisateurs, y compris l'amélioration de la fiabilité des appels d'outils, l'ajout d'un support pour les commandes longues, l'amélioration du rendu dans l'application, et l'amélioration de la compréhension des capacités de Claude lui-même.

L'objectif d'Anthropic en lançant Claude Code est de mieux comprendre comment les développeurs codent avec Claude afin d'améliorer le modèle à l'avenir. En rejoignant cet aperçu, les utilisateurs auront accès aux mêmes outils puissants qu'Anthropic utilise pour construire et améliorer Claude, et les commentaires des utilisateurs influenceront directement son développement futur.

Travailler avec Claude sur la base de code

Anthropic a également amélioré l'expérience de codage sur Claude.ai, et l'intégration GitHub d'Anthropic est maintenant disponible sur tous les plans Claude - permettant aux développeurs de connecter leurs dépôts de code directement à Claude.

Claude 3.7 Sonnet est le meilleur modèle de codage d'Anthropic à ce jour. Avec une meilleure compréhension des projets personnels, professionnels et open source des utilisateurs, il devient un partenaire encore plus fort pour corriger les bugs, développer de nouvelles fonctionnalités et construire la documentation des projets GitHub les plus importants.

Construction responsable

Anthropic a testé et évalué Claude 3.7 Sonnet de manière approfondie et a travaillé avec des experts externes pour s'assurer qu'il répondait aux normes d'Anthropic en matière de sécurité, de fiabilité et de sûreté. Claude 3.7 Sonnet est également plus nuancé dans la distinction entre les demandes nuisibles et bénignes que son prédécesseur, avec 45% de rejets inutiles en moins.

Cette version de la fiche système couvre les dernières découvertes en matière de sécurité dans plusieurs catégories, en détaillant l'évaluation de la politique d'extension responsable d'Anthropic, que d'autres laboratoires d'IA et chercheurs peuvent appliquer à leurs propres travaux. La fiche système explore également les risques émergents posés par l'utilisation des ordinateurs, en particulier les attaques par injection rapide, et explique comment Anthropic évalue ces vulnérabilités et forme Claude à y résister et à les atténuer. En outre, la fiche système examine les avantages potentiels que les modèles d'inférence peuvent apporter en matière de sécurité : la capacité de comprendre comment les modèles prennent des décisions, et si l'inférence des modèles est vraiment digne de confiance et fiable. Pour plus d'informations, consultez la fiche système complète.

regarder vers l'avant

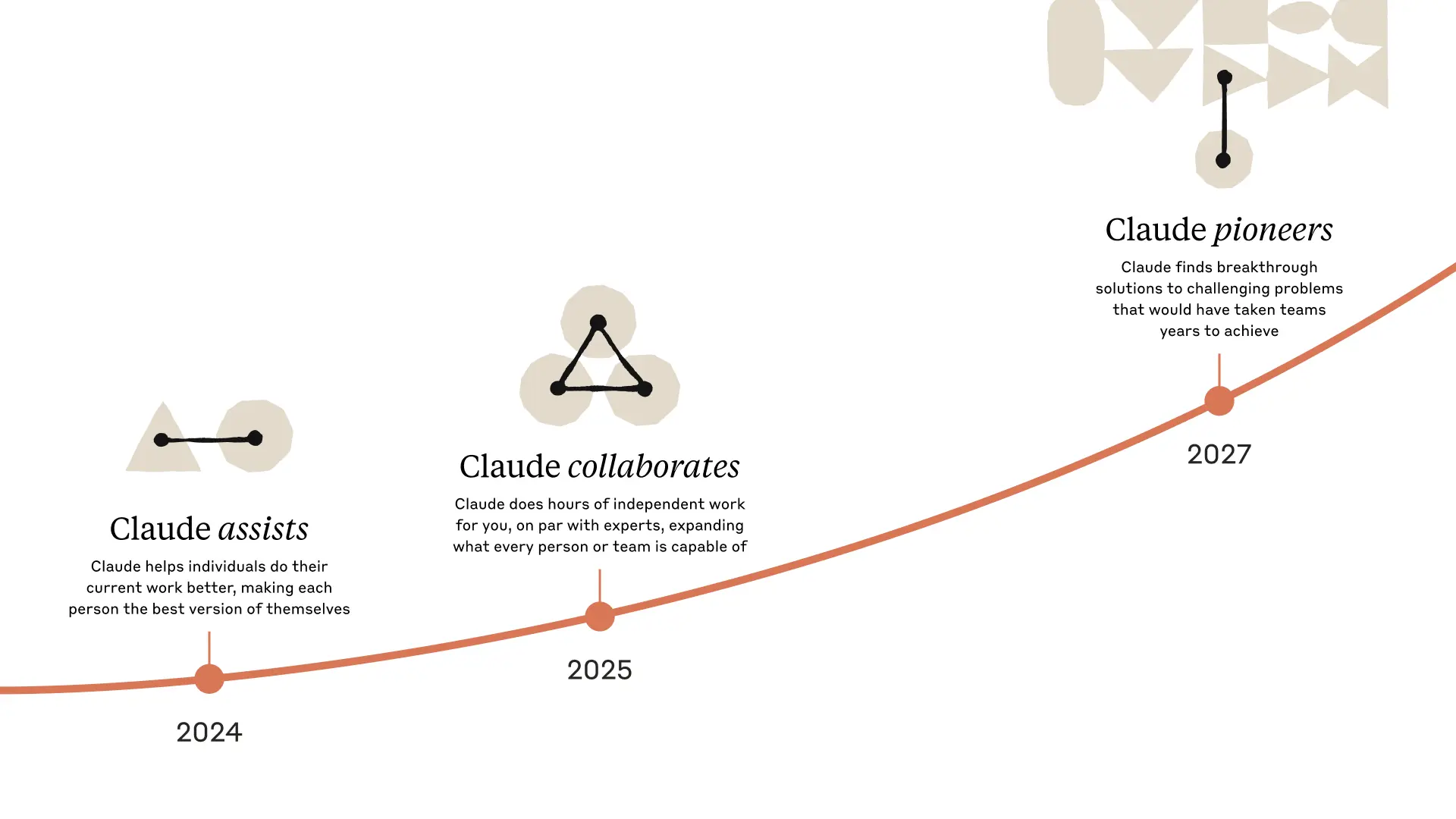

La sortie de Claude 3.7 Sonnet et Claude Code marque une étape importante dans la direction de l'autonomisation des systèmes d'IA. Grâce à leur capacité à raisonner en profondeur, à travailler de manière autonome et à collaborer efficacement, ils nous conduisent vers un avenir où l'IA peut enrichir et étendre les réalisations humaines.

Anthropic a hâte que les utilisateurs explorent ces nouvelles fonctionnalités et se réjouit de voir ce que les utilisateurs vont créer. Anthropic accueille toujours avec plaisir les [feedback] (mailto : feedback@anthropic.com) des utilisateurs afin qu'Anthropic puisse continuer à améliorer et à développer les modèles d'Anthropic.

annexe

^1 ^ Leçons sur la dénomination.

Évaluation des sources de données

Banc TAU

Informations sur les échafaudages

Ces scores ont été obtenus en ajoutant une annexe à la politique de l'agent de la compagnie aérienne qui demandait à Claude de mieux utiliser l'outil "planification". Dans ce mode, Anthropic encourage le modèle à écrire son processus de réflexion au cours de plusieurs tours d'interaction dans la résolution de problèmes afin d'utiliser pleinement ses capacités de raisonnement, ce qui est une différence par rapport au mode de réflexion habituel d'Anthropic. Pour tenir compte de la consommation supplémentaire de jetons de Claude due à l'utilisation d'un plus grand nombre d'étapes de réflexion, Anthropic a augmenté le nombre maximum d'étapes (en termes d'achèvement du modèle) de 30 à 100 (la plupart des interactions ont été achevées en moins de 30 étapes, et une seule interaction a dépassé les 50 étapes).

De plus, les résultats du banc TAU pour Claude 3.5 Sonnet (nouveau) diffèrent de ceux rapportés par Anthropic au moment de la publication originale en raison de quelques améliorations mineures dans le jeu de données depuis lors. Anthropic a refait le test sur le jeu de données mis à jour pour le comparer plus précisément à Claude 3.7 Sonnet. Anthropic a refait le test sur le jeu de données mis à jour pour le comparer plus précisément à Claude 3.7 Sonnet.

Banc SWE Vérifié

Informations sur les échafaudages

Il existe de nombreuses approches pour résoudre des tâches agentiques ouvertes telles que SWE-bench. Certaines approches transfèrent une grande partie de la complexité (par exemple, décider quels fichiers doivent être examinés ou modifiés, et quels tests doivent être exécutés) vers des logiciels plus traditionnels, ne laissant que le modèle de langage de base pour générer du code dans des emplacements prédéfinis, ou pour choisir parmi un ensemble plus limité d'opérations.Agentless (Xia et al., 2024) est une approche de la résolution de tâches agentiques ouvertes et ouvertes. Deepseek R1 Ce cadre populaire, couramment utilisé dans l'évaluation d'Aide et d'autres modèles, renforce les capacités de l'agent à l'aide de mécanismes de recherche de documents prompts et intégrés, de localisation de correctifs et d'un échantillonnage de rejet au meilleur des 40 pour les tests de régression. D'autres échafaudages (par exemple, Aide) augmentent encore le modèle avec des calculs supplémentaires pendant le temps de test sous la forme de tentatives, de best-of-N ou de recherche arborescente de Monte Carlo (MCTS).

Pour Claude 3.7 Sonnet et Claude 3.5 Sonnet (nouveau), Anthropic utilise une approche plus simple avec un échafaudage minimal. Dans cette approche, le modèle décide des commandes à exécuter et des fichiers à éditer en une seule session. Le principal résultat du pass@1 "sans réflexion approfondie" d'Anthropic consiste simplement à équiper le modèle de deux des outils décrits ici - l'utilitaire bash et un outil d'édition de fichiers qui fonctionne par substitution de chaînes de caractères - ainsi que d'un outil d'édition de fichiers qui fonctionne par substitution de chaînes de caractères. - l'utilitaire bash et un outil d'édition de fichiers qui fonctionne par substitution de chaînes de caractères - ainsi que l'"outil de planification" qu'Anthropic mentionne dans les résultats du TAU-bench. En raison des limitations de l'infrastructure, seuls 489/500 problèmes ont pu être résolus sur l'infrastructure interne d'Anthropic (c'est-à-dire que la solution gold a passé le test). Pour le score vanille pass@1, Anthropic a compté 11 problèmes non résolus comme des échecs afin de s'aligner sur le classement officiel. Par souci de transparence, Anthropic a publié séparément les cas de test qui n'ont pas fonctionné sur l'infrastructure d'Anthropic.

Pour les nombres "high compute", Anthropic utilise une complexité supplémentaire et des calculs de temps de test parallèles, comme indiqué ci-dessous :

- Échantillons anthropiques plusieurs tentatives parallèles utilisant l'échafaudage ci-dessus

- Anthropic rejette les correctifs qui corrompent les tests de régression visibles dans le référentiel, de manière similaire à la méthode d'échantillonnage par rejet utilisée par Agentless ; notez qu'Anthropic n'utilise pas les informations sur les tests cachés.

- Anthropic a ensuite classé les tentatives restantes à l'aide d'un modèle de notation similaire aux résultats GPQA et AIME d'Anthropic décrits dans l'article de recherche et a sélectionné les meilleures tentatives pour la soumission.

Cela donne un score de 70.3% sur le sous-ensemble de n=489 tâches vérifiées qui fonctionnent sur l'infrastructure d'Anthropic. Sans cet échafaudage, Claude 3.7 Sonnet a obtenu un score de 63.7% sur SWE-bench Verified en utilisant le même sous-ensemble.Les 11 cas de test avec lesquels l'infrastructure interne d'Anthropic n'est pas compatible sont listés ci-dessous :

- scikit-learn__scikit-learn-14710

- django__django-10097

- psf__requests-2317

- sphinx-doc__sphinx-10435

- sphinx-doc__sphinx-7985

- sphinx-doc__sphinx-8475

- matplotlib__matplotlib-20488

- astropy__astropy-8707

- astropy__astropy-8872

- sphinx-doc__sphinx-8595

- sphinx-doc__sphinx-9711

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...