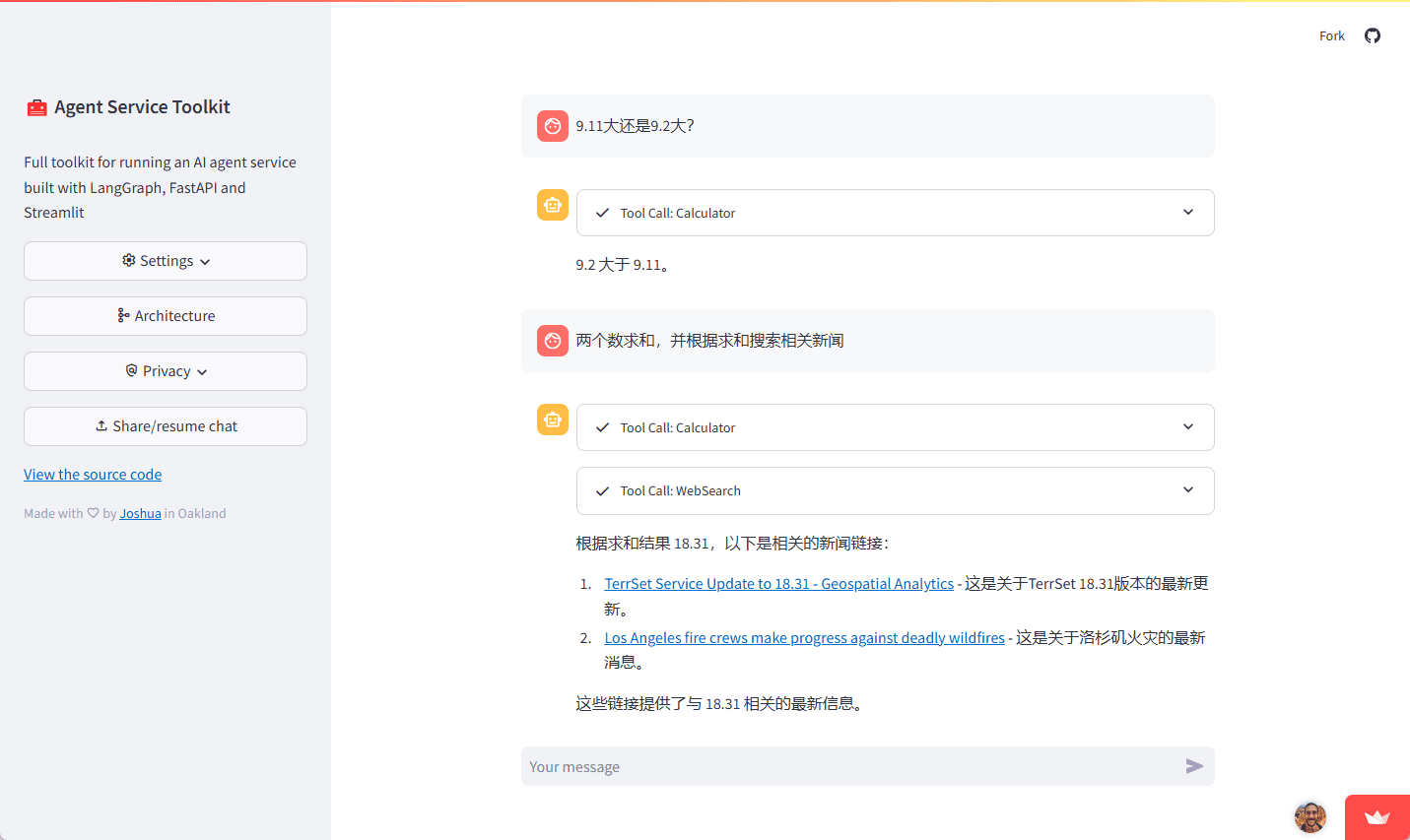

Agent Service Toolkit : un ensemble complet d'outils pour la construction d'intelligences IA basées sur LangGraph

Introduction générale

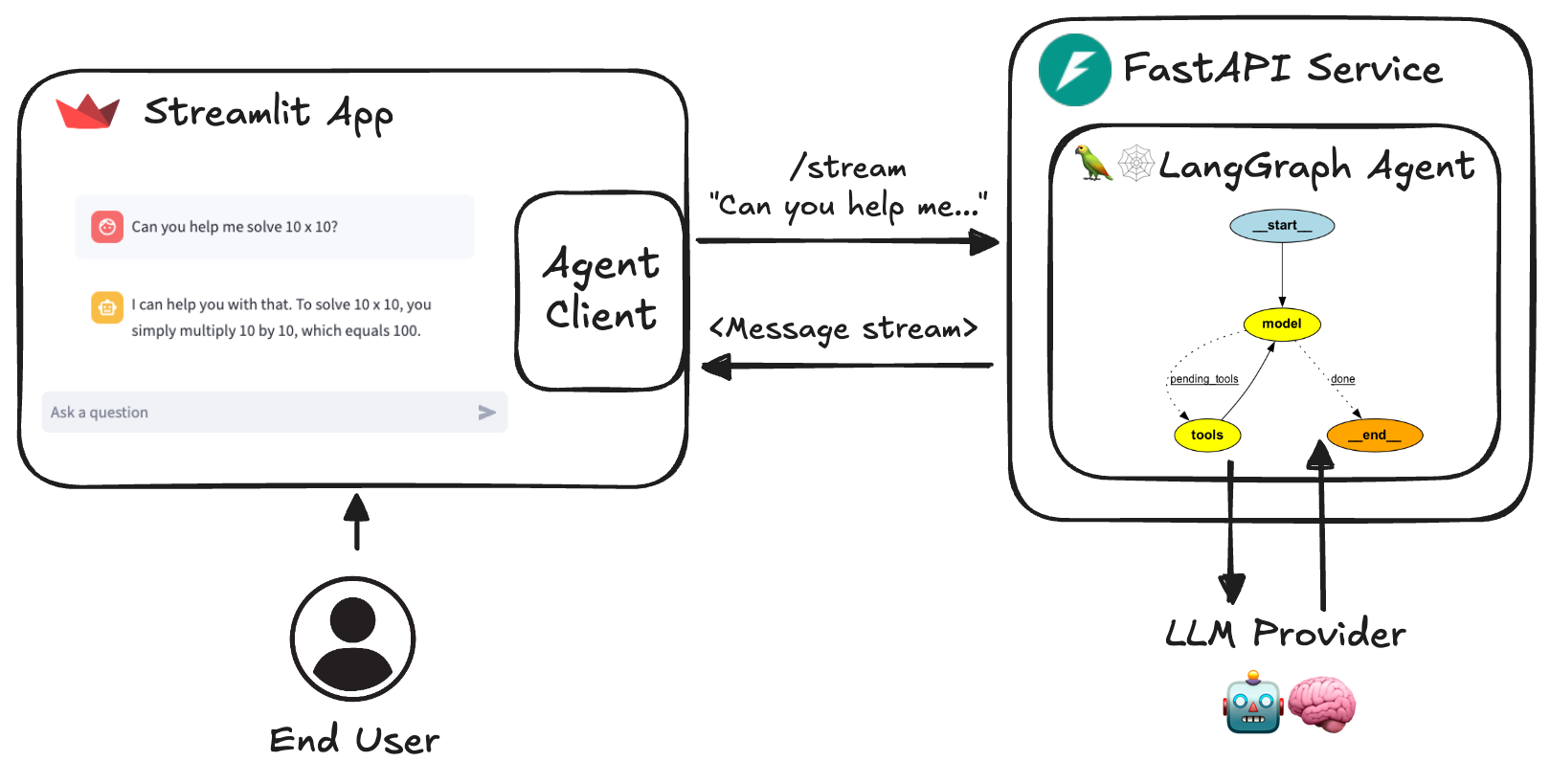

AI Agent Service Toolkit est un ensemble d'outils complet basé sur LangGraph, FastAPI et Streamlit, conçu pour aider les développeurs à créer et à exécuter rapidement des services d'agents d'intelligence artificielle. La boîte à outils fournit un cadre flexible qui prend en charge les fonctionnalités et les interactions des agents définies par l'utilisateur pour une variété de scénarios d'application. Qu'il s'agisse de développer des chatbots, des outils d'analyse de données ou d'autres services basés sur l'IA, les utilisateurs peuvent rapidement les mettre en œuvre à l'aide de la boîte à outils. La boîte à outils est conçue dans un souci de facilité d'utilisation et d'extensibilité, ce qui permet aux utilisateurs d'intégrer facilement les fonctionnalités requises par le biais d'une configuration simple et de modifications du code.

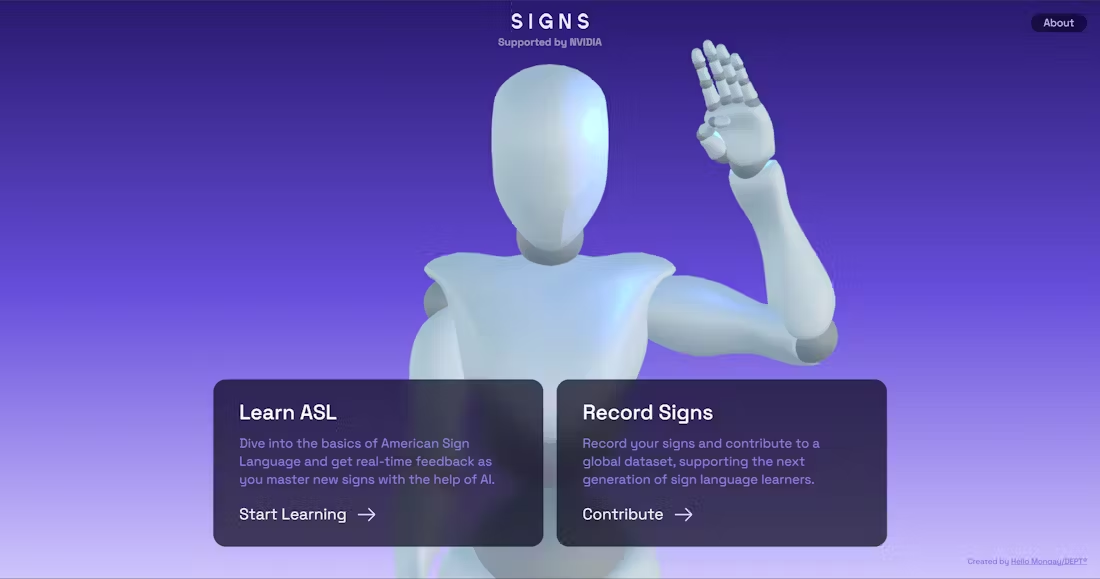

Expérience : https://agent-service-toolkit.streamlit.app/

Architecture de la boîte à outils de services d'agents

Liste des fonctions

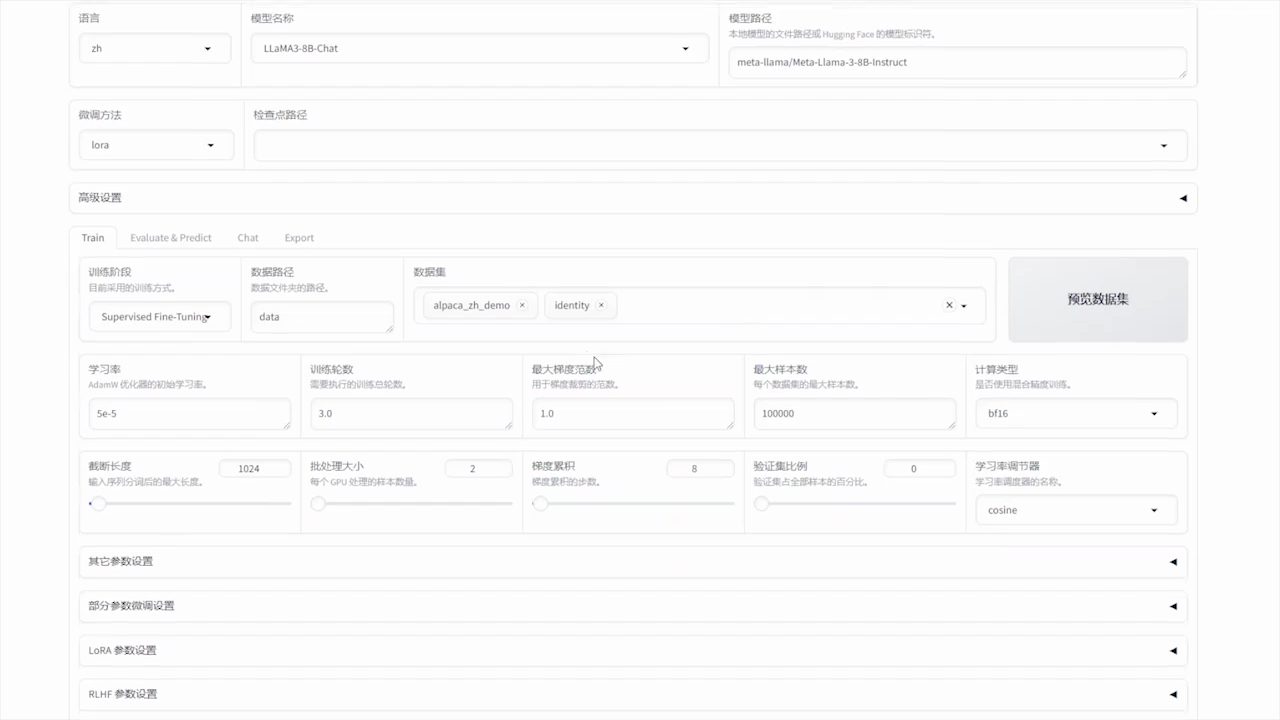

- LangGraph Agent : Utilisation LangGraph Agents personnalisables construits sur la base d'un cadre.

- Services FastAPI Le système de gestion de l'information : fournit des services pour les points d'extrémité avec ou sans flux.

- Traitement avancé des flux Les services d'information et de communication de la Commission européenne sont les suivants : ils prennent en charge la diffusion en continu basée sur les jetons et les messages.

- Audit de contenu Mise en œuvre de LlamaGuard pour l'audit de contenu (obligatoire) Groq (clé API).

- Interface Streamlit Le système de chat : Il fournit une interface de chat conviviale pour interagir avec les agents.

- Support multi-agents Le service d'assistance à l'utilisateur est un service d'assistance à l'utilisateur qui permet d'exécuter plusieurs serveurs mandataires dans le service et de les invoquer par l'intermédiaire de chemins d'accès URL.

- conception asynchrone Les services d'aide à la décision : Gestion efficace des demandes concurrentes avec async/await.

- Mécanismes de retour d'information Le système d'évaluation par étoiles est intégré à LangSmith.

- Métadonnées dynamiques Le point de terminaison : /info fournit des métadonnées de configuration dynamique sur les services et les agents et modèles disponibles.

- Support Docker Le logiciel de gestion de l'information est un outil de gestion de l'information qui permet aux utilisateurs d'avoir accès à l'information sur l'état de l'environnement et de la société.

- test (machines, etc.) Les tests d'unité et d'intégration sont complets.

Utiliser l'aide

Processus d'installation

- L'exécuter directement en Python : :

- Assurez-vous d'avoir au moins une clé API LLM :

echo 'OPENAI_API_KEY=your_openai_api_key' >> .env- Installer les dépendances et synchroniser :

pip install uv uv sync --frozen- Activez l'environnement virtuel et exécutez le service :

source .venv/bin/activate python src/run_service.py- Activez l'environnement virtuel dans un autre terminal et lancez l'application Streamlit :

source .venv/bin/activate streamlit run src/streamlit_app.py - Fonctionnement avec Docker : :

- Assurez-vous d'avoir au moins une clé API LLM :

bash echo 'OPENAI_API_KEY=your_openai_api_key' >> .env - Exécutez-le avec Docker Compose :

bash docker compose up

- Assurez-vous d'avoir au moins une clé API LLM :

Fonction Opération Déroulement

- LangGraph Agent : :

- Définir le proxy : dans le

src/agents/Catalogue permettant de définir des agents ayant des capacités différentes. - Configuration du proxy : utilisez la fonction

langgraph.jsonconfigure le comportement et les paramètres de l'agent.

- Définir le proxy : dans le

- Services FastAPI : :

- Démarrer le service : run

src/service/service.pyDémarrer le service FastAPI. - Accès aux points d'extrémité : via

/streamrépondre en chantant/non-streamEndpoint Access Proxy Service.

- Démarrer le service : run

- Interface Streamlit : :

- Écran de lancement : Exécuter

src/streamlit_app.pyLancer l'application Streamlit. - Utilisation interactive : interagir avec l'agent par le biais d'une interface de chat conviviale.

- Écran de lancement : Exécuter

- Audit de contenu : :

- Configuration de LlamaGuard : Dans l'onglet

.envpour ajouter la clé de l'API Groq afin d'activer l'audit de contenu.

- Configuration de LlamaGuard : Dans l'onglet

- Support multi-agents : :

- Configurer plusieurs serveurs mandataires : dans le champ

src/agents/pour définir plusieurs serveurs mandataires et les invoquer via différents chemins d'accès URL.

- Configurer plusieurs serveurs mandataires : dans le champ

- Mécanismes de retour d'information : :

- Système de retour d'information intégré : un système de retour d'information basé sur des étoiles est intégré au service d'agent afin de recueillir les commentaires des utilisateurs et d'améliorer le service.

- Métadonnées dynamiques : :

- Accès aux métadonnées : via

/infoLes points d'accès obtiennent des métadonnées de configuration dynamique sur les services et les agents et modèles disponibles.

- Accès aux métadonnées : via

- test (machines, etc.) : :

- Exécuter le test : dans la fenêtre

tests/Catalogue permettant d'exécuter des tests unitaires et d'intégration afin de garantir la stabilité et la fiabilité du service.

- Exécuter le test : dans la fenêtre

© déclaration de droits d'auteur

Article copyright Cercle de partage de l'IA Tous, prière de ne pas reproduire sans autorisation.

Articles connexes

Pas de commentaires...