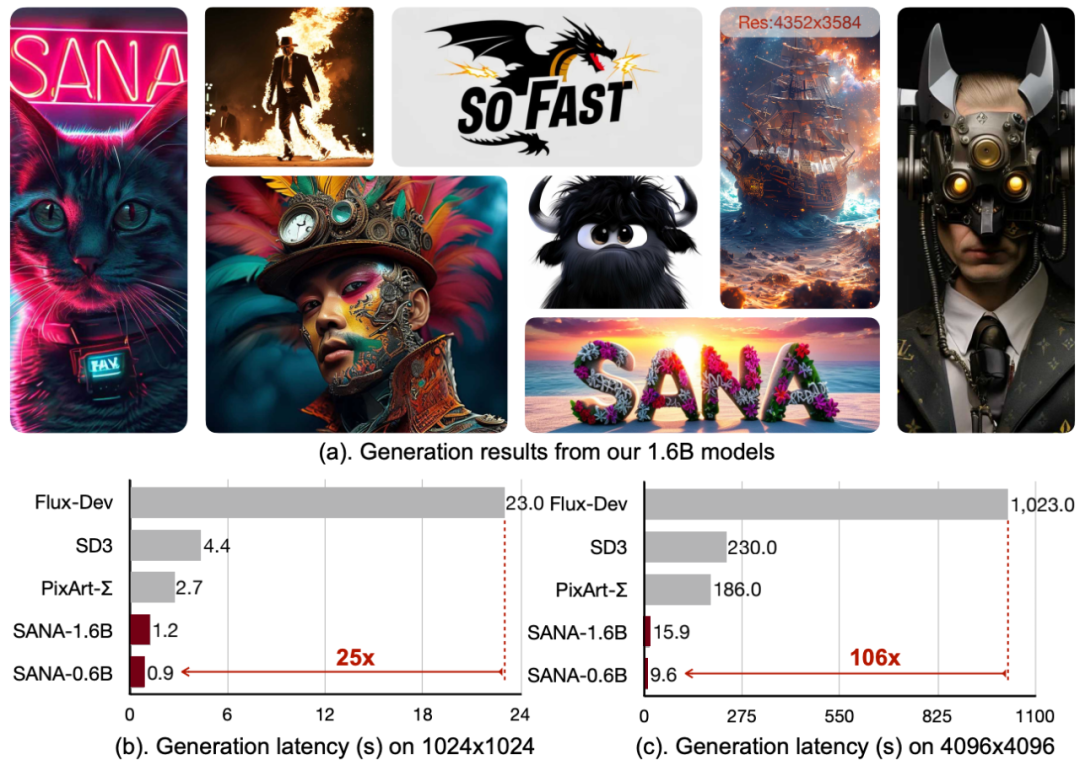

ByteDance y otros lanzan el primer modelo de cuantificación FLUX de 1,58 bits con una reducción de parámetros TP3T del 99,51, ¡comparable al FLUX de precisión total!

Análisis de lo más destacado

- FLUJO de 1,58 bitsEl primero será FLUX visualmente Transformador (un total de 11.900 millones) se reduce en 99,5% a un modelo de cuantificación de 1,58 bits, lo que elimina la necesidad de basarse en datos de imagen y reduce drásticamente los requisitos de almacenamiento.

- Desarrollo de un núcleo lineal eficiente optimizado para el cálculo de 1,58 bits, con lo que se consigue una importante reducción de memoria y una aceleración de la inferencia.

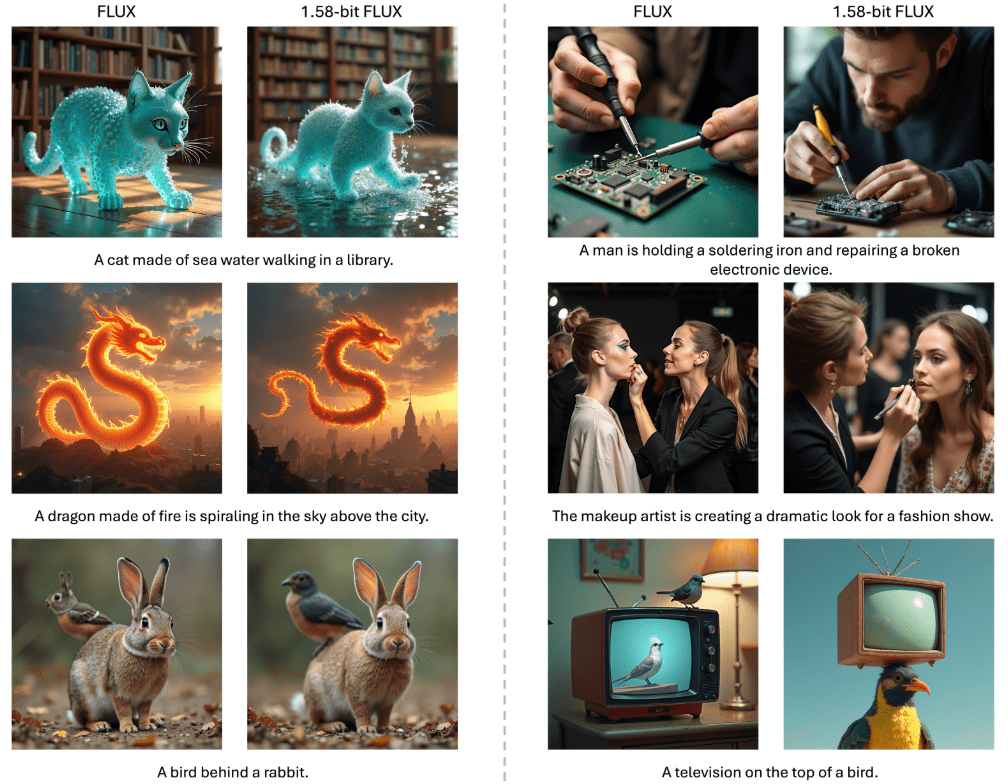

- pruebe FLUJO de 1,58 bits En la exigente prueba T2I, el rendimiento fue comparable al del modelo FLUX de precisión total.

Resumen rápido

Problemas resueltos

- Los modelos actuales de conversión de texto en imagen (T2I), como DALLE 3 y Stable Diffusion 3, tienen un enorme número de parámetros y altos requisitos de memoria para la inferencia, lo que dificulta su implantación en dispositivos con recursos limitados (por ejemplo, dispositivos móviles).

- Este artículo se centra en la viabilidad de la cuantificación de bits muy bajos (1,58 bits) en los modelos T2I para reducir los requisitos de almacenamiento y memoria, al tiempo que se mejora la eficacia de la inferencia.

Programa propuesto

- Se eligió el modelo FLUX.1-dev como objetivo de cuantificación, y sus pesos se comprimieron a 1,58 bits (con valores restringidos a {-1, 0, +1}) mediante un método de cuantificación posterior al entrenamiento sin acceder a los datos de la imagen.

- Desarrollo de un núcleo específico de optimización de operaciones de bits bajos para mejorar aún más la eficacia de la inferencia.

Tecnología aplicada

- Cuantificación del peso en 1,58 bitsBitización extremadamente baja: La bitización extremadamente baja se consigue comprimiendo los pesos de la capa lineal del modelo a 1,58 bits mediante un método similar a BitNet b1.58 y almacenando los pesos mediante enteros con signo de 2 bits.

- Métodos cuantitativos no supervisados: se basa exclusivamente en el mecanismo de autosupervisión del propio modelo FLUX.1-dev, y no necesita recurrir a esquemas de precisión mixta ni a datos de entrenamiento adicionales.

- Núcleo personalizadoNúcleo de inferencia optimizado para operaciones de pocos bits, lo que reduce el uso de memoria y la latencia de la inferencia.

punzón

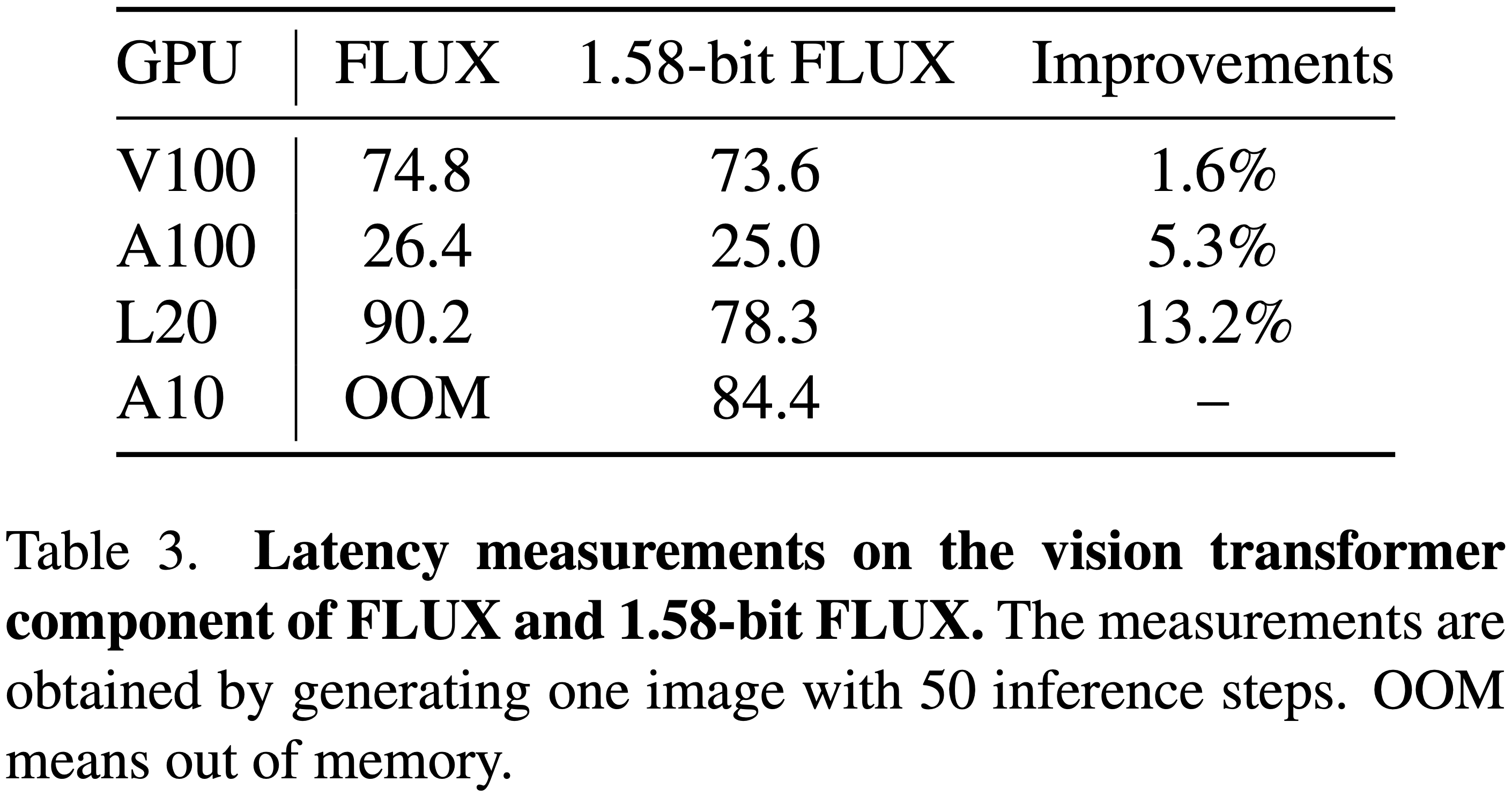

- Eficacia del almacenamientoModelo de almacenamiento reducido en 7,7 veces, comprimido de 16 bits a 2 bits.

- Eficacia del razonamientoEl uso de memoria durante la inferencia se reduce en 5,1 veces y la latencia de la inferencia mejora significativamente.

- Generar calidadEn las pruebas comparativas GenEval y T2I Compbench, la calidad de generación está esencialmente a la par con la de FLUX de precisión completa, lo que valida la eficacia y utilidad del esquema.

Resultados

establecer

cuantificableLa cuantificación se llevó a cabo utilizando un conjunto de datos calibrado compuesto por claves del conjunto de datos Parti-1k y el conjunto de entrenamiento T2I CompBench, con un total de 7.232 claves. Todo el proceso es completamente independiente de los datos de imagen y no se requieren conjuntos de datos adicionales. La cuantificación comprime todos los pesos de las capas lineales de FluxTransformerBlock y FluxSingleTransformerBlock en FLUX a 1,58 bits, lo que representa el 99,5% del total de los parámetros del modelo.

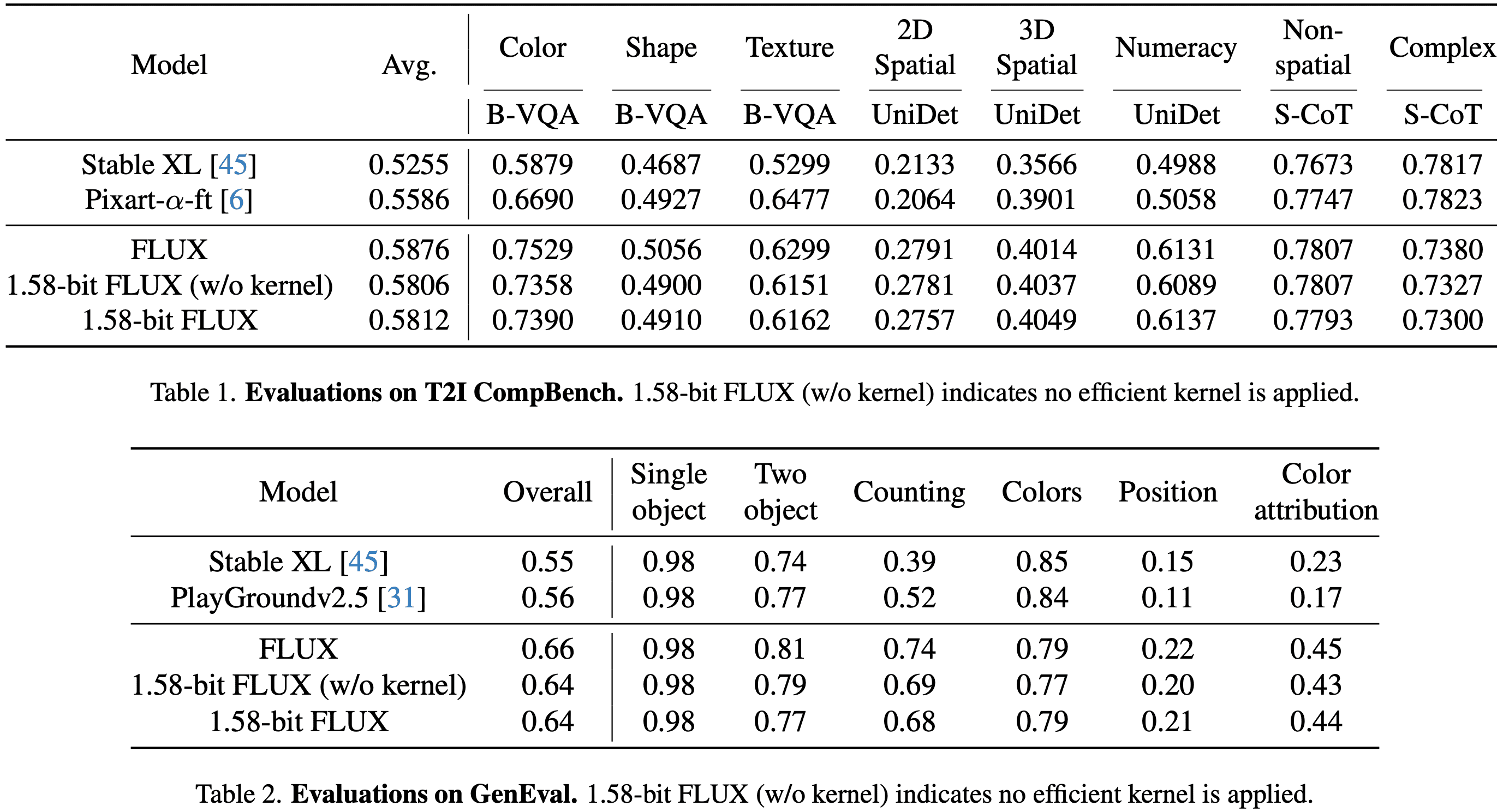

valoraciónEvaluación de FLUX y FLUX de 1,58 bits en el conjunto de datos GenEval y el conjunto de validación T2I CompBench, siguiendo el proceso oficial de generación de imágenes.

- Conjunto de datos GenEvalContiene 553 preguntas, cada una de las cuales genera 4 imágenes.

- Conjunto de validación T2I CompBenchLa evaluación se llevó a cabo en 8 categorías con 300 preguntas por categoría, cada una de las cuales generaba 10 imágenes, con un total de 24.000 imágenes para la evaluación.

- Todas las imágenes se generan con una resolución de 1024 × 1024 para FLUX y FLUX de 1,58 bits.

al final

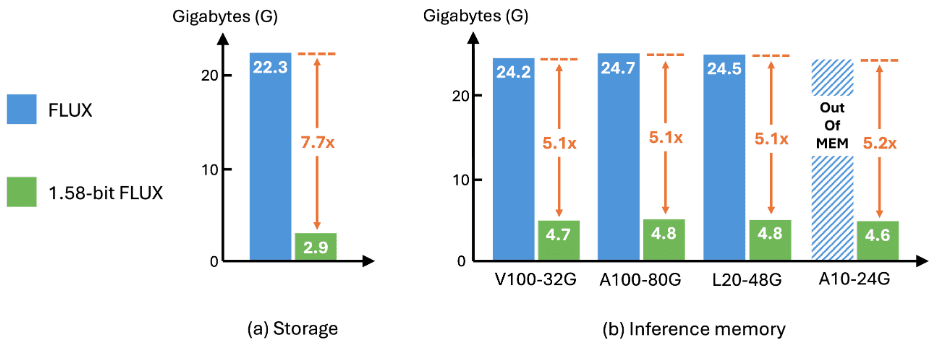

actuacionesEl rendimiento del FLUX de 1,58 bits es comparable al del FLUX de precisión completa en las pruebas comparativas T2I Compbench y GenEval, como se muestra en las Tablas 1 y 2. Los cambios de rendimiento son mínimos antes y después de aplicar el núcleo lineal personalizado, lo que valida aún más la precisión de la implementación.

eficaciaFLUX de 1,58 bits: como se muestra en la Figura 2, FLUX de 1,58 bits consigue mejoras significativas en el almacenamiento de modelos y la memoria de inferencia. En cuanto a la latencia de inferencia, como se muestra en la Tabla 3 a continuación, la mejora es especialmente significativa en GPU de bajo rendimiento pero fáciles de instalar, como L20 y A10.

Conclusión y debate

Este documento presenta FLUJO de 1,58 bitsEn el caso de 99.5%, el parámetro Transformer se cuantificó a 1,58 bits, y se consiguieron las siguientes mejoras personalizando el núcleo de cálculo:

- Reducción de las necesidades de almacenamientoReduce los requisitos de almacenamiento del modelo en un factor de 7,7.

- Memoria de inferencia reducidaReduce el uso de memoria de inferencia en más de 5,1 veces.

A pesar de conseguir estos efectos de compresión, el FLUX de 1,58 bits mostró un rendimiento comparable al modelo de precisión completa en las pruebas comparativas T2I, manteniendo una alta calidad visual. Se espera que FLUJO de 1,58 bits Ser capaz de motivar a las comunidades para que desarrollen modelos más adecuados para los dispositivos móviles.

Limitaciones actuales

Limitaciones en las mejoras de velocidad

- Aunque FLUX de 1,58 bits reduce el tamaño del modelo y el consumo de memoria, su mejora de la latencia es limitada debido a la falta de cuantificación del valor de activación y de optimizaciones más avanzadas del núcleo.

- Dados los resultados obtenidos hasta ahora, es de esperar que la comunidad se anime a desarrollar implementaciones personalizadas del núcleo para el modelo de 1,58 bits.

Sobre las limitaciones de la calidad visual

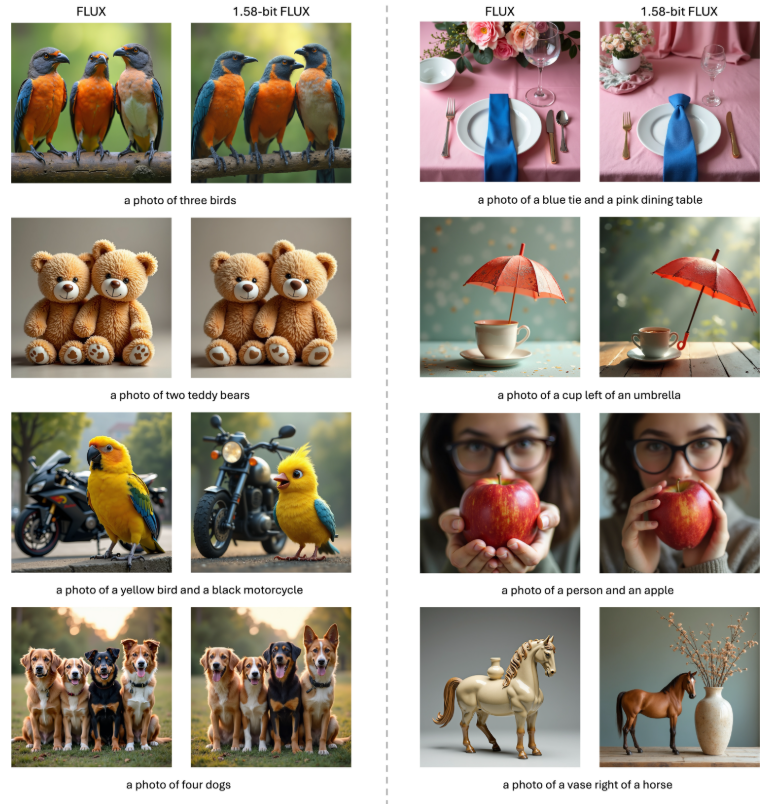

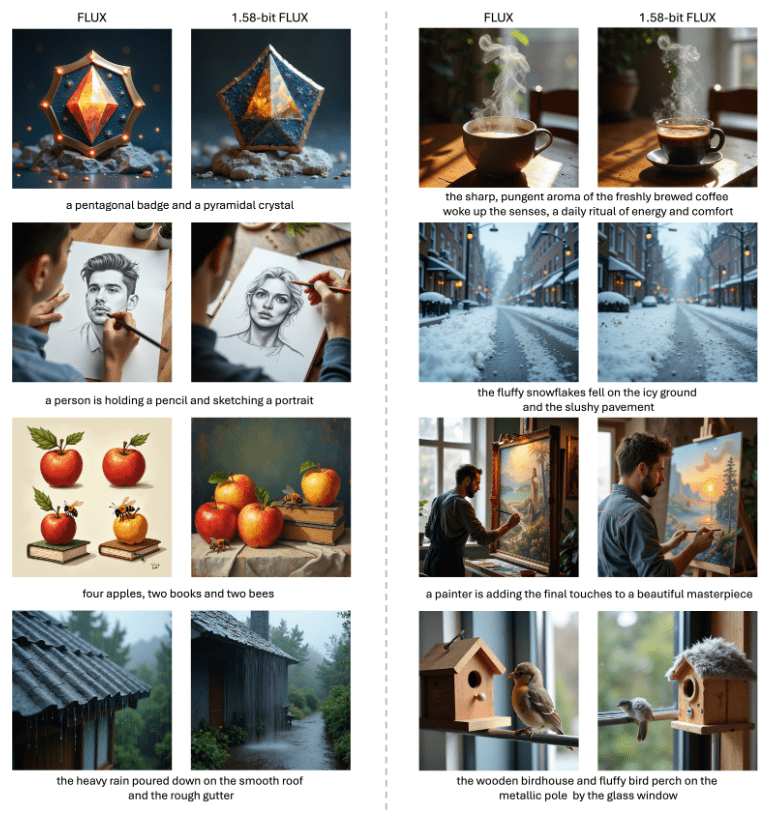

- Como se muestra en las figuras 1, 3 y 4, el FLUX de 1,58 bits produce imágenes vívidas y realistas que son muy coherentes con las señales textuales, pero sigue estando por detrás del modelo FLUX original en la representación de detalles de resolución ultraalta.

- Está previsto colmar esta laguna en futuros estudios.

- Comparación visual de FLUX con FLUX de 1,58 bits. FLUX de 1,58 bits demuestra una calidad de generación comparable a FLUX con cuantificación de 1,58 bits, donde 99,5% del parámetro 11,9B del transformador visual se limita a +1, -1 o 0. Por coherencia, todas las imágenes de cada comparación se generan utilizando la misma entrada de ruido latente. FLUX de 1,58 bits utiliza un núcleo personalizado de 1,58 bits. Por coherencia, todas las imágenes de cada comparación se han generado utilizando la misma entrada de ruido potencial. 1.58-bit FLUX utiliza un kernel personalizado de 1,58 bits.

Se publican los códigos de inferencia y las ponderaciones: https://github.com/Chenglin-Yang/1.58bit.flux

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...