Se demuestra que: la RL supera a la SFT en el aprendizaje de conocimientos generalizables, especialmente en tareas multimodales, mostrando mayores capacidades de razonamiento y reconocimiento visual.

breve

En el campo de la inteligencia artificial.modelo básico(por ejemplo, los modelos lingüísticos a gran escala y los modelos lingüísticos visuales) se han convertido en una fuerza central que impulsa el progreso tecnológico. Sin embargo, ¿cómo mejorar eficazmente loscapacidad de generalizaciónEl reto de adaptarse a la complejidad y variabilidad de los escenarios reales sigue siendo importante. Actualmente.Ajuste fino supervisado (SFT) y aprendizaje por refuerzo (RL)son dos métodos de post-entrenamiento ampliamente adoptados, pero sus funciones y efectos específicos en la mejora de la capacidad de generalización de los modelos siguen sin estar claros.

Esta tesis se apoya en unEstudio comparativo en profundidadExploramos sistemáticamente el impacto de la SFT y la RL en la capacidad de generalización del modelo subyacente. Nos centramos en los dos aspectos clave siguientes:

- Generalización textual basada en reglas: Hemos diseñado un sistema llamado GeneralPuntos de un juego de cartas de razonamiento aritmético que evalúa el rendimiento del modelo con distintas variantes de reglas.

- Generalización visual: Utilizamos el V-IRL un entorno de navegación basado en datos visuales reales, para comprobar la capacidad de adaptación del modelo a los cambios en los datos visuales.

A través de una serie deExperimentación y análisis rigurososllegamos a las siguientes conclusiones importantes:

- RL supera a SFT tanto en generalización de reglas como en generalización visual: La RL es capaz de aprender y aplicar nuevas reglas con eficacia, manteniendo un buen rendimiento en presencia de variaciones visuales de entrada. En cambio, la SFT tiende a memorizar los datos de entrenamiento y tiene dificultades para adaptarse a variantes no vistas.

- La RL mejora el reconocimiento visual: En el modelado del lenguaje visual (VLM), la RL no sólo mejora el razonamiento, sino que también mejora el reconocimiento visual, mientras que la SFT reduce el reconocimiento visual.

- El SFT es fundamental para la formación en RL: La SFT es un factor clave para el éxito del entrenamiento RL cuando el modelo troncal no tiene una buena capacidad de seguimiento de instrucciones. Estabiliza el formato de salida del modelo para que RL pueda aprovechar al máximo su rendimiento.

- Ampliar el número de iteraciones de verificación mejora la generalización de la RL: En el entrenamiento RL, aumentar el número de iteraciones de validación puede mejorar aún más la generalización del modelo.

Estos resultadosAporta valiosas ideas para la investigación y las aplicaciones futuras de la IA.En este estudio, se demuestra que la RL tiene más potencial en tareas multimodales complejas. Nuestro estudio no solo revela las diferentes funciones de SFT y RL, sino que también aporta nuevas ideas sobre cómo combinar estos dos enfoques de forma más eficaz para construir modelos subyacentes más potentes y fiables.

Tanto si es usted un investigador de IA, un ingeniero o un lector interesado en el futuro de la IA, este documento le proporcionará ideas y orientación práctica. Profundicemos en los misterios de la SFT y la RL para desvelar el camino crítico hacia la generalización del modelo subyacente.

Texto original:https://tianzhechu.com/SFTvsRL/assets/sftvsrl_paper.pdf

lectura rápida

1. RL supera a SFT en la generalización de reglas

Conclusión:

La RL es capaz de aprender y generalizar reglas basadas en texto de forma eficiente, mientras que la SFT tiende a memorizar los datos de entrenamiento y tiene dificultades para adaptarse a variantes de reglas no vistas.

Ejemplo:

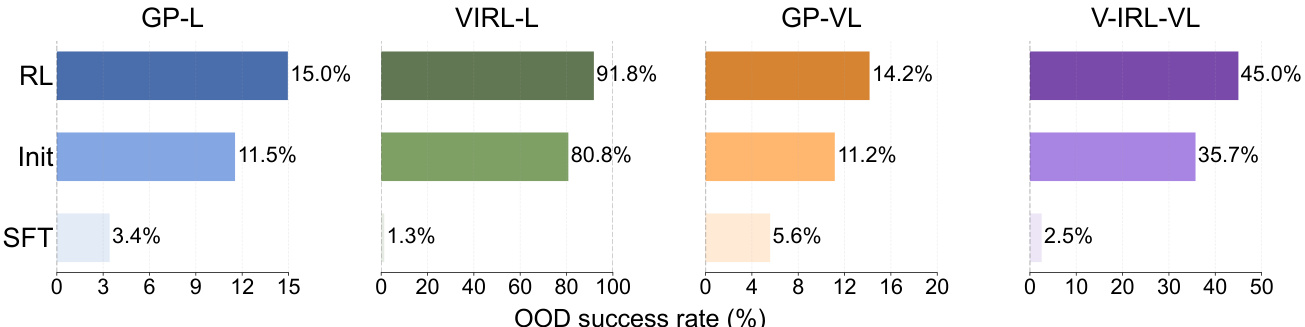

RL supera a SFT en rendimiento fuera de distribución (OOD) tanto en tareas GeneralPoints como V-IRL.

- Puntos Generales (GP-L):

- RL. La tasa de éxito fue de 15,01 TP3T, lo que supone un aumento con respecto a los 11,51 TP3T del control inicial. +3.5%.

- SFT. La tasa de éxito fue de 3,41 TP3T, lo que supone un descenso con respecto a los 11,51 TP3T del punto de control inicial. -8.1%.

- V-IRL (V-IRL-L):

- RL. La precisión por paso fue de 91,8%, lo que supone una mejora con respecto al punto de control inicial de 80,8%. +11.0%.

- SFT. La precisión por paso fue de 1,31 TP3T, frente a los 80,81 TP3T del punto de control inicial. -79.5%.

Figura 6: Para cada subgrafo, RL y SFT se entrenan utilizando la misma cantidad de cálculo, y su punto de control inicial compartido (etiquetado Init) se establece como línea de base. Véase el Apéndice C.3 para más detalles.

2. La RL también se generaliza en las tareas visuales de OOD, mientras que la SFT obtiene malos resultados.

Conclusión:

Incluso en tareas que contienen modalidades visuales, RL sigue siendo capaz de generalizar a variantes visuales no vistas, mientras que SFT sufre una degradación del rendimiento.

Ejemplo:

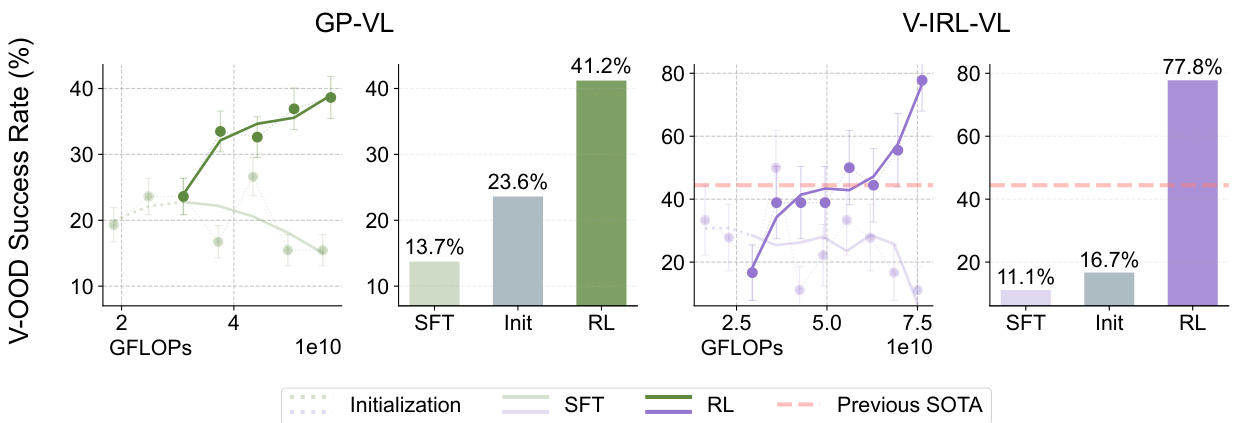

En las tareas GeneralPoints-VI y V-IRL-VL:

- Puntos Generales-VI (GP-VI):

- RL. La tasa de éxito fue de 41,21 TP3T, lo que supuso un aumento con respecto a los 23,61 TP3T del punto de control inicial. +17.6%.

- SFT. La tasa de éxito fue de 13,71 TP3T, por debajo de los 23,61 TP3T del control inicial. -9.9%.

- V-IRL-VL (V-IRL-VL):

- RL. La precisión por paso fue de 77,81 TP3T, lo que supone una mejora con respecto a los 16,71 TP3T del punto de control inicial. +61.1%.

- SFT. La precisión por paso fue de 11,11 TP3T, por debajo de los 16,71 TP3T del punto de control inicial. -5.6%.

Figura 7: De forma similar a las Figuras 5 y 6, mostramos la dinámica de rendimiento (mostrada como líneas) y el rendimiento final (mostrado como barras) evaluado fuera de la distribución visual. El estado de la técnica anterior en la prueba de referencia pequeña V- IRL VLN (Yang et al., 2024a) está marcado en naranja. Véase el apéndice C.3 para obtener información detallada sobre la configuración de la evaluación (y el suavizado de curvas).

3. RL mejora el reconocimiento visual de los VLM

Conclusión:

RL no sólo mejora la inferencia del modelo, sino que también mejora su reconocimiento visual, mientras que SFT reduce el reconocimiento visual.

Ejemplo:

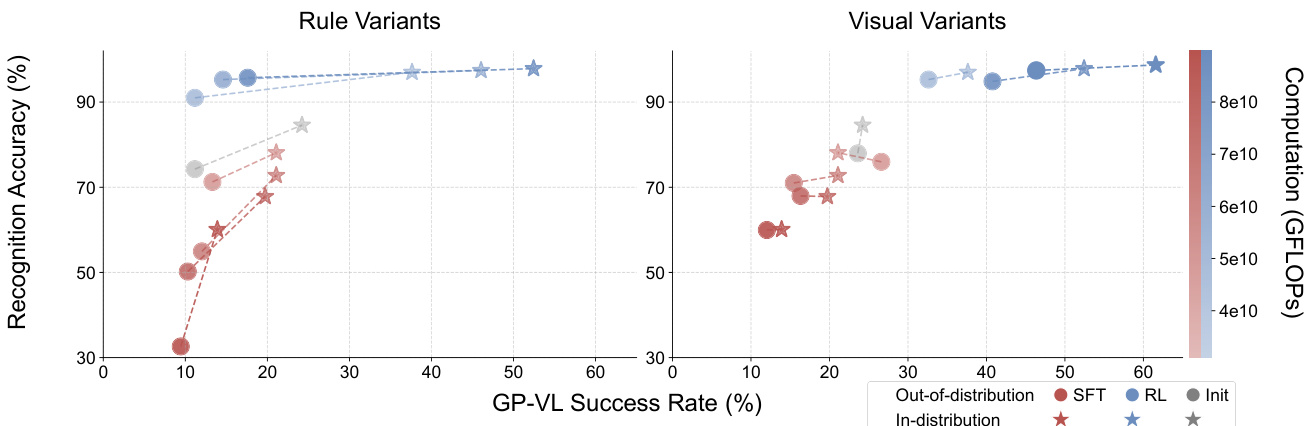

En la tarea GeneralPoints-VI:

- RL. A medida que aumenta la cantidad de cálculo de entrenamiento, mejoran tanto la precisión del reconocimiento visual como la tasa de éxito global.

- SFT. A medida que aumenta la cantidad de cálculo de entrenamiento, disminuyen tanto la precisión del reconocimiento visual como la tasa global de éxito.

Figura 8: Comparación de la tasa de reconocimiento y la tasa de éxito del aprendizaje por refuerzo (RL) y el ajuste fino supervisado (SFT) con distintas variantes de GP-VL. Los gráficos muestran el rendimiento de la tasa de reconocimiento (eje y) y la tasa de acierto en una sola pantalla (eje x), correspondientes a datos dentro de la distribución (rojo) y datos fuera de la distribución (azul), respectivamente. La transparencia de los puntos de datos (barras de color) representa la cantidad de cálculo de entrenamiento. Los pares de datos conectados por líneas (⋆-◦ ) se evalúan utilizando los mismos puntos de control. Los resultados muestran que el aprendizaje por refuerzo (RL) mejora tanto en tasa de reconocimiento como en precisión global a medida que aumenta la cantidad de cálculo posterior al entrenamiento, mientras que el ajuste fino supervisado (SFT) muestra la tendencia opuesta.

Figura 8: Comparación de la tasa de reconocimiento y la tasa de éxito del aprendizaje por refuerzo (RL) y el ajuste fino supervisado (SFT) con distintas variantes de GP-VL. Los gráficos muestran el rendimiento de la tasa de reconocimiento (eje y) y la tasa de acierto en una sola pantalla (eje x), correspondientes a datos dentro de la distribución (rojo) y datos fuera de la distribución (azul), respectivamente. La transparencia de los puntos de datos (barras de color) representa la cantidad de cálculo de entrenamiento. Los pares de datos conectados por líneas (⋆-◦ ) se evalúan utilizando los mismos puntos de control. Los resultados muestran que el aprendizaje por refuerzo (RL) mejora tanto en tasa de reconocimiento como en precisión global a medida que aumenta la cantidad de cálculo posterior al entrenamiento, mientras que el ajuste fino supervisado (SFT) muestra la tendencia opuesta.

4. El SFT es necesario para la formación en RL

Conclusión:

La SFT es necesaria para el entrenamiento de la RL cuando el modelo troncal no tiene un buen seguimiento de órdenes.

Ejemplo:

Todos los experimentos en los que se aplicó directamente RL de extremo a extremo a Llama-3.2 post-entrenamiento sin inicialización SFT acabaron en fracaso.

- Casos prácticos de fracaso:

- El modelo genera respuestas largas, digresivas y desestructuradas que no consiguen recuperar la información y las recompensas asociadas al entrenamiento de RL.

- Por ejemplo, el modelo intenta resolver el juego de 24 puntos escribiendo código, pero no consigue completar la generación de código, lo que da lugar a un fallo de validación.

![]()

Figura 20: Registramos las respuestas de los modelos utilizando señales similares a las mostradas en la Figura 11. Los resultados muestran que Llama-3.2-Vision-11B no sigue correctamente las instrucciones. Omitimos las respuestas largas que intentaban resolver el rompecabezas mediante código, pero que no lograban completarlo dentro de la longitud limitada del contexto.

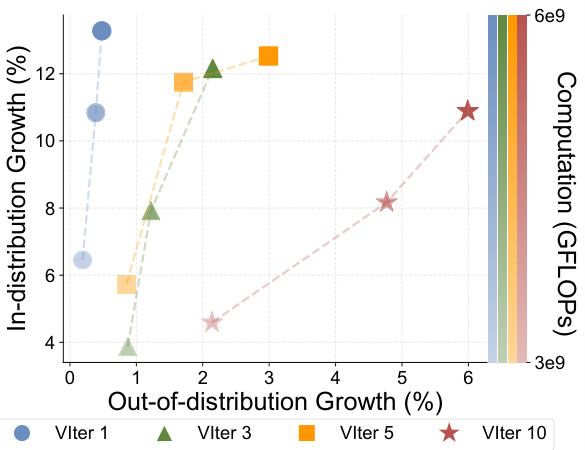

5. Ampliar el número de iteraciones de validación mejora la capacidad de generalización de RL

Conclusión:

En el entrenamiento RL, aumentar el número de iteraciones de validación mejora la generalización del modelo.

Ejemplo:

En la tarea GeneralPoints-Language (GP-L):

- 1 iteración de validación. El rendimiento de OOD sólo mejora +0.48%.

- 3 iteraciones de validación. Se mejora el rendimiento de la OOD +2.15%.

- 5 iteraciones de validación. Se mejora el rendimiento de la OOD +2.99%.

- 10 iteraciones de validación. Se mejora el rendimiento de la OOD +5.99%.

Figura 10: Registramos experimentos de RL con un número variable de iteraciones de validación (VIter) como forma de escalar la cantidad de cálculo de entrenamiento (transparencia de color).

6. La SFT se adapta en exceso a los marcadores de inferencia e ignora los de reconocimiento

Conclusión:

La SFT tiende a sobreajustarse a los marcadores inferidos y a infraajustarse a los marcadores identificados, posiblemente debido a la alta frecuencia de marcadores inferidos.

Ejemplo:

En la tarea GeneralPoints-VI, la SFT no pudo lograr un rendimiento intra-distribución comparable al de la RL, incluso después de ajustar los hiperparámetros.

- Estudio de ablación SFT.

- Tras ajustar la tasa de aprendizaje y otros componentes ajustables, ninguna de las tasas de éxito de la SFT superó los 30% y no mostraron ninguna tendencia al alza.

Figura 16: Estudio de ablación de GeneralPoints-VL SFT. Realizamos experimentos de ablación sobre la tasa de aprendizaje e informamos de la tasa de éxito dentro de la distribución, en una sola pantalla (%) para todos los experimentos. Ninguno de los experimentos tuvo tasas de éxito superiores a 30% y no mostraron una tendencia creciente.

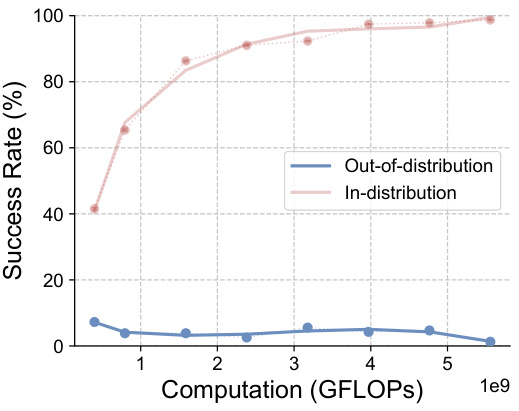

7. RL no puede recuperar el rendimiento OOD de los puntos de control de sobreajuste

Conclusión:

Cuando se inicializó a partir de un punto de control sobreajustado, RL fue incapaz de recuperar el rendimiento OOD del modelo.

Ejemplo:

En la tarea V-IRL-VL:

- RL Inicialización a partir de puntos de control sobreajustados: la

- La precisión inicial por paso es inferior a 1% y RL no puede mejorar el rendimiento OOD.

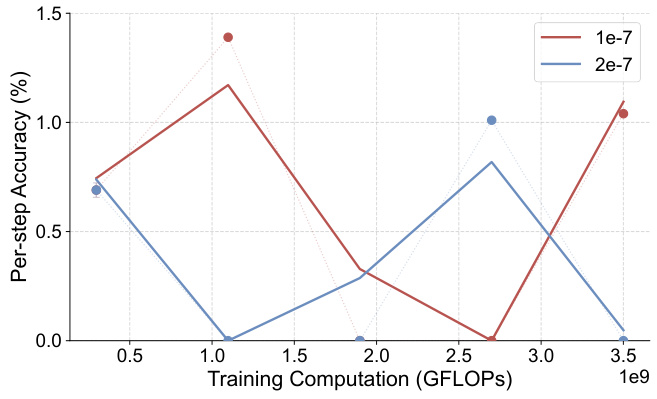

Figura 19: Precisión de un solo paso fuera de distribución (%) - GFLOPs: modelo V-IRL-VL bajo variantes regulares (utilizando puntos de control iniciales sobreajustados). Véanse los detalles de las métricas de evaluación en el Apéndice C.3.

resúmenes

Mediante una serie de experimentos y análisis, esta tesis demuestra las ventajas de la RL en el aprendizaje de conocimientos generalizables, y la tendencia de la SFT a favorecer la memorización de los datos de entrenamiento. La tesis también destaca la importancia de la SFT para el entrenamiento de la RL y el impacto positivo de ampliar el número de iteraciones de validación en la capacidad de generalización de la RL. Estos resultados aportan información valiosa para construir modelos base más sólidos y fiables en el futuro.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...