El futuro ya está aquí: una mirada en profundidad a la era del "modelo como producto

En los últimos años se ha debatido sin cesar sobre la próxima fase de desarrollo de la IA: ¿agencialización? ¿Mayores capacidades de razonamiento? ¿O una verdadera fusión multimodal? Han surgido todo tipo de especulaciones, señal de un nuevo cambio en el campo de la IA.

Creo que ha llegado el momento de emitir un juicio definitivo:Ha llegado la era del "modelo como producto". No se trata sólo de una tendencia, sino de una visión profunda del panorama actual del desarrollo de la IA.

Tanto si se trata de la vanguardia de la investigación académica como de la dirección real del mercado comercial, todas las señales apuntan claramente en esta dirección transformadora.

- La ampliación del modelo genérico está experimentando cuellos de botella: El modelo de desarrollo "cuanto más grande, mejor" del gran modelo genérico está revelando poco a poco sus limitaciones. No se trata sólo de un reto técnico, sino también de una consideración de rentabilidad. Como ha puesto de manifiesto el debate del sector tras la GPT-4, la relación entre el aumento de la capacidad de los modelos y el incremento de los costes aritméticos no es simplemente lineal, sino que se trata de una brecha en tijera cada vez mayor. Puede que la potencia de los modelos sólo crezca a un ritmo lineal, pero el coste de formación y funcionamiento de estos behemoths sube exponencialmente. Incluso empresas con tanta tecnología y recursos como OpenAI, por no hablar de otros proveedores, están luchando por encontrar un modelo de negocio que pueda cubrir su enorme inversión. Esto indica que la era de confiar únicamente en la ampliación del tamaño de los parámetros del modelo para mejorar infinitamente las capacidades de la IA puede haber llegado a su fin. Tenemos que encontrar vías más eficientes, rentables y sostenibles para el desarrollo de la IA.

- La formación para la orientación ha surgido como una nueva fuerza, con resultados que superan con creces las expectativas: En marcado contraste con el atrofiado desarrollo de los modelos genéricos, la"Formación de opinión". muestra un potencial asombroso. Este paradigma de formación hace hincapié en la puesta a punto y el entrenamiento de modelos para tareas y escenarios de aplicación específicos. La convergencia de las técnicas de aprendizaje por refuerzo y razonamiento ha revigorizado la formación específica. En lugar de limitarse a "aprender los datos", los modelos empiezan a "aprender la tarea". Se trata de un salto cualitativo que marca un cambio en la forma de concebir la IA. Ya se trate del asombroso rendimiento de los modelos pequeños en matemáticas, de la evolución de los modelos de código de generadores de código a gestores autónomos de bases de código, o del Claude Los casos en los que se juega a juegos complejos con una aportación de información casi nula son una prueba del poder del entrenamiento de orientación. Esta vía de desarrollo de modelos "pequeños pero finos" y "especializados pero fuertes" puede convertirse en la corriente principal de las futuras aplicaciones de IA.

- Los costes de inferencia de modelos caen en picado: El coste del razonamiento, que antes se consideraba un "obstáculo" para la adopción de la IA, también se ha aliviado en gran medida. Gracias a DeepSeek los avances en la optimización de modelos y la aceleración de la inferencia por parte de empresas como AI, el umbral de implantación y adopción de modelos de IA se ha reducido drásticamente. Las últimas investigaciones de DeepSeek muestran que la capacidad de cálculo de las GPU existentes puede dar cabida, en teoría, a miles de millones de personas en todo el mundo, cada una de ellas utilizando modelos de última generación para procesar 10.000 modelos de IA al día. fichas Las necesidades de los Esto significa que la aritmética ya no es un factor clave que restrinja la popularidad de la IA, y que la era de la aplicación a gran escala de la IA se está acelerando. Para los proveedores de modelos, confiar únicamente en el modelo de negocio de "pago por uso" de la venta de tokens no es suficiente para explotar plenamente el valor de los modelos de IA. Deben mirar hacia el extremo superior de la cadena de valor, como ofrecer servicios y soluciones de modelos más verticales y especializados.

Todos estos signos indican que el foco de desarrollo de la industria de la IA está pasando de un "modelo general" a un nuevo paradigma de "modelo como producto". No se trata solo de un ajuste técnico, sino también de un profundo cambio en el modelo empresarial y el patrón industrial. Puede que haya que revisar la filosofía tradicional de "las aplicaciones son las reinas". Durante mucho tiempo, los inversores y empresarios se han centrado en la capa de aplicación de la IA, creyendo que la innovación en las aplicaciones es la clave de la comercialización de la IA. Sin embargo, en la era del "modelo como producto", la capa de aplicación puede ser la primera en ser automatizada y perturbada. En el futuro, la competición se centrará en los propios modelos, y quien tenga modelos más avanzados, más eficaces y más profesionales podrá hacerse con el primer puesto en la competición de IA.

La forma de los futuros modelos: especialización, verticalización, prestación de servicios

En las últimas semanas, hemos visto surgir dos productos emblemáticos del paradigma "modelo como producto": DeepResearch de OpenAI y Antrópico El Sonnet Claude 3.7. Ambos productos reflejan las tendencias de la nueva generación de modelos y son un presagio de cómo pueden ser los modelos del futuro.

DeepResearch de OpenAI, que ha generado mucha atención desde su lanzamiento, ha ido acompañado de muchas interpretaciones erróneas. Muchos lo han interpretado simplemente como una aplicación "shell" de GPT-4, o una herramienta de mejora de la búsqueda basada en GPT-4. Pero eso está muy lejos de la realidad. En realidad, OpenAI entrena un modelo completamente nuevo específico para tareas de investigación y recuperación de información. DeepResearch no es un "flujo de trabajo" que dependa de motores de búsqueda externos o de llamadas a herramientas, sino una verdadera "Modelo lingüístico de investigación".Cuenta con capacidades autónomas de búsqueda, navegación, integración de información y generación de informes de extremo a extremo sin ninguna intervención externa. Dispone de capacidades autónomas de búsqueda, navegación, integración de información y generación de informes de extremo a extremo sin ninguna intervención externa. Cualquiera que haya utilizado DeepResearch puede notar claramente la diferencia con los LLM o chatbots tradicionales. Los informes que genera están claramente estructurados, rigurosamente argumentados y son trazables de forma fiable, lo que refleja una profesionalidad y profundidad que supera con creces la de las herramientas de búsqueda y los LLM tradicionales.

En cambio, otros productos del mercado que dicen ser "Deep Search" como Perplejidad y las funcionalidades relacionadas de Google palidecen en comparación. Como señala Hanchung Lee, estos productos siguen basándose esencialmente en un modelo genérico con algunos ajustes simples y superposiciones de funciones, y carecen de una optimización profunda y un diseño sistemático para la tarea de búsqueda. La aparición de DeepResearch marca el aterrizaje inicial del concepto de "modelo como producto", y también nos muestra la dirección de desarrollo de modelos especializados y verticalizados.

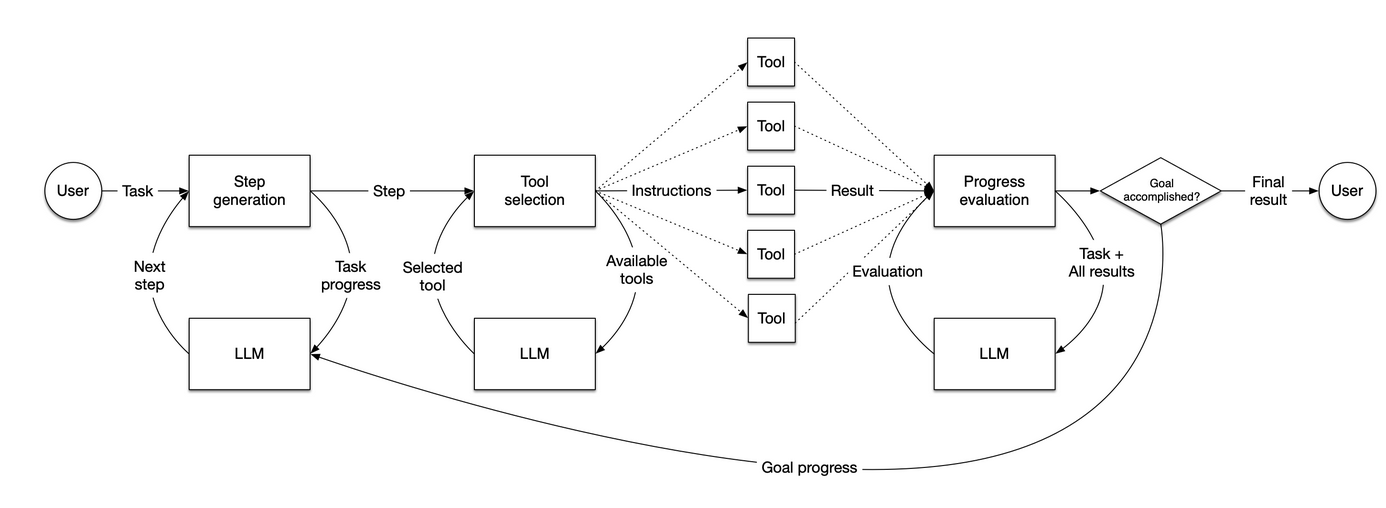

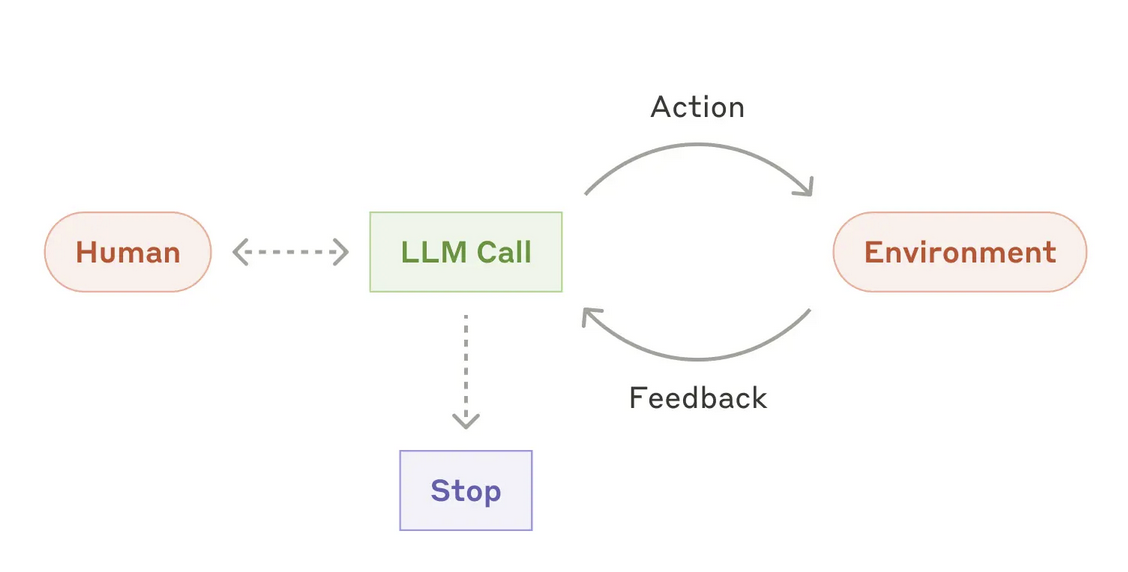

Anthropic también persigue activamente una estrategia de "modelo como producto" y ha aportado ideas sobre los modelos de agente. En diciembre del año pasado publicaron un artículoinforme de investigaciónAnthropic ha redefinido el modelo de Agente. Según Anthropic, un verdadero modelo de Agente debería tener "Autonomía".que es capaz de completar la tarea objetivo de forma independiente, y no sólo como un eslabón en el flujo de trabajo. Al igual que DeepResearch, Anthropic hace hincapié en que los modelos de agente deben ser "Internamente" Completar todo el proceso de ejecución de tareas, incluida la planificación dinámica del flujo de tareas, la selección autónoma y la invocación de herramientas, etc., en lugar de depender de rutas de código predefinidas y orquestación externa.

En el mercado actual está surgiendo un gran número de empresas emergentes de agentes, pero la mayoría de los "agentes" que están construyendo siguen estancados en la "Flujo de trabajo Nivel. Estos "agentes" son esencialmente una serie de flujos de código predefinidos que enlazan LLM y diversas herramientas para realizar tareas en un número fijo de pasos. Este enfoque de "pseudoagente", aunque puede tener cierto valor en determinados verticales, sigue estando muy lejos del enfoque de "agente real" definido por Anthropic y OpenAI. Los sistemas verdaderamente autónomos deben remodelarse e innovar a nivel de modelo para dar un salto cualitativo.

El lanzamiento de Anthropic Claude 3.7 es una prueba más de la tendencia "modelo como producto". Claude 3.7 es un modelo profundamente optimizado para escenarios de código complejos. Claude 3.7 demuestra un excelente rendimiento en la generación, comprensión y edición de código. Es especialmente destacable que incluso un modelo como Devin Un flujo de trabajo "programador de IA" tan complejo e inteligente, impulsado por Claude 3.7, también fue capaz de lograr mejoras significativas en las pruebas de referencia SWE. Esto sugiere que es la potencia del propio modelo la clave para crear grandes aplicaciones. En lugar de dedicar mucho esfuerzo a diseñar flujos de trabajo complejos y herramientas externas, los recursos deberían invertirse en el desarrollo y la optimización del propio modelo.

El equipo Pleias de RAG La exploración del ámbito de la Generación Mejorada de Recuperación (GAR) también refleja la idea de "modelo como producto". Los sistemas RAG tradicionales suelen estar compuestos por múltiples flujos de trabajo independientes y acoplados, como el enrutamiento de datos, la fragmentación de textos, la reordenación de resultados, la comprensión de consultas, la expansión de consultas, la fusión de contextos, la optimización de búsquedas, etc. La falta de integración orgánica entre estos enlaces conduce a una alta vulnerabilidad y a elevados costes de mantenimiento y optimización. La falta de integración orgánica entre estos eslabones provoca una gran vulnerabilidad del sistema y elevados costes de mantenimiento y optimización. El equipo de Pleias está intentando utilizar las últimas técnicas de formación para integrar los distintos aspectos del sistema GAR. "Modelización"El GAR tiene dos modelos principales: uno para el preprocesamiento de datos y la construcción de la base de conocimientos, y otro para la recuperación de información, la generación de contenidos y la salida de informes. Estos dos modelos colaboran entre sí para completar todas las tareas del proceso de la RAG. Esta solución, que requiere un nuevo diseño de la arquitectura del modelo, un canal de datos sintéticos perfeccionado y una función de recompensa de aprendizaje por refuerzo personalizada, constituye una auténtica innovación tecnológica y un gran avance en la investigación. La "modelización" del sistema GAR permite simplificar enormemente la arquitectura del sistema, mejorar su rendimiento y estabilidad, reducir los costes de despliegue y mantenimiento y hacer realidad la aplicación a escala de la tecnología GAR.

En pocas palabras, el concepto básico de "modelo como producto" es que "Desplazar la complejidad". Los problemas complejos que originalmente deben resolverse en la capa de aplicación se procesan y digieren por adelantado en el nivel del modelo mediante el entrenamiento del mismo. El modelo aprende y se adapta a diversos escenarios complejos y situaciones extremas por adelantado durante la fase de entrenamiento, con lo que el despliegue y la aplicación del modelo resultan más sencillos y eficientes. En el futuro, el valor fundamental de los productos de IA residirá más en el propio modelo que en las funciones extravagantes y los flujos de trabajo complejos de la capa de aplicación. Los formadores de modelos se convertirán en los actores dominantes en la creación y captura de valor. El objetivo de Anthropic Claude es perturbar y sustituir los actuales sistemas de "pseudoagentes" basados en flujos de trabajo, como el marco de agentes subyacente proporcionado por LlamaIndex. Quieren hacer posibles aplicaciones de IA más inteligentes, autónomas y fáciles de usar con modelos más potentes.

se sustituirá por una arquitectura de modelización más avanzada, como se describe a continuación:

Sobrevivir en la era del "modelo como producto": ¿desarrollar su propio modelo o ser engullido por él?

Una vez más, la ubicación estratégica de los grandes laboratorios de IA no es una "operación encubierta", sino clara y abierta. Aunque en algunos aspectos sus estrategias puedan parecer poco transparentes, sus intenciones fundamentales están claras: Empezarán por la capa del modelo y penetrarán hacia arriba hasta la capa de la aplicación para construir productos y servicios de IA de extremo a extremo y tratar de dominar la cadena de valor. Las implicaciones empresariales de esta tendencia son de gran alcance. Naveen Rao, vicepresidente de Gen AI en Databricks, da en el clavo:

En los próximos 2-3 años, todos los proveedores de modelos de IA de código cerrado dejarán gradualmente de vender directamente interfaces API. Sólo los modelos de código abierto seguirán prestando servicios a través de API. El objetivo de los proveedores de modelos de código cerrado es crear capacidades de IA no genéricas y singularmente competitivas y, para poder ofrecerlas, necesitan crear la experiencia de usuario y la interfaz de aplicación definitivas. El producto de IA del futuro ya no será sólo el modelo en sí, sino una aplicación completa que integre el modelo, la interfaz de la aplicación y funciones específicas.

Esto significa que el periodo de luna de miel de la "división del trabajo" entre los proveedores de modelos y los desarrolladores de aplicaciones ha llegado a su fin. Los desarrolladores de aplicaciones, especialmente las empresas "envoltorio" que dependen de API de modelos de terceros para crear aplicaciones, se enfrentan a retos sin precedentes para su supervivencia. En el futuro, el panorama competitivo de la industria de la IA puede evolucionar en las siguientes direcciones:

- Los proveedores de modelos desarrollan sus propias aplicaciones para captar cuota de mercado: Código Claude y DeepSearch han señalado que los proveedores de modelos están ampliando activamente sus áreas de aplicación. DeepSearch no tiene una interfaz API abierta, pero está integrada en el servicio de suscripción premium de OpenAI como una función básica que aumenta el valor del servicio. Claude Code es una herramienta ligera de integración de extremos que permite a los desarrolladores utilizar modelos Claude 3.7 directamente en un editor de código. Estos movimientos indican que los proveedores de modelos están acelerando la construcción de sus propios ecosistemas de aplicaciones para prestar servicios directamente a los usuarios y captar cuota de mercado. Cabe señalar que algunas envolturas de aplicaciones, como Cursor, han experimentado una degradación del rendimiento y una pérdida de usuarios cuando se han conectado al modelo Claude 3.7. Esto apoya aún más la idea de que el modelo es el producto. Esto corrobora la idea de que el modelo es el producto: Un verdadero agente de IA se preocupa por maximizar las capacidades propias del modelo en lugar de acomodarse y adaptarse a los flujos de trabajo existentes.

- Transformación de la envoltura de la aplicación, centrada en la autoinvestigación de modelos: Ante el "golpe descendente" de los proveedores de modelos, algunos envoltorios de aplicaciones de cabecera, han empezado a buscar activamente la transformación, tratando de construir sus propias capacidades de formación de modelos. A pesar de su tardío comienzo y de su relativa debilidad en la formación de modelos, estas empresas están sentando activamente las bases. Cursor, por ejemplo, hace hincapié en el valor de sus modelos de autocompletado de código pequeño; WindSurf dispone de un modelo de código propio de bajo coste, Codium; Perplexity confía desde hace tiempo en un clasificador propio para el enrutamiento del tráfico y ha empezado a entrenar su propia variante de DeepSeek para mejorar las búsquedas. Estos movimientos demuestran que los envoltorios de aplicaciones se han dado cuenta de que es difícil confiar únicamente en el modelo de "llamada a la API" para hacerse un hueco en la futura competencia, y que deben dominar ciertas capacidades de autodesarrollo del modelo para seguir siendo competitivos.

- La innovación en la interfaz de usuario puede ser la clave para abrirse camino: Para el gran número de pequeños y medianos envoltorios de aplicaciones, el margen de supervivencia será aún más estrecho en el futuro. Si los grandes laboratorios modelo reducen sus servicios API de forma generalizada, estos pequeños wrappers podrían verse obligados a recurrir a proveedores de servicios de razonamiento de terceros más neutrales. Con la convergencia de las capacidades de los modelos, la innovación en la interfaz y la experiencia del usuario puede convertirse en la clave para que los pequeños envasadores se abran paso. Durante mucho tiempo se ha subestimado gravemente el valor de la interfaz de usuario en el ámbito de la IA. A medida que los modelos genéricos se hacen más potentes y los procesos de despliegue y aplicación de modelos se racionalizan cada vez más, laUna interfaz de usuario excelente será el factor clave para aumentar la competitividad del producto y atraer a los usuarios. Especialmente en escenarios de aplicación como el GAR, la capacidad del modelo puede dejar de ser el factor decisivo, y la facilidad de uso, la interactividad y la experiencia del usuario, cobrarán mayor importancia.

En resumen, para la mayoría de los envoltorios de aplicaciones, el futuro plantea un dilema: O te transformas en formador de modelos (Training) o acabas siendo engullido por el dueño de los modelos (Being Trained On). En la actualidad, todo el trabajo realizado por estos envoltorios de aplicaciones se ha convertido, en cierto modo, en "investigación de mercado gratuita" y "etiquetado de datos gratuito" para los grandes laboratorios de modelos. En efecto, todos los datos sobre la interacción de los usuarios y las reacciones de éstos terminan llegando a los proveedores de modelos para ayudarles a mejorarlos, optimizar sus productos y reforzar su posición en el mercado.

La futura dirección de los envoltorios de aplicaciones también depende en gran medida de las actitudes y percepciones de los inversores. Preocupantemente, el clima de inversión actual parece estar algo "sesgado" en contra del espacio de formación de modelos. Muchos inversores siguen aferrados al concepto tradicional de "la aplicación es el rey" y no reconocen el valor y el potencial de la formación de modelos. Este "desajuste" de la inversión puede obstaculizar el desarrollo saludable de la tecnología de IA, e incluso hacer que la industria occidental de IA se quede rezagada en la competencia futura. Es posible que, como consecuencia de ello, algunos envoltorios de aplicaciones también tengan que "ocultar" sus esfuerzos en la formación de modelos para no ser malinterpretados por los inversores. Las miniaturas de Cursor y Codium, por ejemplo, han carecido hasta ahora de la publicidad y promoción adecuadas. Esta orientación de la inversión "centrada en las aplicaciones pero no en los modelos" debe suscitar una profunda reflexión y vigilancia en el sector.

El infravalorado aprendizaje por refuerzo: la clave de la futura competencia de la IA

En el espacio actual de inversión en IA, existe una "El aprendizaje por refuerzo no tenía precio". El fenómeno. Detrás de este fenómeno está el sesgo cognitivo de la comunidad inversora hacia la tendencia de desarrollo de la tecnología de IA y su descuido de la importancia estratégica de la tecnología de aprendizaje por refuerzo.

Las decisiones de inversión de las sociedades de capital riesgo en IA suelen basarse en varios supuestos:

- La capa de aplicación es el bolsillo de valor, la capa de modelo es sólo la infraestructura: En general, los inversores creen que el valor real de la IA se refleja en la capa de la aplicación, y la innovación de la aplicación es la clave para perturbar el mercado existente. La capa del modelo es solo una infraestructura que proporciona interfaces API y no tiene competitividad básica.

- Los precios de las API de modelos seguirán bajando y las envolturas de aplicaciones seguirán beneficiándose: Los inversores esperan que los proveedores de modelos sigan reduciendo el precio de las llamadas a las API para ganar cuota de mercado, impulsando así la rentabilidad de los envoltorios de aplicaciones.

- La API del modelo de código cerrado es suficiente para todas las aplicaciones: Los inversores creen que las aplicaciones creadas a partir de modelos de API de código cerrado pueden satisfacer las necesidades de una amplia gama de escenarios, incluso en sectores sensibles con elevados requisitos de seguridad de datos y autonomía.

- La formación de modelos es una gran inversión, de ciclo largo y alto riesgo, por lo que es mejor comprar API directamente: Los inversores suelen creer que crear capacidades de formación de modelos es una inversión "ingrata". La formación de modelos requiere enormes cantidades de capital, ciclos largos y umbrales técnicos elevados, y el riesgo es mucho mayor que adquirir directamente API de modelos y desarrollar rápidamente aplicaciones.

Sin embargo, estos supuestos son cada vez más insostenibles en el contexto de la era del "modelo como producto". Me preocupa que si la comunidad inversora sigue aferrándose a estas nociones anticuadas, pueda perder oportunidades estratégicas para el desarrollo de la IA e incluso provocar una mala asignación de los recursos del mercado. El actual auge de la inversión en IA podría convertirse en una "apuesta arriesgada", un "fallo del mercado que no evalúa con precisión los últimos avances tecnológicos (especialmente el aprendizaje por refuerzo)".

Los fondos de capital riesgo (CR), que supuestamente buscan invertir en una cartera de "Sin correlación"El objetivo de las sociedades de capital riesgo no es batir al índice S&P500. El objetivo de una sociedad de capital riesgo no es batir al índice S&P500, sino construir una cartera diversificada que reduzca el riesgo global y garantice que algunas inversiones sigan dando sus frutos durante los ciclos bajistas. Formación de modelos, que encaja en el perfil de la inversión "no correlacionada". En un contexto de riesgos de recesión en las principales economías occidentales, el campo de la formación de modelos de IA, que alberga un enorme potencial de innovación y crecimiento, está poco correlacionado con los ciclos macroeconómicos. Sin embargo, las empresas modelo de formación suelen tener dificultades de financiación, lo que es contrario a la lógica esencial del capital riesgo. Prime Intellect es una de las pocas startups occidentales de formación de modelos de IA con potencial para convertirse en un laboratorio de IA de vanguardia. A pesar de sus avances tecnológicos, incluida la formación del primer LLM descentralizado, su escala de financiación es comparable a la de una empresa de aplicaciones "fantasma" ordinaria. Este fenómeno del "dinero malo que expulsa al dinero bueno" invita a la reflexión.

Con la excepción de algunos grandes laboratorios, el ecosistema actual de formación de modelos de IA sigue siendo muy frágil y marginal. A escala mundial, sólo hay un puñado de empresas innovadoras centradas en la formación de modelos. Prime Intellect, Moondream, Arcee, Nous, Pleias, Jina, el equipo de preentrenamiento de HuggingFace (que es muy pequeño) y otros conforman casi la totalidad del espacio de entrenamiento de modelos de IA de código abierto. Junto con un puñado de instituciones académicas como Allen AI, EleutherAI, etc., están construyendo y manteniendo las piedras angulares de la actual infraestructura de formación de IA de código abierto. En Europa, me enteré de que hay 7-8 proyectos LLM que planean entrenar modelos basados en el corpus Common Corpus y en las herramientas de preentrenamiento desarrolladas por el equipo Pleias. La próspera comunidad de código abierto ha compensado en cierta medida la falta de inversión comercial, pero también se ha esforzado por llegar a la raíz de los retos a los que se enfrenta el ecosistema de formación de modelos.

OpenAI también parece ser muy consciente de la importancia de la "RL vertical". Recientemente, se ha informado de que los ejecutivos de OpenAI han expresado su descontento con el panorama de las nuevas empresas de Silicon Valley, que es "ligero en RL y pesado en aplicaciones". Presumiblemente, este mensaje procede del propio Sam Altman, y puede que se refleje en el próximo YC Startup Camp. Esto indica un posible cambio en la estrategia de colaboración de OpenAI. En el futuro, es posible que los socios de OpenAI ya no sean sólo clientes de API, sino "cocontratantes" que participen en las primeras fases de formación de los modelos. El entrenamiento de modelos, que pasará de estar entre bastidores a ocupar el primer plano, se convertirá en un aspecto central de la competición de IA.

La era del "modelo como producto" implica un cambio de paradigma en la innovación de la IA. La era de la lucha en solitario ha terminado, la cooperación abierta y la innovación colaborativa se convertirán en la corriente dominante. Los dominios de búsqueda y código son los primeros en lograr el "modelo como producto", en gran parte debido a la relativa madurez de los escenarios de aplicación en estos dos dominios, la clara demanda del mercado y el claro camino tecnológico, que facilita "recoger la fruta madura" rápidamente. Como Cursor Estos productos innovadores pueden iterarse rápidamente y lanzarse al mercado en pocos meses. Sin embargo, los escenarios de aplicación de la IA de mayor valor para el futuro, como la mejora inteligente de los sistemas basados en reglas, se encuentran aún en una fase temprana de exploración, con enormes retos técnicos y una demanda del mercado incierta, lo que dificulta la consecución de avances de forma "corta, media y rápida". Se trata de áreas que requieren pequeños equipos con formación interdisciplinar y un alto grado de concentración para inversiones en I+D a largo plazo y en profundidad. Estos "pequeños y bellos" equipos de innovación pueden convertirse en una fuerza importante en la industria de la IA en el futuro, y pueden ser adquiridos por grandes empresas tecnológicas para materializar su valor tras completar su acumulación tecnológica inicial. Un modelo similar de colaboración podría surgir en el espacio de la interfaz de usuario (IU). Algunas empresas centradas en la innovación de la interfaz de usuario podrían crear productos de IA diferenciados y competitivos estableciendo asociaciones estratégicas con grandes laboratorios de modelos para obtener acceso exclusivo a la API de modelos especializados de código cerrado.

La disposición estratégica de DeepSeek es sin duda más previsora y ambiciosa en la tendencia "modelo es producto". El objetivo de DeepSeek no es sólo "modelo como producto", sino "modelo como capa de infraestructura común". Al igual que OpenAI y Anthropic, el fundador de DeepSeek, Wenfeng Lien, ha expuesto públicamente su visión de DeepSeek:

Creemos que la fase actual es Una explosión de innovación tecnológica, no de aplicacionesDeepSeek es la única empresa que tiene la capacidad de hacerlo. Sólo cuando se establezca un ecosistema industrial completo de IA ascendente y descendente, DeepSeek no tendrá que hacer la aplicación por sí misma. Por supuesto, si es necesario, DeepSeek también puede hacer aplicaciones, pero no es una prioridad. La estrategia central de DeepSeek ha sido siempre la adhesión a la innovación tecnológica y la construcción de una potente plataforma de infraestructura común de IA.

En la era del "modelo como producto", limitar nuestra atención a la capa de aplicación equivale a "Utilizar a los generales de la última generación de guerra para comandar la próxima generación de guerra".Lo preocupante es que la industria occidental de la IA parece seguir inmersa en la vieja mentalidad de "la aplicación es el rey". Lo preocupante es que la industria occidental de la IA parece seguir inmersa en la vieja mentalidad de "la aplicación es el rey" y carece de conocimientos y preparación suficientes para las nuevas tendencias de desarrollo de la IA. Quizá mucha gente aún no se haya dado cuenta de que la "guerra" en el campo de la IA ha entrado silenciosamente en una nueva fase. Quien sea el primero en adoptar el nuevo paradigma de "modelo como producto" tendrá ventaja en la futura competición de IA.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...