Uni-1.1 - Luma AI推出的图像生成模型

Últimos recursos sobre IAPublicado hace 3 semanas Círculo de intercambio de inteligencia artificial 11.6K 00

Uni-1.1是什么

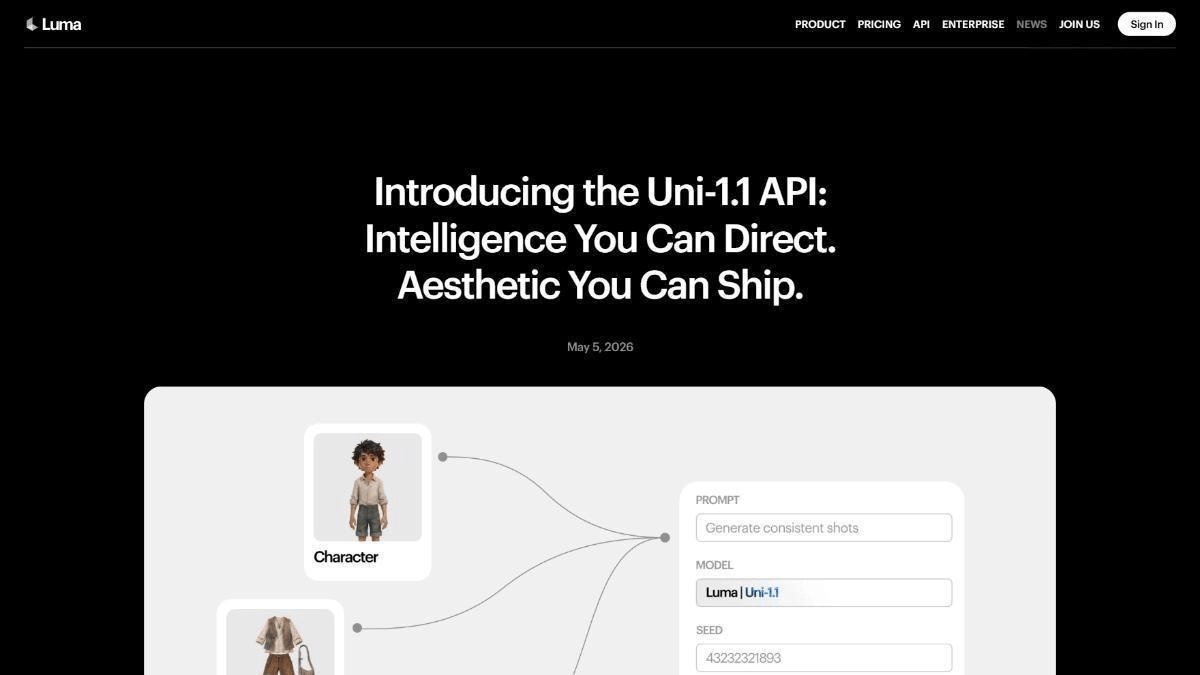

Uni-1.1是Luma AI推出的图像生成模型,将文本理解与图像生成整合进同一个 decoder-only、autoregressive 模型中,非像主流方案那样把语言模型和图像模型拼接使用。模型在第三方盲测榜单 Image Arena 中排名全球第三,Human Preference Elo 排名第一,API 价格约为同类竞品的一半,目前已获 Adobe、Envato、Freepik、Krea 等平台接入 。

Uni-1.1的功能特色

- 统一模态生成:在同一个模型序列中处理文本 ficha 和图像 token,实现真正的"理解即生成",避免多模型拼接带来的语义漂移。

- edición de imágenes en lenguaje natural: a través de

modify-image端点,用户可用自然语言描述局部修改需求(如换背景、调灯光),无需复杂 prompt 工程。 - 多图参考一致性:单次请求最多支持上传 9 张参考图像,保持角色身份、视觉风格和构图一致性,适合系列化创意产出。

- 低延迟生产级输出:官方称单张图像生成耗时约 31 秒,提供比同类模型更低的延迟和成本。

- Comandos en varios idiomas:API 支持多种语言输入,便于全球化分发和本地化工作流集成。

Uni-1.1的核心优势

- 架构统一,语义对齐:文本推理与图像生成共享同一套自回归序列,能在生成前完成创意意图和结构逻辑的深度解析,解决"指令阶段与最终输出不一致"的痛点。

- 小团队,高性能:核心研发团队不到 15 人,由两位华人学者(扩散模型采样加速奠基人 + 计算机视觉顶会最佳论文得主)领衔,以精简架构实现头部榜单前三的性能。

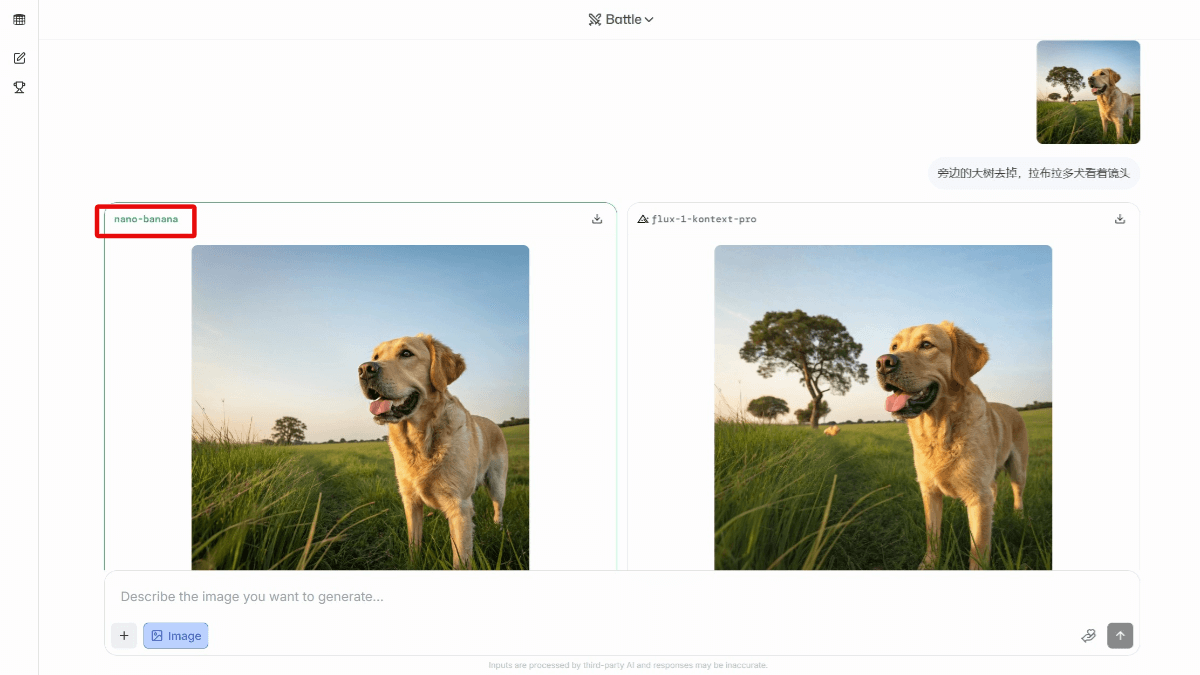

- 性价比突出:官方定位为"GPT-Image 2 级别的智能、Midjourney 级别的审美、仅为 Nano Banana 一小部分的价格",API 成本约为同类水平的一半。

- 空间推理领先:在 RISEBench 空间逻辑推理基准测试中排名第一,擅长处理包含多约束条件(如空间布局、构图逻辑)的复杂生成任务。

使用Uni-1.1的操作步骤

- Registrar una cuenta:访问Luma AI开发者平台官网(https://platform.lumalabs.ai)注册并登录账号。

- Obtener la llave:在开发者后台创建项目并获取API Key。

- 选择计费模式:根据用量选择Build计划(按量计费,适合灵活调用)或Scale计划(预留吞吐,最低8单元起订,适合大规模生产)。

- 调用Reasoning端点:发送文本指令与参考图,让模型解构需求、规划构图并锁定品牌/角色约束。

- 调用Generation端点:基于推理结果完成像素渲染,获取最终生成图像。

- SDK de integración:通过官方提供的Python、JavaScript、TypeScript、Go或CLI SDK将API接入现有工作流。

Uni-1.1的适用人群

- AI 图像应用开发者:需要为产品接入生产级图像生成/编辑能力的独立开发者或技术团队。

- 创意与设计工作流搭建者:从事广告、电商、品牌视觉、漫画、建筑等需要批量保持风格一致性的设计从业者。

- 多模态 AI 产品探索者:希望基于"统一智能"架构构建下一代生成式应用,而非简单拼接现有文生图 API 的创业者。

- 预算敏感的中小团队:对图像生成成本敏感,但不愿牺牲质量和可控性的内容生产团队。

Uni-1.1的常见问题

Q:Uni-1.1 与主流文生图 API(如 Midjourney、GPT-Image)最大的区别是什么?

A:主流方案通常将语言理解模型和图像生成模型分开,通过 prompt 串联;Uni-1.1 是单一自回归模型,文本和图像 token 在同一序列中处理,能在生成图像前先完成推理和意图对齐,减少语义丢失 。

Q:API 的定价模式是怎样的?

A:采用按量计费(usage-based pricing),官方强调其成本显著低于同类可比模型,具体价格需参考 Luma 官方文档 。

Q:支持哪些类型的编辑操作?

A:通过自然语言即可请求局部修改,例如背景替换、光照调整、风格迁移等,无需结构化 prompt 或遮罩输入 。

Q:目前有哪些已知客户或合作伙伴?

A:已披露的合作方包括 Adobe、Envato、Freepik 等创意平台,以及 Fal、Krea、Magnific 等 AI 原生开发工具 。

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...