Story-Flicks: introduce temas para generar automáticamente vídeos de cuentos infantiles

Últimos recursos sobre IAActualizado hace 1 año Círculo de intercambio de inteligencia artificial 53K 00

Introducción general

Story-Flicks es una herramienta de IA de código abierto centrada en ayudar a los usuarios a generar rápidamente vídeos de historias en alta definición. Los usuarios sólo tienen que introducir un tema de la historia , el sistema generará contenido de la historia a través de un modelo de lenguaje grande , y combinado con imágenes generadas por IA , audio y subtítulos , la salida de la obra completa de vídeo . El backend del proyecto se basa en Python y el marco FastAPI, y el frontend está construido con React, Ant Design y Vite. Es compatible con OpenAI, AliCloud, DeepSeek y otros proveedores de servicios de modelos, y los usuarios pueden elegir de forma flexible los modelos de generación de texto e imágenes. Ya sea para crear cuentos infantiles, animaciones cortas o vídeos didácticos, Story-Flicks puede satisfacer fácilmente las necesidades de desarrolladores, creadores y educadores.

Lista de funciones

- Generar vídeo con un clic: Introduzca un tema para la historia y genere automáticamente un vídeo con imágenes, texto, audio y subtítulos.

- Compatibilidad con varios modelos: Compatible con OpenAI, Aliyun, DeepSeek, Ollama y SiliconFlow de modelos de texto e imagen.

- Personalización de segmentosEl usuario puede especificar el número de párrafos de la historia, y cada párrafo genera la imagen correspondiente.

- salida multilingüe: Soporte para generación de texto y audio en múltiples idiomas, adaptado para usuarios globales.

- despliegue de código abierto: Ofrece tanto instalación manual como despliegue en Docker para facilitar el funcionamiento local.

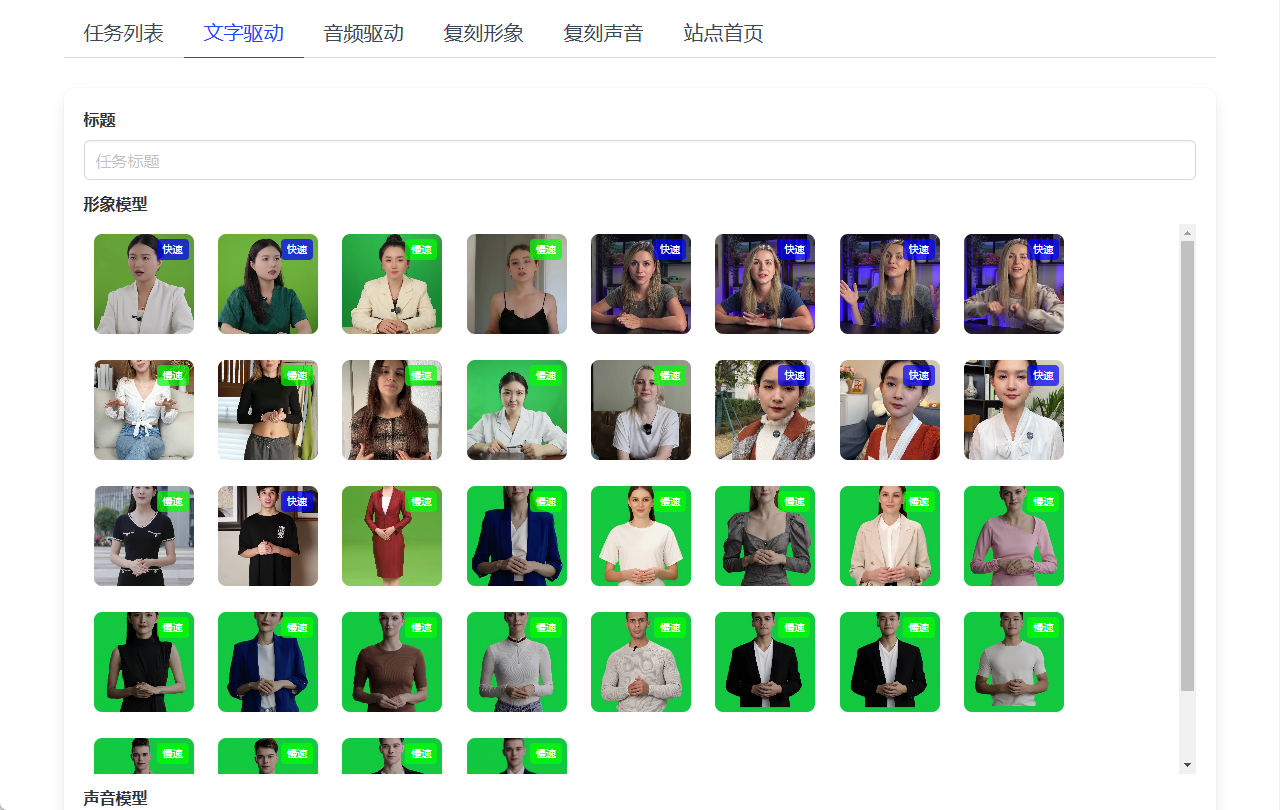

- interfaz intuitivaLa página de inicio es fácil de usar y admite la selección de parámetros y la previsualización de vídeo.

Utilizar la ayuda

Proceso de instalación

Story-Flicks ofrece dos métodos de instalación: instalación manual y despliegue Docker. A continuación se detallan los pasos para garantizar que los usuarios puedan crear el entorno sin problemas.

1. Instalación manual

Paso 1: Descargar el proyecto

Clona el proyecto localmente introduciendo el siguiente comando en el terminal:

git clone https://github.com/alecm20/story-flicks.git

Paso 2: Configurar la información del modelo

Vaya al directorio backend y copie el archivo de configuración del entorno:

cd backend

cp .env.example .env

espectáculo (una entrada) .env para configurar el modelo de generación de texto e imágenes. Ejemplo:

text_provider="openai" # 文本生成服务商,可选 openai、aliyun、deepseek 等

image_provider="aliyun" # 图像生成服务商,可选 openai、aliyun 等

openai_api_key="你的OpenAI密钥" # OpenAI 的 API 密钥

aliyun_api_key="你的阿里云密钥" # 阿里云的 API 密钥

text_llm_model="gpt-4o" # 文本模型,如 gpt-4o

image_llm_model="flux-dev" # 图像模型,如 flux-dev

- Si elige OpenAI, se recomienda utilizar

gpt-4ocomo modelo textual.dall-e-3como modelo de imagen. - Si elige AliCloud, se recomienda utilizar

qwen-plustal vezqwen-max(modelización textual) yflux-dev(modelo de imagen, actualmente disponible para prueba gratuita, ver detalles enDocumentación de AliCloud). - Guarde el archivo una vez finalizada la configuración.

Paso 3: Iniciar el backend

Vaya al directorio backend en el terminal, cree el entorno virtual e instale las dependencias:

cd backend

conda create -n story-flicks python=3.10 # 创建 Python 3.10 环境

conda activate story-flicks # 激活环境

pip install -r requirements.txt # 安装依赖

uvicorn main:app --reload # 启动后端服务

Tras iniciarse correctamente, el terminal mostrará:

INFO: Uvicorn running on http://127.0.0.1:8000 (Press CTRL+C to quit)

INFO: Application startup complete.

Esto indica que el servicio back-end se ha ejecutado http://127.0.0.1:8000.

Paso 4: Iniciar la interfaz

Ve al directorio del front-end en un nuevo terminal, instala las dependencias y ejecútalo:

cd frontend

npm install # 安装前端依赖

npm run dev # 启动前端服务

Después de arrancar con éxito, el terminal muestra:

VITE v6.0.7 ready in 199 ms

➜ Local: http://localhost:5173/

Acceso desde un navegador http://localhost:5173/Puedes ver la interfaz del front-end.

2. Despliegue de Docker

Paso 1: Preparar el entorno

Asegúrese de que Docker y Docker Compose están instalados localmente; si no es así, descárguelos del sitio web oficial.

Paso 2: Iniciar el proyecto

Ejecútelo en el directorio raíz del proyecto:

docker-compose up --build

Docker crea e inicia automáticamente los servicios front-end y back-end. Cuando haya terminado, visita la página http://localhost:5173/ Ver la página del front-end.

Utilización

Tras la instalación, los usuarios pueden generar vídeos de historias a través de la interfaz front-end. A continuación se muestra el flujo de operaciones específico:

1. Acceso a la interfaz front-end

Escriba en su navegador http://localhost:5173/Se abre la página principal de Story-Flicks.

2. Ajuste de los parámetros de generación

La interfaz ofrece las siguientes opciones:

- Proveedor de modelos de generación de texto: Selección

openaiyaliyunetc. - Generación de imágenes Proveedor de modelos: Selección

openaiyaliyunetc. - modelo de textoIntroduzca el nombre del modelo, por ejemplo

gpt-4otal vezqwen-plus. - modelización de imágenesIntroduzca el nombre del modelo, por ejemplo

flux-devtal vezdall-e-3. - Idioma del vídeo: Selecciona un idioma, como chino o inglés.

- Tipo de voz: Selecciona un estilo de audio, como masculino o femenino.

- TemasIntroduzca un tema, por ejemplo "Las aventuras del conejo y la zorra".

- Número de párrafos de la historia: Introduzca un número (por ejemplo, 3), y cada segmento corresponderá a una imagen.

3. Generación de vídeo

Después de rellenar los parámetros, haga clic en el botón "Generar". El sistema generará el vídeo de acuerdo con la configuración. El tiempo de generación está relacionado con el número de párrafos, cuantos más párrafos más tarda. Cuando termine, el vídeo se mostrará en la página, soportará reproducción y descarga.

advertencia

- Si la generación falla, compruebe el

.envpara obtener la clave API correcta, o compruebe que la conexión de red funciona. - utilizar Ollama Al ajustar el

ollama_api_key="ollama"Recomendadoqwen2.5:14bo modelos más grandes, los modelos más pequeños pueden no funcionar tan bien. - El modelo de imagen de SiliconFlow sólo se ha probado hasta ahora.

black-forest-labs/FLUX.1-devAsegúrese de seleccionar un modelo compatible.

Función destacada Operación

Generar vídeo completo con un solo clic

En la interfaz, introduce "La historia del lobo y el conejo", establece 3 párrafos y haz clic en "Generar". Al cabo de unos minutos, obtendrás un vídeo con 3 imágenes, voz en off y subtítulos. Por ejemplo, el vídeo de demostración oficial muestra las historias "El conejo y la zorra" y "El lobo y el conejo".

Soporte multilingüe

¿Quieres generar un vídeo en inglés? Ajusta el "Idioma del vídeo" a "Inglés" y el sistema generará texto, audio y subtítulos en inglés. Cambiar a otros idiomas es igual de fácil.

Segmentación personalizada

¿Necesitas una historia más larga? Ajusta el número de párrafos a 5 o más. Cada párrafo genera una nueva imagen y la historia se amplía en consecuencia.

Con estos pasos, los usuarios pueden instalar y utilizar fácilmente Story-Flicks para crear rápidamente vídeos narrativos en alta definición. Ya sea para entretenimiento personal o para uso educativo, ¡esta herramienta puede ayudarte a ser creativo!

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...