Raycast-G4F: ¡Acceso gratuito a GPT-4, Llama-3 y muchos otros modelos de IA a través de Raycast!

Últimos recursos sobre IAPublicado hace 1 año Círculo de intercambio de inteligencia artificial 62.2K 00

Introducción general

Raycast-G4F (GPT4Free) es un potente Raycast La extensión ofrece a los usuarios acceso gratuito a una amplia gama de modelos avanzados de IA, como GPT-4 y Llama-3. La extensión no sólo proporciona transmisión de diálogos en tiempo real, sino que también admite diversas funciones, como búsqueda en la web, carga de archivos, generación de imágenes, etc. Lo más destacable es que admite más de 40 proveedores y modelos de IA diferentes. Sobre todo, admite más de 40 proveedores y modelos de IA diferentes, lo que permite a los usuarios cambiar libremente según sus necesidades. La extensión es completamente de código abierto y se centra en la protección de la privacidad del usuario, con todos los datos almacenados localmente en el dispositivo. Aunque actualmente no está disponible en la tienda oficial de Raycast, puede utilizarse mediante una sencilla instalación del código fuente y proporciona actualizaciones automáticas para garantizar que la última versión esté siempre disponible.

Raycast-G4F sólo está disponible actualmente para macOS, con una versión para Windows en desarrollo. Los usuarios pueden instalar la extensión desde el código fuente con sencillos pasos de instalación y disfrutar de sus potentes funciones de IA.

Lista de funciones

- Función de transmisión de diálogos en tiempo real con carga de mensajes instantáneos

- 18 comandos diferentes para distintas situaciones de uso

- Permite acceder a más de 40 proveedores y modelos de IA

- Almacenamiento inteligente del registro de chat y funciones de asignación de nombres de sesión

- Capacidad de búsqueda en Internet para obtener información actualizada

- Admite la carga de archivos de imagen, vídeo, audio y texto

- Función de generación de imágenes AI

- Soporte para crear comandos de IA personalizados

- Función de intérprete de código (Beta)

- La función de almacenamiento persistente garantiza la conservación segura de los datos

Utilizar la ayuda

1. Preparación previa a la instalación

- Asegúrese de que la aplicación Raycast está instalada (actualmente sólo es compatible con macOS).

- Instale Node.js (versión recomendada v20.18.1 o superior)

2. Pasos de la instalación

- Descargue la última versión del código fuente de GitHub o clone el repositorio

- Abra el terminal y vaya a la carpeta de descargas

- estar en movimiento

npm ci --productionInstalación de dependencias - (Opcional) Ejecutar

pip3 install -r requirements.txtInstalación de las dependencias de Python - estar en movimiento

npm run devCreación e importación de extensiones

3. Modalidades de actualización

Actualizaciones automáticas:

- Utilice el comando "Buscar actualizaciones" integrado en la extensión.

- Active la opción "Buscar actualizaciones automáticamente" en Preferencias (activada por defecto).

Actualización manual:

Ejecute los siguientes comandos en orden:

git pullnpm ci --productionnpm run dev

4. Descripción del uso de las principales funciones

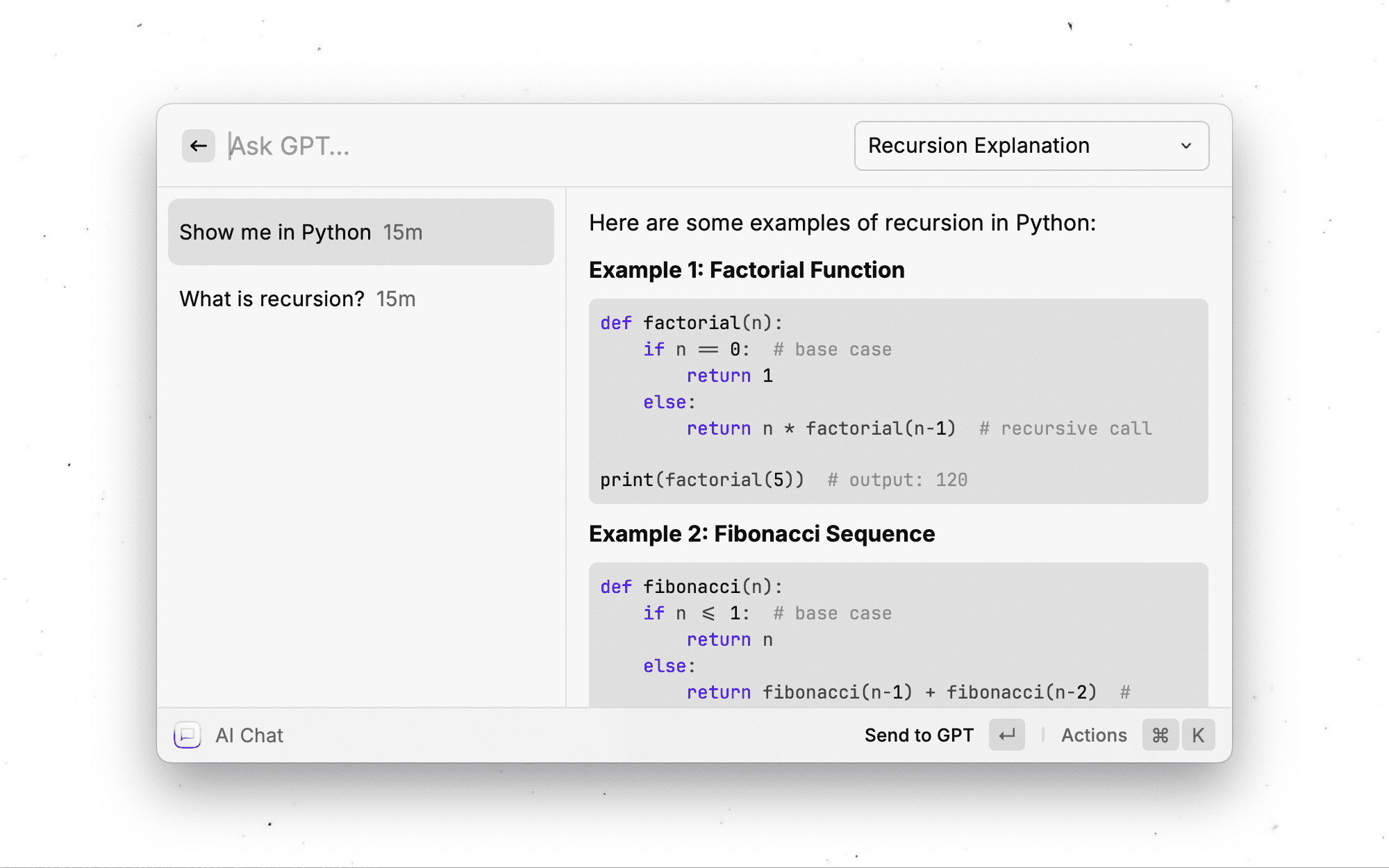

Chat con inteligencia artificial

- Soporte para flujos de diálogo en tiempo real

- Guardar automáticamente el historial de chat

- Denominación inteligente de las sesiones

- La búsqueda web puede activarse en una sola sesión

Función de búsqueda en Internet

Se ofrecen cuatro modos:

- Desactivar (por defecto)

- Modo automático: se activa automáticamente sólo en el chat AI

- Modo equilibrado: activado tanto en los comandos de la IA como en el chat.

- Siempre activado: la búsqueda web se utiliza para todas las consultas

Capacidad de tratamiento de documentos

- Admite la carga de archivos de texto (.txt, .md, etc.).

- Algunos proveedores admiten imágenes, vídeos y archivos de audio

- Compatibilidad con el comando "Preguntar contenido de pantalla

Personalización

- Creación de comandos de IA personalizados

- Configuración de preajustes de IA

- Configuración del almacenamiento persistente

- API personalizadas compatibles con OpenAI

5. Configuración de funciones avanzadas

Configuración de la API Google Gemini

- Visite https://aistudio.google.com/app/apikey

- Acceder a la cuenta de Google

- Creación de una clave API

- Introduzca la clave en Preferencias ampliadas

Intérprete de código (beta)

- Soporte para la ejecución local de código Python

- Sólo se admiten modelos específicos con capacidad de llamada a funciones

- Se han configurado restricciones de seguridad para garantizar la ejecución segura del código

Modelos gratuitos y proveedores de servicios ofrecidos

| proveedor (empresa) | modelización | funcionalidad | situación | tempo | Calificaciones y notas ampliadas del autor |

|---|---|---|---|---|---|

| Nexra | gpt-4o (por defecto) | ▶️ | Activo | muy rápido | 8,5/10, el modelo con mejor rendimiento. |

| Nexra | gpt-4-32k | Activo | moderado | 6,5/10, no soporta streaming, pero por lo demás es un gran modelo. | |

| Nexra | chatgpt | ▶️ | Desconocido | muy rápido | 7.5/10 |

| Nexra | Bing | ▶️ | Activo | moderado | 8/10, basado en GPT-4 y con capacidad de búsqueda en la web. |

| Nexra | llama-3.1 | ▶️ | Activo | afilado (de cuchillos o ingenio) | 7/10 |

| Nexra | gemini-1.0-pro | ▶️ | Activo | afilado (de cuchillos o ingenio) | 6.5/10 |

| DeepInfra | meta-llama-3.3-70b | ▶️ | Activo | afilado (de cuchillos o ingenio) | 8,5/10, el último modelo con grandes tamaños de contexto. |

| DeepInfra | meta-llama-3.2-90b-vision | ▶️ 📄¹ | Activo | afilado (de cuchillos o ingenio) | 8/10, el último modelo con capacidades visuales. |

| DeepInfra | meta-llama-3.2-11b-vision | ▶️ 📄¹ | Activo | muy rápido | 7.5/10 |

| DeepInfra | meta-llama-3.1-405b | ▶️ | Inactivo | moderado | 8,5/10, modelo abierto de última generación para tareas complejas. |

| DeepInfra | meta-llama-3.1-70b | ▶️ | Activo | afilado (de cuchillos o ingenio) | 8/10 |

| DeepInfra | meta-llama-3.1-8b | ▶️ | Activo | muy rápido | 7.5/10 |

| DeepInfra | llama-3.1-nemotron-70b | ▶️ | Activo | afilado (de cuchillos o ingenio) | 8/10 |

| DeepInfra | WizardLM-2-8x22B | ▶️ | Activo | moderado | 7/10 |

| DeepInfra | DeepSeek-V2.5 | ▶️ | Activo | afilado (de cuchillos o ingenio) | 7.5/10 |

| DeepInfra | Qwen2.5-72B | ▶️ | Activo | moderado | 7.5/10 |

| DeepInfra | Qwen2.5-Codificador-32B | ▶️ | Activo | afilado (de cuchillos o ingenio) | 7/10 |

| DeepInfra | QwQ-32B-Vista previa | ▶️ | Activo | muy rápido | 7.5/10 |

| Caja negra | modelo personalizado | ▶️ | Activo | afilado (de cuchillos o ingenio) | 7,5/10 con una generación muy rápida con funciones de búsqueda web integradas, pero optimizada para la codificación. |

| Caja negra | llama-3.1-405b | ▶️ | Activo | afilado (de cuchillos o ingenio) | 8.5/10 |

| Caja negra | llama-3.1-70b | ▶️ | Activo | muy rápido | 8/10 |

| Caja negra | gemini-1.5-flash | ▶️ | Activo | la velocidad del rayo | 7.5/10 |

| Caja negra | qwq-32b-vista previa | ▶️ | Activo | la velocidad del rayo | 6.5/10 |

| Caja negra | gpt-4o | ▶️ | Activo | muy rápido | 7.5/10 |

| Caja negra | claude-3.5-sonnet | ▶️ | Activo | afilado (de cuchillos o ingenio) | 8.5/10 |

| Caja negra | gemini-pro | ▶️ | Activo | afilado (de cuchillos o ingenio) | 8/10 |

| DuckDuckGo | gpt-4o-mini | ▶️ | Activo | la velocidad del rayo | 8/10, auténtico modelo GPT-4o-mini con fuerte protección de la privacidad. |

| DuckDuckGo | claude-3-haiku | ▶️️ | Activo | la velocidad del rayo | 7/10 |

| DuckDuckGo | meta-llama-3.1-70b | ▶️️ | Activo | muy rápido | 7.5/10 |

| DuckDuckGo | mixtral-8x7b | ▶️️ | Activo | la velocidad del rayo | 7.5/10 |

| BestIM | gpt-4o-mini | ▶️ | Inactivo | la velocidad del rayo | 8.5/10 |

| Rocas | claude-3.5-sonnet | ▶️ | Activo | afilado (de cuchillos o ingenio) | 8.5/10 |

| Rocas | claude-3-opus | ▶️ | Activo | afilado (de cuchillos o ingenio) | 8/10 |

| Rocas | gpt-4o | ▶️ | Activo | afilado (de cuchillos o ingenio) | 7.5/10 |

| Rocas | gpt-4 | ▶️ | Activo | afilado (de cuchillos o ingenio) | 7.5/10 |

| Rocas | llama-3.1-405b | ▶️ | Activo | afilado (de cuchillos o ingenio) | 7.5/10 |

| Rocas | llama-3.1-70b | ▶️ | Activo | muy rápido | 7/10 |

| ChatgptGratis | gpt-4o-mini | ▶️ | Activo | la velocidad del rayo | 8.5/10 |

| AI4Chat | gpt-4 | Activo | muy rápido | 7.5/10 | |

| DarkAI | gpt-4o | ▶️ | Activo | muy rápido | 8/10 |

| Mhystical | gpt-4-32k | Activo | muy rápido | 6.5/10 | |

| PizzaGPT | gpt-4o-mini | Activo | la velocidad del rayo | 7.5/10 | |

| Meta IA | meta-llama-3.1 | ▶️ | Activo | moderado | 7/10, el último modelo con acceso a Internet. |

| Replicar | mixtral-8x7b | ▶️ | Activo | moderado | ?/10 |

| Replicar | meta-llama-3.1-405b | ▶️ | Activo | moderado | ?/10 |

| Replicar | meta-llama-3-70b | ▶️ | Activo | moderado | ?/10 |

| Replicar | meta-llama-3-8b | ▶️ | Activo | afilado (de cuchillos o ingenio) | ?/10 |

| Phind | Phind Instantáneo | ▶️ | Activo | la velocidad del rayo | 8/10 |

| Google Empresa de Internet Géminis | auto (gemini-1.5-pro, gemini-1.5-flash) | ▶️ 📄 | Activo | muy rápido | 9/10, muy buen modelo genérico, pero requiere una clave API. (Esgratis(Consulte la sección siguiente) |

| Google Gemini (Experimental) | auto (cambia con frecuencia) | ▶️ 📄 | Activo | muy rápido | - |

| Google Gemini (Pensamiento) | auto (cambia con frecuencia) | ▶️ 📄 | Activo | muy rápido | - |

| API personalizada compatible con OpenAI | - | ▶️ | Activo | - | Permite utilizar cualquier API personalizada compatible con OpenAI. |

▶️ - Soporte de streaming.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...