Oferta anual de OneFlow: ebook gratuito "Generative AI and Big Models" de 900 páginas

Resulta difícil imaginar los asombrosos cambios que se habrían producido en la IA en 2024 si la Ley de la Escala no se hubiera ralentizado, pero, por otra parte, uno podría alegrarse de que sea gracias a la ralentización de la Ley de la Escala por lo que se está dando a los participantes más tardíos en la industria la oportunidad de ponerse al día, y a más gente corriente la oportunidad de subirse a esta ronda de revolución tecnológica.

Los cambios en la IA son conmovedores. Hace un año, la comunidad de la IA creía en general que la mayoría de los modelos estaban a medio o un año de distancia de los modelos de OpenAI, pero el preentrenamiento de grandes modelos se está volviendo gradualmente menos secreto, y su barrera de entrada se está reduciendo en órdenes de magnitud. Para gran sorpresa de la comunidad tecnológica nacional e internacional, la diferencia entre los grandes modelos de código abierto representados por DeepSeek y Qwen y el principal modelo de código cerrado GPT 4o se ha reducido drásticamente, y ambos modelos proceden de equipos chinos de IA. Mientras tanto, a medida que el rendimiento de preentrenamiento de los grandes modelos toca techo, la inferencia se considera la "segunda curva de crecimiento" para la mejora continua de la capacidad de los modelos, y la popularización de la tecnología de IA se acelera aún más, permitiendo a la gente desarrollar eficientemente una aplicación de IA generativa simplemente accediendo a API estandarizadas, o simplemente disfrutando de los beneficios de la tecnología de IA. productos interesantes lanzados por exploradores de productos

En 2024, OneFlow publicó 80 artículos de calidad, como siempre, documentando y explorando los numerosos cambios en el campo de la IA generativa y los big models. Al final del año, seleccionamos más de 60 artículos e hicimos un "anuario" de 900 páginas para cada lector, con la esperanza de ayudarle a entender el proceso de construcción de big models, el estado actual de la industria y las tendencias. Esta colección se divide en ocho secciones:Visión general, Fundamentos de Big Model, Sin secretos para el entrenamiento de Big Model, "Segunda curva de crecimiento" de Big Model: Inferencia, Cambios de chip de IA, Construcción de productos de IA generativa, Análisis de la industria de la IA generativa, Retos y futuro de la IA generativa.

Gracias a cada uno de los autores por compartir abiertamente sus conocimientos sobre IA e inspirarnos a usted y a mí, que es nuestra motivación para seguir recopilando estos contenidos en profundidad. Esperamos encontrar aquellos que merezcan la pena leer entre la maraña de información y difundirlos al mayor número posible de personas que deseen aprender y explorar la IA. Si quiere entender de verdad la IA, el atajo más corto es abrir este regalo y lanzarse a leerlo. 2025, espere nuevas sorpresas de la IA.

I. Panorama general

- Inventario de IA 2024: aumento de la inversión, reconfiguración de las infraestructuras, aceleración de la adopción de la tecnología /4

- Las tendencias que veo detrás de las 900 herramientas de IA de código abierto /36

II. Fundamentos del gran modelo

- Comprender el funcionamiento del LLM utilizando las matemáticas de la escuela media /49

- Comprender y codificar desde cero el mecanismo de autoatención de LLM /78

- Revelación del proceso de muestreo de LLM /112

- 50 diagramas para visualizar y comprender el gran modelo del Experto Mixto (ME) /125

- Creación desde cero de un modelo de difusión para la generación de vídeo /158

- 10 grandes jugadas ocultas del modelo que cambian cada día /174

En tercer lugar, no hay ningún secreto en la formación de grandes modelos

- LLaMA 3: Un nuevo prólogo a la batalla de los grandes modelos /177

- Extrapolación de los requisitos de memoria de la GPU para el entrenamiento LLM /190

- Revelación de estrategias por lotes en la GPU /200

- La verdad sobre el rendimiento tras el uso de la GPU /205

- Asignación de coma flotante para LLM /211

- Optimización del rendimiento de la multiplicación de matrices de entrada mixta /219

- Eficiencia computacional de LLM 10 veces acelerada: multiplicación de matrices evanescente /227

- El mayor conjunto de datos de primer nivel se abre para crear 15 billones de Token /240

- 70B Big Model Training Recipe 1: Dataset Creation and Evaluation /244

- De Bare Metal a modelos grandes de 70B ②: Configuración de la infraestructura y secuencias de comandos /270

- 70B Receta de entrenamiento de grandes modelos III: resultados de 1.000 experimentos de optimización de hiperparámetros /289

- John Schulman, Director de ChatGPT: El secreto para actualizar los grandes modelos /303

IV. Gran modelo "segunda curva de crecimiento": razonamiento

- El nuevo campo de batalla de la IA generativa: inferencia lógica y computación deductiva /318

- Selección de la estrategia de inferencia lógica LLM: cálculo durante la inferencia frente a cálculo durante el entrenamiento /330

- Exploración del espacio de rendimiento, latencia y coste del razonamiento LLM /345

- Lograr un razonamiento LLM extremo desde cero /363

- Guía para principiantes del razonamiento LLM 1: Fases de inicialización y descodificación de la generación de textos /402

- Guía para principiantes sobre el razonamiento LLM ②: Un análisis en profundidad de la caché KV /408

- Guía para principiantes sobre el razonamiento LLM (3): Perfilar el rendimiento de los modelos /429

- Guía de aceleración del razonamiento LLM /442

- LLM al servicio de la maximización del rendimiento efectivo /480

- ¿Cómo evaluar de forma precisa e interpretable los efectos cuantitativos de los grandes modelos? /491

- Evaluación de la eficacia cuantitativa del LLM: conclusiones tras 500.000 pruebas empíricas /502

- Difusión estable XL Guía definitiva para la optimización /510

V. Cambios en el chip de IA

- Alquiler de H100 por 2 $/hora: la noche antes de que estalle la burbuja de la GPU /585

- Lo último en tecnología de interconexión de GPU: el muro de memoria que desaparece /600

- Cerebras: desafiando a Nvidia, la "magia" del chip de inferencia de IA más rápido del mundo /614

- ¿20 veces más rápido que las GPU? Análisis precio/rendimiento de la inferencia de matrices d /624

- Tecnología, mercados y futuro de los semiconductores de IA /630

- Historia, tecnología y principales actores de los centros de datos de IA /642

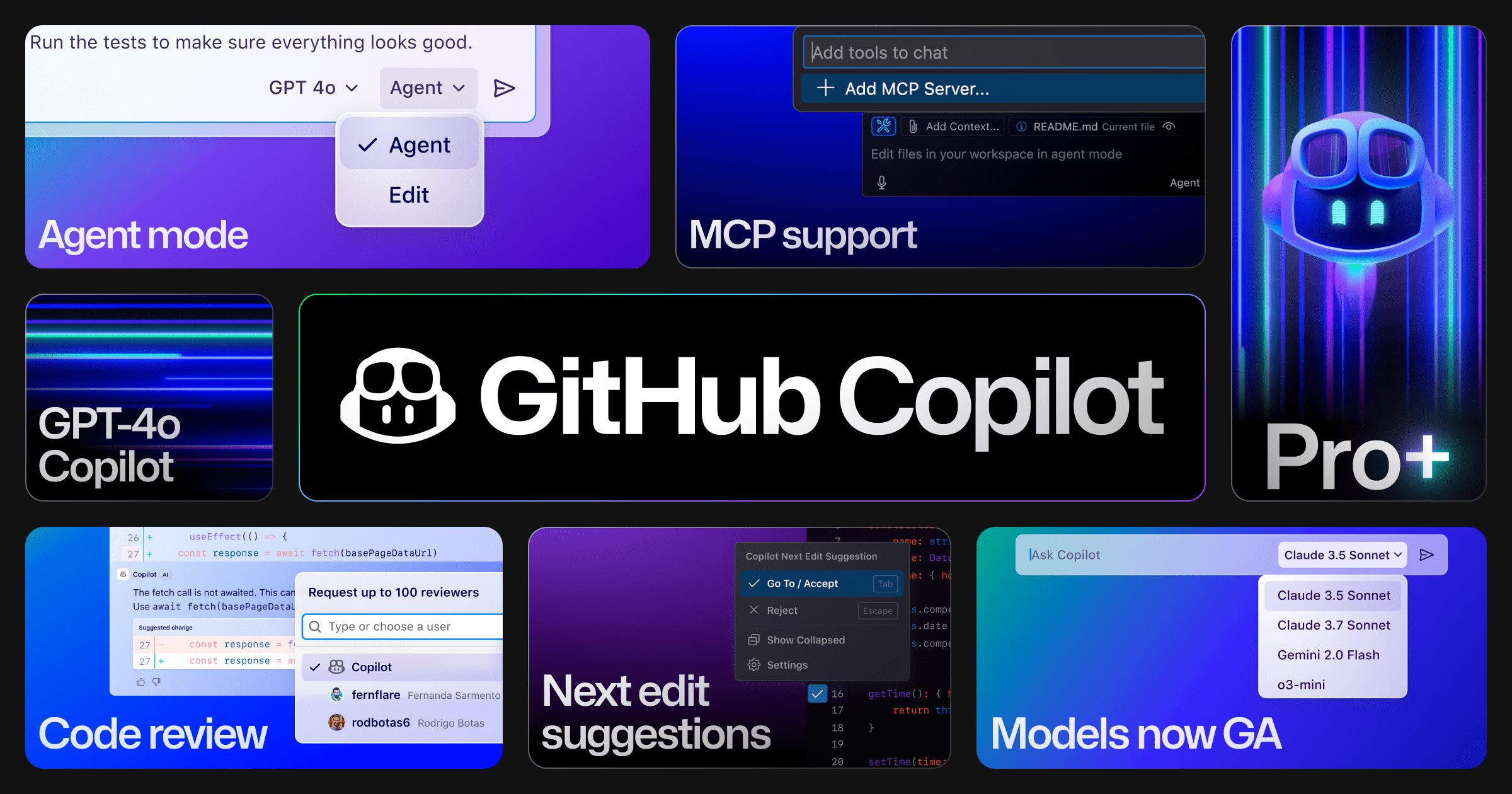

VI. Construcción de productos de IA generativa

- El primer año de la producción de grandes modelos: táctica, operaciones y estrategia /658

- OpenAI descontinuado, ¡los grandes modelos de cosecha propia son de uso libre! Ficha de desarrollador gratuita /691

- LLM contexto largo RAG capacidad medida: gpt-o1 vs. Géminis /699

- Comparación coste-eficacia de modelos grandes: DeepSeek 2.5 frente a DeepSeek 2.5. Claude 3.5 Sonnet frente a GPT-4o /712

- Herramientas de codificación eficientes para ingenieros 10x: Cursor x SiliconCloud /718

- Supera Midjourney-v6, ejecuta Kotaku Kolors sin GPU /723

- El enfoque de AI Search Perplexity para la creación de productos /728

- Detrás de la explosión de NotebookLM: ideas centrales e innovaciones en productos nativos de IA /739

- Forma organizativa, mecanismos de decisión y construcción de productos de OpenAI /750

- Desmontando la plataforma de IA generativa: componentes subyacentes, funcionalidad e implementación /761

- De generalista a experto: la evolución de los sistemas de IA hacia la IA compuesta /786

VII. Análisis del sector de la IA Generativa

- El código empresarial detrás de la IA de código abierto /792

- Misterios y flujos de capital en el mercado de la IA /805

- Economía de la industria de la IA generativa: distribución del valor y estructura de los beneficios /819

- Última encuesta sobre IA generativa empresarial: el gasto en IA se multiplica por 6, predominan los despliegues multimodelo /829

- Tecnologías, mercados y futuro del razonamiento generativo de IA /842

- Oportunidades de mercado, competencia y futuro del negocio del razonamiento generativo de IA /855

- La IA no es otra "burbuja de Internet" /864

- Tres perspectivas de la IA para 2025 según Sequoia Capital /878

VIII. Retos y futuro de la AGI

- El mito de la ampliación de la IA /884

- ¿Es sostenible la ampliación de grandes modelos /891

- El "salto crítico" de GenAI: razonamiento y conocimiento /904

- Los grilletes del razonamiento lógico LLM y estrategias para romperlos /924

- Revisión de las tres falacias del razonamiento lógico LLM /930

- Richard Sutton, el padre del aprendizaje por refuerzo: el próximo paradigma en la investigación de la inteligencia artificial /937

- Richard Sutton, el padre del aprendizaje por refuerzo: otra posibilidad para la AGI /949

https://siliconflow.feishu.cn/file/OSZtbnfYQoa4nBxuQ7Kcwpjwnpf

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...