o3 Demostración práctica de la superioridad de los modelos de inferencia genéricos sobre los modelos de programación especializados en dominios de programación

Texto original:Estudio de la competencia en programación basado en un modelo de razonamiento amplioA continuación se ofrece un breve resumen para facilitar la lectura.

1. Introducción

1.1 Antecedentes y motivación

En los últimos años, los modelos de grandes lenguajes (LLM) han avanzado significativamente en la generación de programas y tareas de razonamiento complejas. Las competiciones de programación, especialmente plataformas como la Olimpiada Internacional de Informática (IOI) y CodeForces, son bancos de pruebas ideales para evaluar las capacidades de razonamiento de los sistemas de IA debido a sus rigurosas exigencias en materia de pensamiento lógico y habilidades de resolución de problemas.

1.2 Objetivos del estudio

Este estudio pretende explorar las siguientes cuestiones:

- Comparación de rendimiento de modelos de razonamiento genéricos y específicos de un dominioComparar el rendimiento de los modelos de inferencia de propósito general (por ejemplo, o1 y o3 de OpenAI) con los modelos de dominio específico diseñados específicamente para las competiciones de IOI (por ejemplo, o1-ioi).

- El papel del aprendizaje por refuerzo en la mejora de la capacidad de razonamiento por modelos: Evaluación del rendimiento de grandes modelos de inferencia entrenados mediante aprendizaje por refuerzo (RL) en tareas de programación complejas.

- La aparición de estrategias de razonamiento autónomo basadas en modelos: Observar si el modelo puede desarrollar de forma autónoma estrategias de razonamiento eficaces sin intervención humana.

2. Metodología

2.1 Introducción al modelo

2.1.1 OpenAI o1

OpenAI o1 es un modelo de lenguaje a gran escala entrenado mediante aprendizaje por refuerzo para generar y ejecutar código. Resuelve problemas paso a paso generando una cadena interna de razonamiento, optimizada mediante RL.

2.1.2 OpenAI o1-ioi

o1-ioi es una versión mejorada de o1, ajustada específicamente para el concurso IOI. Emplea una estrategia de tiempo de prueba similar a la del sistema AlphaCode, que consiste en generar un gran número de soluciones candidatas para cada subtarea y seleccionar la mejor presentación mediante agrupación y reordenación.

2.1.3 OpenAI o3

o3 es el sucesor de o1 y mejora aún más la capacidad de inferencia del modelo. A diferencia de o1-ioi, o3 no depende de estrategias diseñadas manualmente en tiempo de prueba, sino que desarrolla de forma autónoma estrategias de inferencia complejas mediante el entrenamiento RL de extremo a extremo.

2.2 Metodología de evaluación

2.2.1 Concursos de simulación CodeForces

Simulamos el entorno de competición CodeForces, utilizando el conjunto completo de pruebas e imponiendo las restricciones de tiempo y memoria adecuadas para evaluar el rendimiento del modelo.

2.2.2 Concurso en vivo IOI 2024

o1-ioi participó en la competición IOI 2024, compitiendo en las mismas condiciones que los competidores humanos.

2.2.3 Evaluación de tareas de ingeniería de software

También evaluamos el rendimiento del modelo en los conjuntos de datos HackerRank Astra y SWE-bench Verified para comprobar sus capacidades en tareas reales de desarrollo de software.

3. Descubrimiento

3.1 Modelos genéricos frente a modelos específicos

- o1-ioi en el concurso IOI: En la competición IOI 2024, o1-ioi obtuvo 213 puntos y se clasificó en 49%. Tras relajar las restricciones de presentación, su puntuación mejoró hasta los 362,14 puntos, por encima de la línea de puntuación de la medalla de oro.

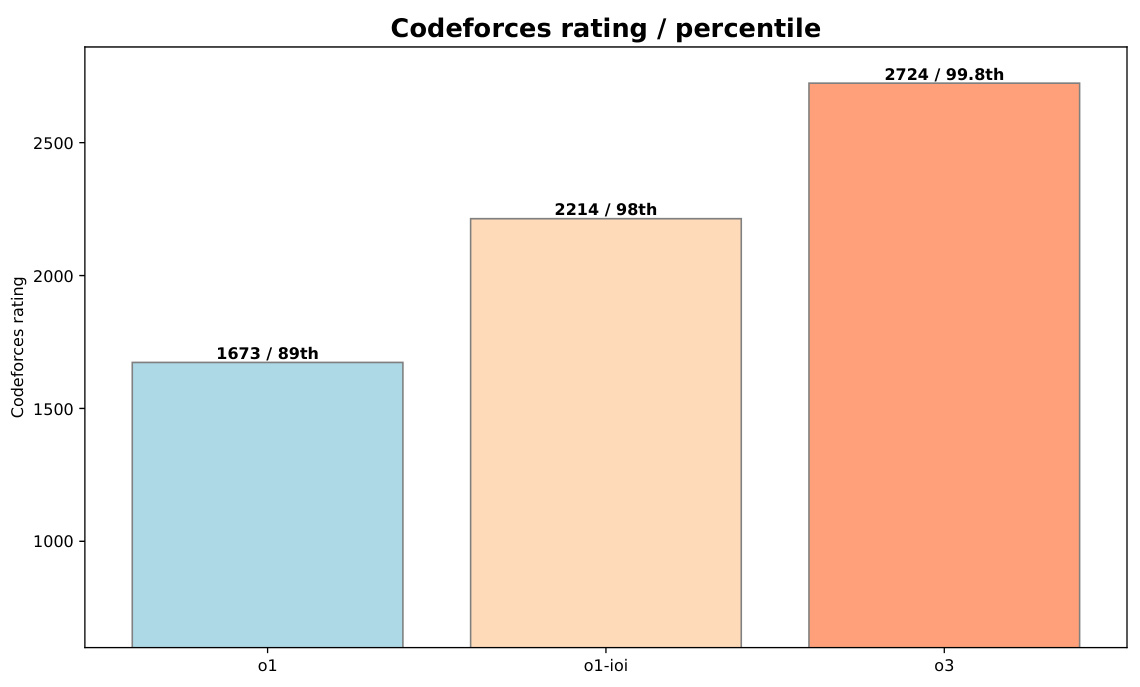

- o3 excelenciao3 obtuvo buenos resultados en la prueba CodeForces, con una puntuación de 2724 (percentil 99,8), significativamente mejor que o1-ioi (2214, percentil 98). En la prueba comparativa IOI 2024, o3 también logró una puntuación de 395,64, superando la línea de puntuación de la medalla de oro, con un límite de sólo 50 envíos.

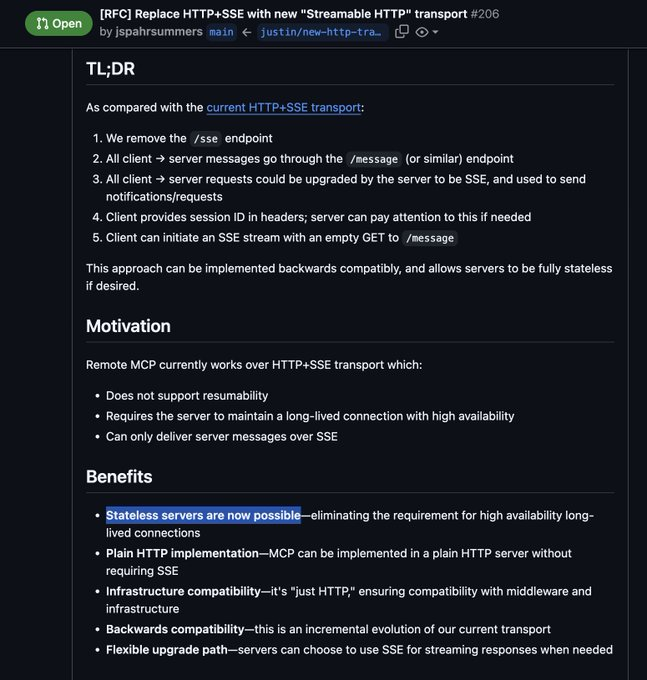

Figura 1: Comparación del rendimiento de o1-preview y o1 con gpt-4o en CodeForces

3.2 Potenciar el papel del aprendizaje

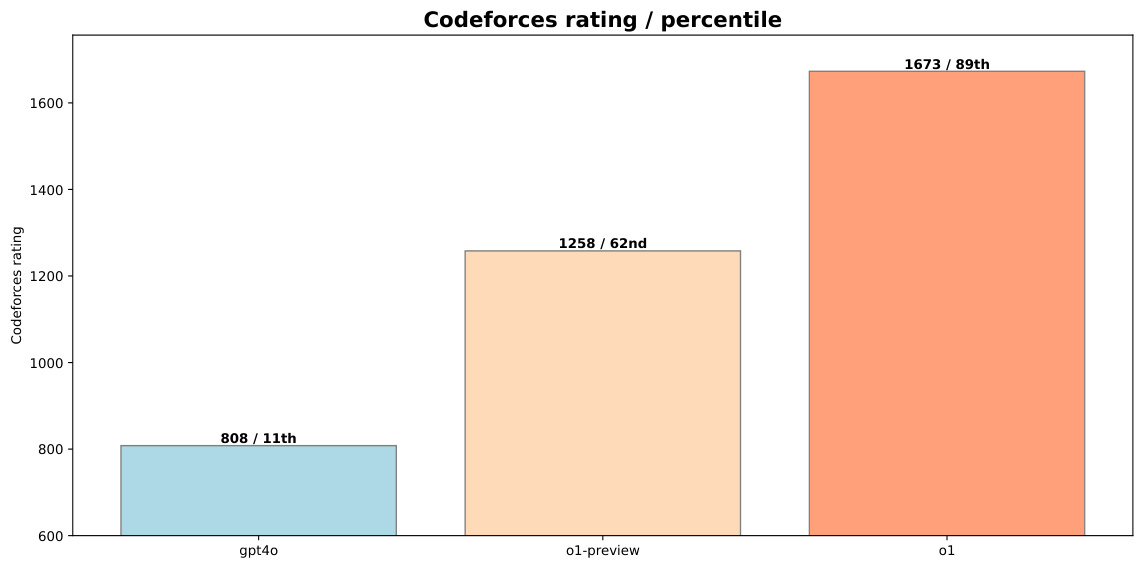

- Aumento del cálculo durante el entrenamiento y las pruebas de RLComo se muestra en la Fig. 2, aumentar los recursos computacionales durante el entrenamiento y las pruebas de RL puede mejorar significativamente el rendimiento del modelo en tareas matemáticas competitivas.

Figura 2: El entrenamiento RL adicional y el cálculo en tiempo de prueba mejoran el rendimiento en tareas matemáticas competitivas

3.3 Surgimiento de estrategias de razonamiento autónomo del modelo

- Estrategias de razonamiento autónomo para o3o3 muestra cadenas de razonamiento más complejas y reflexivas cuando se ponen a prueba. Por ejemplo, para los problemas que requieren validación, genera soluciones sencillas de fuerza bruta y luego coteja su resultado con una implementación más optimizada del algoritmo para detectar posibles errores.

Figura 3: Solución de prueba propia de o3, que refleja una aplicación parcial de la estrategia de prueba utilizada por o1-ioi en IOI 2024

4. Conclusión

4.1 Principales resultados

- Superioridad de los modelos generalizadosEl modelo o3: Mientras que los modelos de dominio específico (p. ej., o1-ioi) obtienen buenos resultados en tareas específicas, los modelos de propósito general (p. ej., o3) entrenados en RL a gran escala son capaces de superar estos resultados sin depender de heurísticas de inferencia diseñadas manualmente.

- Eficacia de la formación en RLLa adición de recursos informáticos de entrenamiento y prueba de RL puede mejorar sistemáticamente el rendimiento del modelo y acercarlo al de los mejores jugadores humanos del mundo.

- Modelización de la capacidad para desarrollar de forma autónoma estrategias complejaso3 demuestra la capacidad del modelo para desarrollar de forma autónoma estrategias de inferencia complejas, eliminando la necesidad de diseñar manualmente estrategias de prueba.

4.2 Perspectivas de futuro

Los resultados de este estudio demuestran que el entrenamiento a gran escala de la RL proporciona una vía sólida para alcanzar el estado del arte de la IA en dominios de razonamiento como la programación competitiva. En el futuro, se espera que los modelos de inferencia a gran escala desbloqueen muchos nuevos escenarios de aplicación en una variedad de campos como la ciencia, la codificación y las matemáticas.

5. Ejemplos

5.1 Ejemplos de soluciones del concurso IOI 2024

5.1.1 El problema del Nilo

o1-ioi obtuvo la máxima puntuación en el problema de Nilo, aquí está el código de ejemplo para la solución:

#include "nile.h"

#include <bits/stdc++.h>

using namespace std;

// ... (代码省略,详见附录C.1)

5.1.2 Problema de mensajes

o1-ioi obtuvo una puntuación de 79,64 en el problema Mensaje y aquí está el código de ejemplo para la solución:

#include "message.h"

#include <bits/stdc++.h>

using namespace std;

// ... (代码省略,详见附录C.2)

5.2 Ejemplos de soluciones en tareas de ingeniería de software

5.2.1 Conjunto de datos HackerRank Astra

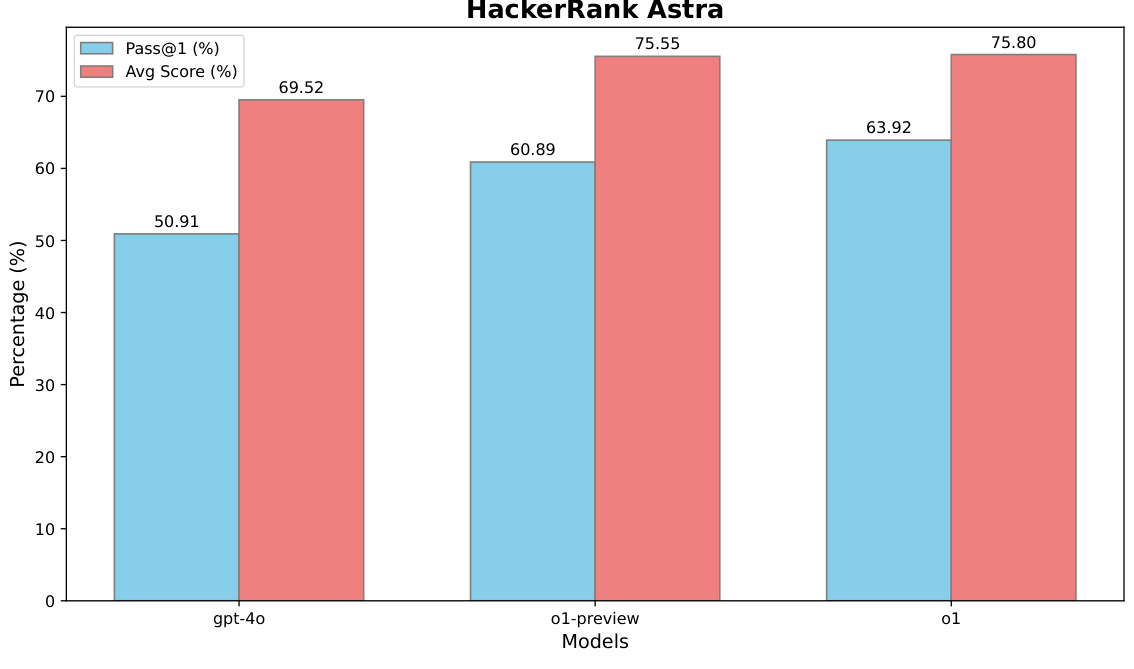

o1 en el conjunto de datos HackerRank Astra:

Figura 4: Rendimiento de o1 en el conjunto de datos HackerRank Astra

5.2.2 Conjunto de datos SWE-bench Verified

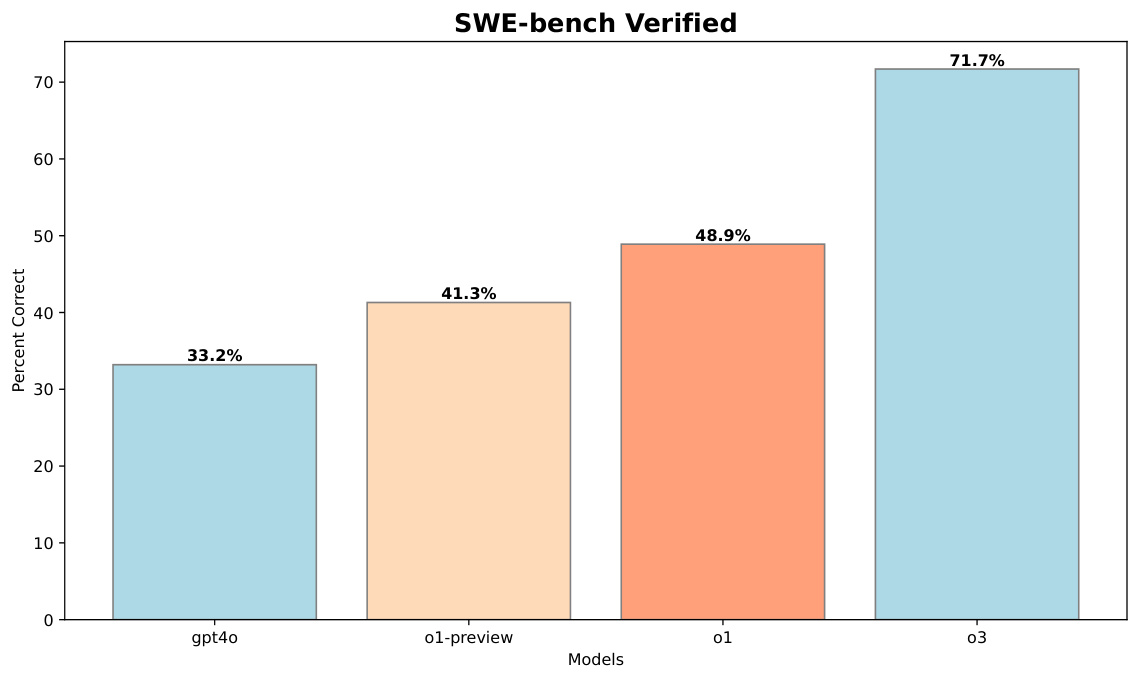

o3 en el conjunto de datos SWE-bench Verified:

Figura 5: Rendimiento de o3 en el conjunto de datos SWE-bench Verified

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Puestos relacionados

Sin comentarios...