Mistral lanza la Mistral Small 3 de código abierto: rivaliza en rendimiento con la GPT-4o y supera a la Llama 3

Mistral Pequeño 3: protocolo Apache 2.0, 81% MMLU, 150 tokens/seg.

Hoy, Mistral AI ha lanzado Mistral Small 3, un modelo de 24.000 millones de parámetros con latencia optimizada, y lo ha publicado bajo el protocolo Apache 2.0.

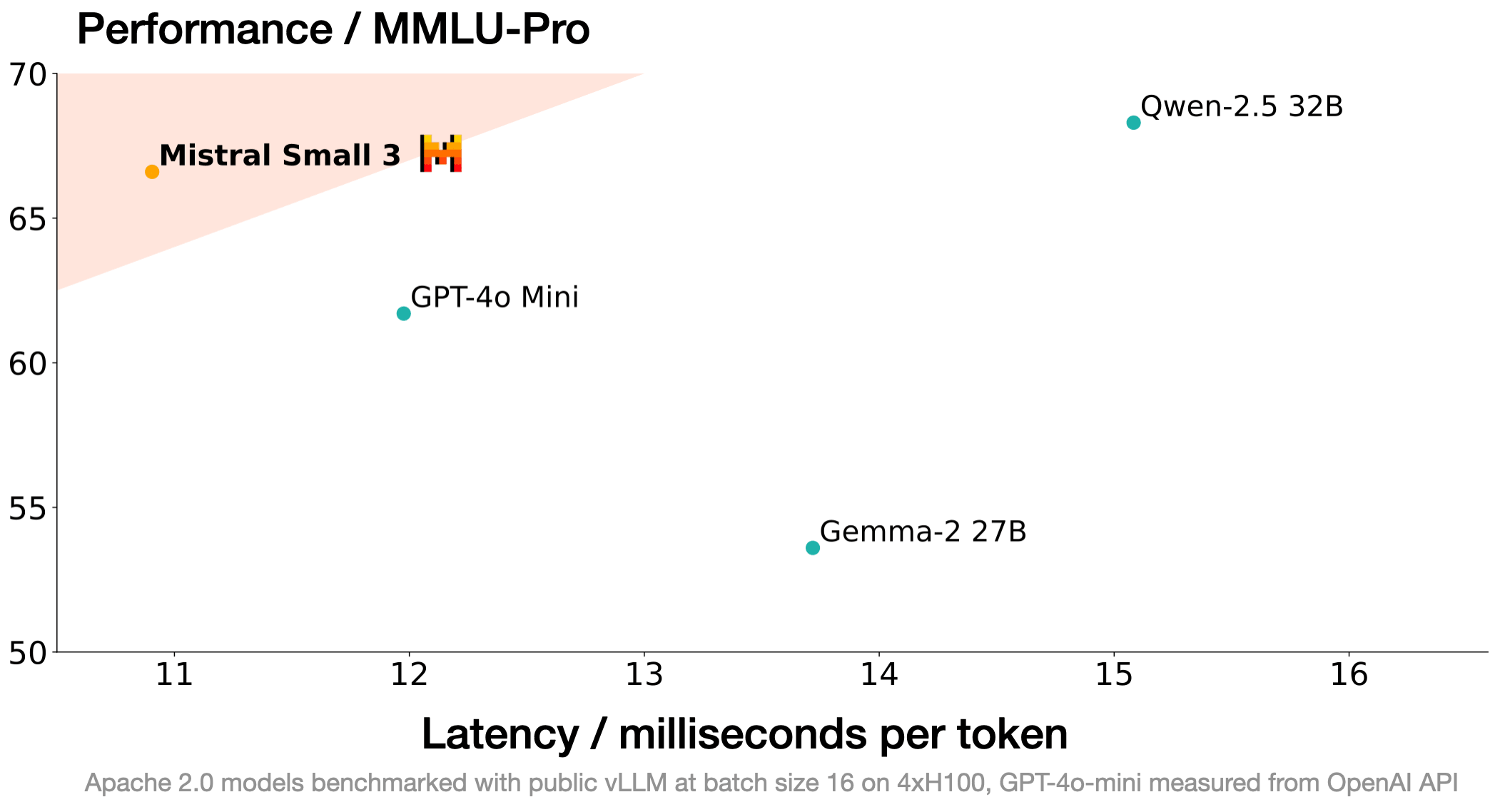

Mistral Small 3 es comparable a modelos más grandes como Llama 3.3 70B o Qwen 32B, y es una excelente alternativa de código abierto a modelos propietarios opacos como GPT4o-mini. Mistral Small 3 es comparable al instructor Llama 3.3 70B, pero es más de 3 veces más rápido en el mismo hardware.

Mistral Small 3 es un modelo preentrenado y ajustado a las instrucciones diseñado para satisfacer las necesidades del '80%' en tareas de IA generativa que requieran una gran capacidad lingüística y un rendimiento de adherencia a las instrucciones con una latencia muy baja.

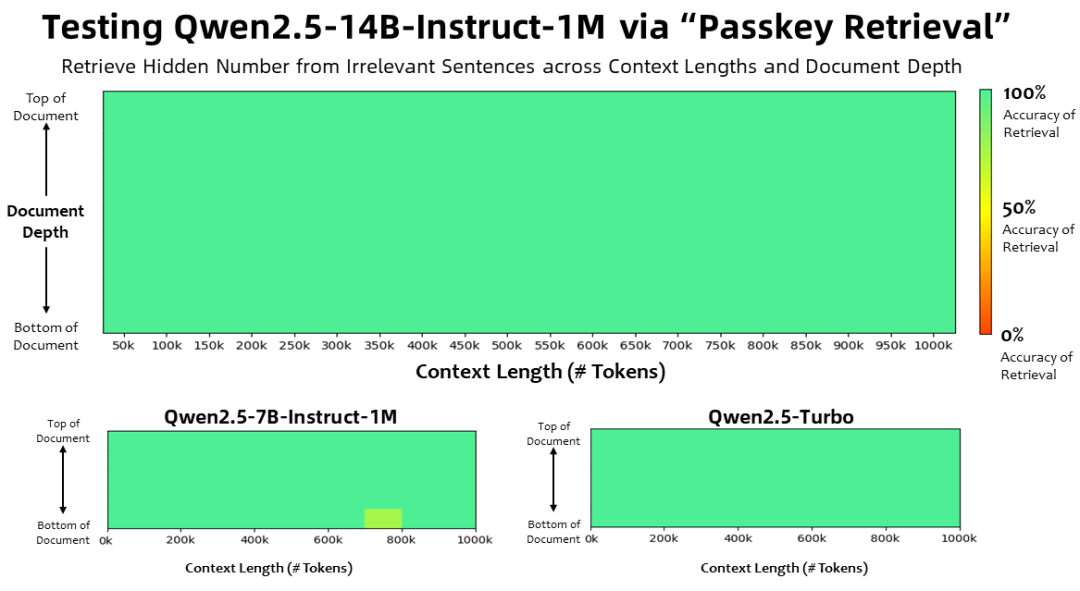

Mistral AI Este nuevo modelo se diseñó para saturar el rendimiento a una escala adecuada para el despliegue local. En concreto, Mistral Small 3 tiene muchas menos capas que los modelos de la competencia, lo que reduce significativamente el tiempo por propagación hacia delante.Con una precisión MMLU de más de 81% y una latencia de 150 tokens/segundo, Mistral Small es el modelo más eficiente de su clase hasta la fecha.

Mistral AI está lanzando puntos de control de preentrenamiento y de ajuste de instrucciones bajo el protocolo Apache 2.0. Estos puntos de control pueden servir de base para acelerar el progreso. Tenga en cuenta que Mistral Small 3 no se entrena utilizando el aprendizaje por refuerzo (RL) ni datos sintéticos, por lo que es más eficiente en el proceso de producción de modelos que el Búsqueda profunda R1 (¡una tecnología de código abierto estupenda y complementaria!) Mistral AI está deseando ver cómo la comunidad de código abierto la adopta y personaliza. Mistral AI está deseando ver cómo la comunidad de código abierto la adopta y personaliza.

actuaciones

evaluación manual

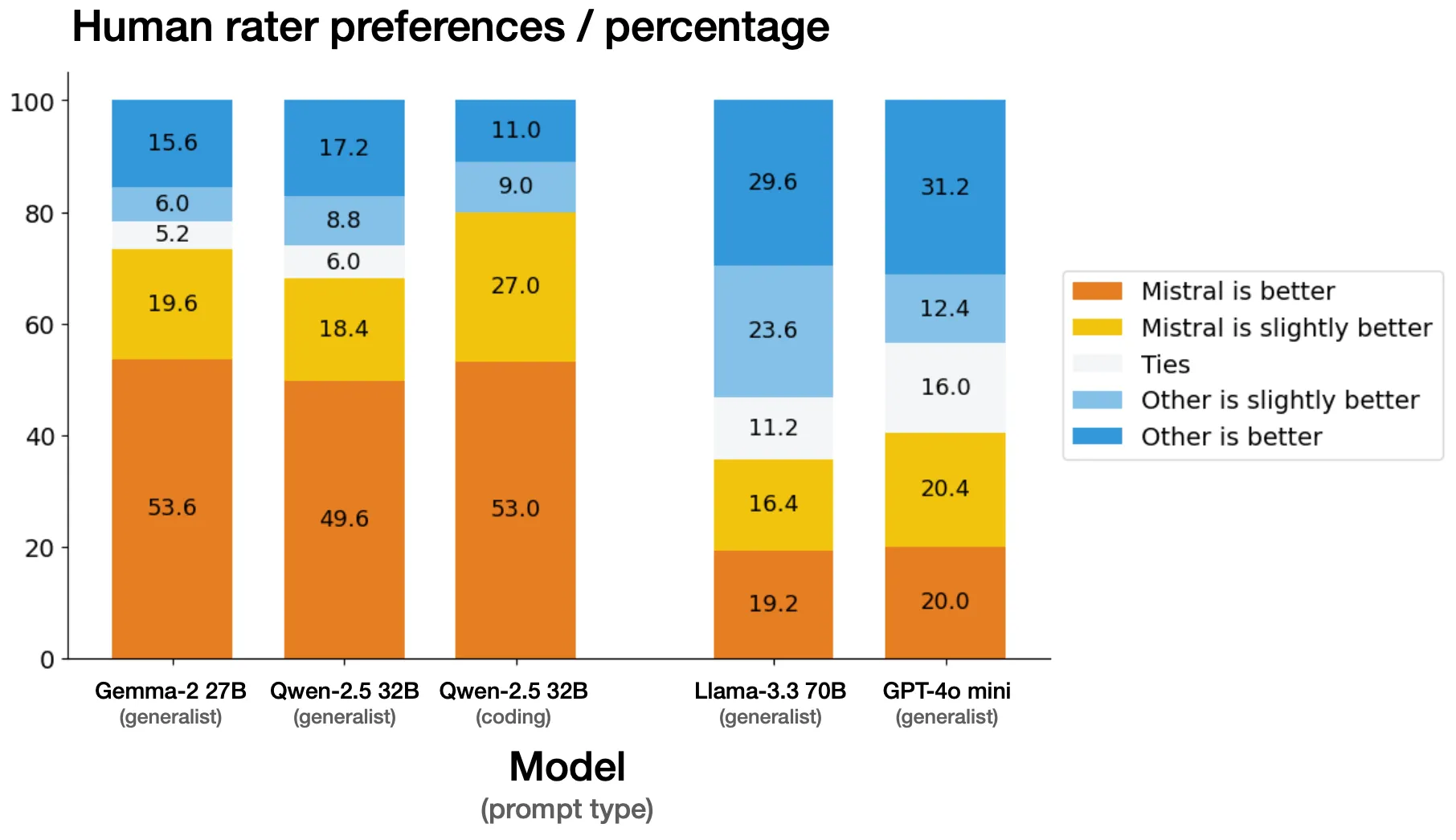

Mistral AI llevó a cabo evaluaciones paralelas de un conjunto de más de 1.000 códigos propios y pistas genéricas con un proveedor externo. Mistral AI es consciente de que en algunos casos los puntos de referencia de juicio humano diferirán significativamente de los puntos de referencia disponibles públicamente, pero Mistral AI ha tenido especial cuidado para verificar la imparcialidad de la evaluación. válidos.

función directiva

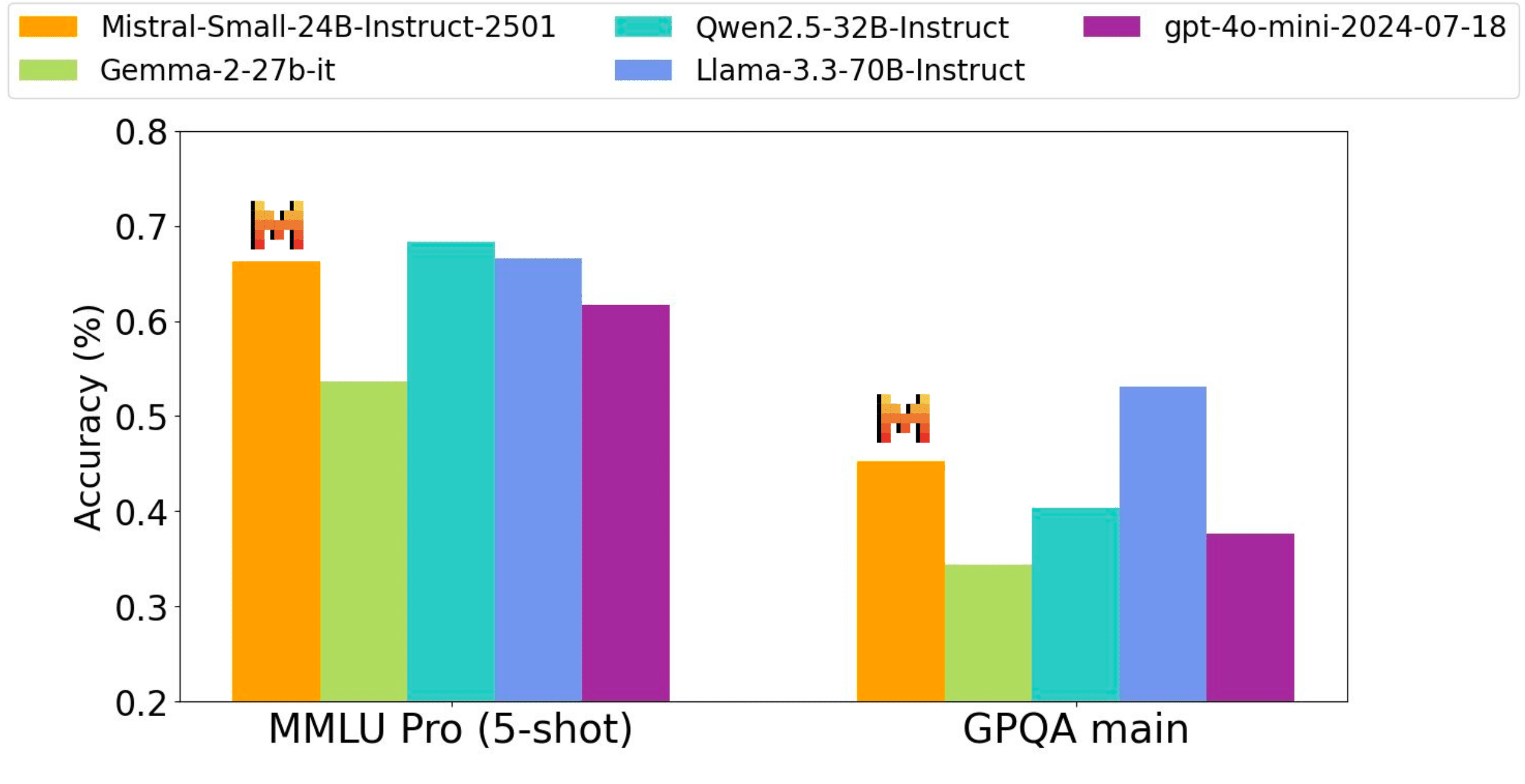

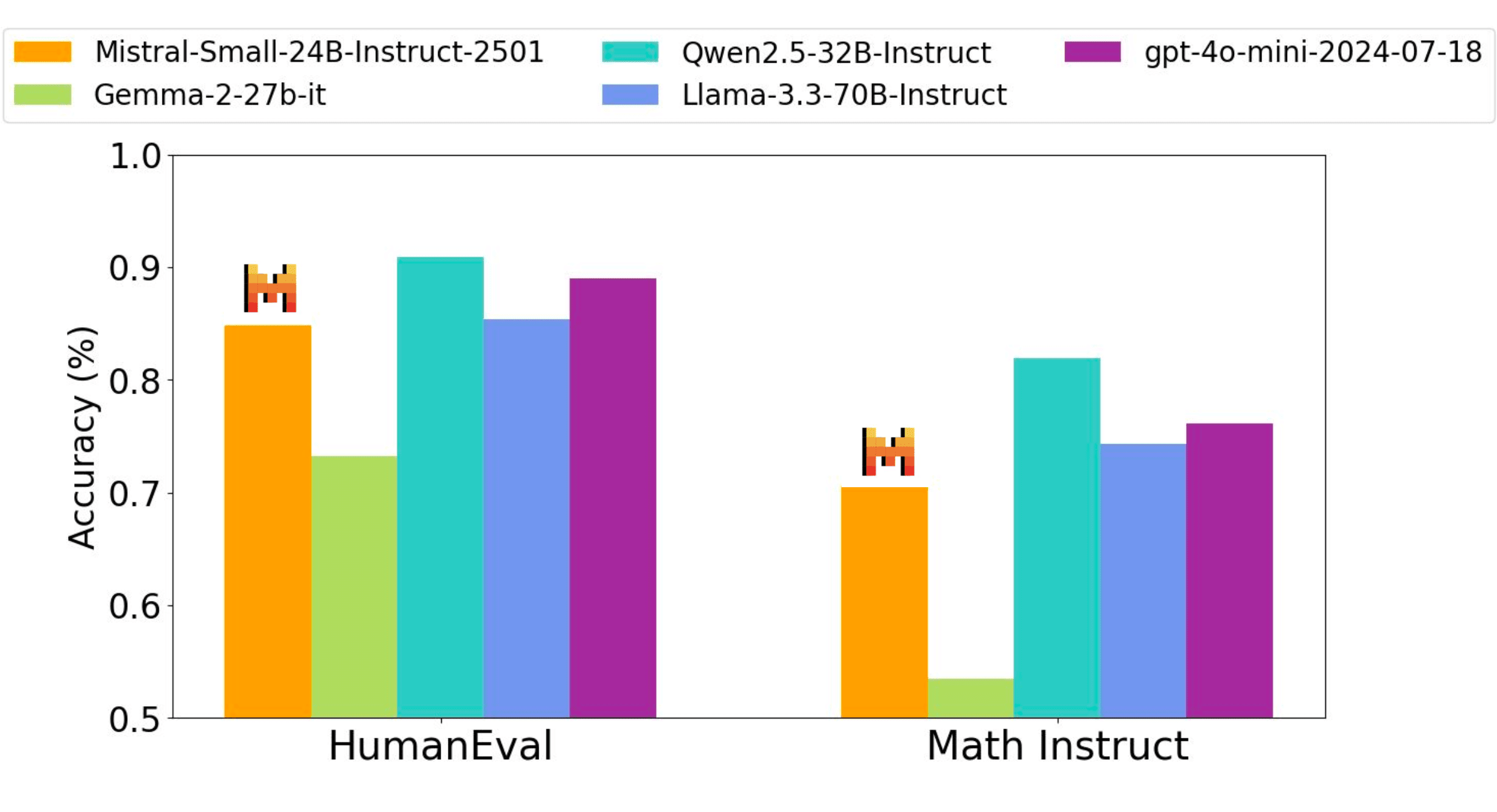

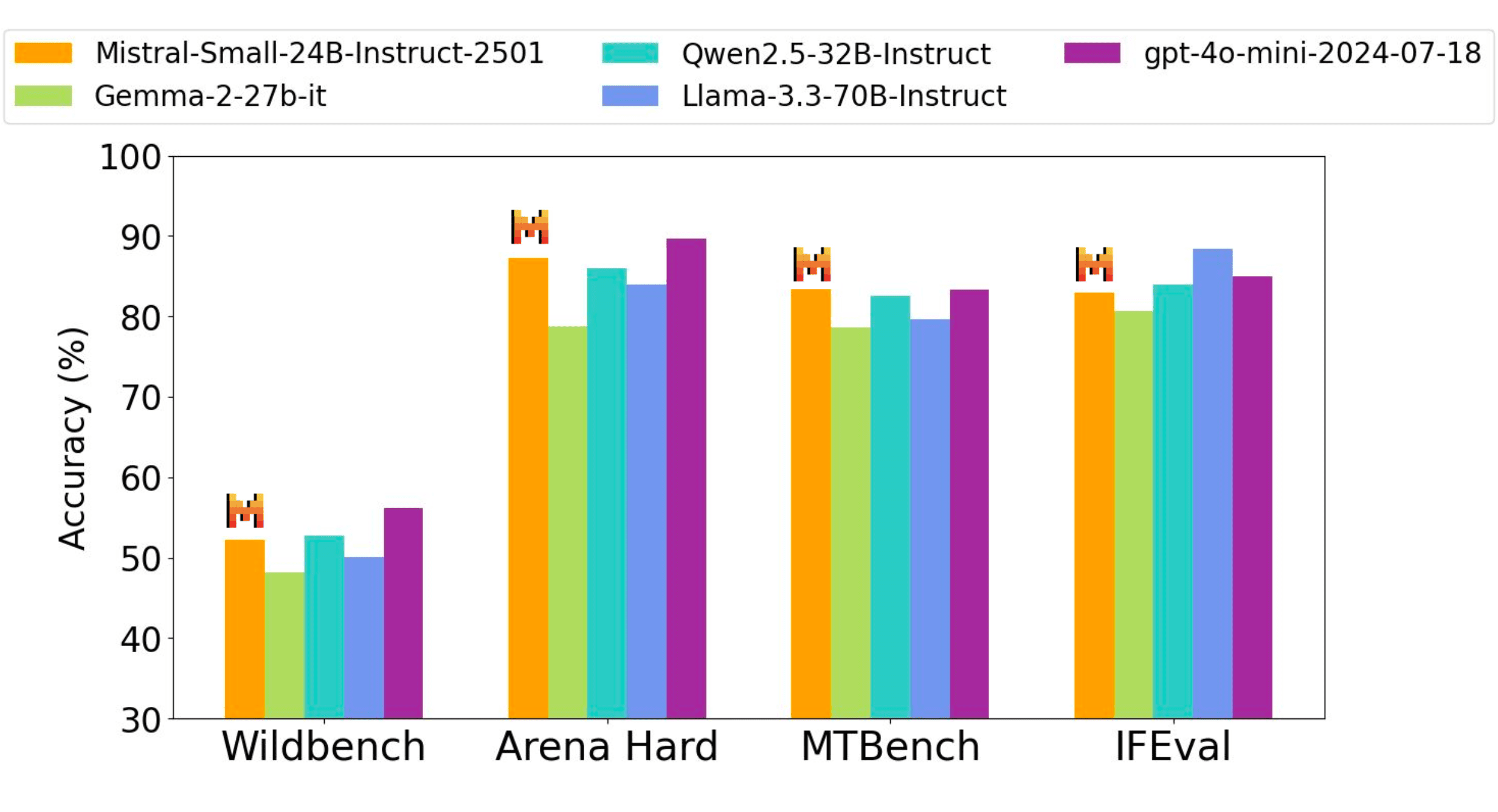

El modelo de ajuste fino de instrucciones de Mistral AI tiene una ventaja competitiva sobre los modelos de ponderación de código abierto que son tres veces mayores, así como sobre el modelo propietario GPT4o-mini, en pruebas comparativas de código, matemáticas, conocimientos generales y seguimiento de instrucciones.

La precisión del rendimiento de todos los benchmarks se obtiene mediante el mismo proceso de evaluación interna, por lo que las cifras pueden diferir ligeramente del rendimiento comunicado anteriormente (Qwen2.5-32B-Instruct, Llama-3.3-70B-Instruct, Gemma-2-27B-IT). wildbench, Arena hard y Evaluaciones basadas en Wildbench, Arena hard y MTBench Judge basadas en gpt-4o-2024-05-13.

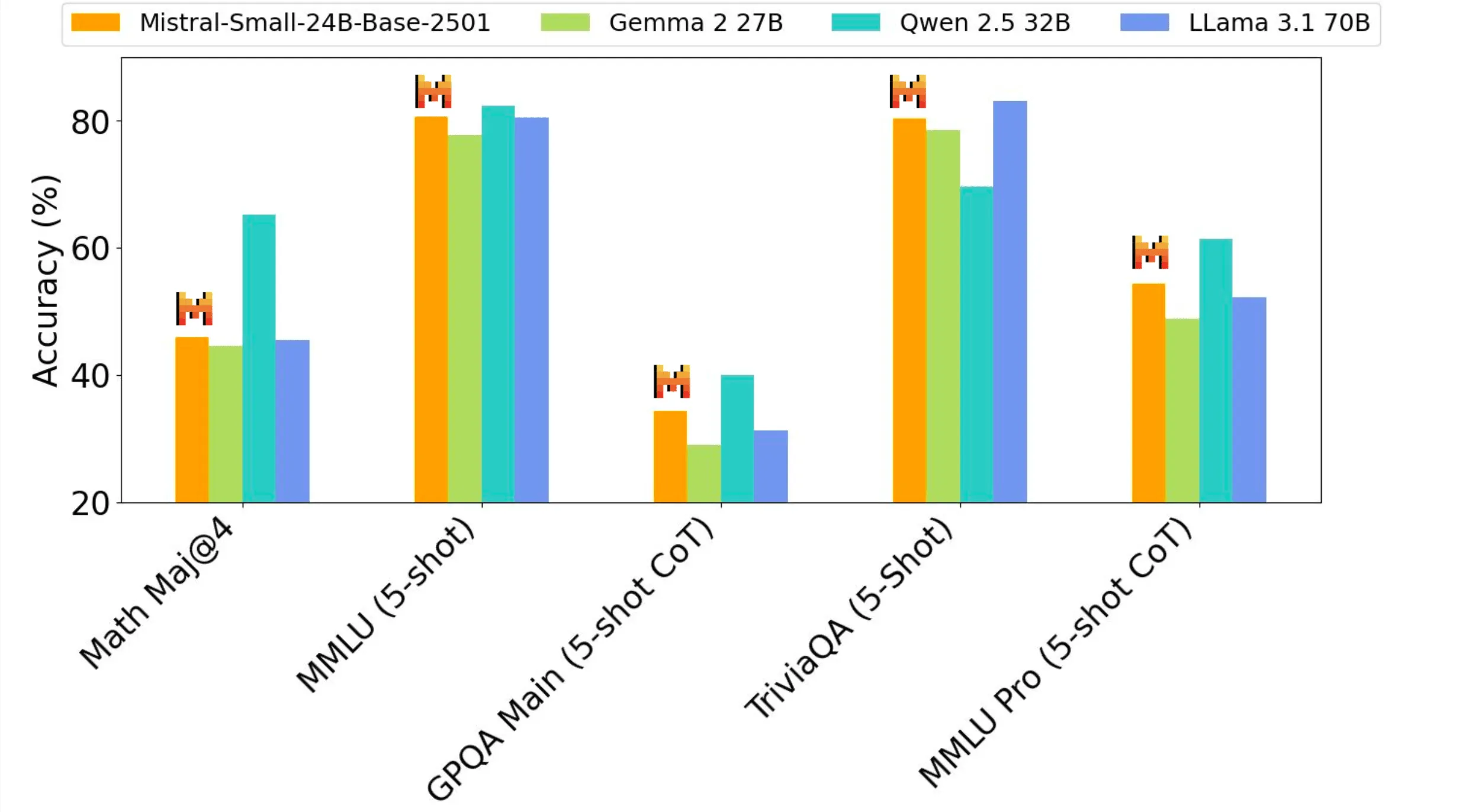

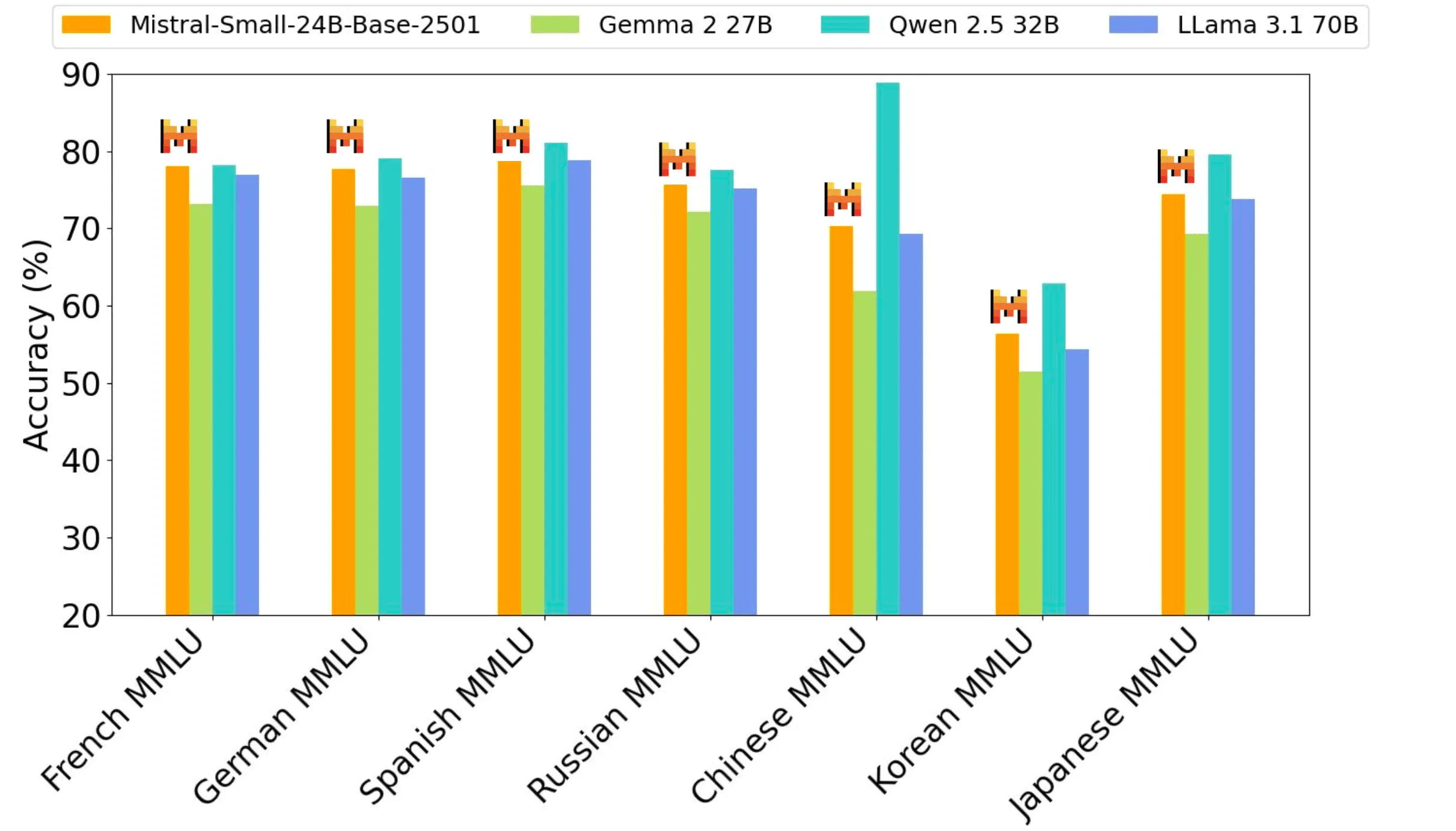

Rendimiento antes del entrenamiento

El Mistral Small 3, como modelo 24B, ofrece el mejor rendimiento para su clase de tamaño y puede igualar a modelos tres veces mayores, como el Llama 3.3 70B.

Cuándo utilizar Mistral Small 3

Entre los clientes y la comunidad de Mistral AI han surgido varios casos de uso únicos para modelos preformados a esta escala:

- Asistencia de diálogo de respuesta rápida: Mistral Small 3 destaca en situaciones que requieren respuestas rápidas y precisas. Esto incluye muchos escenarios de asistente virtual en los que los usuarios esperan una respuesta instantánea y una interacción casi en tiempo real.

- Llamadas a funciones de baja latencia: Mistral Small 3 puede gestionar la ejecución rápida de funciones cuando se utiliza como parte de un flujo de trabajo de automatización o agente.

- Ajuste para crear expertos en la materia: Mistral Small 3 puede ajustarse para centrarse en áreas específicas y crear expertos en la materia de gran precisión. Esto resulta especialmente útil en ámbitos como el asesoramiento jurídico, el diagnóstico médico y la asistencia técnica, en los que los conocimientos específicos del campo son fundamentales.

- Razonamiento local: especialmente beneficioso para aficionados y organizaciones que manejan información sensible o reservada. A la hora de cuantificar, Mistral Small 3 puede funcionar de forma privada con una sola RTX 4090 o un Macbook con 32 GB de RAM.

Los clientes de Mistral AI están evaluando Mistral Small 3 en múltiples sectores, entre ellos:

- Utilizado por clientes de servicios financieros para detectar fraudes

- Utilizado por los profesionales sanitarios para el triaje de clientes

- Empresas de robótica, automoción y fabricación para el mando y control de dispositivos.

- Los casos de uso horizontales entre clientes incluyen el servicio virtual de atención al cliente y el análisis de opiniones y comentarios.

Utilización de Mistral Small 3 en sus pilas tecnológicas favoritas

El Mistral Small 3 ya está disponible en la Plateforme como un mistral-small-latest tal vez mistral-small-2501 El texto se proporciona en forma de modelo de Mistral AI. Consulte la documentación de Mistral AI para obtener información sobre cómo utilizar los modelos de Mistral AI para la generación de texto.

Mistral AI también se complace en asociarse con Hugging Face, Ollama, Kaggle, Together AI y Fireworks AI para que el modelo esté disponible en sus plataformas a partir de hoy:

- Cara abrazada (modelo base)

- Ollama

- Kaggle

- Juntos AI

- Fuegos artificiales AI

- Próximamente en NVIDIA NIM, Amazon SageMaker, Groq, Databricks y Snowflake.

El camino a seguir

Mistral Small 3 complementa los grandes modelos de inferencia de código abierto, como el recientemente publicado DeepSeek, y puede utilizarse como un potente modelo de base para poner de relieve las capacidades de inferencia.

Entre otras muchas cosas, en las próximas semanas se lanzarán modelos Mistral pequeños y medianos con capacidades de razonamiento mejoradas. Si estás interesado en unirte al viaje de Mistral AI (Mistral AI está contratando), o ir más allá crackeando Mistral Small 3 y mejorándolo ¡ahora mismo!

El modelo de código abierto de Mistral

Mistral AI reafirma su compromiso de utilizar el protocolo Apache 2.0 para los modelos genéricos, ya que está eliminando progresivamente los modelos con licencia MRL. . Al igual que con Mistral Small 3, los pesos del modelo estarán disponibles para su descarga y despliegue local, y podrán modificarse libremente y utilizarse en cualquier entorno. Los modelos también estarán disponibles a través de API sin servidor en la Plateforme, las plataformas de despliegue local y VPC, personalización y orquestación de Mistral AI, y los socios de inferencia y nube de Mistral AI. Las empresas y los desarrolladores que necesiten funcionalidades especializadas (mayor velocidad y contexto, conocimiento específico del dominio, modelos específicos de tareas (por ejemplo, finalización de código)) pueden confiar en modelos comerciales adicionales para complementar las contribuciones de Mistral AI a la comunidad.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...