Mistral AI lanza el modelo Small 3.1: otra mejora de las capacidades multimodales de código abierto

Mistral AI ha anunciado recientemente el lanzamiento de su último modelo Mistral Small 3.1, y afirmó que era la mejor opción entre los modelos equivalentes disponibles.

Este nuevo modelo se basa en el Mistral Small 3 con mejoras significativas en el rendimiento del texto, la comprensión multimodal y el procesamiento contextual, con una ventana de contexto que se extiende a 128k tokens.Los datos oficiales de Mistral AI muestran que Small 3.1 supera a modelos comparables como Gemma 3 y GPT-4o Mini, manteniendo los 150 por segundo fichas La velocidad del razonamiento.

Uno de los aspectos más destacados de Mistral Small 3.1 es la adopción de la licencia de código abierto Apache 2.0, que permite utilizar y estudiar el modelo más ampliamente.

Las aplicaciones modernas de IA imponen mayores exigencias a las capacidades de los modelos, que deben ser capaces de procesar texto, comprender entradas multimodales, admitir varios idiomas y gestionar contextos extensos, además de ser rentables y de baja latencia. Mistral AI cree que Mistral Small 3.1 es el primer modelo de código abierto que alcanza o supera el rendimiento de los principales modelos pequeños de código cerrado en todas estas dimensiones. modelos de código abierto.

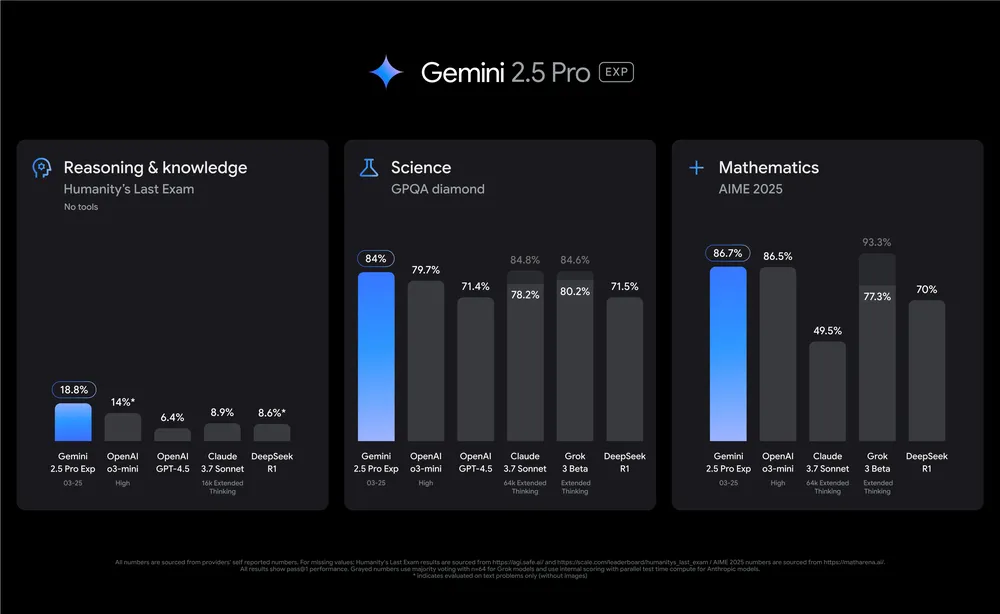

Según los datos de rendimiento publicados por Mistral AI, Mistral Small 3.1 obtiene buenos resultados en una serie de pruebas de referencia. Para garantizar la comparabilidad de los datos, Mistral AI ha utilizado cifras comunicadas por otros proveedores ранее siempre que ha sido posible; de lo contrario, el modelo se evaluó mediante su herramienta de evaluación genérica.

Cumplimiento de las instrucciones

Evaluación comparativa de comandos de texto

A continuación se muestra una comparación del rendimiento de instrucción de texto del Mistral Small 3.1 con otros modelos, incluidos el Gemma 3-it (27B), el Cohere Aya-Vision (32B), el GPT-4o Mini y el Claude-3.5 Haiku.

Tablas de datos de rendimiento

Evaluación comparativa de la instrucción multimodal

A continuación se muestran los resultados de la prueba comparativa Multimodal Command Benchmark, con la puntuación MM-MT-Bench escalada entre 0 y 100. Los modelos también incluidos en la comparación son Gemma 3-it (27B), Cohere Aya-Vision (32B), GPT-4o Mini y Claude-3.5 Haiku.

Tablas de datos de rendimiento

multilingüismo

Mistral Small 3.1 también demuestra sus puntos fuertes en el tratamiento multilingüe, comparándolo con modelos como Gemma 3-it (27B), Cohere Aya-Vision (32B) y GPT-4o Mini.

Tablas de datos de rendimiento

capacidad de procesamiento de contextos largos

Para el procesamiento de contextos largos, Mistral Small 3.1 se comparó con Gemma 3-it (27B), GPT-4o Mini y Claude-3.5 Haiku para validar su rendimiento en el procesamiento de textos largos.

Tablas de datos de rendimiento

Rendimiento antes del entrenamiento

Mistral AI también ha lanzado un modelo base preentrenado para Mistral Small 3.1.

Todos los datos de preentrenamiento

Mistral Small 3.1 Base (24B) se comparó con Gemma 3-pt (27B) para el rendimiento previo al entrenamiento.

Tablas de datos de rendimiento

escenario de aplicación

Mistral Small 3.1 se posiciona como un modelo versátil diseñado para manejar una amplia gama de tareas de IA generativa, incluyendo el seguimiento de comandos, la asistencia en el diálogo, la comprensión de imágenes y la llamada a funciones, y Mistral AI cree que establece una base sólida para aplicaciones de IA tanto empresariales como de consumo.

Atributos y capacidades clave

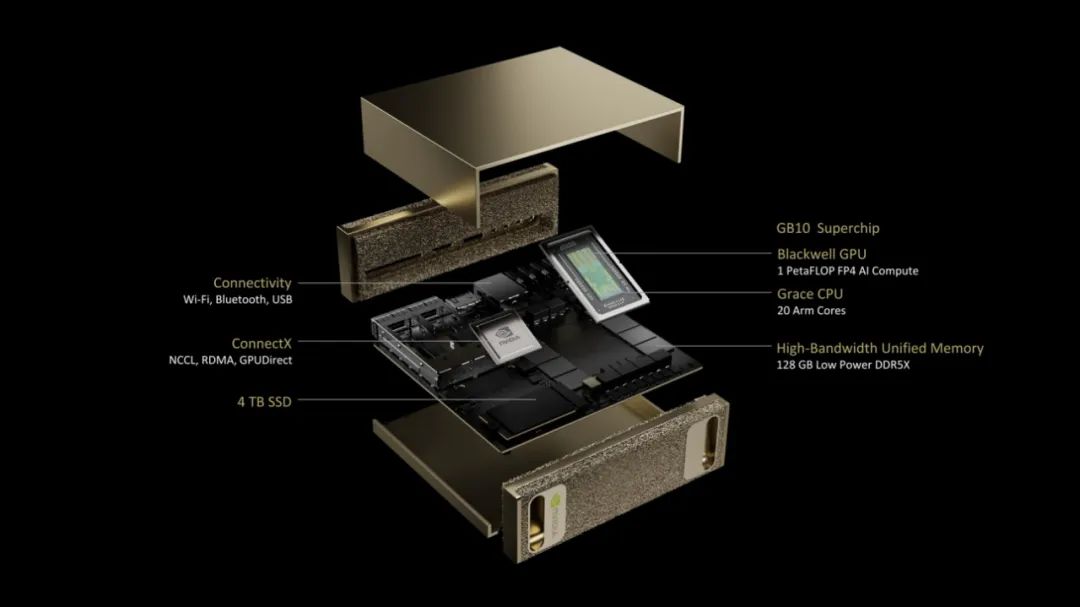

- Ligero. Mistral Small 3.1 funciona con una sola tarjeta gráfica RTX 4090 o un dispositivo Mac con 32 GB de RAM. Esto lo hace ideal para escenarios del lado del dispositivo.

- Asistencia al diálogo de respuesta rápida. Ideal para asistentes virtuales y otras aplicaciones que requieren respuestas rápidas y precisas.

- Llamadas a funciones de baja latencia. Capacidad para ejecutar rápidamente funciones en un flujo de trabajo automatizado o con agentes.

- Puesta a punto para áreas específicas. Mistral Small 3.1 puede ajustarse a ámbitos específicos para crear modelos precisos de ámbitos especializados. Esto resulta especialmente útil en ámbitos como el asesoramiento jurídico, el diagnóstico médico y el soporte técnico.

- Fundamentos del razonamiento avanzado. Mistral AI afirma que la capacidad de la comunidad para construir sobre modelos Mistral de código abierto es impresionante. En las últimas semanas han aparecido algunos modelos de inferencia excelentes basados en Mistral Small 3, como el de Nous Research DeepHermes 24B.. Con este fin, Mistral AI ha publicado el modelo base y los puntos de control del modelo de mando para Mistral Small 3.1 con el fin de facilitar la personalización posterior del modelo.

Mistral Small 3.1 cuenta con una amplia gama de escenarios de aplicación que abarcan aplicaciones empresariales y de consumo que requieren comprensión multimodal, como validación de documentos, diagnósticos, procesamiento de imágenes del lado del dispositivo, inspección visual para control de calidad, detección de objetos en sistemas de seguridad, atención al cliente basada en imágenes y asistentes en general.

usabilidad

Mistral Small 3.1 puede descargarse desde el sitio web de Hugging Face:Base Mistral Small 3.1 responder cantando Mistral Small 3.1 Instruir. Para implantaciones empresariales que requieran una infraestructura de inferencia privada y optimizada, póngase en contacto con Mistral AI.

Los usuarios también pueden utilizar la plataforma para desarrolladores de Mistral AI para La Plataforma Pruebe las llamadas a la API. El modelo también está disponible en Google Cloud Vertex AI.Mistral Small 3.1 llegará a NVIDIA NIM y Microsoft Azure AI Foundry en las próximas semanas.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...