LiteLLM: SDK de Python para la llamada unificada a múltiples API de Big Model, herramienta multiplataforma de gestión y llamada a LLM

Últimos recursos sobre IAActualizado hace 1 año Círculo de intercambio de inteligencia artificial 77.8K 00

Introducción general

LiteLLM es un SDK de Python y un servidor proxy desarrollado por BerriAI para simplificar y unificar la invocación y gestión de múltiples API de modelos de lenguaje de gran tamaño (LLM). Soporta más de 100 APIs de grandes modelos, incluyendo OpenAI, HuggingFace, Azure, etc., y las unifica en formato OpenAI, lo que facilita a los desarrolladores el cambio y la gestión entre diferentes servicios de IA. También proporciona una imagen Docker estable y una guía de migración detallada.LiteLLM permite a los usuarios llamar a más de 100 API LLM en formato OpenAI a través de un servidor proxy y Python SDK, lo que mejora enormemente la eficiencia y la flexibilidad del desarrollo.

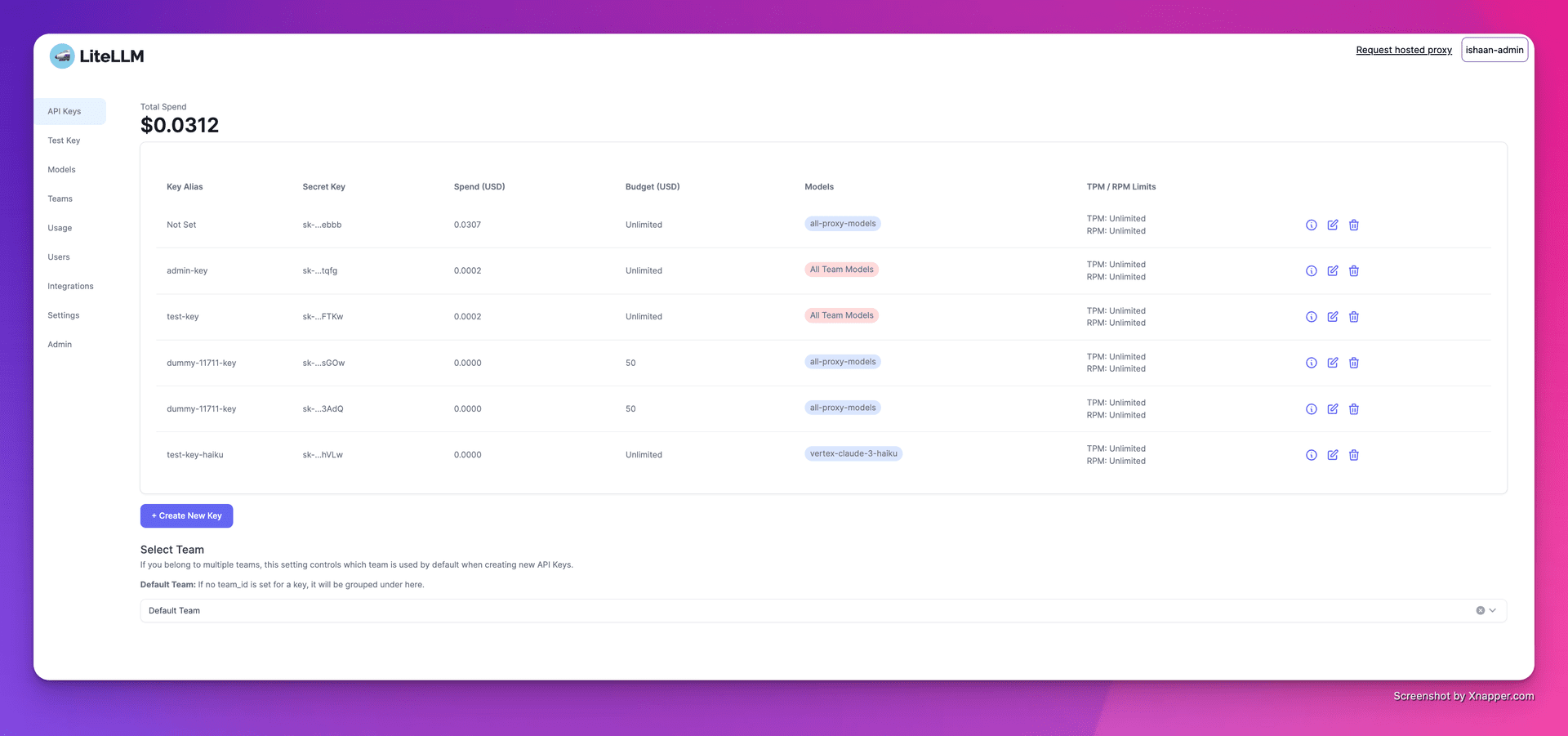

1. Creación de claves

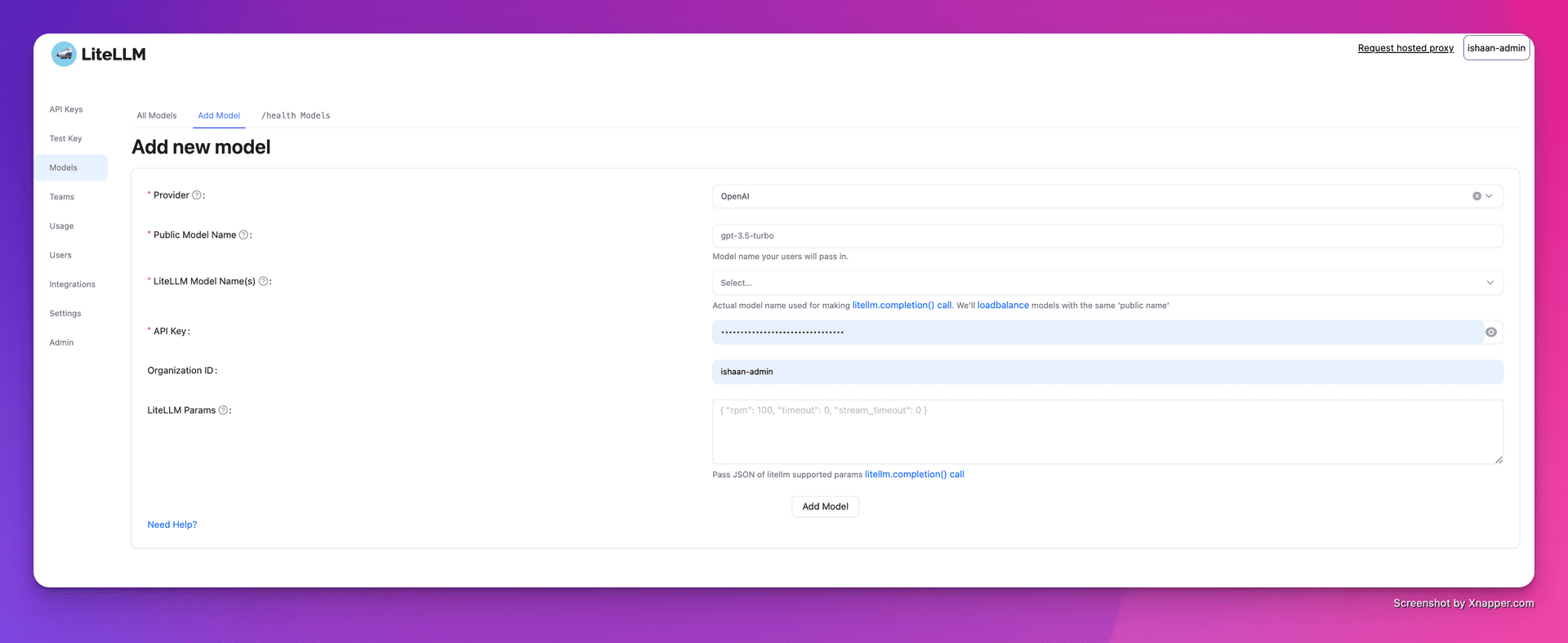

2. Añadir modelos

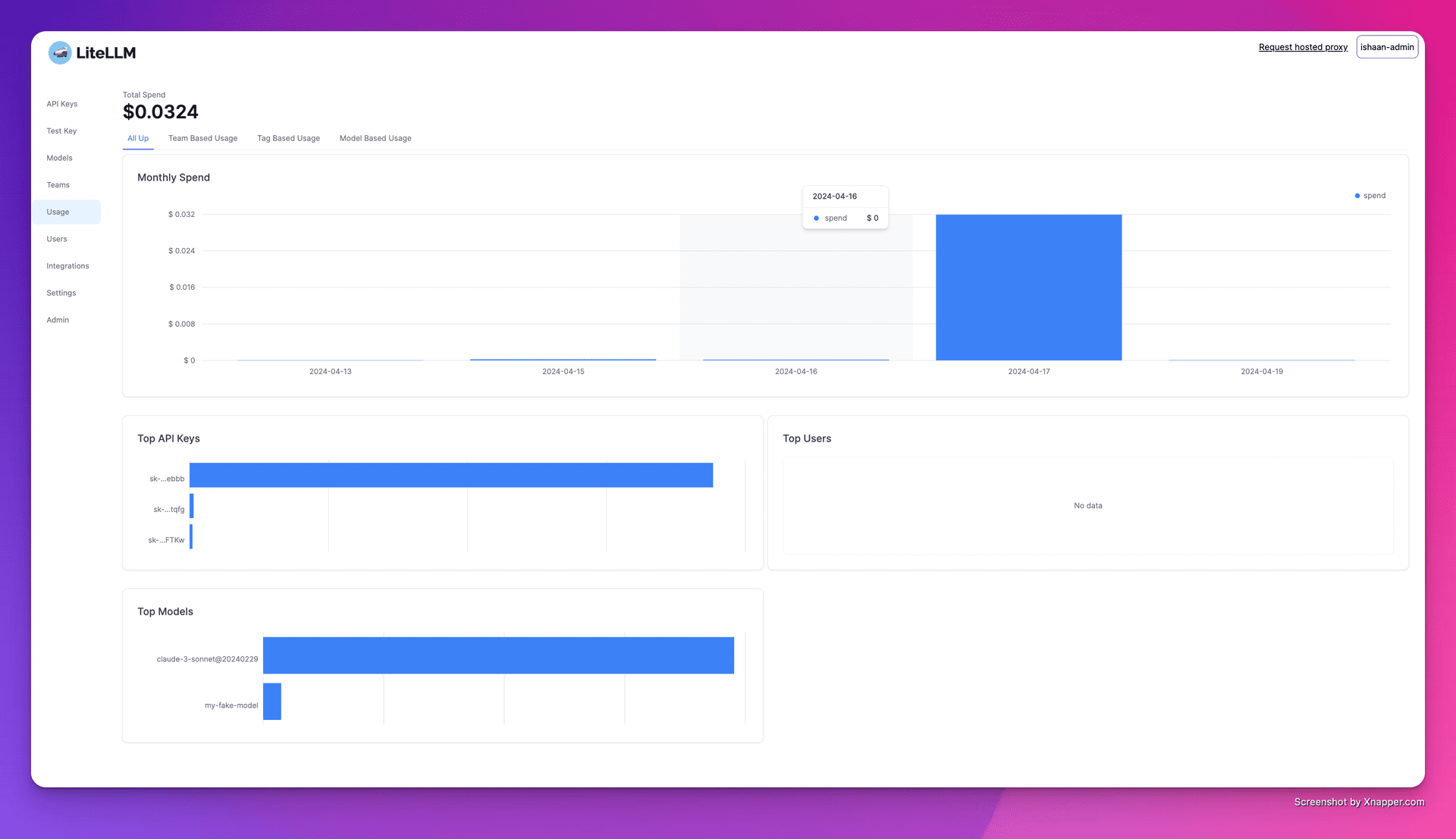

3. Seguimiento de los gastos

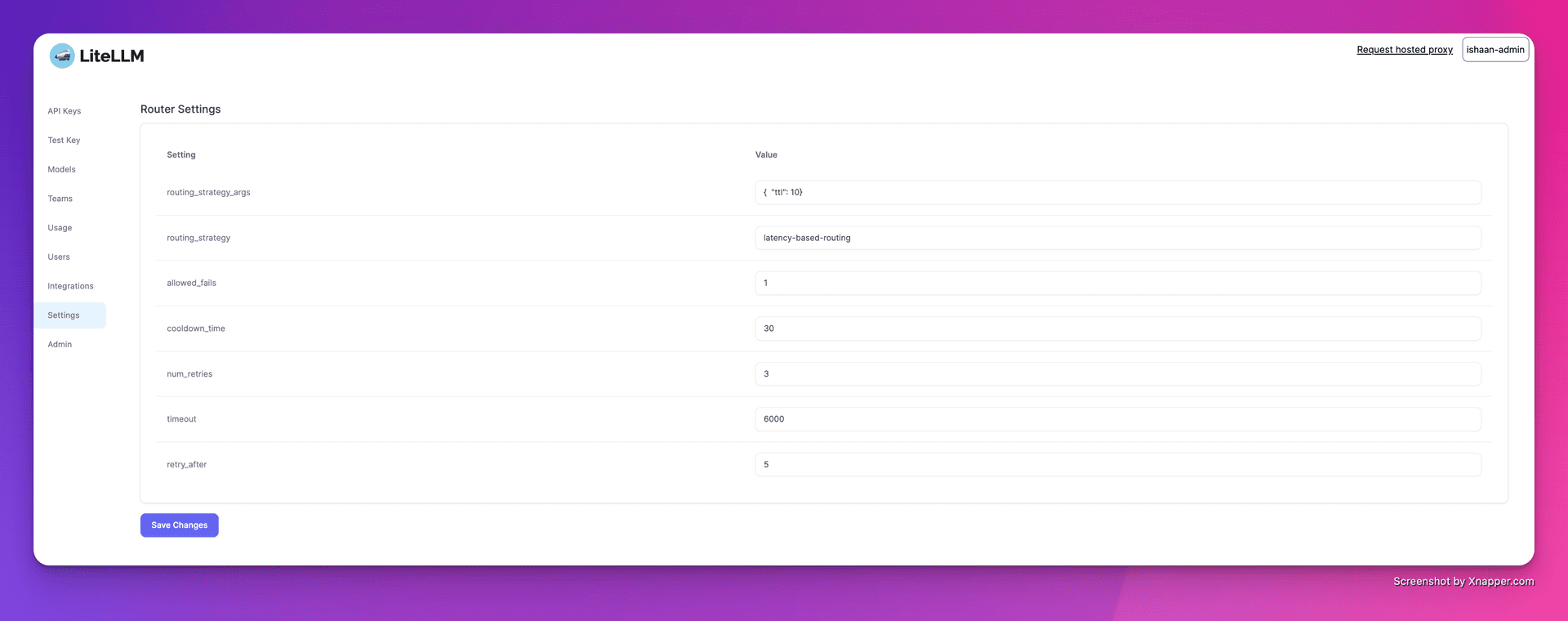

4. Configuración del equilibrio de carga

Lista de funciones

- Soporte multiplataformaSoporta múltiples proveedores LLM como OpenAI, Cohere, Anthropic, y más. Admite más de 100 llamadas a la API de grandes modelos.

- versión estableProporciona imágenes Docker estables que han sido sometidas a pruebas de carga durante 12 horas. Admite la configuración de límites de presupuesto y frecuencia de solicitud.

- servidor proxy: Invocación unificada de múltiples APIs LLM a través de un servidor proxy, conversión unificada del formato API al formato OpenAI.

- SDK de PythonSe proporciona un SDK de Python para simplificar el proceso de desarrollo.

- respuesta en tiempo real: Soporte para la transmisión de respuestas del modelo de retorno para mejorar la experiencia del usuario.

- función callback: Admite múltiples retrollamadas para facilitar el registro y la supervisión.

Utilizar la ayuda

Instalación y configuración

- Instalación de DockerAsegúrese de que Docker está instalado en su sistema.

- Tirar de los espejos: Uso

docker pullextrae una imagen estable de LiteLLM. - Iniciar el servidor proxy::

cd litellm echo 'LITELLM_MASTER_KEY="sk-1234"' > .env echo 'LITELLM_SALT_KEY="sk-1234"' > .env source .env poetry run pytest . - Configurar el cliente: Establece la dirección del servidor proxy y la clave API en el código.

import openai client = openai.OpenAI(api_key="your_api_key", base_url="http://0.0.0.0:4000") response = client.chat.completions.create(model="gpt-3.5-turbo", messages=[{"role": "user", "content": "Hello, how are you?"}]) print(response)

Funciones de uso

- modelo de invocación: a través de

model=<provider_name>/<model_name>Modelos de llamada de distintos proveedores. - respuesta en tiempo real: Ajustes

stream=TrueObtener la respuesta de streaming.response = await acompletion(model="gpt-3.5-turbo", messages=messages, stream=True) for part in response: print(part.choices.delta.content or "") - Establecimiento de retrollamadasConfigura funciones de callback para registrar entradas y salidas.

litellm.success_callback = ["lunary", "langfuse", "athina", "helicone"]

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...