Kunlun Weaver lanza en China el primer modelo de código abierto de vídeo de gran tamaño para cortometrajes de IA

Escenarios generales frente a escenarios verticales, esta es la primera elección de cara al desarrollo de grandes modelos de IA.

La mayoría de los modelos de vídeo del mercado son modelos generales que pueden generar contenidos de vídeo para diversos escenarios a partir de las palabras clave introducidas por los usuarios. Al mismo tiempo, algunos de los grandes modelos de vídeo también han empezado a explorar campos verticales más cercanos a los escenarios de aplicación, como el recientemente lanzado por ByteDance Goku El modelo, por tanto, se centra en la aplicación de bandas en directo de Digital Man.

SkyReels V1: un hito para los modelos de generación de vídeos de ficción breve con IA en China

Kunlun World Wide ha anunciado hoy SkyReels V1, el primer gran modelo chino de generación de vídeo para la creación de cortometrajes de IA. En diciembre de 2024, Kunlun Wanwei lanzó oficialmente SkyReels, una plataforma de cortometrajes de IA. SkyReels V1 proporcionará un sólido soporte tecnológico de grandes modelos para la plataforma.

De acuerdo con la observación y la experiencia reales, SkyReels V1 puede calificarse como el modelo de vídeo "con más prestaciones" del mercado. Ha demostrado su capacidad expresiva comparable a la del cine y la televisión en muchos aspectos, como las microexpresiones de los personajes, los detalles de las acciones, la construcción de escenas, la composición de imágenes y el funcionamiento de los objetivos, y es capaz de generar secuencias de rendimiento de "nivel de estrella de cine y reina".

SkyReels A1: algoritmos simultáneos de código abierto para movimientos de expresión controlados

Lanzado junto con el SkyReels V1, el SkyReels A1, que es el primer algoritmo controlable de expresión-acción basado en un modelo de base de vídeo de nivel SOTA desarrollado por KunlunWanwei.

Además, SkyReels V1 y SkyReels A1 son modelos de código abierto, y todos los usuarios pueden descargarlos y utilizarlos gratuitamente según el acuerdo de código abierto. La dirección del código abierto es la siguiente:

https://github.com/SkyworkAI/SkyReels-V1

https://github.com/SkyworkAI/SkyReels-A1

https://skyworkai.github.io/skyreels-a1.github.io/report.pdf

si DeepSeek R1 establece un nuevo punto de referencia de código abierto para grandes modelos de texto, especialmente modelos de inferencia, a continuación, Kunlun Wanwei's SkyReels V1 SkyReels A1 y SkyReels A1 han establecido un nuevo nivel de código abierto en el floreciente mercado de los cortometrajes de IA. Con el apoyo de estos dos modelos, se espera que el mercado de los cortometrajes de IA marque el comienzo del "momento DeepSeek".

1. El megamodelo de vídeo "más eficaz

SkyReels V1 es un gran modelo que se beneficia de la comunidad de código abierto y contribuye activamente a ella. Su formación se basa en HunYuan-Video, un modelo híbrido de gran vídeo de código abierto creado por Tencent en diciembre de 2023.

Aunque los modelos de código abierto funcionan bien en tareas de propósito general, su rendimiento puede no ser óptimo en dominios específicos o tareas segmentadas. En consecuencia, los proveedores de modelos suelen tener que realizar muchos ajustes, optimizar las inferencias y alinear la seguridad durante el propio proceso de formación.

En la actualidad, los grandes modelos de vídeo del mercado de los cortometrajes de AI suelen tener deficiencias en la generación de la expresión de los personajes, y el problema más destacado es que las expresiones de los personajes son vacías y carecen de viveza. Con SkyReels V1, Kunlun quiere romper estos puntos débiles de la industria.

El entrenamiento de modelos es un componente clave en el dominio de los conocimientos y capacidades de un gran modelo. En el proceso de formación de SkyReels V1, el objetivo principal de KunlunWei es enseñar al modelo "cómo actuar". Para ello, Kunlun ha llevado a cabo principalmente las dos innovaciones tecnológicas fundamentales siguientes:

Limpieza y etiquetado de datos: piedra angular del ajuste de modelos

El primero es la limpieza y etiquetado de datos, que es una parte clave del ajuste del modelo. Del mismo modo que un profesor necesita material didáctico de alta calidad para preparar una clase, KunlunWavi ha creado un conjunto de datos de películas, series de televisión y documentales de diez millones de niveles de alta calidad basado en su propio proceso de limpieza y etiquetado manual de datos de alta calidad. Esto constituye el "material didáctico" para que SkyReels V1 aprenda a actuar.

El gran modelo multimodal de comprensión de vídeo centrado en el ser humano: mejorar la comprensión de los personajes

Los "materiales didácticos" por sí solos no bastan; se necesita una orientación más profunda sobre la modelización. Por ello, KunlunWanwei ha desarrollado su propio modelo multimodal Human-Centric (centrado en los personajes) para la comprensión de vídeos. El objetivo es mejorar significativamente la capacidad del modelo para comprender la información relacionada con los personajes del vídeo.

Este sistema de análisis inteligente de personajes basado en un gran modelo multimodal de comprensión de vídeo puede lograr efectos de rendimiento de personajes "de nivel de estrella de cine" en múltiples niveles, como el reconocimiento de expresiones, la percepción de la ubicación espacial de los personajes, la comprensión de la intención de comportamiento y la comprensión de la escena de rendimiento.

¿Qué es la actuación de una "estrella de cine"?

Por ejemplo, SkyReels V1 es capaz de generar microexpresiones de personajes de calidad cinematográfica, con 33 sutiles expresiones de personajes y más de 400 combinaciones de movimientos naturales, reproduciendo así al máximo las expresiones emocionales de la vida real.

Otro ejemplo es que SkyReels V1 también domina la estética de la iluminación cinematográfica. Cada fotograma generado por SkyReels V1 tiene una calidad cinematográfica en términos de composición, posición del actor y ángulo de la cámara.

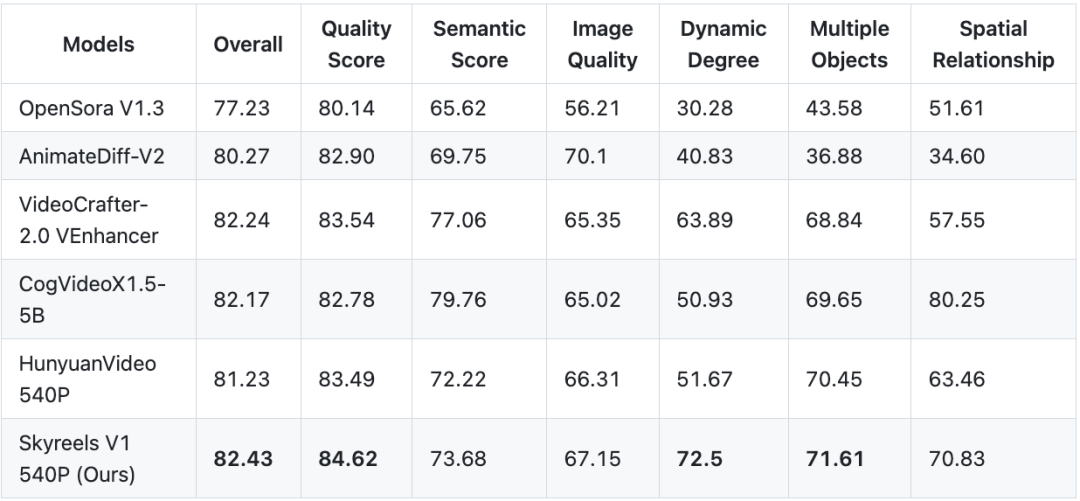

Comparación de SkyReels V1 con modelos de código cerrado

Aunque SkyReels V1 es un modelo de código abierto, genera resultados comparables a los de modelos de código cerrado como Conch AI y Corinne AI. En las mismas condiciones de palabra clave, la comparación de los resultados de generación de SkyReels V1, Conch AI y Keling AI es la siguiente:

Palabra clave 1: Una foto de una mujer de pelo castaño con unas preciosas gafas rojas y los labios pintados de carmesí. Agitó la mano hacia delante, sonriendo y luego riendo.

SkyReels V1.

Concha AI.

Kerin AI.

Palabra clave 2: Un dramático primer plano frontal muestra el rostro de un submarinista que lleva una escafandra de cobre antigua. El grueso cristal circular del casco permite ver claramente su expresión tranquila. Pequeñas burbujas flotan hacia arriba en el interior del casco, con gotas de agua adheridas a las paredes interiores. Sostiene con cuidado un libro abierto, cuyas páginas revolotean suavemente en las corrientes submarinas. El libro parecía estar seco e intacto, en marcado contraste con su acuoso entorno. Suaves rayos de sol atravesaban el agua, iluminando su rostro y proyectando un resplandor dorado sobre las páginas. Los peces nadaban a su alrededor, con colores apagados por la profundidad pero aún vivos frente al fondo azul verdoso. El submarinista lee atentamente el texto, completamente inmerso en la lectura a pesar de estar bajo el agua. La combinación surrealista de la literatura y las profundidades del océano crea una atmósfera onírica, que pone de relieve la búsqueda del conocimiento en los lugares más insospechados.

SkyReels V1.

Concha AI.

Kerin AI.

En términos de resultados reales, SkyReels V1 muestra la fuerza de los modelos de código cerrado en términos de claridad de imagen y la finura del rendimiento de los personajes. SkyReels V1 supera incluso a los modelos de código cerrado en cuanto a la dinámica del pelo y otros detalles.

Las funciones de vídeo generado por gráficos no tienen parangón en los modelos de código abierto

Además, SkyReels V1 no sólo admite vídeo generado por texto, sino también vídeo generado por imágenes, que es uno de los modelos de vídeo generado por gráficos más potentes entre los modelos de código abierto actuales.

Para validar la capacidad de SkyReels V1 de generar gráficos de vídeo, alimentamos el modelo con imágenes fijas de la popular marmota de la película sobre el Año Nuevo chino Ne Zha's Demon Child Descends, y establecimos una palabra de referencia: la marmota mira hacia arriba, hace una pausa de un segundo y, a continuación, grita. Los resultados generados por SkyReels V1 son asombrosos:

Podría decirse que sí.SkyReels V1 es el macromodelo de vídeo con más prestaciones del mercado actual.

2. Marco de inferencia de desarrollo propio SkyReels Infer: creación de un modelo de código abierto para todos

Lo que es aún más valioso es que SkyReels V1, como modelo de código abierto, no sólo ha logrado un avance significativo en la generación de resultados, sino que también tiene una eficiencia de inferencia muy alta. Esto es gracias a SkyReels Infer, un marco de razonamiento desarrollado por Kunlun Wanwei.

Implicaciones de un marco de razonamiento propio

¿Qué importancia tienen los marcos de razonamiento autoinvestigativo?

En general, los modelos de código abierto no suelen optimizarse específicamente para los marcos de inferencia, sobre todo en escenarios de aplicación a gran escala. Sin embargo, si no se optimiza el marco de razonamiento, es difícil satisfacer los requisitos de experiencia del usuario en términos de eficacia y coste del razonamiento.

Un ejemplo es el lanzamiento de OpenAI a principios de 2024. Sora En aquel momento, algunos usuarios informaron de que Sora tardaba una hora en generar un vídeo de un minuto. Esta fue una de las principales razones por las que Sora dejó de funcionar casi un año después de su lanzamiento. A día de hoy, muchos grandes modelos de vídeo siguen sufriendo largos tiempos de espera para la generación de vídeos.

SkyReels Infer, el marco de inferencia desarrollado por KunlunWanwei, no sólo mantiene un alto rendimiento, sino que también tiene en cuenta la eficiencia y la facilidad de uso.

Rendimiento superior de SkyReels Infer

La velocidad de razonamiento de SkyReels Infer es excelente. En una sola tarjeta RTX 4090, solo se tardan 80 segundos en generar un vídeo 544P. Los usuarios pueden estar ensimismados o navegando por el móvil y el vídeo ya está generado.

SkyReels Infer admite la computación paralela distribuida multitarjeta. Se trata de una tecnología muy potente. En pocas palabras, permite que varias tarjetas gráficas trabajen juntas en tareas de generación de vídeo.

Con tecnologías como Context Parallel, CFG Parallel y VAE Parallel, varias tarjetas gráficas trabajan juntas como un equipo altamente eficiente para alcanzar importantes velocidades de procesamiento. Esto resulta especialmente útil para aplicaciones que requieren cálculo a gran escala, como la creación de animaciones complejas o vídeos con efectos especiales.

SkyReels Infer también destaca en la optimización de memoria de vídeo baja. Utiliza la cuantificación fp8 y la tecnología de descarga a nivel de parámetros para que SkyReels Infer funcione sin problemas incluso en tarjetas gráficas normales con poca memoria de vídeo.

La memoria gráfica es un parámetro clave de una tarjeta gráfica, que determina la cantidad de datos que la tarjeta puede procesar simultáneamente. En el pasado, muchos modelos de generación de vídeo requerían una memoria gráfica elevada, lo que a menudo impedía al usuario medio utilizarlos por falta de rendimiento de la tarjeta gráfica. La optimización de la memoria baja de SkyReels Infer ha cambiado por completo esta situación. Esto significa que los usuarios pueden experimentar fácilmente la potencia de los modelos de generación de vídeo sin tener que adquirir costosas tarjetas gráficas de gama alta. Sin duda, esto reduce el umbral de generación de vídeo de IA, lo que permite a más usuarios disfrutar de la diversión de la tecnología de IA.

SkyReels Infer se basa en la biblioteca de código abierto Diffuser. La biblioteca Diffuser es una excelente biblioteca de código abierto que proporciona una gran cantidad de funciones y herramientas. SkyReels Infer se basa en la biblioteca Diffuser y, naturalmente, hereda muchas de sus ventajas. Para los desarrolladores, esto significa que pueden empezar rápidamente e integrar fácilmente SkyReels Infer en sus proyectos existentes.

Comparación de resultados

¿Cuál es el rendimiento real de SkyReels Infer? Kunlun utiliza SkyReels V1 con SkyReels Infer para comparar su rendimiento con HunYuan-Video de código abierto de Tencent. Los resultados de las pruebas muestran que SkyReels V1 tiene mejor velocidad y latencia que HunYuan-Video a la hora de generar vídeos de 544p.

Además, SkyReels V1 admite una estrategia de despliegue multitarjeta, lo que permite utilizar hasta 8 tarjetas gráficas simultáneamente para acelerar las tareas informáticas. Además, SkyReels V1 es compatible con tarjetas gráficas de gama alta, como la A800, y de consumo, como la RTX 4090, lo que satisface las necesidades de usuarios profesionales y ocasionales.

3. SkyReels A1: tecnología "AI face-swapping" líder del sector con algoritmos de control del movimiento de la expresión de código abierto

Cabe mencionar que tras las sesiones de entrenamiento e inferencia del modelo, elCon el fin de lograr una generación de vídeo de personajes más precisa y controlable, Kunlun también ha abierto SkyReels A1, un algoritmo controlable para movimientos de expresión basado en un modelo de vídeo base.

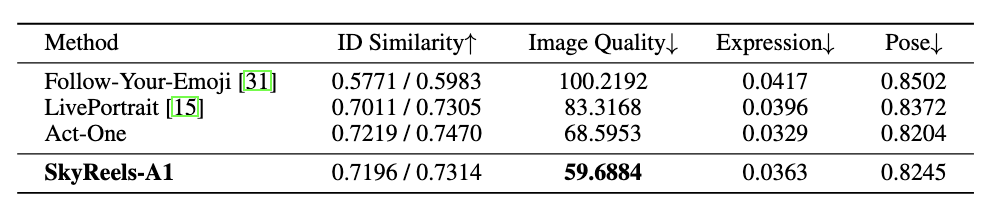

SkyReels A1 es un algoritmo de capa de aplicación que se asienta sobre la tecnología subyacente de formación e inferencia, y se compara con la tecnología Act-One de Runway para la captura de expresiones cinematográficas.

Juego "AI Face Swap" de SkyReels A1.

El juego principal de Runway Act-One y Kunlun SkyReels A1 es "AI Face Swap": los usuarios sólo tienen que preparar una foto del personaje A y un videoclip del personaje B, y luego la expresión, el movimiento y las líneas del personaje B se pueden trasplantar directamente al personaje A.

En términos de similitud de ID, calidad de imagen, expresión y pose, SkyReels A1 consigue resultados SOTA (State of the Art) en comparación con algoritmos de código abierto similares del sector. En comparación con algoritmos de código abierto similares del sector, SkyReels A1 consigue resultados SOTA (State of the Art), que se acercan a los de la tecnología Act-One de código cerrado, con una ventaja en la calidad de generación.

Captura de expresión cinematográfica basada en vídeo

En primer lugar, SkyReels A1 permite capturar expresiones cinemáticas a través del vídeo, con un mayor grado de control de la expresión de los personajes que Runway Act-One.

Reproducción de microexpresiones de alta fidelidad

Lo siguiente es la reproducción de microexpresiones de alta fidelidad. SkyReels A1 es capaz de generar vídeo de gran realismo de personas en movimiento a cualquier escala humana, incluidos retratos y composiciones de medio cuerpo y cuerpo entero. Este realismo procede de la simulación precisa de los cambios de expresión y las emociones, así como de la profundidad de los detalles multidimensionales, como la textura de la piel y el seguimiento del movimiento corporal.

Por ejemplo, la generación de control de expresión facial lateral:

y generación de microexpresiones de cejas y ojos más realistas:

Retención facial y procesamiento de movimientos amplios

Además de en microexpresiones, SkyReels A1 también supera a Runway Act-One en áreas como la retención de rostros y el procesamiento de movimientos a gran escala. La retención de rostros y el procesamiento de movimientos a gran escala son precisamente las áreas en las que muchos modelos de generación de vídeo son propensos a cometer errores.

Por ejemplo, en el caso siguiente, la cara del personaje situado más a la derecha muestra una distorsión significativa que no coincide con la imagen original del personaje.

SkyReels A1 también permite un mayor movimiento natural de la cabeza y el cuerpo. En el caso siguiente, el cuerpo del personaje situado más a la derecha casi no tiene movimiento.

Es fácil ver que los algoritmos SkyReels A1 simplifican el complejo proceso de la producción de vídeo tradicional, proporcionando a los creadores de contenidos una solución eficaz, flexible y de bajo coste que puede utilizarse ampliamente en la producción de una gran variedad de contenidos creativos.

4. El "momento DeepSeek" en el mercado de los cortometrajes de IA

El código abierto de SkyReels V1 y SkyReels A1 es sólo el primer paso del plan de código abierto de KunlunWei para modelos de vídeo de gran tamaño. En el futuro, Kunlun continuará abriendo tecnologías relacionadas, incluidas versiones de control de espejos de calidad profesional, parámetros de modelos con resolución 720P, parámetros de modelos para conjuntos de datos de entrenamiento más grandes y algoritmos de generación de vídeo compatibles con la generación controlada de cuerpo completo.

De hecho, el código abierto está integrado desde hace tiempo en el ADN de Kunlun World Wide. Fang Han, Presidente y Consejero Delegado de Kunlun World Wide, como padre fundador de Linux chino, uno de los Cuatro Mosqueteros de Linux chino y uno de los primeros expertos en ciberseguridad de China, cuenta con 30 años de experiencia en la industria de Internet. Fang Han ha participado activamente en el movimiento del código abierto desde 1994, y es uno de los primeros promotores del concepto de código abierto en Internet.

Fang Han ha declarado públicamente que el gran modelo de código abierto es un importante complemento y alternativa al gran modelo comercial de código cerrado, con la esperanza de promover la democratización de la tecnología y rebajar el umbral de la industria a través del código abierto.

Ya en diciembre de 2022, Kunlun WV publicó toda la serie de algoritmos y modelos de AIGC "Kunlun Tiangong", y anunció el código abierto completo. Kunlun no solo es una de las empresas con el diseño más completo en el campo nacional de AIGC, sino también la primera empresa de China en dedicarse a la comunidad de código abierto de AIGC.

En los últimos tres años, KunlunWanwei ha estado lanzando y abriendo la serie Tiangong de grandes modelos. En abril de 2024, KunlunWei lanzó Tiangong 3.0, un supermodelo de MoE con 400.000 millones de parámetros, cuyo rendimiento supera al de Grok 1.0, y al mismo tiempo abrió su código fuente. En junio de 2024, KunlunWei volvió a publicar en código abierto el modelo MoE disperso de 200.000 millones, convirtiéndose en el primer modelo MoE de código abierto de 100.000 millones que admite la inferencia en un único servidor RTX 4090. En noviembre de 2024, KWL puso en código abierto Skywork-o1-Open y otras series de modelos.

Con la creencia en la tecnología de código abierto, Kunlun se compromete a impulsar la industria para hacer realidad el sueño de la AGI (Inteligencia Artificial General).

Desde que entró en el campo de la IA en 2020, Kunlun ha completado la disposición de toda la cadena industrial de "infraestructura aritmética - algoritmo de gran modelo - aplicación de IA" y ha construido una matriz empresarial de IA diversificada.

Los cortometrajes de IA son un segmento importante de la diversificada matriz de aplicaciones de IA de Kunlun.

Las series cortas de AI son un mercado emergente, que se espera que experimente un gran crecimiento en 2025. El "2024 Short Drama Overseas Marketing White Paper" publicado por TikTok for Business predice que la media mensual de usuarios de short drama en los mercados extranjeros alcanzará los 200-300 millones en el futuro, y se espera que el tamaño del mercado alcance los 10.000 millones de dólares, por lo que el potencial del mercado es enorme.

En diciembre de 2024, KunlunWanwei lanzó la plataforma de cortometrajes de IA Skyreels en Estados Unidos, lo que supuso un paso importante para KunlunWanwei en el mercado global del entretenimiento de IA y aportó una nueva experiencia de cortometrajes inteligentes al público norteamericano. La plataforma de cortometrajes SkyReels AI no sólo proporciona potentes herramientas de creación para creadores de contenidos profesionales, sino que también reduce significativamente el umbral de creación de cortometrajes AI, facilitando el inicio a usuarios no profesionales.

Repercusiones de largo alcance de la IA en la industria mundial del cine y la televisión

¿Cómo revolucionará la tecnología de la IA la industria mundial del cine y la televisión?

En su discurso en la Conferencia Mundial sobre Inteligencia Artificial 2024, Fang Han, Presidente de Kunlun World Wide, señaló que la IA encierra un enorme dividendo de desarrollo en el extranjero, especialmente en los países de lengua pequeña.

Citando como ejemplo la industria del cine y el teatro, señaló que cuesta unos 20.000 dólares producir una película en Nigeria. Una producción así es claramente poco competitiva si se compara con Tierra Errante, cuya producción costó a China 300 millones de RMB, y Avatar, cuya producción costó a Estados Unidos cientos de millones de dólares. Sin embargo, se espera que la llegada de la tecnología de IA reduzca esta brecha.

"Mi predicción personal es que, dentro de 3-5 años, el coste de producción de una superproducción del nivel de la Tierra Errante podría bajar a decenas de miles de dólares con la ayuda de la tecnología de IA. Esto brindará enormes oportunidades de desarrollo a muchas regiones de ultramar. La gente de todo el mundo está ansiosa por ver productos culturales localizados, ya sean novelas, música, vídeos o cómics, y necesita contenidos más cercanos a su cultura local. Por lo tanto, la IA en el extranjero alberga un enorme dividendo de desarrollo". afirmó Fang Han.

A un nivel menor, el dividendo que aporta la IA reside en la reducción exponencial del coste de producción de los productos culturales, que hace posible el modo de creación de "una persona, un drama". A un nivel más amplio, al reducir el umbral de creación, la tecnología AIGC capacita a grupos culturales desfavorecidos para producir contenidos por sí mismos, lo que promoverá la afirmación cultural global, que es la mejor manifestación de la tecnología para el bien.

El sector suele considerar la aparición de la IA como el "momento iPhone", pero Fang Han cree que la IA se parece más a la revolución de la cámara de los teléfonos móviles, porque la cámara desencadenó un cambio en la forma de filmar, que a su vez dio origen a enormes plataformas de vídeos cortos como Jitterbug y Shutterbug. Del mismo modo, la IA también dará lugar a un gran número de nuevas plataformas de UGC de IA, abriendo una edad de oro de la producción y el consumo de contenidos personalizados.

SkyReels V1, el primer modelo de generación de vídeo de código abierto para la creación de obras cortas de IA, y SkyReels A1, el primer algoritmo de nivel SOTA para el control de las expresiones faciales basado en un modelo de base de vídeo, son precisamente las herramientas para acelerar la universalidad de la era AIGC. SkyReels V1, el primer modelo de generación de vídeo de código abierto para la creación de cortometrajes de IA, y SkyReels A1, el primer algoritmo de nivel SOTA para controlar las expresiones faciales basado en un modelo de base de vídeo, son precisamente las herramientas para acelerar la llegada de la era AIGC.

Se espera que el mercado de los cortometrajes con IA inaugure el "momento DeepSeek" que le pertenece.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...