InspireMusic: marco unificado de generación de música, canciones y audio de código abierto de Ali.

Últimos recursos sobre IAActualizado hace 1 año Círculo de intercambio de inteligencia artificial 54.8K 00

Introducción general

InspireMusic es un conjunto de herramientas de código abierto basado en PyTorch centrado en la generación de música, canciones y audio. Proporciona un marco unificado para generar audio de alta calidad con control sobre las pistas de texto, la estructura de la música y el estilo musical. InspireMusic admite la generación de audio a 24kHz y 48kHz y es capaz de generar audio de larga duración. El objetivo de InspireMusic es ayudar a los usuarios a innovar los paisajes sonoros y mejorar la estética armónica en la investigación musical a través del proceso de etiquetado y des-etiquetado de audio.

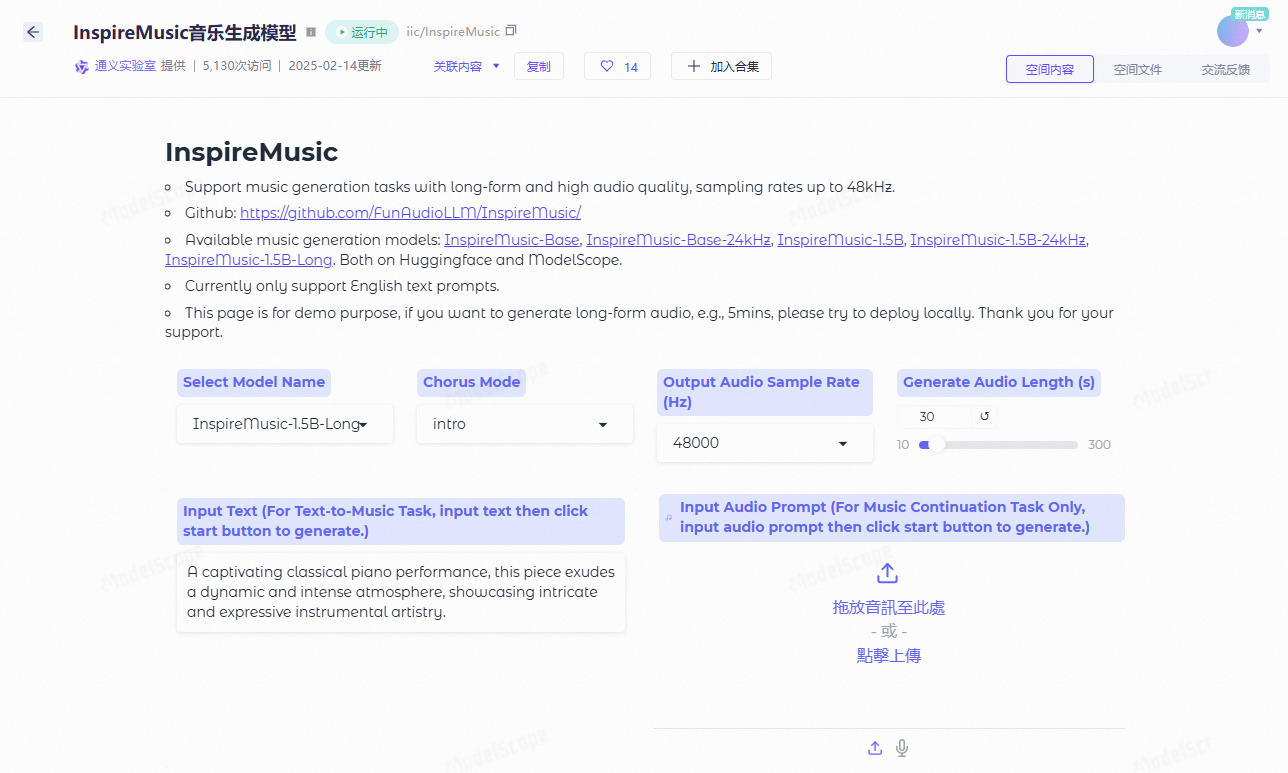

Demostración: https://modelscope.cn/studios/iic/InspireMusic/summary

Lista de funciones

- Texto a música: Genera música a partir de pistas de texto.

- Control de la estructura musical: Soporte para generar música basada en estructuras musicales.

- Control del estilo musical: Puedes controlar el estilo de la música generada.

- Generación de audio de alta calidad: Admite la generación de audio de 24 kHz y 48 kHz.

- Generación de audio de larga duración: Admite la generación de audio de larga duración.

- Entrenamiento de precisión mixtoAdmite la formación de precisión mixta BF16, FP16/FP32.

- Ajuste e inferencia del modelo: Facilita el ajuste y el razonamiento sobre guiones y estrategias.

- Demostración en línea: Está disponible una demostración en línea y los usuarios pueden experimentarla en ModelScope y HuggingFace.

Utilizar la ayuda

Proceso de instalación

- Almacén de clonación:

git clone https://github.com/FunAudioLLM/InspireMusic.git

cd InspireMusic

- Instale la dependencia:

pip install -r requirements.txt

- Instale PyTorch (elija el comando de instalación adecuado para su versión de CUDA):

pip install torch torchvision torchaudio

Normas de uso

Texto a música

- Prepare indicaciones de texto, por ejemplo: "Genere una pieza optimista de música para piano".

- Ejecute el script de generación:

python app.py --text "生成一段欢快的钢琴音乐"

- La música generada se guardará en el directorio de salida especificado.

Control de la estructura musical

- Prepara un archivo de estructura musical que defina los ritmos, acordes, etc. de la música.

- Ejecute el script de generación:

python app.py --structure path/to/structure/file

- La música generada se basará en el archivo de estructura.

Control del estilo musical

- Seleccione un estilo musical predefinido, por ejemplo "Clásica", "Jazz", etc.

- Ejecute el script de generación:

python app.py --style "古典"

- La música generada coincidirá con el estilo musical seleccionado.

Ajuste e inferencia del modelo

InspireMusic proporciona cómodos scripts de ajuste e inferencia que permiten a los usuarios ajustar el modelo y la inferencia según sus necesidades. A continuación se muestra un sencillo ejemplo de ajuste:

- Prepare el conjunto de datos de entrenamiento.

- Ejecute el script de ajuste:

python finetune.py --data path/to/dataset --output path/to/output/model

- Inferencia mediante un modelo ajustado:

python app.py --model path/to/output/model --text "生成一段新的音乐"

Demostración en línea

Los usuarios pueden visitar las páginas de demostración en línea de ModelScope y HuggingFace para experimentar la potencia de InspireMusic. Basta con introducir texto para generar música de alta calidad.

jian27 Paquete de integración

Quark: https://pan.quark.cn/s/4843d9c54615

Baidu: https://pan.baidu.com/s/1hKIHENqPbKRBjnbVRBni7Q?pwd=2727

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...