Informe técnico de KAG, el primer marco de servicios profesionales de mejora del conocimiento de dominios en China, que ayuda a los grandes modelos a aterrizar en dominios verticales.

Recientemente, Liang Lei, responsable del motor de conocimiento de Ant Group, compartió en la Conferencia Bund los avances del equipo en los últimos seis meses en la investigación de la fusión del grafo de conocimiento y el modelo de lenguaje a gran escala, y lanzó KAG, el primer marco de servicios de mejora del conocimiento para dominios profesionales en China, que ayuda a construir inteligencias profesionales con funciones de mejora del conocimiento. Este artículo es una recopilación textual del contenido del informe.

Informes técnicos relacionados Dirección arXiv:https://arxiv.org/pdf/2409.13731

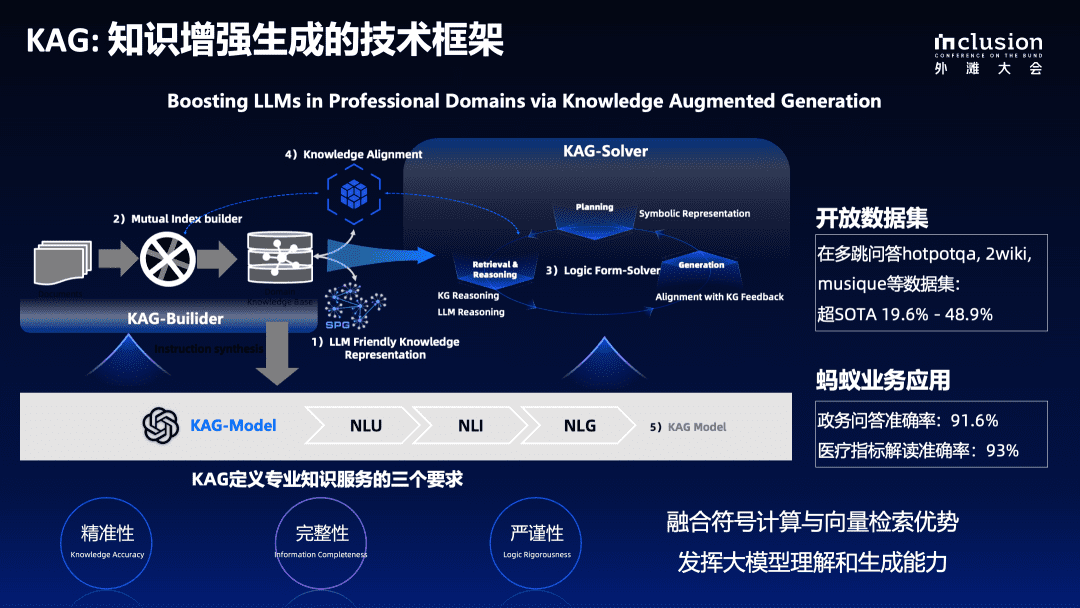

Esta vez hemos anunciado KAG del informe técnico general. Esperamos fusionar realmente las ventajas de la computación simbólica y la recuperación vectorial de grafos de conocimiento, ya que son complementarias en muchos sentidos. Al mismo tiempo, aprovecharemos las capacidades de comprensión y generación de los grandes modelos lingüísticos para construir un sistema de generación de grandes modelos lingüísticos basado en el conocimiento.

Estamos a punto de estar en OpenSPG El marco KAG está publicado en el proyecto de código abierto, dirección GitHub:

https://github.com/OpenSPG/KAG

Cuestiones clave en la aplicación de grandes verticales de modelización

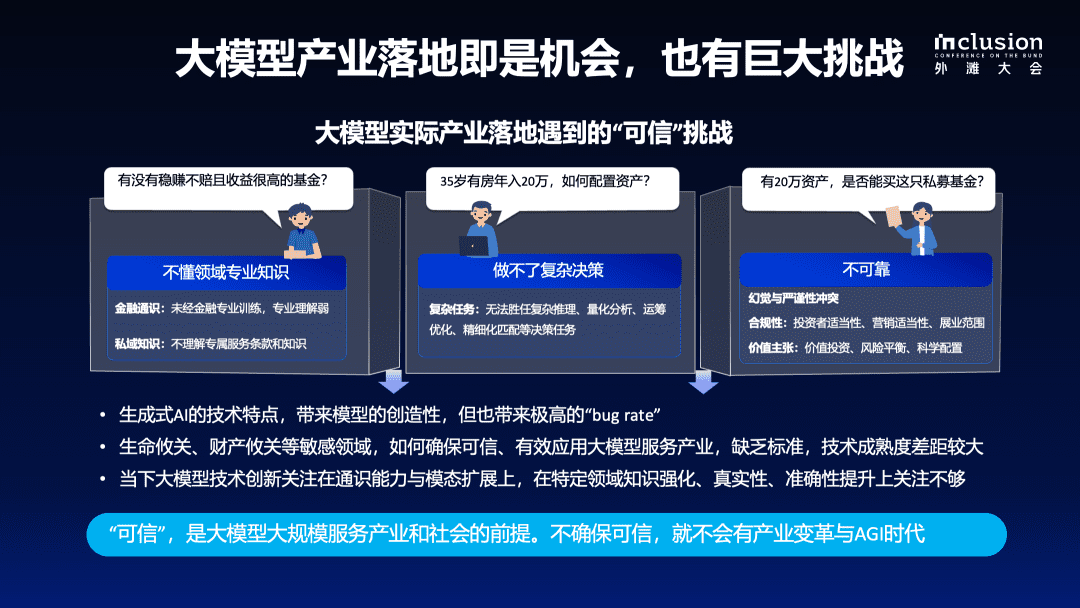

Tras casi dos años de investigación y práctica, la industria ha reconocido en general los puntos fuertes y las limitaciones de los Big Language Models, así como sus retos en aplicaciones específicas del sector. Aunque los Big Language Models han demostrado una gran capacidad de comprensión y generación, siguen existiendo problemas como la falta de conocimiento del dominio, la dificultad para tomar decisiones complejas y la falta de fiabilidad en dominios profesionales. Creemos que la "fiabilidad" es un prerrequisito clave para la implementación de los Big Language Models en escenarios del mundo real.

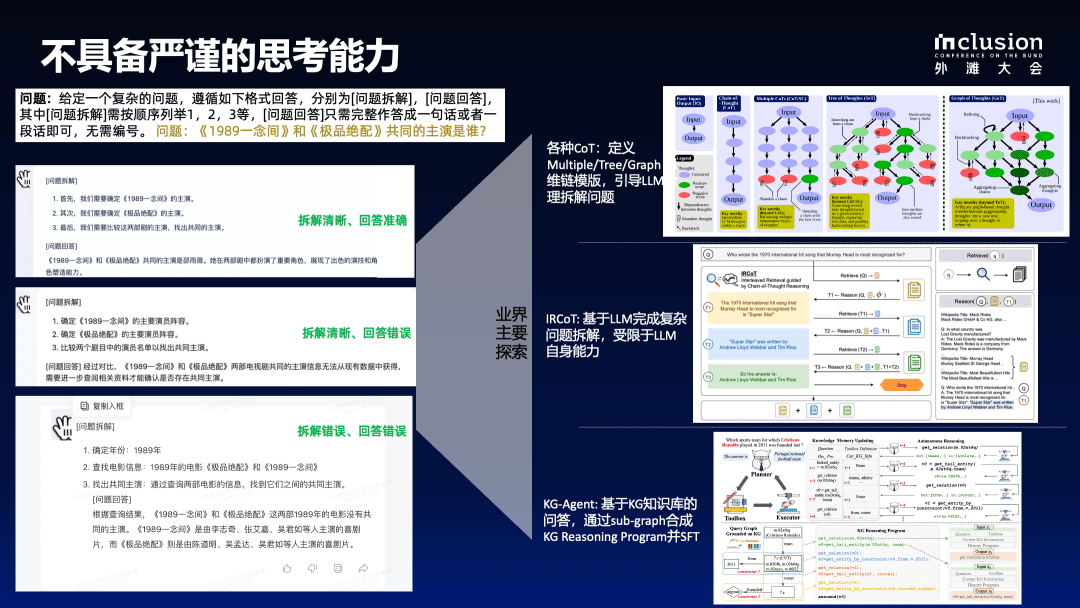

1.1 LLM no tiene capacidad de pensamiento crítico

En primer lugar, los grandes modelos lingüísticos no proporcionan capacidades de razonamiento rigurosas. Por ejemplo, utilizamos la pregunta "¿Quién es la estrella común de 1989 Un pensamiento y El mejor partido?". Para esta pregunta, probamos varios modelos lingüísticos de gran tamaño en China por separado, y los resultados muestran que la precisión y la coherencia de las respuestas son bajas. Incluso si algunos modelos pueden dar una respuesta, hay errores lógicos o un desmontaje inadecuado del problema. A medida que las condiciones se hacen más complejas, como cambiar las condiciones a "actor principal masculino" y "actor principal femenino" o añadir restricciones de tiempo, la precisión y la estabilidad seguirán disminuyendo.

Para resolver estos problemas, se han llevado a cabo muchas exploraciones en la industria. Por ejemplo, mediante la construcción del modelo de cadena de pensamiento (COT) y la definición de la plantilla de cadena de pensamiento múltiple/árbol/grafos, se guía a LLM para desmontar razonablemente el problema. Este año, cada vez más investigaciones se han centrado en llevar la RAG para compensar su falta de información factual. Otros avances son GraphRAG, que emplea estructuras gráficas para optimizar los mecanismos de recuperación.

La introducción de bases de conocimiento externas está muy extendida hoy en día, pero incluso cuando se introducen técnicas como RAG para que las bases de conocimiento o los archivos de hechos específicos de un dominio estén disponibles para su regeneración en grandes modelos lingüísticos, la precisión de las respuestas generadas sigue sin estar totalmente garantizada.

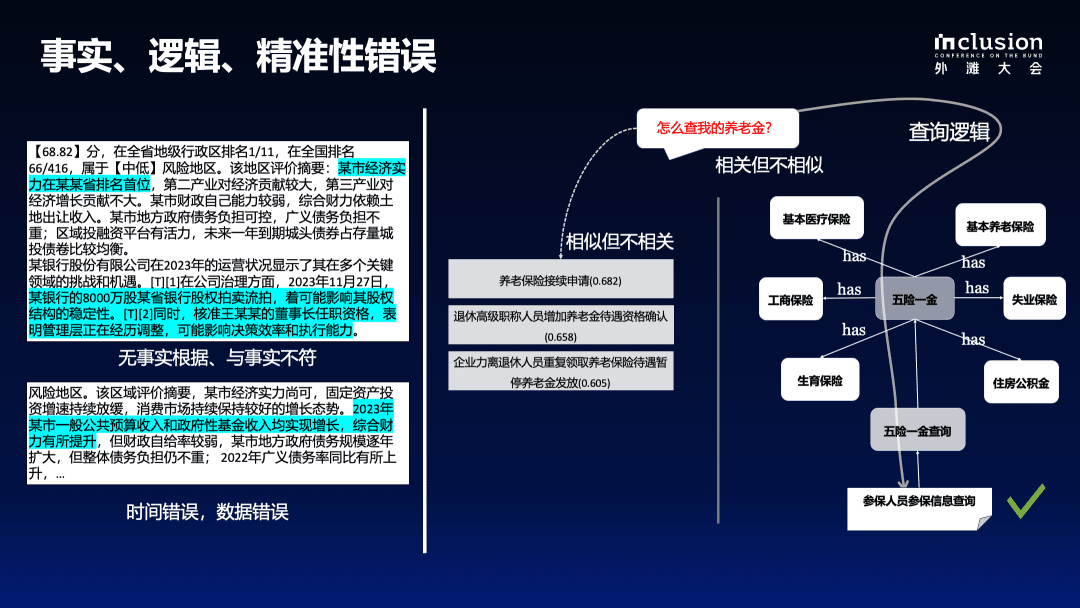

1.2 Errores de hecho, de lógica y de precisión

La parte izquierda de la siguiente figura muestra un ejemplo de uso de un gran modelo para interpretar un indicador de un informe gubernamental. Aunque los empresarios lo hayan marcado de antemano, el gran modelo seguirá añadiendo su propia interpretación, lo que dará lugar a una información distorsionada o a errores sin fundamento. Por ejemplo, se menciona que una determinada ciudad ocupa el primer lugar en una determinada provincia, pero esto es incorrecto desde el punto de vista empresarial. Del mismo modo, la información sobre una participación de 80 millones de dólares en un banco que salió a subasta no está presente en el documento original. Peor aún, el modelo también produce errores numéricos y lógicos, donde las métricas empresariales proporcionadas en el documento original pertenecen a 2022, pero el contenido generado está etiquetado como 2023.

Las imprecisiones en el proceso de recuperación siguen siendo un problema incluso cuando se proporciona una base de conocimientos externa. El ejemplo de la derecha ilustra las deficiencias del enfoque GAR basado en el cálculo de vectores. Por ejemplo, cuando se consulta cómo encontrar una pensión, el uso directo de vectores para calcular los documentos recuperados no se corresponde con los conocimientos definidos por los expertos de la empresa.

En los dominios verticales, muchos conocimientos están en realidad estrechamente relacionados entre sí, aunque a primera vista no parezcan similares. Por ejemplo, "pensión" pertenece a la categoría de "cinco seguros y una pensión", que está estrechamente relacionada con la política nacional, y el gran modelo no puede generar esa información arbitrariamente. Por tanto, se necesita una estructura de conocimiento del dominio predefinida para limitar el comportamiento del modelo y proporcionar una entrada de conocimiento eficaz.

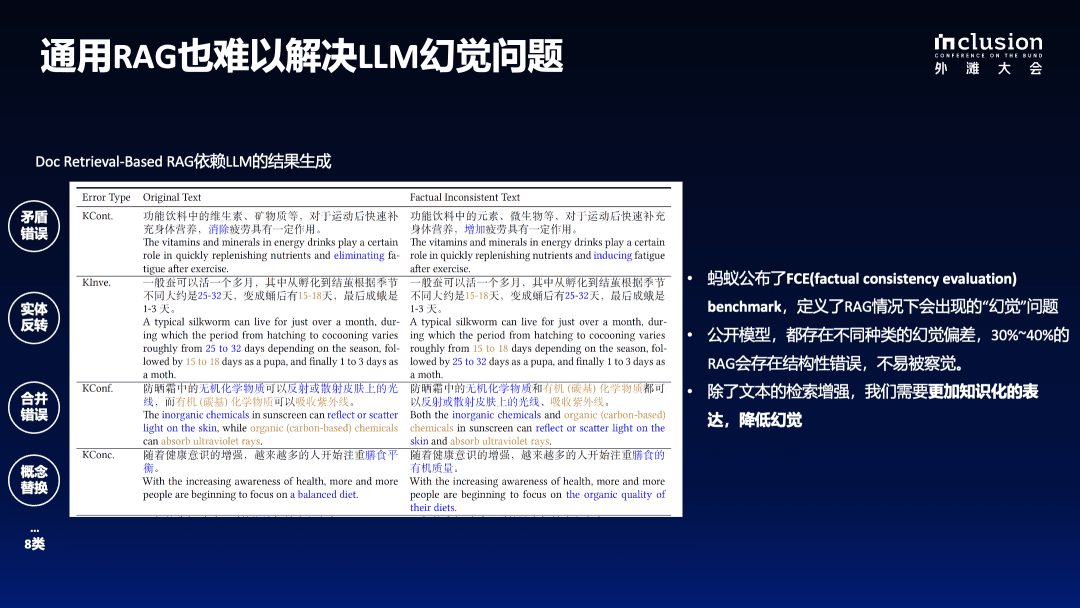

1.3 El GAR genérico tampoco resuelve las ilusiones del LLM

Como se muestra en la figura siguiente, el texto original menciona que las vitaminas y minerales de las bebidas funcionales son beneficiosas para reponer el organismo y eliminar la fatiga después del ejercicio, pero después de reescribir el modelo, puede describirse incorrectamente como "que tienen un cierto efecto en el aumento de la fatiga", lo que constituye un mensaje engañoso que causará problemas a los usuarios.

Además, hay problemas con las inversiones de entidad, como reescribir la frase original de "15-18 días después de convertirse en pupa" a "25-32 días después de convertirse en pupa". Este tipo de errores de detalle son más difíciles de detectar cuando el modelo genera cientos o incluso miles de palabras de contenido.

Según los resultados de la evaluación, incluso con la incorporación de la técnica RAG, el modelo lingüístico a gran escala sigue adoleciendo de una tasa de fantasmas de 30%-40%, lo que supone un porcentaje bastante elevado. Por tanto, cuando se aplican modelos lingüísticos a gran escala en dominios verticales, deben cumplir requisitos de profesionalidad extremadamente elevados.

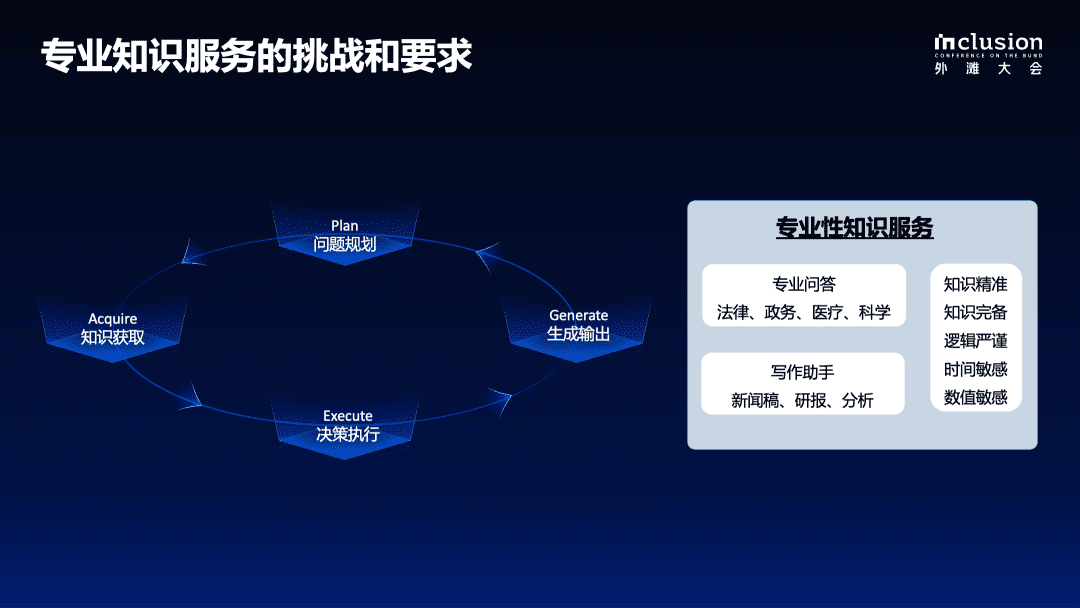

1.4 Retos y requisitos de los servicios profesionales del conocimiento

En los escenarios reales de toma de decisiones empresariales, ya sea la generación de un informe de investigación o la gestión de una reclamación de seguro de automóvil, la resolución de problemas complejos requiere un riguroso proceso paso a paso que incluye la planificación del problema, la recopilación de datos, la ejecución de la decisión y la generación y retroalimentación. También debe existir un proceso de toma de decisiones riguroso y controlado cuando se aplican modelos de Big Language a dominios profesionales.

Cuando se prestan servicios de peritaje basados en un gran modelo, deben cumplirse varias condiciones para servir mejor a la comunidad y a ámbitos específicos:

- En primer lugar, es importante garantizar la exactitud de los conocimientos, incluida la integridad de sus límites y la claridad de su estructura y semántica;

- En segundo lugar, se requiere rigor lógico, sensibilidad temporal y sensibilidad numérica;

- Por último, se necesita información contextual completa para facilitar el acceso a información de apoyo completa a la hora de tomar decisiones basadas en el conocimiento;

Las anteriores son también las capacidades de las que carecen la mayoría de los grandes modelos actuales. En vista de ello, en el primer semestre de este año realizamos una gran exploración y empezamos formalmente a construir un marco de generación controlada basado en la mejora del conocimiento para dominios verticales.

KAG: Marco de Servicios de Aumento de Conocimientos por Áreas de Especialización

La figura siguiente ilustra el principio de nuestro marco general de generación de conocimiento mejorado (KAG), que se basa en la OpenSPG Mejoras basadas en proyectos de código abierto. Hemos realizado mejoras para abordar cinco aspectos de la combinación actual de grandes modelos lingüísticos y grafos de conocimiento:

En primer lugar, conseguimos mejorar la representación del conocimiento. El grafo de conocimiento original está constreñido por un fuerte esquema, lo que conduce a un alto umbral de aplicación y datos dispersos, haciéndolo a menudo irresoluble cuando se responde a preguntas en dominios verticales. Por este motivo, optimizamos y mejoramos la representación del conocimiento para modelos lingüísticos de gran tamaño, de modo que el grafo de conocimiento pueda soportar mejor la aplicación de modelos lingüísticos de gran tamaño.

En segundo lugar, los gráficos sirven como una excelente herramienta de integración para conectar mejor todo tipo de conocimientos, ya sean conocimientos académicos rigurosos o la información de un texto. Así pues.Creamos una estructura de índice mutuo, pasando de un índice invertido basado en términos a un índice invertido basado en gráficos.Esto no sólo indexa los documentos de forma eficiente, sino que también mantiene las asociaciones semánticas entre documentos y la coherencia entre entidades.

En tercer lugar, durante el proceso de razonamiento, empleamos el desensamblaje simbólico para garantizar el rigor lógico. Resulta difícil garantizar la coherencia lógica en el lenguaje generado por el modelo lingüístico, por lo que introducimos LogicForm-driven Solver and Reasoning para la desambiguación basada en símbolos.

En cuarto lugar, para salvar la distancia entre el coste de construcción del grafo de conocimiento y la eficiencia de la aplicación práctica, tomamos prestado el método de extracción de información abierta para construir el grafo de conocimiento, lo que reduce enormemente el coste de construcción, pero también introduce más ruido. Por lo tanto, introducimos el mecanismo de alineación del conocimiento, que utiliza el conocimiento conceptual para completar la alineación entre la información abierta y el conocimiento del dominio, con el objetivo de equilibrar las necesidades de la extracción de información abierta y la alineación semántica.

Por último, desarrollamos el modelo KAG con el objetivo de integrar mejor las capacidades de los modelos lingüísticos a gran escala y los grafos de conocimiento para lograr una sinergia más eficaz. La interacción orgánica entre ambos se facilita mediante la síntesis de instrucciones, con el objetivo último de integrar plenamente las ventajas de la computación simbólica y la recuperación vectorial, y dar todo el juego a las capacidades comprensivas y generativas del modelo de lenguaje, promoviendo así su aplicación y la mejora de capacidades en dominios verticales.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...