Cómo supera GRPO a o1, o3-mini y R1 en el juego "Clue of Time".

Base de conocimientos de IAPublicado hace 1 año Círculo de intercambio de inteligencia artificial 51.7K 00

En los últimos años, el campo de la Inteligencia Artificial ha avanzado significativamente en sus capacidades de razonamiento. Después de que OpenAI demostrara el año pasado el potente potencial de inferencia de los grandes modelos lingüísticos (LLM), Google DeepMind, Alibaba, DeepSeek y Antrópico Organizaciones como la Universidad de California en Berkeley no han tardado en seguir su ejemplo, utilizando técnicas de aprendizaje por refuerzo (RL) para entrenar modelos avanzados con capacidades de "cadena de pensamiento" (CoT). Estos modelos han alcanzado puntuaciones cercanas a la saturación en muchas pruebas de referencia en áreas como las matemáticas y la programación.

Sin embargo, es un hecho que no se puede ignorar: incluso los mejores modelos disponibles en la actualidad siguen enfrentándose a algunos obstáculos insalvables a la hora de abordar problemas de razonamiento lógico. Los grandes modelos lingüísticos suelen tener dificultades para mantener una cadena coherente de razonamiento lógico con atención constante a todos los detalles relevantes, o para conectar de forma fiable múltiples pasos de razonamiento. Incluso los modelos más avanzados, que generan contenidos 10-100 veces más extensos que los modelos ordinarios, suelen cometer errores de bajo nivel fácilmente detectables por los solucionadores de problemas humanos.

Para explorar esta cuestión, Brad Hilton y Kyle Corbitt, los autores de este artículo, se pusieron a pensar: ¿pueden aprovecharse las últimas técnicas de aprendizaje por refuerzo para llevar modelos más pequeños y de código abierto a la vanguardia del rendimiento de inferencia? Para responder a esta pregunta, eligieron una técnica llamada Optimización de la Política Relativa de Grupo (GRPO) de los algoritmos de aprendizaje por refuerzo.

¿Qué es GRPO?

En pocas palabras, GRPO es un método para optimizar gradientes de estrategia. Los métodos de gradiente de estrategia mejoran el rendimiento del modelo ajustando su estrategia (es decir, la distribución de probabilidad de las acciones del modelo en una situación determinada). La GRPO actualiza la estrategia de forma más eficaz comparando los méritos relativos de un conjunto de respuestas del modelo. En comparación con los métodos tradicionales, como la Optimización de la Política Próxima (PPO), la GRPO simplifica el proceso de formación sin dejar de garantizar un rendimiento excelente.

Para comprobar la validez del GRPO, eligieron un programa llamado "Pista temporal"Juegos de razonamiento como plataformas experimentales.

¿Qué es Time Clue?

"Time Clue" es un juego de puzzle inspirado en el clásico juego de mesa "Clue (Cluedo)". En este juego, el jugador tiene que resolver una serie de pistas para averiguar el asesino, el arma del crimen, el lugar, la hora del asesinato y el motivo. A diferencia del juego original, Cluedo amplía el problema a cinco dimensiones, lo que aumenta la complejidad y el desafío del juego.

Los autores empezaron con modelos relativamente débiles y los entrenaron iterativamente con el juego "Time Clue" utilizando el algoritmo GRPO. Con el tiempo, observaron una mejora significativa en la capacidad de razonamiento de estos modelos, llegando a igualar o incluso superar a algunos de los modelos propietarios más potentes.

Ahora, compartirán la información que incluyepruebayProgramas de formaciónyconjunto de datos responder cantandopeso del modelo todos ellos disponibles gratuitamente bajo la licencia MIT.

evaluación comparativa

Para llevar a cabo un experimento, primero es necesario identificar una tarea de razonamiento desafiante que tenga una solución claramente verificable y una complejidad escalable. Casualmente, uno de los autores, Brad Hilton, había creado anteriormente un proyecto llamado Pista temporal del conjunto de puzles que satisface perfectamente estas necesidades. Además de cumplir los criterios de claridad fáctica básica, se pueden crear nuevos puzles según las necesidades.

Temporal Clue se inspira en el popular juego de mesa Cluedo (Cluedo)Pista temporal En este juego, los jugadores deben averiguar quién mató al Sr. Boddy en la mansión Tudor. Temporal Clue convierte este juego en un rompecabezas de lógica independiente que va más allá de lo habitual.quey¿Con qué?ydondey añadió dos dimensiones adicionales:¿Cuándo?(tiempo) y¿Por qué razón?(Motivación). Los rompecabezas se generan aleatoriamente, y se utilizan pistas mínimas pero suficientes para OR-Tools (utilizado como expresión nominal) Solucionador CP-SAT Elegido.

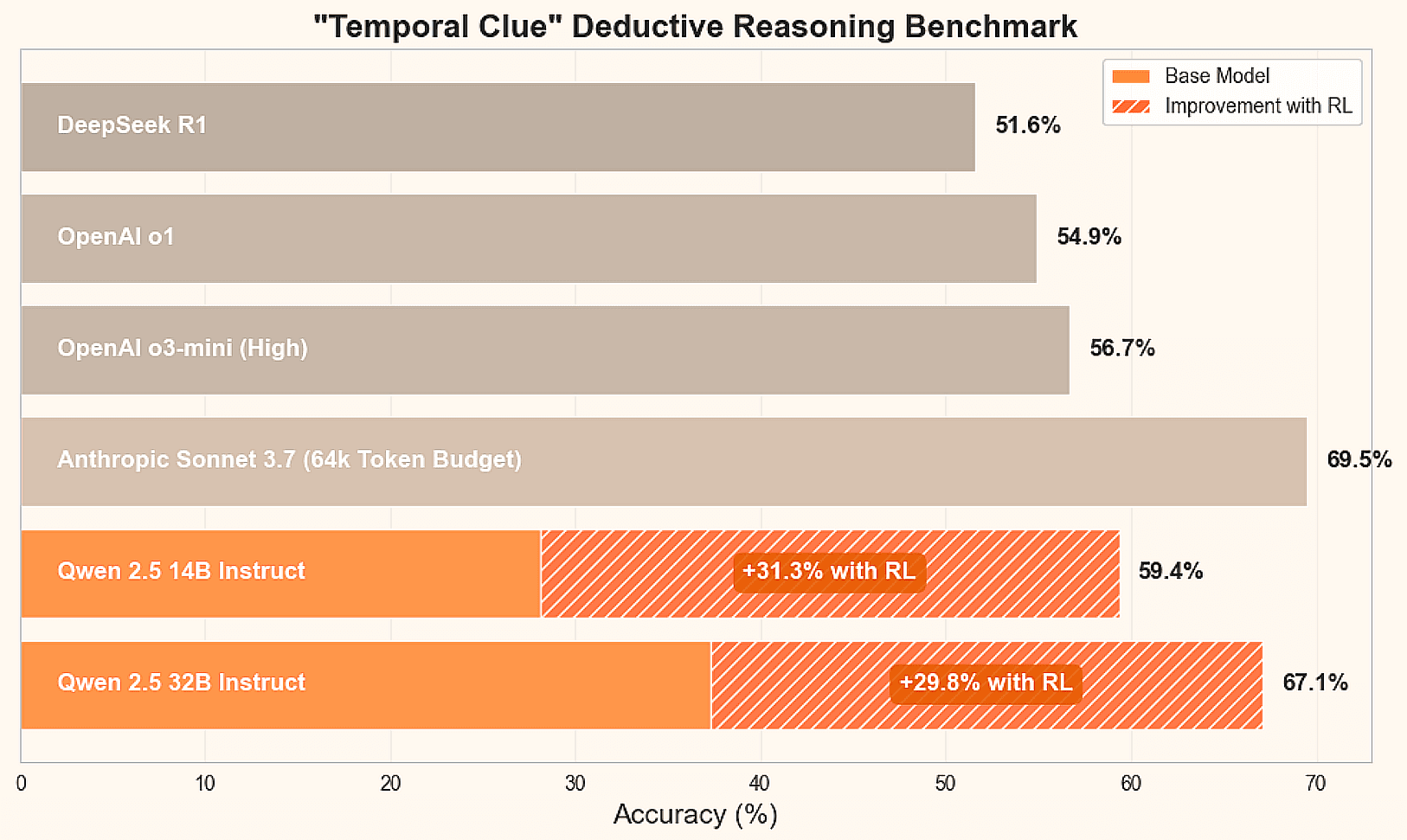

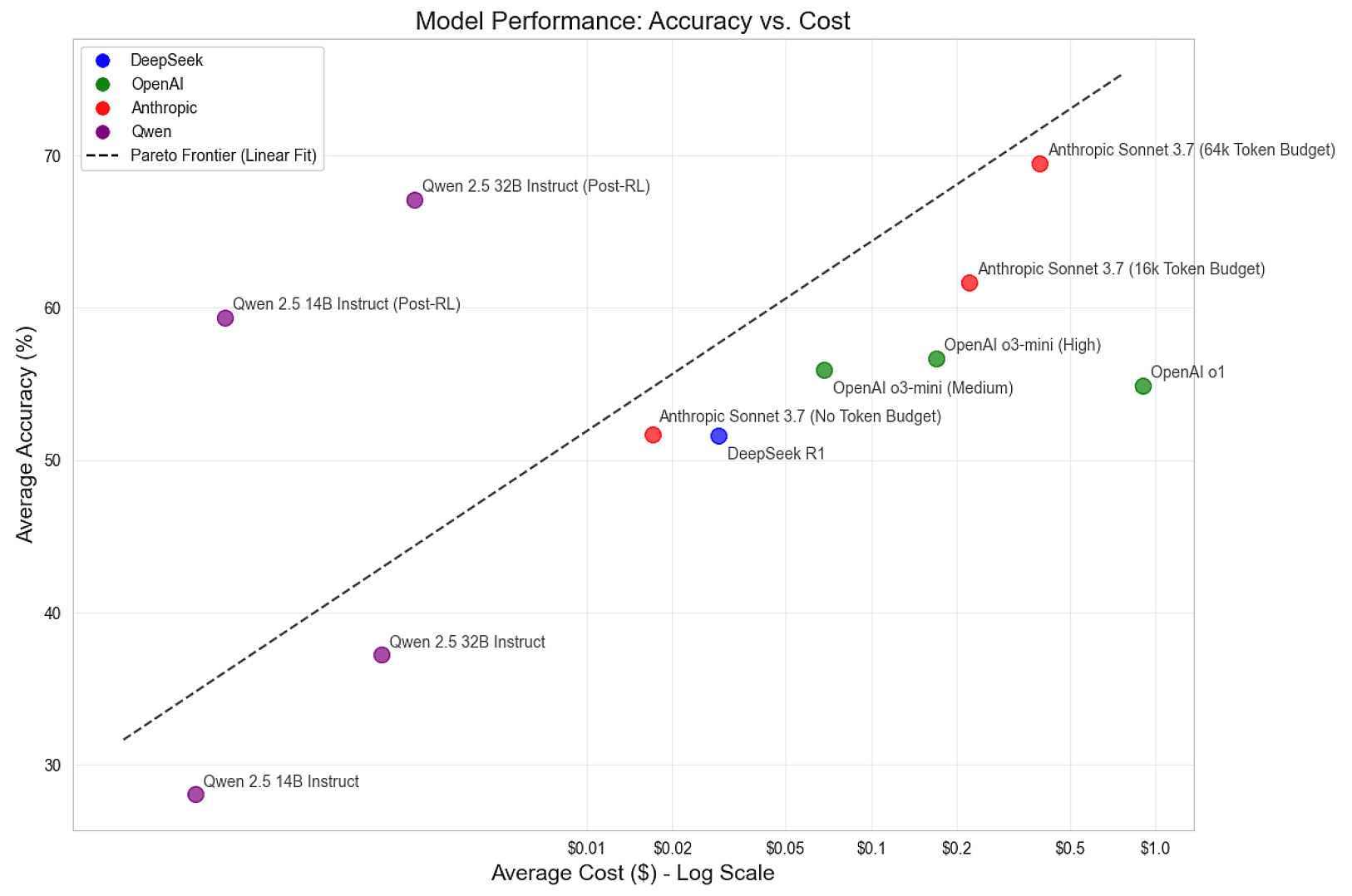

Para determinar el estado actual de la técnica en esta tarea de inferencia, se compararon los principales modelos de inferencia, entre ellos DeepSeek R1, Antrópico Claude Sonnet 3.7, y los modelos Qwen 2.5 14B y 32B Instruct de Alibaba. Además, ofrecen un avance de los resultados finales:

| mecanismo | modelización | capacidad de razonamiento | Precisión media | coste medio |

|---|---|---|---|---|

| DeepSeek | R1 | por defecto (ajuste) | 51.6% | $0.029 |

| Antrópico | Soneto 3.7 | no tener | 51.7% | $0.017 |

| Antrópico | Soneto 3.7 | 16k | 61.7% | $0.222 |

| Antrópico | Soneto 3.7 | 64k | 69.5% | $0.392 |

| Alí Babá, personaje de Las mil y una noches | Qwen 2.5 14B Construir | no tener | 28.1% | $0.001 |

| Alí Babá, personaje de Las mil y una noches | Qwen 2.5 32B Instruir | no tener | 37.3% | $0.002 |

A partir de estos puntos de referencia, se puede ver que tener 64k ficha El modelo Claude Sonnet 3.7 de Anthropic fue el que obtuvo mejores resultados en esta tarea, pero todos los modelos principales tienen margen de mejora. DeepSeek R1, un popular modelo de código abierto, obtuvo unos resultados cercanos a la precisión media de Claude Sonnet 3.7 de Anthropic 51,7%. Sin embargo, el rendimiento del modelo Qwen 2.5 Instruct es relativamente pobre. La gran pregunta es: ¿pueden estos modelos más pequeños y de código abierto entrenarse hasta niveles punteros?

tren

Para entrenar un modelo de inferencia de vanguardia, utilizaron el aprendizaje por refuerzo, un método que permite a las inteligencias aprender de su propia experiencia en un entorno controlado. En este caso, los LLM son las inteligencias y los puzles son el entorno. Guiaron el aprendizaje de los LLM haciéndoles generar múltiples respuestas para cada enigma con el fin de explorar el panorama del problema. Refuerzan los razonamientos que conducen a la solución correcta y penalizan los que llevan al modelo por mal camino.

Entre los distintos métodos de RL, eligieron el popular algoritmo Group Relative Policy Optimisation (GRPO) desarrollado por DeepSeek. En comparación con otros métodos más tradicionales, como la Optimización de Políticas Proximales (PPO), GRPO simplifica el proceso de entrenamiento sin dejar de ofrecer un gran rendimiento. Para acelerar sus experimentos, omitieron el Dispersión de Kullback-Leibler (KL) castigo, aunque su programa de formación lo respalde.

En resumen, el ciclo de formación sigue estos pasos básicos:

- Generación de respuestas modelo a tareas de rompecabezas.

- Puntúe las respuestas y estime la ventaja de completar el chat para cada grupo (ésta es la parte "relativa al grupo" de GRPO).

- El modelo se ajusta utilizando un gradiente de estrategias de adaptación guiadas por estas estimaciones de dominancia.

- Repita estos pasos con nuevos rompecabezas y la última versión del modelo hasta conseguir un rendimiento óptimo.

Para generar la respuesta, utilizan el popular vLLM Motor de inferencia. Ajustaron la selección de parámetros para maximizar el rendimiento y minimizar el tiempo de arranque. El almacenamiento en caché de prefijos es especialmente importante, ya que muestrean muchas respuestas para cada tarea y el almacenamiento en caché de sugerencias ayuda a evitar cálculos redundantes.

Observaron que demasiadas peticiones pueden vLLM lo que provoca que se adelanten o intercambien las solicitudes en curso. Para resolver este problema, limitan las peticiones mediante un semáforo ajustado para mantener una alta utilización de la caché de valores clave (KV) y minimizar el intercambio. Mecanismos de programación más avanzados pueden producir una mayor utilización al tiempo que admiten longitudes de generación flexibles.

Tras el muestreo, se realiza una Transformadores HuggingFace AutoTokenizer El procesamiento se ha completado. Su función de plantilla de chat presenta el objeto de mensaje como una cadena de consulta que incluye una máscara de ayuda para determinar qué tokens fueron generados por el LLM. carecen de lo necesario en la plantilla predeterminada. %generation% por lo que se modifican en el paso de etiquetado. Las máscaras de ayuda generadas se incluyen en el diccionario tensorial utilizado para el ajuste y sirven para identificar qué posiciones son necesarias para calcular las pérdidas.

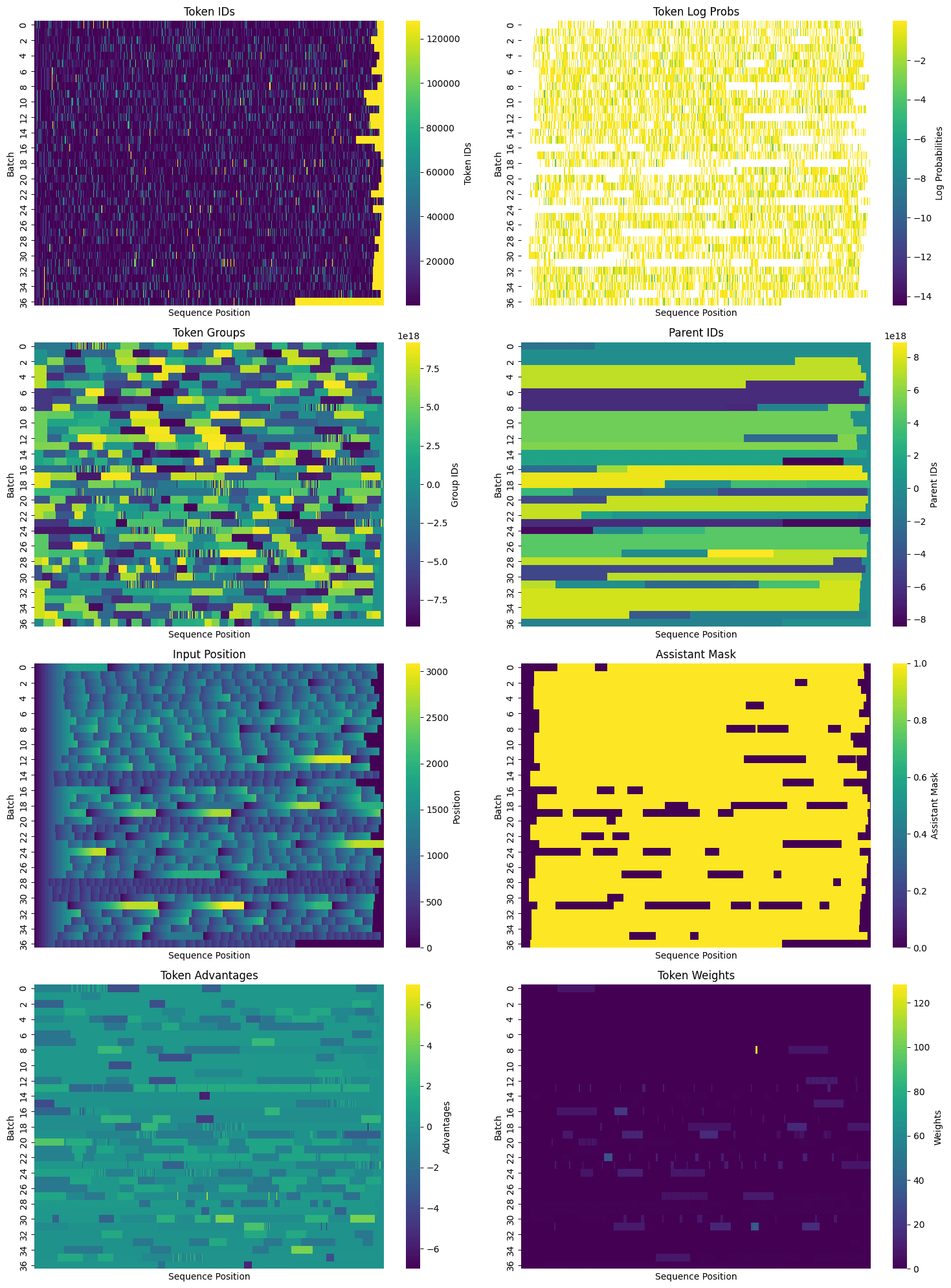

Tras agrupar las respuestas y obtener máscaras de ayuda, empaquetaron los datos para su ajuste. Además de incluir varios pares de pistas/respuestas en cada secuencia empaquetada, identificaron las pistas compartidas y asignaron a cada una de ellas un identificador principal y un identificador de grupo estándar. puede reducir significativamente la redundancia. Una vez empaquetada toda la información necesaria, el conjunto de datos de entrenamiento puede visualizarse en dos dimensiones: cada fila es una secuencia de fichas que pueden contener varias pistas y conclusiones:

Con datos muy ajustados, es hora de afinar. Los modelos han sido preentrenados, sintonizados instruccionalmente, son bastante inteligentes y buenos siguiendo instrucciones. Sin embargo, todavía no pueden resolver con fiabilidad el puzzle de la pista temporal. Sin embargo, de vez en cuando lo consiguen, y eso es suficiente. Poco a poco, el modelo es guiado hacia un estado de "detective" aumentando la probabilidad de buen razonamiento y disminuyendo la probabilidad de mal razonamiento. Esto se consigue mediante técnicas estándar de aprendizaje automático, utilizando un enfoque de gradiente de política para calcular las pérdidas y desplazar los pesos favorablemente.

Para la formación, el equipo de PyTorch proporcionó el torchtune Torchtune tiene un decodificador altamente eficiente sólo transformador para modelos populares como Llama, Gemma, Phi y otros. Aunque para este proyecto utilizaron principalmente el modelo Qwen, también experimentaron con los modelos Llama 8B y 70B de Meta.Torchtune también proporciona utilidades de ahorro de memoria y mejora del rendimiento, entre las que se incluyen:

- Activar puntos de control

- Activación Desinstalación

- cuantificable

- Ajuste fino eficiente de parámetros (PEFT)Por ejemplo Adaptativo de bajo rango (LoRA)

Para obtener una lista completa de las optimizaciones admitidas, consulte la páginaDocumento autoexplicativo.

Además, Torchtune soporta multidispositivo (y ahoramultinodo), por lo que es ideal para modelos de gran tamaño. Admite tanto el entrenamiento en paralelo de datos totalmente segmentados (FSDP) como el entrenamiento en paralelo de tensor (TP), que pueden utilizarse de forma combinada. También proporcionanUna docena de programasanimando a los usuarios a replicarlo y personalizarlo para sus propios casos de uso. Crearon una versión modificada del programa completo de ajuste fino que admite:

- Formación con varios equipos y con uno solo

- Carga del modelo de referencia e intercambio de pesos para calcular la dispersión KL

- Cálculo avanzado de máscaras causales mediante ID de grupos e ID de padres

- Integración de pérdidas GRPO y registro de componentes

El programa está disponible enaquí estánVer. En el futuro, esperan añadir soporte para el paralelismo tensorial y explorar PEFT y la cuantificación.

El proceso de entrenamiento de RL implica la selección de un gran número de hiperparámetros. Mientras entrenaban el modelo, probaron varias configuraciones e identificaron principalmente las siguientes:

- Modelos: Qwen 2.5 Instruct 14B y 32B

- Número de tareas por iteración: 32

- Número de muestras por tarea e iteración: 50

- Número total de muestras por iteración: 32 * 50 = 1600

- Tasa de aprendizaje: 6e-6

- Tamaño del microlote: 4 secuencias para el modelo de 14B, 8 secuencias para el modelo de 32B

- Tamaño del lote: variable, en función del número de secuencias

Los tamaños de los lotes son variables porque las longitudes de las respuestas pueden cambiar durante el entrenamiento, la eficacia del empaquetamiento de secuencias fluctúa en cada iteración y se descartan las respuestas de dominancia cero (es decir, las respuestas para las que el modelo no da ninguna respuesta positiva o negativa). En una de las ejecuciones, se intentó ajustar dinámicamente la tasa de aprendizaje en función del tamaño del lote, pero el resultado fue una tasa de aprendizaje demasiado alta para lotes pequeños, por lo que hubo que limitarla. La versión con el límite fijado no fue significativamente diferente de la que utilizó una tasa de aprendizaje constante, pero el ajuste del tamaño del lote y la tasa de aprendizaje sigue siendo un área interesante para futuros experimentos.

También realizaron breves experimentos aumentando el número de tareas por iteración y disminuyendo el número de muestras por tarea y viceversa, manteniendo el número total de muestras por iteración aproximadamente igual. Estos cambios no mostraron diferencias significativas a lo largo de un breve periodo de entrenamiento, lo que sugiere que el esquema es robusto a diferentes compensaciones entre el número de tareas y el número de muestras por tarea.

al final

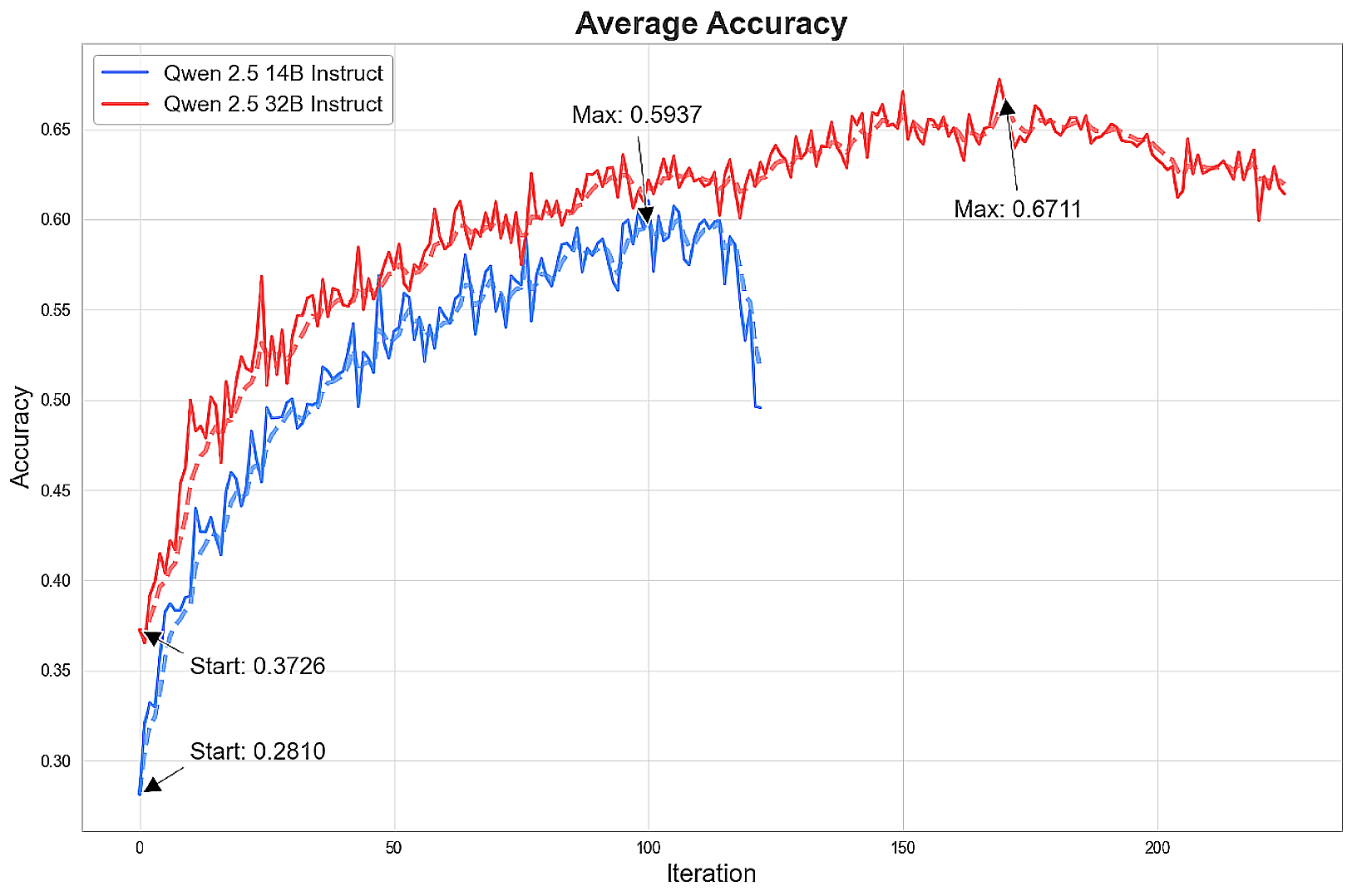

Tras entrenar el modelo durante más de 100 iteraciones, se alcanzó un nivel de inferencia puntero.

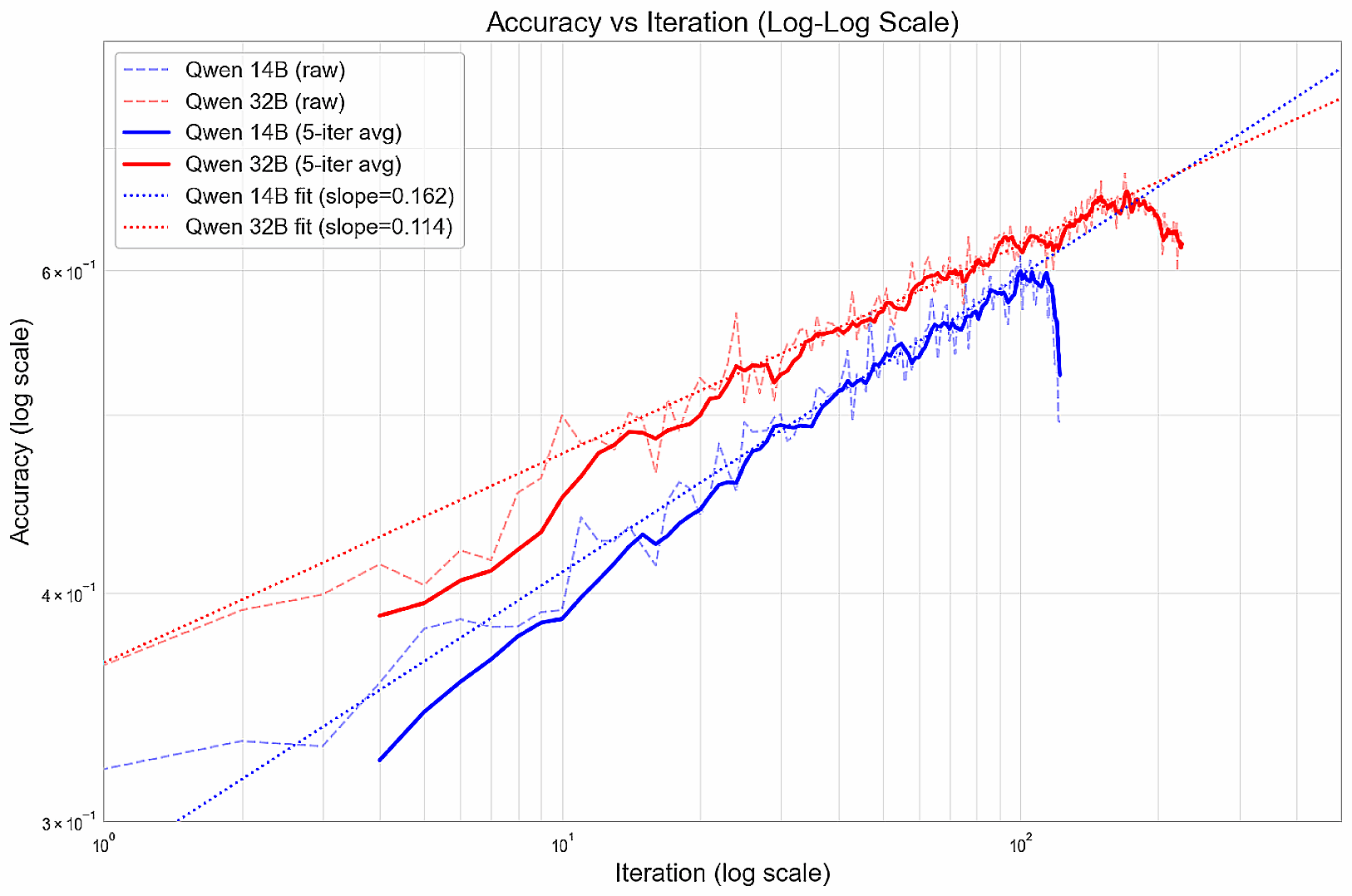

El modelo mejora rápidamente, y después la mejora de la precisión empieza a disminuir y finalmente decae, a veces drásticamente. En el mejor de los casos, el modelo 14B se aproxima al rendimiento de Claude Sonnet 3.7 a 16.000 palabras, y el modelo 32B casi iguala los resultados de Sonnet a 64.000 palabras.

Durante el entrenamiento, la mejora del rendimiento sigue una ley de potencia, formando una relación lineal en el gráfico log-log (antes del deterioro).

Sospechan que estos modelos pueden converger prematuramente en estrategias codiciosas que funcionan al principio, pero pueden limitar sus perspectivas a largo plazo. El siguiente paso podría consistir en explorar formas de fomentar la diversidad de respuestas, o formas de desarrollar la competencia de forma gradual (por ejemplo, aprendizaje en el curso), o asignar mayores recompensas a las soluciones especialmente buenas para incentivar la exploración exhaustiva.

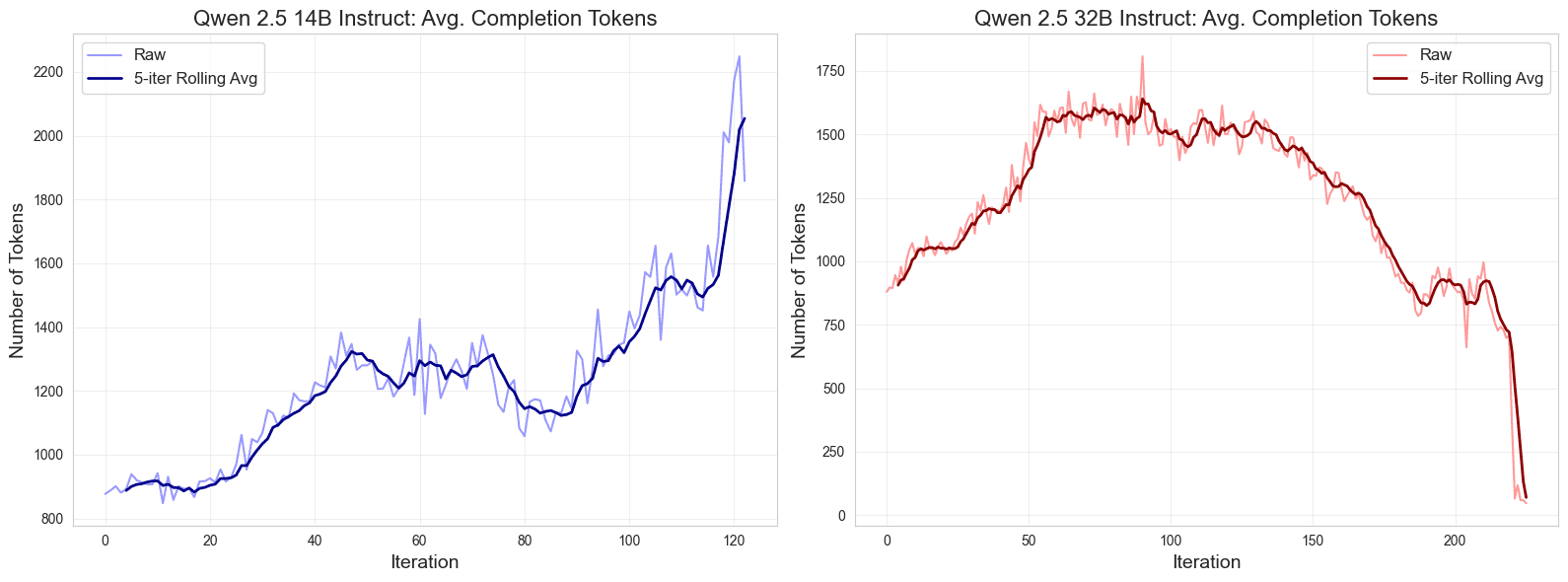

Además, observaron un patrón interesante en la longitud de la salida durante el entrenamiento. Al principio, la respuesta se hace más larga, luego se estabiliza y después diverge hacia el final del entrenamiento, con la respuesta del modelo 14B haciéndose más larga y la longitud de respuesta del modelo 32B acortándose, especialmente después de alcanzar el rendimiento máximo.

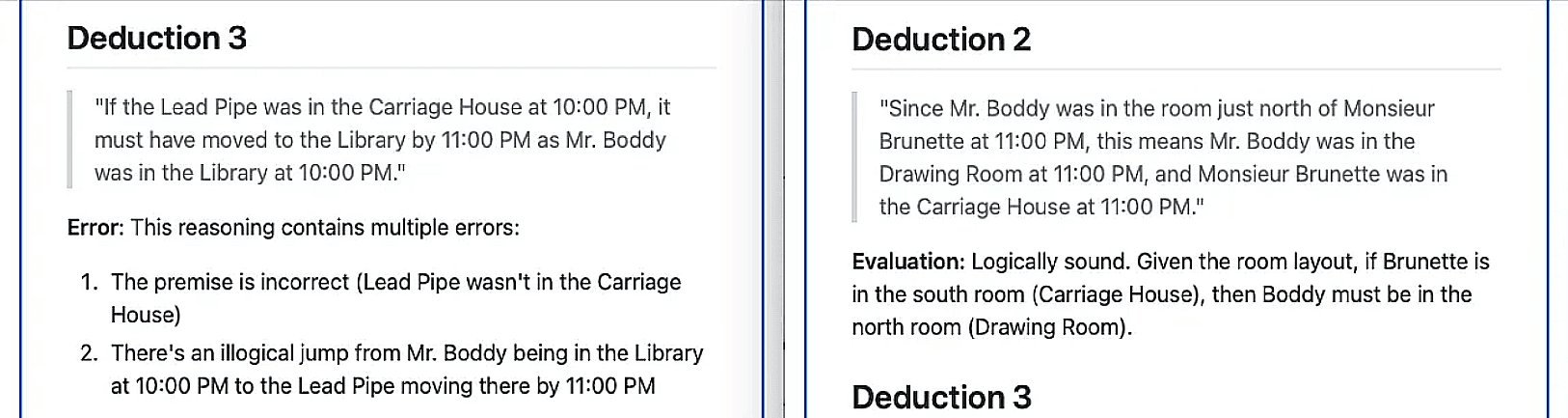

Para evaluar cualitativamente las mejoras en el razonamiento lógico, hicieron que su modelo de vanguardia más potente, Claude Sonnet 3.7, identificara y evaluara la verosimilitud del razonamiento realizado por el modelo Qwen 32B en rompecabezas similares, antes y después de más de 100 iteraciones de entrenamiento.Sonnet identificó 6 inferencias a partir del modelo base, de las cuales todas menos 1 fueron consideradas falsas;En cambio, identificó siete inferencias a partir del modelo entrenado, todas menos una de las cuales se consideraron lógicamente sólidas.

Por último, la hipótesis de quedespliegue a peticióntienenRendimiento suficienteSe basan en Fuegos artificiales AI (utilizado como expresión nominal)Niveles de precios sin servidorestimaron el coste del modelo Qwen. Compararon la precisión con el logaritmo natural del coste medio de inferencia por respuesta y observaron una clara frontera de Pareto lineal en el modelo sin ajustar. El equilibrio entre coste y precisión mejoró significativamente al entrenar con éxito el modelo de código abierto hasta el nivel de precisión de la frontera.

resúmenes

En esta investigación, trataron de explorar si modelos lingüísticos más pequeños y de código abierto podían alcanzar capacidades de razonamiento de vanguardia mediante el aprendizaje por refuerzo. Después de entrenar los modelos Qwen 14B y 32B en desafiantes puzles de pistas temporales utilizando hiperparámetros cuidadosamente elegidos y el método GRPO, lograron impresionantes mejoras de rendimiento. Estas mejoras sitúan a los modelos de código abierto a la vanguardia del rendimiento de inferencia, al tiempo que reducen significativamente el coste. Los resultados ponen de relieve el potencial del aprendizaje por refuerzo para entrenar eficazmente modelos abiertos en tareas de razonamiento complejas.

Como ya se ha dicho.conjunto de datosypruebayProgramas de formación y las ponderaciones del modelo (14B, 32B) están disponibles gratuitamente bajo la licencia MIT.

Además, descubrieron que sólo 16 ejemplos de formación Se pueden conseguir aumentos de rendimiento significativos de hasta 10-15%.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...