Google lanza AI Video Veo2 y AI Mapping Imagen3

A principios de este año, Google lanzó Veo, un modelo de generación de vídeo, e Imagen 3, su modelo de generación de imágenes más reciente, y desde entonces ha sido emocionante ver cómo la gente daba vida a sus ideas con estos modelos: los creadores de YouTube están explorando las posibilidades creativas de crear fondos de vídeo para YouTube Shorts, los clientes empresariales están mejorando sus flujos de trabajo creativos con Vertex AI clientes empresariales están mejorando sus flujos de trabajo creativos con Vertex AI, y los creativos están utilizando VideoFX responder cantando ImageFX para contar sus historias. Con socios de todas partes, desde cineastas a empresas, seguimos desarrollando y haciendo evolucionar estas tecnologías.

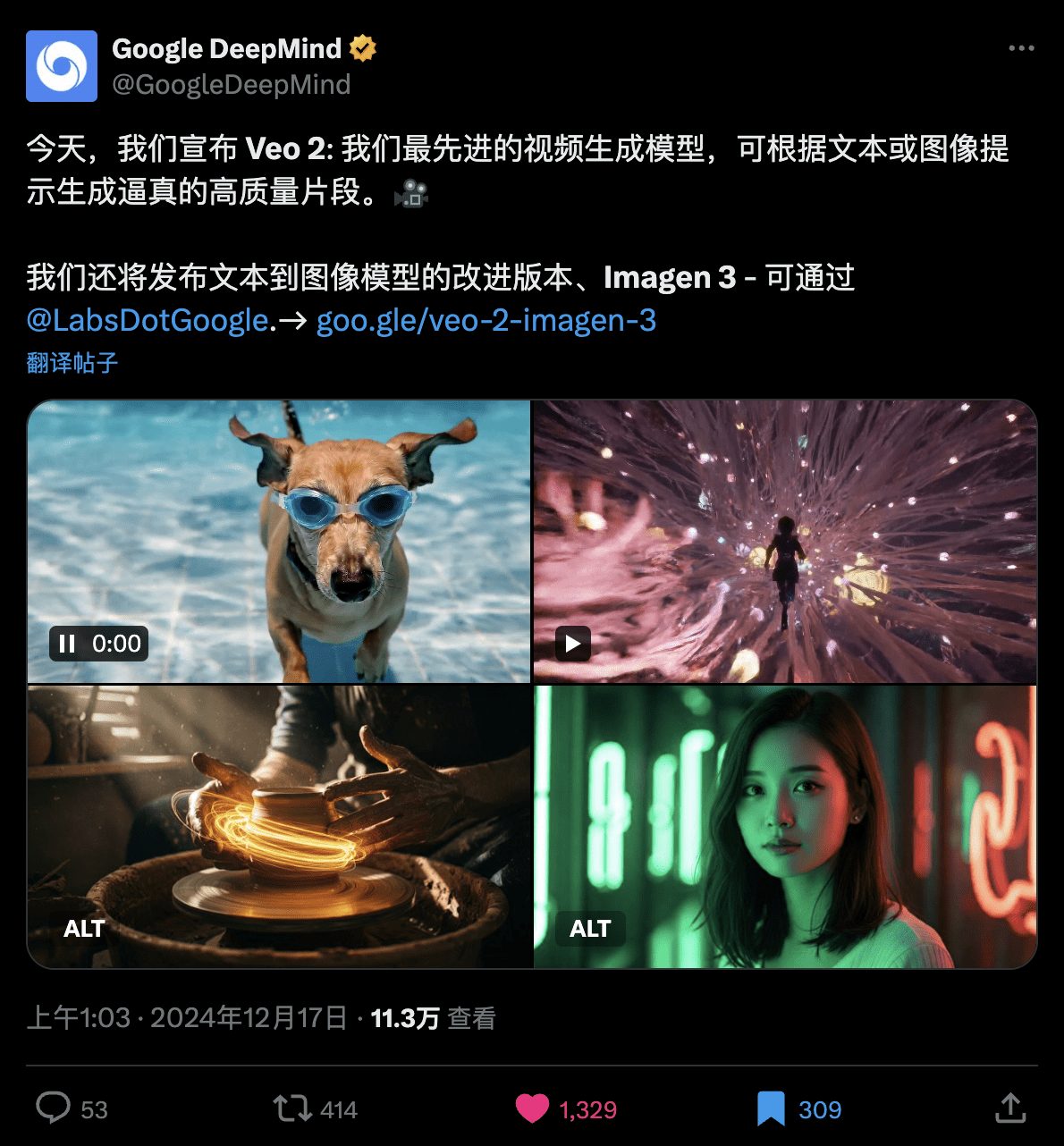

En mitad de la noche, OpenAI publicó una búsqueda de IA personalizada después de que su basura de transmisión en directo no tuviera nada que mostrar. Pero Google, sin bromas ni marketing, publicó silenciosamente dos grandes en X.

Google ha lanzado hoy un nuevo modelo de vídeo, Veo 2, y la última versión, Imagen 3, ambos con resultados de última generación. Estos modelos ya están disponibles en VideoFX, ImageFX y nuestro último proyecto experimental Whisk.

Veo 2: tecnología punta de generación de vídeo

Veo 2 crea vídeos de altísima calidad sobre una amplia gama de temas y estilos. En comparaciones cara a cara realizadas por revisores humanos, Veo 2 obtuvo resultados de vanguardia frente a los principales modelos.

Aporta una mejor comprensión de la física del mundo real, así como de los detalles del movimiento y la expresión humanos, lo que contribuye a una sensación general de detalle y realismo. veo 2 entiende el lenguaje único de la cinematografía: basta con proporcionar un género, especificar una toma, sugerir un efecto cinematográfico, y veo 2 lo hace, con resoluciones de hasta 4K y con duraciones que pueden extenderse hasta varios minutos. a varios minutos. Pídale que haga un travelling a través de una escena desde un ángulo bajo, o un primer plano de un científico mirando a través de un microscopio, y Veo 2 lo creará. Sólo tienes que escribir "objetivo de 18 mm" en la pregunta y Veo 2 sabrá cómo capturar los efectos de gran angular que caracterizan al objetivo, o desenfocar el fondo para centrarse en el sujeto añadiendo "poca profundidad de campo" a la pregunta.

Veo 2, el modelo de vídeo AI más avanzado disponible en la actualidad, e Imagen 3, una versión mejorada del modelo de dibujo AI. Mientras veíamos los resultados, un grupo de nosotros no paraba de exclamar asombrados por las explosiones. Casi nunca utilizo la palabra reventar, pero los efectos de la AI Video Veo 2 realmente me dieron ganas de animar, incluso, un poco como viendo a Sora aquella fatídica noche del 16 de febrero. Uno por uno.

I. Vídeo AI Veo 2

Efecto en línea Veo 2 efecto no construido

Mientras que los modelos de vídeo suelen "alucinar" con detalles no deseados -como dedos de más u objetos inesperados-, Veo 2 produce estos problemas con menos frecuencia, lo que da como resultado una salida más realista. El resultado es una salida más realista.

Nuestro compromiso con la seguridad y el desarrollo responsable ha guiado el diseño de Veo 2. Hemos tenido cuidado en ampliar la usabilidad de Veo para ayudar a identificar, comprender y mejorar la calidad y la seguridad del modelo a medida que se despliega lentamente a través de VideoFX, YouTube y Vertex AI.

Al igual que todos nuestros modelos de generación de imágenes y vídeos, el resultado de Veo 2 contiene una marca de agua SynthID invisible para ayudar a identificarlo como contenido generado por IA, lo que reduce la probabilidad de desinformación y atribución errónea.

Hoy incorporamos nuevas funciones de Veo 2 a la herramienta de generación de vídeo de Google Labs, VideoFX, y ampliamos la gama de usuarios accesibles. Visita Google Labs para inscribirte en la lista de espera. También tenemos previsto ampliar Veo 2 a YouTube Shorts y a otros productos el año que viene.

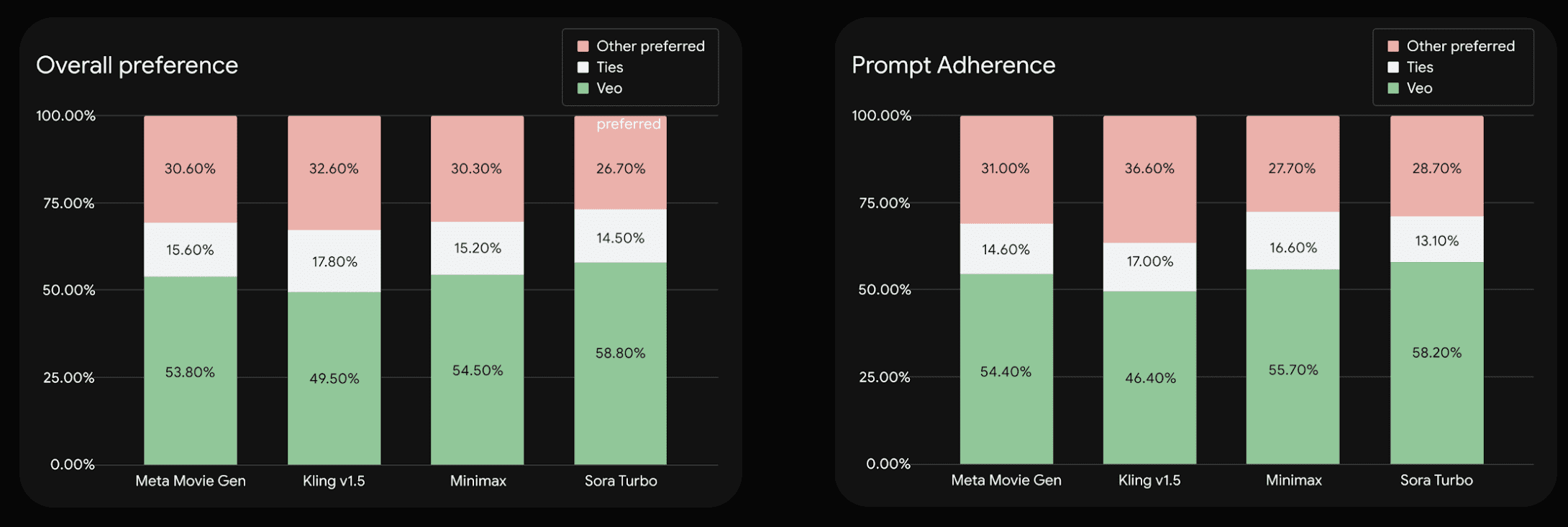

El propio Google hizo una revisión con observadores humanos, a través del conjunto de datos de referencia MovieGenBench publicado por Meta, e hizo 1003 datos para que la gente probara a ciegas cuál funcionaba mejor. Los resultados, tal y como se obtuvieron finalmente, fueron los siguientes.

Voy a explicar un poco esta pieza, hay dos tablas que se dividen en Preferencia General (Overall Preference) y Adherencia al Prompt (Prompt Match).

El eje horizontal de cada gráfico representa los diferentes modelos que se comparan, que son Meta, Kerin v1.5, Minimax y Sora Turbo. lo que hizo Google fue hacer una prueba ciega punto a punto de la Veo 2 contra estos modelos.

Ahora sí que se pueden utilizar los modelos nacionales como punto de referencia para comparar, y de repente se me acelera la sangre al corazón.

Y cada columna consta de tres partes, cuyos colores representan la clasificación de los resultados:

Sección verde (Veo): el porcentaje de resultados de Veo que los revisores prefirieron en sus comparaciones.

La parte blanca (Empates): la proporción de revisores que consideran que los dos son indistinguibles, es decir, sin una preferencia clara.

Sección rosa (Otro preferido): el revisor prefiere las proporciones del otro modelo (no Veo).

En el habitual estilo de cejas gruesas de Google DeepMind, básicamente no falsea nada, así que como puedes ver, el Veo 2 de Google consigue resultados óptimos en la mayoría de los casos.

Y en la revisión de Google, el más fuerte de los otros cuatro modelos, aparte del Veo 2, es el Korin v1.5, que es un resultado bastante interesante. Y, una cosa a tener en cuenta.Veo 2, capaz de grabar directamente vídeo 4K.

Los vídeos que han subido a Youtube también son en 4K nativo, y este da bastante miedo. Ellos mismos dicen que la mayor dificultad y limitación de momento sigue estando en el movimiento.

La afirmación original era: "Crear vídeo realista, dinámico o complejo con total coherencia en escenas complejas o con movimiento complejo sigue siendo un reto."

II. Dibujo AI Imagen 3

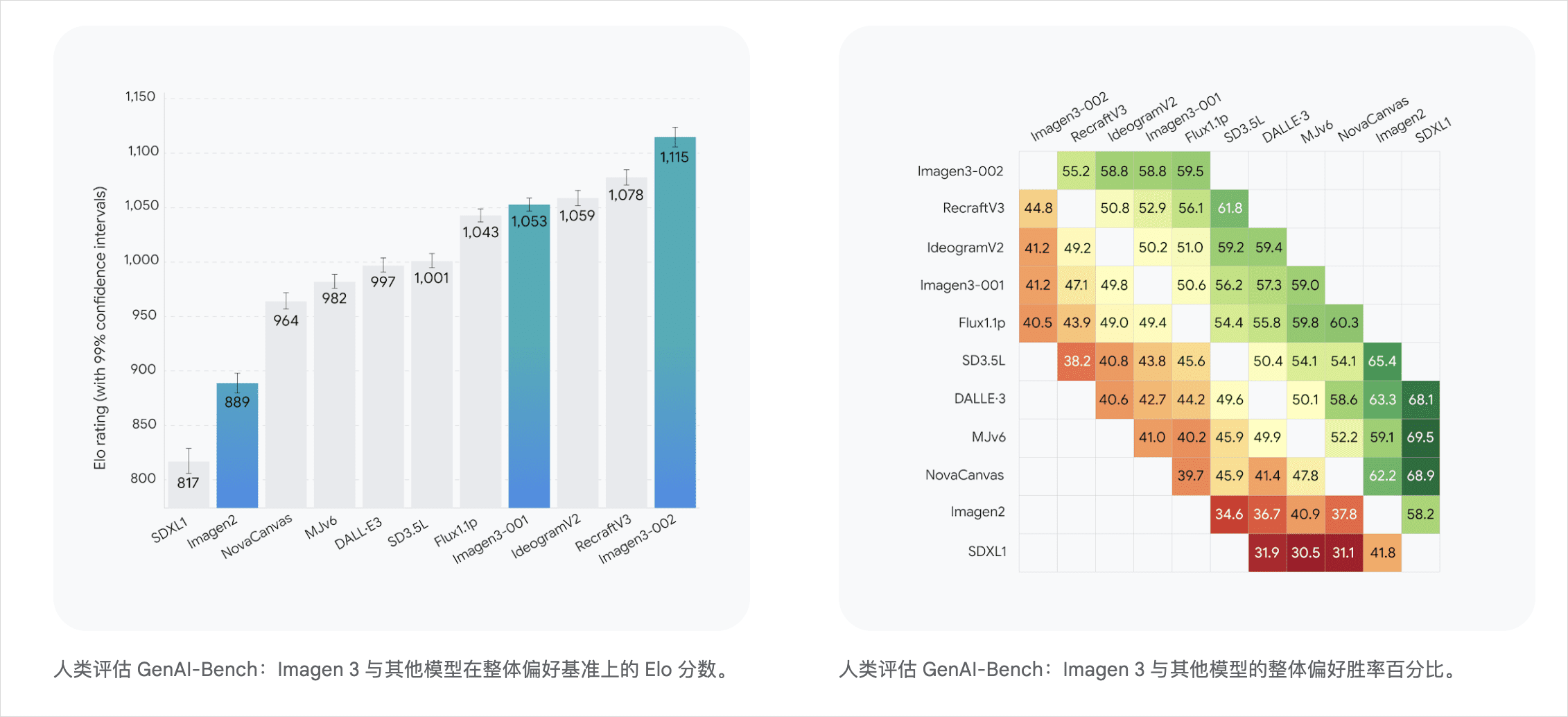

Google también ha mejorado su modelo de generación de imágenes Imagen 3, que ahora produce imágenes más brillantes y mejor compuestas. Ahora es capaz de renderizar una mayor variedad de estilos artísticos -desde el fotorrealismo al impresionismo, pasando por el arte abstracto o el anime- con mayor precisión. La actualización también permite que el modelo siga las señales con mayor fidelidad y renderice detalles y texturas más ricos. En una comparación con los principales modelos de generación de imágenes realizada por evaluadores humanos, Imagen 3 se situó a la cabeza.

A partir de hoy, los últimos modelos de Imagen 3 estarán disponibles en todo el mundo en ImageFX, la herramienta de generación de imágenes de Google Labs, en más de 100 países. Visita ImageFX para empezar.

Además del Veo 2, la ola de Google también fue directa a enviar su versión mejorada del modelo Imagen 3 de mapeo de IA, que en realidad es técnicamente el modelo Imagen 3-002, la segunda generación de Imagen 3. La primera generación de Imagen 3 se lanzó el 14 de mayo de 2024, en la conferencia de desarrolladores I/O de Google. Seis meses después, Google ha hecho una evolución significativa de la Imagen 3, lanzando una versión mejorada de la segunda generación, y en su propia revisión, es directamente una carnicería de los gráficos.

Actualmente no hay colas, sólo hay que jugar y, bueno, es gratis.

Escribe Prompt directamente en el cuadro de entrada y empieza a jugar.

El diseño de su Prompt, pero también muy interesante, puede introducir una variedad de extraños y extrañas una gran serie de Prompt, él le dará automáticamentecláusula de desambiguaciónEs algo así como esa explosión de cápsulas que tuvo Lao Luo en su día, en la que dividía algunas palabras y las convertía para usted encuadro desplegableasociando automáticamente otras opciones.

Estos son algunos de los renders publicados oficialmente

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...