Google lanza su propio modelo de IA de "razonamiento": Gemini 2.0 Flash Thinking Experimental

Google ha lanzado lo que denomina un nuevo modelo de IA de "razonamiento", pero aún está en fase experimental y, según nuestras breves pruebas, tiene margen de mejora.

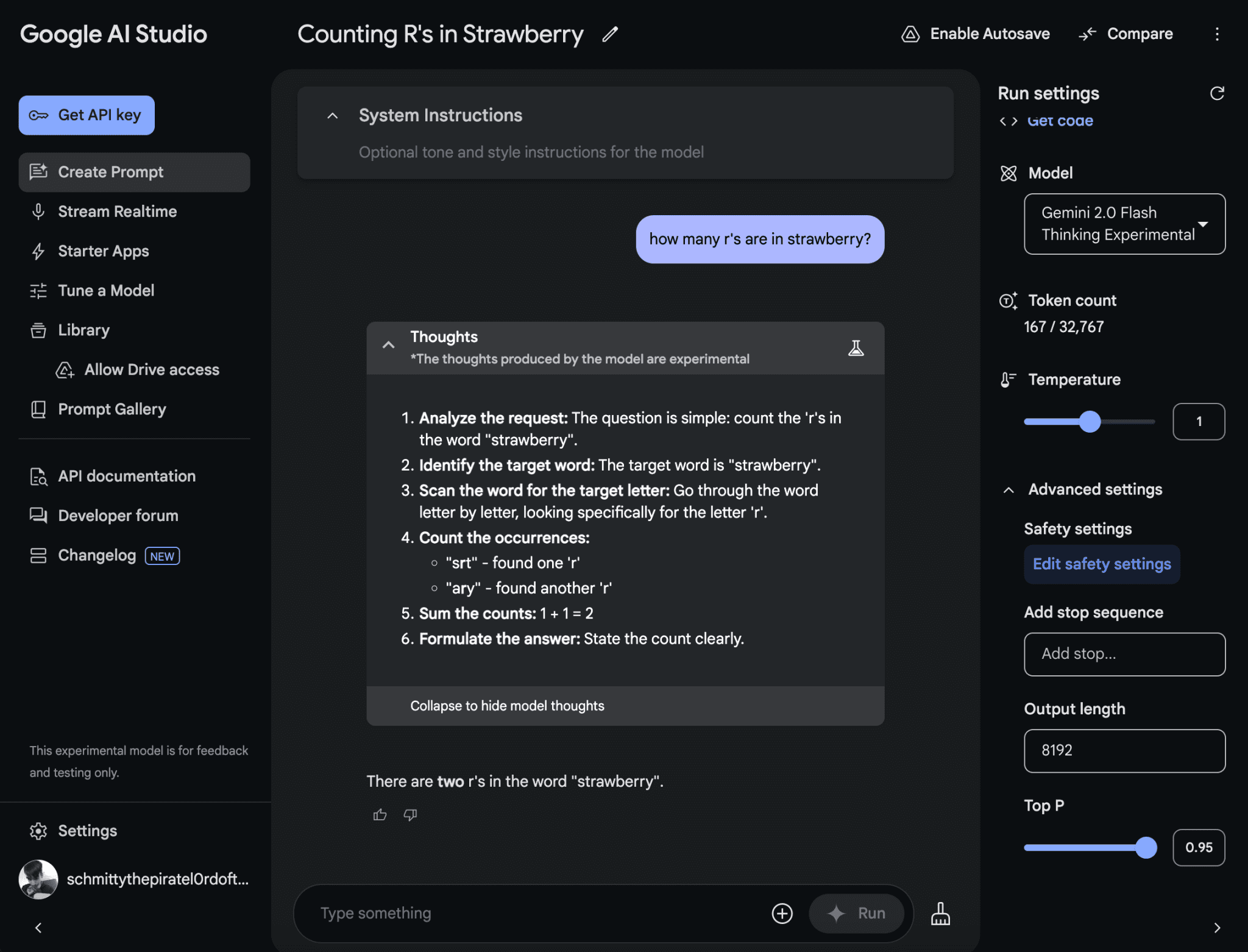

Este nuevo modelo se denomina Géminis 2.0 Flash Thinking Experimental (el nombre es un poco trabalenguas), que se encuentra en la sección Estudio AI Se utiliza en la plataforma de creación de prototipos de IA de Google. La ficha del modelo lo describe como "el más adecuado para la comprensión multimodal, el razonamiento y la codificación" y capaz de "resolver los problemas más complejos en áreas como la programación, las matemáticas y la física".

En un post sobre X, Logan Kilpatrick, responsable del producto AI Studio, calificó el Gemini 2.0 Flash Thinking Experimental como el "primer paso en un viaje de razonamiento" de Google. En su propio post, Jeff Dean, científico jefe de Google DeepMind, afirmó que el Gemini 2.0 Flash Thinking Experimental está entrenado para utilizar el pensamiento con el fin de mejorar el razonamiento.

"Vimos resultados alentadores cuando aumentamos la cantidad de cálculo para el tiempo de inferencia", dijo Dean, refiriéndose a la cantidad de cálculo necesaria para que el modelo responda a la pregunta.

El Gemini 2.0 Flash Thinking Experimental se basa en el modelo Gemini 2.0 Flash de Google, que parece tener un diseño similar al o1 de OpenAI y a otros modelos de inferencia. A diferencia de la mayoría de las IA, el modelo de inferencia se autocomprueba de forma efectiva, evitando algunos de los escollos que suelen hacer que los modelos de IA se equivoquen.

Sin embargo, una desventaja de los modelos de inferencia es que suelen tardar más -a menudo de segundos a minutos- en llegar a una solución.

Ante una pregunta, el Experimento de Pensamiento Relámpago Gemini 2.0 hace una pausa antes de responder, considera varias preguntas relacionadas y "explica" su razonamiento durante el proceso. Posteriormente, el modelo resume la respuesta que considera más acertada.

Bueno, en teoría debería. Cuando le pregunté a Gemini 2.0 Flash Thinking Experimental cuántas erres tiene la palabra "fresa", me respondió "dos".

El nuevo modelo de inferencia de Google funciona mal al contar las letras de las palabras y a veces comete errores. Crédito de la imagen: Google

Los resultados reales pueden variar de una persona a otra.

Tras el lanzamiento de o1, se produjo una explosión de modelos de inferencia procedentes de laboratorios de IA rivales, y no sólo de Google. una empresa de investigación en IA financiada por operadores cuantitativos. DeepSeek presentó su primer modelo de inferencia, DeepSeek-R1, a principios de noviembre, y en el mismo mes, el equipo Qwen de Alibaba publicó lo que afirma ser el primer modelo de inferencia para el reto abierto o1.

En octubre se informó de que Google tenía varios equipos trabajando en modelos de inferencia. Luego, en un informe de noviembre, The Information reveló que Google tiene al menos 200 investigadores centrados en esta tecnología.

¿Qué ha provocado el auge de los modelos de inferencia? Una de las razones es la búsqueda de nuevas formas de mejorar la IA generativa. Como informó recientemente mi colega Max Zeff, las técnicas de "fuerza bruta" para escalar modelos ya no proporcionan las mejoras de antaño.

No todo el mundo está convencido de que los modelos de inferencia sean el mejor camino a seguir. Por un lado, suelen ser costosos debido a la cantidad de potencia computacional necesaria para ejecutarlos. Y, aunque su rendimiento en las pruebas comparativas es bueno, no está claro que los modelos inferenciales puedan mantener este ritmo de progreso.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...