La API Gemini lanza un nuevo modelo de incrustación de texto: aumento del rendimiento y compatibilidad con entradas 8K

Imagen de Google Géminis 2.0 Generación Flash

Recientemente, Google API Géminis Se ha introducido un nuevo modelo experimental de incrustación de texto en el gemini-embedding-exp-03-07[1]El modelo se entrena basándose en el modelo Gemini. El modelo se entrena en base al modelo Gemini, heredando la profunda comprensión del lenguaje y los contextos sutiles de Gemini, y es aplicable a una amplia gama de escenarios. Cabe destacar que este nuevo modelo supera al anteriormente publicado por Google text-embedding-004 y encabezó las listas de Multilingual Text Embedding Benchmark (MTEB), a la vez que ofrecía una entrada más larga. ficha Nuevas funciones como la longitud.

comentarios

Teniendo en cuenta que ya existen en el mercado algunos modelos de incrustación de código abierto, como multilingual-e5-large-instruct, aunque pueden ser ligeramente inferiores al nuevo modelo de Gemini en términos de rendimiento, el modelo de código abierto puede seguir siendo competitivo en determinados escenarios, como el procesamiento de bloques de texto pequeños y las aplicaciones sensibles a los costes. Por lo tanto, la futura aceptación en el mercado del nuevo modelo de Gemini dependerá en última instancia de si su estrategia de precios y sus restricciones de uso satisfacen las necesidades de los desarrolladores, además de su rendimiento superior.

Completo modelo líder de incrustación de texto

Google afirma que el nuevo modelo se ha entrenado específicamente para ofrecer una versatilidad extraordinaria, con un rendimiento excelente en finanzas, ciencia, derecho, búsquedas y muchas otras áreas, y puede utilizarse directamente sin necesidad de realizar grandes ajustes para tareas específicas.

En la clasificación de MTEB multilingües.gemini-embedding-exp-03-07 El ranking MTEB es una referencia importante para la comparación de modelos, ya que proporciona una evaluación exhaustiva del rendimiento de los modelos de incrustación de texto en diversas tareas, como la recuperación y la clasificación.

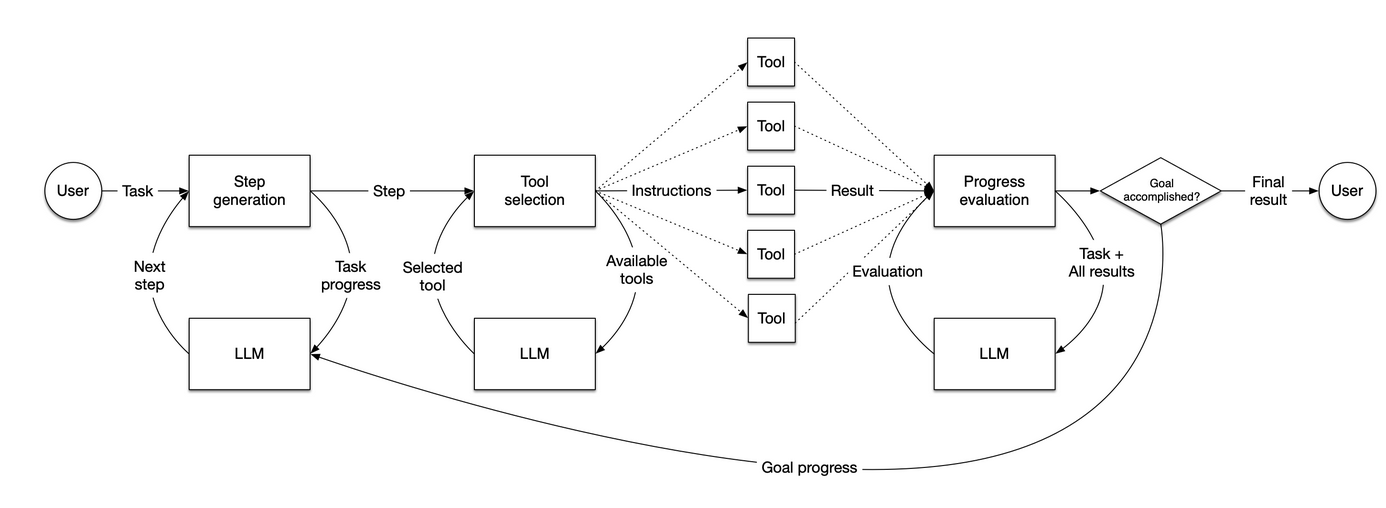

¿Por qué elegir la incrustación de texto?

Generación mejorada a partir de la construcción de la búsqueda inteligente (RAG) y los sistemas de recomendación, hasta la clasificación de textos, la capacidad de los modelos lingüísticos a gran escala (LLM) para comprender el significado que hay detrás del texto es fundamental. Las técnicas de incrustación permiten a menudo crear sistemas más eficientes, que reducen el coste y la latencia al tiempo que ofrecen mejores resultados que los sistemas de concordancia de palabras clave.

Las técnicas de incrustación captan la semántica y el contexto a través de la representación numérica de los datos. Los datos con semántica similar tienen vectores de incrustación más próximos. Las técnicas de incrustación admiten diversas aplicaciones:

- Recuperación eficaz: Encontrar documentos relevantes en grandes bases de datos, como la recuperación de documentos jurídicos o la búsqueda empresarial, comparando la consulta con los vectores de incrustación de los documentos.

- Generación de Recuperación Aumentada (RAG): Mejorar la calidad y pertinencia del texto generado recuperando e integrando información relevante en el contexto del modelo.

- Agrupación y clasificación: Agrupe textos similares para identificar tendencias y temas en los datos.

- Clasificación: Clasificación automática basada en el contenido del texto, por ejemplo, análisis de sentimientos o detección de spam.

- Texto similar: Identifique el contenido duplicado y realice tareas como la eliminación de duplicados de páginas web o la detección de plagios.

Para obtener más información sobre la incrustación y los casos de uso habituales de la IA, puede consultar la página Documentación de la API Gemini.

Experimente ahora la incrustación de texto Gemini

Los desarrolladores ya pueden utilizar este nuevo modelo experimental de incrustación de texto a través de la API Gemini. Es similar al modelo embed_content Compatibilidad de interfaces.

from google import genai

client = genai.Client(api_key="GEMINI_API_KEY")

result = client.models.embed_content(

model="gemini-embedding-exp-03-07",

contents="阿尔法折叠是如何工作的?",

)

print(result.embeddings)

Además de mejorar la calidad en todos los aspectos degemini-embedding-exp-03-07 También tiene las siguientes características:

- Límite de entrada de 8K tokens: En comparación con modelos anteriores, Google ha mejorado la longitud del contexto para permitir la incrustación de trozos más grandes de texto, código u otros datos.

- 3072 salida dimensional: vectores de incrustación de alta dimensión con casi 4 veces más tokens que el modelo de incrustación anterior.

- Aprendizaje de representaciones matrioskas (MRL): MRL permite a los desarrolladores truncar el vector original de 3072 dimensiones para reducir los costes de almacenamiento. En pocas palabras, la tecnología MRL permite a los usuarios sacrificar una parte de la precisión a cambio de ahorrar espacio de almacenamiento.

- Soporte lingüístico ampliado: El número de idiomas admitidos se ha duplicado hasta superar los 100.

- Modelo unificado: El modelo supera en calidad a los modelos de Google lanzados anteriormente para tareas específicas, multilingües, en inglés sencillo y para códigos específicos.

Aunque actualmente se encuentra en fase experimental con una capacidad limitada, esta versión ofrece a los desarrolladores la oportunidad de explorar las primeras gemini-embedding-exp-03-07 Oportunidades de capacidad. Como todos los modelos experimentales, está sujeto a cambios. Google afirma que está trabajando para disponer de una versión estable y de disponibilidad general en los próximos meses.

Google anima a los desarrolladores a hacer más accesibles sus productos y servicios a través de Formulario de comentarios integrado Proporcione información.

Algunos usuarios han señalado que el modelo es gratuito durante la vista previa, pero hay estrictoslímite de velocidad-5 solicitudes por minuto, 100 solicitudes por día. Los desarrolladores pueden activar fácilmente estos límites al probar modelos. Algunos usuarios han expresado su esperanza de que Google aumente pronto estos límites.

En el debate de Reddit, muchos usuarios expresaron su entusiasmo por el lanzamiento del nuevo modelo y lo describieron como "algo más grande de lo que la gente cree". Un usuario comentó: "3.000 vectores de incrustación fp32 dimensionales son enormes. Apuesto a que se podría construir un descodificador muy razonable con esa cantidad de datos ...... Si este modelo fuera barato, probablemente lo utilizaría más a menudo que un modelo lingüístico completo a gran escala. Normalmente, lo que realmente quieres es extraer características semánticas".

Otro usuario señaló que este modelo "no tiene mucha competencia" en el ámbito multilingüe, y añadió que probablemente sea más adecuado para bloques de texto más grandes debido a la limitación de velocidad y a la dimensionalidad de la incrustación.

[1]: en Vertex AI, el mismo modelo se pasa por eltext-embedding-large-exp-03-07 se proporciona la interfaz. La nomenclatura será coherente en el momento del lanzamiento oficial.© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...