fal: API de macromodelado generativo para desarrolladores de clases multimedia enriquecidas

Últimos recursos sobre IAPublicado hace 1 año Círculo de intercambio de inteligencia artificial 73.8K 00

Introducción general

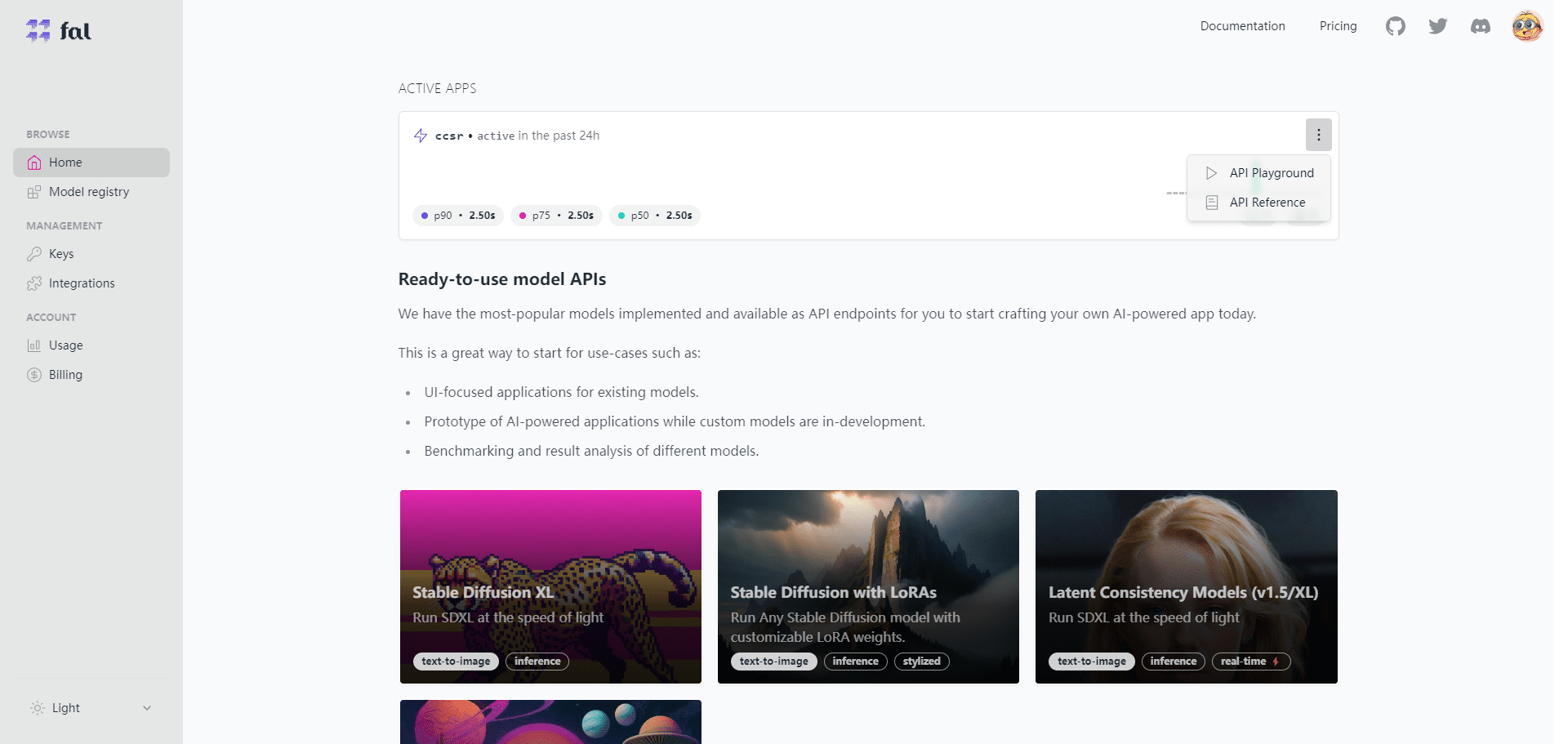

fal es una plataforma de inferencia de IA en línea que ayuda a los usuarios a crear aplicaciones de IA en tiempo real con modelos generativos de medios de alta calidad, incluidos imágenes, vídeo y audio. fal ofrece una variedad de modelos generativos preentrenados, como Stable Diffusion XL, Stable Diffusion with LoRAs, Optimised Latent Consistency (SDv1.5), etc., que permiten a los usuarios utilizar descripciones de texto sencillas y garabatos para generar imágenes rápidamente. generar imágenes rápidamente.

fal también permite a los usuarios cargar modelos personalizados o utilizar modelos compartidos, con un control detallado y la posibilidad de aumentar o reducir la escala automáticamente. fal admite diversos tipos de máquinas y especificaciones, como GPU-A100, GPU-A10G, GPU-T4, etc., que pueden satisfacer diferentes requisitos de rendimiento y coste. fal cuenta con documentación detallada y ejemplos, que pueden ayudar a los usuarios a iniciarse y utilizarlo rápidamente.

Impulsada por su motor de inferencia fal patentado, la plataforma es capaz de ejecutar modelos de difusión hasta 4 veces más rápido que otras alternativas, lo que permite nuevas experiencias de IA en tiempo real. fal.ai, fundada en 2021 y con sede en San Francisco, se dedica a reducir las barreras a la expresión creativa optimizando la velocidad y la eficiencia de la inferencia.

Lista de funciones

- Motor de inferencia eficaz: Proporciona el motor de inferencia de modelos de difusión más rápido del mundo, con velocidades de inferencia de hasta 400%.

- Modelos de generación múltiple: Admite una variedad de modelos generativos preentrenados, como Stable Diffusion 3.5 y FLUX.1.

- Formación LoRA: Proporciona la mejor herramienta de entrenamiento LoRA del sector, con capacidad para personalizar o entrenar un nuevo estilo en menos de 5 minutos.

- Integración API: Existen diversas bibliotecas del lado del cliente, como JavaScript, Python y Swift, que los desarrolladores pueden integrar fácilmente.

- razonamiento en línea: Admite la generación en tiempo real de inferencia de medios para herramientas creativas en tiempo real y entrada de cámara.

- Optimización de costesPago por uso para garantizar cálculos rentables.

Utilizar la ayuda

Instalación e integración

- registrar una cuentaVisita fal.ai y regístrate para obtener una cuenta de desarrollador.

- Obtener la clave APIClave de API: Después de conectarse, genere y obtenga su clave de API en la página "Clave de API".

- Instalación de bibliotecas cliente::

- JavaScript::

import { fal } from "@fal-ai/client"; const result = await fal.subscribe("fal-ai/fast-sdxl", { input: { prompt: "photo of a cat wearing a kimono" }, logs: true, onQueueUpdate: (update) => { if (update.status === "IN_PROGRESS") { update.logs.map((log) => log.message).forEach(console.log); } }, }); - Python::

from fal import Client client = Client(api_key="YOUR_API_KEY") result = client.subscribe("fal-ai/fast-sdxl", input={"prompt": "photo of a cat wearing a kimono"}) print(result) - Swift::

import FalAI let client = FalClient(apiKey: "YOUR_API_KEY") client.subscribe(model: "fal-ai/fast-sdxl", input: ["prompt": "photo of a cat wearing a kimono"]) { result in print(result) }

- JavaScript::

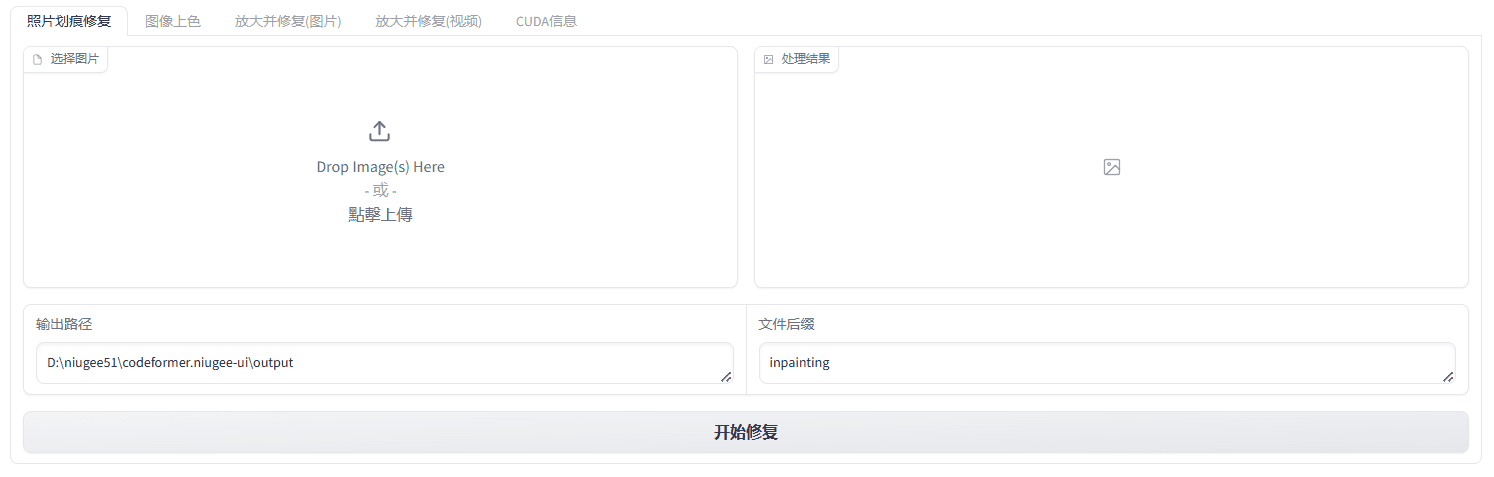

Uso de modelos generativos

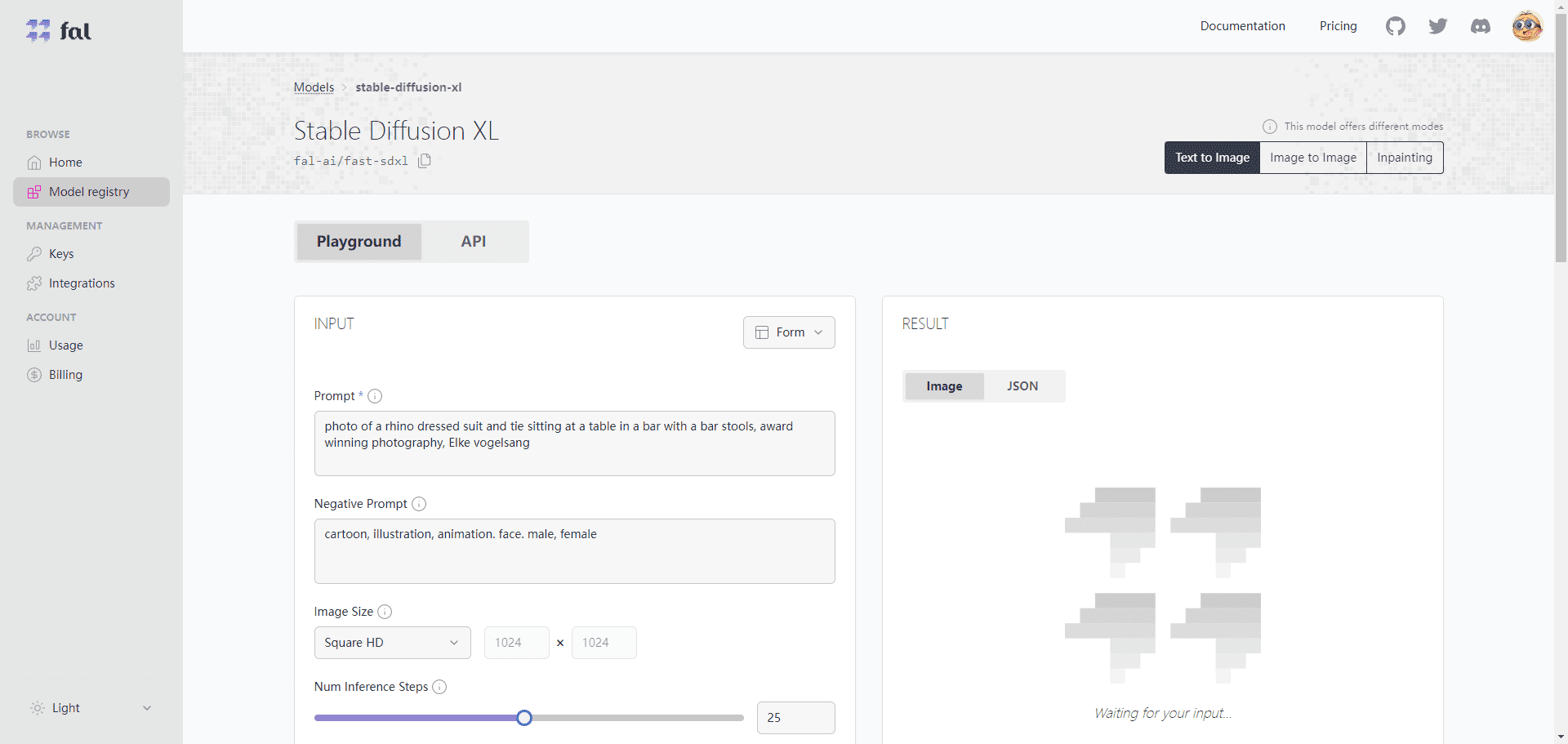

- Seleccionar modelo: Seleccione un modelo de la biblioteca de modelos de fal.ai que sea adecuado para su proyecto, como Stable Diffusion 3.5 o FLUX.1.

- Parámetros de configuraciónConfigure los parámetros del modelo, como el número de pasos de inferencia, el tamaño de la imagen de entrada, etc., según los requisitos del proyecto.

- razonamiento en funcionamiento: Utilice las llamadas a la API para ejecutar la inferencia y obtener el contenido multimedia generado.

- Optimización y ajusteEn función de los resultados generados, ajuste los parámetros o seleccione un modelo diferente para la optimización.

Formación LoRA

- Cargar datosPrepara los datos de entrenamiento y cárgalos en la plataforma fal.ai.

- Selección del modelo de formaciónSeleccione un modelo de entrenamiento LoRA adecuado, como FLUX.1.

- Configuración de los parámetros de entrenamientoAjuste los parámetros de entrenamiento, como la velocidad de aprendizaje, el número de pasos de entrenamiento, etc.

- Iniciar la formación: Inicie el proceso de formación y la plataforma completará la formación y generará un nuevo modelo de estilo en un breve periodo de tiempo.

- Aplicación del nuevo modeloInferencia mediante modelos recién entrenados para generar contenidos multimedia personalizados.

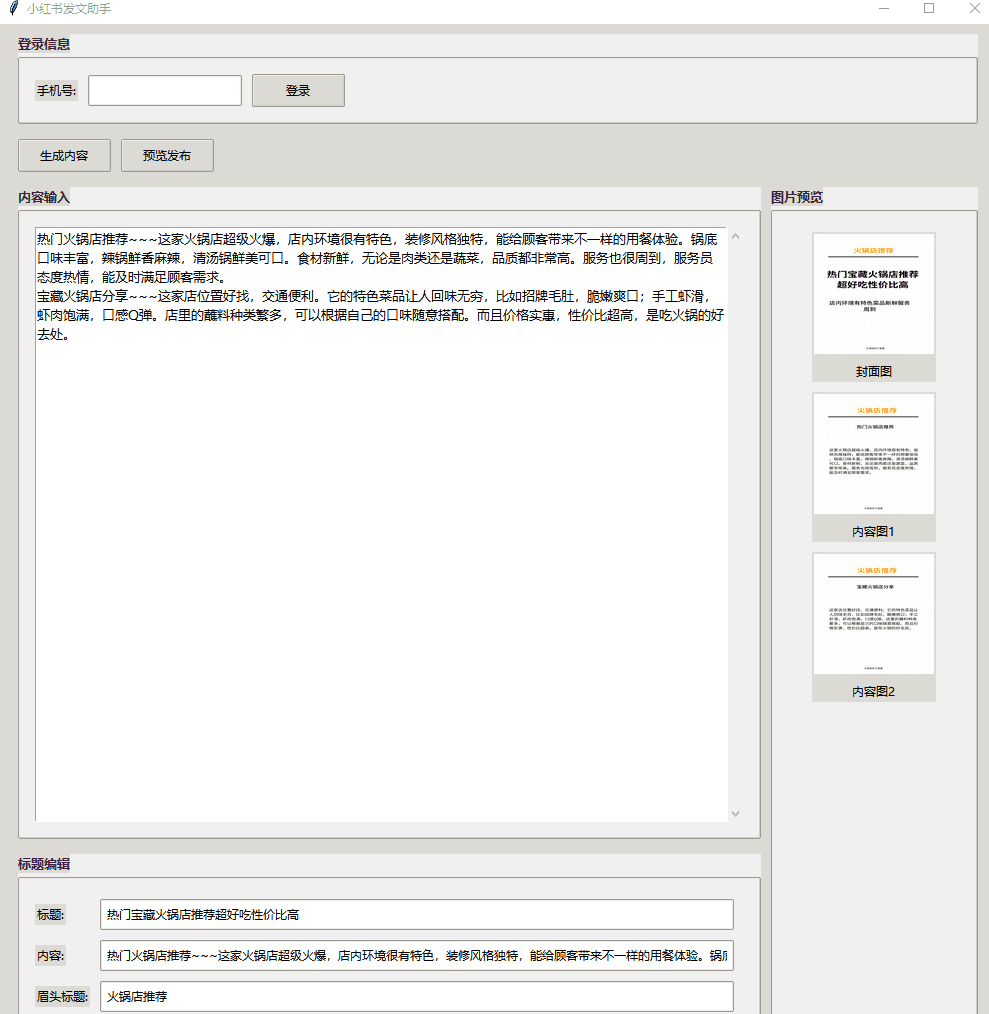

Todos los modelos se dividen en interfaz de depuración y API dos partes, puede utilizar en la interfaz de depuración no hay problema en llamar a la API:

fal Modelos opcionales

| Nombre del modelo | Introducción al modelo | Categoría de modelo | Descripción detallada |

| Difusión estable con LoRA | Ejecuta cualquier modelo de difusión estable con ponderaciones LoRA personalizadas | texto a imagen | LoRA es una técnica utilizada para mejorar la calidad y la diversidad de una imagen ajustando diferentes pesos para controlar el estilo y el detalle de la imagen resultante. |

| Difusión estable XL | SDXL a la velocidad de la luz | texto a imagen | SDXL es un método de generación de imágenes basado en modelos de difusión que genera imágenes de alta calidad en pocos pasos de inferencia y es más rápido y estable que los métodos GAN tradicionales |

| Cascada estable | Generación de imágenes en espacios potenciales más pequeños y baratos | texto a imagen | Stable Cascade es un método de generación de imágenes que utiliza múltiples capas de espacio latente para generar imágenes de alta resolución a bajo coste computacional, adecuadas para dispositivos móviles y edge computing. |

| Escalador creativo | Crear imágenes ampliadas creativas | imagen a imagen | Creative Upscaler es un método utilizado para la ampliación de imágenes con el fin de añadir elementos creativos como texturas, colores, formas, etc., ¡manteniendo al mismo tiempo la claridad de la imagen! |

| Escalador CCSR | Amplificadores de imagen de última generación | imagen a imagen | CCSR Upscaler es un método de ampliación de imágenes basado en aprendizaje profundo que puede ampliar una imagen hasta cuatro veces la resolución original o más sin introducir desenfoque ni distorsión |

| PhotoMaker | Personaliza fotos de personajes realistas apilando incrustaciones de ID | imagen a imagen | PhotoMaker es un método para generar fotos de personajes que permite al usuario controlar el aspecto, la expresión, la pose, el fondo, etc. del personaje ajustando distintas incrustaciones de ID para generar fotos de personajes realistas. |

| Susurro | Whisper es un modelo de transcripción y traducción de voz | voz a texto | Whisper es un modelo integral de traducción y reconocimiento del habla basado en Transformer que convierte el habla en texto en distintos idiomas en un solo paso, con soporte para múltiples lenguas y dialectos. |

| Consistencia latente (SDXL y SDv1.5) | Generación de imágenes de alta calidad con pasos de inferencia mínimos | texto a imagen | La coherencia latente es una técnica utilizada para mejorar la eficacia y la calidad de la generación de imágenes mediante la producción de imágenes de alta calidad en menos pasos de inferencia, manteniendo al mismo tiempo la coherencia espacial latente y la interpretabilidad. |

| Consistencia latente optimizada (SDv1.5) | Genera imágenes de alta calidad con pasos de inferencia mínimos. Optimizado para un tamaño de imagen de entrada de 512×512. | imagen a imagen | La coherencia latente optimizada es un método de generación de imágenes optimizado para un tamaño de imagen de entrada específico con el fin de producir imágenes de alta calidad en menos pasos de inferencia, manteniendo al mismo tiempo la coherencia y la interpretabilidad del espacio latente. |

| Fooocus | Utilización de parámetros por defecto para la optimización automática y la mejora de la calidad | texto a imagen | Fooocus es un método de generación de imágenes que permite al usuario producir imágenes de alta calidad sin ajustar ningún parámetro, a la vez que utiliza técnicas automáticas de optimización y mejora de la calidad para mejorar los resultados producidos |

| InstantID | Generación que preserva la identidad con muestras cero | imagen a imagen | InstantID es un método para generar imágenes con identidad preservada que permite a los usuarios generar imágenes con la misma identidad que la imagen original sin ningún dato de entrenamiento, pero con la posibilidad de cambiar otros atributos como el peinado, la ropa, el fondo, etc. |

| AnimateDiff | ¡Anima tus ideas con AnimateDiff! | texto a vídeo | AnimateDiff es un método para generar animaciones que permite a los usuarios generar clips de vídeo cortos introduciendo una descripción de texto, y que admite una gran variedad de estilos y temas, como dibujos animados, realistas, abstractos, ¡y mucho más! |

| AnimateDiff Vídeo a vídeo | ¡Añade estilo a tus vídeos con AnimateDiff! | vídeo a vídeo | AnimateDiff Video to Video es un método de conversión de estilos de vídeo que permite a los usuarios generar un nuevo vídeo introduciendo un vídeo y una descripción de estilo, compatible con una amplia gama de estilos y temas, como dibujos animados, realista, abstracto, ¡y mucho más! |

| MetaVoice | MetaVoice-1B es un modelo base de 1.200 millones de parámetros para la conversión de texto a voz, entrenado con 100.000 horas de voz. | texto a voz | MetaVoice es un método de generación de voz que permite a los usuarios generar voz en diferentes idiomas y sonidos mediante la introducción de texto, soportando múltiples idiomas y dialectos, así como una gran variedad de características vocales como el tono, el ritmo, la emoción, etc. |

| MusicGen | Cree música de alta calidad con descripciones de texto o pistas melódicas | texto a audio | MusicGen es un método de generación de música que permite al usuario generar música de diferentes estilos y temas introduciendo descripciones textuales o pistas melódicas, compatible con una amplia gama de instrumentos y timbres, así como una gran variedad de características musicales como ritmos, acordes, melodías ¡y mucho más! |

| Ilusión Difusión | Crear ilusiones a partir de imágenes | texto a imagen | Illusion Diffusion es un método para generar ilusiones que permite al usuario generar nuevas imágenes introduciendo una imagen y una descripción de la ilusión, ¡soportando muchos tipos de ilusiones como visuales, auditivas, táctiles y más! |

| Difusión estable XL Imagen a imagen | Ejecute SDXL imagen a imagen a la velocidad de la luz | imagen a imagen | Stable Diffusion XL Image to Image es un método de imagen a imagen que permite al usuario generar una nueva imagen a partir de una imagen de entrada, lo que admite una amplia gama de tareas de imagen a imagen, como la conversión de estilos, la superresolución, la restauración de imágenes y mucho más. |

| Cómodo Flujo de trabajo Ejecutor | Ejecución de flujos de trabajo Comfy en fal | json-to-image | Comfy Workflow Executor es un método para ejecutar flujos de trabajo Comfy que permite a los usuarios generar imágenes introduciendo flujos de trabajo en formato JSON, con soporte para una variedad de componentes de flujo de trabajo como datos, modelos, operaciones, salidas y ¡mucho más! |

| Modelo Segment Anything | Modelo SAM | imagen a imagen | Segment Anything Model es un método de segmentación de imágenes que permite al usuario generar un mapa de segmentación introduciendo una imagen, soportando una gran variedad de tareas de segmentación de imágenes, como segmentación semántica, segmentación de instancias, segmentación de caras, etc. |

| TinySAM | Segmento destilado Cualquier cosa Modelo TinySAM | imagen a imagen | TinySAM es un método de segmentación de imágenes que constituye una versión destilada del Segment Anything Model, capaz de obtener resultados de segmentación similares a los del modelo original con modelos de menor tamaño y velocidades de inferencia más rápidas. |

| Estimación de profundidad Midas | Creación de mapas de profundidad mediante la estimación de profundidad Midas | imagen a imagen | Midas Depth Estimation es un método para generar mapas de profundidad que permite al usuario generar mapas de profundidad a partir de una imagen de entrada, con soporte para diversos formatos de mapas de profundidad, como escala de grises, color, pseudocolor, etc. |

| Eliminar fondo | Eliminar el fondo de la imagen | imagen a imagen | Remove Background es un método para eliminar el fondo de una imagen, que permite al usuario generar una imagen con el fondo eliminado introduciendo una imagen, con soporte para una variedad de tipos de fondo, como paisajes naturales, escenas de interior, objetos complejos, etc. |

| Imágenes de lujo | Ampliar la imagen en un factor determinado | imagen a imagen | Upscale Images es un método de ampliación de imágenes que permite al usuario generar una nueva imagen introduciendo una imagen y un factor de zoom, y admite diversos formatos de imagen, como JPG, PNG, BMP, etc. |

| ControlNet SDXL | Generación de imágenes mediante ControlNet | imagen a imagen | ControlNet SDXL es un método de generación de imágenes que permite al usuario generar nuevas imágenes introduciendo una imagen y vectores de control, con soporte para una amplia gama de tipos de vectores de control, como estilo, color, forma, etc. |

| Inpainting sdxl y sd | Reparación de imágenes con SD y SDXL | imagen a imagen | Inpainting sdxl y sd es un método de restauración de imágenes que permite al usuario generar una imagen restaurada mediante la introducción de una imagen y una máscara, y que admite una amplia gama de tareas de restauración de imágenes, como la eliminación de marcas de agua, el relleno de huecos, la eliminación de ruido, etc. |

| Animatediff LCM | Anime su texto con un modelo de coherencia latente | texto a imagen | Animatediff LCM es un método para generar animaciones que permite a los usuarios generar clips de vídeo cortos introduciendo texto y fotogramas, y admite diversos modelos de consistencia latente, como SDXL, SDv1.5, SDv1.0, etc. |

| Animatediff SparseCtrl LCM | Animar sus dibujos con un modelo de coherencia latente | texto a vídeo | Animatediff SparseCtrl LCM es un método para generar animaciones que permite al usuario generar clips de vídeo cortos introduciendo dibujos y recuentos de fotogramas, y admite una amplia gama de modelos de consistencia latente como SDXL, SDv1.5, SDv1.0, etc. |

| Controlado Vídeo estable Difusión | Genera videoclips cortos a partir de tus imágenes | imagen a imagen | Controlled Stable Video Diffusion es un método de generación de vídeos que permite al usuario generar clips de vídeo cortos mediante la introducción de imágenes y vectores de control, admitiendo múltiples tipos de vectores de control, como movimiento, ángulo, velocidad, etc. |

| Animación mágica | Generar clips de vídeo cortos a partir de secuencias de movimiento | imagen a imagen | Magic Animate es un método para generar vídeos que permite a los usuarios generar clips de vídeo cortos introduciendo imágenes y secuencias de movimiento, y que admite una gran variedad de formatos de secuencias de movimiento, como texto, iconos, gestos, ¡y mucho más! |

| Cara intercambiable | Intercambiar caras entre dos imágenes | imagen a imagen | Swap Face es un método para intercambiar caras que permite al usuario generar una nueva imagen introduciendo dos imágenes, admitiendo una amplia gama de tipos de imágenes como personas, animales, dibujos animados, etc. |

| Adaptador IP Face ID | Personalización cero muestras de alta calidad | imagen a imagen | IP Adapter Face ID es un método para generar imágenes personalizadas que permite a los usuarios generar nuevas imágenes introduciendo una imagen y una descripción personalizada, admitiendo una amplia gama de tipos de personalización como peinados, ropa, fondos, etc. |

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Puestos relacionados

Sin comentarios...