DeepSeek-V3/R1 Visión general de los sistemas de razonamiento (DeepSeek Open Source Week Day 6)

Principios de diseño del sistema

El objetivo de optimización del servicio de inferencia DeepSeek-V3/R1 es:Mayor rendimiento y menor latencia.

Para optimizar estos dos objetivos, DeepSeek emplea una solución denominada paralelismo experto entre nodos (EP).

- En primer lugar, EP escala significativamente el tamaño del lote, lo que mejora la eficiencia del cálculo matricial en la GPU y aumenta el rendimiento.

- En segundo lugar, EP reduce la latencia distribuyendo los expertos entre varias GPU, de forma que cada GPU procesa sólo una pequeña fracción de los expertos (lo que reduce los requisitos de acceso a la memoria).

Sin embargo, la PE aumenta la complejidad del sistema de dos formas principales:

- El PE introduce la comunicación entre nodos. Para optimizar el rendimiento, deben diseñarse flujos de trabajo computacionales adecuados que solapen la comunicación con el cálculo.

- El PE implica múltiples nodos y, por lo tanto, requiere el propio Paralelismo de Datos (DP) y el equilibrio de carga entre diferentes instancias de DP.

Este artículo se centra en DeepSeek Cómo afrontar estos retos:

- Utilice EP para ampliar el tamaño del lote.

- Ocultar los retrasos de comunicación tras el cálculo, y

- Equilibrar la carga.

Paralelismo experto entre nodos a gran escala (EP)

Debido al gran número de expertos en DeepSeek-V3/R1 (sólo se activan 8 de 256 expertos por capa), la gran dispersión del modelo requiere un tamaño de lote total muy grande. Esto garantiza un tamaño de lote suficiente por experto, lo que se traduce en un mayor rendimiento y una menor latencia. La PE entre nodos a gran escala es crucial.

Dado que DeepSeek emplea una arquitectura de separación entre prepoblación y descodificación, se utilizan distintos niveles de paralelismo en las fases de prepoblación y descodificación:

- Fase de prepoblación [Experto en rutas EP32, MLA/Experto compartido DP32]Cada unidad de despliegue abarca 4 nodos y tiene 32 expertos en enrutamiento redundantes, con cada GPU manejando 9 expertos en enrutamiento y 1 experto compartido.

- Fase de descodificación [Experto en rutas EP144, Experto en MLA/Sharing DP144]Cada unidad de despliegue abarca 18 nodos y cuenta con 32 expertos en enrutamiento redundantes. Cada GPU gestiona 2 expertos en enrutamiento y 1 experto compartido.

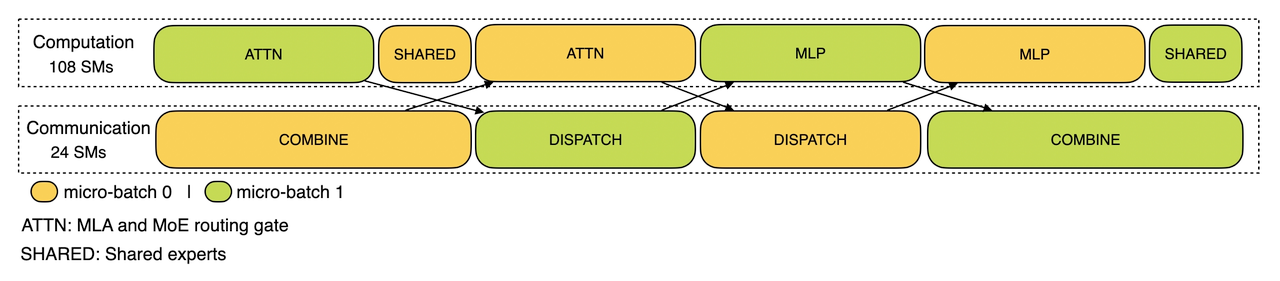

solapamiento informática-comunicaciones

Los PE a gran escala entre nodos introducen una sobrecarga de comunicación significativa. Para mitigar esto, DeepSeek emplea una estrategia de solapamiento de doble lote para ocultar el coste de comunicación y mejorar el rendimiento general dividiendo un lote de solicitudes en dos microlotes. En la fase de prepoblación, estos dos microlotes se ejecutan alternativamente, y el coste de comunicación de un microlote se oculta tras el cálculo del otro.

Cálculo de la fase de prepoblación - solapamiento de la comunicación

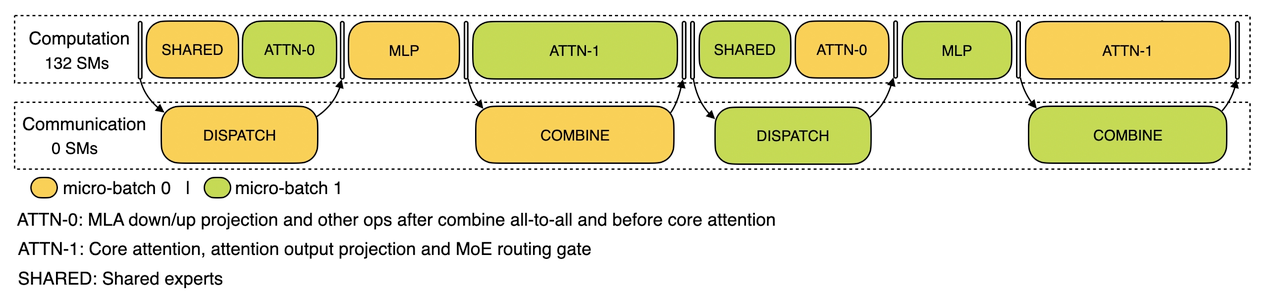

En la fase de descodificación, el tiempo de ejecución de las distintas etapas es desigual. Por ello, DeepSeek subdivide la capa de atención en dos pasos y utiliza un pipeline de 5 fases para lograr un solapamiento computación-comunicación sin fisuras.

Solapamiento cálculo-comunicación en la fase de descodificación

Para más información sobre el mecanismo de superposición de cálculos y comunicaciones de DeepSeek, visite https://github.com/deepseek-ai/profile-data.

Equilibrio óptimo de la carga

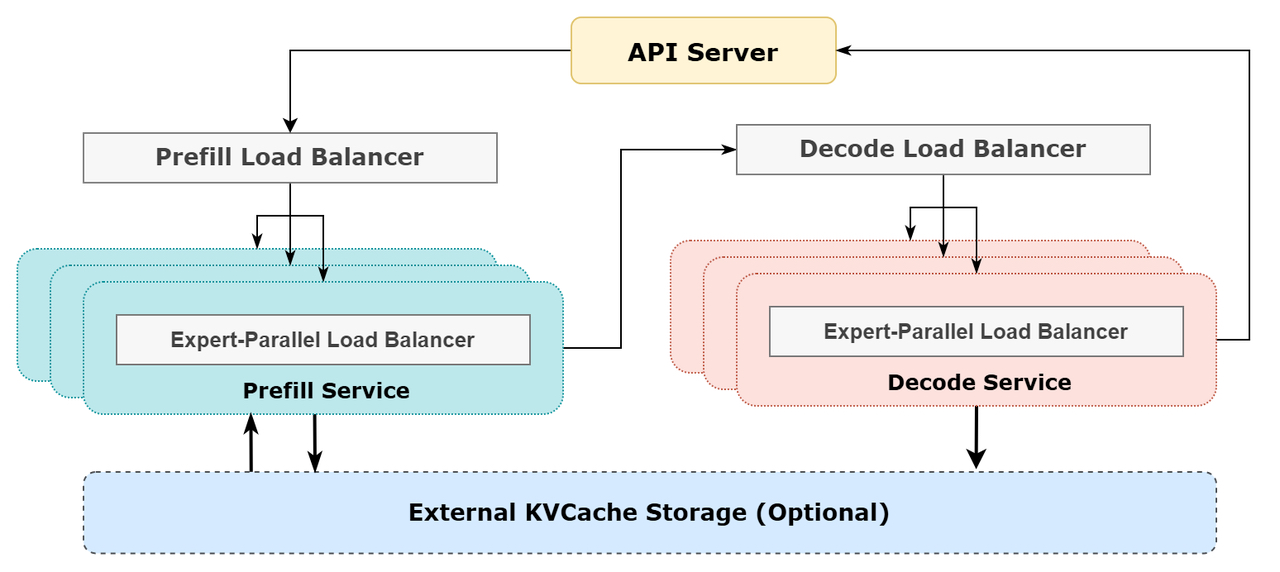

El paralelismo masivo (incluidos DP y EP) plantea un reto clave: si una sola GPU se sobrecarga de cálculo o comunicación, se convierte en un cuello de botella de rendimiento, ralentizando todo el sistema mientras las demás GPU están inactivas. Para maximizar la utilización de los recursos, DeepSeek trata de equilibrar la carga de cálculo y comunicación entre todas las GPU.

1. Equilibrador de carga prepoblado

- Problema clave: el diferente número de solicitudes y longitudes de secuencia entre las instancias de AD provoca un desequilibrio en el cálculo de la atención central y la carga de envío de programación.

- Objetivos de optimización:

- Equilibrio del cómputo de atención central entre GPUs (equilibrio de carga del cómputo de atención central).

- Igualar las entradas de cada GPU Ficha (programación de envío de equilibrio de carga) para evitar largos tiempos de procesamiento en GPU específicas.

2. Descodificación de los equilibradores de carga

- Problema clave: El número desigual de peticiones y la longitud de las secuencias entre las instancias de AD provocan diferencias en el cómputo de la atención central (relacionado con el uso de KVCache) y la carga de envío de programación.

- Objetivos de optimización:

- Equilibra el uso de KVCache entre GPUs (Core Attention Computing load balancing).

- Equilibra el número de peticiones por GPU (programación envía equilibrio de carga).

3. Equilibrador de carga paralelo experto

- Problema clave: para un determinado modelo de MoE, existe una carga inherentemente alta de expertos, lo que da lugar a una carga de trabajo de cálculo de expertos desequilibrada entre las distintas GPU.

- Objetivos de optimización:

- Equilibrar el cálculo experto en cada GPU (es decir, minimizar la carga máxima de recepción de programación en todas las GPU).

Diagrama esquemático del sistema de razonamiento en línea DeepSeek

Diagrama esquemático del sistema de razonamiento en línea DeepSeek

Estadísticas del servicio en línea DeepSeek

Todos los servicios de inferencia de DeepSeek-V3/R1 se proporcionan en GPUs H800 con una precisión coherente con el entrenamiento. En concreto, la multiplicación de matrices y las transferencias de programación tienen un formato FP8 coherente con el entrenamiento, mientras que los cálculos de MLA del núcleo y las transferencias combinatorias utilizan el formato BF16 para garantizar un rendimiento óptimo del servicio.

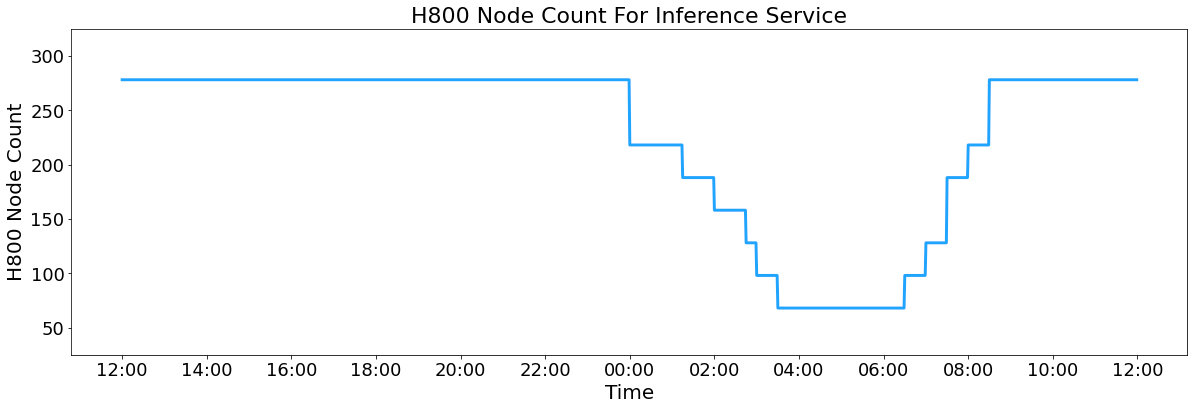

Además, debido a la alta carga del servicio durante el día y la baja carga durante la noche, DeepSeek implementó un mecanismo para desplegar el servicio de inferencia en todos los nodos durante las horas punta del día. Durante las horas de baja carga por la noche, DeepSeek reduce los nodos de inferencia y asigna recursos a la investigación y la formación. Durante las últimas 24 horas (12:00pm UTC+8 del 27 de febrero de 2025 a 12:00pm UTC+8 del 28 de febrero de 2025), la ocupación máxima de nodos para los servicios de inferencia V3 y R1 ascendió a 278 nodos, con una ocupación media de 226,75 nodos (cada uno de ellos con 8 GPUs H800). Suponiendo un coste de alquiler de 2 dólares por hora para una GPU H800, el coste diario total es de 87.072 dólares.

H800 Número de nodos del servicio de inferencia

V3 y R1 durante el periodo estadístico de 24 horas (12:00 horas UTC+8 del 27 de febrero de 2025 a 12:00 horas UTC+8 del 28 de febrero de 2025):

- Token de entrada total: 608B, de los cuales 342B Token (56,3%) llegaron a la caché KV en disco.

- Token de salida total: 168 B. La velocidad media de salida es de 20-22 Token por segundo, y la longitud kvcache media de cada Token de salida es de 4.989 Token.

- Cada nodo H800 proporciona una media de ~73,7k Token/s de rendimiento de entrada (incluidos los aciertos de caché) durante la prepoblación o ~14,8k Token/s de rendimiento de salida durante la descodificación.

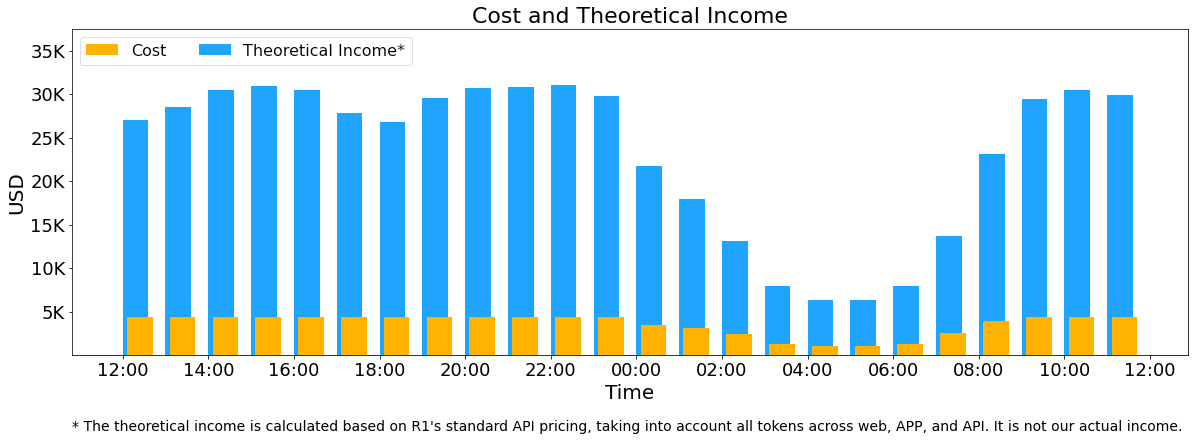

Las estadísticas anteriores incluyen todas las solicitudes de usuarios desde la web, la aplicación y la API. Si todos los tokens son conformes a la DeepSeek-R1 Los ingresos diarios totales ascienden a 562.027 dólares, con un margen de costes de 545% basado en la facturación de precios (*).

() Precios R1: 0,14 $/M por ficha de entrada (acierto de caché), 0,55 $/M por ficha de entrada (fallo de caché), 2,19 $/M por ficha de salida.

Sin embargo, los ingresos reales de DeepSeek son muy inferiores por las siguientes razones:

- DeepSeek-V3 tiene un precio muy inferior al R1, el

- Sólo algunos de los servicios son de pago (el acceso a la web y a la APP sigue siendo gratuito).

- Los descuentos nocturnos se aplican automáticamente fuera de las horas punta.

Costes e ingresos teóricos

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...