Funciones de DeepSeek-R1 en detalle, con informe de evaluación chino

lectura rápida

Experiencia:DeepSeek Sitio web oficial: chat.deepseek.com Chatea con DeepSeek-R1 y activa el botón "Deep Thinking". Visite API compatible con el formato OpenAI .

Bienestar:Implantación en línea del modelo de código abierto DeepSeek-R1 con potencia de GPU gratuita yRegalo de 1001 créditosTP4T DeepSeek-R1yLas 5 mejores plataformas de inferencia de IA que utilizan una versión completa y gratuita de DeepSeek-R1

Recurrencia:Intentos recientes de reproducir Hay bastantes proyectos para DeepSeek-R1, así que no pierdas de vista los siguientes artículos:TinyZero: una réplica de bajo coste del efecto epifánico de DeepSeeK-R1 Zero yOpen R1: Cara abrazada reproduce el proceso de entrenamiento de DeepSeek-R1 yReplicando DeepSeek-R1: 8K ejemplos matemáticos ayudan a pequeños modelos a lograr avances en inferencia mediante aprendizaje por refuerzo Aún hay más:R1 Overthinker: obligar a los modelos DeepSeek R1 a pensar más tiempo .

Resumen:Longitud del contexto: 128K, 2,19 dólares por millón de tokens de salida (un dineral en el mundo de los grandes modelos), rendimiento equiparable al de OpenAI-o1, todos los modelos de código abierto destilados libremente y utilizados comercialmente, funcionalidad front-end imaginativa para escribir

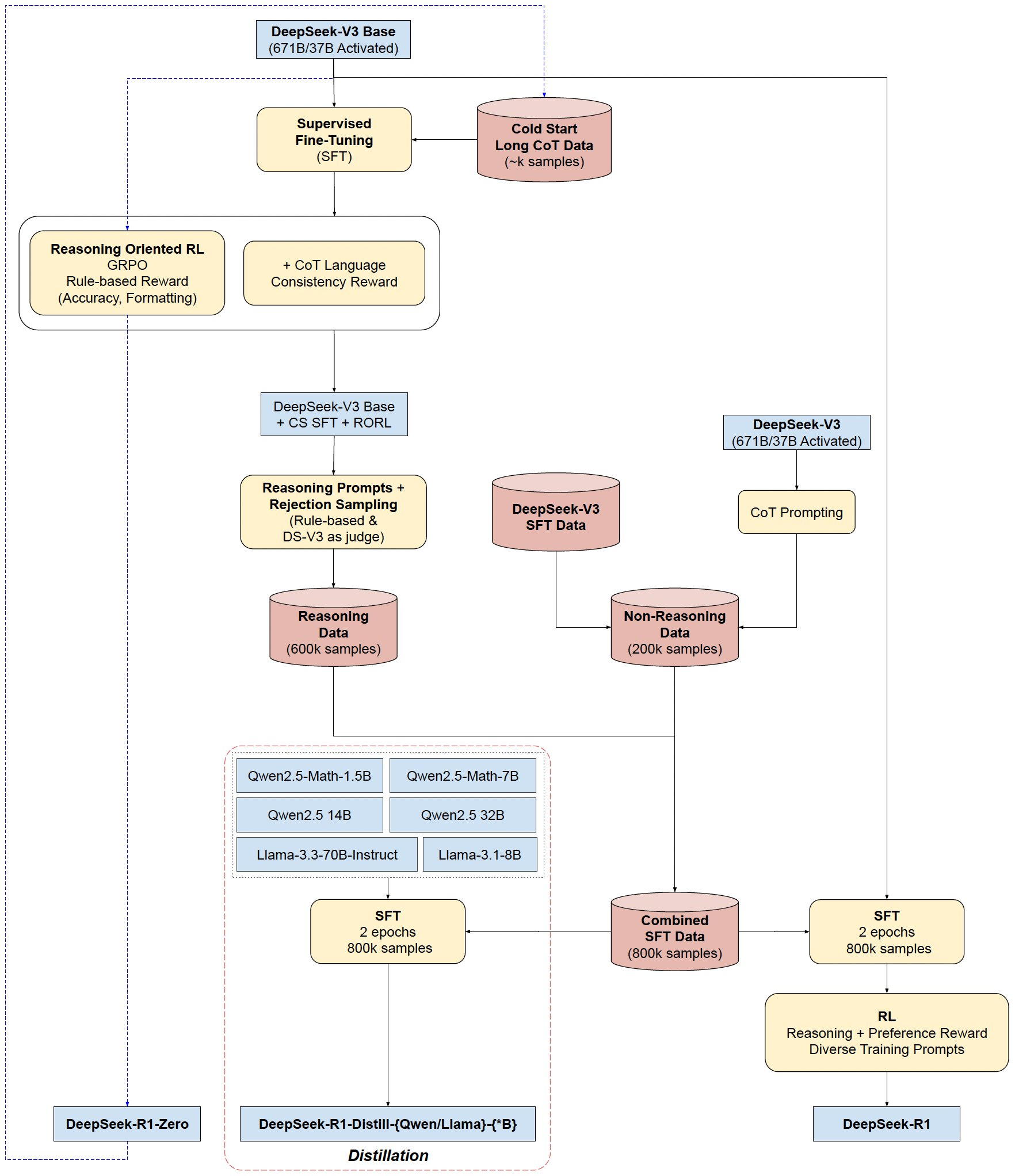

Modelo base: Tanto DeepSeek-R1-Zero como DeepSeek-R1 se entrenan a partir de DeepSeek-V3-Base, y DeepSeek-R1 se mejora con una pequeña cantidad de datos CoT largos, lo que hace que el resultado sea más estructurado y parsimonioso.

Modelos de destilación (mejora general de las capacidades de las miniaturas de código abierto existentes): Destilación de DeepSeek-R1 en varios modelos más pequeños que son ( Ollama (disponible para descarga)

Qwen2.5-Matemáticas-1.5B, Qwen2.5-Matemáticas-7B, Qwen2.5-14B, Qwen2.5-32B, Llama-3.1-8B, Llama-3.3-70B-Instrucción

Flujo de entrenamiento de DeepSeek-R1(-Cero)

- Arranque en frío: puesta a punto del ejemplo CoT

- Aprendizaje por refuerzo del razonamiento: añadir recompensas de coherencia lingüística

- Generación de datos: creados 80 10.000 muestras de entrenamiento

- Aprendizaje de refuerzo final: competencias equilibradas (tanto de razonamiento como genéricas) mediante retroalimentación combinada.

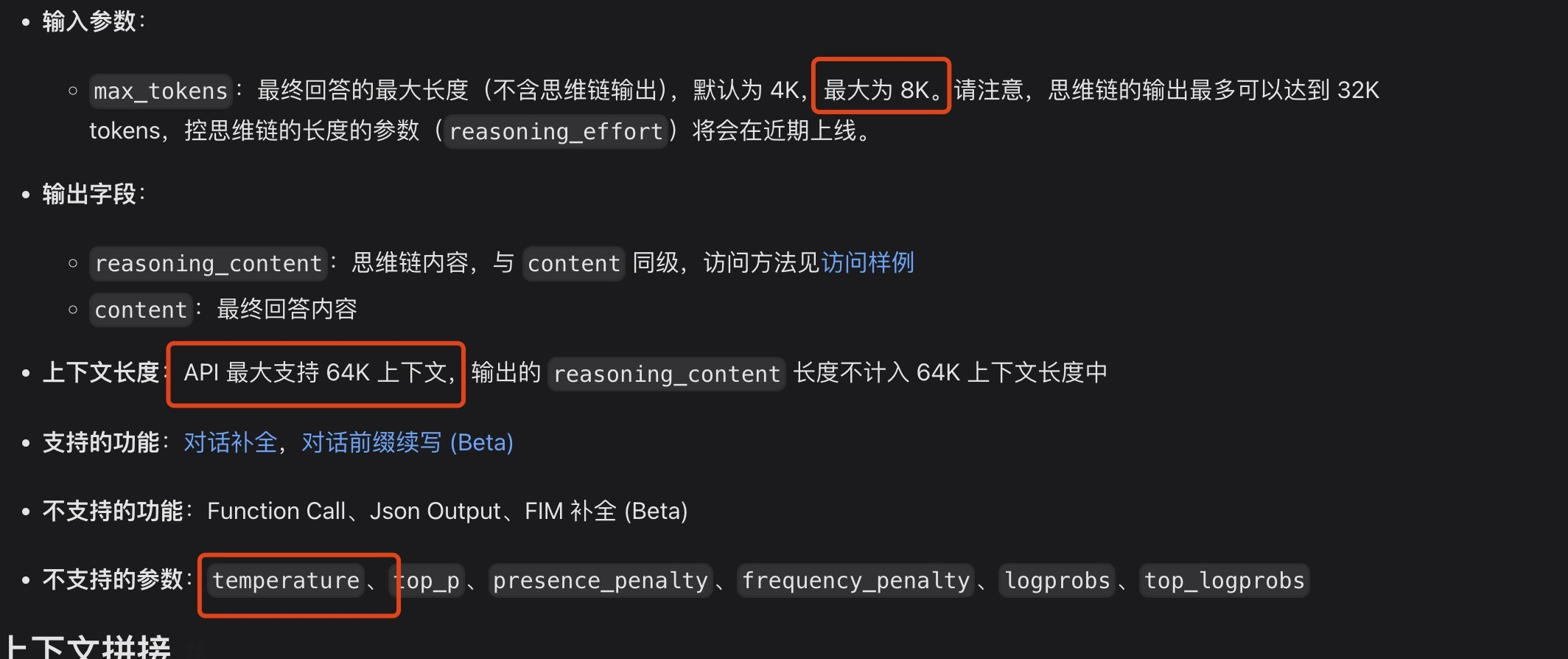

problema, la longitud de contexto de la API puede no ser suficiente en programación

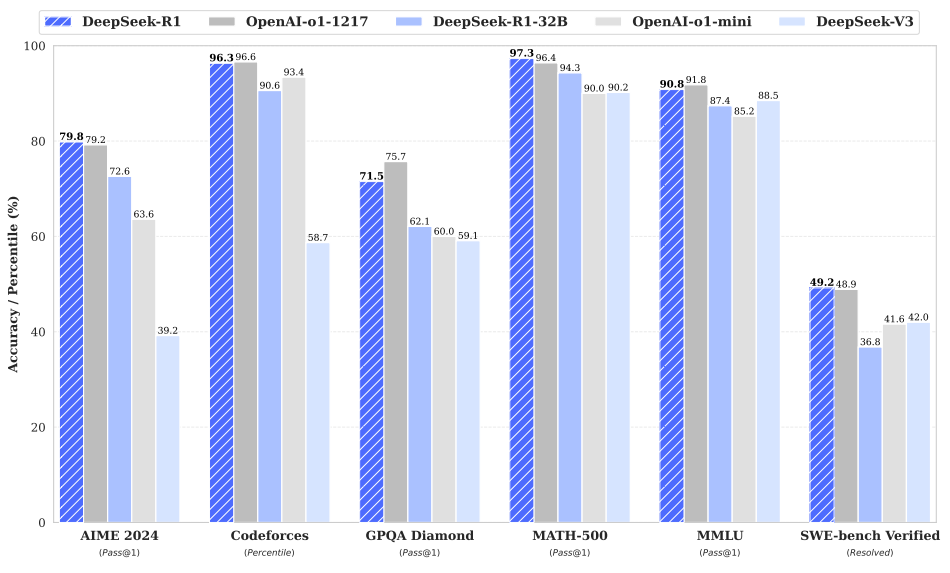

Evaluación comparativa

Gran capacidad de razonamiento:

Buen rendimiento en problemas matemáticos, comparable al de OpenAI-01-1217. Obtiene una puntuación increíblemente alta (97,3%) en la prueba MATH-500.

Gran rendimiento en tareas de codificación de algoritmos como Codeforces y LiveCodeBench.

Demostrar grandes capacidades en tareas que requieran un razonamiento complejo, como FRAMES.

Gran capacidad de uso general:

Excelente rendimiento en pruebas comparativas basadas en el conocimiento, como MMLU, MMLU-Pro y GPQA Diamond.

También destacó en redacción, respuesta a preguntas de campo abierto y otras tareas diversas.

Excelentes tasas de éxito en el control de la longitud en pruebas de referencia como AlpacaEval 2.0 y ArenaHard, lo que demuestra que gestiona de forma inteligente las consultas no orientadas a exámenes.

Capacidad para generar resúmenes concisos y evitar el sesgo de longitud.

Buena legibilidad:Con datos de arranque en frío y un diseño específico en el proceso de entrenamiento, la salida de DeepSeek-R1 es más fácil de leer, utilizando el formato y la estructura adecuados.

Multilingüismo:Aunque en la actualidad está optimizado principalmente para chino e inglés, muestra cierta capacidad para gestionar consultas en varios idiomas.

Capacidad para seguir instrucciones:Obtuvo buenos resultados en la prueba de referencia IF-Eval, demostrando su capacidad para comprender y seguir bien las instrucciones.

Capacidad de autoevolución:Mediante el aprendizaje por refuerzo, los modelos pueden aprender de forma autónoma y mejorar su capacidad de razonamiento, y son capaces de enfrentarse a problemas complejos aumentando su tiempo de reflexión.

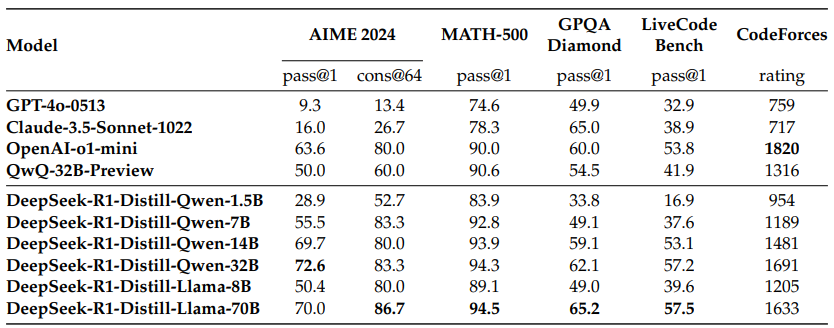

Excelente potencial de destilación:DeepSeek-R1 se puede utilizar como modelo maestro para destilar la potencia de inferencia en modelos más pequeños, y los modelos destilados tienen un rendimiento excelente, por ejemplo, DeepSeek-R1-Distill-Qwen-32B, que supera significativamente a los otros modelos en varios puntos de referencia.

Acerca de las capacidades de programación local

Si cree que v3 es lo suficientemente bueno para la programación, ¿cuál es el modelo de destilación alternativo de escritorio? Comparado con DeepSeek V3, ¿qué modelo de destilación es comparable? Según la puntuación de LiveCodeBench, DeepSeek V3 obtiene una puntuación de 42,2 y el modelo de destilación Qwen 14B obtiene una puntuación de 53,1, que tiene un rendimiento comparable y un tamaño de clase relativamente de escritorio para poder ejecutarse, y se recomienda utilizar 14B en el escritorio.

DeepSeek-R1: Motivación del razonamiento LLM mediante el aprendizaje por refuerzo.

Publicado por DeepSeek-AI

Original: https://github.com/deepseek-ai/DeepSeek-R1/blob/main/DeepSeek_R1.pdf

resúmenes

Presentamos nuestros modelos de inferencia de primera generación, DeepSeek-R1-Zero y DeepSeek-R1. DeepSeek-R1-Zero, un modelo entrenado mediante aprendizaje por refuerzo (RL) a gran escala sin un paso inicial de ajuste fino supervisado (SFT), demuestra una inferencia superior. Con RL, DeepSeek-R1-Zero emerge de forma natural con muchos comportamientos de inferencia potentes e interesantes. Sin embargo, también se enfrenta a algunos retos, como la escasa legibilidad y la mezcla de lenguajes. Para hacer frente a estos problemas y mejorar aún más el rendimiento de la inferencia, presentamos DeepSeek-R1, que combina el entrenamiento multietapa y los datos de arranque en frío antes de la RL. DeepSeek-R1 consigue un rendimiento comparable al de OpenAI-01-1217 en tareas de inferencia. Para apoyar a la comunidad investigadora, hemos abierto DeepSeek-R1-Zero, DeepSeek-R1 y seis modelos densos (1.5B, 7B, 8B, 14B, 32B, 70B) basados en los refinamientos de Qwen y Llama.

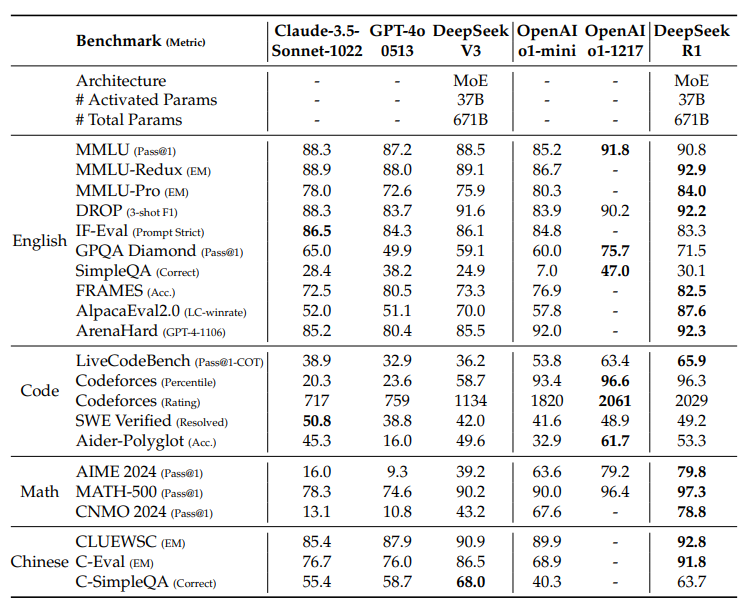

Fig. 1 | Rendimiento de DeepSeek-R1.

directorio (en el disco duro del ordenador)

1 Introducción

1.1 Contribuciones

1.2 Resumen de los resultados de la evaluación

2 Metodología

2.1 Panorama general

2.2 DeepSeek-R1-Zero: aprendizaje por refuerzo basado en modelos fundacionales

2.2.1 Algoritmo de aprendizaje mejorado

2.2.2 Modelización de los incentivos

2.2.3 Plantillas de formación

2.2.4 Rendimiento de DeepSeek-R1-Zero, procesos autoevolutivos y momentos de epifanía

2.3 DeepSeek-R1: Aprendizaje por refuerzo en frío

2.3.1 Arranque en frío

2.3.2 Aprendizaje por refuerzo orientado al razonamiento

2.3.3 Rechazo del muestreo y supervisión de la puesta a punto

2.3.4 Aprendizaje por refuerzo para todos los escenarios

2.4 Destilación: aumentar la capacidad de razonamiento de los modelos pequeños

3 Experimentos

3.1 Evaluación de DeepSeek-R1

3.2 Evaluación de la modelización de la destilación

4 Debate

4.1 Destilación frente a aprendizaje intensivo

4.2 Intentos fallidos

5 Conclusiones, limitaciones y trabajo futuro

1. Introducción

En los últimos años, los modelos lingüísticos a gran escala (LLM) han experimentado una rápida iteración y desarrollo (Anthropic, 2024; Google, 2024; OpenAI, 2024a), cerrando gradualmente la brecha que conduce a la inteligencia general artificial (AGI).

Recientemente, el post-entrenamiento se ha convertido en una parte importante del proceso completo de entrenamiento. Se ha demostrado que mejora la precisión de las tareas de razonamiento, se alinea con los valores sociales y se adapta a las preferencias del usuario, al tiempo que requiere relativamente pocos recursos informáticos en comparación con el preentrenamiento. En cuanto a la capacidad de razonamiento, la familia de modelos o1 de OpenAI (OpenAI, 2024b) introduce por primera vez el escalado al razonar aumentando la longitud del proceso de razonamiento de la cadena de pensamiento. Este enfoque ha dado lugar a avances significativos en diversas tareas de razonamiento, como el razonamiento matemático, de codificación y científico. Sin embargo, el reto del escalado eficaz del tiempo de prueba sigue siendo una cuestión abierta para la comunidad investigadora. Algunos trabajos anteriores han explorado diversos enfoques, como los modelos de recompensa basados en procesos (Lightman et al., 2023; Uesato et al., 2022; Wang et al., 2023), el aprendizaje por refuerzo (Kumar et al., 2024) y algoritmos de búsqueda como la búsqueda en árbol Monte-Carlo y la búsqueda por paquetes (Feng et al., 2024; Trinh et al.) 2024; Trinh et al.). Sin embargo, ninguno de estos métodos ha sido capaz de lograr un rendimiento de inferencia generalizada comparable al de la familia de modelos o1 de OpenAI.

En este artículo, damos el primer paso hacia la mejora de las capacidades de razonamiento de los modelos lingüísticos utilizando el aprendizaje por refuerzo (RL) puro. Nuestro objetivo es explorar el potencial del LLM para desarrollar capacidades de razonamiento sin ningún dato supervisado, centrándonos en la autoevolución a través de un proceso de RL puro. En concreto, utilizamos DeepSeek-V3-Base como modelo base y GRPO (Shao et al., 2024) como marco de RL para mejorar el rendimiento del modelo en el razonamiento. Durante el proceso de entrenamiento, DeepSeek-R1-Zero emerge de forma natural con muchos comportamientos de inferencia potentes e interesantes. Después de miles de pasos de RL, DeepSeek-R1-Zero muestra un excelente rendimiento en las pruebas de inferencia. Por ejemplo, AIME 2024的pass@1得分从15.6%提高到71.0% y por votación mayoritaria, la puntuación se mejora aún más hasta 86,7%, alcanzando el nivel de rendimiento de OpenAI-01-0912.

Sin embargo, DeepSeek-R1-Zero se enfrenta a problemas como la mala legibilidad y la mezcla de idiomas. Para resolver estos problemas y mejorar aún más el rendimiento de la inferencia, presentamos DeepSeek-R1, que combina una pequeña cantidad de datos de arranque en frío con un proceso de entrenamiento en varias etapas. En concreto, primero recopilamos miles de datos de arranque en frío para ajustar el modelo DeepSeek-V3-Base. A medida que el proceso de RL se acerca a la convergencia, creamos nuevos datos SFT mediante el muestreo de rechazo de los puntos de control de RL, los combinamos con datos supervisados de DeepSeek-V3 en los ámbitos de la escritura, las preguntas objetivas y el autoconocimiento, y luego volvemos a entrenar el modelo DeepSeek-V3-Base. V3-Base. Después de afinar con los nuevos datos, este punto de control se somete a un proceso adicional de RL, que tiene en cuenta las señales de todos los escenarios. Tras estos pasos, obtenemos un punto de control llamado DeepSeek-R1, cuyo rendimiento es comparable al de OpenAI-01-1217.

También exploramos la destilación de DeepSeek-R1 a modelos densos más pequeños. Utilizando Qwen 2.5-32B (Qwen, 2024b) como modelo base, la destilación directa de DeepSeek-R1 supera a la aplicación de RL sobre él, lo que sugiere que los patrones de inferencia encontrados en el modelo base más grande son fundamentales para mejorar la inferencia. Hemos abierto la familia de modelos Qwen y Llama (Dubey et al., 2024) para la destilación. En particular, nuestro modelo destilado de 14B supera sustancialmente al modelo de código abierto de última generación QwQ-32B-Preview (Qwen, 2024a), y los modelos destilados de 32B y 70B establecen un nuevo récord de puntos de referencia de razonamiento en modelos densos.

1.1 Contribuciones

Post-entrenamiento: aprendizaje por refuerzo a gran escala basado en modelos de base

- Aplicamos el aprendizaje por refuerzo (RL) directamente al modelo subyacente sin depender del ajuste fino supervisado (SFT) como paso previo. Este enfoque permite al modelo explorar cadenas de pensamiento (CoT) para resolver problemas complejos, lo que conduce al desarrollo de DeepSeek-R1-Zero. DeepSeek-R1-Zero demuestra la capacidad de autovalidación, reflexión y crecimiento de las CoT, marcando un hito importante para la comunidad investigadora. En particular, se trata del primer estudio público que valida que la capacidad de razonamiento de LLM puede ser motivada por la RL pura sin necesidad de SFT.

- Describimos el proceso utilizado para desarrollar DeepSeek-R1. El proceso consta de dos fases de RL destinadas a descubrir patrones de razonamiento mejorados y alinearlos con las preferencias humanas, y dos fases de SFT que sirven de semilla para las capacidades de razonamiento y no razonamiento del modelo. Creemos que el proceso beneficiará a la industria al crear mejores modelos.

Destilación: los modelos pequeños pueden ser poderosos

- Demostramos que los patrones de inferencia de modelos grandes pueden destilarse en modelos más pequeños para obtener un mejor rendimiento en comparación con los patrones de inferencia descubiertos mediante RL en modelos pequeños. El código abierto DeepSeek-R1 y su API beneficiarán a la comunidad investigadora a la hora de destilar mejores modelos pequeños en el futuro.

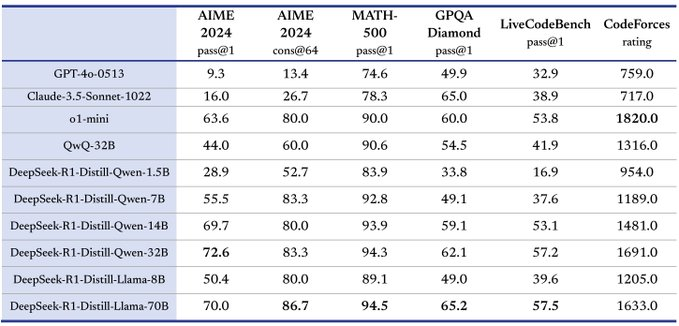

- Utilizando los datos de inferencia generados por DeepSeek-R1, hemos ajustado varios modelos densos ampliamente utilizados en la comunidad investigadora. Los resultados de la evaluación muestran que los pequeños modelos densos destilados obtienen buenos resultados en las pruebas comparativas. DeepSeek-R1-Distill-Qwen-7B obtiene una puntuación de 55,51 TP3T en AIME 2024, superando a QwQ-32B-Preview. obtuvo 72,6% en AIME 2024, 94,3% en MATH-500 y 57,2% en LiveCodeBench. Estos resultados son significativamente mejores que los modelos de código abierto anteriores y comparables a o1-mini. Hemos puesto a disposición de la comunidad los puntos de control de destilación 1,5B, 7B, 8B, 14B, 32B y 70B basados en las series Qwen2.5 y Llama3.

1.2 Resumen de los resultados de la evaluación

- Tareas de inferencia:(1) DeepSeek-R1 obtuvo una puntuación pass@1 de 79,81 TP3T en AIME 2024, superando ligeramente a OpenAI-o1-1217. En MATH-500, obtuvo una impresionante puntuación de 97,31 TP3T, que es comparable al rendimiento de OpenAI-o1-1217 y significativamente mejor que otros modelos. modelos. (2) En tareas relacionadas con la codificación, DeepSeek-R1 demostró un nivel experto en la tarea de competición de código, ya que alcanzó una puntuación Elo de 2.029 en Codeforces, superando al participante humano de 96,31 TP3T en dicha competición. En las tareas relacionadas con la ingeniería, DeepSeek-R1 obtuvo resultados ligeramente mejores que DeepSeek-V3, que ayuda a los desarrolladores a trabajar en el mundo real.

- **** conocimiento: en pruebas de referencia como MMLU, MMLU-Pro y GPQA Diamond, DeepSeek-R1 obtiene resultados sobresalientes, superando significativamente a DeepSeek-V3, con una puntuación de 90,8% en MMLU, 84,0% en MMLU-Pro y GPQA Diamond, con una puntuación de 71,5%. Aunque su rendimiento es ligeramente inferior al de OpenAI-01-1217 en estas pruebas, DeepSeek-R1 supera a los demás modelos de código cerrado, lo que demuestra su ventaja competitiva en tareas educativas. En la prueba SimpleQA, DeepSeek-R1 supera a DeepSeek-V3, lo que demuestra su capacidad para gestionar consultas basadas en hechos. Una tendencia similar se observa en OpenAI-o1 más allá de 4o para este benchmark.

- Otros: DeepSeek-R1 también obtuvo buenos resultados en diversas tareas, como redacción creativa, respuesta a preguntas generales, edición y resumen, entre otras. En AlpacaEval 2.0 alcanzó un porcentaje de victorias en el control de longitud de 87,61 TP3T y en ArenaHard de 92,31 TP3T, lo que demuestra su gran capacidad para procesar de forma inteligente consultas no orientadas a exámenes. Además, DeepSeek-R1 obtiene buenos resultados en tareas que requieren una comprensión contextual larga, superando significativamente a DeepSeek-V3 en pruebas de referencia contextuales largas.

2. Metodología

2.1 Panorama general

Los trabajos anteriores se han basado en gran medida en grandes cantidades de datos supervisados para mejorar el rendimiento del modelo. En este estudio, demostramos que la inferencia puede mejorarse significativamente mediante el aprendizaje por refuerzo (RL) a gran escala, incluso sin utilizar el ajuste fino supervisado (SFT) como arranque en frío. Además, el rendimiento puede mejorarse aún más incluyendo una pequeña cantidad de datos de arranque en frío. En las siguientes secciones, presentamos (1) DeepSeek-R1-Zero, que aplica RL directamente al modelo base sin ningún tipo de datos SFT, y (2) DeepSeek-R1, que aplica RL partiendo de puntos de control ajustados con miles de ejemplos largos de Cadena de Pensamientos (CoT). y (3) destilando las capacidades de inferencia de DeepSeek-R1 en pequeños modelos densos.

2.2 DeepSeek-R1-Zero: aprendizaje por refuerzo basado en modelos fundacionales

El aprendizaje por refuerzo ha demostrado una eficacia significativa en tareas de inferencia, como se demostró en nuestro trabajo anterior (Shao et al., 2024; Wang et al., 2023). Sin embargo, estas tareas dependen en gran medida de datos supervisados, cuya recopilación requiere mucho tiempo. En esta sección, exploramos el potencial del LLM para desarrollar capacidades de razonamiento sin datos supervisados, centrándonos en la autoevolución a través de un proceso de aprendizaje por refuerzo puro. Comenzamos con una breve descripción de nuestro algoritmo de aprendizaje por refuerzo y, a continuación, presentamos algunos resultados interesantes, que esperamos que aporten información valiosa a la comunidad.

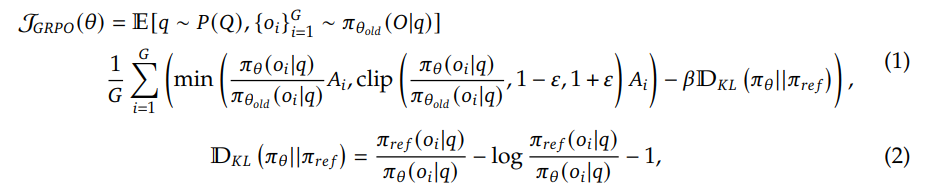

Optimización de la estrategia relativa de grupo Para ahorrar el coste de formación de la RL, empleamos la Optimización de la estrategia relativa de grupo (GRPO) (Shao et al., 2024), que abandona el modelo crítico, que suele ser del mismo tamaño que el modelo de estrategia, y en su lugar estima la línea de base a partir de las puntuaciones de grupo. En concreto, para cada problema q, GRPO muestrea un conjunto de salidas {o1, o2,..., oG} de la estrategia antigua πθold y, a continuación, optimiza el modelo de estrategia πθ maximizando el siguiente objetivo:

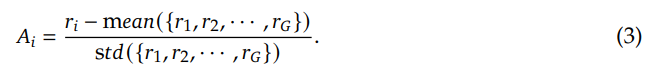

donde ɛ y β son hiperparámetros y Ai es la dominancia, utilizando las recompensas correspondientes a las salidas dentro de cada grupo {r1,r2, . . . , rG} para el cálculo:

La recompensa es la fuente de la señal de entrenamiento, que determina la dirección de optimización de la RL. Para entrenar DeepSeek-R1-Zero, utilizamos un sistema de recompensas basado en reglas que consta de los siguientes dos tipos principales de recompensas:

- Recompensas de precisión: los modelos de recompensa de precisión evalúan si una respuesta es correcta. Por ejemplo, para los problemas de matemáticas con resultados deterministas, el modelo debe proporcionar la respuesta final en un formato especificado (por ejemplo, dentro de un recuadro) para que la verificación de la corrección basada en reglas pueda realizarse de forma fiable. Del mismo modo, para los problemas de LeetCode, el compilador puede utilizarse para generar respuestas basadas en casos de prueba predefinidos.

- Recompensa de formato: Además del modelo de recompensa de precisión, utilizamos un modelo de recompensa de formato que obliga al modelo a situar el proceso de pensamiento entre las etiquetas '' y ''.

En el desarrollo de DeepSeek-R1-Zero no utilizamos modelos neuronales de recompensa de resultados ni de procesos porque descubrimos que los modelos neuronales de recompensa pueden sufrir de hackeo de recompensa durante el aprendizaje por refuerzo a gran escala y que el reentrenamiento del modelo de recompensa requiere recursos de entrenamiento adicionales, lo que puede complicar el proceso de entrenamiento en general.

Para entrenar a DeepSeek-R1-Zero, primero diseñamos una plantilla sencilla que ordena al modelo base seguir las instrucciones que especificamos. Como se muestra en la Tabla 1, esta plantilla requiere que DeepSeek-R1-Zero genere primero el proceso de razonamiento y luego la respuesta final. Limitamos intencionadamente las restricciones a este formato estructural para evitar cualquier sesgo específico del contenido, como forzar el razonamiento reflexivo o promover estrategias específicas de resolución de problemas, para asegurarnos de que podíamos observar con precisión la progresión natural del modelo a través del proceso de aprendizaje por refuerzo (RL).

用户与助手之间的对话。用户提出一个问题,助手解决该问题。

助手首先在脑海中思考推理过程,然后为用户提供答案。

推理过程和答案分别用 <think> </think> 和 <answer> </answer> 标签括起来,即:

<think> 此处为推理过程 </think>

<answer> 此处为答案 </answer>。

用户:提示。助手:

Tabla 1 | Plantillas para DeepSeek-R1-Zero. Durante el entrenamiento, elllamar la atención sobre algose sustituirá por un problema de razonamiento específico.

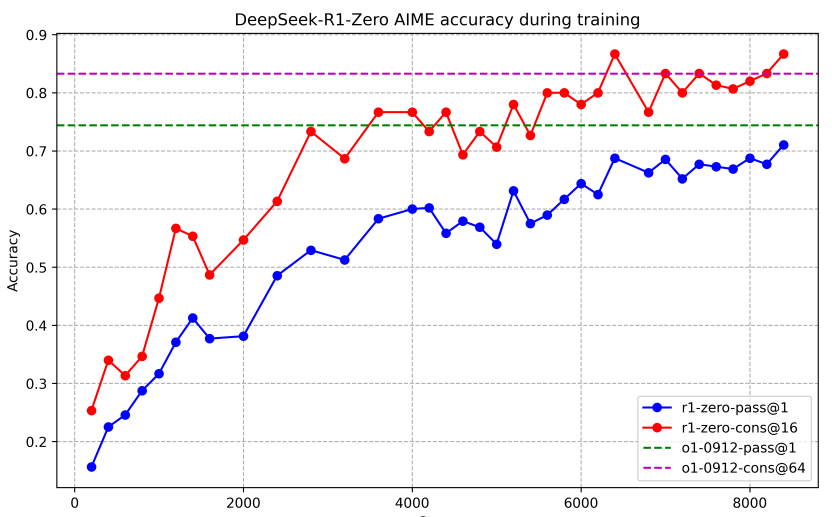

Rendimiento de DeepSeek-R1-Zero La Figura 2 muestra la trayectoria de rendimiento de DeepSeek-R1-Zero en el benchmark AIME 2024 a lo largo del entrenamiento de aprendizaje por refuerzo (RL). Como se muestra, el rendimiento de DeepSeek-R1-Zero muestra una mejora constante y consistente a medida que avanza el entrenamiento RL. En particular, la puntuación media pass@1 de AIME 2024 muestra un crecimiento significativo, pasando de un 15,61 TP3T inicial a un impresionante 71,01 TP3T, alcanzando un nivel de rendimiento comparable al de OpenAI-01-0912. Esta importante mejora pone de manifiesto la eficacia de nuestro algoritmo RL para optimizar el rendimiento del modelo.

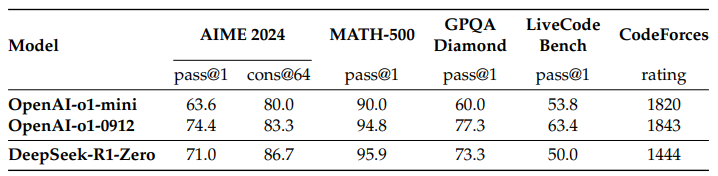

En la Tabla 2 se ofrece un análisis comparativo de DeepSeek-R1-Zero y el modelo o1-0912 de OpenAI en varias pruebas de referencia relacionadas con la inferencia. Los resultados muestran que RL hace

Tabla 2 | Comparación de los modelos DeepSeek-R1-Zero y OpenAI o1 en pruebas de referencia relacionadas con la inferencia.

Fig. 2 | Precisión AIME de DeepSeek-R1-Zero durante el entrenamiento. Para cada problema, muestreamos 16 respuestas y calculamos la precisión media global para garantizar una evaluación estable.

DeepSeek-R1-Zero logra una inferencia potente sin ningún ajuste supervisado de los datos. Se trata de un logro digno de mención, ya que pone de manifiesto la capacidad del modelo para aprender y generalizar de forma eficaz únicamente mediante RL. Además, el rendimiento de DeepSeek-R1-Zero puede mejorarse aún más aplicando la votación por mayoría. Por ejemplo, cuando se utiliza la votación por mayoría en los puntos de referencia AIME, el rendimiento de DeepSeek-R1-Zero mejora de 71,01 TP3T a 86,71 TP3T, superando así el rendimiento de OpenAI-01-0912. pone de manifiesto su gran capacidad subyacente y su potencial para seguir desarrollándose en tareas de razonamiento.

Proceso autoevolutivo de DeepSeek-R1-Zero El proceso autoevolutivo de DeepSeek-R1-Zero es una demostración fascinante de cómo la RL puede llevar a los modelos a mejorar su razonamiento de forma autónoma. Al lanzar la RL directamente desde el modelo base, podemos seguir de cerca el progreso del modelo sin estar sujetos a una fase supervisada de ajuste fino. Este enfoque proporciona una visión clara de cómo evoluciona el modelo con el tiempo, especialmente en términos de su capacidad para manejar tareas de razonamiento complejas.

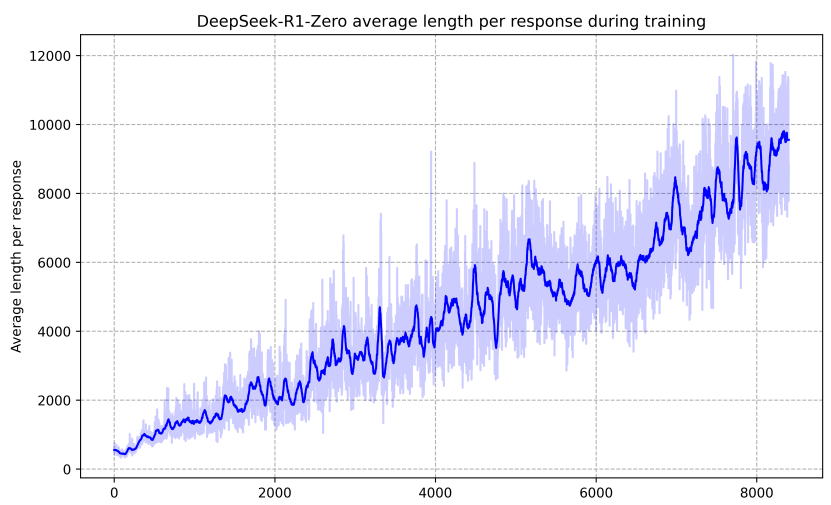

Como se muestra en la Figura 3, el tiempo de razonamiento de DeepSeek-R1-Zero muestra una mejora continua a lo largo del proceso de entrenamiento. Esta mejora no es el resultado de un ajuste externo, sino de un desarrollo intrínseco del modelo. DeepSeek-R1-Zero adquiere de forma natural la capacidad de resolver tareas de razonamiento cada vez más complejas mediante la utilización de un cálculo ampliado en tiempo de prueba. Este cálculo va desde la generación de cientos a miles de tokens de inferencia, lo que permite al modelo explorar y refinar sus procesos de razonamiento en mayor profundidad.

Uno de los aspectos más sorprendentes de esta autoevolución es la aparición de comportamientos complejos a medida que aumenta la computación durante las pruebas. La reflexión, es decir, la revisión y reevaluación de los pasos anteriores por parte del modelo, así como la exploración de enfoques alternativos de resolución de problemas, surgen de forma espontánea. Estos comportamientos no se programan explícitamente, sino que surgen como resultado de la interacción del modelo con el entorno de aprendizaje por refuerzo. Este desarrollo espontáneo mejora significativamente las capacidades de razonamiento de DeepSeek-R1-Zero, permitiéndole abordar tareas más desafiantes con mayor eficiencia y precisión.

Fig. 3 | Longitud media de respuesta de DeepSeek-R1-Zero en el conjunto de entrenamiento del proceso RL.DeepSeek-R1-Zero aprende de forma natural a resolver tareas de inferencia tomándose más tiempo de reflexión.

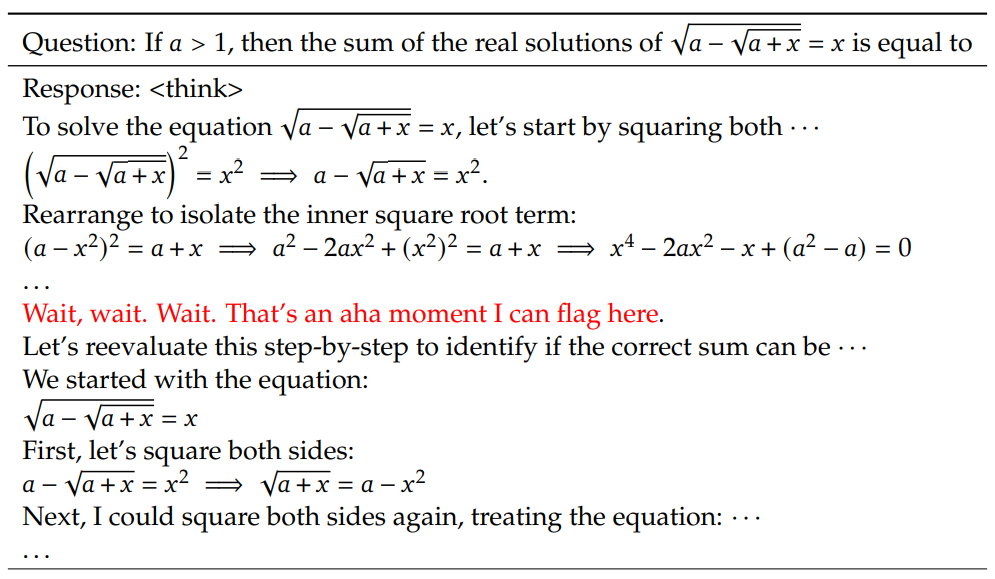

Momentos epifánicos en DeepSeek-R1-Zero Un fenómeno especialmente interesante observado durante el entrenamiento de DeepSeek-R1-Zero es la aparición de "momentos epifánicos". Como se muestra en la Tabla 3, este momento se produce en la versión intermedia del modelo. En esta fase, DeepSeek-R1-Zero aprende a dedicar más tiempo de reflexión al problema reevaluando su planteamiento inicial. Este comportamiento no es sólo un testimonio de las crecientes capacidades de inferencia del modelo, sino también un ejemplo fascinante de cómo el aprendizaje por refuerzo puede conducir a resultados inesperados y complejos.

Tabla 3 | Un interesante "momento epifánico" en la versión intermedia de DeepSeek-R1-Zero. El modelo aprende a repensar utilizando un tono antropomórfico. Este fue también nuestro propio momento epifánico, que nos permitió ser testigos del poder y la belleza del aprendizaje por refuerzo.

Este momento fue una "epifanía" no sólo para el modelo, sino también para los investigadores que observaron su comportamiento. Pone de relieve el poder y la belleza del aprendizaje por refuerzo: en lugar de enseñar explícitamente a un modelo cómo resolver un problema, simplemente le proporcionamos los incentivos adecuados, y él desarrolla de forma autónoma estrategias avanzadas de resolución de problemas. El "momento epifánico" es un poderoso recordatorio del potencial de la RL para desbloquear nuevos niveles de inteligencia en los sistemas de IA, allanando el camino para modelos más autónomos y adaptativos en el futuro.

Desventajas de DeepSeek-R1-Zero Aunque DeepSeek-R1-Zero exhibe grandes capacidades de razonamiento y desarrolla de forma autónoma comportamientos de razonamiento inesperados y potentes, también se enfrenta a algunos problemas. Por ejemplo, DeepSeek-R1-Zero tiene problemas de legibilidad y de mezcla de lenguajes. Para hacer más legible el proceso de razonamiento y compartirlo con la comunidad abierta, exploramos DeepSeek-R1, un enfoque que utiliza RL con datos de arranque en frío adaptados a los humanos.

2.3 DeepSeek-R1: Aprendizaje por refuerzo en frío

Inspirados por los prometedores resultados de DeepSeek-R1-Zero, surgen dos preguntas naturales: 1) ¿Se puede mejorar aún más el rendimiento de la inferencia o acelerar la convergencia mediante la incorporación de una pequeña cantidad de datos de alta calidad como arranque en frío? y 2) ¿Cómo podemos entrenar un modelo fácil de usar que no sólo produzca cadenas de pensamiento (CoTs) claras y coherentes, sino que también demuestre una fuerte capacidad de generalización? Para responder a estas preguntas, hemos diseñado un proceso de entrenamiento de DeepSeek-R1. El proceso consta de cuatro fases, que se describen a continuación.

A diferencia de DeepSeek-R1-Zero, con el fin de evitar una fase temprana inestable de arranque en frío cuando se inicia el entrenamiento RL desde el modelo base, para DeepSeek-R1 construimos y recogimos una pequeña cantidad de datos CoT largos para afinar el modelo como participante inicial RL. Para recopilar estos datos, hemos explorado varios enfoques: el uso de pocas muestras con CoTs largos como ejemplos, directamente el modelo para generar respuestas detalladas con la reflexión y la validación, la recogida de DeepSeek-R1-Zero salidas en un formato legible, y el post-procesamiento de los resultados a través de los anotadores humanos.

En este trabajo, recopilamos miles de datos de arranque en frío para afinar DeepSeek-V3-Base como punto de partida para RL. Las ventajas de los datos de arranque en frío sobre DeepSeek-R1-Zero incluyen:

- Legibilidad: Una de las principales limitaciones de DeepSeek-R1-Zero es que su contenido no suele ser legible. Las respuestas pueden mezclar varios idiomas o carecer del formato de marcado utilizado para resaltar las respuestas del usuario. En cambio, al crear los datos de partida en frío para DeepSeek-R1, diseñamos un esquema legible que incluye un resumen al final de cada respuesta y filtra las respuestas que no son fácilmente legibles. Aquí, definimos el formato de salida como | ficha_especial | | ficha_especial | , donde el proceso de razonamiento es el CoT de la consulta y el resumen se utiliza para resumir los resultados del razonamiento.

- Potencial: Al utilizar un humano antes de elaborar un modelo para datos de arranque en frío, observamos un mejor rendimiento frente a DeepSeek-R1-Zero. Sostenemos que el entrenamiento iterativo es una mejor forma de razonar sobre los modelos.

Tras afinar DeepSeek-V3-Base con datos de partida en frío, aplicamos el mismo proceso de entrenamiento de aprendizaje por refuerzo a gran escala que el empleado en DeepSeek-R1-Zero. El objetivo de esta fase era mejorar las capacidades de inferencia del modelo, especialmente en tareas que requieren inferencia, como la codificación y el razonamiento matemático, científico y lógico con preguntas explícitas. Durante el proceso de entrenamiento, observamos que el CoT presentaba a menudo una mezcla de idiomas, especialmente cuando las pistas de RL implicaban varios idiomas. Para mitigar el problema de la mezcla de idiomas, introdujimos una recompensa de coherencia lingüística durante el entrenamiento de RL, que se calculaba como la proporción de palabras en el idioma de destino en el CoT. Aunque los experimentos de ablación muestran que esta alineación conlleva una ligera degradación del rendimiento del modelo, esta recompensa es coherente con las preferencias humanas, por lo que resulta más legible. Por último, combinamos las recompensas de precisión y coherencia lingüística en la tarea de razonamiento sumándolas directamente para formar la recompensa final. A continuación, aplicamos el aprendizaje por refuerzo (RL) al modelo ajustado hasta que converge en la tarea de inferencia.

Cuando la RL orientada a la inferencia converge, utilizamos los puntos de control generados para recopilar datos SFT (ajuste fino supervisado) para rondas posteriores. A diferencia de los datos iniciales de arranque en frío, que se centran principalmente en el razonamiento, esta fase incorpora datos de otros dominios para mejorar las capacidades del modelo en la escritura, el juego de roles y otras tareas de propósito general. En concreto, generamos datos y ajustamos el modelo como se describe a continuación.

Datos de inferencia Curamos las pistas de inferencia y generamos trayectorias de inferencia realizando un muestreo de rechazo a partir de los puntos de control entrenados con RL descritos anteriormente. En la fase anterior, sólo incluimos datos que podían evaluarse mediante recompensas basadas en reglas. Sin embargo, en esta fase, ampliamos el conjunto de datos mediante la combinación de más datos, algunos de los cuales utilizan modelos de recompensa generativos, mediante la alimentación de etiquetas reales y predicciones del modelo en DeepSeek-V3 para su evaluación. Además, dado que la salida del modelo es a veces confusa y difícil de leer, filtramos las cadenas de pensamiento con lenguaje mixto, párrafos largos y trozos de código. Para cada pista, se tomaron muestras de varias respuestas y sólo se retuvo la respuesta correcta. En total, recogimos unas 600.000 muestras de entrenamiento relacionadas con el razonamiento.

Datos no razonados Para los datos no razonados, como la escritura, el cuestionario de hechos, el autoconocimiento y la traducción, empleamos el proceso DeepSeek-V3 y reutilizamos partes del conjunto de datos SFT de DeepSeek-V3. Para determinadas tareas no relacionadas con el razonamiento, invocamos a DeepSeek-V3 para que genere posibles cadenas de pensamiento mediante preguntas antes de responder a una pregunta. Sin embargo, para consultas sencillas (por ejemplo, "hola"), no proporcionamos un CoT en la respuesta.Por último, recogemos un total de unas 200.000 muestras de entrenamiento que no están relacionadas con la inferencia.

Hemos perfeccionado DeepSeek-V3-Base durante dos periodos utilizando el conjunto de datos de unas 800.000 muestras.

Para alinear aún más el modelo con las preferencias humanas, aplicamos una segunda fase de aprendizaje por refuerzo destinada a aumentar la utilidad e inocuidad del modelo al tiempo que mejoramos continuamente su inferencia. En concreto, entrenamos el modelo utilizando una combinación de señales de recompensa y diversas distribuciones de pistas. Para los datos de inferencia, nos ceñimos al enfoque descrito en DeepSeek-R1-Zero, que utiliza recompensas basadas en reglas para guiar el proceso de aprendizaje en los dominios del razonamiento matemático, de codificación y lógico. Para los datos generales, nos basamos en modelos de recompensa para captar las preferencias humanas en escenarios complejos y detallados. Nos basamos en el proceso de DeepSeek-V3 y utilizamos pares de preferencias y distribuciones de pistas de entrenamiento similares. Para ser útiles, nos centramos exclusivamente en el resumen final, asegurándonos de que la evaluación enfatiza la utilidad y relevancia de la respuesta para el usuario, a la vez que minimiza la interferencia con el proceso de razonamiento subyacente. Para proporcionar inocuidad, evaluamos toda la respuesta del modelo, incluido el proceso de razonamiento y el resumen, para identificar y mitigar cualquier riesgo potencial, sesgo o contenido perjudicial que pueda haber surgido durante el proceso de generación. En última instancia, la integración de señales de recompensa y diversas distribuciones de datos nos permite entrenar un modelo que sobresale en el razonamiento y prioriza tanto la utilidad como la inocuidad.

2.4 Destilación: aumentar la capacidad de razonamiento de los modelos pequeños

Para hacer más eficientes los modelos pequeños con capacidades de inferencia como DeepSeek-R1, afinamos directamente modelos de código abierto como Qwen (Qwen, 2024b) y Llama (AI@Meta, 2024) utilizando las 800.000 muestras cotejadas por DeepSeek-R1 (como se detalla en §2.3.3). Nuestros resultados sugieren que este sencillo método de destilación puede mejorar significativamente la inferencia de modelos pequeños. Los modelos de base que utilizamos son Qwen2.5-Math-1.5B, Qwen2.5-Math-7B, Qwen2.5-14B, Qwen2.5-32B, Llama-3.1-8B y Llama-3.3-70B-Instruct. Llama-3.1.

Para el modelo de destilación, aplicamos únicamente la SFT y no incluimos la etapa de RL, aunque la fusión de RL puede mejorar significativamente el rendimiento del modelo. Nuestro principal objetivo aquí es demostrar la eficacia de la técnica de destilación, dejando la exploración de la etapa RL a la comunidad investigadora en general.

3. Experimentos

evaluación comparativa Hemos publicado los resultados en MMLU (Hendrycks et al., 2020), MMLU-Redux (Gema et al., 2024), MMLU-Pro (Wang et al., 2024), C-Eval (Huang et al., 2023) y CMMLU (Li et al., 2023), IFEval (Zhou et al., 2023), FRAMES (Krishna et al., 2024), GPQA Diamond (OpenAI Diamond) (Rein et al., 2023), y IFEval (Zhou et al., 2023), FRAMES (Krishna et al., 2024), GPQA Diamond (Rein et al., 2023), SimpleQA (OpenAI, 2024c), C-SimpleQA (He et al., 2024), SWE- Bench Verified (OpenAI, 2024d), Aider¹ , LiveCodeBench (Jain et al., 2024) (2024-08 - 2025-01), Codeforces², Chinese National High School Mathematics Olympiad (CNHSMOA) School Mathematics Olympiad (CNMO 2024)³, y American Invitational Mathematics Examination 2024 (AIME 2024) (MAA, 2024). Además de las pruebas de referencia estándar, utilizamos LLM como jurado para evaluar el rendimiento de nuestros modelos en tareas generativas abiertas. En concreto, seguimos las configuraciones originales de AlpacaEval 2.0 (Dubois et al., 2024) y Arena-Hard (Li et al., 2024), que utilizan GPT-4-Turbo-1106 como jurado para las comparaciones por pares. Aquí, sólo proporcionamos los resúmenes finales para la evaluación con el fin de evitar el sesgo de longitud. Para los modelos de destilación, informamos de resultados representativos en AIME 2024, MATH-500, GPQA Diamond, Codeforces y LiveCodeBench.

Consejos de evaluación Siguiendo la configuración de DeepSeek-V3, los puntos de referencia estándar como MMLU, DROP, GPQA Diamond y SimpleQA se evalúan utilizando indicaciones del marco simple-evals. Para MMLU-Redux, utilizamos el formato Zero-Eval (Lin, 2024) en la configuración de muestra cero. En el caso de MMLU-Pro, C-Eval y CLUE-WSC, dado que los mensajes originales estaban submuestreados, los modificamos ligeramente para adaptarlos a la configuración de muestra cero. CoT en pocas muestras puede perjudicar el rendimiento de DeepSeek-R1. Los demás conjuntos de datos siguen el protocolo de evaluación original con las pistas por defecto proporcionadas por sus creadores. Para la evaluación comparativa de código y matemáticas, el conjunto de datos HumanEval-Mul cubre ocho lenguajes de programación principales (Python, Java, C++, C#, JavaScript, TypeScript, PHP y Bash). El rendimiento del modelo en LiveCodeBench se evalúa utilizando el formato CoT, con datos recogidos entre agosto de 2024 y enero de 2025. El conjunto de datos de Codeforces se evaluó utilizando preguntas de 10 competiciones Div.2, así como casos de prueba producidos por expertos, y después se calcularon las puntuaciones esperadas y los porcentajes de los competidores. Los resultados de la validación SWE-Bench se obtuvieron mediante un marco sin agentes (Xia et al., 2024). Los benchmarks relacionados con AIDER se midieron utilizando el formato "diff", y la salida de DeepSeek-R1 se limitó a 32.768 tokens por benchmark.

línea de base (en levantamiento geodésico) Llevamos a cabo evaluaciones exhaustivas frente a varias líneas de base potentes, como DeepSeek-V3, Claude-Sonnet-3.5-1022, GPT-40-0513, OpenAI-01-mini y OpenAI-01-1217. debido al difícil acceso a la API de OpenAI-01-1217 en China continental informamos de su rendimiento basándonos en informes oficiales. Para el modelo de destilación, también comparamos el modelo de código abierto QwQ-32B-Preview (Qwen, 2024a).

Generar ajustes Para todos nuestros modelos, la longitud máxima de generación se fija en 32.768 tokens. Para los puntos de referencia que requieren muestreo, utilizamos una temperatura de 0,6, un valor top-p de 0,95 y generamos 64 respuestas para cada consulta para estimar pass@1.

3.1 Evaluación de DeepSeek-R1

Para los benchmarks de conocimiento orientados a la educación, como MMLU, MMLU-Pro y GPQA Diamond, DeepSeek-R1 demuestra un rendimiento superior al de DeepSeek-V3. Esta mejora se atribuye principalmente a una mayor precisión en los problemas relacionados con STEM, donde se logran ganancias significativas a través del aprendizaje por refuerzo (RL) a gran escala. Además, DeepSeek-R1 obtiene buenos resultados en FRAMES, una larga tarea de control de calidad dependiente del contexto, lo que demuestra su gran capacidad de análisis de documentos. Esto pone de relieve el potencial de los modelos de inferencia en tareas de búsqueda y análisis de datos basadas en IA. En la prueba SimpleQA, DeepSeek-R1 supera a DeepSeek-V3, lo que demuestra su capacidad para gestionar consultas basadas en hechos. Una tendencia similar se observó cuando OpenAI-01 superó a GPT-40 en esta prueba. Sin embargo, DeepSeek-R1 no rinde tan bien como DeepSeek-V3 en la prueba china SimpleQA, principalmente debido a su tendencia a negarse a responder ciertas consultas después de una RL segura. En ausencia de una RL segura, DeepSeek-R1 puede alcanzar una precisión superior a 70%.

Tabla 4 | Comparación entre DeepSeek-R1 y otros modelos representativos.

DeepSeek-R1 también obtuvo unos resultados impresionantes en la IF-Eval, una prueba de referencia diseñada para evaluar la capacidad de un modelo para seguir instrucciones de formato. Estas mejoras pueden estar relacionadas con los datos de adherencia a las instrucciones incluidos en las etapas finales del ajuste fino supervisado (SFT) y el entrenamiento RL. Además, se observó un rendimiento superior en AlpacaEval2.0 y ArenaHard, lo que demuestra que DeepSeek-R1 tiene ventaja en tareas de escritura y respuesta a preguntas de dominio abierto. Su rendimiento significativamente superior al de DeepSeek-V3 pone de manifiesto las ventajas de generalización de la RL a gran escala, que no sólo mejora la inferencia sino también el rendimiento en múltiples dominios. Además, DeepSeek-R1 genera longitudes de resumen concisas, y la media en ArenaHard ficha de 689 y una media de 2.218 caracteres en AlpacaEval 2.0. Esto demuestra que DeepSeek-R1 evita introducir sesgos de longitud durante la evaluación basada en GPT, lo que consolida aún más su solidez en múltiples tareas.

En las tareas matemáticas, el rendimiento de DeepSeek-R1 es comparable al de OpenAI-01-1217, superando significativamente a los demás modelos. Una tendencia similar se observa en tareas de algoritmos de codificación como LiveCodeBench y Codeforces, en las que los modelos centrados en la inferencia dominan estas pruebas. En las tareas de codificación orientadas a la ingeniería, OpenAI-01-1217 supera a DeepSeek-R1 en Aider, pero alcanza un rendimiento comparable en SWE Verified. Creemos que el rendimiento de DeepSeek-R1 para tareas de ingeniería mejorará en la próxima versión, ya que la cantidad de datos de entrenamiento de RL relevantes sigue siendo muy limitada en este momento.

3.2 Evaluación de la modelización de la destilación

Tabla 5 | Comparación del modelo de destilación DeepSeek-R1 con otros modelos comparables en la prueba de referencia de correlación de inferencia.

Como se muestra en la Tabla 5, la simple destilación de la salida de DeepSeek-R1 permite que el eficiente DeepSeek-R1-7B (es decir, DeepSeek-R1-Distill-Qwen-7B, a partir de ahora denominado así) supere a los modelos sin inferencia como GPT-40-0513 en todos los aspectos. DeepSeek-R1-14B supera a QwQ-32B-Preview en todas las métricas de evaluación, mientras que DeepSeek-R1-32B y DeepSeek-R1-70B superan significativamente a o1-mini en la mayoría de las pruebas de referencia. Estos resultados demuestran el gran potencial de distill. Además, descubrimos que la aplicación de RL a estos modelos de destilación da lugar a ganancias adicionales significativas. Creemos que merece la pena seguir estudiando esta cuestión, por lo que aquí sólo presentamos los resultados del modelo de destilación SFT simple.

4. Debate

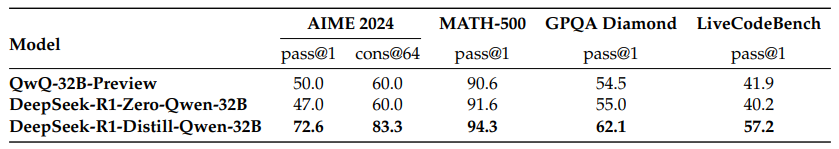

4.1 Destilación frente a aprendizaje intensivo

Tabla 6 | Comparación entre el modelo de destilación y el modelo RL en el benchmark de correlación de inferencia.

En la sección 3.2, podemos ver que destilando DeepSeek-R1, los modelos pequeños pueden lograr resultados impresionantes. Sin embargo, queda una duda: ¿se pueden entrenar modelos con la RL a gran escala analizada en este artículo (sin destilación) para lograr un rendimiento comparable?

Para responder a esta pregunta, realizamos un entrenamiento RL a gran escala de Qwen-32B-Base utilizando matemáticas, código y datos STEM durante más de 10.000 pasos, dando como resultado DeepSeek-R1-Zero-Qwen-32B. Los resultados experimentales (mostrados en la Fig. 6) muestran que el modelo base de 32B, tras un entrenamiento RL a gran escala, alcanza un rendimiento comparable al de QwQ-32B-Preview a un nivel comparable. Sin embargo, DeepSeek-R1-Distill-Qwen-32B, que se destila de DeepSeek-R1, supera significativamente a DeepSeek-R1-Zero-Qwen-32B en todos los puntos de referencia. Por lo tanto, podemos sacar dos conclusiones: en primer lugar, destilar el modelo más potente en un modelo más pequeño produce excelentes resultados mientras que los modelos más pequeños que se basan en las RL a gran escala mencionadas en este artículo requieren una enorme potencia computacional y puede que ni siquiera alcancen el rendimiento de la destilación. En segundo lugar, aunque la estrategia de destilación es rentable y eficiente, puede que sigan siendo necesarios modelos subyacentes más potentes y un aprendizaje por refuerzo a mayor escala para superar los límites de la inteligencia.

4.2 Intentos fallidos

Durante las primeras fases de desarrollo de DeepSeek-R1, también nos encontramos con algunos fracasos y contratiempos. Compartimos aquí nuestros fracasos para aportar ideas, pero esto no significa que estos métodos sean incapaces de desarrollar modelos de inferencia eficaces.

Process Reward Modelling (PRM) La PRM es una forma sensata de guiar a los modelos para que adopten mejores métodos para resolver tareas de razonamiento (Lightman et al., 2023; Uesato et al., 2022; Wang et al., 2023). En la práctica, sin embargo, existen tres limitaciones principales de la PRM que pueden obstaculizar su éxito final. En primer lugar, es difícil definir explícitamente pasos precisos en el razonamiento general. En segundo lugar, determinar si el paso intermedio actual es correcto es una tarea difícil. La anotación automática mediante modelos puede no producir resultados satisfactorios, mientras que la anotación manual no favorece el escalado. En tercer lugar, una vez introducida la PRM basada en modelos, conducirá inevitablemente a la piratería de recompensas (Gao et al., 2022), y el reentrenamiento del modelo de recompensas requiere recursos de entrenamiento adicionales, lo que puede complicar el proceso general de entrenamiento. En resumen, aunque la PRM demuestra una buena capacidad para reordenar las respuestas top-N generadas por el modelo o ayudar en la búsqueda guiada (Snell et al., 2024), sus ventajas son limitadas en comparación con la sobrecarga computacional adicional introducida durante el aprendizaje por refuerzo a gran escala en nuestros experimentos.

Búsqueda en árbol de Montecarlo (MCTS) Inspirándonos en AlphaGo (Silver et al., 2017b) y AlphaZero (Silver et al., 2017a), exploramos el uso de la búsqueda en árbol de Montecarlo (MCTS) para mejorar la escalabilidad del cálculo en tiempo de prueba. Este enfoque consiste en descomponer la respuesta en partes más pequeñas para permitir que el modelo explore sistemáticamente el espacio de soluciones. Para ello, pedimos al modelo que genere varias etiquetas que correspondan a los pasos de inferencia específicos necesarios para la búsqueda. Para el entrenamiento, primero utilizamos las pistas recopiladas para encontrar respuestas mediante un MCTS guiado por un modelo de valores preentrenado. Posteriormente, utilizamos los pares pregunta-respuesta generados para entrenar el modelo de actores y el modelo de valores, mejorando así el proceso de forma iterativa.

Sin embargo, este enfoque se enfrenta a varios retos a la hora de ampliar el entrenamiento. En primer lugar, a diferencia del ajedrez, donde el espacio de búsqueda está relativamente bien definido, la generación de fichas presenta un espacio de búsqueda exponencialmente mayor. Para resolver este problema, fijamos un límite máximo de expansión para cada nodo, pero esto puede hacer que el modelo caiga en un óptimo local. En segundo lugar, el modelo de valores afecta directamente a la calidad de la generación, ya que guía cada paso del proceso de búsqueda. Entrenar un modelo de valores de grano fino es intrínsecamente difícil, lo que dificulta la mejora iterativa del modelo. Aunque el éxito principal de AlphaGo se basa en el entrenamiento de modelos de valor para mejorar progresivamente su rendimiento, el principio es difícil de replicar en nuestro entorno debido a la complejidad de la generación de marcadores.

En conclusión, si bien el MCTS puede mejorar el rendimiento durante la inferencia cuando se combina con modelos de valores preentrenados, la mejora iterativa del rendimiento del modelo durante la autobúsqueda sigue siendo un reto difícil.

5. Conclusiones, limitaciones y trabajos futuros

DeepSeek-R1-Zero representa un enfoque de RL puro que no depende de datos de arranque en frío y logra un gran rendimiento en una variedad de tareas. DeepSeek-R1 es aún más potente, ya que utiliza datos de arranque en frío y un ajuste iterativo de RL. En última instancia, DeepSeek-R1 consigue un rendimiento comparable al de OpenAI-01-1217 en diversas tareas.

También exploramos la posibilidad de destilar la capacidad de razonamiento en pequeños modelos densos. Utilizamos DeepSeek-R1 como modelo maestro para generar 800.000 datos y ajustamos varios modelos densos pequeños. Los resultados son prometedores: DeepSeek-R1-Distill-Qwen-1.5B supera a GPT-40 y Claude-3.5-Sonnet en la prueba comparativa de matemáticas, con una puntuación AIME de 28,91 TP3T y una puntuación MATH de 83,91 TP3T. otros modelos de ajuste fino de instrucciones basados en los mismos puntos de control subyacentes.

En el futuro, tenemos previsto investigar DeepSeek-R1 en las siguientes áreas:

- Capacidades genéricas: Actualmente, DeepSeek-R1 es menos capaz que DeepSeek-V3 en tareas como llamadas a funciones, diálogos de varias rondas, juegos de rol complejos y salidas json.

- Mezcla de idiomas: DeepSeek-R1 está optimizado actualmente para chino e inglés, lo que puede provocar problemas de mezcla de idiomas al procesar consultas en otros idiomas. Por ejemplo, DeepSeek-R1 puede razonar y responder en inglés aunque la consulta esté en un idioma distinto del inglés o el chino. Nos proponemos solucionar esta limitación en una futura actualización.

- Ingeniería de pistas: Al evaluar DeepSeek-R1, descubrimos que es sensible a las pistas. Las pistas con un muestreo menor degradan sistemáticamente su rendimiento. Por lo tanto, recomendamos que los usuarios describan el problema directamente y especifiquen el formato de salida utilizando la configuración de muestra cero para obtener los mejores resultados.

- Tareas de ingeniería de software: La RL a gran escala no se ha aplicado ampliamente a tareas de ingeniería de software debido al largo tiempo de evaluación, que afecta a la eficiencia del proceso de RL. Como resultado, DeepSeek-R1 aún no ha mostrado una gran mejora en el rendimiento en los puntos de referencia de ingeniería de software sobre DeepSeek-V3. Las próximas versiones abordarán este problema implementando el muestreo de rechazo en los datos de ingeniería de software o fusionando las evaluaciones asíncronas en el proceso de RL para mejorar la eficiencia.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...