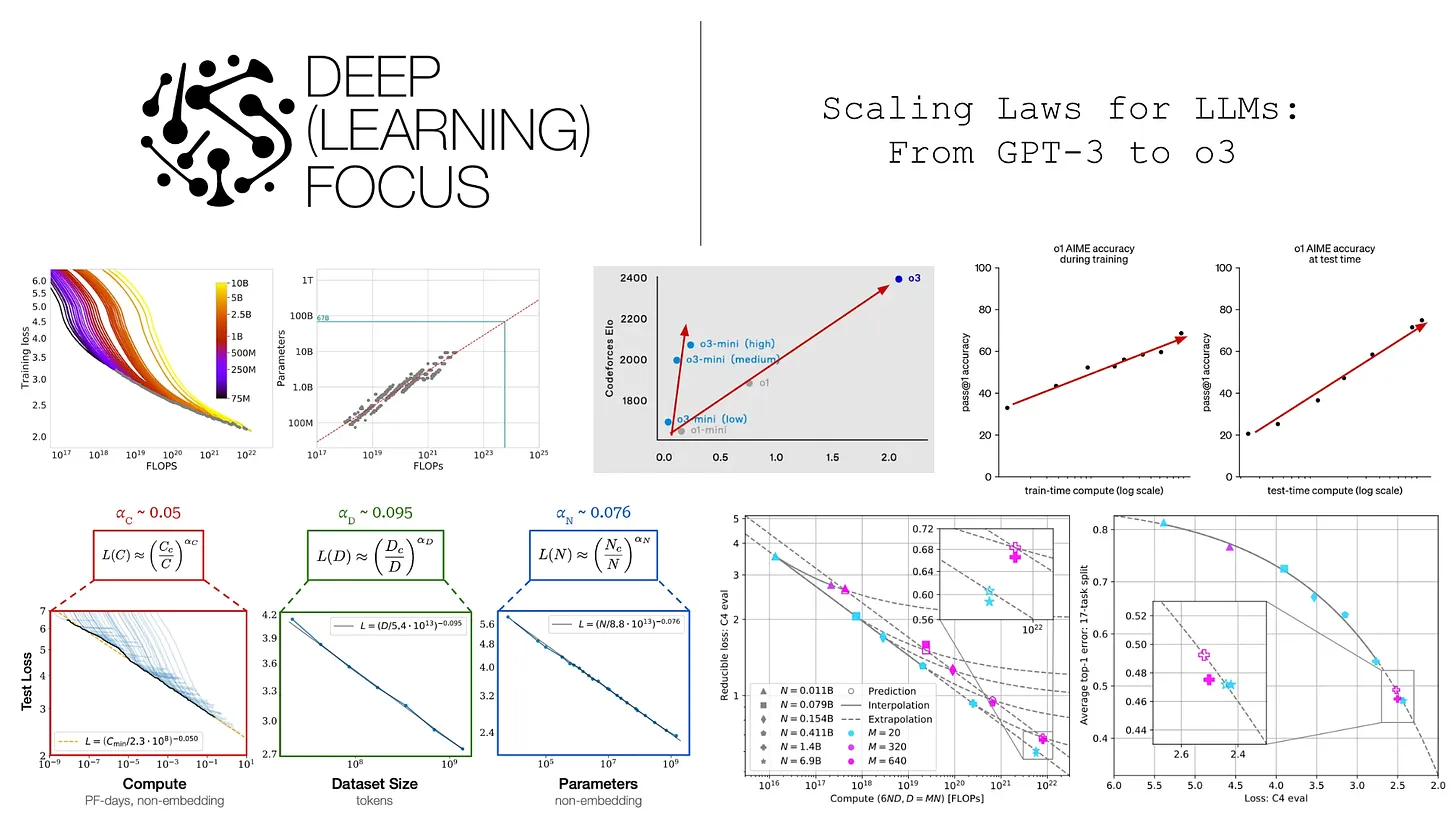

El momento Chinchilla y el momento o3: la evolución de la ley de escala de los grandes modelos lingüísticos

Base de conocimientos de IAActualizado hace 1 año Círculo de intercambio de inteligencia artificial 61.1K 00

Lectura rápida del artículo

Este artículo ofrece una visión exhaustiva y en profundidad del pasado y el presente de la Ley de Escalado de Grandes Modelos Lingüísticos (LLM) y la futura dirección de la investigación en IA. Con una lógica clara y abundantes ejemplos, el autor Cameron R. Wolfe lleva a los lectores desde los conceptos básicos hasta la investigación de vanguardia, presentando un amplio panorama del campo de la IA. A continuación se resumen y comentan el contenido básico del artículo y los puntos de vista del autor:

1. Orígenes y evolución de la ley de la escala: de la GPT a Chinchilla

- Los autores empiezan afirmando que la ley de escala es el motor central del desarrollo de grandes modelos lingüísticos. Introduciendo el concepto básico de la Ley de Potencia, los autores explican cómo la pérdida en las pruebas de un modelo lingüístico de gran tamaño disminuye a medida que aumentan los parámetros del modelo, el tamaño del conjunto de datos y la cantidad de cálculo.

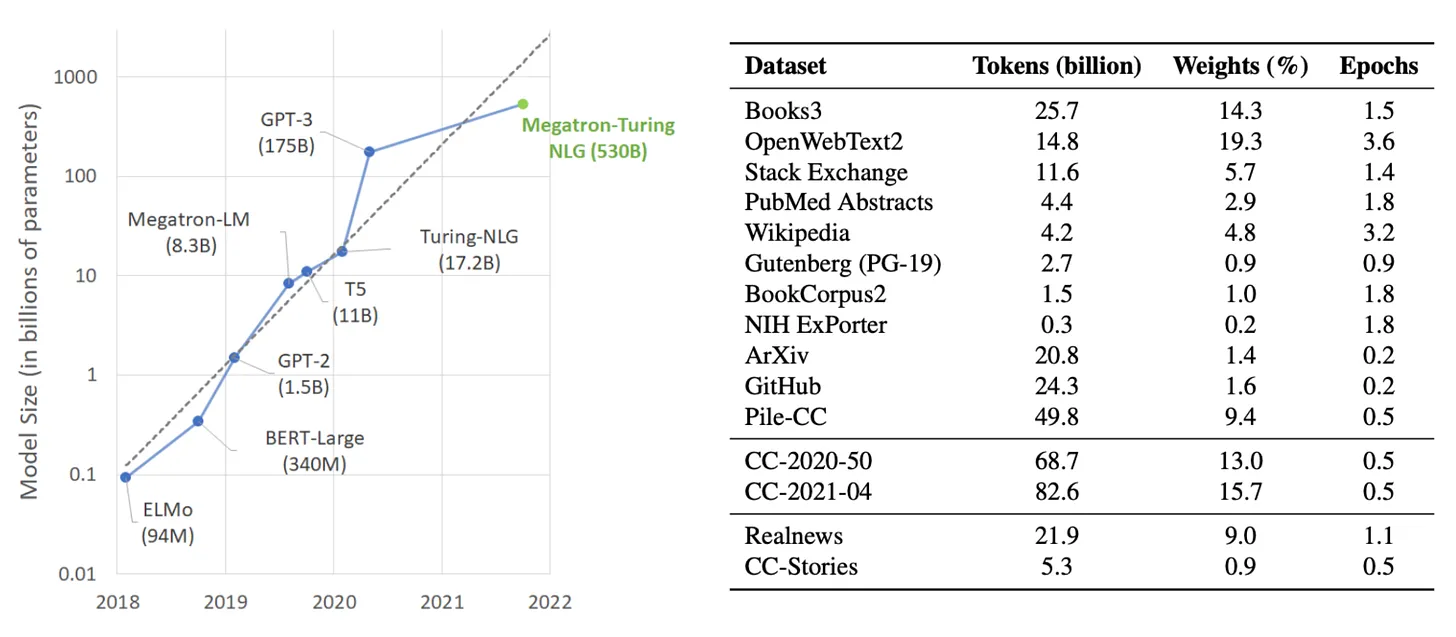

- Los autores examinan la evolución de la familia de modelos GPT y demuestran vívidamente la aplicación de las leyes de escala en la práctica. Desde los primeros GPT y GPT-2, pasando por el emblemático GPT-3, hasta el misterioso GPT-4, OpenAI siempre se ha ceñido a la estrategia de "hacer milagros a partir de grandes esfuerzos", y ha refrescado constantemente el límite superior de las capacidades de los grandes modelos lingüísticos. El artículo describe en detalle las innovaciones clave, las configuraciones experimentales y el rendimiento de cada modelo, y señala que la aparición del GPT-3 marca la transición de un modelo especializado a un modelo base de propósito general del gran modelo lingüístico, y abre una nueva era en la investigación de la IA.

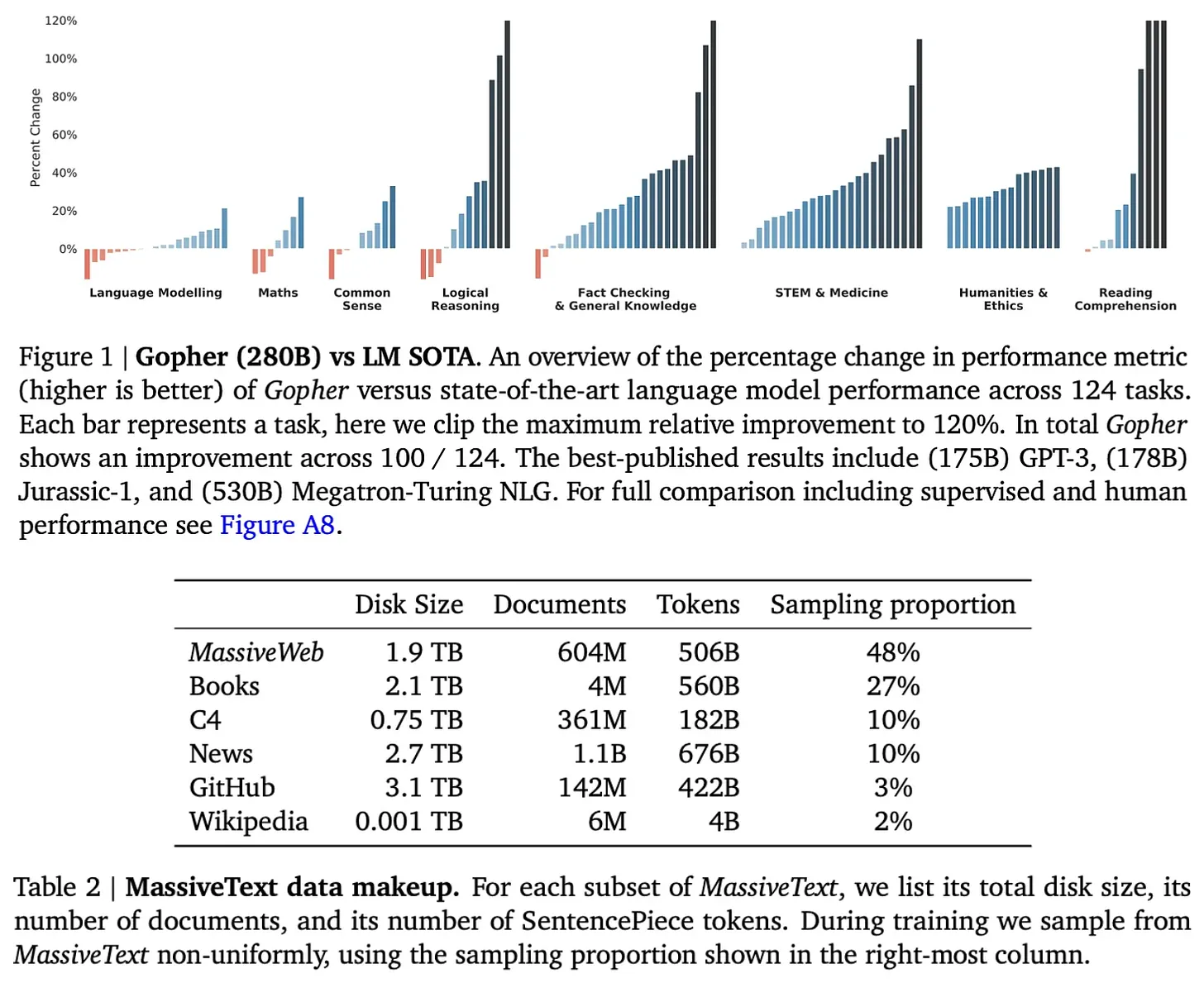

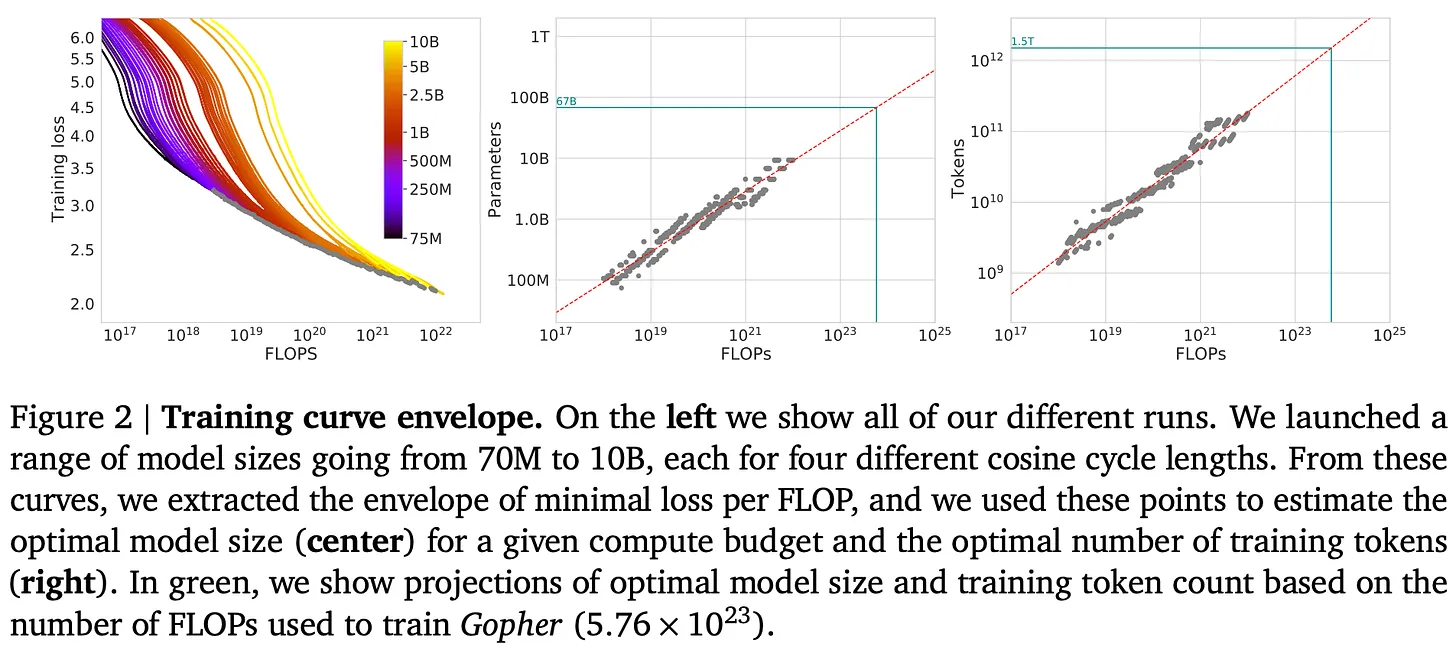

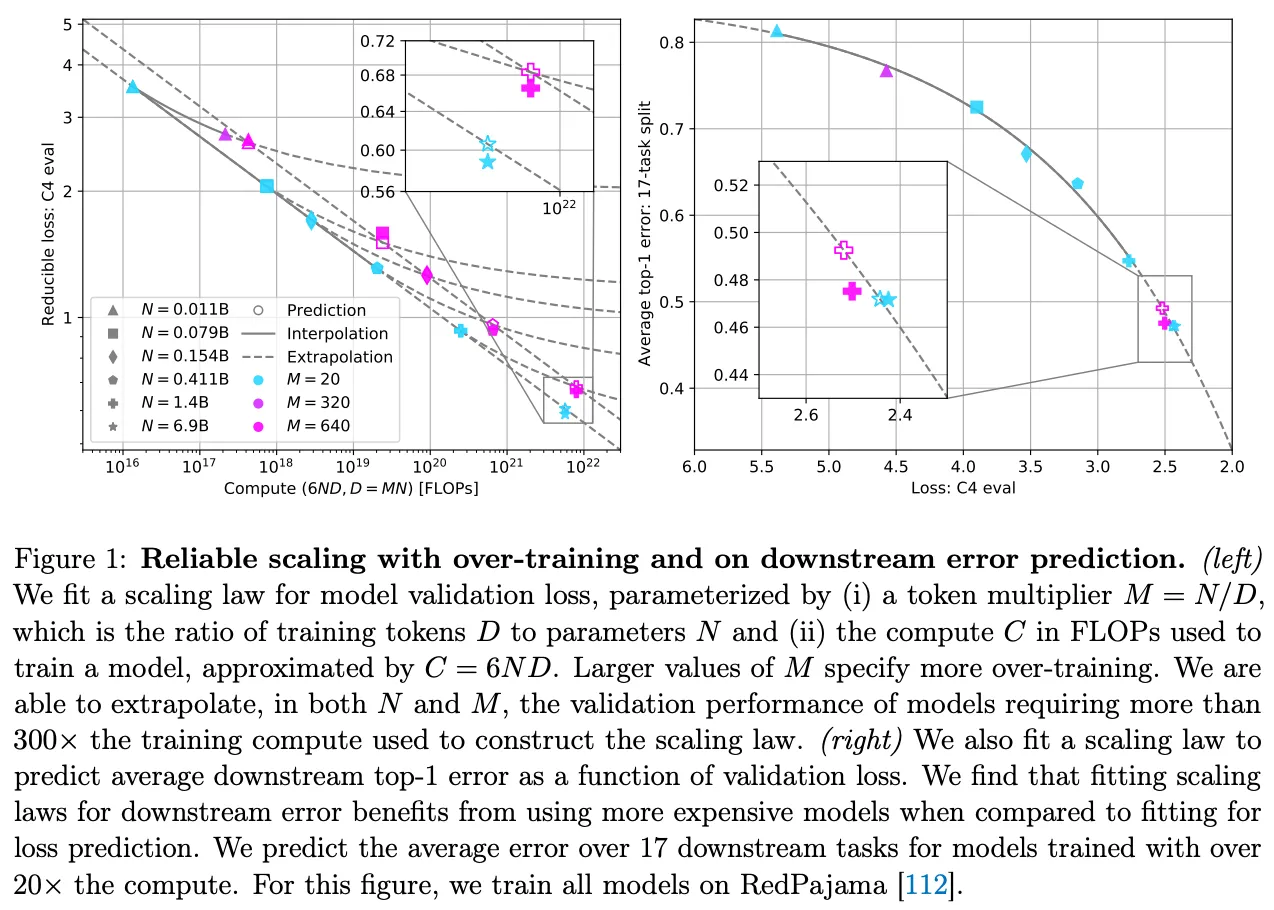

- Los autores no defienden ciegamente que "cuanto más grande, mejor", sino que analizan racionalmente la ley del tamaño "computacionalmente óptimo" propuesta por el modelo Chinchilla. La investigación de DeepMind ha demostrado que los modelos anteriores estaban generalmente "infraentrenados", es decir, el tamaño del conjunto de datos era demasiado pequeño en relación con el tamaño del modelo, y el éxito del modelo de Chinchilla ha demostrado que aumentar el tamaño del conjunto de datos de forma adecuada puede ser más eficaz que aumentar el tamaño del modelo para el mismo presupuesto computacional. Este hallazgo ha tenido un profundo impacto en el entrenamiento de grandes modelos lingüísticos posteriores.

Comentario: Los autores ofrecen una introducción en profundidad a la Ley de la Escala, con explicaciones teóricas y ejemplos de apoyo, para que incluso los lectores no especializados puedan comprender sus ideas centrales. Al repasar la evolución de la serie de modelos GPT, los autores vinculan la abstracta ley de la escala con el desarrollo concreto de modelos, lo que aumenta la legibilidad y persuasión del artículo. El análisis del modelo Chinchilla demuestra el espíritu discursivo del autor, que no aboga ciegamente por la escala, sino que guía a los lectores para que piensen en cómo hacer un uso más eficiente de los recursos informáticos.

2. La "desaparición" de la ley del tamaño: preguntas y reflexiones

- La segunda parte del artículo se centra en el reciente cuestionamiento de la ley de escala en la IA. Los autores citan varios informes de los medios de comunicación que sugieren que la industria está empezando a preguntarse si la ley de la escala ha tocado techo al ralentizarse el ritmo de mejora de los modelos. Al mismo tiempo, los autores citan a expertos del sector, como Dario Amodei y Sam Altman, que sostienen lo contrario, sugiriendo que la escala sigue siendo una fuerza importante que impulsa el progreso de la IA.

- Los autores señalan que la "ralentización" de la ley de escala era algo esperado. La propia ley de escala predice que, a medida que aumenta la escala, la dificultad de mejorar el rendimiento aumenta exponencialmente. Además, los autores subrayan la importancia de definir "rendimiento". Una disminución de las pérdidas en las pruebas no equivale necesariamente a un aumento de las capacidades del modelo Big Language, y las expectativas del sector respecto al modelo Big Language varían mucho.

- Los "cuellos de botella de datos" son uno de los temas en los que se centran los autores. El modelo Chinchilla y los estudios posteriores han puesto de relieve la importancia del tamaño de los datos, pero la limitada disponibilidad de datos de alta calidad en Internet puede actuar como un cuello de botella para el futuro desarrollo de los modelos biglanguage.

Comentario: Esta sección demuestra el pensamiento crítico del autor y su aguda visión del sector. En lugar de eludir la polémica, los autores presentan objetivamente los puntos de vista de diversas partes y analizan las posibles razones de la "ralentización de la escala" desde un punto de vista técnico. El énfasis que pone el autor en los "cuellos de botella de los datos" es especialmente importante, no sólo como verdadero reto para el desarrollo de grandes modelos lingüísticos, sino también como orientación para futuras investigaciones.

3. El futuro de la investigación en IA: más allá del preentrenamiento

- La parte final del artículo examina las direcciones futuras de la investigación en IA, centrándose en los grandes modelos de lenguaje sistema/agente y los modelos de inferencia.

- Los autores sostienen que, incluso si el crecimiento del tamaño de los modelos preentrenados llega a un cuello de botella, aún podemos mejorar las capacidades de la IA construyendo sistemas complejos de grandes modelos lingüísticos. El artículo describe las dos estrategias principales de descomposición y vinculación de tareas, y utiliza los resúmenes de libros como ejemplo de cómo las tareas complejas pueden descomponerse en subtareas que los grandes modelos lingüísticos manejan de forma excelente.

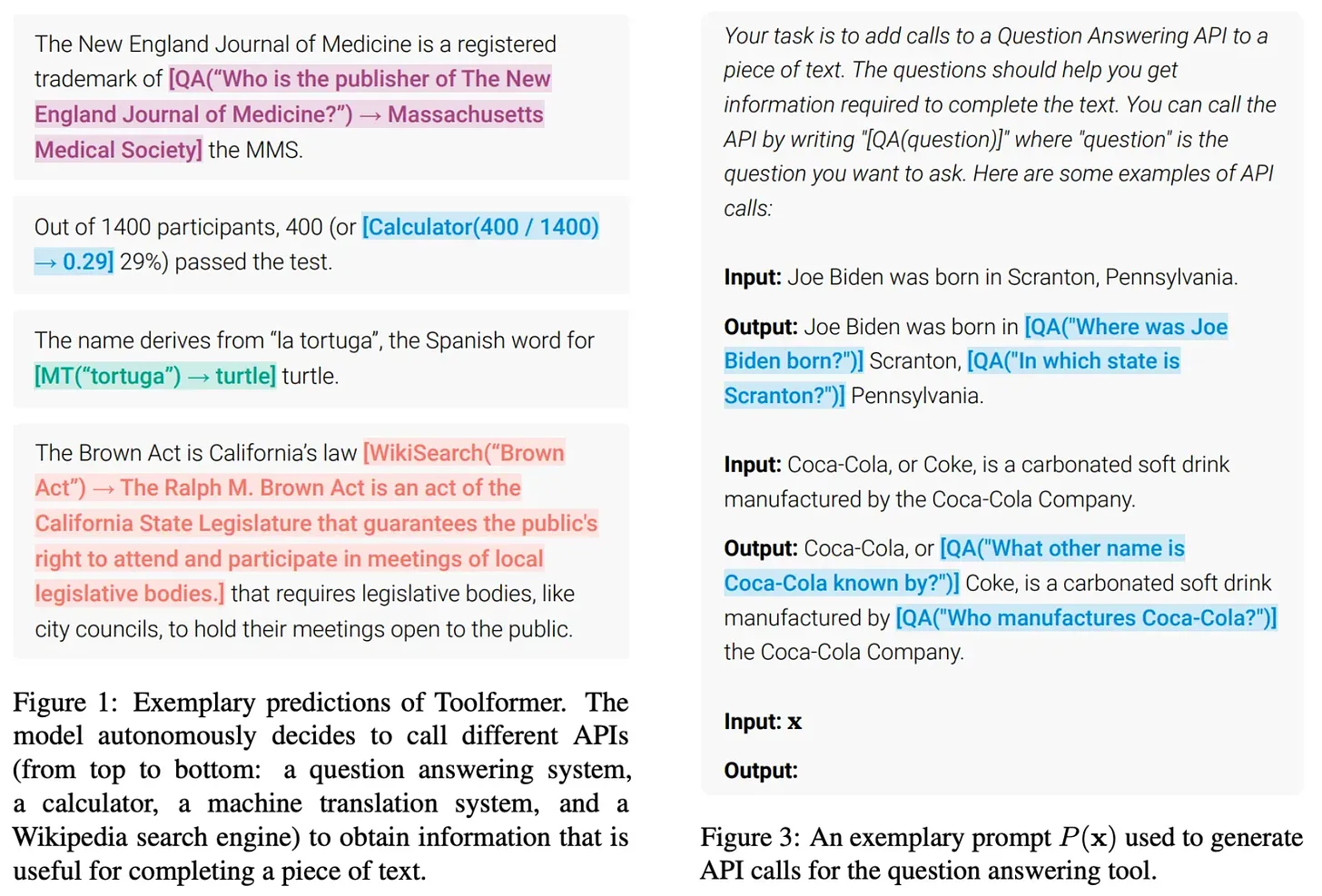

- Los autores también analizan la posibilidad de aplicar Big Language Models en el desarrollo de productos, señalando que la creación de productos Big Language Model realmente útiles es una dirección importante para la investigación actual en IA. En concreto, el artículo destaca el concepto de agente, que amplía los escenarios de aplicación de los grandes modelos lingüísticos al darles la capacidad de utilizar herramientas. Sin embargo, los autores también señalan los problemas de robustez que plantea la construcción de grandes sistemas complejos de modelización lingüística, y presentan orientaciones de investigación para mejorar la fiabilidad del sistema mediante algoritmos de metageneración mejorados.

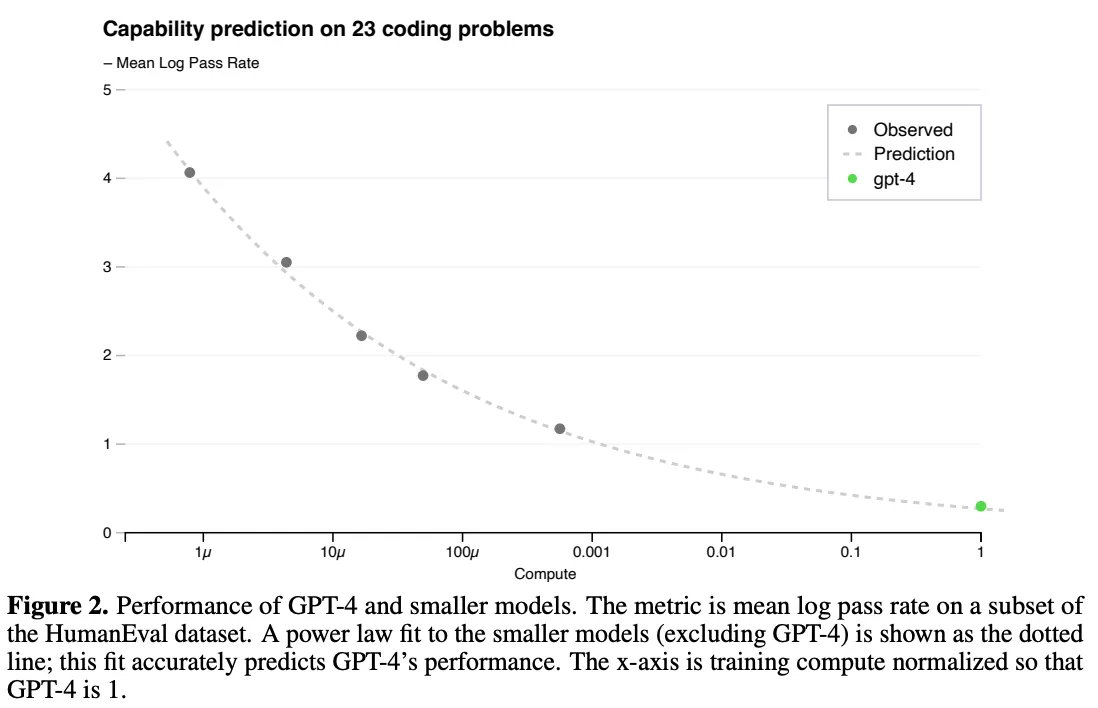

- En cuanto a los modelos de inferencia, los autores presentan los modelos o1 y o3 de OpenAI, que han logrado resultados impresionantes en tareas de inferencia complejas. o3, en particular, superó los niveles humanos en varias pruebas de referencia difíciles e incluso superó las predicciones de Terence Tao en algunos problemas. Los autores señalan que el éxito de los modelos o1 y o3 demuestra que, además de escalar el preentrenamiento, la inferencia de los modelos también puede mejorarse significativamente aumentando la entrada computacional en el momento de la inferencia, lo que constituye un nuevo paradigma de escalado.

Comentario: Esta sección está muy orientada al futuro, y la introducción de los autores a los sistemas/agentes de Big Language Modelling y a los modelos de inferencia abre nuevos horizontes a los lectores. El énfasis de los autores en la construcción de productos Big Language Model es de gran importancia práctica, no sólo para la investigación académica, sino también para la aplicación de la tecnología de IA sobre el terreno. La introducción de los modelos o1 y o3 es alentadora, ya que muestran el gran potencial de la IA para tareas de razonamiento complejas e indican nuevas direcciones para la futura investigación en IA.

Resumir y reflexionar:

El artículo de Cameron R. Wolfe es un excelente trabajo que combina amplitud y profundidad, no sólo proporcionando una visión sistemática del desarrollo de la ley de escala para grandes modelos lingüísticos, sino también ofreciendo una perspectiva perspicaz sobre el futuro de la investigación en IA. El punto de vista del autor es objetivo y racional, afirmando el importante papel de la ley de escala, pero señalando también sus limitaciones y retos. La lógica del artículo es clara y está bien argumentada, de modo que incluso los lectores que no estén familiarizados con el campo de la IA pueden beneficiarse de él.

Hechos destacados:

- Una explicación en profundidad: El autor tiene un don para explicar conceptos complejos en un lenguaje fácil de entender, como la introducción de leyes de potencia, leyes de escala y descomposición de tareas.

- Apoyado por ricos ejemplos: El artículo enumera un gran número de modelos y resultados experimentales, como la serie GPT, Chinchilla, Gopher, o1, o3, etc., para hacer tangibles y relacionables las teorías abstractas.

- Revisión exhaustiva de la bibliografía: El artículo cita un gran número de referencias que abarcan artículos clásicos y resultados de investigaciones recientes en el campo de la modelización de grandes lenguas, lo que proporciona a los lectores recursos para un estudio en profundidad.

- Pensamiento abierto: Los autores no dan una respuesta definitiva sobre el futuro de la ley de la escala, sino que conducen al lector a un pensamiento independiente, como el de "¿Qué escalamos a continuación?". Esta pregunta inspirará a más investigadores a explorar las fronteras de la IA.

Éste es un artículo que merece ser leído con atención por todos los que siguen el desarrollo de la IA. No sólo resume el pasado, sino que también ilumina el futuro. El valor del artículo reside no sólo en su contenido en sí, sino también en su espíritu de estimular el pensamiento y liderar la innovación. Creo que en la futura investigación sobre IA veremos más avances como el de o3, y las ideas a escala seguirán impulsando el progreso de la tecnología de IA en nuevas formas.

Título:Leyes de escala para grandes modelos lingüísticos: de GPT-3 a o3.

Texto original:https://cameronrwolfe.substack.com/p/llm-scaling-laws

Conozca el estado actual de la modelización a gran escala del lenguaje y el futuro de la investigación en IA...

(Fuentes [1, 7, 10, 21])

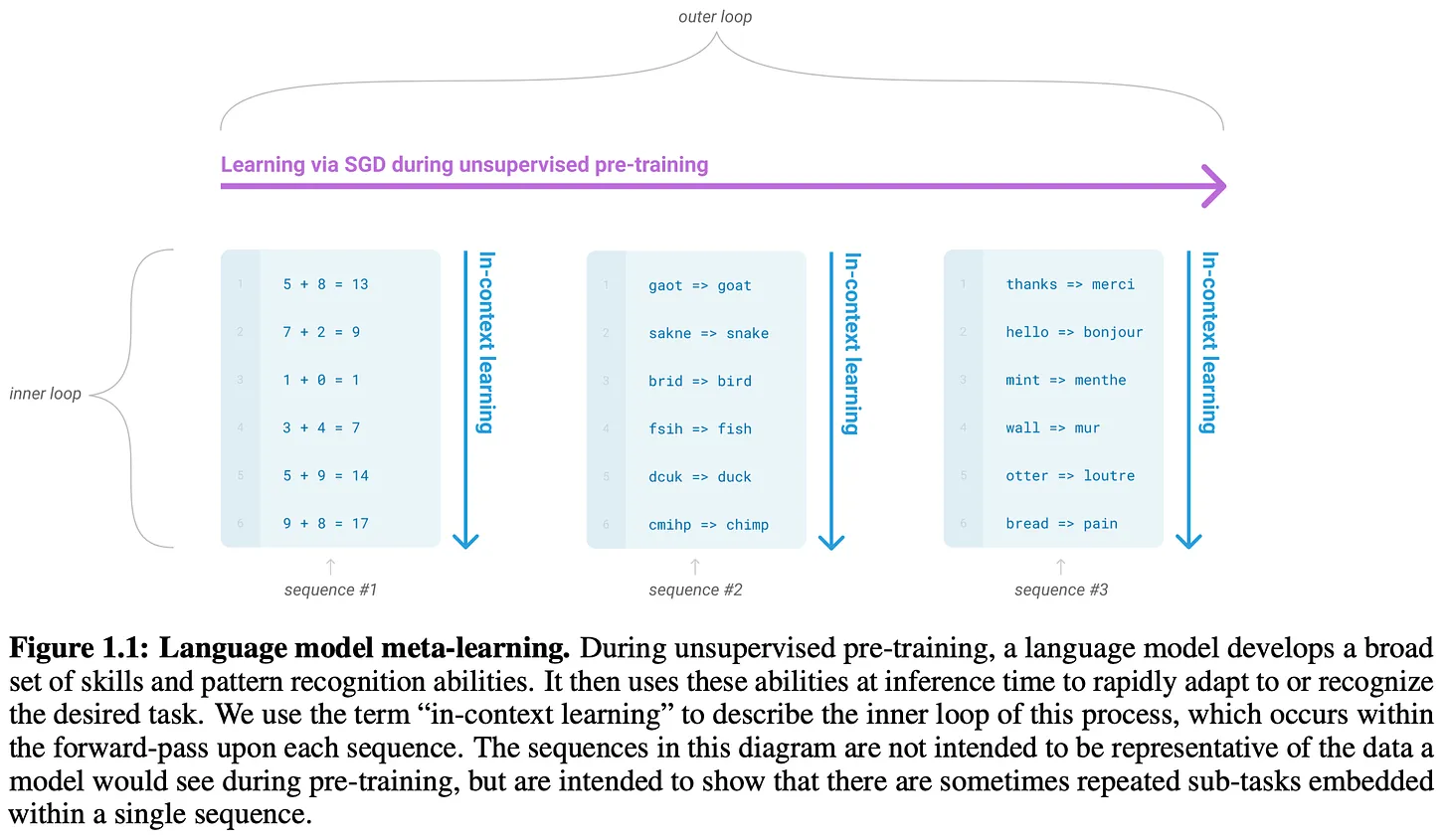

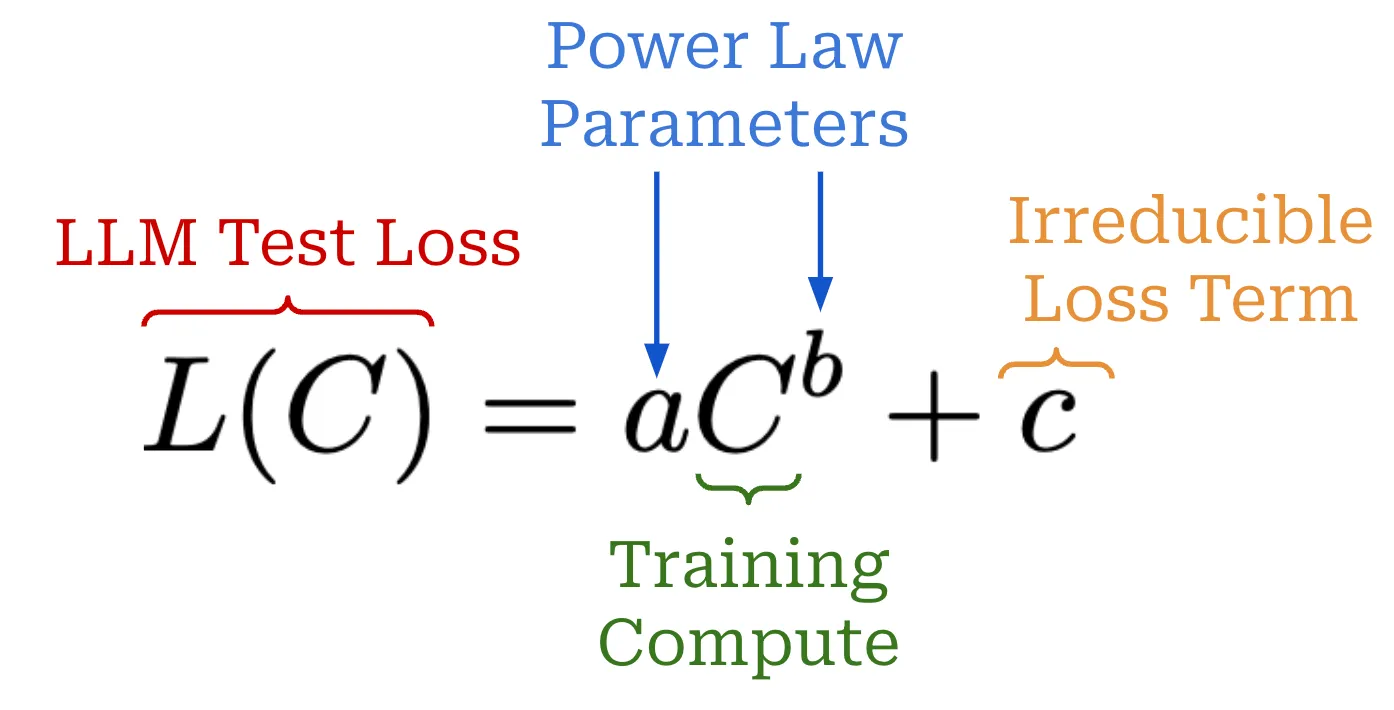

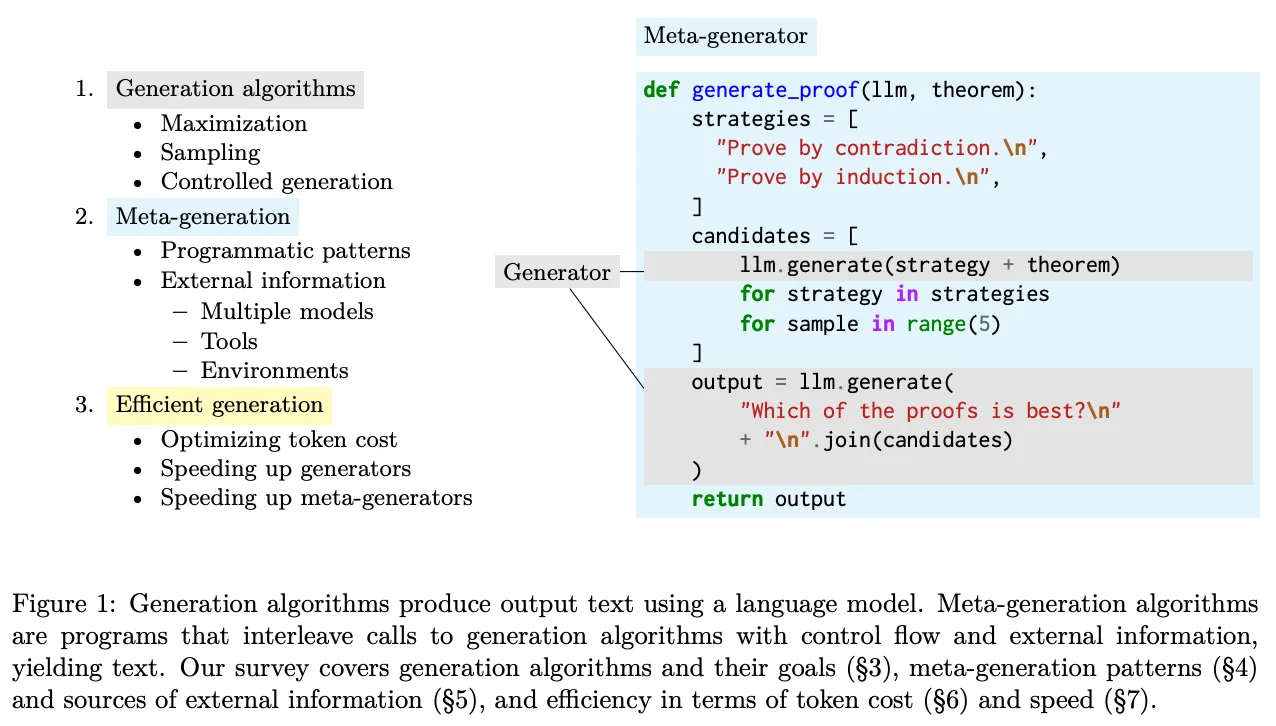

Avances más recientes en la investigación sobre IA -En concreto, el Modelo de Lenguaje Amplio (LLM)- Todo depende de la escala. Si entrenamos modelos más grandes con más datos, obtendremos mejores resultados. Esta relación puede definirse de forma más rigurosa mediante la ley de escala, que es una ecuación que describe cómo disminuye la pérdida en las pruebas de un modelo lingüístico grande a medida que aumentamos alguna cantidad relevante (por ejemplo, la cantidad de cálculo de entrenamiento). La ley del tamaño nos ayuda a predecir los resultados de ejecuciones de entrenamiento más grandes y costosas, lo que nos da la confianza necesaria para seguir invirtiendo en el escalado.

"Si tienes un gran conjunto de datos y entrenas una red neuronal muy grande, el éxito está garantizado". - Ilya Sutskever

Durante años, la ley de escala ha sido una predecible estrella polar para la investigación en IA. De hecho, el éxito de laboratorios pioneros como OpenAI se ha atribuido incluso a su adhesión a la ley de la escala. Sin embargo, la persistencia de la ley de escala se ha visto cuestionada recientemente por1 informes según los cuales los principales laboratorios de investigación están trabajando para crear la próxima generación de mejores modelos de grandes lenguajes. Estas afirmaciones pueden suscitar nuestro escepticismo:¿Se producirá un cuello de botella a escala? Si es así, ¿hay otras formas de avanzar?

Este resumen responderá a estas preguntas desde la base, empezando por una explicación en profundidad de las Leyes de Escala del Modelo Big Language y la investigación que las rodea. El concepto de la Ley de la Escala es sencillo, pero el público tiene todo tipo de ideas erróneas sobre la escala.La ciencia en la que se basa este estudio es muy específicaLa ley de la escala. A partir de este conocimiento detallado de la escala, analizaremos las últimas tendencias en la investigación de Big Language Modelling, así como los factores que han provocado que la ley de escala se "estanque". Por último, utilizaremos esta información para ofrecer una imagen más clara del futuro de la investigación en IA, centrándonos en algunas ideas clave -Incluida la escala--Estas ideas pueden seguir impulsando el progreso.

Conceptos básicos de escalado para grandes modelos lingüísticos

Para comprender el estado de escala de los grandes modelos lingüísticos, primero tenemos que establecer una comprensión general de las leyes de escala. Construiremos esta comprensión desde cero, empezando por el concepto de leyes de potencia. A continuación, exploraremos cómo se han aplicado las leyes de potencia en el estudio de grandes modelos lingüísticos para derivar las leyes de escala que utilizamos hoy en día.

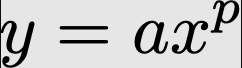

¿Qué es una ley de potencia?

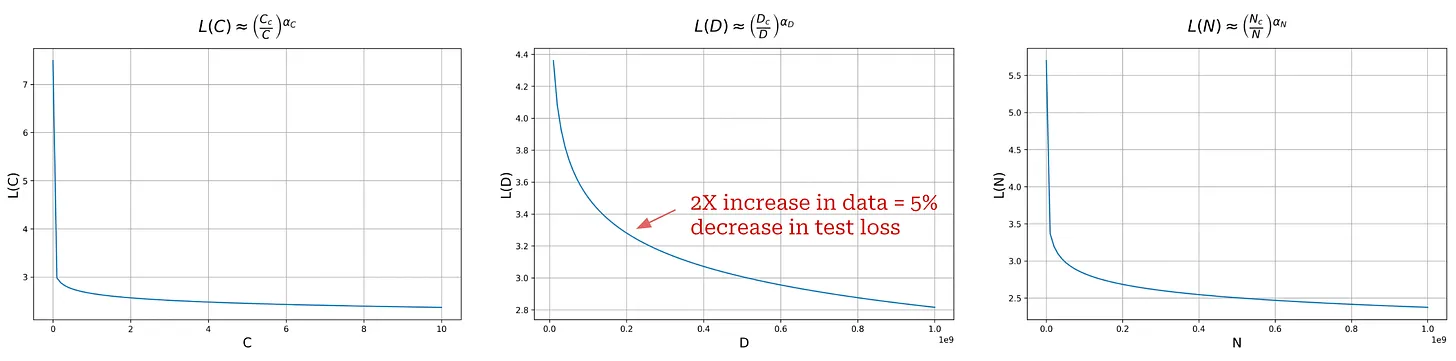

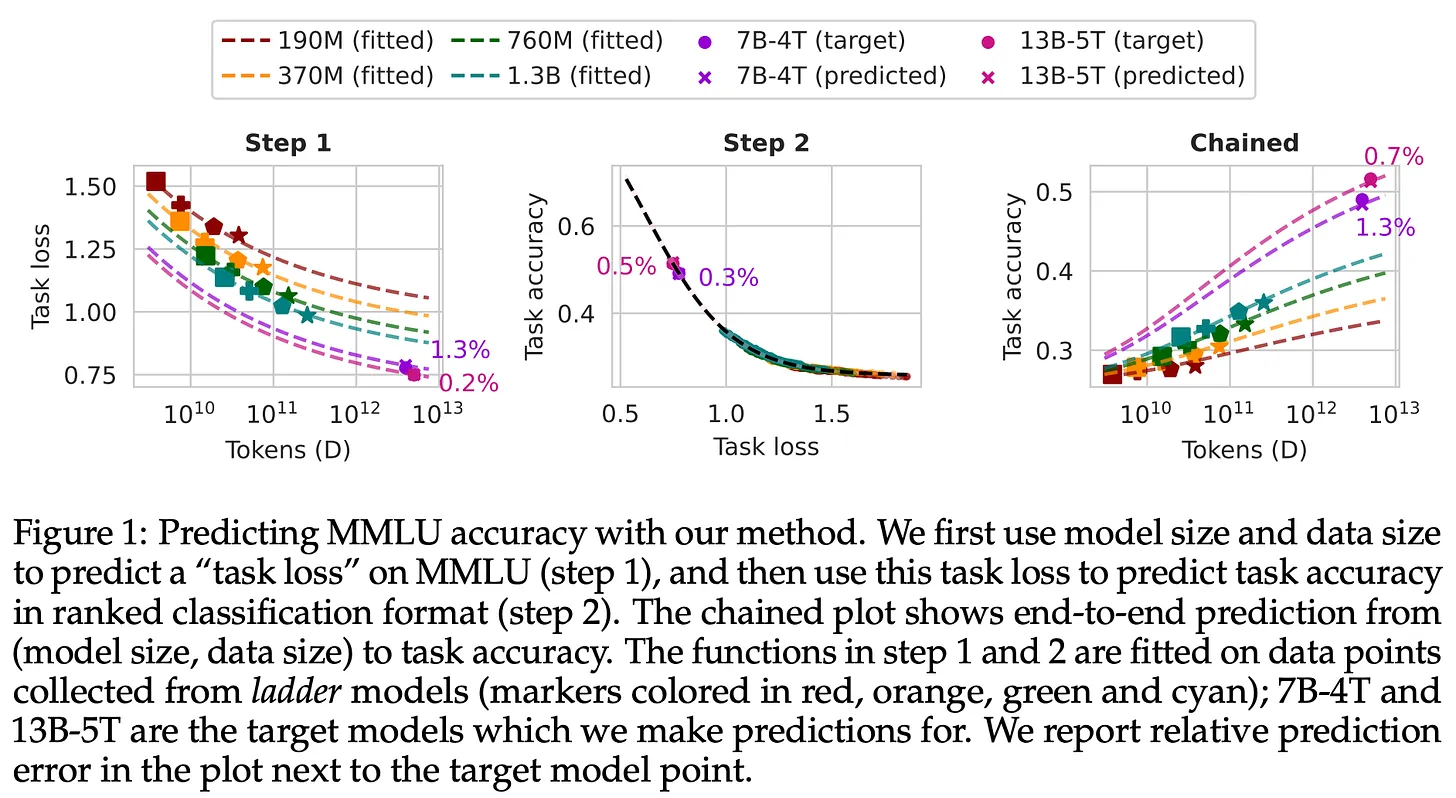

Las leyes de potencia son un concepto fundamental en el escalado de grandes modelos lingüísticos. En pocas palabras, una ley de potencia simplemente describe la relación entre dos cantidades. En el caso de un modelo lingüístico de gran tamaño, la primera cantidad es la pérdida de la prueba del modelo lingüístico de gran tamaño.u otras métricas de rendimiento relevantes (por ejemplo, la precisión de la tarea descendente [7]).- La otra es que estamos intentando escalar ciertos parámetros, como el número de parámetros del modelo. Por ejemplo, al investigar las propiedades de escalado de un modelo lingüístico de gran tamaño, podríamos ver la siguiente afirmación.

"Si hay suficientes datos de entrenamiento, el escalado de la pérdida de validación debería ser una función de ley de potencia suave aproximada del tamaño del modelo". - Fuente [4]

Tal afirmación nos dice que existe una relación mensurable entre la pérdida de prueba del modelo y el número total de parámetros del modelo. Un cambio en una de estas cantidades provocará un cambio invariable en la escala relativa de la otra. En otras palabras, sabemos por esta relación que el aumento del número total de parámetros del modelo -elSuponiendo que se cumplan otras condiciones (por ejemplo, que se disponga de suficientes datos de entrenamiento)--resultará en una reducción de las pérdidas en las pruebas por un factor predecible.

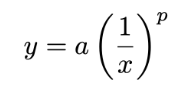

Fórmula de la ley de potencia. La ley de potencia básica se expresa mediante la siguiente ecuación.

Las dos magnitudes estudiadas aquí son x responder cantando ypero (no) a responder cantando p es una constante que describe la relación entre estas magnitudes. Si representamos gráficamente esta función de ley de potencia2 , obtenemos la siguiente figura. Proporcionamos gráficos tanto en escala normal como logarítmica porque la mayoría de los artículos que estudian el escalado de grandes modelos lingüísticos utilizan escalas logarítmicas.

Gráfico de la ley de potencia fundamental entre x e y

Sin embargo, los diagramas proporcionados para escalar el Big Language Model no se parecen a los diagramas mostrados anteriormente - elSuelen estar al revés.Véase el ejemplo siguiente.

(Fuente [1])

La ecuación de la ley de potencia inversa es casi la misma que la ecuación de la ley de potencia estándar, pero nos interesa la variable p Utiliza exponentes negativos. Si el exponente de una ley de potencias es negativo, la gráfica se invierte; véase el ejemplo siguiente.

Gráfica de la ley de potencia inversa entre x e y

Cuando se traza utilizando la escala logarítmica, esta ley de potencia inversa produce la relación lineal que caracteriza las leyes de tamaño de la mayoría de los grandes modelos lingüísticos. En casi todos los artículos de este resumen se generan gráficos de este tipo para investigar cómo afecta el escalado de distintos factores (por ejemplo, el tamaño, el cálculo, los datos, etc.) al rendimiento de un modelo lingüístico de gran tamaño. Ahora, echemos un vistazo más práctico a las leyes de potencia y conozcamos uno de los primeros artículos que las estudian en el contexto del escalado de grandes modelos lingüísticos [1].

Leyes de escala para la modelización neurolingüística [1]

En los inicios del modelado del lenguaje, no comprendíamos el impacto de la escala en el rendimiento. El modelado lingüístico era un área de investigación prometedora, pero la generación de modelos de entonces (por ejemplo, el GPT original) tenía una potencia limitada. Aún no habíamos descubierto la potencia de los modelos más grandes, y el camino para crear mejores modelos lingüísticos no estaba claro.¿Importa la forma del modelo (es decir, el número de capas y el tamaño)? ¿Aumenta el tamaño del modelo su rendimiento? ¿Cuántos datos se necesitan para entrenar estos modelos más grandes?

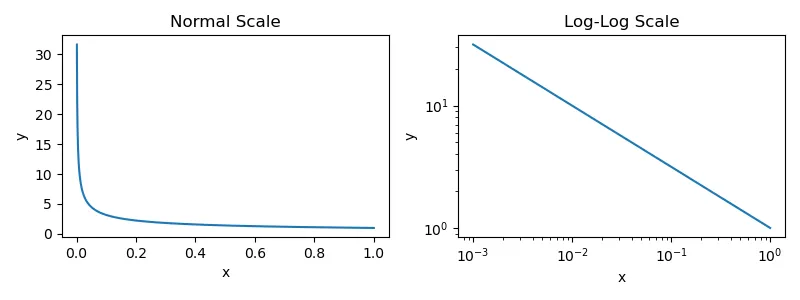

"A medida que aumentan el tamaño del modelo, el tamaño del conjunto de datos y la cantidad de computación utilizada para el entrenamiento, la pérdida escala como una ley de potencia, con algunas de estas tendencias abarcando más de siete órdenes de magnitud". - Fuente [1]

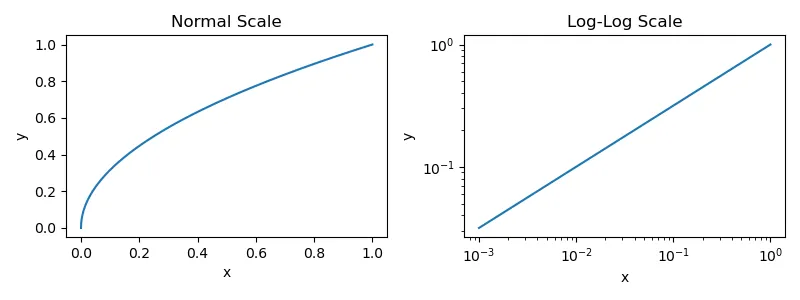

En [1], los autores se propusieron analizar varios factores por-Ejemplos: tamaño del modelo, forma del modelo, tamaño del conjunto de datos, cálculo del entrenamiento y tamaño del lote.- sobre el rendimiento del modelo para responder a estas preguntas. De este análisis se desprende que el rendimiento del modelo lingüístico de gran tamaño mejora suavemente a medida que aumentamos el número de

- Número de parámetros del modelo.

- El tamaño del conjunto de datos.

- La cantidad de cálculo utilizada para el entrenamiento.

Más concretamente.Cuando el rendimiento no se ve obstaculizado por los otros dos factores, se observa una relación de ley de potencia entre cada factor y la pérdida de la prueba del modelo de lenguaje grande.

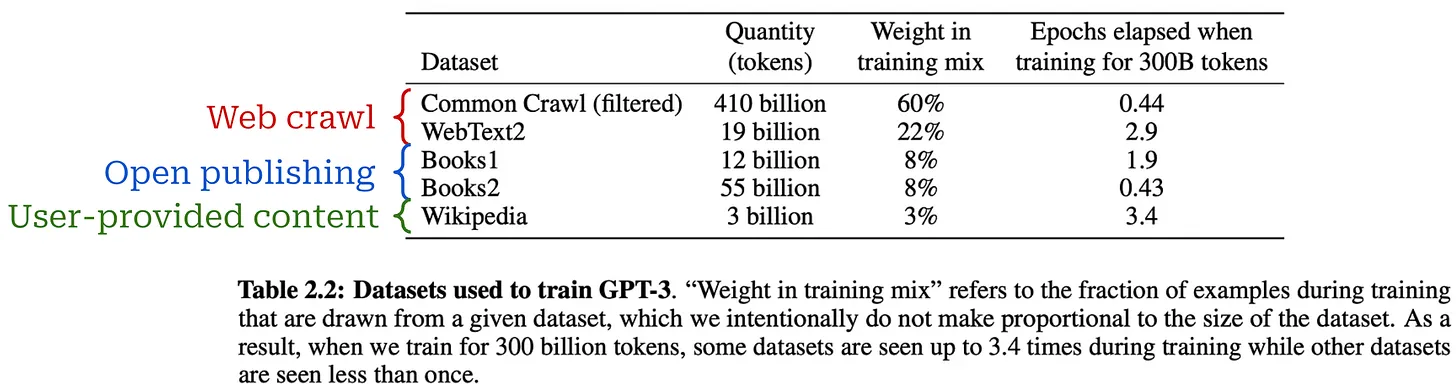

Configuración experimental.Para ajustar sus leyes de potencia, los autores preentrenaron grandes modelos lingüísticos en un subconjunto del corpus WebText2, con un tamaño de hasta 1.500 millones de parámetros y que contenía de 22.000 a 23.000 millones de tokens. todos los modelos utilizaron 1.024 Ficha de longitud de contexto fija y pérdida estándar de predicción del siguiente token (entropía cruzada) para el entrenamiento. La misma pérdida se mide en un conjunto de pruebas reservado y se utiliza como nuestra principal métrica de rendimiento.Esta configuración coincide con la configuración estándar de preentrenamiento para la mayoría de los modelos lingüísticos de gran tamaño..

(Fuente [1])

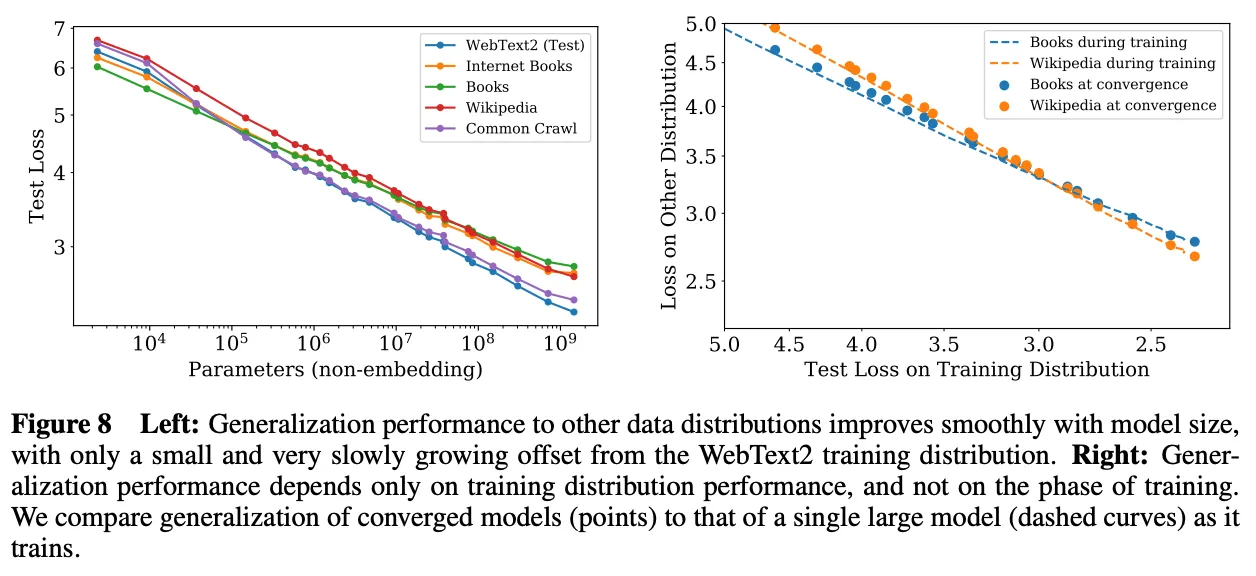

Grandes modelos lingüísticos Leyes de potencia de escala.Rendimiento del gran modelo lingüístico entrenado en [1] -En cuanto a sus pérdidas en las pruebas con WebText2- demostraron mejorar constantemente con más parámetros, datos y cálculo3 . Estas tendencias abarcan ocho órdenes de magnitud en el cálculo, seis órdenes de magnitud en el tamaño del modelo y dos órdenes de magnitud en el tamaño del conjunto de datos. Las relaciones exactas de la ley de potencia y las ecuaciones ajustadas a cada relación se muestran en la figura anterior. Cada una de las ecuaciones es muy similar a las ecuaciones de ley de potencia inversa que hemos visto antes. Sin embargo, fijamos a = 1 y añadir una constante de multiplicación adicional de 4 dentro de los paréntesis.

(Fuente [1])

Estas leyes de potencia sólo se aplican cuando el entrenamiento no se ve obstaculizado por otros factores. Por lo tanto, los tres componentes -elTamaño del modelo, datos y cálculos-deben ampliarse todos al mismo tiempo para obtener un rendimiento óptimo. Si ampliamos cualquiera de estos componentes de forma aislada, llegaremos a un punto de rendimiento decreciente.

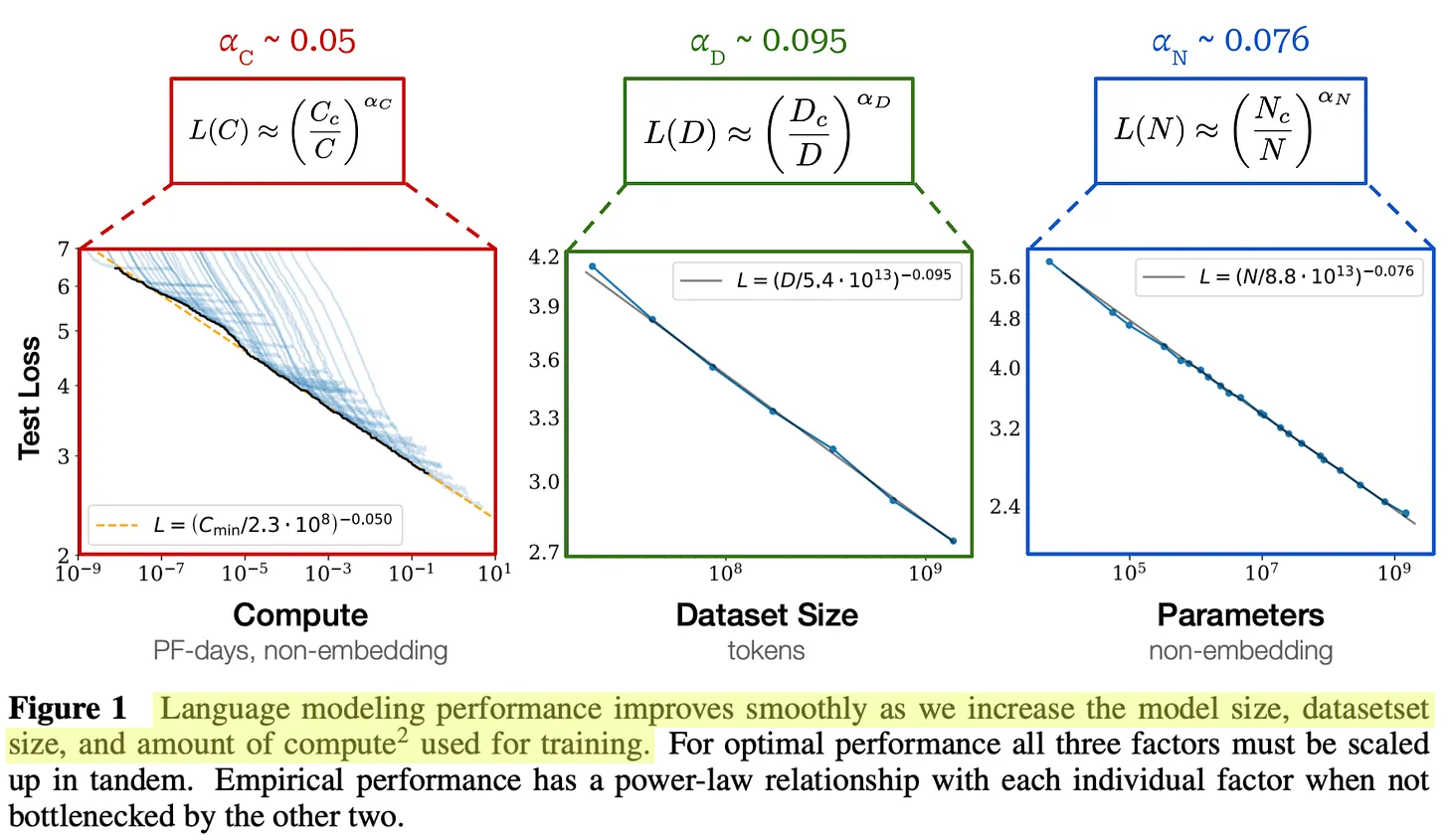

¿Qué nos dice la ley de potencia?Aunque los gráficos de la ley de potencia proporcionados en [1] parecen prometedores, debemos tener en cuenta que estos gráficos se generaron utilizando la escala logarítmica. Si generamos gráficos normales (es decir, sin escala logarítmica), obtenemos la siguiente figura, en la que vemos que la forma de la ley de potencia se asemeja a un decaimiento exponencial.

Gráficos de ley de potencias sin escalas logarítmicas

Teniendo en cuenta gran parte del discurso en línea sobre el escalado y la AGI, este hallazgo parece contrario a la intuición. En muchos casos, la intuición que nos han transmitido parece ser que la calidad de los grandes modelos lingüísticos aumenta exponencialmente con el crecimiento logarítmico de la computación, pero no es así. De hecho, elMejorar la calidad de un modelo lingüístico de gran tamaño resulta cada vez más difícil a medida que aumenta la escala.

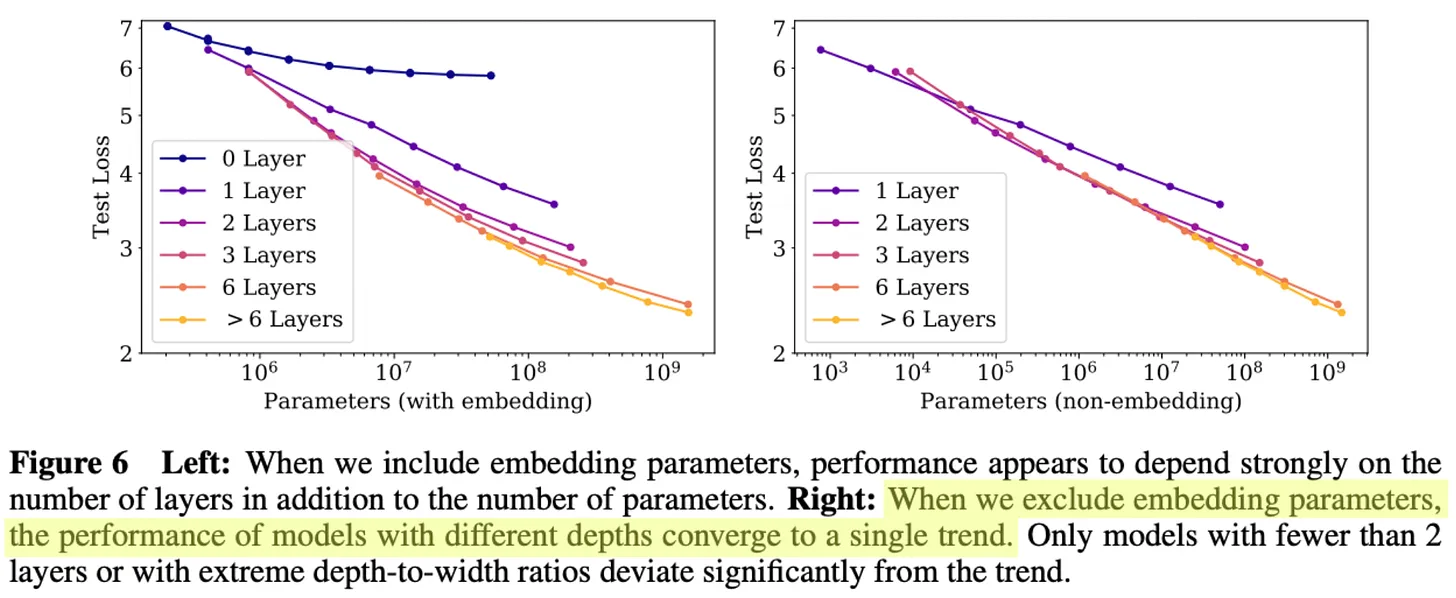

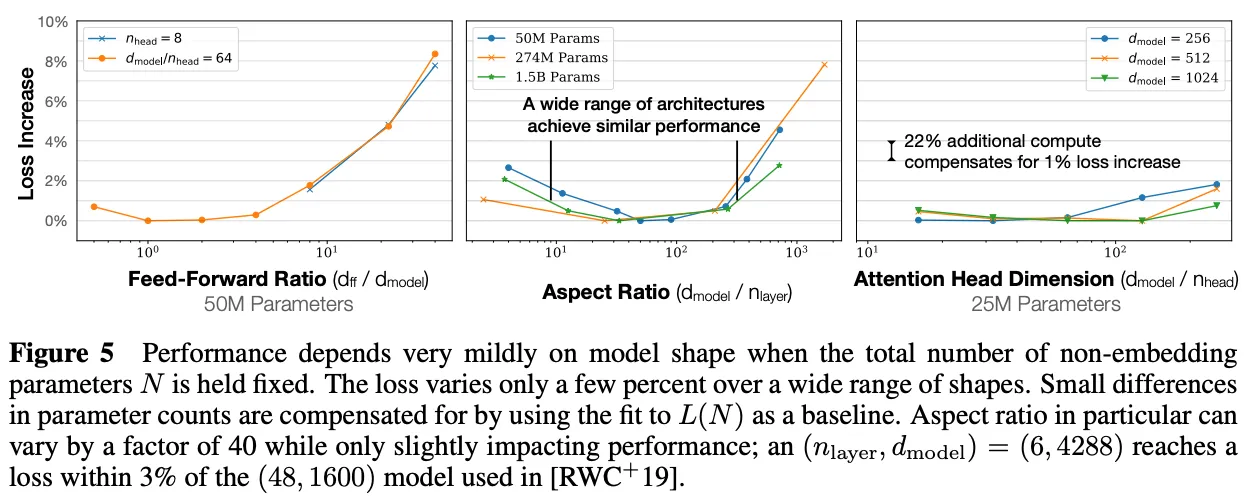

(Fuente [1])

Otros hallazgos útiles.Además de la ley de potencia observada en [1], hemos visto que otros factores considerados, como la forma del modelo o la configuración arquitectónica, tienen poco impacto en el rendimiento del modelo; véase más arriba. Con diferencia, la escala es el factor que más contribuye a crear mejores modelos para lenguas de gran tamaño: elMás datos, cálculos y parámetros del modelo conducen a un aumento suave del rendimiento del gran modelo lingüístico.

"Los modelos más grandes tienen eficiencias de muestreo significativamente más altas, por lo que el entrenamiento óptimo eficiente desde el punto de vista computacional implica entrenar modelos muy grandes con cantidades relativamente modestas de datos y detenerse significativamente antes de la convergencia." - Fuente [1]

Curiosamente, los análisis empíricos de [1] muestran que los grandes modelos lingüísticos de mayor tamaño tienden a tener una mayor eficiencia muestral, lo que significa que utilizan menos datos para alcanzar el mismo nivel de pérdida en la prueba en comparación con los modelos más pequeños. Por este motivo, losPreentrenar un gran modelo lingüístico hasta la convergencia es (posiblemente) subóptimo.. En su lugar, podemos entrenar modelos más grandes con menos datos y detener el proceso de entrenamiento antes de la convergencia. Este enfoque es óptimo en términos de la cantidad de cálculo de entrenamiento utilizado, pero no tiene en cuenta los costes de inferencia. De hecho, solemos entrenar modelos más pequeños con más datos porque alojar modelos más pequeños es menos costoso.

Los autores también analizaron exhaustivamente la relación entre el tamaño del modelo y la cantidad de datos utilizados para el preentrenamiento y descubrieron que no es necesario que el tamaño del conjunto de datos aumente tan rápidamente como el tamaño del modelo.Aumentar el tamaño del modelo unas 8 veces requiere aumentar el volumen de datos de entrenamiento unas 5 veces para evitar el sobreajuste.

(Fuente [1])

"Estos resultados demuestran que el rendimiento de los modelos lingüísticos mejora de forma suave y predecible cuando escalamos adecuadamente el tamaño del modelo, los datos y el cálculo. Esperamos que los modelos lingüísticos más grandes funcionen mejor que los actuales y tengan una mayor eficiencia de muestreo". - Fuente [1]

Aplicación práctica de la ley del tamaño

El hecho de que el preentrenamiento a gran escala sea tan beneficioso nos plantea un pequeño dilema. Los mejores resultados se obtienen entrenando grandes modelos con grandes cantidades de datos. Sin embargo, estos entrenamientos son muy caros yEsto significa que también asumen muchos riesgos¿Y si gastamos 10 millones de dólares en entrenar un modelo que no cumple nuestras expectativas? ¿Qué pasa si gastamos 10 millones de dólares en entrenar un modelo que no cumple nuestras expectativas? Dado el coste del preentrenamiento, no podemos realizar ningún ajuste específico del modelo, y tenemos que asegurarnos de que los modelos que entrenamos funcionan bien. Tenemos que desarrollar una estrategia para afinar estos modelos y predecir su rendimiento sin gastar demasiado dinero.

(Fuente [11])

- Entrene un grupo de modelos más pequeños utilizando varios ajustes de entrenamiento.

- Adaptar la ley de escala al rendimiento de modelos más pequeños.

- Inferir el rendimiento de modelos más grandes utilizando la ley del tamaño.

Por supuesto, este enfoque tiene sus limitaciones. Predecir el rendimiento de modelos más grandes a partir de modelos más pequeños es difícil y puede resultar inexacto. Los modelos pueden comportarse de forma diferente en función de su tamaño. Sin embargo, se han propuesto varios métodos para hacerlo más factible, y en la actualidad las leyes de tamaño se utilizan habitualmente con este fin. La posibilidad de utilizar leyes de tamaño para predecir el comportamiento de modelos más grandes nos da más confianza (y tranquilidad) como investigadores. Además, la ley del tamaño proporciona una forma sencilla de justificar la inversión en investigación sobre IA.

Fase de ampliación y formación previa

"Eso es lo que está impulsando todos los avances que vemos hoy: mega redes neuronales entrenadas en enormes conjuntos de datos". - Ilya Sutskever

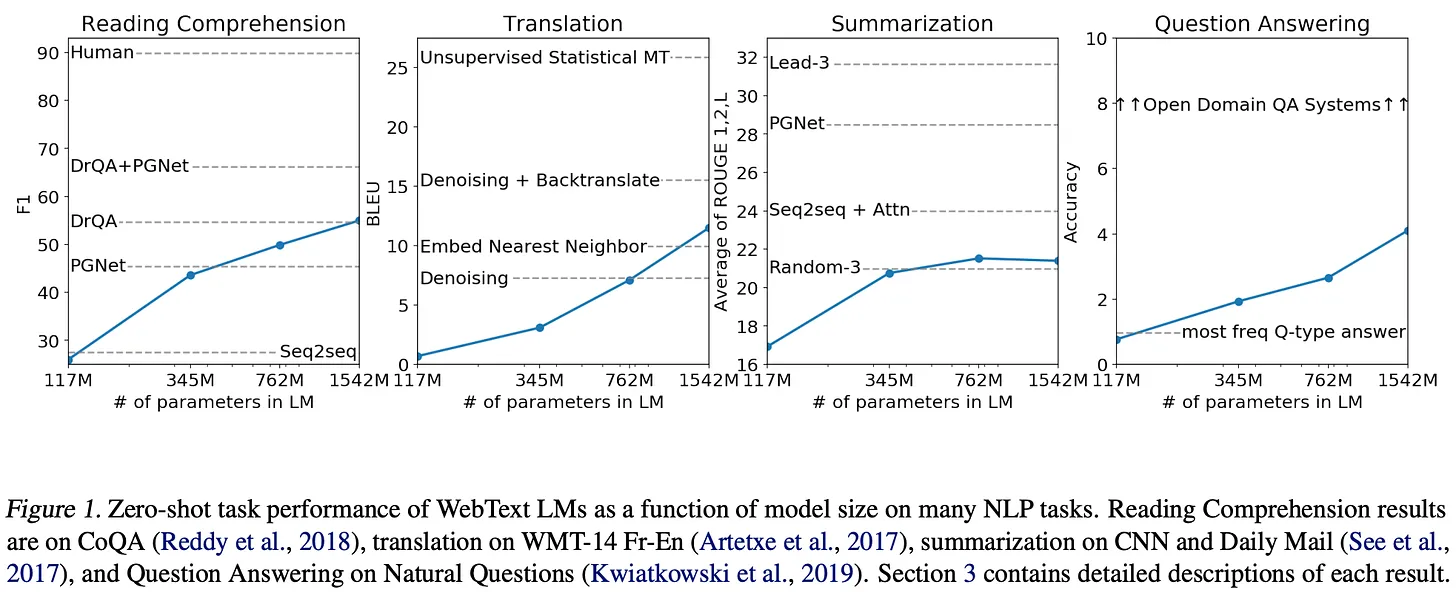

El descubrimiento de la Ley de la Escala ha catalizado muchos avances recientes en el estudio de grandes modelos lingüísticos. Para obtener mejores resultados, basta con entrenar modelos en conjuntos de datos más grandes (¡y mejores!) para entrenar modelos cada vez más grandes. para entrenar modelos cada vez mayores. Esta estrategia se ha utilizado para crear varios modelos de la familia GPT, así como la mayoría de los modelos conocidos de equipos ajenos a OpenAI. En este artículo analizaremos en profundidad el progreso de esta investigación sobre el escalado: laRecientemente descrita por Ilya Sutskever como "la era del preentrenamiento". 5.

Serie GPT: GPT [2], GPT-2 [3], GPT-3 [4] y GPT-4 [5].

Grandes modelos lingüísticos La aplicación más conocida y visible de las leyes de escala es la creación de la familia de modelos GPT de OpenAI. Nos centraremos principalmente en los primeros modelos abiertos de la serie: el modeloHasta GPT-3-Porque:

- Los detalles de estos modelos se están compartiendo más abiertamente.

- Los modelos posteriores se han beneficiado de los avances en la investigación post-entrenamiento, además de ampliar el proceso de pre-entrenamiento.

También presentaremos algunos resultados de escalado conocidos, como los modelos de GPT-4.

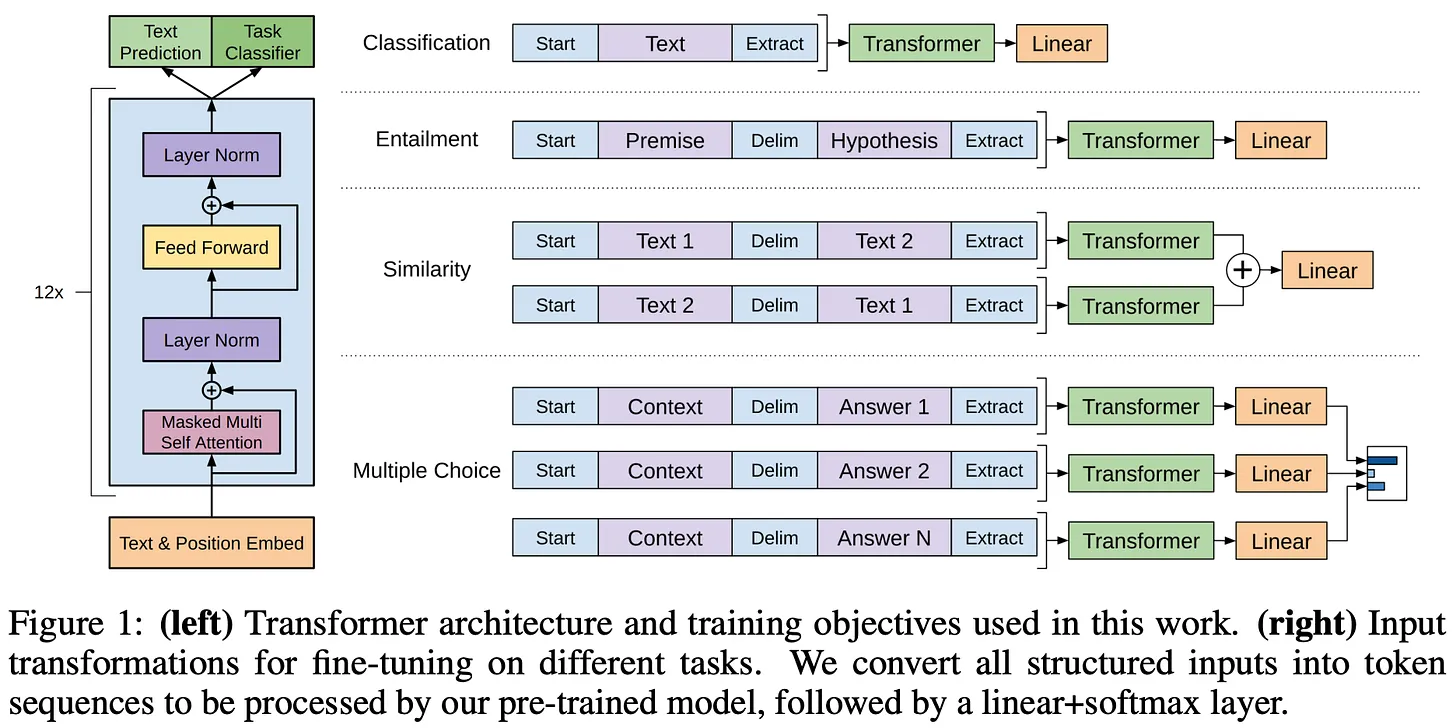

(Fuente [2])

- El preentrenamiento autosupervisado sobre texto plano es muy eficaz.

- Es importante utilizar tramos de texto largos y continuos para el preentrenamiento.

- Una vez preentrenados, los modelos individuales pueden ajustarse para resolver diversas tareas con la máxima precisión6 .

En general, GPT no es un modelo especialmente destacable, pero sentó algunas bases importantes para trabajos posteriores (es decir, el Transformer sólo decodificador y el preentrenamiento autosupervisado) que exploraron modelos similares a mayor escala.

(Fuente [3])

- Estos modelos están preentrenados en WebText, que i) es mucho mayor que BooksCorpus, y ii) Creado a partir de datos de Internet.

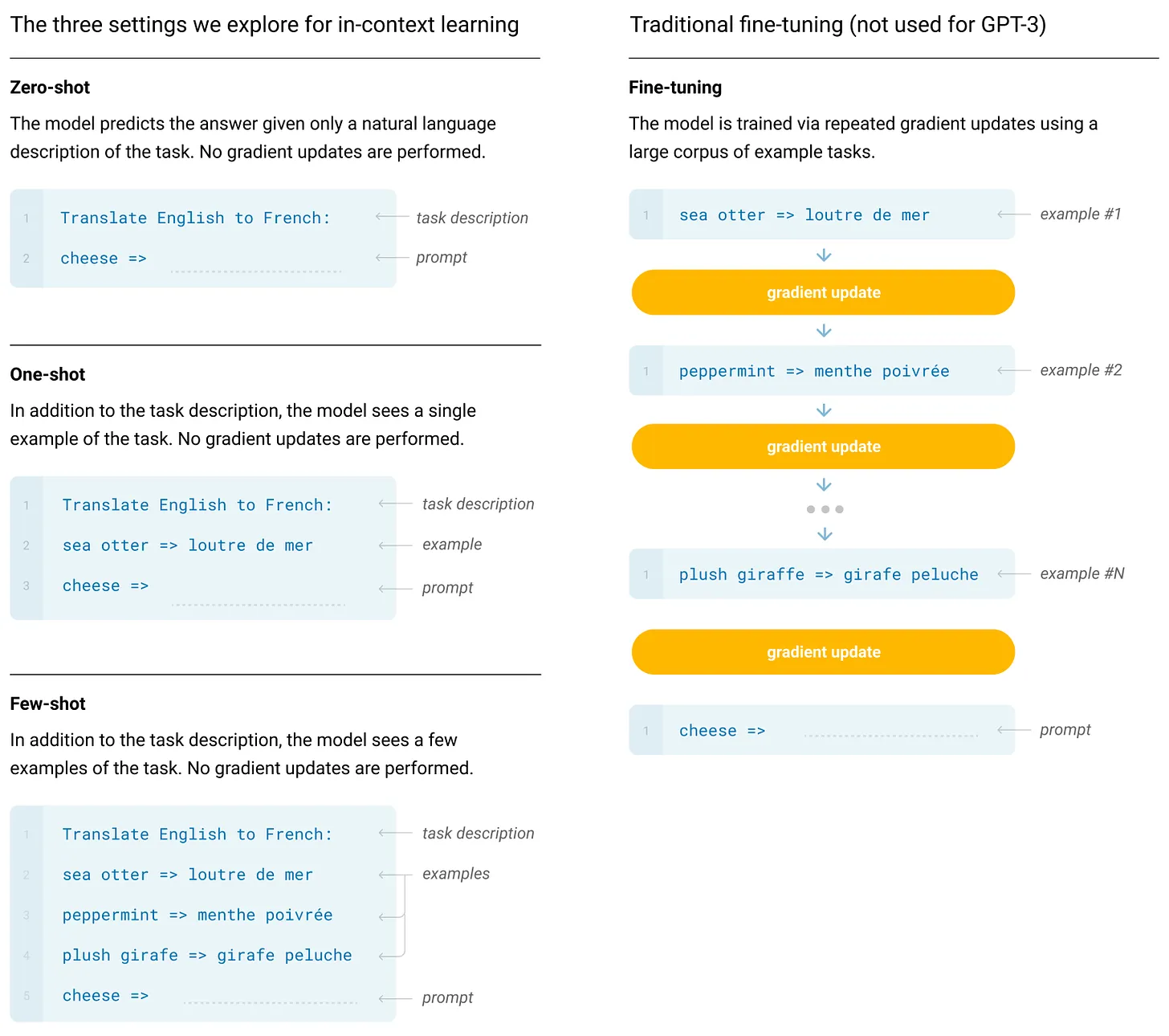

- Estos modelos no se ajustan para tareas posteriores. En su lugar, resolvemos la tarea realizando una inferencia de muestra cero7 utilizando modelos preentrenados.

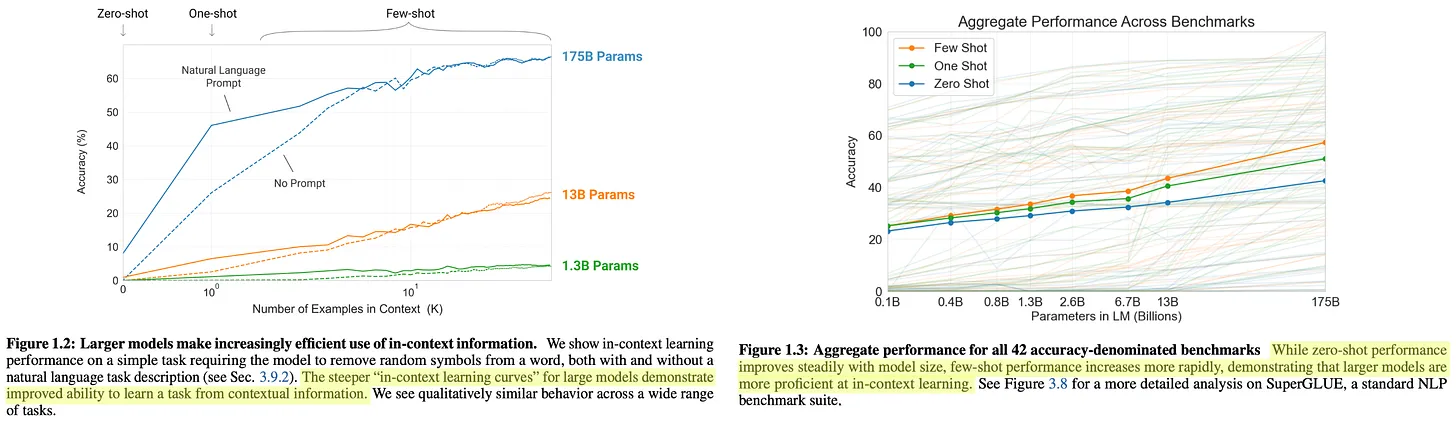

Los modelos GPT-2 no alcanzan el rendimiento más avanzado en la mayoría de las pruebas comparativas8 , pero su rendimiento mejora sistemáticamente al aumentar el tamaño del modelo: elAmpliar el número de parámetros del modelo aporta claras ventajasVéase más abajo.

(Fuente [3])

"Los modelos lingüísticos con capacidad suficiente empezarán a aprender a inferir y realizar tareas demostradas en secuencias de lenguaje natural para predecirlas mejor, independientemente de su método de adquisición". - Fuente [3]

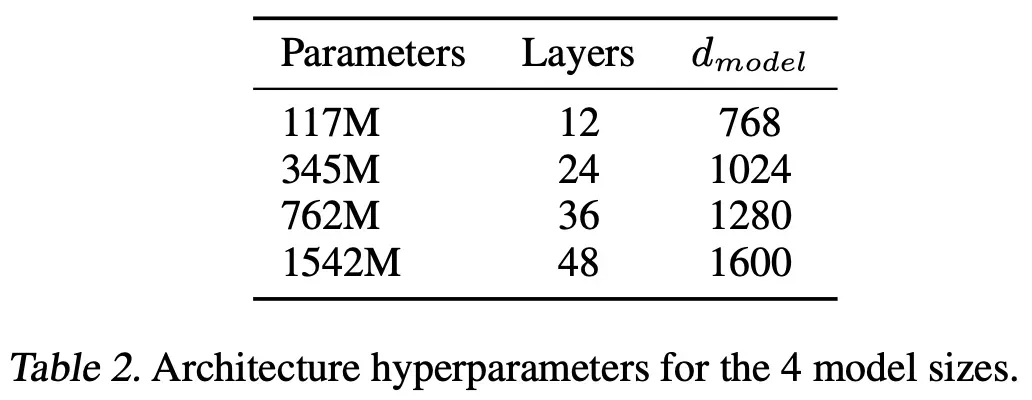

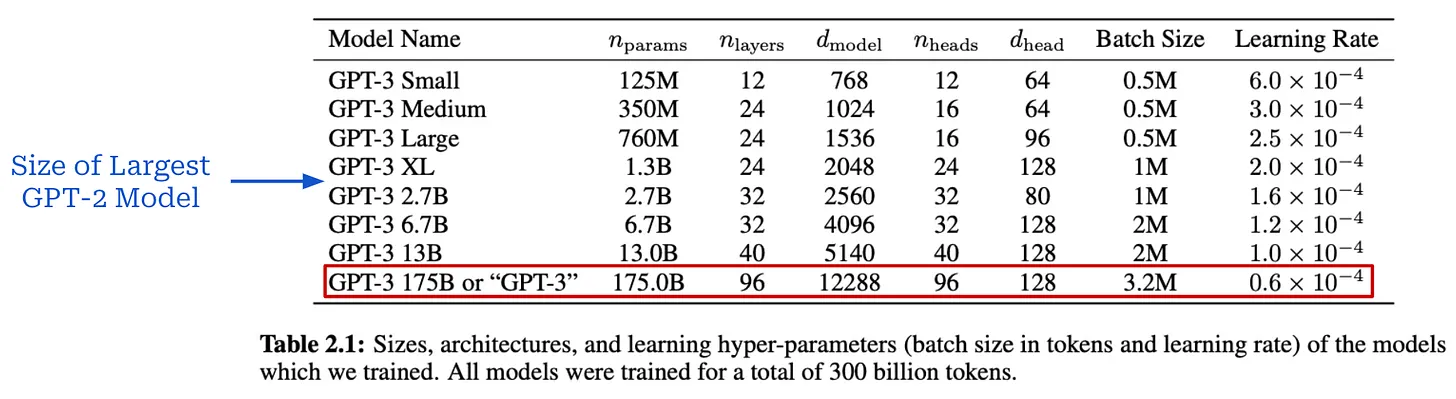

GPT-3 [4] marcó un hito en la investigación de la IA al demostrar claramente las ventajas del preentrenamiento a gran escala de un gran modelo lingüístico. Con más de 175.000 millones de parámetros, este modelo es más de 100 veces mayor que el mayor modelo GPT-2; véase más adelante.

(Fuente [4])

(Fuente [4])

(Fuente [4])

(Fuente [4])

(Fuente [4])

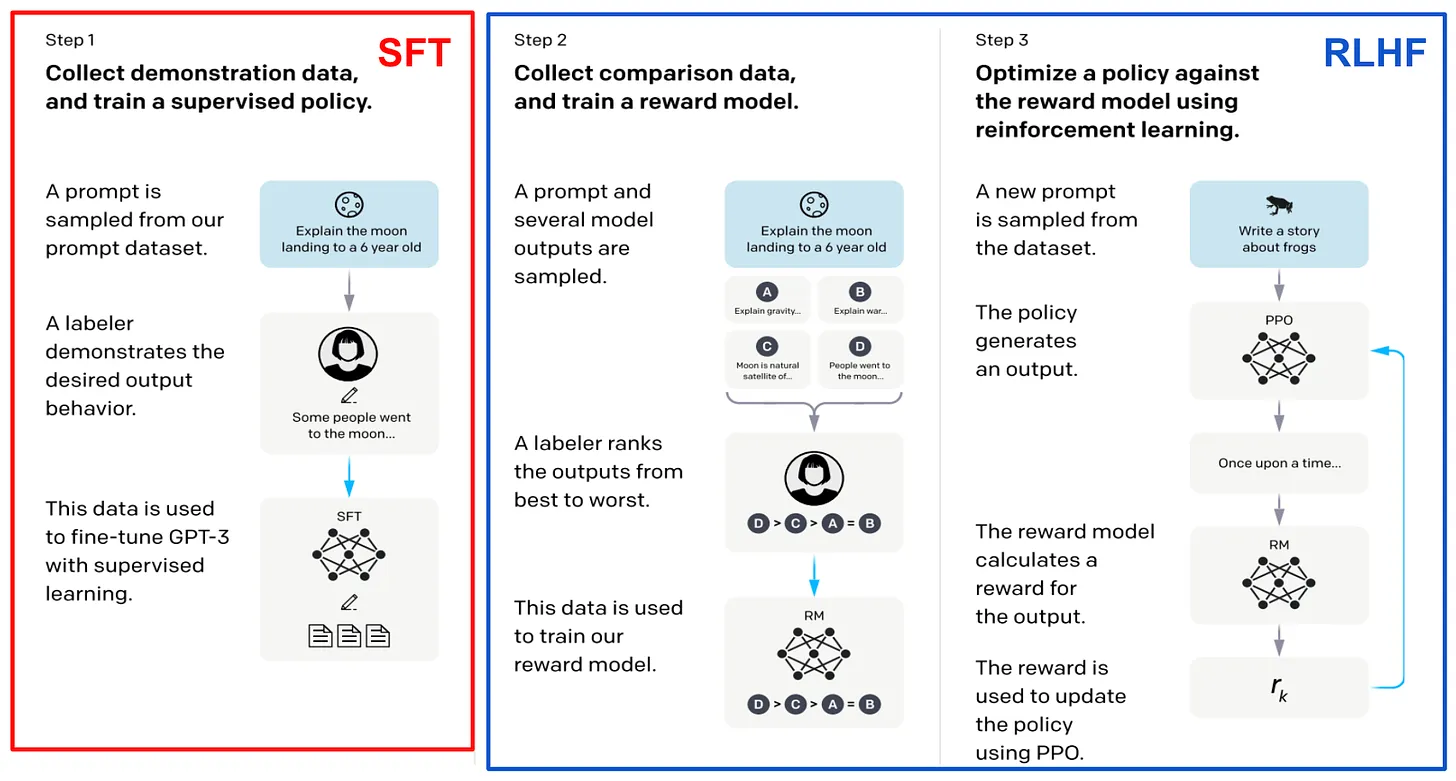

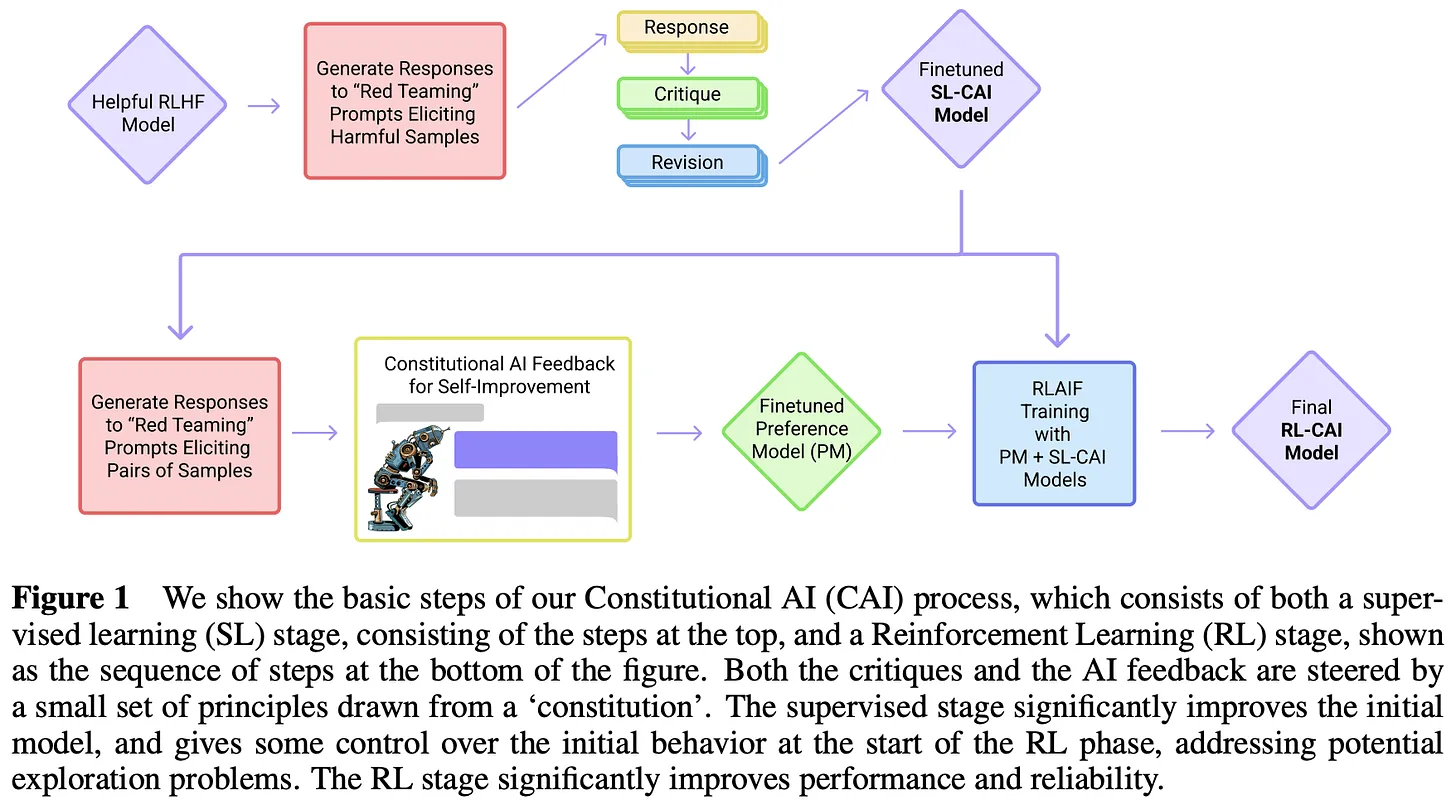

Después de GPT-3. El impresionante rendimiento de GPT-3 ha despertado un gran interés en el estudio de grandes modelos lingüísticos, centrándose principalmente en el preentrenamiento a gran escala. los siguientes modelos lanzados por OpenAI - elInstructGPT [8], ChatGPT y GPT-4 [5].-El uso de una combinación de preentrenamiento a gran escala y nuevas técnicas de postentrenamiento (es decir, el ajuste fino supervisado y el aprendizaje por refuerzo a partir de la retroalimentación humana) ha mejorado espectacularmente la calidad de los grandes modelos lingüísticos. Estos modelos son tan impresionantes que incluso han provocado un aumento del interés público por la investigación en Inteligencia Artificial.

"GPT-4 es un modelo basado en Transformer que está pre-entrenado para predecir el siguiente Token en un documento. el proceso de alineación post-entrenamiento mejora la métrica de factorialidad y la adherencia al comportamiento deseado." - Fuente [5]

En ese momento, OpenAI empezó a publicar menos detalles sobre su investigación. En su lugar, los nuevos modelos sólo se publicaban a través de su API, lo que impedía que el público entendiera cómo se creaban estos modelos. Afortunadamente, del material que OpenAI publica se puede extraer alguna información útil. Por ejemplo, InstructGPT [8]-ChatGPT predecesores-- Existe un documento relacionado que documenta la estrategia de post-entrenamiento del modelo en detalle; véase más adelante. Dado que este documento también establece que GPT-3 es el modelo de base para InstructGPT, es razonable deducir que la mejora del modelo en el rendimiento es en gran medida independiente del proceso de pre-entrenamiento ampliado.

(Fuente [8])

- GPT-4 se basa en Transformer.

- El modelo se preentrena utilizando la predicción de la siguiente ficha.

- Uso de datos públicos y de terceros con licencia.

- El modelo se perfecciona mediante el aprendizaje por refuerzo a partir de las reacciones humanas.

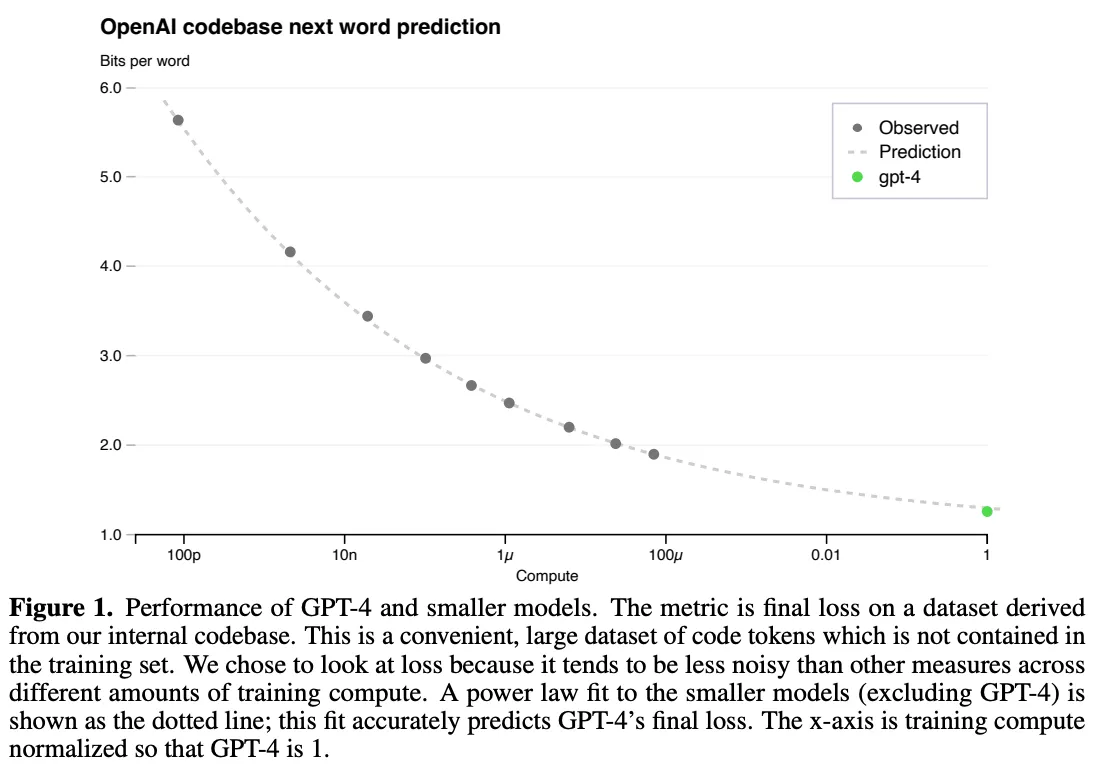

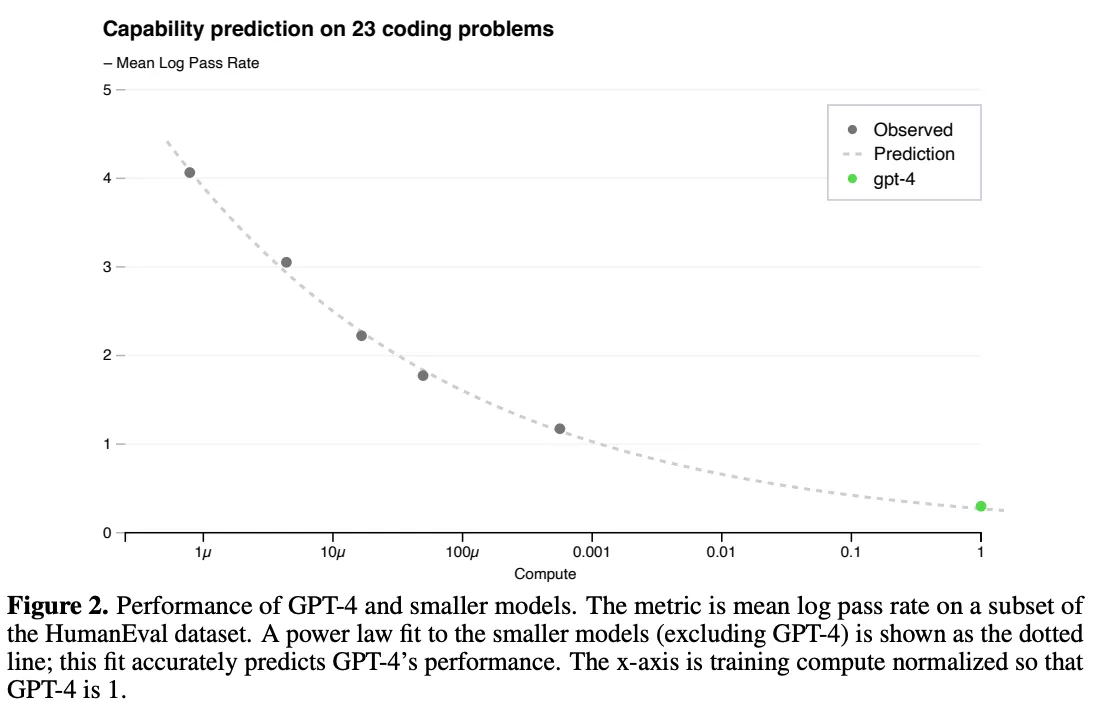

No obstante, la importancia de la escalabilidad queda patente en este informe técnico. Los autores señalan que un reto clave en este trabajo es desarrollar una arquitectura de entrenamiento escalable que funcione de forma predecible a diferentes escalas, permitiendo la extrapolación de los resultados de ejecuciones más pequeñas y proporcionando así confianza para ejercicios de entrenamiento más grandes (¡y mucho más caros!). ejercicios de entrenamiento con confianza.

"La pérdida final de un gran modelo lingüístico correctamente entrenado ...... puede aproximarse mediante una ley de potencias de la cantidad de cálculo utilizada para entrenar el modelo". - Fuente [5]

La formación previa masiva es muy cara, así que normalmente sólo tenemos una oportunidad de hacerlo bien...No hay margen para ajustes específicos de cada modelo. La ley del tamaño desempeña un papel clave en este proceso. Podemos entrenar un modelo utilizando entre 1.000 y 10.000 veces menos cálculos y utilizar los resultados de estos entrenamientos para ajustar leyes de potencia. Estas leyes de potencia pueden utilizarse después para predecir el rendimiento de modelos más grandes. En particular, vimos en [8] que el rendimiento de GPT-4 se predijo utilizando leyes de potencia que miden la relación entre la pérdida de cómputo y la pérdida de prueba; véase más adelante.

GPT-4 Fórmula de la ley de escalas para la formación (Fuente [5])

(Fuente [5])

(Fuente [5])

Chinchilla. Formación de grandes modelos lingüísticos óptimos desde el punto de vista computacional [5]

(Fuente [9])

(Fuente [10])

(Fuente [10])

"La cantidad de datos de entrenamiento que se espera necesitar supera con creces la que se utiliza actualmente para entrenar grandes modelos". - Fuente [6]

Chinchilla.El análisis presentado en [6] destaca la importancia del tamaño de los datos.Los modelos grandes deben entrenarse con más datos para lograr un rendimiento óptimo.Para verificar este hallazgo, los autores entrenaron un gran modelo lingüístico de 70.000 millones de parámetros llamado Chinchilla. Para verificar este hallazgo, los autores entrenaron un gran modelo lingüístico de 70.000 millones de parámetros llamado Chinchilla. En comparación con los modelos anteriores, Chinchilla es más pequeño, pero tiene un conjunto de datos de preentrenamiento mayor: el1,4 billones de fichas de formación en totalChinchilla utiliza los mismos datos y la misma estrategia de evaluación que Gopher [10]. Aunque es cuatro veces más pequeño que Gopher, Chinchilla supera sistemáticamente a los modelos más grandes; véase más adelante.

(Fuente [6])

La "desaparición" de la ley de la balanza

La ley de escala se ha convertido recientemente en un tema candente (y controvertido) en la investigación de la IA. Como hemos visto en este resumen, la escala impulsó gran parte de la mejora de la IA durante la era previa al entrenamiento. Sin embargo, a medida que el ritmo de lanzamientos y mejoras de modelos se ralentiza en la segunda mitad de 202411 , empezamos a ver un cuestionamiento generalizado del escalado de modelos, lo que parece indicar que la investigación en IA -laEn particular, la ley de escala--Puede estar chocando contra un muro.

- OpenAI está cambiando su estrategia de producto debido a los cuellos de botella en la ampliación de su enfoque actual, según Reuters.

- Según la información, las mejoras del modelo GPT empiezan a ralentizarse.

- Bloomberg destaca las dificultades a las que se enfrentan varios laboratorios punteros cuando intentan construir una IA más potente.

- TechCrunch dice que la escala está empezando a producir rendimientos decrecientes.

- La revista Time publicó un matizado artículo en el que destacaba los diversos factores que están provocando la ralentización de la investigación en IA.

- Ilya Sutskever dijo en NeurIPS'24 *"El preentrenamiento tal y como lo conocemos acabará "*.

Al mismo tiempo, muchos expertos sostienen la opinión contraria. Por ejemplo, (Antrópico CEO) ha dicho que el escalado *"probablemente ...... continuará"Y Sam Altman sigue predicando.la frase "no hay muros "*. En esta sección daremos más color a este debate explicando con conocimiento de causa el estado actual de la escala y los diversos problemas que pueden existir.

Reducción de escala: ¿qué significa? ¿Por qué se produce?

"Ambas afirmaciones son probablemente ciertas: a nivel técnico, el escalado sigue funcionando. Para los usuarios, el ritmo de mejora se está ralentizando". - Nathan Lambert

Así que ......¿Se está ralentizando la ampliación? La respuesta es compleja y depende mucho de nuestra definición precisa de "desaceleración". Hasta ahora, mi respuesta más plausible a esta pregunta es que ambas respuestas son correctas. Por esta razón, no intentaremos responder a esta pregunta. En su lugar, profundizaremos en lo que se dice sobre este tema para poder construir una comprensión más matizada del estado actual (y futuro) del escalado de grandes modelos lingüísticos.

¿Qué nos dice la ley de la escala?En primer lugar, debemos repasar la definición técnica de la ley del tamaño. La ley del tamaño define la relación entre el cálculo de entrenamiento (o tamaño del modelo/conjunto de datos) y la pérdida en la prueba de un modelo lingüístico grande según una ley de potencia. Sin embargo, laA menudo se malinterpreta la naturaleza de esta relación. La idea de obtener ganancias exponenciales de rendimiento a partir del crecimiento logarítmico de la computación es un mito. La ley de la escala se parece más a un decaimiento exponencial, lo que significa que con el tiempo tendremos que esforzarnos más para obtener mayores ganancias de rendimiento; véase más adelante.

(Fuente [5])

"Los profesionales suelen utilizar la precisión de referencia descendente como indicador de la calidad del modelo, en lugar de la pérdida en el conjunto de evaluación de la perplejidad". - Fuente [7]

Definir el rendimiento.¿Cómo medimos si el Big Language Model está mejorando? Desde la perspectiva de la ley de escala, el rendimiento de un modelo lingüístico grande suele medirse por la pérdida de prueba del modelo durante el preentrenamiento, pero el efecto de una pérdida de prueba menor en la capacidad de un modelo lingüístico grande no está claro.¿Producen las menores pérdidas una mayor precisión en las tareas posteriores? ¿Las menores pérdidas darán lugar a nuevas capacidades para los grandes modelos lingüísticos? Existe una desconexión entre lo que nos dice la ley de la escala y lo que realmente nos importa:

- La ley del tamaño nos dice que aumentar el tamaño del preentrenamiento reducirá suavemente la pérdida en las pruebas de los modelos lingüísticos grandes.

- Nuestra preocupación es obtener un modelo "mejor" de la lengua mayor.

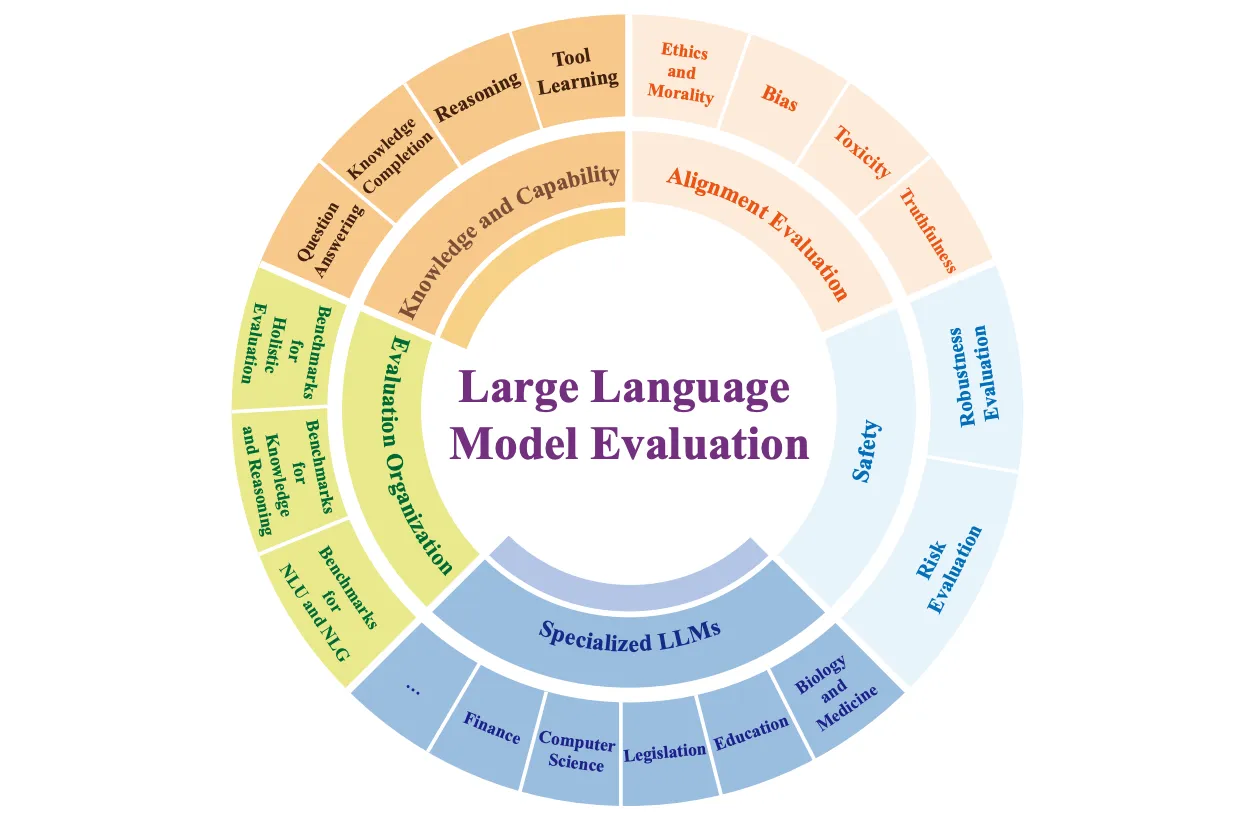

Dependiendo de quién seas y de lo que esperes de un nuevo sistema de IA...y los métodos que utilizó para evaluar estos nuevos sistemas-serán muy diferentes. Los usuarios normales de IA tienden a centrarse en aplicaciones de chat de uso general, mientras que los profesionales suelen preocuparse por el rendimiento de los grandes modelos lingüísticos en tareas posteriores. En cambio, los investigadores de los laboratorios punteros parecen tener grandes expectativas (y muy concretas) respecto a los sistemas de IA; por ejemplo, escribir tesis doctorales o resolver problemas avanzados de razonamiento matemático. Dada la amplia gama de capacidades difíciles de evaluar, hay muchas formas de analizar el rendimiento de los grandes modelos lingüísticos; véase más abajo.

(Fuente [15])

Desaparición de datos.Para ampliar el preentrenamiento de modelos lingüísticos de gran tamaño, debemos aumentar tanto el tamaño del modelo como el del conjunto de datos. Las primeras investigaciones [1] parecen sugerir que la cantidad de datos es menos importante que el tamaño del modelo, pero en Chinchilla [6] vemos que el tamaño del conjunto de datos es igualmente importante. Además, trabajos recientes sugieren que la mayoría de los investigadores prefieren "sobreentrenar" sus modelos.o preentrenarlos en conjuntos de datos cuyo tamaño supere la optimalidad de Chinchilla-para ahorrar costes de inferencia [7].

"Los estudios de escalado suelen centrarse en calcular los mecanismos de entrenamiento óptimos ...... Dado que los modelos más grandes son más caros de razonar, hoy en día es práctica común sobreentrenar los modelos más pequeños." - Fuente [7]

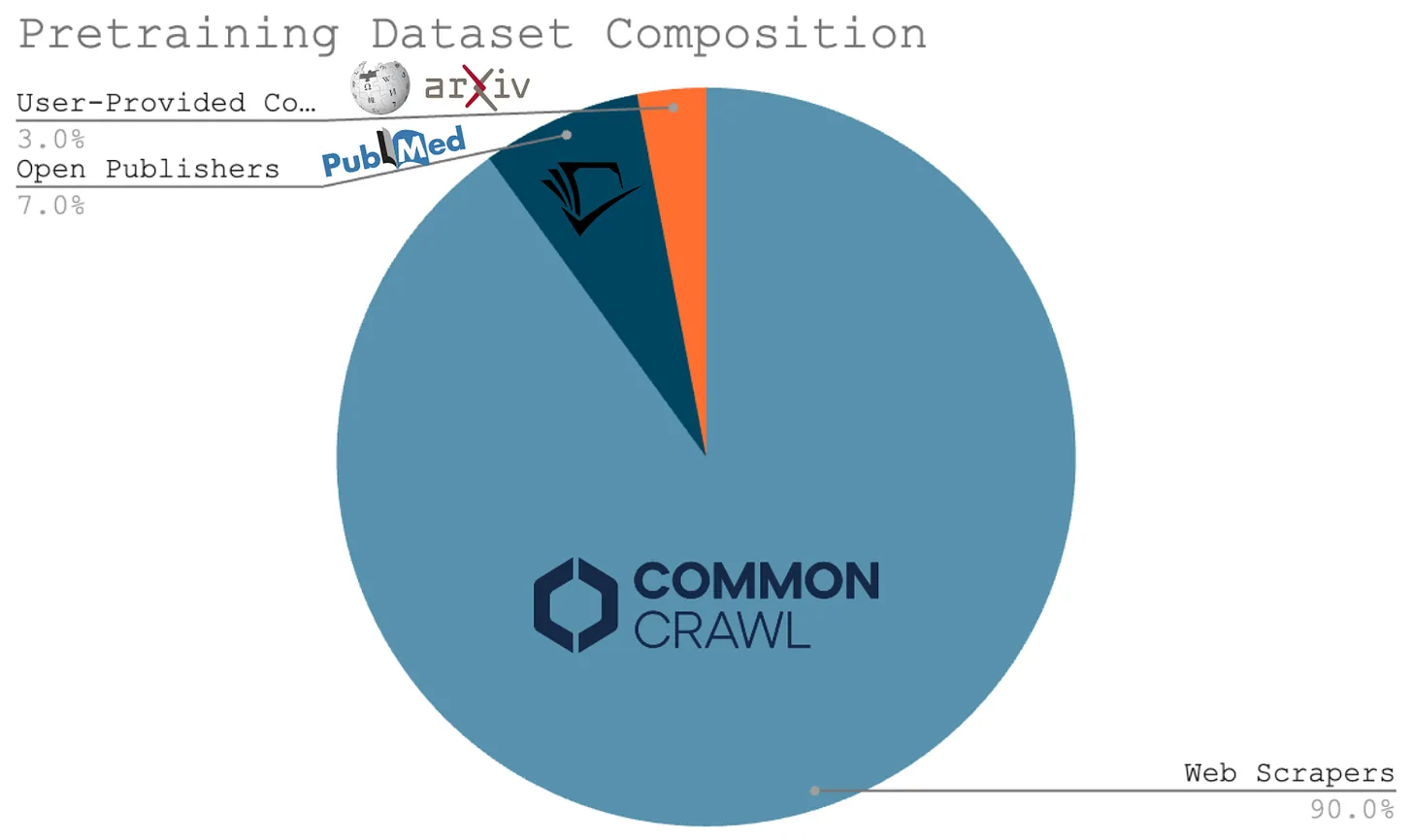

Todos estos estudios nos llevan a una sencilla conclusión: laAmpliar el preentrenamiento de grandes modelos lingüísticos nos obligará a crear conjuntos de datos de preentrenamiento más grandesEste hecho constituye una de las principales críticas a la ley del tamaño para grandes modelos lingüísticos. Este hecho constituye una de las principales críticas a la ley del tamaño para grandes modelos lingüísticos. Muchos investigadores han argumentado que quizá no haya datos suficientes para seguir escalando el proceso de preentrenamiento. A modo de antecedente, la gran mayoría de los datos de preentrenamiento utilizados para el Big Language Model actual se obtuvieron mediante rastreo web; véase más adelante. Dado que sólo disponemos de Internet, puede resultar difícil encontrar fuentes completamente nuevas de datos de preentrenamiento a gran escala y de alta calidad.

Incluso Ilya Sutskever ha esgrimido recientemente este argumento, afirmando que i) La informática crece rápidamente, pero ii) Los datos no han crecido debido a la dependencia del rastreo web. Como resultado, argumenta que no podemos seguir ampliando el proceso de preentrenamiento para siempre. El preentrenamiento tal y como lo conocemos llegará a su fin, y debemos encontrar nuevas vías para que progrese la investigación en IA. Dicho de otro modo."Hemos alcanzado el pico de datos"..

Escala de preentrenamiento de nueva generación

Con el tiempo, el escalado tendrá un rendimiento decreciente, y los argumentos centrados en los datos contra el escalado continuado son razonables y convincentes. Sin embargo, todavía hay varias líneas de investigación que podrían mejorar el proceso de preentrenamiento.

Datos sintéticos.Para ampliar el proceso de preentrenamiento en varios órdenes de magnitud, es posible que necesitemos recurrir a datos generados sintéticamente. A pesar de la preocupación de que una dependencia excesiva de los datos sintéticos pueda provocar problemas de diversidad [14], cada vez vemos más modelos lingüísticos de gran tamaño.Y parece que lo ha conseguido--utilizando datos sintéticos [12]. Además, el aprendizaje de curso [13] y las estrategias de preentrenamiento continuo han dado lugar a varias mejoras significativas ajustando los datos de preentrenamiento; por ejemplo, cambiando la mezcla de datos o añadiendo datos de instrucción al final del preentrenamiento.

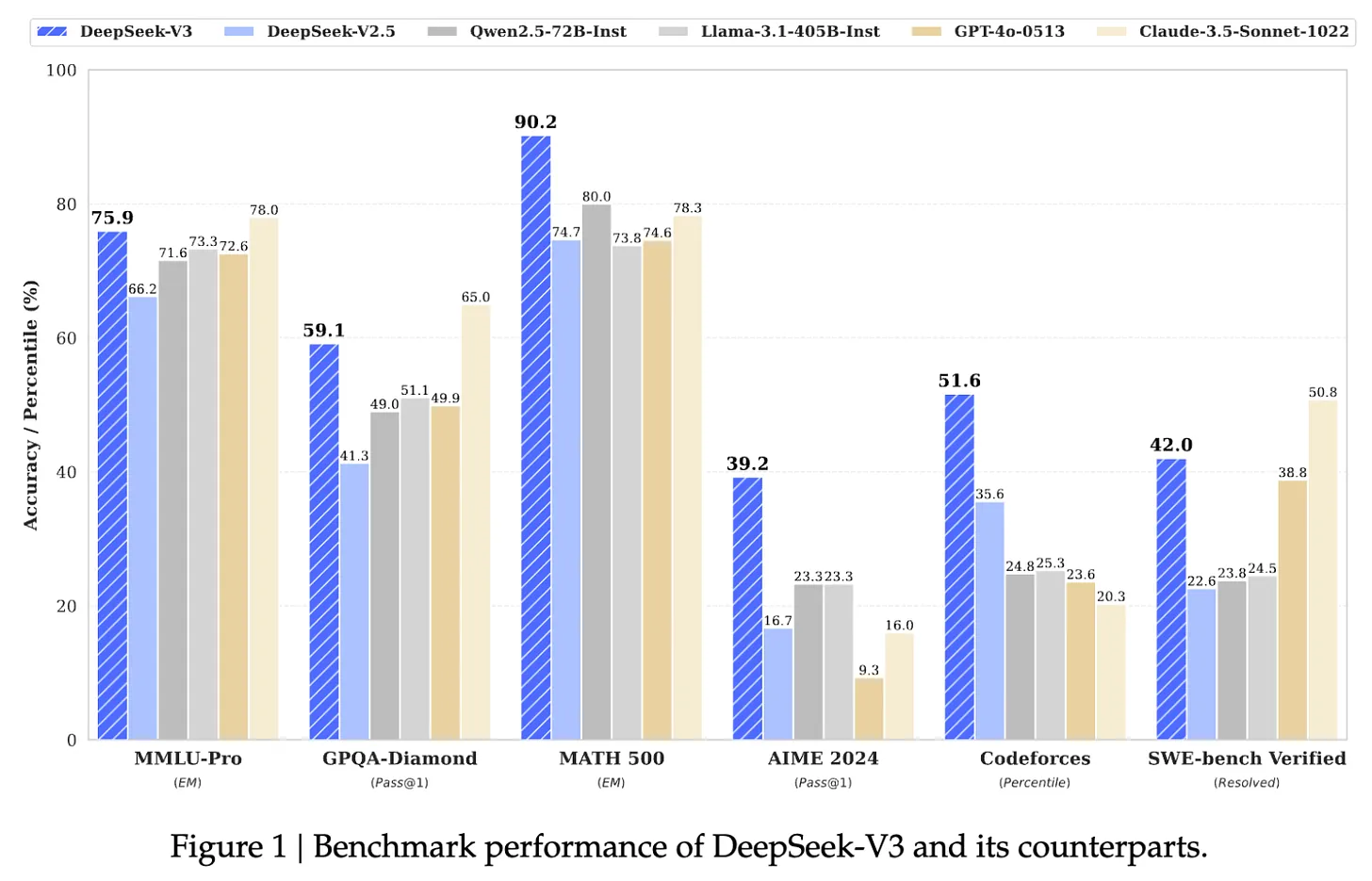

(Fuente [7])

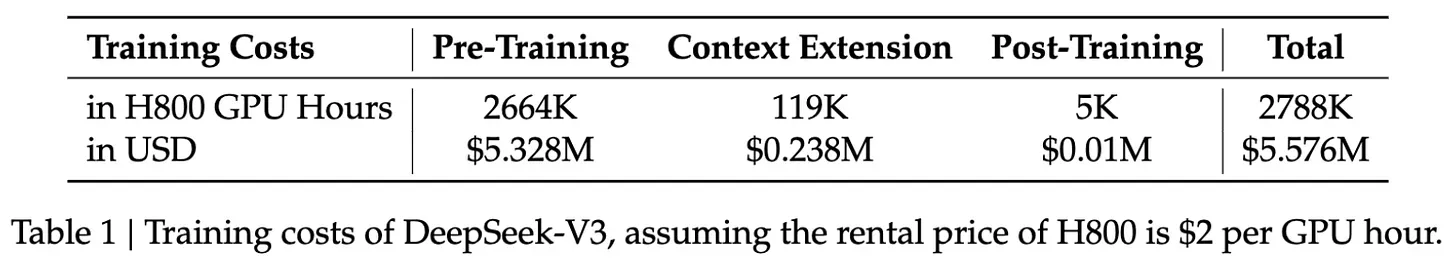

DeepSeek-v3.A pesar de los recientes debates, seguimos viendo avances semiprecuentes al ampliar el proceso de preentrenamiento para grandes modelos lingüísticos. Por ejemplo, el reciente lanzamiento de DeepSeek-v3 [18] -- elUn parámetro de 671.000 millones12 (MoE) modelo. Además de ser de código abierto, el modelo se entrenó previamente con 14,8 billones de textos Token y superó tanto a GPT-4o como a Claude-3.5-Sonnet; véase la figura siguiente para conocer el rendimiento del modelo y aquí para obtener la licencia. Como referencia, el modelo LLaMA-3 se entrenó con más de 15 billones de datos de texto en bruto; para más detalles, consulte aquí.

(Fuente [18])

- Arquitectura MoE optimizada de DeepSeek-v2.

- Una nueva estrategia de pérdida sin ayuda para equilibrar la carga de ME.

- Predicción multitarea de objetivos de formación.

- Perfeccionamiento de las capacidades de razonamiento a partir de modelos de cadenas de pensamiento largas (es decir, similares al o1 de OpenAI).

El modelo también se sometió a un postentrenamiento, que incluyó el ajuste fino supervisado y el aprendizaje por refuerzo a partir de los comentarios humanos para alinearlo con las preferencias humanas.

"Entrenamos DeepSeek-V3 en 14,8 billones de tokens de alta calidad y diversidad. el proceso de preentrenamiento fue muy estable. No experimentamos ningún pico de pérdida irrecuperable ni tuvimos que retroceder a lo largo del proceso de entrenamiento." - Fuente [8]

Sin embargo, la mayor clave del impresionante rendimiento de DeepSeek-v3 es la escala de preentrenamiento: elSe trata de un gran modelo entrenado en un conjunto de datos igualmente grande¡DeepSeek-v3 tiene un proceso de preentrenamiento asombrosamente estable y sigue el estándar de modelos lingüísticos grandes a un coste muy bajo! Entrenar un modelo tan grande es difícil por varias razones (por ejemplo, fallos de la GPU y picos de pérdidas.) DeepSeek-v3 tiene un proceso de preentrenamiento asombrosamente estable y se entrena a un coste razonable según el estándar de modelos lingüísticos grandes; véase más abajo.Estos resultados sugieren que las operaciones de preentrenamiento a mayor escala se vuelven más manejables y eficientes con el tiempo.

(Fuente [18])

- Clusters informáticos más grandes13.

- Más (y mejor) hardware.

- Mucha potencia.

- nuevos algoritmos (por ejemplo, para la formación distribuida a mayor escala,).

Entrenar modelos de última generación no es sólo cuestión de conseguir financiación para más GPU: es una proeza de ingeniería multidisciplinar. Una empresa tan compleja requiere tiempo. A modo de referencia, la GPT-4 se publicó en marzo de 2023, casi tres años después de la GPT-3, elEn concreto, 33 mesesEs razonable esperar un plazo similar (si no más largo) para desbloquear otro aumento de 10-100x. Es razonable esperar un plazo similar (si no más largo) para desbloquear otro aumento de escala de 10-100x.

"En cada orden de magnitud de crecimiento de escala, hay que encontrar diferentes innovaciones". - Ege Erdil (Época AI)

El futuro de la investigación en IA

Ahora que conocemos en profundidad el estado del preentrenamiento a escala, supongamos (a efectos meramente de este debate) que la investigación en preentrenamiento se topa de repente con un muro. Aunque las capacidades de los modelos no mejoren en absoluto en un futuro próximo, hay varias formas de que la investigación en IA siga evolucionando rápidamente. Ya hemos tratado algunos de estos temas (por ejemplo, los datos sintéticos). En esta sección, nos centraremos en dos temas actualmente populares:

- Sistema/agente de grandes modelos lingüísticos.

- Modelos de razonamiento.

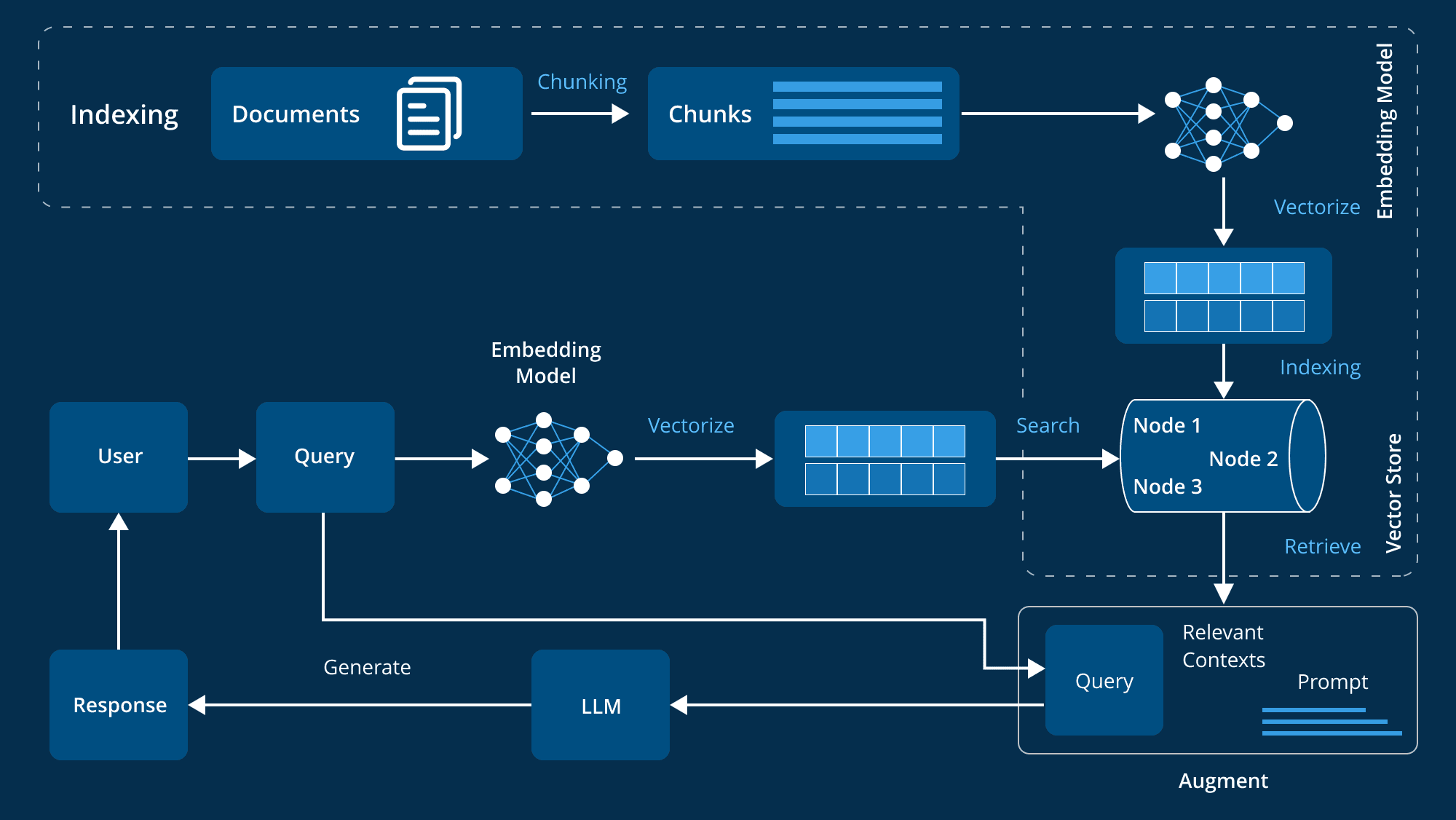

Construir un sistema útil de modelización de grandes lenguajes

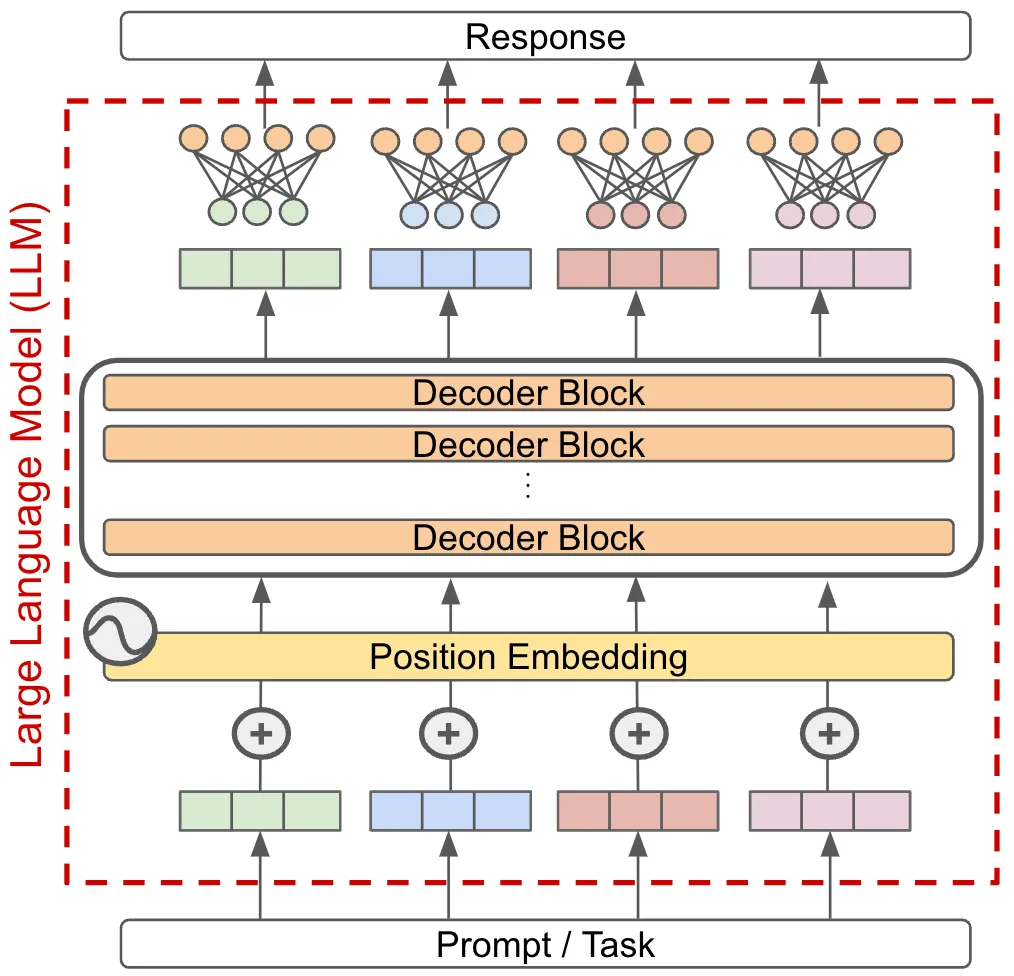

La mayoría de las aplicaciones actuales basadas en Big Language Models se ejecutan en un paradigma de modelo único. En otras palabras, resolvemos una tarea pasándola a un único Big Language Model y utilizando directamente el resultado del modelo como respuesta a dicha tarea; véase más adelante.

Si quisiéramos mejorar un sistema de este tipo (es decir, resolver tareas más difíciles con mayor precisión), podríamos simplemente mejorar las capacidades del modelo subyacente, pero este enfoque se basa en crear modelos más potentes. En cambio, podemos superar el paradigma del modelo único construyendo un sistema basado en un modelo de gran lenguaje que combine varios modelos de gran lenguaje -elu otro componente-- para resolver tareas complejas.

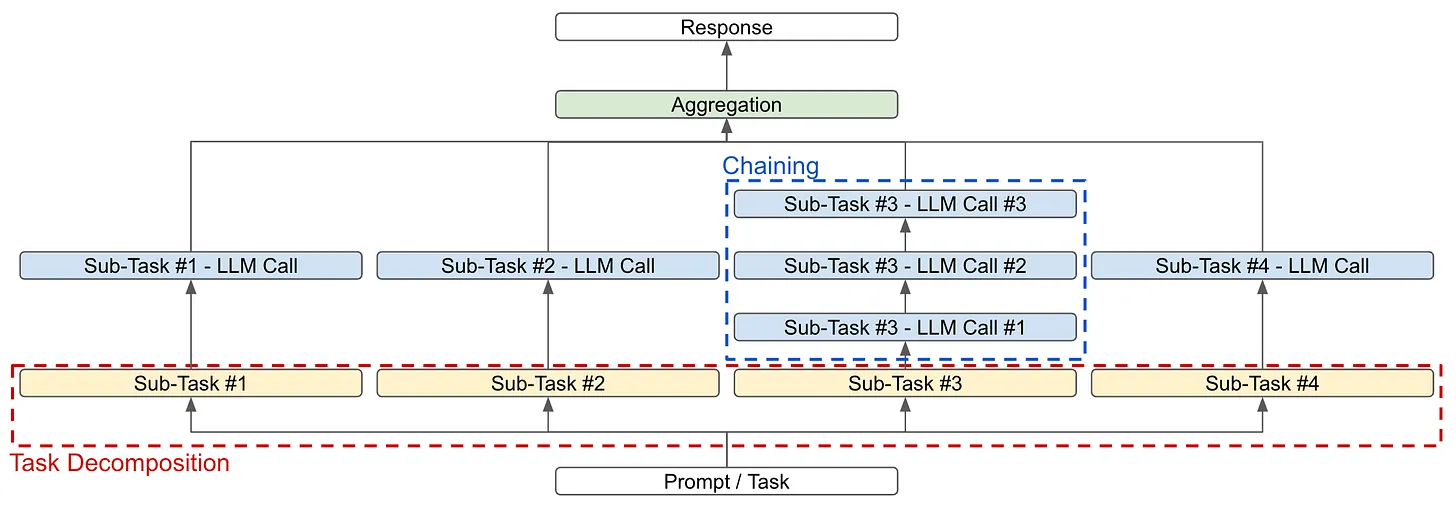

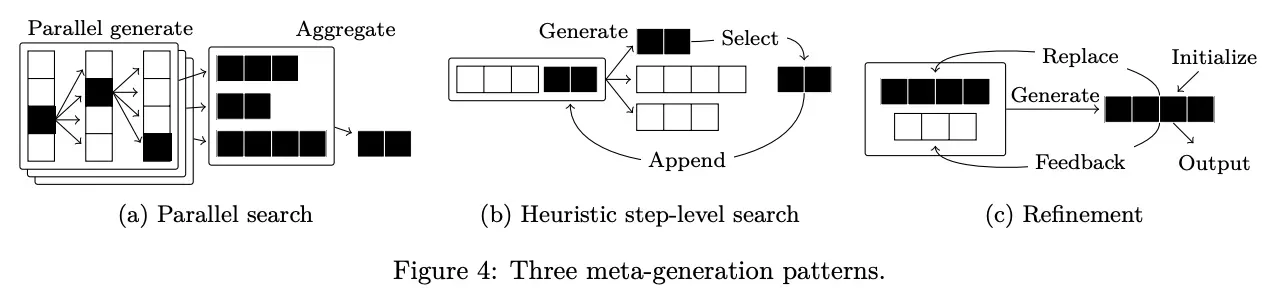

Fundamentos del sistema de modelización de grandes lenguajes. El objetivo de un sistema Big Language Model es descomponer tareas complejas en partes más pequeñas que puedan ser resueltas más fácilmente por el Big Language Model u otros módulos. Hay dos estrategias principales que se pueden utilizar para lograr este objetivo (como se muestra en la figura anterior):

- Desglose de tareasDesglose la tarea en subtareas más pequeñas que puedan resolverse individualmente y agregarse posteriormente14 para formar la respuesta final.

- enlace (en un sitio web): Resuelve tareas o subtareas realizando múltiples llamadas secuenciales al gran modelo de lenguaje en lugar de una única llamada.

Estas estrategias pueden utilizarse por separado o en tándem. Por ejemplo, supongamos que queremos crear un sistema para resumir libros. Para ello, podemos dividir la tarea resumiendo primero cada capítulo del libro. A partir de ahí, podemos

- Resumir la tarea dividiéndola en trozos de texto más pequeños (es decir, de forma similar a la descomposición recursiva/jerárquica).

- Vincule varias llamadas LM; por ejemplo, haga que una LM extraiga todos los hechos o información importantes de un capítulo y que otra LM genere un resumen del capítulo basado en esos hechos clave.

A continuación, podemos agregar estos resultados haciendo que el Big Language Model resuma los resúmenes de los capítulos conectados para formar un resumen de toda la novela. El hecho de que la mayoría de las tareas complejas puedan descomponerse en partes sencillas y fáciles de resolver hace que estos grandes sistemas de modelización lingüística sean muy potentes. A medida que realizamos una descomposición y vinculación más extensas, estos sistemas pueden llegar a ser muy complejos, lo que los convierte en un área interesante (e influyente) de la investigación aplicada de la IA.

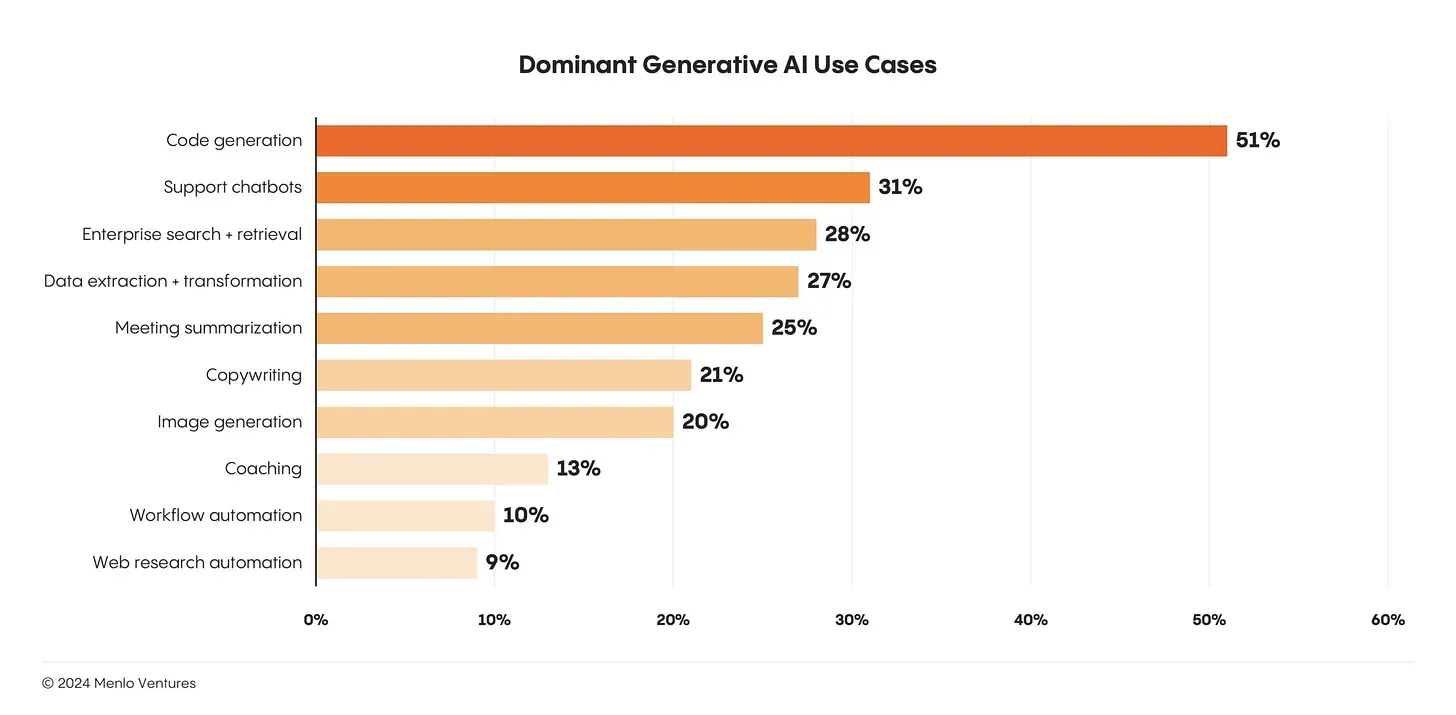

Creación de productos basados en el modelo Big Language.A pesar del éxito y la popularidad del Big Language Model, el número de casos de uso reales (y ampliamente adoptados) del Big Language Model sigue siendo muy reducido. En la actualidad, los mayores casos de uso del Big Language Model son la generación de código y el chat, aplicaciones ambas relativamente obvias del Big Language Model15 ; véase más adelante.

Dado que son tantos los ámbitos de aplicación de la modelización de grandes lenguas.La creación de productos realmente útiles basados en grandes modelos lingüísticos es un área importante de la investigación aplicada a la IA.. Ya disponemos de modelos muy potentes, pero utilizarlos para crear productos que merezcan la pena es un problema totalmente distinto. Para resolverlo, hay que aprender a construir grandes sistemas de modelización lingüística fiables y potentes.

(Fuente [19])

robustezes uno de los mayores obstáculos para construir Big Language Models/sistemas de agentes más potentes. Supongamos que tenemos un sistema Big Language Model que realiza diez llamadas diferentes al Big Language Model. Además, supongamos que cada llamada al Big Language Model tiene una probabilidad de éxito de 95%, y que todas las llamadas deben tener éxito para generar el resultado final correcto. Aunque los componentes individuales del sistema son razonablemente precisos, elSin embargo, la tasa de éxito de todo el sistema es de sólo 60%¡!

(Fuente [20])

(Fuente [20])

Modelos de razonamiento y nuevos paradigmas de escalado

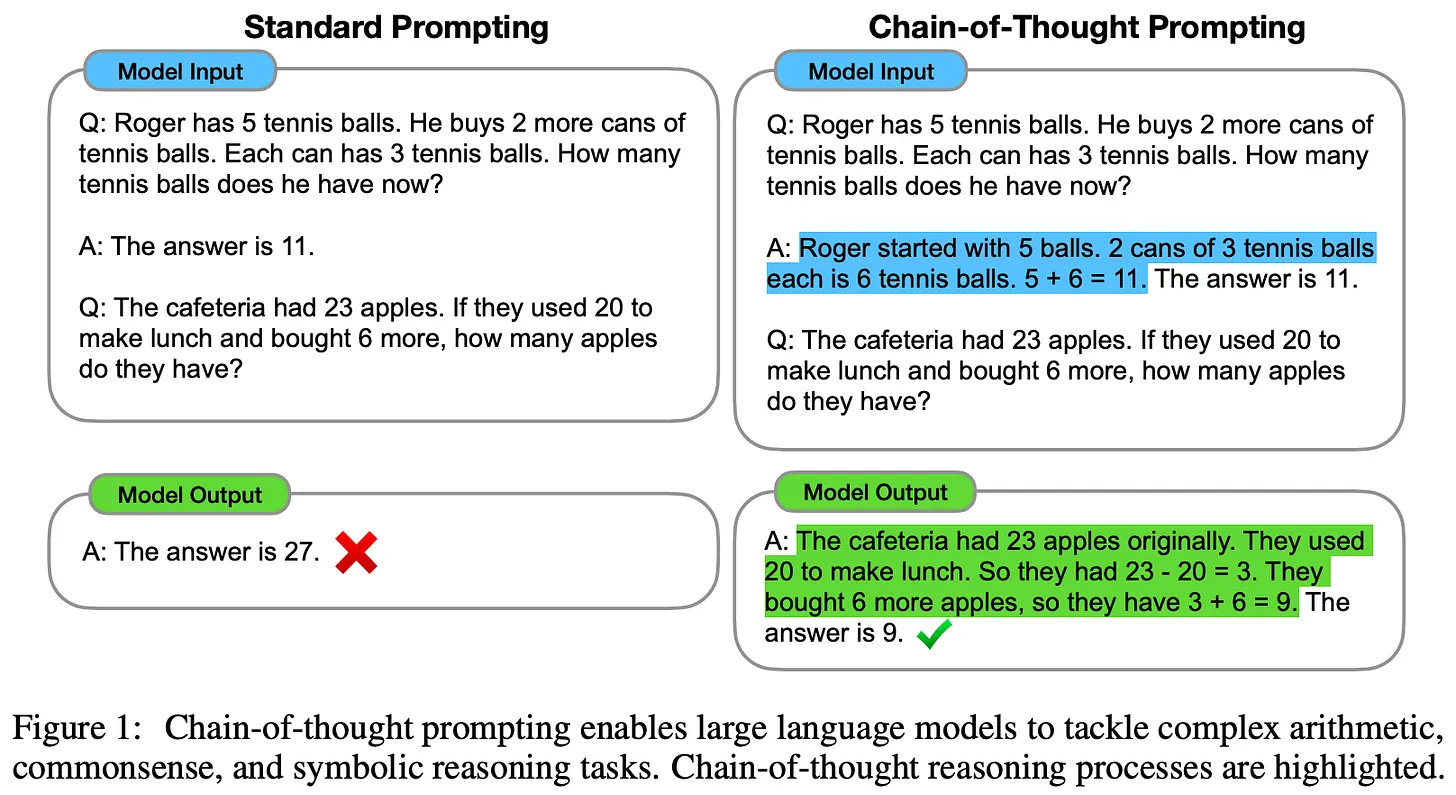

Una crítica común a los primeros grandes modelos lingüísticos era que se limitaban a memorizar datos y tenían poca capacidad de razonamiento. Sin embargo, la afirmación de que los grandes modelos lingüísticos son incapaces de razonar ha quedado ampliamente desmentida en los últimos años. Gracias a investigaciones recientes, sabemos que es posible que estos modelos siempre hayan tenido una capacidad inherente de razonamiento, pero que hemos tenido que utilizar las pistas o los métodos de entrenamiento adecuados para obtener esta capacidad.

Consejos para la Cadena de Pensamiento (CdT) [22] fue una de las primeras técnicas en demostrar las capacidades de inferencia de un gran modelo lingüístico. El método es sencillo y se basa en pistas. Simplemente pedimos al Big Language Model que proporcione una explicación de su respuesta antes de generar la respuesta real; véase aquí para más detalles. La capacidad de razonamiento del Big Language Model mejora significativamente cuando genera una explicación que resume el proceso paso a paso utilizado para llegar a una respuesta. Además, estas explicaciones son legibles y pueden hacer que el resultado del modelo sea más interpretable.

(Fuente [22])

- Class Large Language Models - Judge Evaluation Los modelos suelen proporcionar la base para la puntuación antes de generar los resultados finales de la evaluación [23, 24].

- Se han propuesto estrategias de ajuste fino supervisado y de ajuste de instrucciones para enseñar a los modelos de lenguaje grandes más pequeños/abiertos a escribir mejores cadenas de pensamiento [25, 26].

- A menudo se pide a los grandes modelos lingüísticos que reflexionen sobre sus propios resultados y los comenten o validen, para después modificar sus resultados basándose en esta información [12, 27].

El razonamiento complejo es un tema de investigación activo y en rápida evolución. Los nuevos algoritmos de entrenamiento que enseñan a los grandes modelos lingüísticos a incorporar la verificación (a nivel de pasos) [28, 29] en su proceso de razonamiento han mostrado resultados prometedores, y probablemente seguiremos viendo mejoras a medida que se disponga de nuevas y mejores estrategias de entrenamiento.

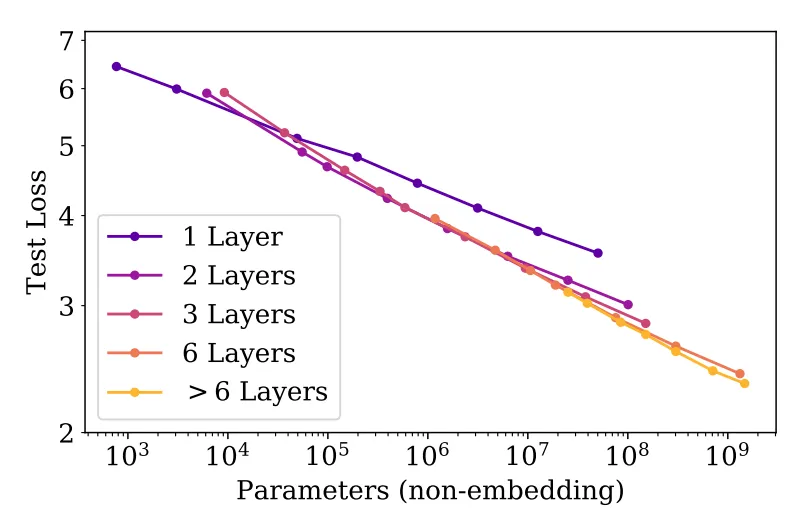

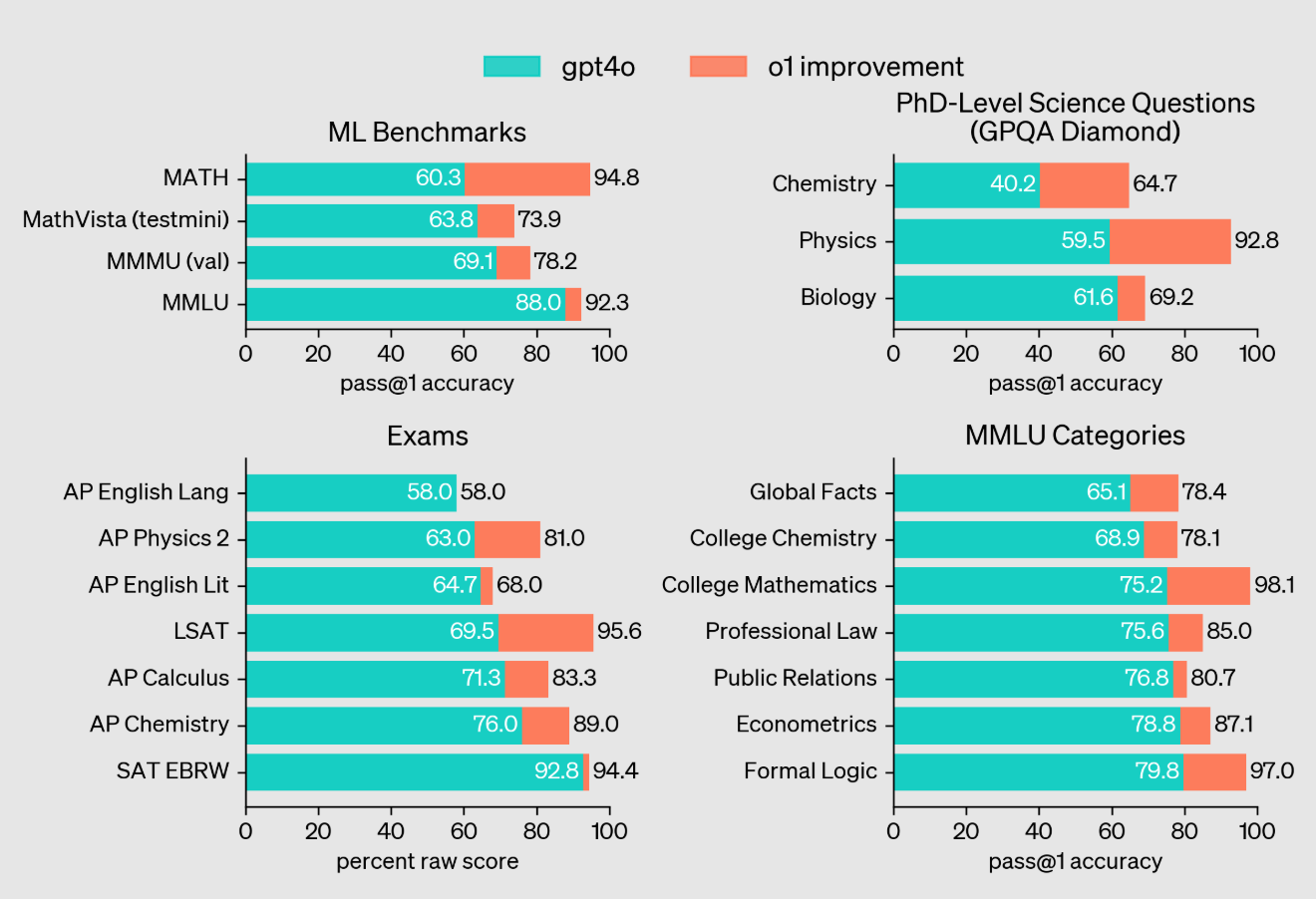

Modelo de inferencia o1 de OpenAI [21] marca un importante salto adelante en las capacidades de razonamiento del Big Language Model. o1 utiliza estrategias de razonamiento que se basan en gran medida en cadenas de pensamiento. Al igual que los humanos piensan antes de responder a una pregunta, o1 se toma su tiempo para "pensar" antes de dar una respuesta. De hecho, el "pensamiento" que genera o1 es simplemente una larga cadena de pensamientos que el modelo utiliza para pensar sobre el problema, descomponerlo en pasos más sencillos, probar varios enfoques para resolver el problema e incluso corregir sus propios errores16.

"OpenAI o1 [es] un nuevo modelo lingüístico a gran escala entrenado para realizar razonamientos complejos utilizando el aprendizaje por refuerzo. o1 piensa antes de responder: puede generar una larga cadena interna de pensamiento antes de responder al usuario." - Fuente [21]

Los detalles de la estrategia exacta de entrenamiento de o1 no se han hecho públicos. Sin embargo, sabemos que o1 aprende a razonar utilizando un algoritmo de "aprendizaje por refuerzo a gran escala" que "hace un uso muy eficiente de los datos" y se centra en mejorar la capacidad del modelo para generar cadenas de pensamiento útiles. A juzgar por los comentarios públicos de los investigadores de OpenAI y las recientes declaraciones sobre o1, parece que el modelo se entrenó mediante aprendizaje por refuerzo puro, lo que contradice las sugerencias anteriores de que o1 podría haber utilizado alguna forma de búsqueda de árboles en su razonamiento.

Comparación de GPT-4o y o1 en tareas de inferencia intensiva (Fuente [21])

- Top 89% en Problemas de Programación Competitiva en Codeforces.

- Colocación entre los 500 mejores estudiantes de Estados Unidos en las rondas clasificatorias de la Olimpiada Matemática Americana (AIME).

- Supera la precisión de los estudiantes de doctorado humanos en las preguntas de Física, Biología y Química a nivel de posgrado (GPQA).

(Fuente [22])

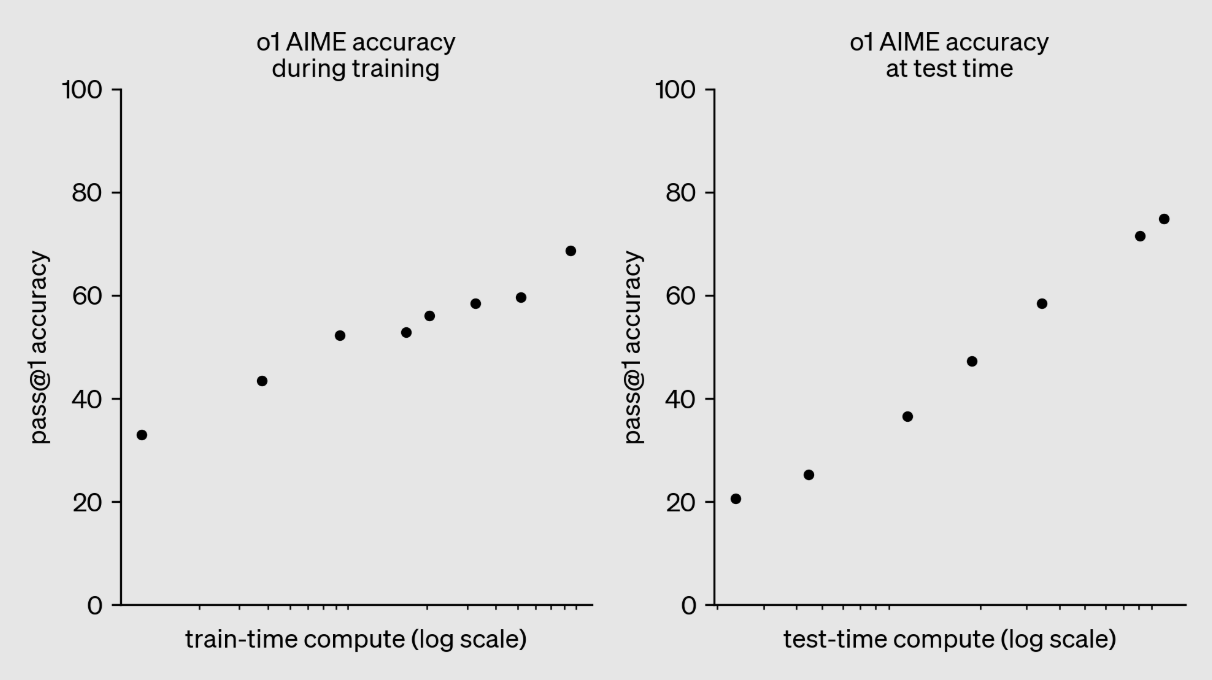

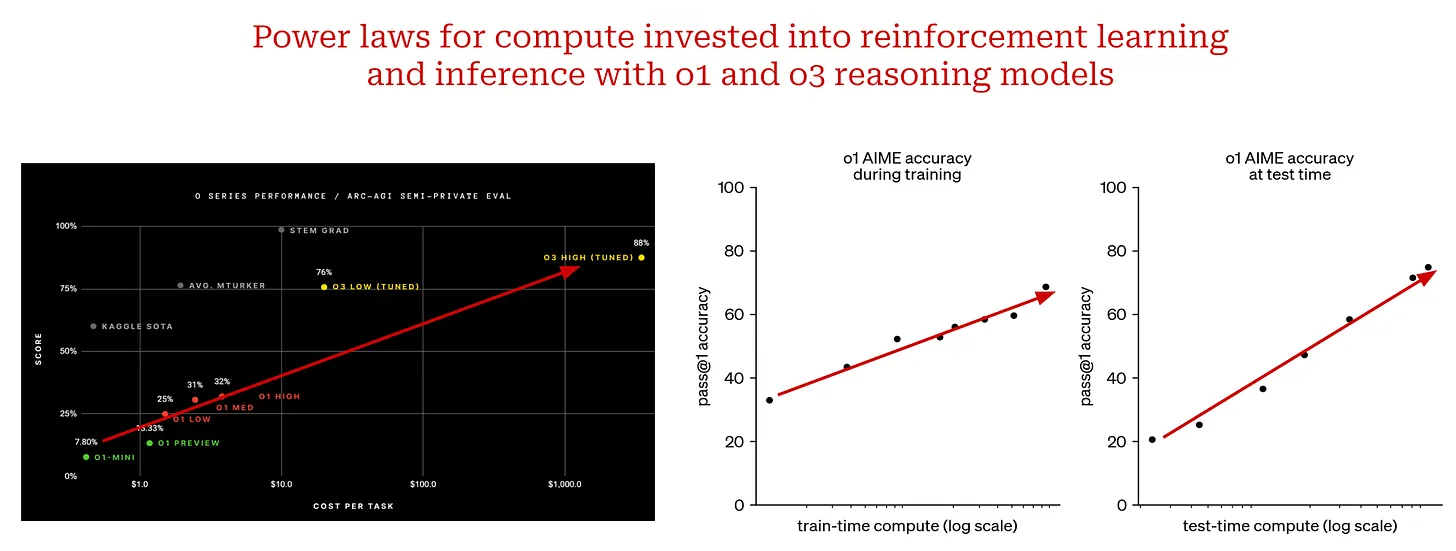

"Descubrimos que el rendimiento de o1 seguía mejorando con más aprendizaje por refuerzo (computado durante el entrenamiento) y más tiempo de pensamiento (computado durante las pruebas)." - Fuente [22]

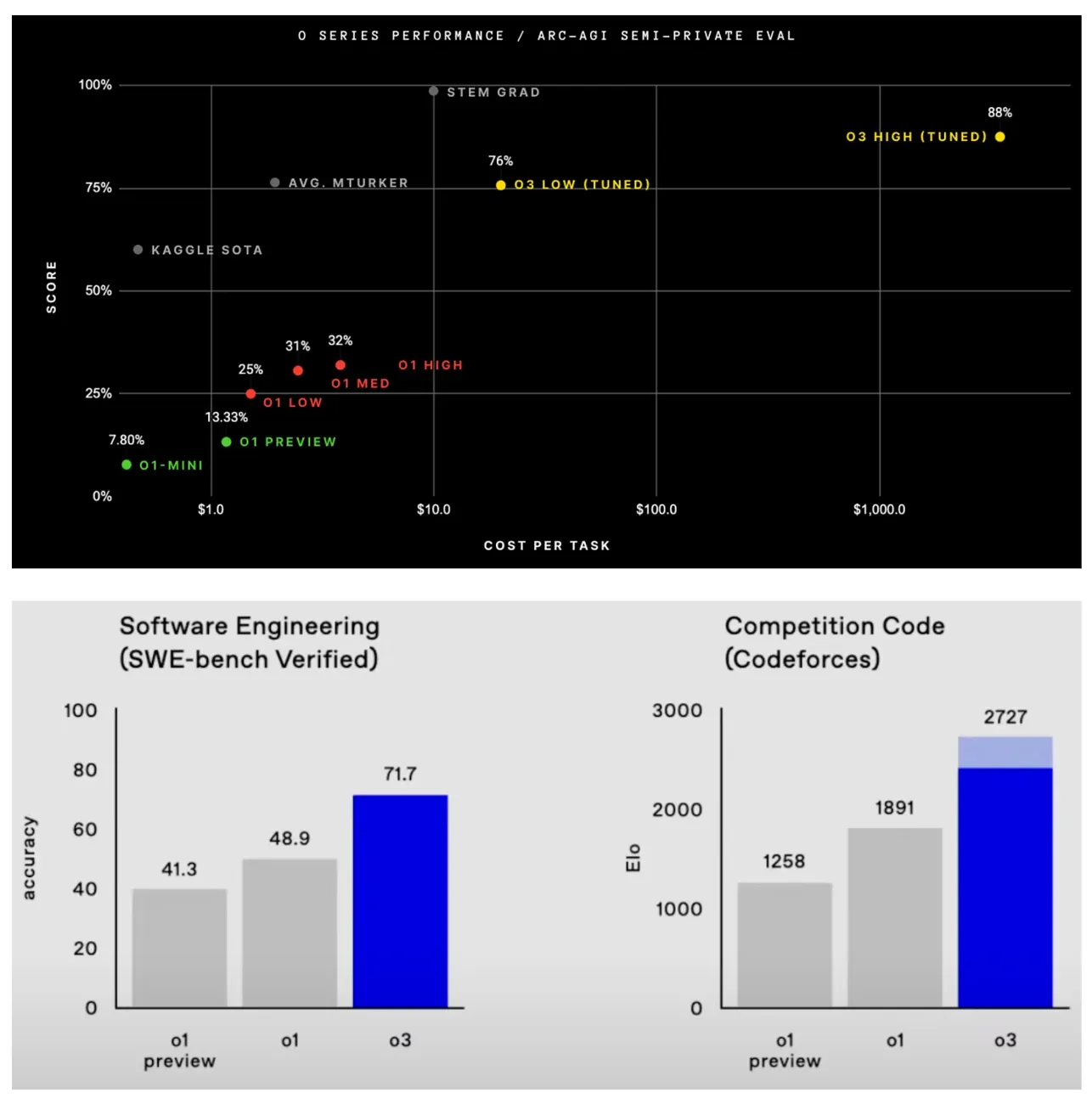

Del mismo modo, vemos en el gráfico anterior que el rendimiento de o1 mejora suavemente a medida que invertimos más computación en el entrenamiento a través del aprendizaje por refuerzo. Este es exactamente el enfoque seguido para crear el modelo de inferencia o3. El modelo ha sido evaluado por OpenAI a finales de 2024 y se han compartido públicamente muy pocos detalles sobre o3. Sin embargo, dado que el modelo se lanzó tan rápidamente después de o1 (es decir, tres meses más tarde), es probable que o3 sea una versión "ampliada" de o1, con más computación invertida en el aprendizaje por refuerzo.

En el momento de escribir estas líneas, el modelo o3 aún no ha salido al mercado, pero los resultados obtenidos con la ampliación de o1 son impresionantes (y en algunos casos chocantes). A continuación se enumeran los logros más notables de o3:

- obtuvo una puntuación de 87,5% en la prueba ARC-AGI, frente a la precisión de 5% de GPT-4o. o3 fue el primer modelo en superar los 85% de rendimiento a nivel humano en ARC-AGI. Esta prueba ha sido descrita como la "Estrella del Norte" de AGI y ha permanecido invicta durante más de cinco años17 .

- Una precisión de 71,7% en SWE-Bench Verified y una puntuación Elo de 2727 en Codeforces sitúan a o3 entre los 200 mejores programadores humanos competitivos del mundo.

- con una precisión de 25,2% en la prueba FrontierMath de EpochAI.Precisión del estado del arte mejorada con respecto al anterior 2.0%El punto de referencia fue descrito por Terence Tao como "extremadamente difícil" y probablemente irresoluble por sistemas de IA "durante al menos unos años". El punto de referencia fue descrito por Terence Tao como "extremadamente difícil" y probablemente irresoluble por sistemas de IA "durante al menos unos años".

También se ha presentado una versión lite de o3, llamada o3-mini, que funciona muy bien y ofrece mejoras significativas en eficiencia computacional.

(Fuente [21] y aquí están)

- Tiempo de formación (aprendizaje intensivo) Cálculo.

- Calcula al razonar.

El escalado de los modelos de estilo o1 difiere de la tradicional ley del tamaño. En lugar de ampliar el proceso de preentrenamiento, ampliamos la cantidad de cálculos dedicados al postentrenamiento y la inferencia.Se trata de un nuevo paradigma de escala.Hasta ahora, los resultados obtenidos con la ampliación del modelo de inferencia han sido muy buenos. Tal hallazgo sugiere que existen claramente otras vías de expansión más allá del preentrenamiento. Con la aparición de los modelos de inferencia, hemos descubierto la siguiente montaña que hay que escalar. Aunque puede adoptar distintas formas, laLa escala seguirá impulsando los avances en la investigación de la IA.

observaciones finales

Ahora tenemos una idea más clara de las leyes de escala, su impacto en los grandes modelos lingüísticos y la futura dirección de la investigación en IA. Como hemos aprendido, hay muchos factores que contribuyen a las recientes críticas a las leyes de escala:

- La decadencia natural de la ley de la escala.

- Las expectativas de competencia en la modelización de grandes lenguas variaban considerablemente.

- Retrasos en trabajos de ingeniería interdisciplinarios a gran escala.

Son preguntas legítimas quePero ninguno de ellos indica que el escalado siga sin funcionar como se esperaba. La inversión en preentrenamiento a gran escala continuará (y debería continuar), pero las mejoras serán cada vez más difíciles con el tiempo. En consecuencia, otras direcciones de desarrollo (por ejemplo, agentes e inferencia) cobrarán mayor importancia. Sin embargo, la idea básica del escalado seguirá desempeñando un papel enorme mientras invertimos en estas nuevas áreas de investigación. La cuestión no es si seguimos ampliando o no.La verdadera pregunta es qué vamos a ampliar a continuación.

bibliografía

[1] Kaplan, Jared, et al. "Scaling laws for neural language models". arXiv preprint arXiv:2001.08361 (2020).[2] Radford, Alec. "Mejora de la comprensión lingüística mediante preentrenamiento generativo" (2018).[3] Radford, Alec, et al. "Los modelos lingüísticos son aprendices multitarea no supervisados". Blog de OpenAI 1.8 (2019): 9.[4] Brown, Tom, et al. "Language models are few-shot learners". Avances en los sistemas de procesamiento neural de la información 33 (2020): 1877-1901.[5] Achiam, Josh, et al. "Informe técnico Gpt-4". arXiv preprint arXiv:2303.08774 (2023).[6] Hoffmann, Jordan, et al. "Training compute-optimal large language models". arXiv preprint arXiv:2203.15556 (2022).[7] Gadre, Samir Yitzhak, et al. "Language models scale reliably with over-training and on downstream tasks". arXiv preprint arXiv:2403.08540 (2024).[8] Ouyang, Long, et al. "Training language models to follow instructions with human feedback". Avances en los sistemas de procesamiento neural de la información 35 (2022): 27730-27744.[9] Smith, Shaden, et al. "Using deepspeed and megatron to train megatron-turing nlg 530b, a large-scale generative language model". arXiv preprint arXiv:2201.11990 (2022).[10] Rae, Jack W., et al. "Scaling language models: methods, analysis & insights from training gopher". arXiv preprint arXiv:2112.11446 (2021).[11] Bhagia, Akshita, et al. "Establishing Task Scaling Laws via Compute-Efficient Model Ladders". arXiv preprint arXiv:2412.04403 (2024).[12] Bai, Yuntao, et al. "Constitutional ai: Harmlessness from ai feedback". arXiv preprint arXiv:2212.08073 (2022).[13] Blakeney. Cody."¿Sus datos despiertan alegría? Aumento del rendimiento gracias al remuestreo de dominios al final del entrenamiento". arXiv preprint arXiv:2406.03476 (2024).[14] Chen, Hao, et al. "On the Diversity of Synthetic Data and its Impact on Training Large Language Models". arXiv preprint arXiv:2410.15226 (2024).[15] Guo, Zishan, et al. "Evaluating large language models: A comprehensive survey". arXiv preprint arXiv:2310.19736 (2023).[16] Xu, Zifei, et al. "Scaling laws for post-training quantized large language models". arXiv preprint arXiv:2410.12119 (2024).[17] Xiong, Yizhe, et al. "Temporal scaling law for large language models". arXiv preprint arXiv:2404.17785 (2024).[18] DeepSeek-AI et al. "Informe técnico DeepSeek-v3". https://github.com/deepseek-ai/DeepSeek-V3/blob/main/DeepSeek_V3.pdf (2024).[19] Schick, Timo, et al. "Toolformer: language models can teach themselves to use tools" arXiv preprint arXiv:2302.04761 (2023).[20] Welleck, Sean, et al. "From decoding to meta-generation: reference-time algorithms for large language models". arXiv preprint arXiv:2406.16838 (2024).[21] OpenAI et al. "Aprender a razonar con LLMs". https://openai.com/index/learning-to-reason-with-llms/ (2024).[22] Wei, Jason, et al. "Chain-of-thought prompting elicits reasoning in large language models". Avances en los sistemas de procesamiento neural de la información 35 (2022): 24824-24837.[23] Liu, Yang, et al. "G-eval: Nlg evaluation using gpt-4 with better human alignment". arXiv preprint arXiv:2303.16634 (2023).[24] Kim, Seungone, et al. "Prometheus: Inducing fine-grained evaluation capability in language models". Duodécima Conferencia Internacional sobre el Aprendizaje de Representaciones . 2023.[25] Ho, Namgyu, Laura Schmid y Se-Young Yun. "Los grandes modelos lingüísticos son maestros del razonamiento". arXiv preprint arXiv:2212.10071 (2022).[26] Kim, Seungone, et al. "The cot collection: improving zero-shot and few-shot learning of language models via chain-of-thought fine-tuning". arXiv preprint arXiv:2305.14045 (2023).[27] Weng, Yixuan, et al. "Large language models are better reasoners with self-verification". arXiv preprint arXiv:2212.09561 (2022).[28] Lightman, Hunter, et al. "Verifiquemos paso a paso". arXiv preprint arXiv:2305.20050 (2023).[29] Zhang, Lunjun, et al. "Generative verifiers: reward modelling as next-token prediction". arXiv preprint arXiv:2408.15240 (2024).1 Los dos informes principales proceden de The Information y Reuters.

2 Generamos el dibujo utilizando la siguiente configuración:a = 1(matemáticas) génerop = 0.5paz 0 < x < 1.

3 Los cálculos se definen en [1] como 6NBSque N es el número de parámetros del modelo queB es el tamaño del lote utilizado durante el entrenamiento.S es el número total de pasos de entrenamiento.

4 Esta constante de multiplicación adicional no cambia el comportamiento de la ley de potencia. Para entender por qué es así, debemos comprender la definición de invariancia de escala. Dado que las leyes de potencia son invariantes de escala, las características básicas de una ley de potencia son las mismas aunque la ampliemos o reduzcamos en algún factor. El comportamiento observado es el mismo a cualquier escala.

5 Esta descripción procede del Premio Test of Time que Ilya recibió por este trabajo en NeurIPS'24.

6 Aunque esto pueda parecer obvio ahora, hay que tener en cuenta que, por aquel entonces, la mayoría de las tareas de la PNL (por ejemplo, el resumen y las preguntas y respuestas) ¡tenían dominios de investigación dedicados a ellas! Cada una de estas tareas tenía asociadas arquitecturas específicas dedicadas a su realización, y la GPT era un único modelo genérico que podía superar a la mayoría de estas arquitecturas en múltiples tareas diferentes.

7 Esto significa que simplemente describimos cada tarea en las indicaciones del gran modelo lingüístico y utilizamos el mismo modelo para resolver las diferentes tareas - elSólo cambian los avisos entre tareas.

8 Esto es de esperar, ya que estos modelos utilizan la inferencia de muestra cero y no se ajustan a ninguna tarea posterior en absoluto.

9 Por capacidades "emergentes" entendemos habilidades que sólo están disponibles para los grandes modelos lingüísticos una vez que alcanzan cierto tamaño (por ejemplo, un modelo suficientemente grande).

10 Aquí, definimos "computacionalmente óptimo" como la configuración de entrenamiento que produce el mejor rendimiento (en términos de pérdida en la prueba) con un coste computacional de entrenamiento fijo.

11 Por ejemplo, Anthropic sigue retrasando su lanzamiento. Claude 3.5 Opus, Google sólo ha lanzado una versión flash de Gemini-2, y OpenAI sólo ha lanzado GPT-4o en 2024 (hasta el lanzamiento de o1 y o3 en diciembre), que podría decirse que no es mucho más capaz que GPT-4.

12 Sólo 37.000 millones de parámetros están activos durante la inferencia de una única ficha.

13 Por ejemplo, xAI acaba de construir un nuevo centro de datos en Memphis con 100.000 GPU NVIDIA, y la dirección de Anthropic está multiplicando por 100 su gasto en computación en los próximos años.

14 La etapa de agregación puede realizarse de varias maneras. Por ejemplo, podemos agregar respuestas manualmente (por ejemplo, a través de una conexión), utilizando un gran modelo lingüístico, ¡o cualquier cosa intermedia!

15 Esto no se debe a que estas tareas sean sencillas. Tanto la generación de código como el chat son difíciles de resolver, pero son aplicaciones (discutiblemente) bastante obvias del Big Language Model.

16OpenAI ha optado por ocultar estas largas cadenas de pensamiento a los usuarios de o1. El argumento detrás de esta elección es que estos fundamentos proporcionan información sobre los procesos de pensamiento del modelo que se pueden utilizar para depurar o supervisar el modelo. Sin embargo, a los modelos se les debe permitir expresar sus pensamientos puros sin ninguno de los filtros de seguridad necesarios para la salida del modelo de cara al usuario.

17 En la actualidad, ARC-AGI permanece técnicamente invicto porque o3 supera los requisitos computacionales de la evaluación comparativa. Sin embargo, el modelo sigue alcanzando una precisión de 75,7% utilizando ajustes computacionales inferiores.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...