Lamentablemente, el informe técnico Kimi k1.5 publicado junto con DeepSeek-R1 mejora el contexto largo y la inferencia multimodal

Kimi k1.5 Informe técnico Lecturas rápidas

1. Potente razonamiento multimodal:

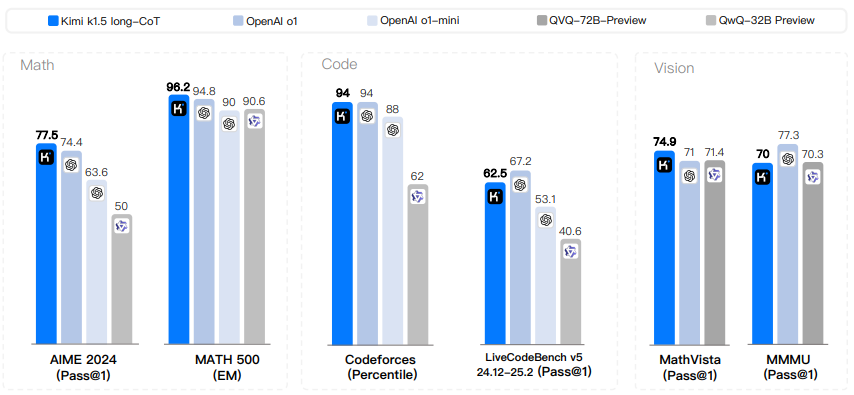

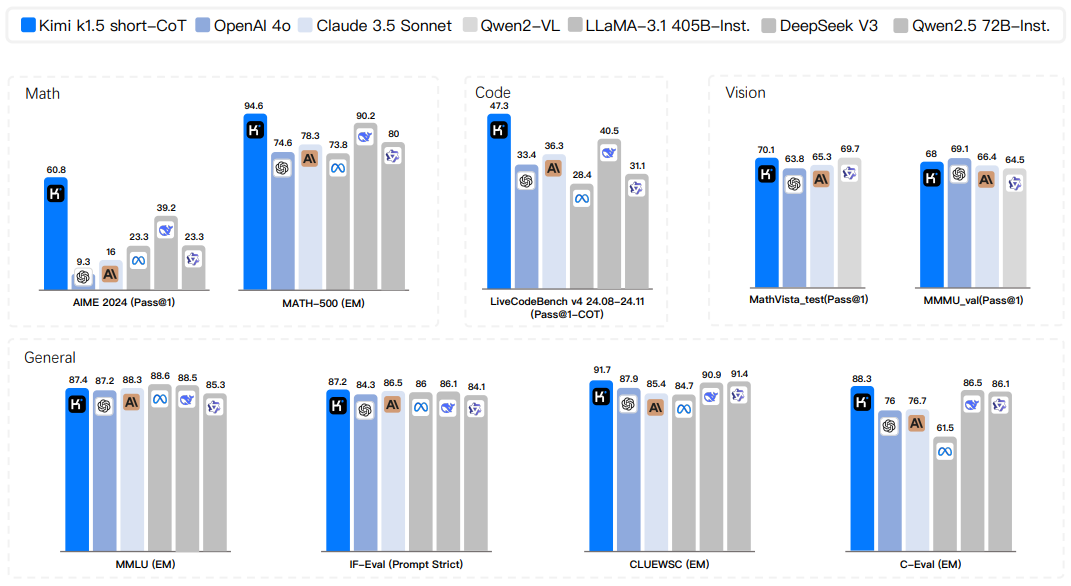

Kimi El modelo k1.5 alcanza el rendimiento de inferencia más avanzado en múltiples pruebas de referencia y modalidades, incluidas tareas de inferencia matemática, de código, textual y visual.

No sólo maneja texto plano, sino que también entiende combinaciones de imágenes y texto, lo que permite un verdadero razonamiento multimodal.

Tanto la versión de CoT largo como la de CoT corto muestran un gran rendimiento.

Se ha alcanzado el liderazgo en conjuntos de datos como AIME, MATH 500, Codeforces y otros.

También obtiene buenos resultados en pruebas visuales como MathVista.

2. Avances en la formación en RL de contexto largo:

Al ampliar la ventana de contexto a 128k, el rendimiento del modelo sigue mejorando, lo que verifica que la longitud del contexto es una dimensión clave para el escalado del aprendizaje por refuerzo.

- Se utiliza una técnica de despliegue parcial para mejorar significativamente la eficacia del entrenamiento de RL de contexto largo, lo que permite entrenar procesos de inferencia más largos y complejos.

- Se demuestra que los contextos largos son críticos para la resolubilidad de problemas complejos.

3. Métodos long2short válidos:

- Se propone un enfoque long2short eficaz para aprovechar los conocimientos de los modelos de contexto largo para mejorar el rendimiento de los modelos de contexto corto y mejorar la Ficha Eficiencia.

- La mejora del rendimiento de los modelos cortos se consigue mediante técnicas como la fusión de modelos, el muestreo de rechazo más corto y la OPD, y es más eficiente que entrenar modelos cortos directamente.

Se demuestra que el rendimiento de los modelos cortos puede mejorarse migrando el conocimiento previo del pensamiento de los modelos CoT largos.

4. Marco de entrenamiento RL optimizado:

Se proponen métodos mejorados de optimización de políticas para lograr un rendimiento sólido sin depender de técnicas complejas.

Se exploran estrategias de muestreo múltiple, penalizaciones de longitud y optimización de recetas de datos para mejorar la eficiencia y la eficacia del entrenamiento de la RL.

La eficacia de la metodología y las técnicas de formación propuestas se verificó mediante estudios de ablación.

5. Proceso de formación detallado y diseño del sistema:

- Se ha hecho pública una receta de entrenamiento detallada para Kimi k1.5, que incluye fases de preentrenamiento, puesta a punto y aprendizaje intensivo.

- Se presentan estrategias de despliegue híbridas para optimizar la utilización de recursos durante el entrenamiento y la inferencia.

- Se describen detalladamente la canalización de datos y los mecanismos de control de calidad para garantizar la calidad de los datos de entrenamiento.

- Desarrollo de una caja de arena de código seguro para la ejecución y evaluación del código generado.

6. Exploración del tamaño del modelo y la longitud del contexto:

Se investiga el efecto del tamaño del modelo y la longitud del contexto en el rendimiento y se descubre que los modelos más grandes obtienen mejores resultados, pero los modelos más pequeños que utilizan contextos más largos pueden acercarse o incluso igualar el rendimiento de los modelos más grandes, lo que demuestra la mejora del rendimiento del modelo mediante el entrenamiento en RL.

resúmenes

Se ha demostrado que el preentrenamiento de modelos lingüísticos mediante la predicción de la siguiente ficha es eficaz desde el punto de vista computacional, pero está limitado por la cantidad de datos de entrenamiento disponibles. El aprendizaje por refuerzo extendido (RL) abre una nueva dimensión para la mejora continua en IA, prometiendo escalar los datos de entrenamiento para grandes modelos lingüísticos (LLM) aprendiendo a explorar recompensas. Sin embargo, los trabajos publicados anteriormente no han producido resultados competitivos. A la luz de esto, informamos sobre las prácticas de entrenamiento de Kimi k1.5, nuestro último LLM multimodal entrenado utilizando RL, incluyendo sus técnicas de entrenamiento RL, formulación de datos multimodales y optimizaciones de infraestructura. La extensión de contextos largos y los métodos mejorados de optimización de políticas son elementos clave de nuestro enfoque, que establece un marco de RL sencillo y eficaz sin depender de técnicas más complejas como la búsqueda en árbol Monte Carlo, las funciones de valor y los modelos de recompensa de procesos. En particular, nuestro sistema alcanza un rendimiento de inferencia de vanguardia en múltiples pruebas de referencia y modalidades: por ejemplo, 77,5 en AIME, 96,2 en MATH 500, percentil 94 en Codeforces, MathVista 74,9 en MathVista, igualando el 01 de OpenAI. Además, presentamos métodos long2short eficaces que utilizan técnicas de CoT largo para mejorar el modelo de CoT corto, produciendo resultados de inferencia de CoT corto de última generación, por ejemplo, 60,8 en AIME, 94,6 en MATH500, 47,9 en LiveCodeBench, y 47,3 en LiveCodeBench, superando con creces a los modelos de CoT corta existentes, como GPT-40 y Claude Sonnet 3.5 (hasta +550%).

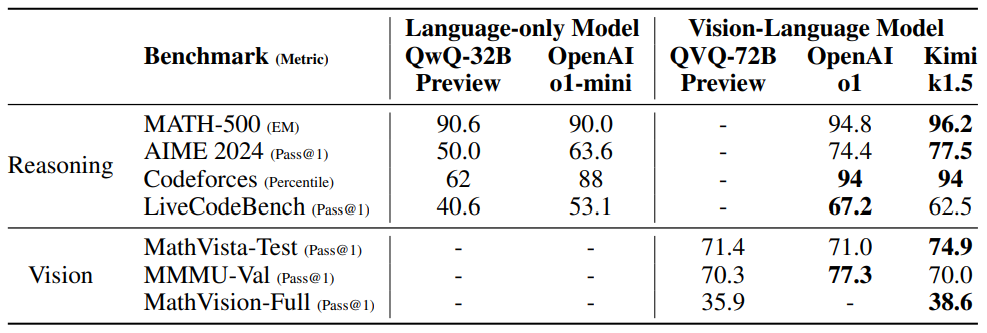

Figura 1: Resultados de Kimi k1.5 long-CoT.

Figura 2: Resultados de Kimi k1.5 short-CoT.

1 Introducción

El preentrenamiento de modelos lingüísticos mediante la predicción de la siguiente ficha se ha investigado en el contexto del lema de expansión, en el que el escalado de los parámetros del modelo y el tamaño de los datos conducen a mejoras continuas de la inteligencia. (Kaplan et al. 2020; Hoffmann et al. 2022) Sin embargo, este enfoque está limitado por la cantidad de datos de entrenamiento de alta calidad disponibles. (Villalobos et al. 2024; Muennighoff et al. 2023) En este informe, presentamos la receta de entrenamiento para Kimi k1.5, nuestro último LLM multimodal entrenado mediante aprendizaje por refuerzo (RL). Utilizando RL con LLM, el modelo aprende a explorar recompensas y, por tanto, no está limitado a conjuntos de datos estáticos preexistentes.

Hay varios elementos clave en relación con el diseño y la formación de k1.5.

- extensión de contexto largoEn este caso, ampliamos la ventana de contexto de RL a 128k y observamos mejoras continuas en el rendimiento a medida que aumentaba la longitud del contexto. Una idea clave de nuestro enfoque es utilizar el despliegue parcial para mejorar la eficiencia del entrenamiento, es decir, evitar el coste de volver a generar nuevas trayectorias desde cero reutilizando grandes porciones de trayectorias anteriores para muestrear nuevas trayectorias. Nuestras observaciones sugieren que la longitud del contexto es una dimensión clave para el escalado continuo de la RL en LLM.

- Optimización mejorada de la estrategiaAlgoritmo: Derivamos la formulación RL con long-CoT y utilizamos una variante del descenso espejo en línea para una optimización robusta de la estrategia. El algoritmo mejora aún más gracias a nuestra eficiente estrategia de muestreo, la penalización por longitud y la optimización de la formulación de los datos.

- Marco simplificadoLa combinación de extensiones de contexto largas y métodos de optimización de políticas mejorados crea un marco de RL simplificado para el aprendizaje mediante LLM. Dado que podemos ampliar la longitud del contexto, el CoT aprendido presenta propiedades de planificación, reflexión y corrección. El aumento de la longitud del contexto incrementa el número de pasos de búsqueda. Como resultado, demostramos que se puede conseguir un rendimiento robusto sin depender de técnicas más sofisticadas (por ejemplo, búsqueda en árbol Monte Carlo, funciones de valor y modelos de recompensa de procesos).

- multimodalNuestro modelo se entrena conjuntamente con datos textuales y visuales, lo que le confiere la capacidad de razonar conjuntamente sobre ambas modalidades.

Además, proponemos un enfoque long2short eficaz que utiliza técnicas long-CoT para mejorar los modelos short-CoT. En concreto, nuestro enfoque consiste en aplicar una penalización de longitud con activación de long-CoT y fusión de modelos.

Nuestra versión de long-CoT alcanza un rendimiento de inferencia de vanguardia en múltiples puntos de referencia y modalidades: por ejemplo, 77,5 en AIME, 96,2 en MATH 500, 94º percentil en Codeforces, 74,9 en MathVista, igualando OpenAI 01. 74,9 en MathVista, igualando el 01 de OpenAI. Nuestro modelo también alcanza resultados de inferencia de CoT corta de última generación -por ejemplo, 60,8 en AIME, 94,6 en MATH500 y 47,3 en LiveCodeBench- que superan sustancialmente a los modelos de CoT corta existentes como GPT-40 y Claude Sonnet 3.5 (hasta +550%). Los resultados se muestran en las figuras 1 y 2.

2 Método: Aprendizaje por refuerzo mediante LLM

El desarrollo de Kimi k1.5 constó de varias fases: preentrenamiento, ajuste fino supervisado por vainilla (SFT), ajuste fino supervisado por CoT largo y aprendizaje por refuerzo (RL). Este informe se centra en el RL, comenzando con una visión general de la gestión de los conjuntos de pistas (Sección 2.1) y el ajuste fino supervisado por CoT largo (Sección 2.2), seguido de un análisis en profundidad de las estrategias de entrenamiento del RL en la Sección 2.3. En la sección 2.5 se ofrece información más detallada sobre el preentrenamiento y el ajuste supervisado con vainilla.

2.1 Gestión del conjunto de señales RL

A través de nuestros experimentos preliminares, descubrimos que la calidad y diversidad de los conjuntos de pistas RL desempeñan un papel crucial a la hora de garantizar la eficacia del aprendizaje por refuerzo. Unos conjuntos de pistas cuidadosamente construidos no sólo guían al modelo hacia una inferencia robusta, sino que también mitigan el riesgo de ataques de recompensa y de sobreajuste de patrones superficiales. En concreto, hay tres propiedades clave que definen los conjuntos de indicios RL de alta calidad:

- Cobertura diversificadaConsejos: los consejos deben abarcar una variedad de disciplinas, como STEM, codificación y razonamiento general, para mejorar la adaptabilidad del modelo y garantizar su amplia aplicabilidad en diferentes ámbitos.

- Dificultad equilibradaEl conjunto de preguntas debe incluir problemas fáciles, medios y difíciles distribuidos uniformemente para promover el aprendizaje incremental y evitar la adaptación excesiva a niveles de complejidad específicos.

- Evaluabilidad precisaConsejos: los consejos deben permitir una evaluación objetiva y fiable por parte del validador para garantizar que el rendimiento del modelo se mide basándose en un razonamiento sólido y no en patrones superficiales o conjeturas aleatorias.

Para lograr una cobertura diversa en el conjunto de pistas, utilizamos filtros automáticos para seleccionar preguntas que requieren un razonamiento rico y son fáciles de evaluar. Nuestro conjunto de datos incluye preguntas de diversos ámbitos, como disciplinas STEM, concursos y tareas de razonamiento general, y contiene datos de cuestionarios de texto sin formato y de texto con imágenes. Además, desarrollamos un sistema de etiquetado para clasificar las preguntas por dominio y disciplina con el fin de garantizar una representación equilibrada de las diferentes áreas temáticas (M. Li et al. 2023; W. Liu et al. 2023).

Utilizamos un enfoque basado en el modelo que utiliza la propia capacidad del modelo para evaluar de forma adaptativa la dificultad de cada pregunta. En concreto, para cada pregunta, el modelo SFT genera diez respuestas utilizando una temperatura de muestreo relativamente alta. A continuación, se calcula el porcentaje de aciertos y se utiliza como indicador de la dificultad de la pista: cuanto menor sea el porcentaje de aciertos, mayor será la dificultad. Este enfoque permite alinear la evaluación de la dificultad con las capacidades intrínsecas del modelo, lo que lo hace muy eficaz en el entrenamiento de RL. Utilizando este enfoque, podemos preseleccionar la mayoría de los casos triviales y explorar fácilmente diferentes estrategias de muestreo durante el entrenamiento de RL.

Para evitar posibles ataques de recompensa (Everitt et al. 2021; Pan et al. 2022), necesitamos asegurarnos de que podemos verificar con precisión el proceso de razonamiento y la respuesta final para cada pista. Las observaciones empíricas han demostrado que algunos problemas de razonamiento complejos pueden tener respuestas relativamente sencillas y fáciles de adivinar, lo que conduce a una validación hacia delante espuria, en la que el modelo llega a la respuesta correcta a través de un proceso de razonamiento incorrecto. Para abordar este problema, excluimos las preguntas propensas a tales errores, como las de opción múltiple, verdadero/falso y las basadas en pruebas. Además, para las tareas generales de pregunta-respuesta, proponemos un método sencillo pero eficaz para identificar y eliminar las pistas fácilmente atacables. En concreto, pedimos al modelo que adivine posibles respuestas sin ningún paso de inferencia de CoT. Si el modelo predice la respuesta correcta en N intentos, la pista se considera demasiado fácil de atacar y se elimina. Hemos comprobado que N = 8 elimina la mayoría de las pistas fáciles de atacar. El desarrollo de modelos de verificación más avanzados sigue siendo una dirección abierta para futuras investigaciones.

2.2 Ajuste fino supervisado de Long-CoT

Con un conjunto de pistas RL mejorado, empleamos la ingeniería de pistas para construir un conjunto de datos de calentamiento de CoT largo, pequeño pero de alta calidad, que contiene rutas de inferencia verificadas con precisión para entradas de texto e imagen. Este enfoque es similar al muestreo de rechazo (RS), pero se centra en la generación de rutas de inferencia de CoT largo a través de la ingeniería de pistas. El conjunto de datos de calentamiento resultante está diseñado para encapsular procesos cognitivos clave que son esenciales para el razonamiento humanoide, como la planificación (en la que el modelo traza sistemáticamente los pasos previos a la ejecución); la evaluación (que incluye una valoración crítica de los pasos intermedios); la reflexión (que permite al modelo reconsiderar y mejorar su enfoque); y la exploración (que fomenta la consideración de soluciones alternativas). Al aplicar la SFT ligera a este conjunto de datos de calentamiento, podemos guiar eficazmente al modelo para que interiorice estas estrategias de inferencia. Como resultado, el modelo long-CoT perfeccionado muestra una mayor capacidad para generar respuestas más detalladas y lógicamente coherentes, mejorando así su rendimiento en diversas tareas de inferencia.

2.3 Mejora del aprendizaje

2.3.1 Planteamiento del problema

Dado un conjunto de datos de entrenamiento D = {(xi, yi)}^n_i=1, que contiene la pregunta xi y la correspondiente respuesta verdadera yi, nuestro objetivo es entrenar el modelo de estrategia πθ para resolver con precisión el problema de prueba. En un contexto de razonamiento complejo, la asignación del problema x a la solución y no es una tarea fácil. Para hacer frente a este reto, el enfoque de la cadena de pensamiento (CoT) sugiere utilizar una serie de pasos intermedios z = (z1, z2, ... , zm) para tender un puente entre x y la solución y. , zm) para tender un puente entre x e y, donde cada zi es una secuencia coherente de fichas que puede servir como paso intermedio importante en la resolución de problemas (J. Wei et al., 2022). En la resolución del problema x, la mente de muestreo autorregresivo zt ~ πθ(-|x, z1, ... , zt-1), y luego el muestreo de la respuesta final y ~ πθ(-|x, z1,... , zm). Utilizamos y, z ~ πθ para denotar este proceso de muestreo. Obsérvese que tanto los pensamientos como las respuestas finales se muestrean como secuencias lingüísticas.

Para mejorar aún más las capacidades de inferencia del modelo, empleamos algoritmos de planificación para explorar varios procesos de pensamiento con el fin de generar CoTs mejorados al razonar (Yao et al. 2024; Y. Wu et al. 2024; Snell et al. 2024). La idea central de estos enfoques es la construcción explícita de árboles de búsqueda de pensamiento guiados por estimaciones de valor. Esto permite al modelo explorar varias continuaciones del proceso de pensamiento, o retroceder para investigar nuevas direcciones cuando se encuentra con un callejón sin salida. Más detalladamente, T es un árbol de búsqueda en el que cada nodo representa una solución parcial s = (x, z1:|s|). Aquí s consiste en el problema x y una secuencia de pensamientos z1:|s| = (z1, ... , z|s|) que conducen a una solución parcial. , z|s|) que conducen al nodo, donde |s| denota el número de pensamientos de la secuencia. El algoritmo de planificación utiliza el modelo de crítica v para proporcionar retroalimentación v(x, z1:|s|), que ayuda a evaluar el progreso actual en la resolución del problema y a identificar cualquier error en la solución parcial existente. Observamos que la retroalimentación puede proporcionarse mediante puntuaciones discriminantes o secuencias lingüísticas (L. Zhang et al. 2024). Guiado por la retroalimentación de todos los s ∈ T , el algoritmo de planificación expande el árbol de búsqueda seleccionando los nodos que tienen más probabilidades de expandirse. El proceso anterior se repite iterativamente hasta que se obtiene una solución completa.

También podemos abordar los algoritmos de planificación desde una perspectiva algorítmica. Dado el historial de búsqueda anterior disponible en la iteración t (s1, v(s1), ... , st-1, v(st-1)), el algoritmo de planificación A determina iterativamente la siguiente dirección de búsqueda A(st|s1, v(s1), ... , st-1, v(st-1)) y proporciona retroalimentación sobre el progreso de búsqueda actual A(v(st)|s1, v(s1),... , st). st) para proporcionar retroalimentación. Dado que tanto el pensamiento como la retroalimentación pueden considerarse pasos de razonamiento intermedios, y dado que estos componentes pueden representarse como secuencias lingüísticas de tokens, utilizamos z en lugar de s y v para simplificar la representación. Así, vemos el algoritmo de planificación como actuando directamente sobre una secuencia de pasos de inferencia A(-|z1, z2, ...). ) como un mapeo de una serie de pasos de inferencia A(-|z1, z2, . . . ). En este marco, toda la información almacenada en el árbol de búsqueda utilizado por el algoritmo de planificación se extiende en el contexto completo proporcionado al algoritmo. Esto ofrece una perspectiva interesante para generar CdT de alta calidad: en lugar de construir explícitamente el árbol de búsqueda e implementar el algoritmo de planificación, podemos entrenar un modelo para aproximar este proceso. En este caso, la cantidad de pensamiento (es decir, token lingüístico) es análoga al presupuesto computacional tradicionalmente asignado a los algoritmos de planificación. Los recientes avances en ventanas de contexto largas favorecen la escalabilidad sin fisuras durante las fases de entrenamiento y prueba. Si es factible, este enfoque permite al modelo ejecutar búsquedas implícitas directamente en el espacio de inferencia mediante predicciones autorregresivas. Como resultado, el modelo no sólo aprende a resolver un conjunto de problemas de entrenamiento, sino que también desarrolla la capacidad de resolver eficazmente problemas individuales, mejorando así la generalización a problemas de prueba no vistos.

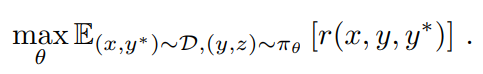

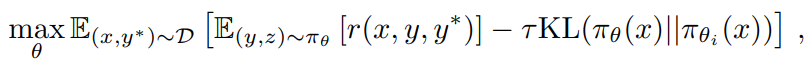

Por lo tanto, consideramos modelos de entrenamiento para generar CoTs utilizando el aprendizaje por refuerzo (RL) (OpenAI 2024). Sea r un modelo de recompensa que proporciona una base para la corrección de la respuesta y propuesta para una pregunta dada x basada en la respuesta verdadera y* asignando un valor r(x, y, y*) ∈ {0, 1}. En los problemas verificables, la recompensa viene determinada directamente por criterios o reglas predefinidos. Por ejemplo, en los problemas de codificación, se evalúa si la respuesta supera el caso de prueba. Para las preguntas con respuestas verdaderas de forma libre, entrenamos el modelo de recompensa r(x, y, y*) para predecir si la respuesta coincide con la respuesta verdadera. Dada una pregunta x, el modelo πθ genera el CoT y la respuesta final mediante un proceso de muestreo z ~ πθ(-|x), y ~ πθ(-|x, z). La calidad de la CoT generada depende de si puede producir respuestas finales correctas. En resumen, consideramos los siguientes objetivos para optimizar la estrategia

Al ampliar el entrenamiento RL, pretendemos entrenar un modelo que aproveche tanto el CoT basado en pistas simples como el CoT mejorado por planificación. El modelo sigue muestreando autorregresivamente secuencias lingüísticas durante la inferencia, evitando así la compleja paralelización que requieren los algoritmos avanzados de planificación durante el despliegue. Sin embargo, una diferencia clave respecto a los enfoques basados en pistas es que el modelo no debe limitarse a seguir una serie de pasos de inferencia. Por el contrario, también debe aprender habilidades clave de planificación, como la identificación de errores, el retroceso y la mejora de la solución, utilizando todo el conjunto de pensamientos explorados como información contextual.

2.3.2 Optimización de la estrategia

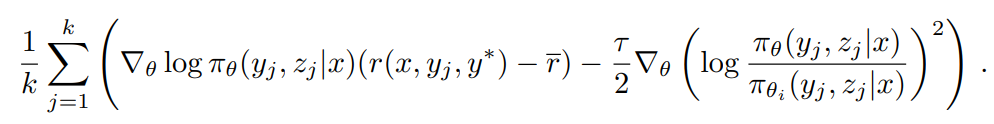

Aplicamos una variante de la estrategia en línea mirror descent como algoritmo de entrenamiento (Abbasi-Yadkori et al. 2019; Mei et al. 2019; Tomar et al. 2020). El algoritmo se ejecuta de forma iterativa. En la iteración i-ésima, utilizamos el modelo actual πθi como modelo de referencia y optimizamos el siguiente problema de optimización de política de regularización de entropía relativa que

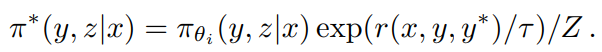

donde τ > 0 es un parámetro que controla el grado de regularización. Este objetivo tiene una solución de forma cerrada

donde Z = Σy',z' πθi (y', z'|x) exp(r(x, y', y*)/τ) es el factor de normalización. Tomando el logaritmo de ambos lados, obtenemos que para cualquier (y, z) se satisfacen las siguientes restricciones, lo que nos permite explotar los datos de la política offline durante la optimización

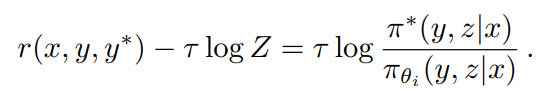

Esto inspiró las siguientes pérdidas por sustitución

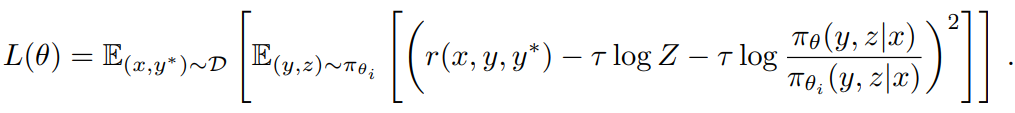

Para aproximar τ log Z, utilizamos las muestras (y1, z1), ... , (yk, zk) ~ πθ: τ log Z ≈ log 1/k Σ^k_j=1 exp(r(x, yj, y*)/τ). También encontramos que utilizando la media empírica de la recompensa muestral τ = mean(r(x, y1, y*), ... , r(x, yk, y*)) arroja resultados prácticos válidos. Esto es razonable porque a medida que τ → ∞, τ log Z se aproxima a la recompensa esperada bajo πθi . Por último, derivamos nuestro algoritmo de aprendizaje tomando el gradiente de la pérdida por sustitución. Para cada problema x, se muestrean k respuestas utilizando la política de referencia πθi , y el gradiente viene dado por

Para aquellos familiarizados con los métodos de gradiente de estrategia, este gradiente es similar al gradiente de estrategia de (2) que utiliza la media de las recompensas muestreadas como línea de base (Kool et al. 2019; Ahmadian et al. 2024). La principal diferencia es que la respuesta se muestrea de πθi en lugar de la estrategia en línea, y se aplica la regularización l2. Por lo tanto, podemos verlo como una extensión natural del algoritmo de gradiente de política regularizado en línea habitual al caso de política fuera de línea (Nachum et al. 2017). Muestreamos un lote de problemas de D y actualizamos el parámetro a θi+1 , que posteriormente se utiliza como política de referencia para la siguiente iteración. También reiniciamos el optimizador al principio de cada iteración, ya que cada iteración considera un problema de optimización diferente debido al cambio en la estrategia de referencia.

Excluimos la red de valores del sistema de entrenamiento, que también se utilizó en un estudio anterior (Ahmadian et al. 2024). Aunque esta elección de diseño mejora significativamente la eficiencia del entrenamiento, también planteamos la hipótesis de que el uso tradicional de funciones de valor para la asignación de créditos en la RL clásica puede no ser apropiado para nuestro contexto. Consideremos una situación en la que el modelo genera un CoT parcial (z1, z2, ... . zt) y tiene dos posibles pasos de inferencia: zt+1 y z't+1. Supongamos que zt+1 conduce directamente a la respuesta correcta, mientras que z't+1 contiene algunos errores. Si la función de valor del oráculo fuera accesible, indicaría que zt+1 conserva un valor mayor que z't+1. Según los principios estándar de asignación de créditos, elegir z't+1 estaría penalizado porque tiene una ventaja negativa sobre la estrategia actual. Sin embargo, explorar z't+1 es valioso para entrenar al modelo a generar CoT largos. Al utilizar la justificación de la respuesta final derivada de la CoT larga como señal de recompensa, el modelo puede aprender de la pauta de ensayo y error de adoptar z't+1 siempre que se recupere con éxito y llegue a la respuesta correcta. La conclusión clave que se extrae de este ejemplo es que debemos animar al modelo a explorar varias vías de razonamiento para mejorar su capacidad de resolver problemas complejos. Este enfoque exploratorio genera una gran cantidad de experiencia que favorece el desarrollo de habilidades críticas de planificación. Más que mejorar al máximo la precisión de los problemas de entrenamiento, nuestro principal objetivo es centrarnos en dotar al modelo de estrategias eficaces de resolución de problemas, lo que en última instancia mejorará su rendimiento en los problemas de prueba.

2.3.3 Penalizaciones por longitud

Observamos un fenómeno de sobrepensamiento en el que la longitud de la respuesta del modelo aumenta significativamente durante el entrenamiento de la RL. Aunque esto conduce a un mejor rendimiento, los procesos de razonamiento excesivamente largos son costosos durante el entrenamiento y la inferencia, y a los humanos generalmente no les gusta pensar demasiado. Para solucionar este problema, introducimos una bonificación de longitud para limitar el rápido crecimiento de la longitud de las fichas y mejorar así la eficacia del modelo. Dadas k respuestas muestreadas (y1, z1) para el problema x, ... (yk, zk) y la respuesta verdadera y*, sea len(i) la longitud de (yi, zi), min_len = min_i len(i) y max_len = max_i len(i). Si max_len = min_len, la bonificación por longitud es cero para todas las respuestas, ya que tienen la misma longitud. En caso contrario, la bonificación de longitud viene dada por

Esencialmente, fomentamos las respuestas más cortas y penalizamos las respuestas más largas en las respuestas correctas, mientras que penalizamos explícitamente las respuestas más largas en las respuestas incorrectas. Esta recompensa basada en la longitud con parámetros de peso se añade a la recompensa original.

En nuestros experimentos preliminares, las penalizaciones por longitud pueden ralentizar la fase inicial del entrenamiento. Para mitigar este problema, sugerimos calentar gradualmente la penalización por longitud en la fase inicial del entrenamiento. En concreto, optimizamos con la estrategia estándar sin penalización de longitud y, a continuación, aplicamos una penalización de longitud constante durante el resto del entrenamiento.

2.3.4 Estrategia de muestreo

Aunque el propio algoritmo RL tiene unas propiedades de muestreo relativamente buenas (los problemas más difíciles proporcionan gradientes mayores), su eficacia de entrenamiento es limitada. Por lo tanto, algunos métodos de muestreo a priori bien definidos pueden producir mayores ganancias de rendimiento. Utilizamos varias señales para mejorar la estrategia de muestreo. En primer lugar, los datos de entrenamiento de RL que recopilamos llevan de forma natural diferentes etiquetas de dificultad. Por ejemplo, los problemas de los concursos de matemáticas son más difíciles que los problemas de matemáticas de la escuela primaria. En segundo lugar, dado que el proceso de entrenamiento de RL muestrea los mismos problemas varias veces, también podemos hacer un seguimiento de la tasa de éxito de cada problema como indicador de dificultad. Proponemos dos métodos de muestreo para aprovechar este conocimiento previo y mejorar la eficacia del entrenamiento.

Muestreo de cursos Primero nos entrenamos en tareas más sencillas y luego pasamos gradualmente a tareas más difíciles. Dado que el modelo inicial de RL tiene un rendimiento limitado, gastar un presupuesto computacional limitado en problemas muy difíciles suele producir pocas muestras correctas, lo que lleva a una menor eficiencia del entrenamiento. Al mismo tiempo, los datos que recopilamos contienen naturalmente etiquetas de grado y dificultad, lo que hace que el muestreo basado en la dificultad sea una forma intuitiva y eficaz de mejorar la eficiencia del entrenamiento.

muestreo prioritario Además del muestreo de cursos, utilizamos una estrategia de muestreo prioritario para centrarnos en los problemas con un rendimiento deficiente del modelo. Hacemos un seguimiento de la tasa de éxito si de cada problema i y muestreamos los problemas de forma proporcional a 1/si, de modo que los problemas con tasas de éxito más bajas reciban una mayor probabilidad de muestreo. Esto dirigirá el esfuerzo del modelo a sus áreas más débiles, acelerando así el aprendizaje y mejorando el rendimiento general.

2.3.5 Información más detallada sobre las recetas de formación

Generación de casos de prueba para la codificación Dado que no hay casos de prueba disponibles para muchos problemas de codificación en la web, ideamos una forma de generar automáticamente casos de prueba que puedan utilizarse como extra para entrenar modelos utilizando RL. Nos centramos principalmente en problemas que no requieren árbitros especiales. También suponemos que se dispone de respuestas reales a estos problemas, de modo que podemos utilizarlas para generar casos de prueba de mayor calidad.

Mejoramos nuestro enfoque con la biblioteca de generación de casos de prueba CYaRon¹, ampliamente reconocida. Utilizamos nuestra base Kimi k1.5 para generar casos de prueba basados en enunciados de problemas. Las instrucciones para utilizar CYaRon y las descripciones de los problemas sirven de entrada al generador. Para cada problema, utilizamos primero el generador para generar 50 casos de prueba y seleccionamos aleatoriamente 10 respuestas reales para cada caso de prueba. Los casos de prueba se comparan con las respuestas enviadas. Un caso de prueba se considera válido si al menos 10 de cada 7 respuestas coinciden. Tras esta ronda de filtrado, tenemos un conjunto seleccionado de casos de prueba. Si al menos 10 de cada 9 envíos superan el conjunto de casos de prueba seleccionados, la pregunta y sus casos de prueba seleccionados asociados se añaden a nuestro conjunto de entrenamiento.

Estadísticamente, de una muestra de 1.000 preguntas de concursos en línea, aproximadamente 614 preguntas no requerían un árbitro especial. Desarrollamos 463 generadores de casos de prueba que produjeron al menos 40 casos de prueba válidos, con lo que nuestro conjunto de entrenamiento contenía 323 problemas.

Modelizar las recompensas de las matemáticas Un reto a la hora de evaluar soluciones matemáticas es que diferentes formas de escritura pueden representar la misma respuesta básica. Por ejemplo, a² - 4 y (a + 2)(a - 2) pueden ser soluciones válidas. Utilizamos dos enfoques para mejorar la precisión de la puntuación del modelo de recompensa:

- RM clásico: inspirándonos en el enfoque InstructGPT (Ouyang et al. 2022), implementamos un modelo de recompensa de encabezado basado en valores y recopilamos unos 800.000 puntos de datos para su ajuste. En última instancia, el modelo toma "pregunta", "referencia" y "respuesta" como entradas y emite un escalar que indica si la respuesta es correcta o no.

- Cadena de pensamiento RM: Estudios recientes (Ankner et al. 2024; McAleese et al. 2024) han demostrado que los modelos de recompensa aumentados con razonamiento de cadena de pensamiento (CoT) pueden superar significativamente los enfoques clásicos, especialmente en tareas que requieren criterios de corrección de grano fino (por ejemplo, matemáticas). Por ello, recopilamos un conjunto de datos de aproximadamente 800.000 ejemplos etiquetados con CoT para ajustar el modelo Kimi. Basándose en las mismas entradas que el MR clásico, el enfoque de la cadena de pensamiento genera explícitamente procesos de inferencia paso a paso en formato JSON y, a continuación, proporciona el juicio final de corrección, lo que da como resultado una señal de recompensa más sólida e interpretable.

En nuestras comprobaciones manuales aleatorias, la precisión del MR clásico fue de aproximadamente 84,4, mientras que la precisión del MR de cadena de pensamiento alcanzó el 98,5. Durante el entrenamiento de RL, utilizamos el MR de cadena de pensamiento para garantizar una retroalimentación más correcta.

Datos visuales Con el fin de mejorar las capacidades de inferencia de imágenes del modelo en el mundo real y lograr una alineación más eficiente entre las entradas visuales y los Modelos de Lenguaje Amplio (LLM), nuestros datos de Aprendizaje Visual por Refuerzo (Vision RL) se extraen de tres categorías diferentes: datos del mundo real, datos de inferencia visual sintéticos y datos renderizados de texto.

- Los datos del mundo real abarcan una amplia gama de problemas científicos de todos los grados que requieren comprensión y razonamiento de gráficos; tareas de adivinación de localizaciones que exigen percepción y razonamiento visuales; y tareas analíticas que implican la comprensión de diagramas complejos. Estos conjuntos de datos mejoran la capacidad del modelo para realizar razonamientos visuales en escenarios del mundo real.

- Los datos sintéticos de razonamiento visual son generados por humanos e incluyen imágenes y escenas creadas por programas diseñados para mejorar habilidades específicas de razonamiento visual, como la comprensión de relaciones espaciales, patrones geométricos e interacciones de objetos. Estos conjuntos de datos sintéticos ofrecen un entorno controlado para poner a prueba las capacidades de razonamiento visual de un modelo y proporcionan una fuente inagotable de ejemplos de entrenamiento.

- Los datos renderizados en texto se crean convirtiendo el contenido textual en un formato visual, lo que permite al modelo mantener la coherencia al procesar consultas basadas en texto en distintas modalidades. Al convertir en imágenes documentos de texto, fragmentos de código y datos estructurados, nos aseguramos de que el modelo ofrezca una respuesta coherente independientemente de si la entrada es texto plano o texto renderizado como imagen (por ejemplo, una captura de pantalla o una foto). Esto también ayuda a mejorar la capacidad del modelo para manejar imágenes con mucho texto.

Cada tipo de datos es fundamental para construir un modelo de lenguaje visual completo que pueda gestionar con eficacia una gran variedad de aplicaciones del mundo real, garantizando al mismo tiempo un rendimiento coherente en todos los modos de entrada.

2.4 Long2short: compresión de contextos para modelos Short-CoT

Aunque el modelo long-CoT consigue un rendimiento robusto, consume más Tokens de tiempo de prueba que el LLM estándar short-CoT. Sin embargo, es posible transferir el conocimiento a priori del pensamiento en el modelo long-CoT al modelo short-CoT para mejorar el rendimiento incluso con un presupuesto limitado de Tokens de tiempo de prueba. Proponemos varios enfoques para este problema long2short, incluida la fusión de modelos (Yang et al., 2024), el muestreo de rechazo más corto, DPO (Rafailov et al., 2024) y RL long2short. A continuación se ofrece una descripción detallada de estos enfoques:

Fusión de modelos Se ha comprobado que la fusión de modelos ayuda a mantener la capacidad de generalización. También hemos comprobado que mejora la eficiencia de Token al fusionar modelos de CoT largo con modelos de CoT corto. Este enfoque combina modelos de CoT largo con modelos más cortos para obtener nuevos modelos sin entrenamiento. En concreto, fusionamos los dos modelos simplemente promediando sus pesos.

Muestreo de rechazo mínimo Observamos que nuestro modelo genera respuestas de longitudes muy variables para un mismo problema. Basándonos en esto, ideamos el método de muestreo de rechazo más corto. Este método muestrea el mismo problema n veces (n = 8 en nuestros experimentos) y selecciona la respuesta correcta más corta para el ajuste fino supervisado.

RPD De forma similar al muestreo de rechazo más corto, utilizamos el modelo CoT largo para generar múltiples muestras de respuesta. La solución correcta más corta se selecciona como muestra positiva, mientras que las respuestas más largas se consideran muestras negativas, incluyendo la respuesta incorrecta más larga y la respuesta correcta más larga (1,5 veces más larga que la muestra positiva seleccionada). Estos pares positivos y negativos constituyen los datos de preferencia emparejados utilizados para el entrenamiento de RPD.

Long2short RL Tras la fase de entrenamiento RL estándar, seleccionamos un modelo que ofrezca el mejor equilibrio entre rendimiento y eficiencia de Token como modelo base y realizamos una fase de entrenamiento RL long2short independiente. En la segunda fase, aplicamos la penalización por longitud introducida en la sección 2.3.3 y reducimos significativamente la longitud máxima de la tirada para penalizar aún más las respuestas más largas de lo necesario pero que pueden ser correctas.

2.5 Otros detalles de la formación

2.5.1 Formación previa

El modelo de base Kimi k1.5 se entrena con un corpus multimodal diverso y de alta calidad. Los datos lingüísticos abarcan cinco ámbitos: inglés, chino, código, razonamiento matemático y conocimiento. Los datos multimodales, que incluyen subtítulos, intercalación imagen-texto, OCR, conocimiento y conjuntos de datos de control de calidad, permiten a nuestro modelo adquirir competencia lingüística visual. Un riguroso control de calidad garantiza la pertinencia, la diversidad y el equilibrio del conjunto de datos de preentrenamiento. Nuestro preentrenamiento se llevó a cabo en tres fases: (1) preentrenamiento visual-lingüístico, en el que se estableció una sólida base lingüística, seguida de una integración multimodal gradual; (2) un periodo de enfriamiento, en el que se utilizaron datos seleccionados y sintéticos para consolidar capacidades, especialmente para tareas de inferencia y basadas en el conocimiento; y (3) activación de contexto largo, en el que el procesamiento de secuencias se escaló hasta 131.072 Tokens. para más detalles sobre nuestros esfuerzos de preentrenamiento para obtener información más detallada, véase el Apéndice B.

2.5.2 Ajuste de la supervisión de la vainilla

Hemos creado un corpus de SFT vainilla que abarca varios dominios. Para las tareas no razonadas, como las preguntas y respuestas, la escritura y el procesamiento de textos, construimos inicialmente un conjunto de datos semilla mediante anotación manual. Este conjunto de datos semilla se utiliza para entrenar modelos semilla. A continuación, recopilamos varias preguntas y utilizamos el modelo semilla para generar varias respuestas para cada pregunta. A continuación, el anotador clasifica estas respuestas y mejora la respuesta mejor clasificada para generar la versión final. Para tareas de razonamiento como los problemas matemáticos y de codificación, en las que la validación basada en el modelado de reglas y recompensas es más precisa y eficiente que el juicio manual, ampliamos el conjunto de datos SFT utilizando el muestreo de rechazo.

Nuestro conjunto de datos SFT contiene aproximadamente un millón de ejemplos de texto. En concreto, 500.000 ejemplos de preguntas y respuestas generales, 200.000 de codificación, 200.000 de matemáticas y ciencias, 5.000 de escritura creativa y 20.000 de tareas de contexto largo, como resúmenes, consultas de documentos, traducción y redacción. Además, hemos creado un millón de ejemplos visuales de texto que abarcan diversas categorías, como interpretación de diagramas, reconocimiento óptico de caracteres, diálogo basado en imágenes, codificación visual, razonamiento visual y problemas de matemáticas y ciencias con ayudas visuales.

En la primera fase (32k), la tasa de aprendizaje disminuye de 2 × 10-5 a 2 × 10-6 , para volver a disminuir a 1 × 10-5 en la segunda fase (128k), antes de disminuir finalmente a 1 × 10-6 . Para mejorar la eficiencia del entrenamiento, empaquetamos múltiples ejemplos de entrenamiento en cada secuencia de entrenamiento.

2.6 Infraestructura de RL

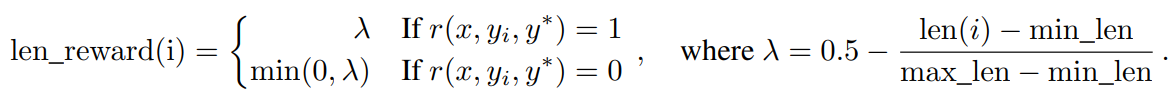

Figura 3: Sistema de aprendizaje por refuerzo a gran escala para LLM

(a) Visión general del sistema

(b) Despliegue parcial

2.6.1 Sistema de aprendizaje por refuerzo a gran escala para LLMs

En el campo de la IA, el aprendizaje por refuerzo (RL) se ha convertido en un método de entrenamiento clave para los grandes modelos lingüísticos (LLM) (Ouyang et al. 2022) (Jaech et al. 2024), inspirándose en su éxito en el dominio de juegos complejos como Go, Starcraft II y Dota 2 con sistemas como AlphaGo (Silver et al. 2017), AlphaStar (Vinyals et al. 2019) y OpenAI Dota Five (Berner et al. 2019), entre otros sistemas. Siguiendo esta tradición, el sistema Kimi k1.5 emplea un marco de RL sincronizado iterativamente que está cuidadosamente diseñado para mejorar la inferencia del modelo a través del aprendizaje y la adaptación persistentes. Una innovación clave en este sistema es la introducción de la técnica de despliegue parcial, que está diseñada para optimizar el procesamiento de trayectorias de inferencia complejas.

Como se muestra en la Fig. 3a, el sistema de entrenamiento RL funciona mediante un enfoque de sincronización iterativa, en el que cada iteración consta de una fase de despliegue y una fase de entrenamiento. Durante la fase de despliegue, un trabajador de despliegue coordinado por un servidor maestro central genera trayectorias de despliegue interactuando con el modelo para producir una secuencia de respuestas a diversas entradas. Estas trayectorias se almacenan en un búfer de repetición, que garantiza un conjunto de datos de entrenamiento diverso e imparcial al interrumpir la correlación temporal. En las fases de entrenamiento posteriores, el cuaderno de entrenamiento accede a estas experiencias para actualizar las ponderaciones del modelo. Este proceso cíclico permite al modelo aprender continuamente de sus operaciones y ajustar su estrategia a lo largo del tiempo para mejorar su rendimiento.

El servidor maestro central actúa como oficial de mando central, gestionando el flujo de datos y la comunicación entre los flujos de trabajo de despliegue, los flujos de trabajo de formación, la evaluación con modelos de recompensa y los búferes de repetición. Garantiza que el sistema funcione de forma coordinada, equilibra la carga y facilita un procesamiento eficaz de los datos.

La rutina de trabajo de entrenamiento accede a estas trayectorias de rodaje, completadas en una única iteración o divididas en múltiples iteraciones, para calcular actualizaciones de gradiente que mejoren los parámetros del modelo y aumenten su rendimiento. Este proceso está supervisado por el modelo de recompensa, que evalúa la calidad de los resultados del modelo y proporciona la información necesaria para guiar el proceso de entrenamiento. La evaluación del modelo de recompensa es fundamental para determinar la eficacia de la estrategia del modelo y guiarlo hacia un rendimiento óptimo.

Además, el sistema incluye un servicio de ejecución de código, diseñado específicamente para tratar problemas relacionados con el código y que forma parte integrante del modelo de recompensa. Este servicio evalúa los resultados del modelo en situaciones reales de codificación, lo que garantiza que el aprendizaje del modelo se ajusta estrechamente a los retos de programación del mundo real. Al validar la solución del modelo frente a la ejecución de código real, este bucle de retroalimentación es esencial para mejorar la estrategia del modelo y aumentar su rendimiento en tareas relacionadas con el código.

2.6.2 Despliegue parcial para RL de CoT larga

Una de las ideas principales de nuestro trabajo es ampliar el entrenamiento de RL de contexto largo. El rollout parcial es una técnica clave que aborda eficazmente el reto de tratar con características de CoT largo gestionando rollouts para trayectorias largas y cortas. Esta técnica establece un presupuesto fijo de tokens de salida que limita la longitud de cada trayectoria de rollout. Si la trayectoria supera el límite de tokens durante la fase de rollout, la parte inacabada se guarda en el búfer de repetición y se continúa en la siguiente iteración. Así se garantiza que ninguna trayectoria larga monopolice los recursos del sistema. Además, como los flujos de trabajo de rollout se ejecutan de forma asíncrona, mientras algunos flujos de trabajo procesan trayectorias largas, otros pueden procesar de forma independiente nuevas tareas de rollout más cortas. El funcionamiento asíncrono maximiza la eficiencia computacional al garantizar que todos los flujos de trabajo de rollout contribuyen activamente al proceso de formación, optimizando así el rendimiento global del sistema.

Como se muestra en la figura 3b, el sistema de despliegue parcial funciona descomponiendo las respuestas largas en fragmentos a lo largo de las iteraciones (de la iteración n-m a la iteración n). El búfer de repetición actúa como mecanismo de almacenamiento central para mantener estos fragmentos de respuesta, donde sólo es necesario calcular en línea la iteración actual (iteración n). Los segmentos anteriores (iteraciones n-m a n-1) pueden reutilizarse eficazmente desde la memoria intermedia, eliminando la necesidad de repetidos despliegues. Este enfoque segmentado reduce significativamente la sobrecarga computacional: en lugar de desplegar toda la respuesta a la vez, el sistema procesa y almacena segmentos de forma incremental, lo que permite generar respuestas más largas manteniendo tiempos de iteración rápidos. Durante el entrenamiento, algunos segmentos pueden excluirse del cálculo de pérdidas para optimizar aún más el proceso de aprendizaje, lo que hace que el sistema en su conjunto sea eficiente y escalable.

La implementación del despliegue parcial también proporciona detección de duplicados. El sistema identifica las secuencias duplicadas en los contenidos generados y las interrumpe antes, reduciendo así los cálculos innecesarios y manteniendo la calidad del resultado. A los duplicados detectados se les pueden asignar penalizaciones adicionales, evitando así que se generen contenidos redundantes en el conjunto de pistas.

2.6.3 Despliegue híbrido de formación y razonamiento

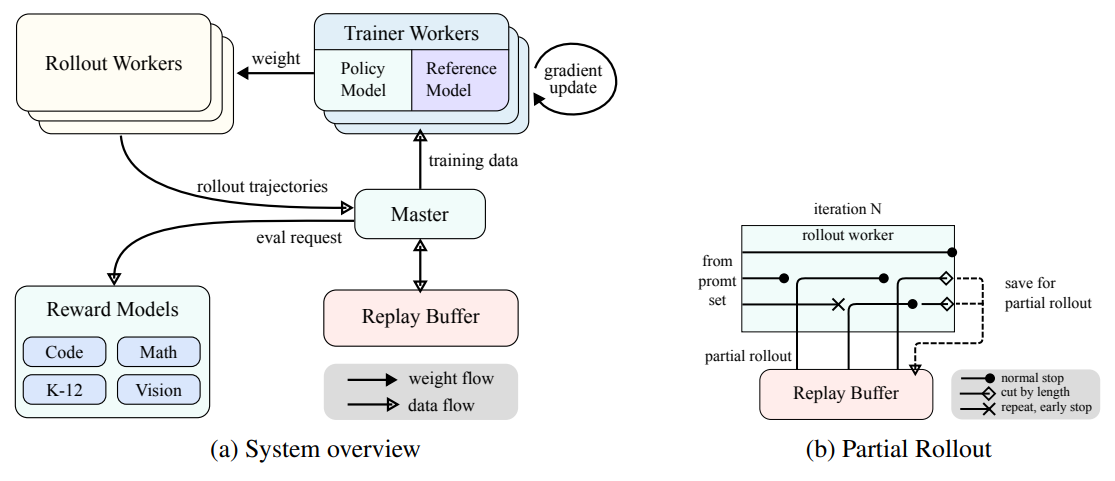

El proceso de entrenamiento RL consta de las siguientes etapas:

Figura 4: Marco de despliegue híbrido

- fase de formaciónMegatron (Shoeybi et al. 2020) y la vLLM (Kwon et al. 2023) se ejecutan en contenedores separados encapsulados por procesos shim llamados motores de punto de control (Sección 2.6.3). megatron comienza el proceso de entrenamiento. Una vez completado el entrenamiento, Megatron descarga la memoria de la GPU y se prepara para transferir los pesos actuales a vLLM.

- fase de inferenciaDespués de la descarga de Megatron, vLLM se inicia con los pesos del modelo virtual y los actualiza con los últimos pesos transferidos desde Megatron a través de Mooncake (Qin et al. 2024). Una vez finalizada la descarga, el motor de puntos de control detiene todos los procesos de vLLM.

- Fase de formación de seguimientoUna vez liberada la memoria asignada a vLLM, Megatron descarga la memoria e inicia otra ronda de entrenamiento.

Nos ha resultado difícil apoyar todas las características siguientes al mismo tiempo con el trabajo existente.

- Estrategias paralelas complejasMegatron puede tener una estrategia de paralelismo diferente a la de vLLM. Los pesos de entrenamiento distribuidos a través de múltiples nodos en Megatron pueden ser difíciles de compartir con vLLM.

- Minimizar los recursos ociosos de la GPUPara la RL de políticas en línea, los trabajos recientes (por ejemplo, SGLang (L. Zheng et al. 2024) y VLLM) pueden reservar algunas GPUs durante el entrenamiento, lo que a su vez puede provocar GPUs de entrenamiento ociosas. es más eficiente compartir los mismos dispositivos entre el entrenamiento y la inferencia.

- Escalabilidad dinámicaEn algunos casos, es posible aumentar considerablemente la velocidad incrementando el número de nodos de inferencia y manteniendo constante el proceso de entrenamiento. Nuestro sistema puede utilizar eficientemente el número necesario de nodos de GPU libres.

Como se muestra en la Figura 4, implementamos este marco de despliegue híbrido sobre Megatron y vLLM (Sección 2.6.3), dando como resultado una fase de entrenamiento a razonamiento en menos de un minuto, y la inversa en unos 10 segundos.

Estrategia de implantación híbrida Proponemos una estrategia de despliegue híbrido para tareas de entrenamiento e inferencia que aprovecha los contenedores Sidecar de Kubernetes para compartir todas las GPUs disponibles con el fin de yuxtaponer ambas cargas de trabajo en un único pod. Las principales ventajas de esta estrategia son:

- Facilita el uso compartido y la gestión eficiente de los recursos y evita que los nodos de formación estén inactivos mientras esperan a los nodos de inferencia (cuando ambos están desplegados en nodos separados).

- Utilizando diferentes imágenes de despliegue, el entrenamiento y la inferencia pueden iterarse de forma independiente para mejorar el rendimiento.

- La arquitectura no se limita a vLLM y pueden integrarse fácilmente otros marcos.

motor de control El motor de control es responsable de gestionar el ciclo de vida del proceso vLLM, exponiendo API HTTP que activan diversas operaciones en vLLM. Para garantizar la coherencia y fiabilidad generales, utilizamos un sistema de metadatos global gestionado por el servicio etcd para difundir las operaciones y el estado.

Cuando se desinstala vLLM, puede resultar difícil liberar por completo la memoria de la GPU, principalmente debido a los gráficos CUDA, los búferes NCCL y los controladores NVIDIA. Para minimizar las modificaciones en vLLM, lo cerramos y reiniciamos cuando es necesario para mejorar la utilización de la GPU y la tolerancia a fallos.

La solución de Megatron convierte los puntos de control propios al formato Hugging Face en memoria compartida. Esta conversión también tiene en cuenta el paralelismo de canalización y el paralelismo experto, de modo que sólo se conserva el paralelismo tensorial en estos puntos de control. A continuación, los puntos de control de la memoria compartida se fragmentan y registran en el sistema de metadatos global. Utilizamos Mooncake para transferir los puntos de control entre nodos pares a través de RDMA. Se requieren algunas modificaciones en vLLM para cargar el archivo de pesos y realizar la transformación tensor-paralelo.

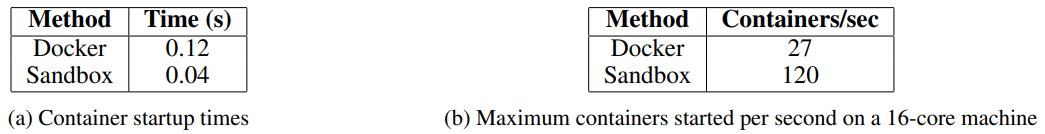

Desarrollamos el sandbox como un entorno seguro para ejecutar código enviado por el usuario que está optimizado para la ejecución de código y la evaluación comparativa de código. Al cambiar dinámicamente las imágenes contenedoras, el sandbox admite diferentes casos de uso a través de MultiPL-E (Cassano, Gouwar, D. Nguyen, S. Nguyen, et al. 2023), DMOJ Judge Server², Lean, Jupyter Notebook y otras imágenes.

Para la RL en tareas de codificación, Sandbox garantiza la fiabilidad de las valoraciones de los datos de formación proporcionando un mecanismo de evaluación coherente y repetible. Su sistema de retroalimentación admite evaluaciones en varias fases, como la retroalimentación de la ejecución del código y las ediciones a nivel de repositorio, al tiempo que mantiene un contexto uniforme para garantizar comparaciones de puntos de referencia justas e imparciales entre lenguajes de programación.

Hemos desplegado el servicio en Kubernetes para aumentar su escalabilidad y elasticidad, y lo hemos expuesto a través de un punto final HTTP para su integración externa.

Para optimizar el rendimiento y admitir entornos RL, hemos integrado varias tecnologías en nuestros servicios de ejecución de código para mejorar la eficacia, la velocidad y la fiabilidad. Entre ellas se incluyen:

- Uso de Crun: Utilizamos crun como tiempo de ejecución del contenedor en lugar de Docker, lo que reduce significativamente el tiempo de inicio del contenedor.

- Reutilización CgroupCreación previa de cgroups para su uso por parte de los contenedores, lo que resulta crítico en escenarios altamente concurrentes en los que la creación y destrucción de cgroups para cada contenedor puede suponer un cuello de botella.

- Optimización del uso del discoSistema de archivos: Se proporciona un espacio de almacenamiento de tamaño fijo y alta velocidad utilizando un sistema de archivos superpuesto montado como tmpfs para controlar las escrituras en disco. Este enfoque favorece las cargas de trabajo temporales.

Estas optimizaciones mejoran la eficacia de la RL en la ejecución del código, proporcionando así un entorno fiable y constante para evaluar el código generado por la RL, lo que resulta esencial para el entrenamiento iterativo y la mejora del modelo.

3 Experimentos

3.1 Evaluación

Dado que k1.5 es un modelo multimodal, realizamos una evaluación exhaustiva de los distintos modos en varias pruebas de referencia. La configuración detallada de la evaluación figura en el Apéndice C. Nuestras pruebas de referencia constan de las tres categorías principales siguientes:

- Evaluación comparativa de textos: MMLU (Hendrycks et al., 2020), IF-Eval (J. Zhou et al., 2023), CLUEWSC (L. Xu et al., 2020), C-EVAL (Y. Huang et al., 2023).

- Evaluación comparativa del razonamientoHumanEval-Mul, LiveCodeBench (Jain et al. 2024), Codeforces, AIME 2024, MATH-500 (Lightman et al. 2023)

- Evaluación comparativa visualMMMU (Yue, Ni, et al. 2024), MATH-Vision (K. Wang et al. 2024), MathVista (Lu et al. 2023).

3.2 Principales resultados

Modelo K1.5 long-CoT El rendimiento del modelo Kimi k1,5 long-CoT se muestra en la Tabla 2. La capacidad de inferencia a largo plazo del modelo ha mejorado significativamente gracias al ajuste supervisado de long-CoT (descrito en la sección 2.2) y al aprendizaje de refuerzo conjunto del texto visual (descrito en la sección 2.3). Las extensiones computacionales en tiempo de prueba mejoran aún más su rendimiento, lo que permite al modelo alcanzar resultados punteros en diversas modalidades. Nuestra evaluación revela mejoras significativas en la capacidad del modelo para razonar, comprender y sintetizar información en contextos ampliados, lo que representa avances en las capacidades de la IA multimodal.

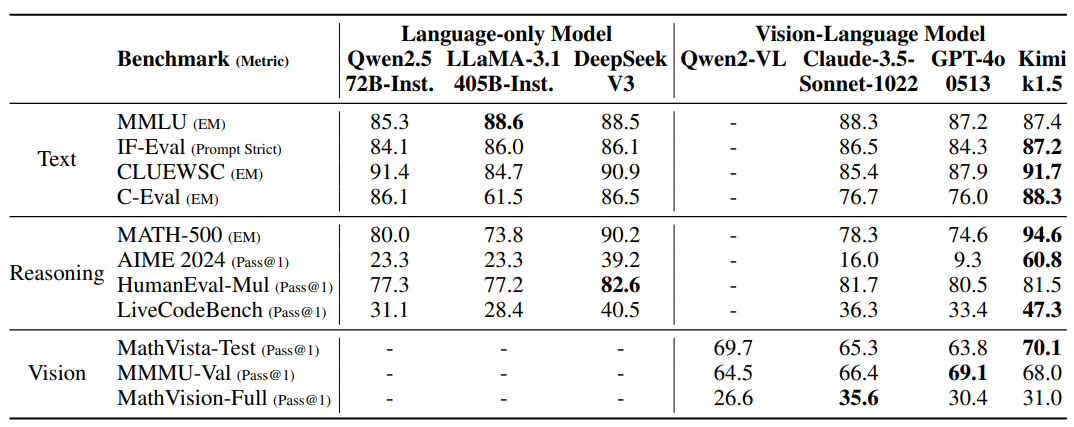

K1.5 modelo corto-CoT En la Tabla 3 se muestra el rendimiento del modelo Kimi k1.5 short-CoT. Este modelo integra diversas técnicas, como el ajuste fino supervisado tradicional (analizado en la sección 2.5.2), el aprendizaje por refuerzo (analizado en la sección 2.3) y el refinamiento de largo a corto (descrito en la sección 2.4). Los resultados muestran que el modelo k1.5 short-CoT ofrece un rendimiento competitivo o superior en una serie de tareas en comparación con los principales modelos de código abierto y patentados. Se trata de tareas textuales, visuales y de razonamiento, con ventajas significativas en comprensión del lenguaje natural, matemáticas, codificación y razonamiento lógico.

Tabla 2: Rendimiento de Kimi k1.5 long-CoT y modelos insignia de código abierto y propietarios.

Tabla 3: Rendimiento de Kimi k1.5 short-CoT y modelos emblemáticos de código abierto y propietarios.El rendimiento del modelo VLM se obtuvo a partir de la plataforma de evaluación comparativa OpenCompass (https://opencompass.org.cn/).

3.3 Extensión del contexto largo

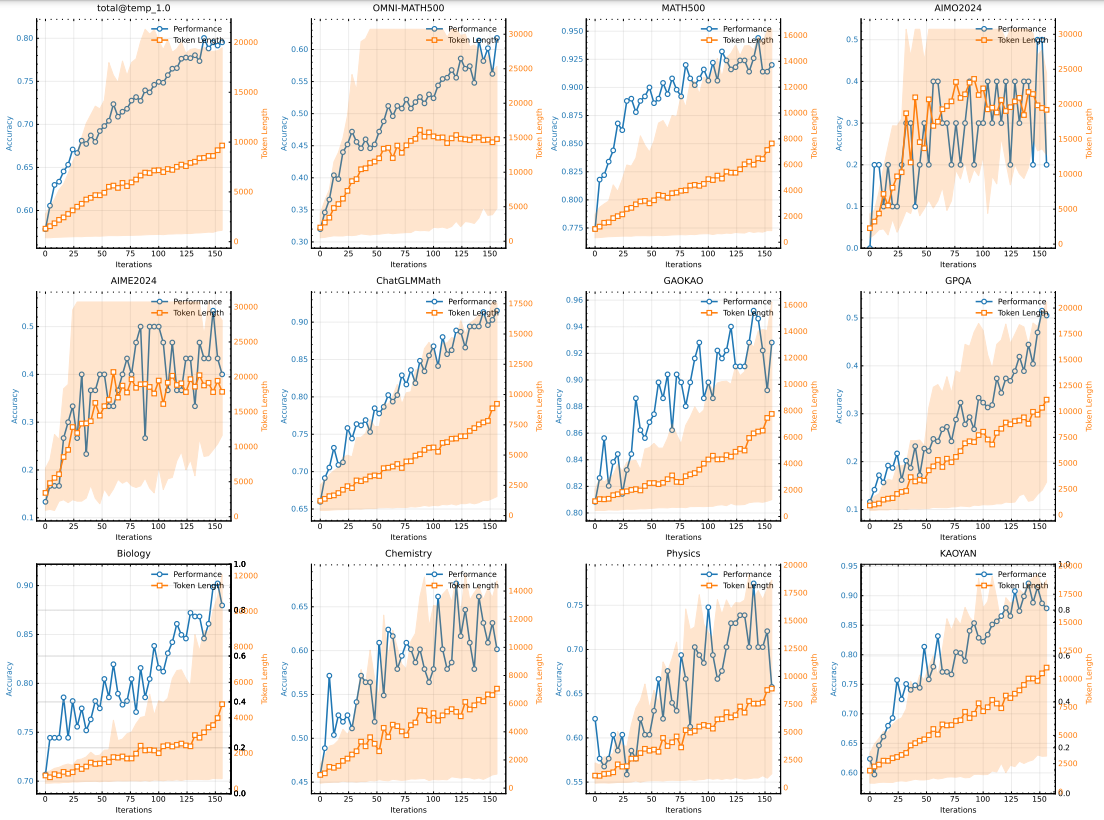

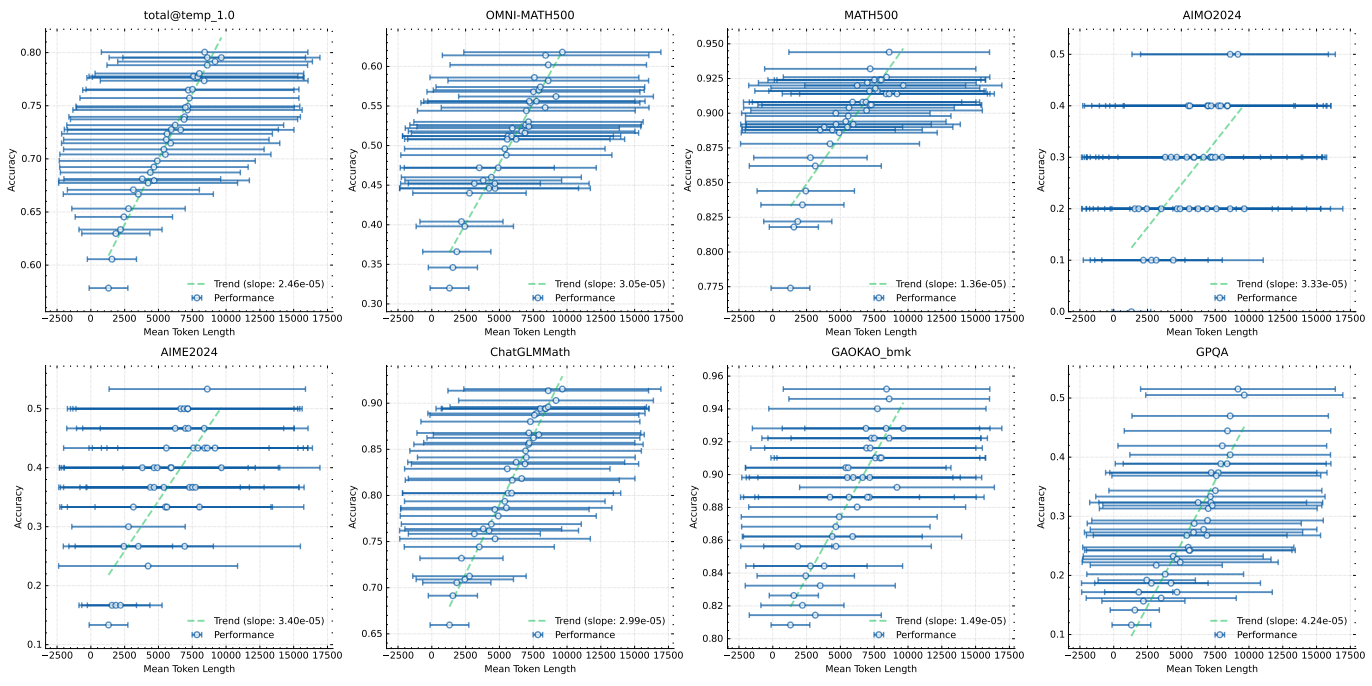

Utilizamos un modelo de tamaño medio para investigar las propiedades ampliadas del RL con LLM. La Figura 5 ilustra la evolución de la precisión del entrenamiento y la longitud de la respuesta a lo largo de las iteraciones de entrenamiento para la variante de modelo pequeño entrenada con el conjunto de pistas matemáticas. A medida que avanza el entrenamiento, observamos un aumento simultáneo de la longitud de la respuesta y de la precisión del rendimiento. En particular, la longitud de la respuesta aumenta más rápidamente en las pruebas de referencia más difíciles, lo que sugiere que el modelo aprende a generar soluciones más detalladas para problemas complejos. La figura 6 muestra una fuerte correlación entre la longitud del contexto de salida del modelo y su capacidad para resolver problemas. Nuestra última ejecución de k1,5 amplía la longitud del contexto a 128k y observa una mejora continua en las pruebas de referencia de inferencia difícil.

Figura 5: Cambios en la precisión y la longitud del entrenamiento a medida que aumenta el número de iteraciones de entrenamiento. Obsérvese que las puntuaciones anteriores proceden del modelo long-cot interno, que tiene un tamaño de modelo mucho menor que el modelo long-CoT k1.5. El área sombreada indica el percentil 95 de la longitud de respuesta.

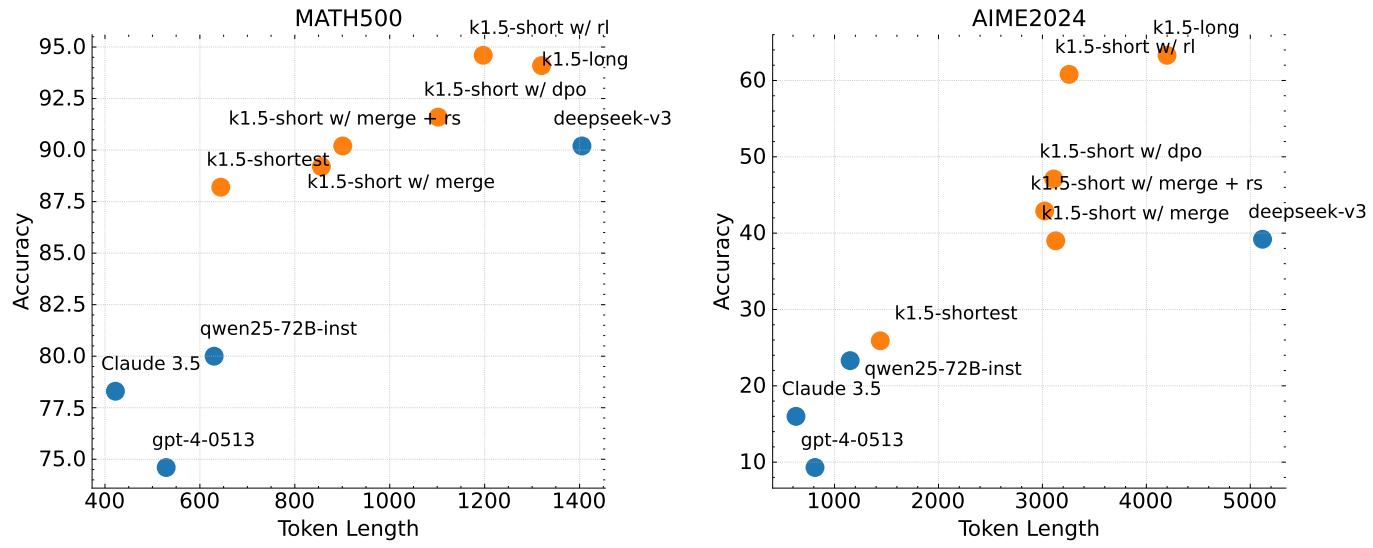

3.4 Long2short

Comparamos el algoritmo RL long2short propuesto con los métodos DPO, muestreo de rechazo más corto y fusión de modelos introducidos en la Sección 2.4, centrándonos en la eficiencia Token del problema long2short (X. Chen et al., 2024), y en particular en cómo hacer que los modelos long-cot obtenidos beneficien a los modelos short. En la Fig. 7, k1.5-long denota el modelo long-cot que elegimos para el entrenamiento long2short. k1.5-short w/ rl se refiere al modelo short obtenido mediante el entrenamiento long2short RL. k1.5-short w/ dpo denota el modelo short que se entrena para mejorar la eficiencia Token mediante el entrenamiento DPO. k1.5-short w/ merge denota la fusión de modelos. short w/ merge denota el modelo tras la fusión de modelos, mientras que k1.5-short w/ merge + rs denota el modelo corto obtenido aplicando el muestreo de rechazo más corto al modelo fusionado. k1.5-shortest denota el modelo más corto que obtuvimos durante el entrenamiento long2short. Como se muestra en la Fig. 7, el algoritmo RL long2short propuesto exhibe la mayor eficiencia Token en comparación con otros métodos como la OPD y la fusión de modelos. Cabe destacar que todos los modelos de la familia k1.5 (marcados en naranja) muestran una mayor eficacia de Token que los demás modelos (marcados en azul). Por ejemplo, k1.5-short con rl obtiene una puntuación Pass@1 de 60,8 en AIME2024 (con una media de 8 ejecuciones) y sólo utiliza una media de 3.272 tokens. k1.5-shortest también obtiene una puntuación Pass@1 de 88,2 en MATH500 y consume aproximadamente el mismo número de tokens que otros modelos cortos. cortos.

Figura 6: El rendimiento del modelo mejora al aumentar la longitud de la respuesta

Figura 7: Rendimiento de Long2Short. Todas las familias k1.5 demuestran mejor eficiencia Token que otros modelos.

3.5 Estudios de ablación

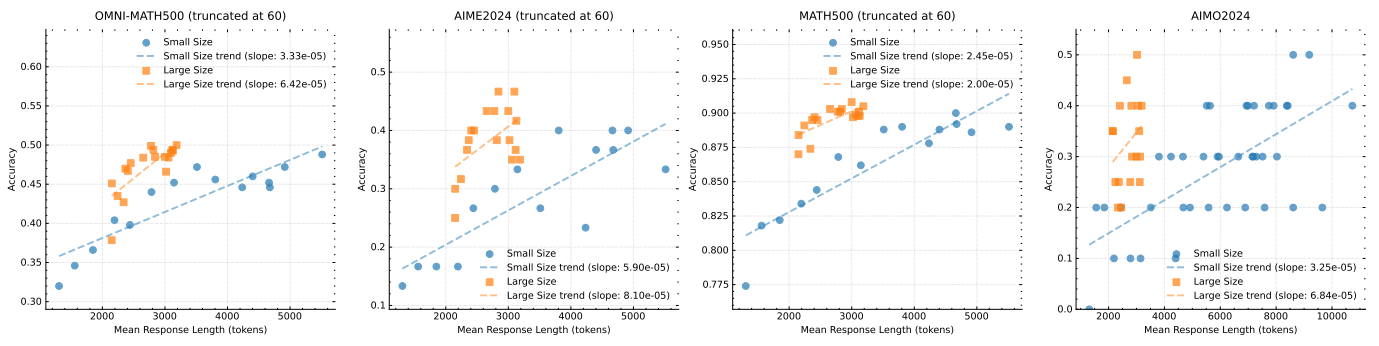

Ampliación del tamaño del modelo y de la longitud del contexto Nuestra principal contribución consiste en aplicar la RL para mejorar la capacidad de los modelos de generar CoT ampliados y mejorar así su inferencia. Una pregunta natural es: ¿cómo se compara esto con el simple aumento del tamaño del modelo? Para demostrar la eficacia de nuestro enfoque, entrenamos dos modelos de diferentes tamaños utilizando el mismo conjunto de datos y registramos los resultados de la evaluación y las longitudes medias de inferencia en todos los puntos de control durante el entrenamiento de RL. Estos resultados se muestran en la Fig. 8. Cabe señalar que, aunque el modelo de mayor tamaño supera inicialmente al de menor tamaño, el modelo de menor tamaño puede lograr un rendimiento comparable aprovechando el CoT más largo optimizado por la RL. Sin embargo, los modelos más grandes suelen mostrar una mayor eficacia de Token que los modelos más pequeños. Esto también sugiere que si el objetivo es obtener el mejor rendimiento posible, la ampliación de la longitud del contexto de los modelos más grandes tiene un límite superior más alto y es más eficiente en Token. Sin embargo, entrenar modelos más pequeños con longitudes de contexto más largas puede ser una solución viable si el cálculo se presupuesta en el momento de la prueba.

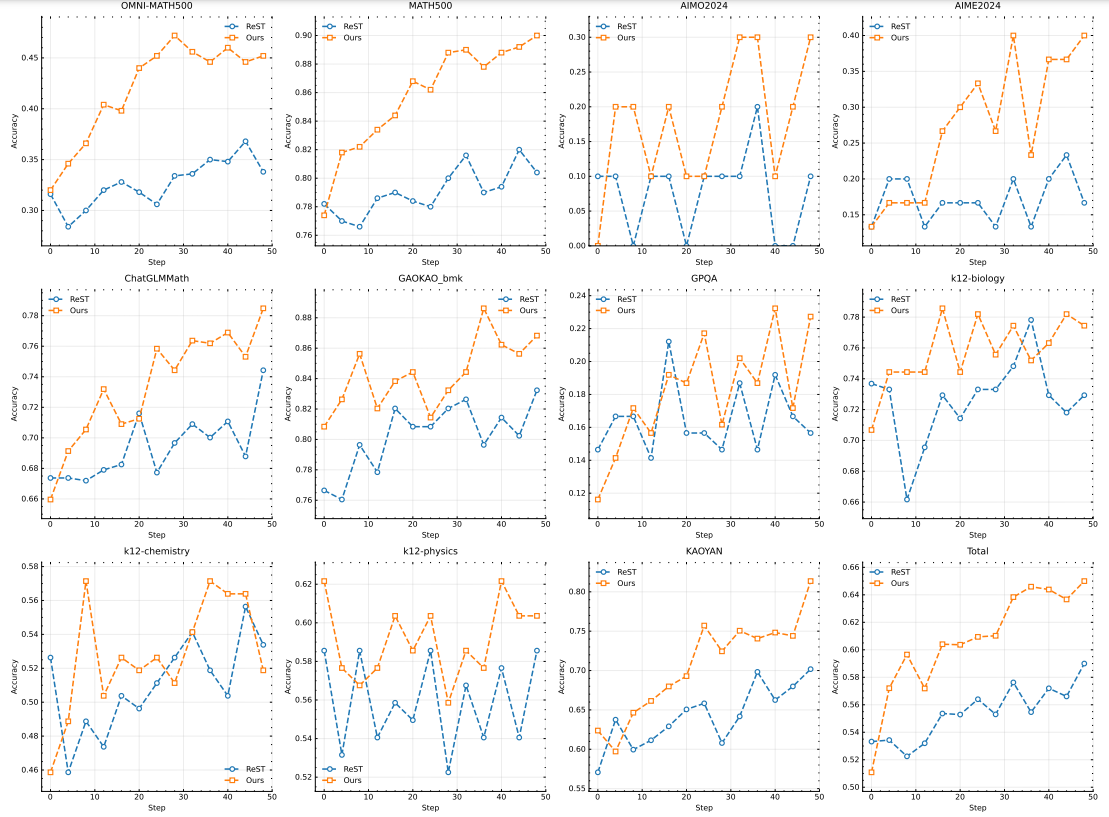

Efectos del uso de gradientes negativos Investigamos la eficacia de utilizar ReST (Gulcehre et al., 2023) como algoritmo de optimización de políticas en nuestra configuración.La principal diferencia entre ReST y otros métodos basados en RL, incluido el nuestro, es que ReST mejora iterativamente el modelo ajustando la mejor respuesta muestreada del modelo actual sin aplicar un gradiente negativo para penalizar las respuestas incorrectas. Como se muestra en la Fig. 10, nuestro método exhibe una mayor complejidad de muestreo en comparación con ReST, lo que sugiere que la incorporación de gradientes negativos mejora significativamente la eficiencia del modelo en la generación de Long-CoTs. Nuestro enfoque no sólo mejora la calidad de la inferencia, sino que también optimiza el proceso de entrenamiento, lo que se traduce en un rendimiento robusto utilizando menos muestras de entrenamiento. Este hallazgo sugiere que la elección del algoritmo de optimización de políticas es crucial en nuestro entorno, ya que la diferencia de rendimiento entre ReST y otros métodos basados en RL no es tan pronunciada en otros dominios como en (Gulcehre et al. 2023). Así pues, nuestros resultados ponen de relieve la importancia de elegir una estrategia de optimización adecuada para maximizar la eficiencia en la generación de CoTs largas.

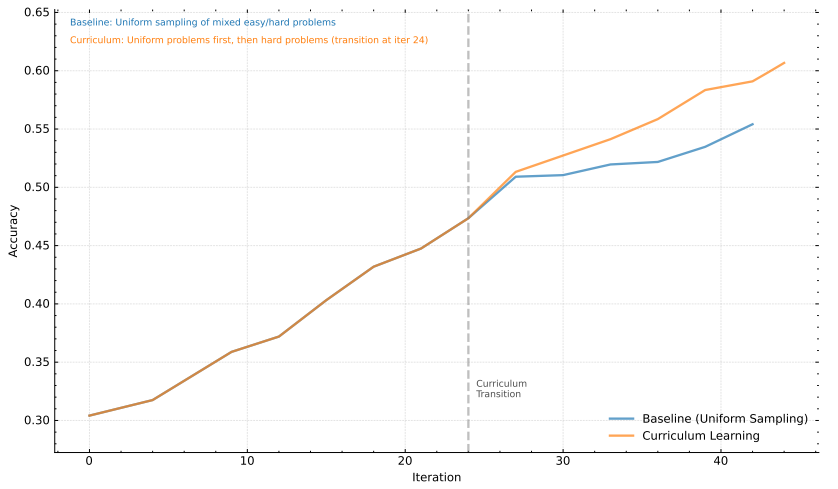

estrategia de muestreo Además, demostramos la eficacia de la estrategia de muestreo de cursos introducida en la sección 2.3.4. Nuestro conjunto de datos de entrenamiento D contiene problemas de varios niveles de dificultad. Con nuestro enfoque de muestreo por cursos, inicialmente utilizamos D para una fase de calentamiento y después entrenamos el modelo centrándonos sólo en los problemas difíciles. Este método se compara con un método de referencia que utiliza una estrategia de muestreo uniforme sin ningún ajuste de curso. Como se muestra en la Fig. 9, nuestros resultados muestran claramente que el enfoque de muestreo de cursos propuesto mejora significativamente el rendimiento. Esta mejora puede atribuirse a la capacidad del método para desafiar progresivamente al modelo, permitiéndole desarrollar una mayor comprensión y capacidad para hacer frente a problemas complejos. Al centrar los esfuerzos de entrenamiento en problemas más difíciles tras una generalización inicial, el modelo puede reforzar mejor sus capacidades de razonamiento y resolución de problemas.

Figura 8: Rendimiento del modelo en función de la longitud de la respuesta para distintos tamaños de modelo

Figura 9: Análisis del enfoque de aprendizaje del curso sobre el rendimiento del modelo.

4 Conclusiones

Presentamos la receta de entrenamiento y el diseño del sistema para k1.5, nuestro último LLM multimodal entrenado mediante RL. Una de las principales conclusiones que extraemos de la práctica es que el escalado de la longitud del contexto es fundamental para la mejora continua de los LLM. Empleamos algoritmos de aprendizaje optimizados y optimizaciones de infraestructura, como el despliegue parcial, para lograr un entrenamiento eficiente de la RL de contexto largo. Cómo mejorar aún más la eficiencia y escalabilidad del entrenamiento de RL de contexto largo sigue siendo un importante camino a seguir.

Figura 10: Comparación de la optimización de políticas mediante ReST.

Otra de nuestras aportaciones consiste en combinar múltiples técnicas para mejorar la optimización de las políticas. En concreto, formulamos RL de CoT larga mediante LLM y derivamos variantes del descenso especular en línea para una optimización robusta. También experimentamos con estrategias de muestreo, penalizaciones de longitud y formulación óptima de datos para lograr un rendimiento robusto de la RL.

Demostramos que, incluso sin utilizar técnicas más sofisticadas (por ejemplo, la búsqueda en árbol de Monte Carlo, funciones de valor y modelos de recompensa de procesos), se puede lograr un rendimiento sólido con extensiones de contexto largas y una optimización mejorada de las políticas. En el futuro, también sería interesante investigar cómo mejorar la asignación de créditos y reducir el exceso de pensamiento sin comprometer las capacidades de exploración del modelo.

También observamos el potencial de los métodos long2short. Estos métodos mejoran en gran medida el rendimiento del modelo short-CoT. Además, los métodos long2short pueden combinarse con el RL long-CoT de forma iterativa para mejorar aún más la eficacia de Token y extraer el mejor rendimiento para un presupuesto de longitud de contexto determinado.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...