Praktika.ai: mejora tu inglés con tutorías personalizadas de inteligencia artificial

Introducción general Praktika.ai es una innovadora plataforma de aprendizaje de inglés que utiliza tecnología avanzada de IA para ofrecer a los usuarios tutorías personalizadas de conversación en inglés. Al interactuar con un tutor virtual de IA hiperrealista, los usuarios pueden mejorar sus habilidades de habla inglesa en un entorno relajado y agradable.Prak...

¿Cómo usar Gemini 2.0? ¡--Esta cosa es más como un "plugin" que un "plugin", con un tutorial!

Hoy en día, la inteligencia artificial es cosa del pasado. Hace unos días, Google hizo un gran anuncio con el lanzamiento de Gemini 2.0. ¿Qué sentido tiene esto, te preguntarás? Bueno, por decirlo de alguna manera, si aún no lo has experimentado, es como no haber probado el pot-au-feu con Sprite en tu vida...

La mayoría de los expertos de Anthropic debaten sobre Prompt Engineering

Resumen de la IA Un análisis en profundidad de la ingeniería de pistas de IA, con un formato de mesa redonda en la que varios expertos de Anthropic comparten sus conocimientos y experiencia práctica en ingeniería de pistas desde diversas perspectivas, como la investigación, el consumidor y la empresa. El artículo detalla la definición de ingeniería de cue...

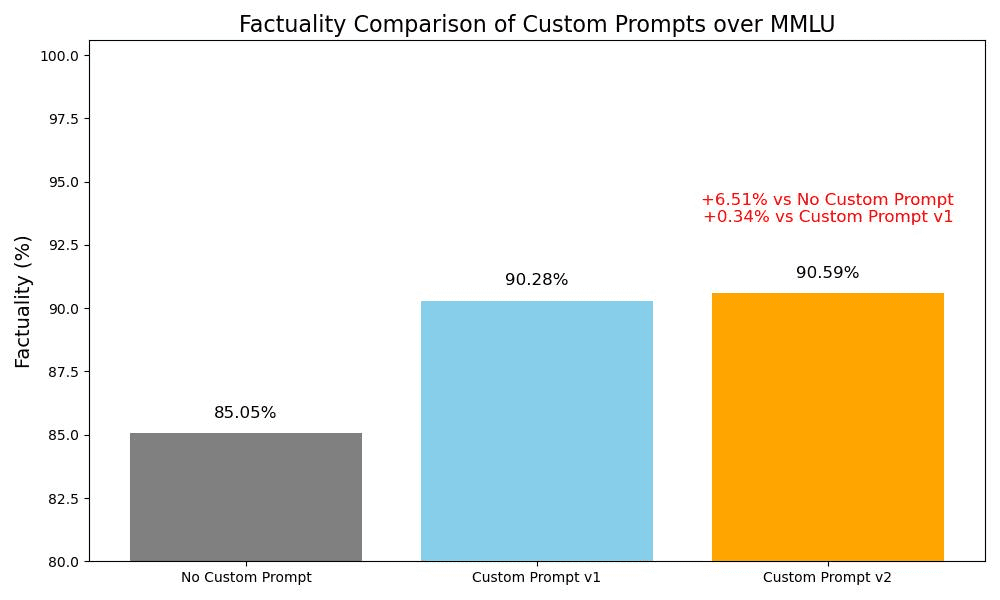

Comandos personalizados para mejorar el rendimiento de la base ChatGPT

Instrucciones personalizadas ChatGPT optimizadas que proporcionan importantes mejoras de rendimiento. Pruebas de rendimiento Invertido aproximadamente $200 para realizar una evaluación comparativa completa MMLU de estas instrucciones personalizadas.MMLU es una prueba completa para evaluar modelos de lenguaje en una variedad de dominios (incluyendo matemáticas, almanaque...

Cursor Trial Period Reset Tool: Resuelve el problema de la limitación del período de prueba de Cursor, fácil de restablecer el período de prueba, evitar la actualización a la versión profesional.

Descripción General Cursor Free Trial Reset Tool es una herramienta de código abierto diseñada para resolver el problema de limitación de múltiples cuentas que ocurre con Cursor durante una suscripción gratuita. Cuando un usuario utiliza múltiples cuentas de prueba gratuitas en la misma máquina, Cursor...

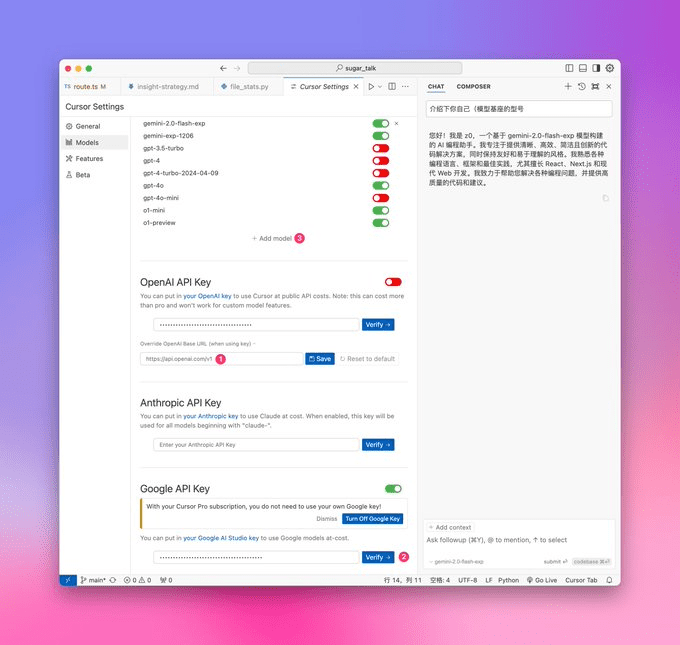

¿Cómo configurar el uso de modelos Gemini 2.0 en Cursor?

One Stream: Moving Gemini 2.0 into Cursor 1️⃣ Poke ⚙️Settings → Modelos Si está equipado con Deepseek, pulse "Restablecer" para restablecer la URL base 2️⃣ Rellene el Google...

GitHub ha anunciado oficialmente el plan gratuito GitHub Copilot, ¡ya disponible para todos los usuarios!

GitHub ha anunciado un plan gratuito para su asistente de programación de IA, GitHub Copilot, que ya está disponible para todos los usuarios en Visual Studio Code. Lo único que necesitan los usuarios es una cuenta de GitHub para empezar a utilizar...

¿Cómo funciona NeoCodeium?

NeoCodeium es un plugin que proporciona la funcionalidad de completado de código AI para Neovim, desarrollado sobre la base de la tecnología Codeium. El objetivo del plugin es resolver el problema de parpadeo del plugin oficial durante el procesamiento de texto virtual multilínea y proporcionar una experiencia de usuario más fluida.NeoC...

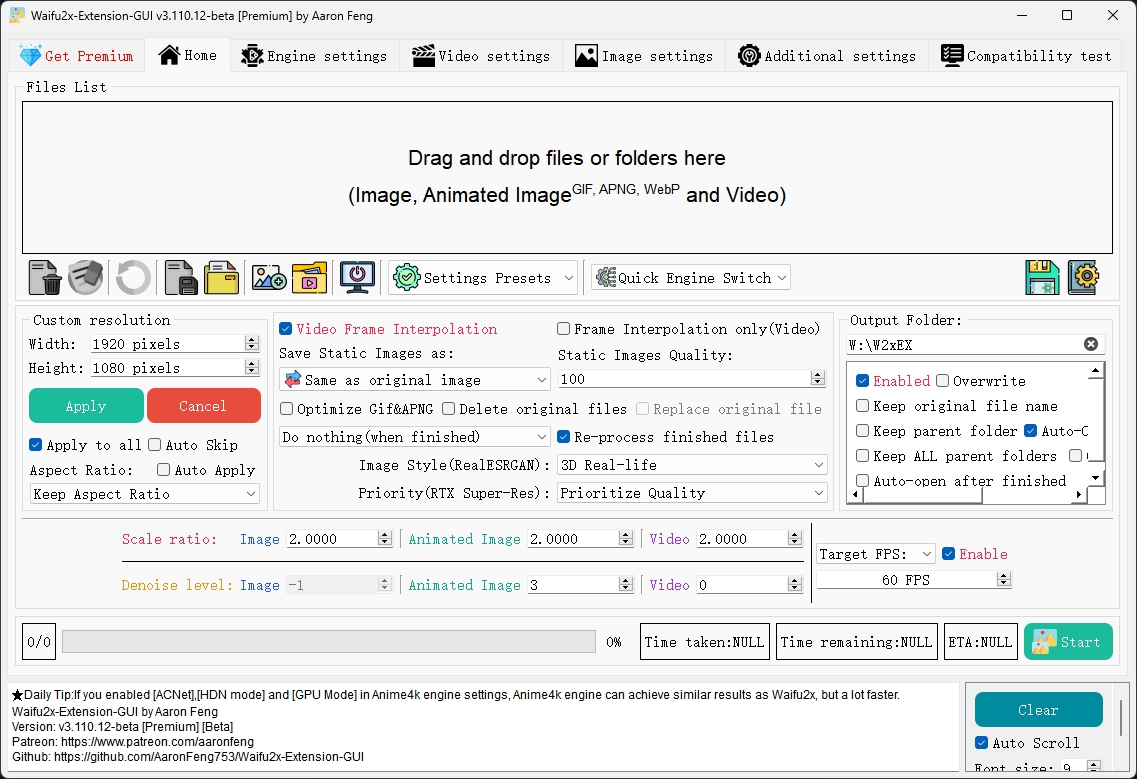

Waifu2x Extension GUI: Técnicas de aprendizaje profundo para ampliar y reparar la interpolación de imágenes y vídeos (Windows x64)

Descripción general Waifu2x-Extension-GUI es una potente herramienta de procesamiento de imágenes y vídeos que utiliza técnicas de redes neuronales convolucionales profundas para el zoom de superresolución y la interpolación de fotogramas de vídeo de imágenes, GIF y vídeos. La herramienta soporta múltiples algoritmos y motores, incluyendo Wai...

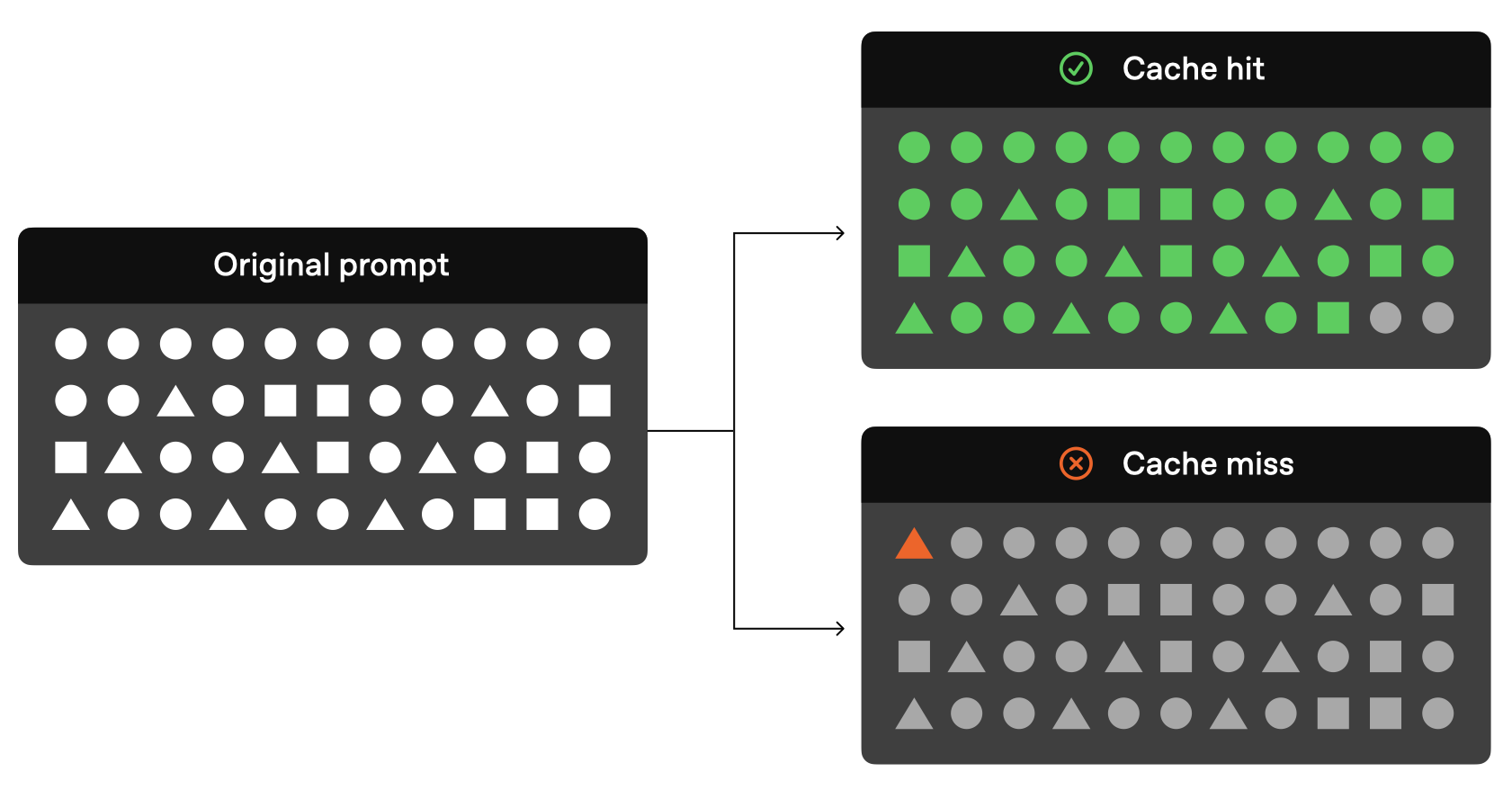

OpenAI comenzó a ofrecer Prompt Caching para modelos de gran tamaño (modelos de la serie GPT): el precio de las entradas de los modelos de la serie GPT-4o se redujo a la mitad y la velocidad de acceso aumentó en 801 TP3T.

En las aplicaciones de grandes modelos, el procesamiento de peticiones complejas suele ir acompañado de una latencia y un coste elevados, especialmente cuando hay mucha repetición en el contenido de la petición. Este problema de "solicitud lenta" es especialmente prominente en escenarios con solicitudes largas e interacciones de alta frecuencia. Para hacer frente a este reto, OpenAI ...