¿Cuánto tiempo de vídeo puede entender un modelo grande? Smart Spectrum GLM-4V-Plus: 2 horas

Basándonos en las dos primeras generaciones de modelos de vídeo (CogVLM2-Video y GLM-4V-PLUS), hemos optimizado aún más nuestras técnicas de comprensión de vídeo con el lanzamiento de la versión beta GLM-4V-Plus-0111. Esta versión introduce técnicas como la resolución variable nativa para mejorar ...

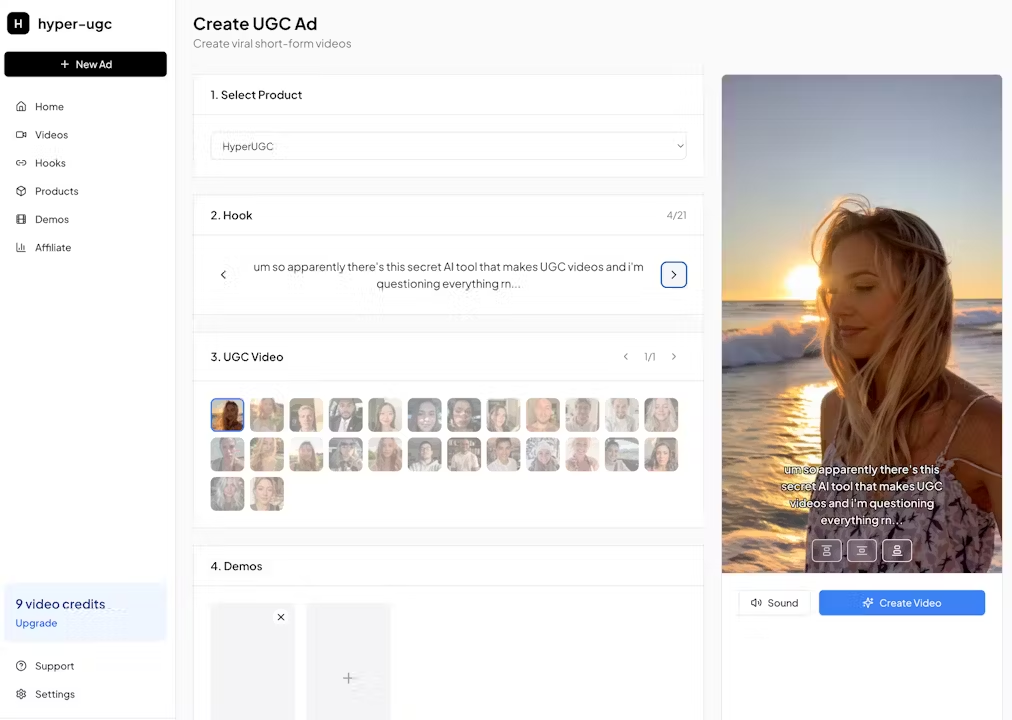

HyperUGC: Generación de vídeos UGC reales con avatares de IA

Introducción general HyperUGC es una plataforma innovadora que utiliza tecnología de IA para generar vídeos de contenido generado por el usuario (CGU) de alta calidad. La plataforma está diseñada para sustituir a los costosos creadores de contenidos mediante la generación de contenidos de vídeo auténticos y atractivos en cuestión de minutos a través de avatares de IA.Hype...

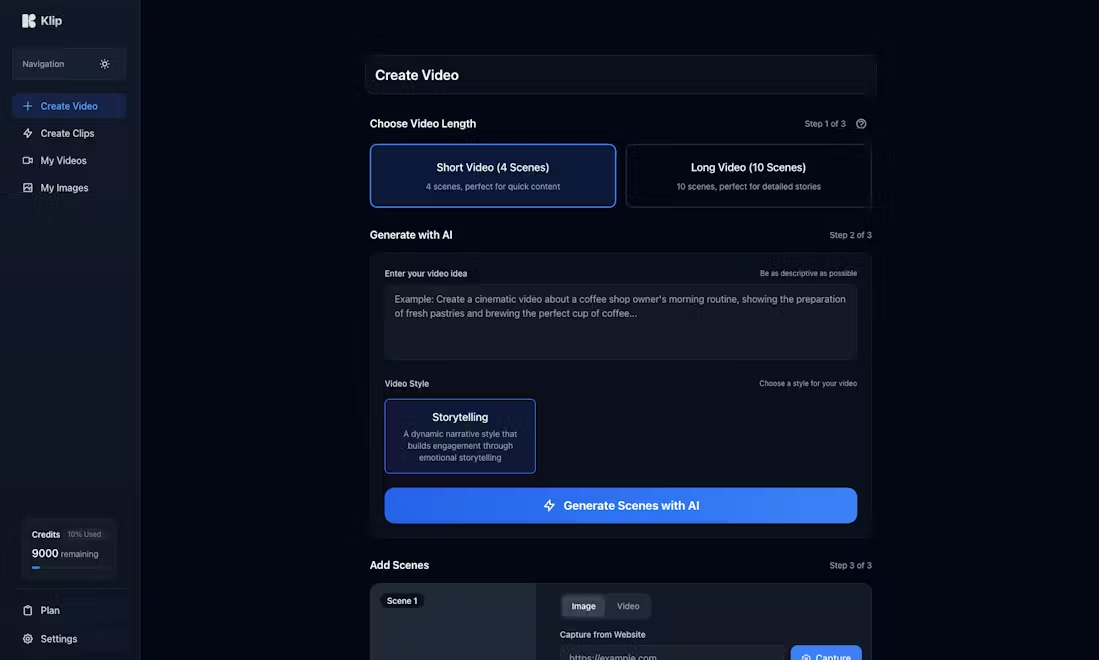

KlipML: Creación y edición de vídeos cortos de marketing viral mediante agentes inteligentes de IA

Introducción general KlipML es una plataforma avanzada de creación de vídeo con IA diseñada para ayudar a los usuarios a generar rápidamente vídeos profesionales. Ya se trate de contenido de marketing, vídeos educativos o clips cortos para redes sociales, KlipML simplifica el proceso de producción de vídeo con sus potentes capacidades de IA. La plataforma ofrece agentes de IA...

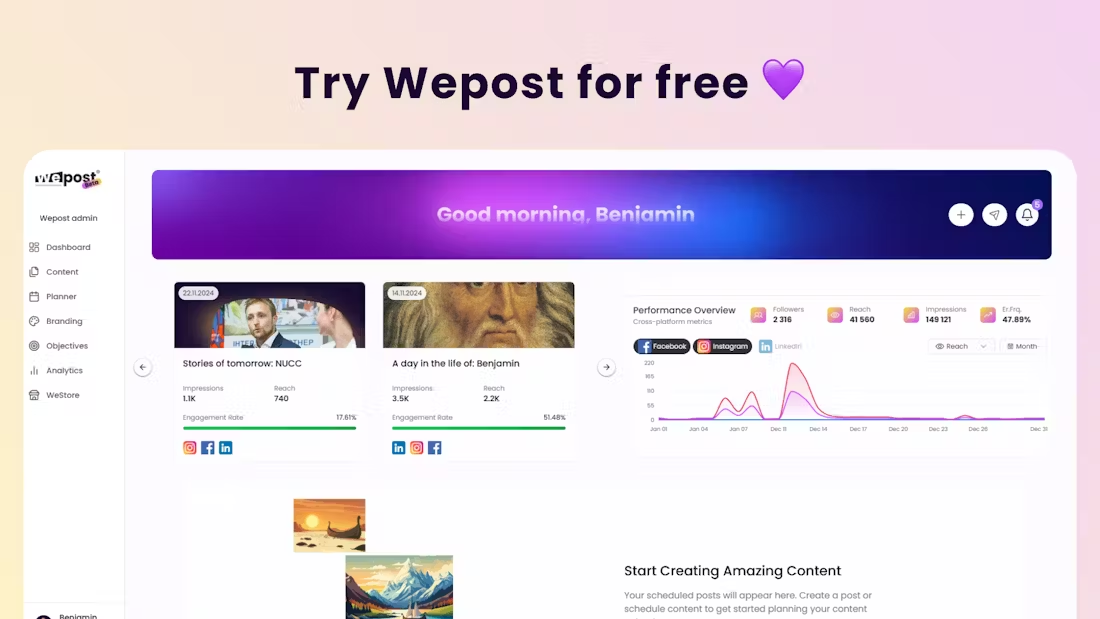

Wepost: una plataforma de inteligencia artificial que simplifica la creación y gestión de contenidos en redes sociales

Descripción general Wepost es una plataforma de marketing de contenidos diseñada para profesionales del marketing muy ocupados que utiliza tecnología de inteligencia artificial para ayudar a los usuarios a crear contenidos de marca de alta calidad. La plataforma integra funciones de planificación, creación, publicación y análisis de contenidos diseñadas para agilizar los flujos de trabajo y aumentar la eficacia del marketing de contenidos. Los usuarios...

Llasa 1~8B: un modelo de conversión de texto en habla de código abierto para la generación y clonación de habla de alta calidad

Introducción general Llasa-3B es un modelo de conversión de texto a voz (TTS) de código abierto desarrollado por el Laboratorio de Audio de la Universidad de Ciencia y Tecnología de Hong Kong (HKUST Audio). El modelo se basa en la arquitectura Llama 3.2B, que ha sido cuidadosamente ajustada para proporcionar una generación de voz de alta calidad que no sólo soporta múltiples...

Fast GraphRAG: una herramienta de generación de mejoras de búsqueda gráfica de gran precisión y bajo coste

Introducción completa Fast GraphRAG es una herramienta de código abierto desarrollada por Circlemind AI para permitir una generación de aumento de recuperación (RAG) eficiente y precisa mediante algoritmos de grafos de conocimiento y PageRank. La herramienta se adapta de forma inteligente al uso que el usuario...

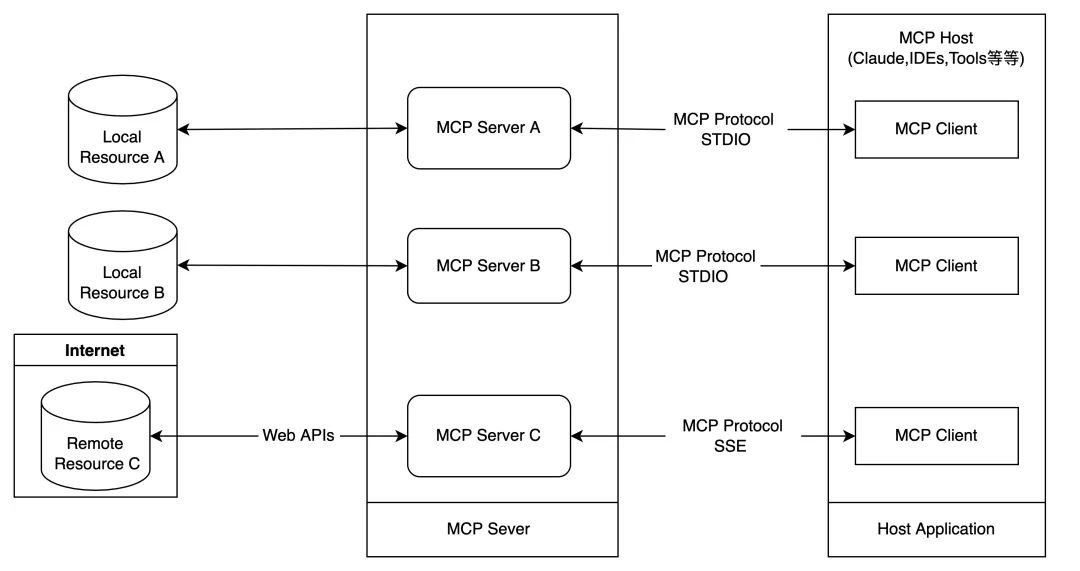

Explicación del desarrollo de servidores MCP y Python

Un primer vistazo a MCP MCP (Model Context Protocol), es un protocolo desarrollado para estandarizar la forma en que las aplicaciones proporcionan contexto para grandes modelos.MCP proporciona una forma estándar de proporcionar datos, herramientas para LLMs.El uso de MCP facilitará la con...

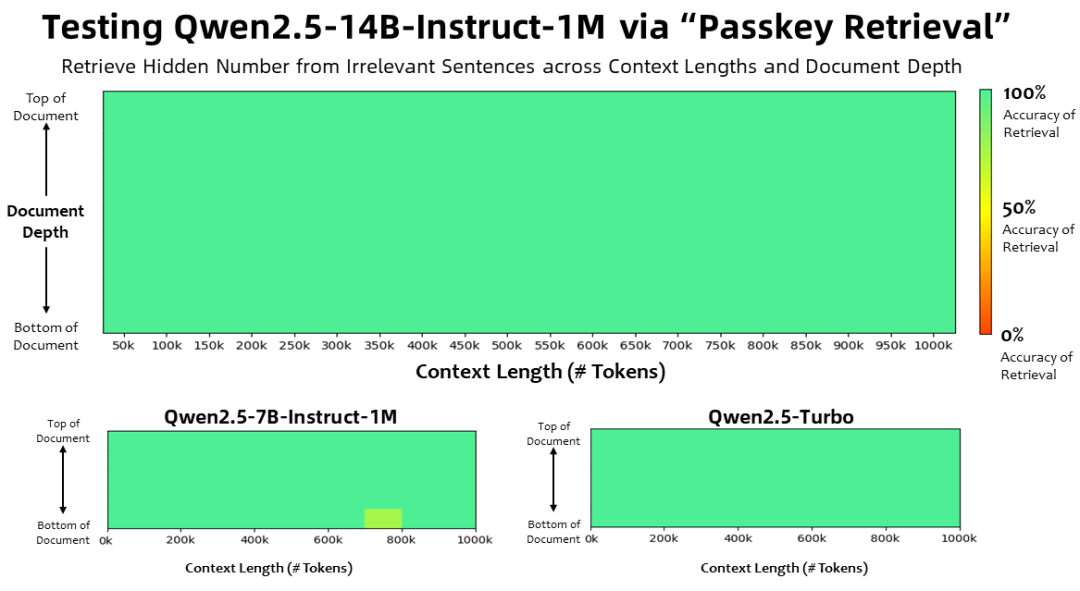

Qwen2.5-1M: Un modelo Qwen de código abierto compatible con un millón de contextos de tokens

1. Introducción Hace dos meses, el equipo de Qwen actualizó Qwen2.5-Turbo para soportar longitudes de contexto de hasta un millón de Tokens. Hoy, Qwen ha lanzado oficialmente el modelo de código abierto Qwen2.5-1M y su correspondiente soporte de marco de inferencia. A continuación...

¡Lanzamiento del modelo de inferencia Arigatou Ziyou-o1! Primera explicación paso a paso de los resultados que puede implementarse en tarjetas gráficas de consumo

2025 el comienzo del año, la industria de la IA puso en marcha un gran modelo de "marea de razonamiento", desde OpenAI lanzado o1, varios modelos de razonamiento siguen surgiendo, la capacidad de razonamiento de orden superior del modelo marcó el comienzo de la mejora del valor de su aplicación es también cada vez más para obtener la atención generalizada de la industria. Recientemente, NetEase ha lanzado oficialmente la primera salida nacional paso a paso ...

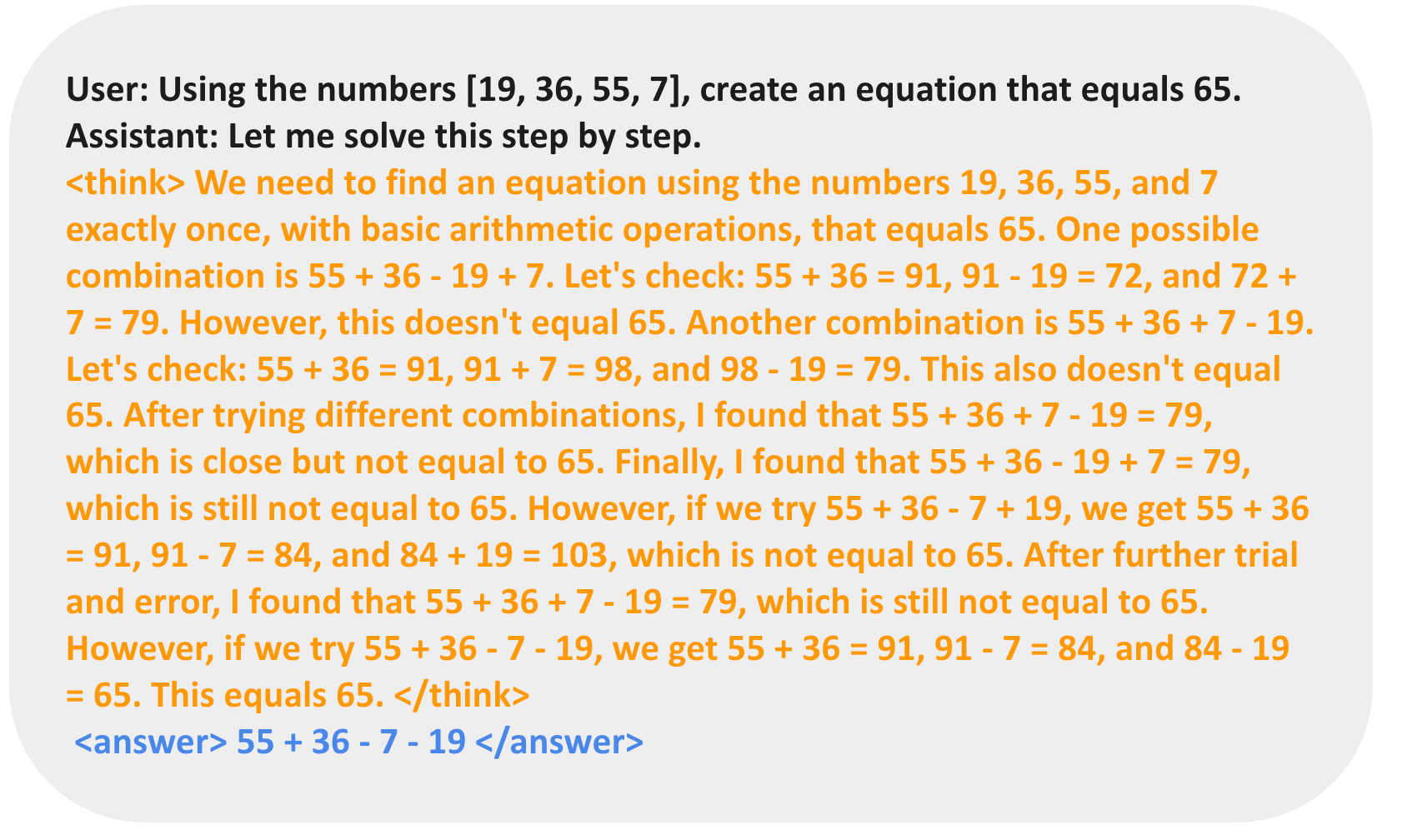

TinyZero: una réplica de bajo coste del efecto epifánico de DeepSeeK-R1 Zero

Introducción general TinyZero es un modelo de aprendizaje por refuerzo basado en veRL diseñado para replicar el rendimiento de DeepSeeK-R1 Zero en tareas de cuenta atrás y multiplicación. Sorprendentemente, el proyecto solo cuesta 30 dólares de ejecución (utilizando 2xH2...