AnyText: Genera y edita texto de imagen multilingüe, altamente controlable para generar múltiples líneas de chino en la imagen.

Últimos recursos sobre IAPublicado hace 1 año Círculo de intercambio de inteligencia artificial 65.7K 00

Introducción general

AnyText es una revolucionaria herramienta de generación y edición de texto visual multilingüe desarrollada a partir del modelo de difusión. Genera texto multilingüe natural y de alta calidad en imágenes y admite funciones flexibles de edición de texto. Desarrollado por un equipo de investigadores y galardonado con la mención Spotlight en el ICLR 2024, el punto fuerte de AnyText reside en su exclusiva arquitectura de dos módulos: el módulo de potencial auxiliar codifica la información de glifos, posición e imagen enmascarada del texto, mientras que el módulo de incrustación de texto procesa los datos de trazos mediante un modelo OCR. El proyecto también proporciona el conjunto de datos AnyWord-3M, el primer conjunto de datos multilingüe de imágenes de texto que contiene 3 millones de pares con anotaciones OCR, lo que supone una importante referencia de evaluación para el campo de la generación de texto visual.

Experiencia: https://modelscope.cn/studios/damo/studio_anytext/summary

Dirección alternativa: https://huggingface.co/spaces/modelscope/AnyText

Lista de funciones

- Generación de texto multilingüe: soporte para generar texto multilingüe en imágenes.

- Editor de texto: Puede editar y modificar el contenido del texto de las imágenes existentes.

- Control de estilo: posibilidad de cambiar el estilo del texto generado a través del modelo base o del modelo LoRA.

- Aceleración de inferencia FP16: admite inferencia rápida, funciona en GPU con más de 8 GB de memoria de vídeo.

- Traducción al chino y al inglés: modelo integrado de traducción al chino y al inglés, posibilidad de introducir directamente palabras en chino.

- Fuentes personalizadas: permite a los usuarios utilizar sus propios archivos de fuentes.

- Procesamiento por lotes: admite la generación y edición por lotes de texto de imágenes.

- Fusión de modelos: posibilidad de fusionar el modelo comunitario y las ponderaciones del modelo LoRA

Utilizar la ayuda

1. Instalación medioambiental

- Primero asegúrate de que Git está instalado en tu sistema:

conda install -c anaconda git

- Clona el código del proyecto:

git clone https://github.com/tyxsspa/AnyText.git

cd AnyText

- Prepare el archivo de fuentes (se recomienda Arial Unicode MS):

mv your/path/to/arialuni.ttf ./font/Arial_Unicode.ttf

- Crear y activar el entorno:

conda env create -f environment.yaml

conda activate anytext

2. Modalidades de utilización

2.1 Inicio rápido

La forma más sencilla de comprobarlo es ejecutar el siguiente comando:

python inference.py

2.2 Lanzar una presentación interactiva

La interfaz de demostración se recomienda para las GPU mejor configuradas (8 GB o más de memoria de vídeo):

export CUDA_VISIBLE_DEVICES=0 && python demo.py

2.3 Configuración avanzada

- Utiliza la precisión FP32 y desactiva el traductor:

export CUDA_VISIBLE_DEVICES=0 && python demo.py --use_fp32 --no_translator

- Utilice fuentes personalizadas:

export CUDA_VISIBLE_DEVICES=0 && python demo.py --font_path your/path/to/font/file.ttf

- Cargar puntos de control específicos:

export CUDA_VISIBLE_DEVICES=0 && python demo.py --model_path your/path/to/your/own/anytext.ckpt

3. Ajustes estilísticos

En la interfaz de demostración, el estilo del texto generado puede ajustarse de dos maneras:

- Cambiar modelo base: introduzca la ruta del modelo base local en [Ruta del modelo base].

- Cargar modelo LoRA: introduzca la ruta del modelo LoRA y la proporción de peso en [Ruta y proporción LoRA], por ejemplo:

/path/of/lora1.pth 0.3 /path/of/lora2.safetensors 0.6

4. Optimización del rendimiento

- Se utiliza la inferencia FP16 por defecto, con los modelos de traducción chino e inglés cargados (ocupando unos 4 GB de memoria de vídeo).

- Si se utiliza FP16 y no se emplea ningún modelo de traslación, una sola imagen de 512x512 sólo requiere unos 7,5 GB de memoria de vídeo.

- La primera vez que se ejecuta, los archivos del modelo se descargan en la carpeta

~/.cache/modelscope/hubdirectorio (en el disco duro del ordenador) - Esto puede hacerse configurando la variable de entorno

MODELSCOPE_CACHEModificar el directorio de descarga

5. Precauciones

- Asegúrese de que está instalada la versión correcta del paquete de dependencias.

- El uso de fuentes personalizadas puede afectar a la generación

- La primera ejecución del modelo requiere la descarga de los archivos pertinentes

- Se recomienda utilizar una GPU con 8 GB de memoria de vídeo o más.

AnyText genera imágenes instrucciones de operación

ejemplo de funcionamiento

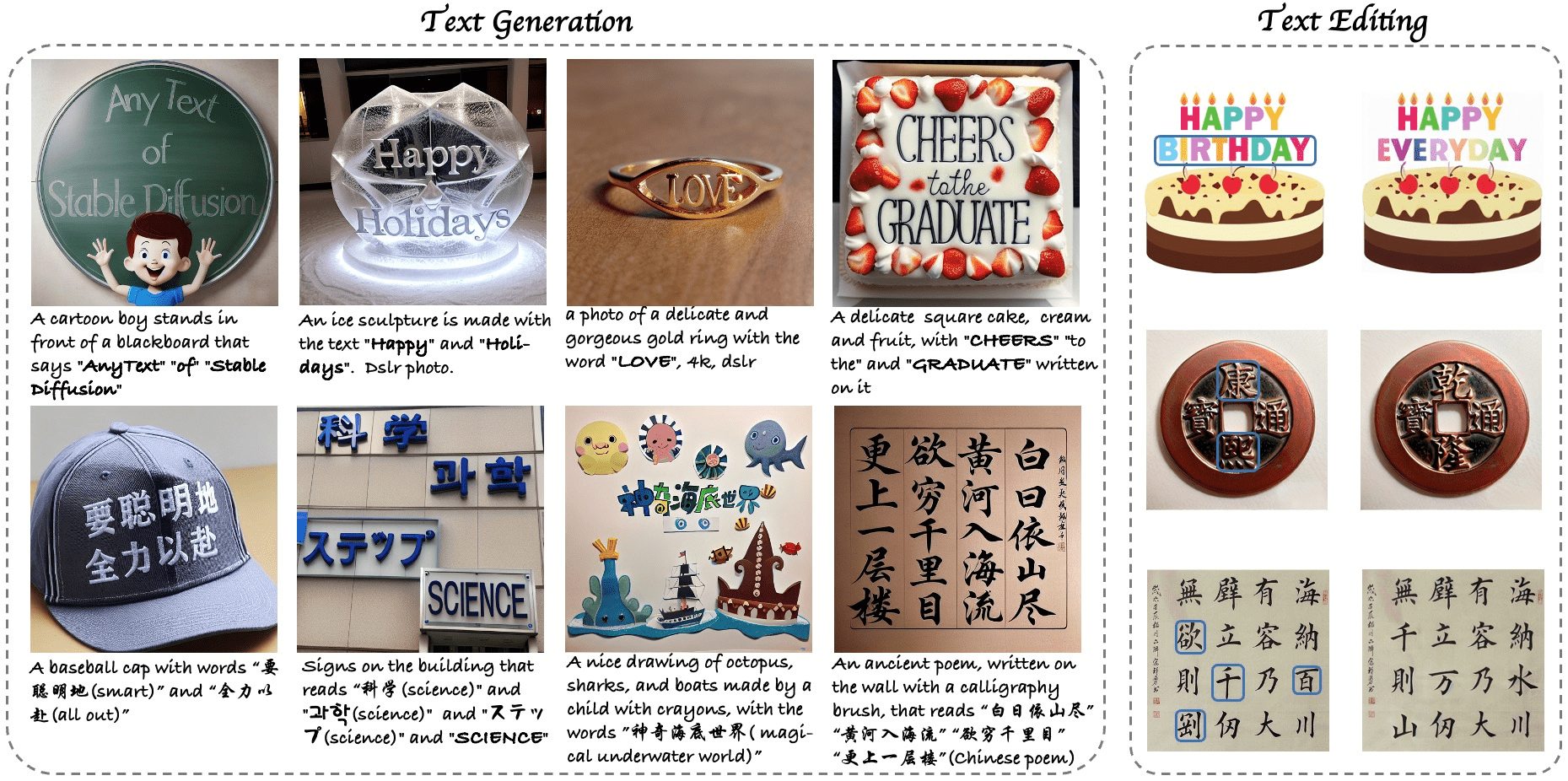

AnyText tiene dos modos de funcionamiento: generación de texto y edición de texto, cada modo proporciona una gran cantidad de ejemplos, elige uno y haz clic en [¡Ejecutar!

Por favor, tenga en cuenta que antes de ejecutar el ejemplo, asegúrese de que el área de localización dibujada a mano está vacía para evitar afectar a los resultados del ejemplo, además, diferentes ejemplos utilizan diferentes parámetros (como la resolución, el número de semillas, etc.), si desea generar el suyo propio, por favor, preste atención a los cambios de parámetros, o actualice la página para volver a los parámetros por defecto.

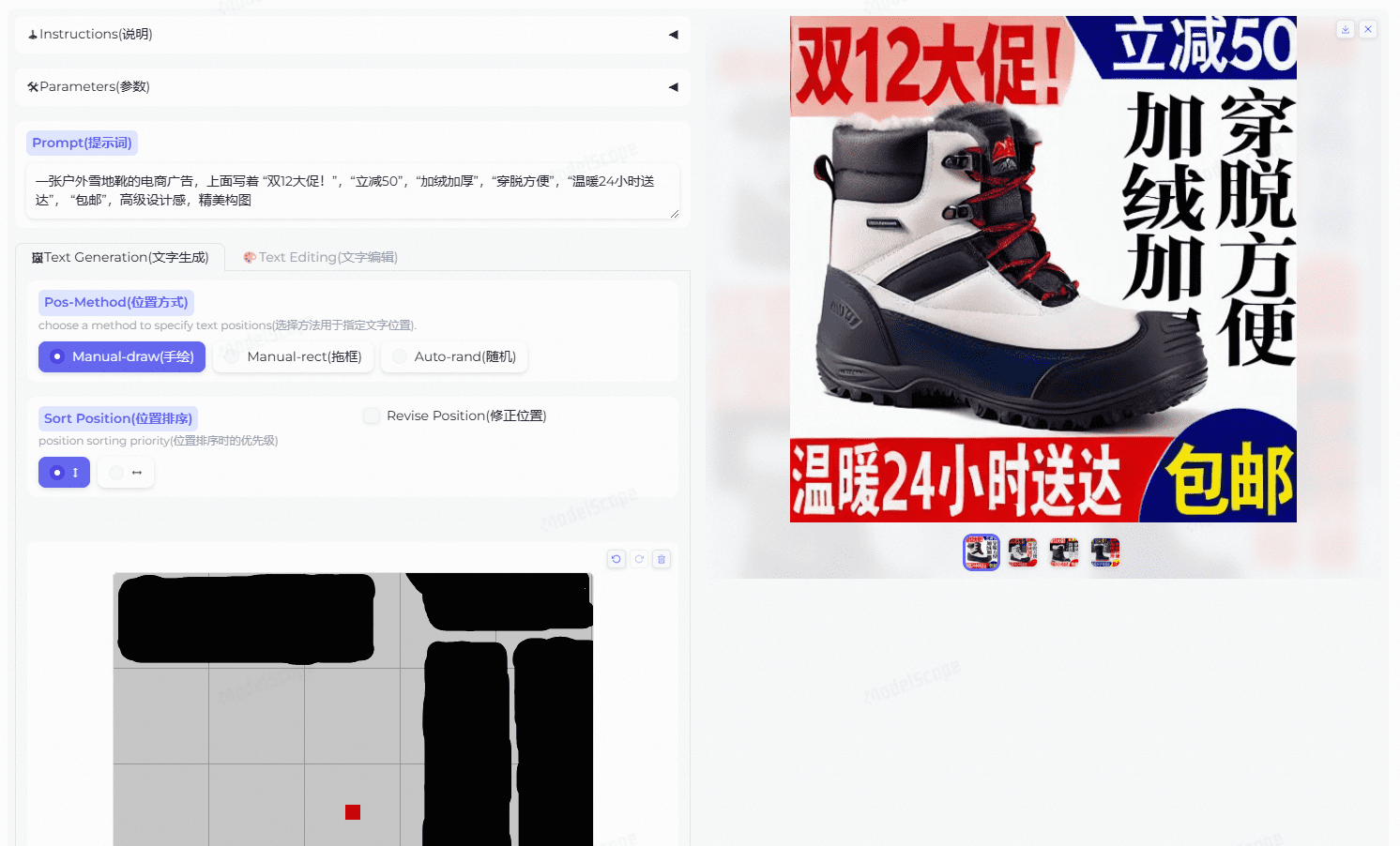

Generación de texto

En el Prompt para introducir la descripción de la palabra de aviso (soporte para chino e Inglés), la necesidad de generar cada línea de texto envuelto entre comillas dobles, y luego secuencialmente dibujado a mano para especificar la ubicación de cada línea de texto para generar imágenes. El dibujo de la posición del texto es muy crítico para la calidad de la imagen, por favor no dibuje demasiado al azar o demasiado pequeño, el número de posiciones debe ser el mismo que el número de líneas de texto, el tamaño de cada posición debe coincidir con la longitud o anchura de la línea de texto correspondiente en la medida de lo posible. Si no puede dibujar a mano (Manual-draw), puede intentar arrastrar el rectángulo de la caja (Manual-rect) o la generación aleatoria (Auto-rand).

Cuando se generan varias líneas, cada posición se ordena según ciertas reglas para que se corresponda con la línea de texto, y la opción Ordenar posición se utiliza para determinar si la prioridad de ordenación es de arriba a abajo o de izquierda a derecha. Puede activar la opción Mostrar depuración en la configuración de parámetros para observar la posición del texto y los glifos en la imagen resultante. También puede marcarse la opción Revisar posición, que utilizará el rectángulo exterior del texto renderizado como posición corregida, aunque ocasionalmente se ha observado que el texto generado de esta forma es ligeramente menos creativo.

corrector de textos

Por favor, cargue una imagen a editar como imagen de referencia (Ref), después de ajustar el tamaño del trazo, pinte la posición a editar en la imagen de referencia, e introduzca las palabras del prompt de descripción y el contenido del texto a modificar en el Prompt para generar la imagen.

La imagen de referencia puede tener cualquier resolución, pero el procesamiento interno restringe el lado largo a no más de 768, y la anchura y la altura se escalan a un múltiplo entero de 64.

© declaración de copyright

Derechos de autor del artículo Círculo de intercambio de inteligencia artificial Todos, por favor no reproducir sin permiso.

Artículos relacionados

Sin comentarios...