Seeduplex - 字节跳动Seed团队发布原生全双工语音大模型

Seeduplex是什么

Seeduplex是字节跳动Seed团队发布原生全双工语音大模型,已全量上线豆包App。区别于传统"听完再说"的半双工模式,Seeduplex实现真正的"边听边说",支持实时打断与多轮对话。采用端到端统一架构,通过语义级干扰抑制和动态判停技术,将误回复率和误打断率降低50%,抢话比例减少40%,延迟控制在165毫秒以内。模型能精准区分用户语音与背景噪音(如导航、电视声),大幅提升复杂场景下的对话流畅度,是业界首个规模化落地的全双工语音AI。

Seeduplex的功能特色

- 原生全双工语音交互:突破传统"听完再说"的半双工模式,实现真正的"边听边说"。模型可在生成回应的同时持续监听用户语音,支持实时打断、纠正与多轮自然对话,延迟控制在约165毫秒。

- 精准语义级抗干扰 :具备持续环境感知能力,能区分用户对话与背景噪音(如导航语音、电视声、旁人说话)。通过联合声学特征与语义理解进行过滤,复杂场景下误回复率和误打断率减少50%。

- 智能动态判停 :融合语音特征与语义特征判断用户意图,准确区分"思考停顿"与"发言结束"。抢话比例下降40%,判停延迟降低约250毫秒,判停准确率提升8%。

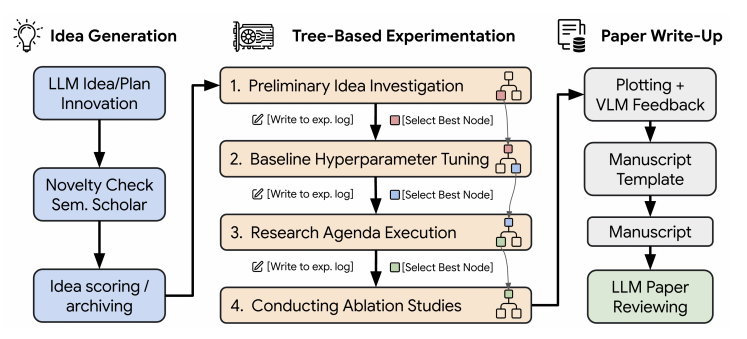

- 端到端统一架构 :摒弃传统"ASR→LLM→TTS"三段式流水线,采用语音语义联合建模的端到端方案。以20ms帧为单位实时处理音频流,实现声学特征(语调、节奏)与语义理解的深度融合。

- 规模化落地能力 :已全量上线豆包App(选择"桃子"音色即可体验),支持亿级用户并发。大规模A/B实验显示,对话流畅度MOS分提升12%,用户满意度提升8.34%。

Seeduplex的核心优势

- 业界首个原生全双工架构 :突破传统"轮流发言"的半双工限制,实现真正意义上的"边听边说"。不同于GPT-4o Voice等竞品的半双工模式,Seeduplex采用原生全双工设计,支持实时打断与无缝多轮对话,总往返延迟仅165ms,远低于300ms的自然对话感知阈值。

- 语义级环境感知与抗干扰 :通过联合声学特征与语义理解,精准区分用户语音与背景噪音(导航、电视、旁人说话等)。相比传统仅依赖声学过滤的方案,复杂场景下误回复率和误打断率减少50%,实现真正的"智能倾听"。

- 精准动态意图判停 :融合语音特征(停顿、语调)与语义特征综合判断用户发言状态,准确识别"思考停顿"与"发言结束"。抢话比例下降40%,判停延迟降低约250ms,判停准确率提升8%,对话流畅度MOS分提升12%。

- 端到端统一建模 :摒弃传统的"语音识别→大模型→语音合成"三段式流水线,采用端到端统一模型架构。以20ms帧为单位流式处理音频,实现声学特征与语义理解的深度融合,避免级联误差累积。

- 规模化商业落地能力 :作为业界首个实现规模化部署的全双工语音AI,已全量上线豆包App并服务亿级用户。大规模A/B实验验证:用户通话满意度绝对值提升8.34%,通话时长和留存等核心指标均显著正向提升。

使用Seeduplex的操作步骤

- 下载并打开豆包 App:在应用商店下载豆包 App,或更新至最新版本确保功能已全量上线。

- 进入语音通话界面:在 App 内找到语音对话入口,进入实时语音交互模式。

- 选择"桃子"音色:在语音设置或音色选择界面,切换至"桃子"音色即可激活 Seeduplex 全双工模式(当前该音色已默认搭载 Seeduplex 模型)。

- 开始全双工对话:启用后直接发言即可体验"边听边说"的实时交互,支持随时打断、纠正和插话,模型会在你听的同时持续理解并回应。

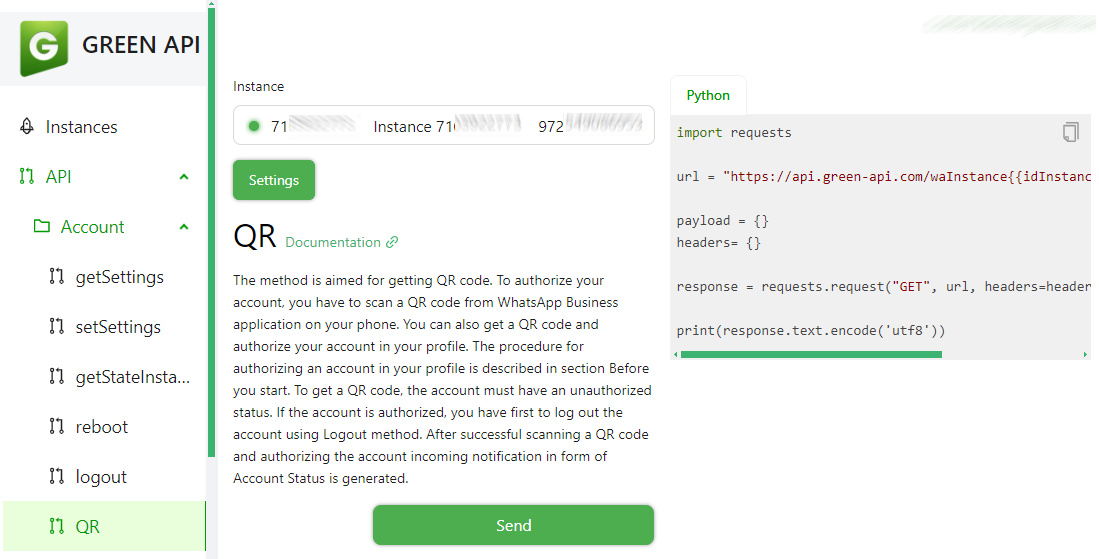

- 开发者 API 接入(可选):开发者可通过字节跳动 Seed API 调用 Seeduplex 接口,将全双工语音能力集成至自有应用或硬件设备。

Seeduplex的适用人群

- 日常高频语音交互用户:适合习惯使用语音助手查询信息、设定提醒、获取服务的普通用户,全双工模式支持随时打断和纠正,对话更贴近自然交流,无需等待机器说完才能插话。

- 驾驶及多任务场景使用者:在开车、做饭、运动等双手占用场景中,Seeduplex 的语义级抗干扰能力可精准识别指令(区分导航语音、环境噪音),实现安全高效的无接触操作。

- 视障及行动不便人士:端到端低延迟语音交互(165ms)提供更流畅的听觉反馈,精准判停减少沟通摩擦,为依赖语音作为主要交互方式的用户群体提供更无障碍的 AI 助手体验。

- 语言学习与口语练习者:支持实时打断和纠音的全双工对话模式,可模拟真实外语对话场景,帮助学习者在自然节奏中练习听说能力,获得即时反馈。

- 开发者与企业客户:可通过 Seed API 将全双工语音能力集成至智能客服、智能硬件、车载系统等行业应用,利用其规模化部署经验和亿级用户验证的稳定性快速落地产品。

- 复杂环境办公用户:在开放式办公区、家庭多成员环境等噪音场景下,语义级过滤技术能有效区分目标用户声音与背景干扰,保障远程会议、语音输入等场景的使用体验。

Seeduplex的常见问题FAQ

Q:如何体验 Seeduplex?

A:用户需下载或更新豆包 App 至最新版本,在语音对话界面选择"桃子"音色即可激活 Seeduplex 全双工模式。开发者也可通过字节跳动 Seed API 接入该能力。

Q:什么是"全双工"模式?和之前的语音助手有什么区别?

A:传统语音助手采用"半双工"(Half-Duplex)模式,类似对讲机,必须等用户说完才能处理并回应。Seeduplex 的原生全双工(Full-Duplex)架构允许模型在生成回应的同时持续监听用户语音,实现真正的实时打断和双向同时交流,延迟控制在约 165ms。

Q:Seeduplex 的响应速度如何?

A:模型总往返延迟约 165ms,远低于 300ms 的人类自然对话感知阈值。同时动态判停技术将判停延迟降低约 250ms,大幅减少"抢话"现象。

Q:Seeduplex 如何在嘈杂环境中保持精准识别?

A:模型采用语义级抗干扰技术,联合分析声学特征(语调、节奏)与语义内容,能区分用户指令与背景噪音(如导航语音、电视声、旁人说话),复杂场景下误回复率和误打断率减少 50%。

Q:Seeduplex 和 GPT-4o Voice、Gemini Live 有什么区别?

A:主要区别在于架构设计:Seeduplex 采用原生全双工架构,而 GPT-4o Voice 和 Gemini Live 主要基于半双工或有限全双工模式。Seeduplex 的语义级干扰抑制和动态判停技术在大规模用户验证中表现更优,且已实现亿级用户规模化落地。

Q:使用 Seeduplex 时如何打断 AI 说话?

A:在全双工模式下,用户无需等待 AI 说完,可直接插话、纠正或切换话题,模型会实时理解新的输入并调整回应,交互体验更接近真人对话。

Q:Seeduplex 支持哪些应用场景?

A:适用于驾驶导航、智能家居控制、办公助手、语言学习、客户服务等多场景,特别适合需要实时交互、多轮对话或嘈杂环境下的语音操作需求。

© Copyright notes

Article copyright AI Sharing Circle All, please do not reproduce without permission.

Related articles

No comments...