ViTLP: Extraktion von strukturierten Daten aus typografisch komplexen PDF-Dokumenten und visuell geführte Generierung von vortrainierten Modellen für das Textlayout

Allgemeine Einführung

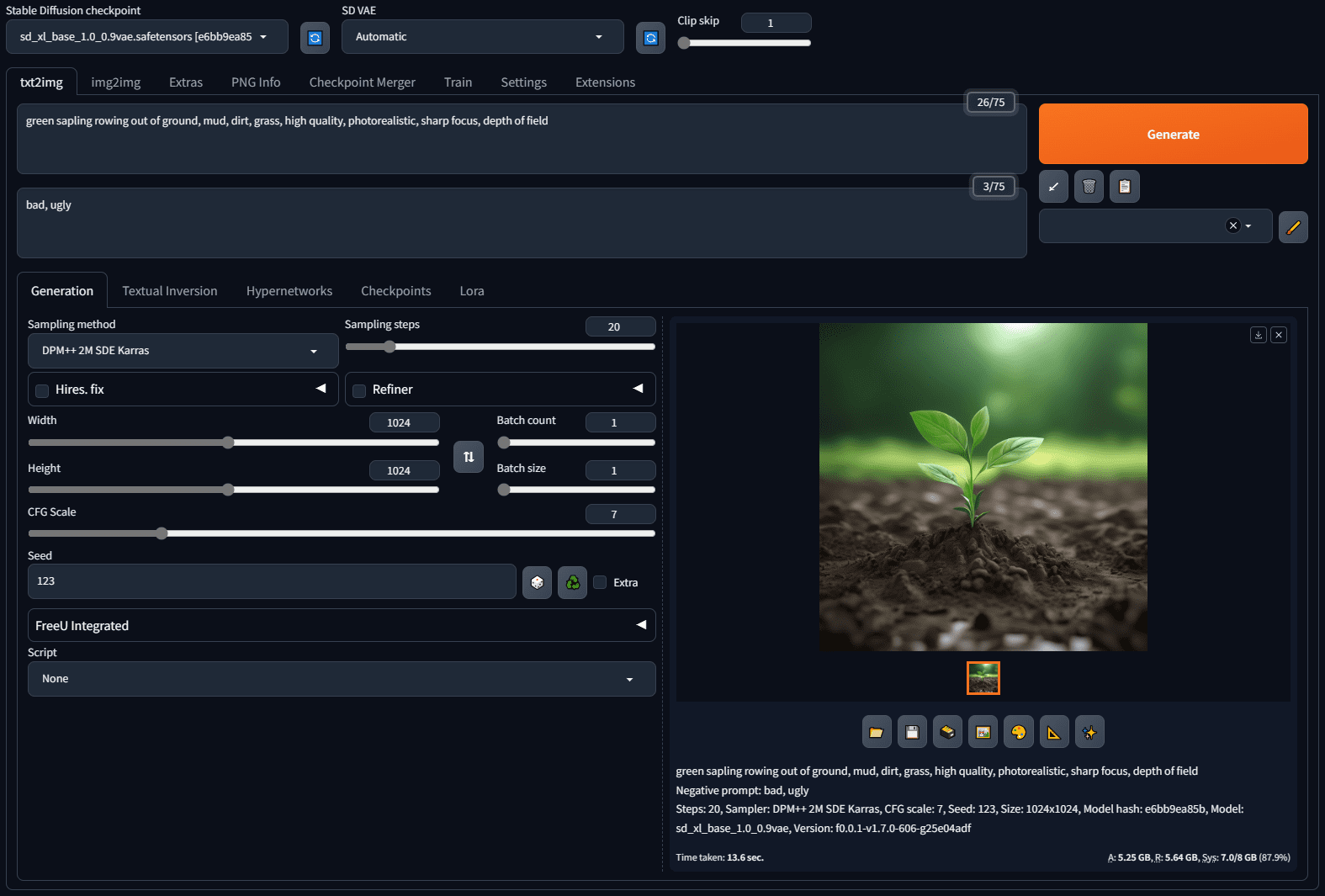

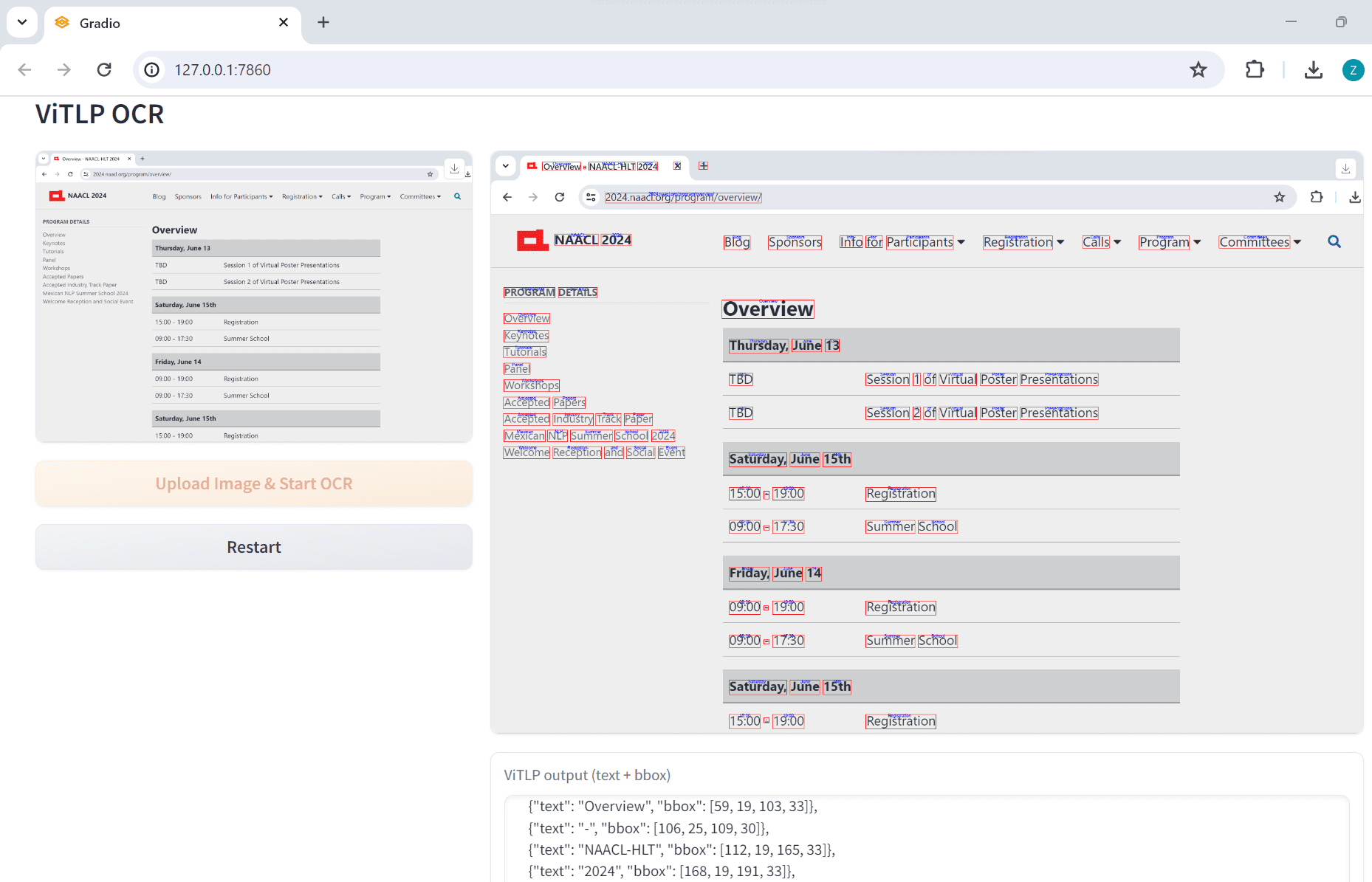

ViTLP (Visually Guided Generative Text-Layout Pre-training for Document Intelligence) ist ein Open-Source-Projekt, das darauf abzielt, die Verarbeitung von Dokumentenintelligenz durch visuell geführte generative Text-Layout-Vortrainingsmodelle zu verbessern. Das Projekt wurde vom Veason-silverbullet-Team entwickelt und auf der NAACL 2024 vorgestellt. Das ViTLP-Modell, das in der Lage ist, OCR-Text zu lokalisieren und zu erkennen, bietet vortrainierte ViTLP-medium (380M)-Kontrollpunkte, auf die Benutzer über Huggingface zugreifen können. Der Code und die Modellgewichte für das Projekt sind auf GitHub verfügbar und unterstützen die OCR-Verarbeitung von Dokumentenbildern und die Erzeugung von Textlayouts.

Funktionsliste

- OCR-Textlokalisierung und -ErkennungViTLP: Das ViTLP-Modell ermöglicht eine effiziente OCR-Textlokalisierung und -Erkennung.

- Pre-Training ModellViTLP-medium (380M) Pre-Trainings-Checkpoints werden zur Verfügung gestellt, die direkt verwendet oder vom Benutzer feinabgestimmt werden können.

- Bildverarbeitung von DokumentenUnterstützung für das Hochladen von Dokumentenbildern und OCR-Verarbeitung.

- Feinabstimmung der ModelleBereitstellung von Tools für die Feinabstimmung zur Unterstützung des späteren Trainings auf OCR- und VQA-Datensätzen.

- Werkzeuge für die DokumentenerstellungBietet Tools für die Dokumentensynthese mit Positionsfeld-Metadaten.

Hilfe verwenden

Einbauverfahren

- Klonen Sie den Code des ViTLP-Projekts:

git clone https://github.com/Veason-silverbullet/ViTLP

cd ViTLP

- Installieren Sie die Abhängigkeit:

pip install -r requirements.txt

- Download Checkpoints vor der Ausbildung:

mkdir -p ckpts/ViTLP-medium

git clone https://huggingface.co/veason/ViTLP-medium ckpts/ViTLP-medium

Verwendungsprozess

- OCR-Texterkennung::

- Führen Sie das OCR-Skript aus:

python ocr.py- Laden Sie ein Dokumentenbild hoch, und das Modell führt automatisch eine OCR-Verarbeitung durch und gibt die Ergebnisse aus.

- Feinabstimmung der Modelle::

- Beratung

./finetuningAnweisungsdatei im Verzeichnis für das anschließende Training mit dem OCR-Datensatz und dem VQA-Datensatz. - Verwenden Sie das Dokumentensynthesetool, um synthetische Dokumente mit Positionsfeld-Metadaten zu erzeugen, um das Modelltraining zu verbessern.

- Beratung

- Batch-Dekodierung::

- Verwenden Sie Batch-Dekodierungsskripte:

bash

bash decode.sh - Das Skript verarbeitet Dokumentbilder im Stapel und gibt OCR-Ergebnisse aus.

- Verwenden Sie Batch-Dekodierungsskripte:

Detaillierte Funktionsweise

- OCR-Textlokalisierung und -ErkennungNach dem Hochladen des Dokumentenbildes erkennt das Modell automatisch den Textbereich und gibt den Textinhalt und die Positionsinformationen aus.

- Feinabstimmung der ModelleBenutzer können die zur Verfügung gestellten Werkzeuge zur Feinabstimmung nutzen, um das Modell entsprechend den Anforderungen ihres Datensatzes weiter zu trainieren und die Erkennungsleistung in bestimmten Szenarien zu verbessern.

- Werkzeuge für die DokumentenerstellungGenerierung von Dokumenten mit Positionsfeld-Metadaten über ein Synthesetool, damit die Modelle das Textlayout und die Struktur während des Trainings besser verstehen.

© urheberrechtliche Erklärung

Artikel Copyright AI-Austauschkreis Alle, bitte nicht ohne Erlaubnis vervielfältigen.

Ähnliche Artikel

Keine Kommentare...