Privatemode: eine KI-Chat-App mit End-to-End-Verschlüsselung zum Schutz der Unternehmensdaten

Allgemeine Einführung

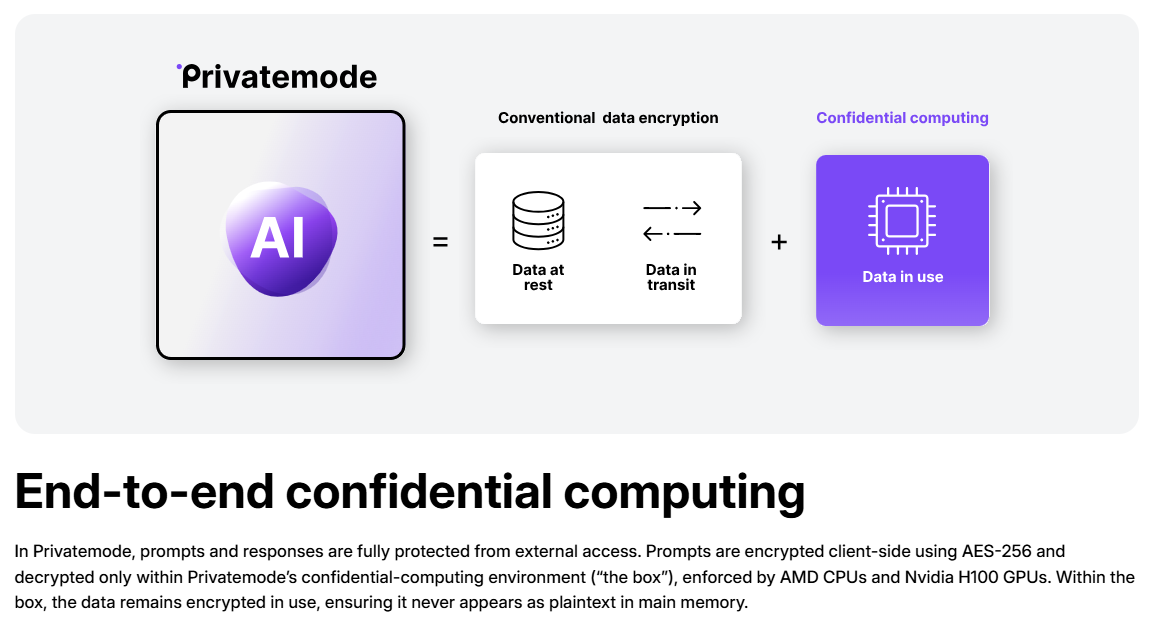

Privatemode AI ist eine generative KI-Serviceplattform, die sich auf Datenschutz und -sicherheit konzentriert. Sie wurde entwickelt, um Nutzern die Verarbeitung sensibler Daten ohne Angst vor Datenschutzverletzungen zu ermöglichen. Sie stellt sicher, dass die Daten während der Übertragung, Speicherung und Verarbeitung durch vertrauliche Computertechnologie stets verschlüsselt sind, so dass selbst Dienstanbieter keinen Zugriff auf die Nutzerdaten haben. Die Website bietet ähnliche Funktionen wie ChatGPT, konzentriert sich aber auf den Schutz der Privatsphäre und unterstützt die neuesten Open-Source-KI-Modelle sowohl für Privatpersonen als auch für Unternehmen. Der Dienst wird in den besten Rechenzentren der EU gehostet und soll in Zukunft auf weitere Regionen ausgedehnt werden. Ob es um die Erstellung von Inhalten oder die Analyse von Dokumenten geht, Privatemode bietet effiziente Unterstützung unter Wahrung des Datenschutzes und eignet sich besonders für Branchen, die sensible Informationen verarbeiten müssen, wie das Gesundheitswesen, der Finanzsektor und der öffentliche Sektor.

Funktionsliste

- Ende-zu-Ende-DatenverschlüsselungDaten werden vom Zeitpunkt der Übertragung vom Gerät bis zur Verarbeitung verschlüsselt, um Datenschutz und Sicherheit zu gewährleisten.

- Vertrauliche Unterstützung bei der DatenverarbeitungVerschlüsselung auf Hardwareebene, um zu verhindern, dass KI-Modelle oder die Infrastruktur auf Nutzerdaten zugreifen.

- Integration von Open-Source-KI-ModellenUnterstützung der neuesten Open-Source-Modelle für große Sprachen, wie z. B. die Llama-Serie von Meta, die von den Benutzern verwendet werden können.

- Chat-App im PrivatmodusBietet Desktop-Chat-Tools, die Windows und macOS unterstützen, für die tägliche Interaktion.

- API-DiensteUnterstützung von Entwicklern bei der Erstellung von datenschutzfreundlichen KI-Anwendungen durch API-Integration in Benutzerprojekte.

- Dokumentenanalyse und Inhaltserstellung:: Sichere Verarbeitung von Dokumenten und Erstellung von Texten für Geschäftsszenarien.

- Dienst-Validierung:: Überprüfung der Integrität des Back-End-Dienstes durch von der Hardware ausgestellte kryptografische Zertifikate.

Hilfe verwenden

Installations- und Nutzungsprozess

Privatemode AI kann auf zwei Arten genutzt werden: entweder über die Privatemode Chat-App auf dem Desktop oder über die API-Integration in Ihre eigenen Projekte. Im Folgenden finden Sie eine detaillierte Anleitung:

1. die Installation und Nutzung der Chat-Anwendung Privatemode

Installationsschritte:

- Apps herunterladenBesuchen Sie die offizielle Website und finden Sie den Download-Link "Privatemode Chat" auf der Homepage, die Windows- und macOS-Systeme unterstützt. Klicken Sie auf die Download-Schaltfläche des entsprechenden Systems, um das Installationspaket zu erhalten.

- Installationsvorgang:

- Windows-Benutzer: Doppelklicken Sie auf die heruntergeladene

.exeDatei, klicken Sie auf "Weiter" und wählen Sie den Installationspfad, um die Installation abzuschließen. - macOS-Benutzer: Öffnen Sie die heruntergeladene

.dmgZiehen Sie die App in den Ordner "Apps". Möglicherweise müssen Sie Apps "von unbekannten Entwicklern" beim Start zulassen (überprüfen Sie dies unter "Systemeinstellungen - Sicherheit & Datenschutz"). Ziehen Sie die App in den Ordner "Apps" und legen Sie sie dort ab.

- Windows-Benutzer: Doppelklicken Sie auf die heruntergeladene

- ErsteinführungNachdem die Installation abgeschlossen ist und Sie die App öffnen, werden Sie aufgefordert, Ihren API-Schlüssel einzugeben. Sie müssen Ihr Konto auf der offiziellen Website registrieren und den Schlüssel erhalten (siehe Abschnitt "API-Schlüssel erhalten" unten). Geben Sie den Schlüssel ein und klicken Sie auf "Überprüfen", um die Hauptschnittstelle zu öffnen.

Funktion Betrieb:

- Chat-InteraktionDie Hauptschnittstelle ähnelt einem herkömmlichen Chat-Tool, mit einer Dialogliste auf der linken Seite und einem Eingabefeld auf der rechten Seite. Geben Sie eine Frage oder einen Befehl in das Eingabefeld ein, z. B. "Schreiben Sie mir eine E-Mail" oder "Analysieren Sie diesen Bericht", klicken Sie auf "Senden" und die KI liefert das Ergebnis innerhalb weniger Sekunden.

- Ein Dokument hochladenKlicken Sie auf die Schaltfläche "Hochladen" am oberen Rand der Schnittstelle, unterstützt PDF, TXT und andere Formate, nach dem Hochladen, können Sie Befehle wie "Fassen Sie den Inhalt des Dokuments", AI wird auf der Grundlage der verschlüsselten Dokument Verarbeitung und Ergebnisse zurück.

- Sprachliche UnterstützungMehrsprachige Eingabe wird standardmäßig unterstützt, Sie können eine Frage direkt auf Chinesisch stellen, z.B. "Antworte mir auf Deutsch", AI schaltet die Sprachausgabe um.

2. die Installation und Nutzung der API

Installationsschritte:

- API-Schlüssel abrufenNach der Registrierung eines Kontos auf der offiziellen Website loggen Sie sich ein und gehen auf die Seite "Entwickler", klicken auf "API-Schlüssel generieren", kopieren den Schlüssel und speichern ihn.

- Installation des ProxysDie Privatemode-API muss über einen Proxy (Privatemode-Proxy) laufen, um eine verschlüsselte Kommunikation zu ermöglichen. Eine Docker-Installation wird empfohlen:

- Vergewissern Sie sich, dass Sie Docker auf Ihrem System installiert haben (herunterladbar von docker.com).

- Öffnen Sie ein Terminal und führen Sie den folgenden Befehl aus, um den Agenten zu starten:

docker run -p 8080:8080 ghcr.io/edgelesssys/privatemode/privatemode-proxy:latest --apiKey <你的API密钥> - Wenn der Agent startet, lauscht er standardmäßig auf dem lokalen Port 8080, der über die Option

localhost:8080Zugang.

Betrieb der API-Funktion:

- Anfrage sendenVerwenden Sie eine Programmiersprache (z.B. Python), um die API aufzurufen. Nehmen Sie Chat als Beispiel, der Beispielcode lautet wie folgt:

import requests url = "http://localhost:8080/v1/chat/completions" headers = {"Content-Type": "application/json"} data = { "model": "ibnzterrell/Meta-Llama-3.3-70B-Instruct-AWQ-INT4", "messages": [{"role": "user", "content": "你好,请介绍一下自己"}] } response = requests.post(url, headers=headers, json=data) print(response.json())Das Rückgabeergebnis enthält die Antwort der KI, und die Daten werden durchgehend verschlüsselt übertragen.

- Auswahl des Modells: In

dataÄnderung"model"Felder, um zwischen verschiedenen Open-Source-Modellen zu wechseln. Die Liste der unterstützten Modelle kann in der offiziellen Website-Dokumentation eingesehen werden. - Erweiterte FunktionenUnterstützung der Dateianalyse beim Hochladen: Sie müssen die Datei in Base64-Kodierung umwandeln und dann an die Anfrage anhängen. Die spezifische Methode finden Sie auf der offiziellen Website "API-Dokumentation".

3. die Bedienung der Sonderfunktionen

- Datenschutz-ÜberprüfungJedes Mal, wenn der Dienst genutzt wird, überprüft der Agent automatisch die Integrität des Backends (über ein Hardware-Verschlüsselungszertifikat). Wenn die Überprüfung fehlschlägt, zeigt die Schnittstelle oder API an, dass der Dienst nicht vertrauenswürdig ist, um die Datensicherheit zu gewährleisten.

- DateiverarbeitungNach dem Hochladen eines Dokuments in der Chat-App können Sie detaillierte Anweisungen eingeben, z. B. "Extrahiere Schlüsseldaten aus dem Dokument und erstelle eine Tabelle", und die KI erledigt die Aufgabe auf datengeschützte Weise.

/v1/documentEndpunkte implementieren ähnliche Funktionen. - Unterstützung mehrerer SprachenGeben Sie "Bitte antworten Sie auf Chinesisch" oder "Bitte generieren Sie Inhalte auf Deutsch" ein, und die KI passt die Ausgabesprache entsprechend dem Befehl an, so dass sie für die Internationalisierung geeignet ist.

Tipps und Vorsichtsmaßnahmen

- NetzanforderungVergewissern Sie sich, dass das Gerät mit einem stabilen Netzwerk verbunden ist, und schließen Sie das Terminalfenster nicht, während der Agent ausgeführt wird, da sonst der API-Dienst unterbrochen wird.

- SchlüsselverwaltungDer API-Schlüssel ist die einzige Zugangsberechtigung zum Dienst, geben Sie ihn nicht an andere weiter. Wenn Sie den Verdacht haben, dass er weitergegeben wurde, können Sie ihn auf der offiziellen Website neu generieren.

- LeistungsoptimierungWenn die Verarbeitung großer Dateien oder komplexer Aufgaben langsam ist, versuchen Sie es mit einem Quantisierungsmodell (z. B. AWQ-INT4), das Sie einfach in der API-Anfrage angeben.

Mit diesen Schritten können Benutzer schnell mit Privatemode AI beginnen und die leistungsstarken Datenschutz- und KI-Funktionen für tägliche Aufgaben oder Entwicklungsprojekte nutzen.

© urheberrechtliche Erklärung

Artikel Copyright AI-Austauschkreis Alle, bitte nicht ohne Erlaubnis vervielfältigen.

Verwandte Beiträge

Keine Kommentare...