OneCAT - Modelo multimodal de código aberto para a Meituan e a Shanghai Jiaotong University

O que é o OneCAT

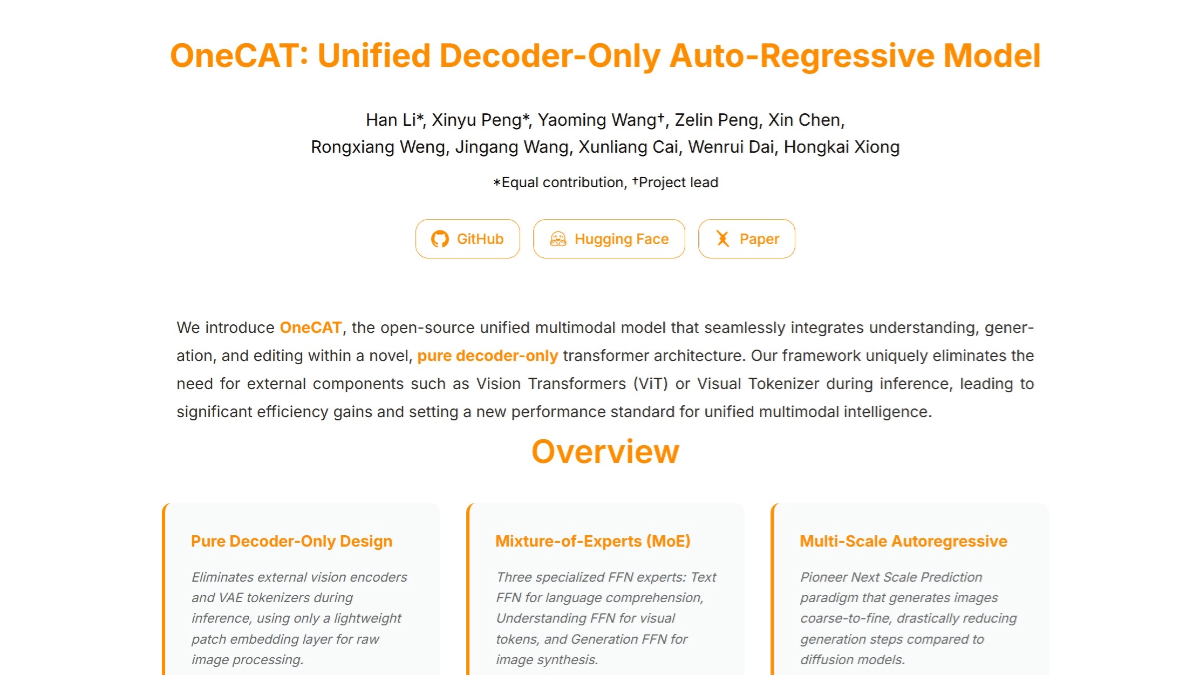

O OneCAT é um novo modelo multimodal unificado lançado pela Meituan em colaboração com a Shanghai Jiaotong University, que adota uma arquitetura de decodificador puro e pode integrar perfeitamente a compreensão multimodal, a geração de texto para imagem e as funções de edição de imagem. O modelo abandona o design dos modelos multimodais tradicionais que dependem de codificadores e desambiguadores visuais externos e obtém um processamento multimodal eficiente por meio de uma arquitetura MoE (Mixed of Experts) específica da modalidade e um mecanismo autorregressivo em várias escalas. Os principais pontos fortes do OneCAT estão em sua arquitetura concisa e na eficiência de inferência significativamente aprimorada, especialmente ao lidar com entradas e saídas de imagens de alta resolução. Ele aprimora ainda mais os recursos de geração visual e o alinhamento multimodal por meio de adaptadores inovadores com reconhecimento de escala e mecanismos de atenção multifuncional multimodal. O OneCAT demonstrou excelente desempenho em vários testes de benchmark para compreensão multimodal, geração de texto para imagem e edição de imagens, estabelecendo um novo padrão para o desenvolvimento de inteligência multimodal unificada.

Recursos do OneCAT

- Processamento multimodal eficienteA arquitetura de decodificador puro, que elimina a necessidade de codificadores visuais externos ou divisores de palavras, simplifica significativamente a estrutura do modelo e reduz a sobrecarga computacional, especialmente ao processar entradas de alta resolução.

- Recursos geradores avançadosO mecanismo multiescala autorregressivo pode gerar gradualmente imagens de alta qualidade de forma grosseira a fina, o que é adequado para geração de texto para imagem e tarefas de edição de imagem com excelentes resultados de geração.

- Edição flexível de imagensSuporte à edição de imagens baseada em comandos, com ajustes locais e globais precisos nas imagens com base nos comandos do usuário, permitindo recursos avançados de geração condicional sem modificações adicionais na arquitetura.

- Capacidade de alinhamento multimodalDescrição: Alinhamento aprimorado entre diferentes modalidades e melhor desempenho do modelo em tarefas multimodais por meio de estruturas Mixing of Experts (MoE) específicas da modalidade e camadas compartilhadas de QKV e atenção.

- Suporte à resolução dinâmicaSuporte nativo para resolução dinâmica, capaz de se adaptar a diferentes tamanhos de entradas, o que melhora a flexibilidade e a aplicabilidade do modelo.

Principais benefícios do OneCAT

- Arquitetura simples e eficienteO uso de uma arquitetura de decodificador puro sem a necessidade de um codificador visual externo ou divisor de palavras, a estrutura do modelo é significativamente simplificada, a sobrecarga computacional é reduzida e a eficiência da inferência é significativamente aprimorada, especialmente ao lidar com entradas de alta resolução.

- Forte capacidade de fusão multimodalO sistema de fusão de especialistas (Mixing of Experts, MoE), por meio da estrutura de mistura de especialistas específica da modalidade, pode processar perfeitamente textos, imagens e outros dados multimodais para obter funções eficientes de compreensão, geração e edição multimodais, o que aumenta a profundidade e a eficiência da fusão de informações multimodais.

- Excelente desempenho de geraçãoO que é: A introdução inovadora de um mecanismo autorregressivo visual em várias escalas para gerar imagens de forma incremental, de maneira grosseira a fina, reduz drasticamente o número de etapas de decodificação, mantendo resultados visuais de alta qualidade, e demonstra um desempenho robusto na geração de texto para imagem e em tarefas de edição de imagens.

- Forte aderência ao comandoDesempenho: demonstra excelente aderência aos comandos em tarefas de geração e edição multimodais, compreende e executa com precisão os comandos do usuário e gera conteúdo de imagem compatível que aprimora a experiência do usuário.

- Suporte à resolução dinâmicaSuporte nativo para resolução dinâmica e capacidade de adaptação a entradas de diferentes tamanhos, o que aumenta a flexibilidade e a aplicabilidade do modelo a uma ampla gama de cenários de aplicação.

Qual é o site oficial do OneCAT?

- Site do projeto:: https://onecat-ai.github.io/

- Repositório do Github:: https://github.com/onecat-ai/onecat

- Biblioteca do modelo HuggingFace:: https://huggingface.co/onecat-ai/OneCAT-3B

- Artigo técnico do arXiv:: https://arxiv.org/pdf/2509.03498

Para quem é o OneCAT

- Pesquisadores de inteligência artificialO OneCAT, como um novo modelo multimodal, oferece aos pesquisadores novas direções de pesquisa e plataformas experimentais que podem ser usadas para explorar tecnologias de ponta para compreensão, geração e edição multimodais.

- Cientistas e engenheiros de dadosEm projetos que precisam lidar com dados multimodais, o OneCAT pode ajudá-los a implementar rapidamente funções como geração de texto para imagem, edição de imagens etc. para aumentar a eficiência do desenvolvimento.

- Designers e artistas criativosOneCAT: O OneCAT gera imagens de alta qualidade com base em descrições de texto, fornecendo inspiração e material para design criativo e trabalho artístico, ajudando-os a concretizar ideias criativas rapidamente.

- educadorNo campo da educação, o OneCAT pode gerar imagens relacionadas ao conteúdo de ensino para ajudar os alunos a entender e memorizar melhor o conhecimento e enriquecer os recursos de ensino.

- Criadores de conteúdo e profissionais de mídiaOneCAT: O OneCAT pode ser usado para gerar e editar conteúdo de imagem para ajudar na criação de anúncios, vídeos, conteúdo de mídia social e muito mais, melhorando a eficiência e a qualidade da criação de conteúdo.

© declaração de direitos autorais

Direitos autorais do artigo Círculo de compartilhamento de IA A todos, favor não reproduzir sem permissão.

Artigos relacionados

Nenhum comentário...